多光谱图像融合的IC 器件表面缺陷检测

邓耀华,黄志海

(广东工业大学 机电工程学院,广东 广州 510006)

1 引言

IC 器件为现代技术和工业的发展做出了不可或缺的贡献[1]。塑封IC 器件因其小尺寸、低成本、高性能的优势,成为IC 行业的宠儿。然而,塑封为非气密性封装,封装过程十分复杂,在实际塑封过程中某环节稍有差错,就会诱发各类表面缺陷,对IC 器件的可靠性和使用寿命构成严重威胁[2]。根据形成原因和特点,缺陷可分为划痕、异物、凹坑和崩边四类[3]。缺陷特征表现出低对比度、形状各异等复杂特性,导致检测环境光照不稳定,IC 器件的缺陷漏检率一直高居不下[4]。

目前在电子工业缺陷检测中,大部分视觉检测方法仅关注RGB、红外图像或其他单一成像形式的输入。Chao 等[5]提出了一种以单RGB图像输入的图像特征和多级图像分割的IC 器件表面缺陷检测方法,但因缺陷特征复杂,光照不均匀,通常会产生不同的图像对比度,仅仅依赖RGB 图像很难将缺陷和背景区分开来。张稼等[6]提出了一种基于线激光锁相热成像的多通道数字集成芯片表面缺陷检测方法,将外部热激励源应用于目标,采用主成分分析法提取缺陷特征,实现芯片缺陷检测。但温度分布差异是红外热成像缺陷检测的重要前提,因此,温度差异不明显的缺陷常常淹没在红外图像中。近年来,基于多光谱图像融合的表面缺陷检测广泛应用于IC 领域,Cong 等[7]提出基于轮廓线主方向的印刷电路板缺陷锁相热成像与可见光图像配准融合方法,有效地增强缺陷特征,实现了光热融合检测。Li 等[8]提出一种基于可见光和热红外光谱中偏振信息融合的印刷电路缺陷检测方法,其检测平均精度优于最先进的AOI 光学检测系统。

图像配准是进行高质量图像融合的重要前提。在基于点特征的图像配准中,可见光与红外图像因尺度不一致和对比度反转所造成的图像间差异大,特征相似性低是图像配准的难点。针对这一难点,江泽涛等[9]通过构建高斯金字塔来解决 ORB(Oriented FAST and Rotated BRIEF)算法的尺度不变性问题,改善了原算法在图像尺度不一致时误匹配率高的缺陷,但高斯金字塔尺度会导致空间边缘弱化,图像细节丢失。徐海洋等[10]利用相位一致性提取ORB特征点描述符相似性高的稳定边缘结构,改善了可见光与红外图像对比度反转带来的差异性,提高了配准精度。

多尺度变换的图像融合框架广泛应用在已配准的可见光与红外图像融合中。非下采样剪切波变换(Non-Subsample Shearlet Transform,NSST)具有平移不变性,避免了伪吉布斯现象,在图像融合领域展现出良好的性能。研究表明[11-12],NSST 能够有效提取细节纹理信息,得到高质量的融合图像。合适的融合规则同样对融合质量至关重要,传统融合规则包括加权平均法、绝大值取大和区域能量和等[13],但这些规则未能从全局上考虑区域间像素相关性,容易导致图像中重要信息丢失,图像显著特征不够突出。Li 等[14]利用显著性检测的低频融合规则,有效地解决了融合过程中亮度和细节信息丢失的问题,增强了显著特征的对比度。Zhang 等[15]利用脉冲耦合神经网络(Pulse Coupled Neural Network,PCNN)将图像全局信息联系起来,融合图像在主客观评价上有较好的效果。

上述文献表明,基于光谱动态范围较低的单一图像输入,不能同时呈现所有缺陷特征,甚至淹没了部分弱缺陷。高精度缺陷检测的重要前提是获得高质量的图像输入。鉴于IC 器件表面缺陷在不同光谱下表现出易于检测的互补特性,本文提出红外与可见光图像像素级融合的检测方法,针对IC 器件表面缺陷可见光与红外图像在配准融合中存在的尺度不一致,对比度反转和互补信息融合不充分等问题,引入图像细节信息丰富的拉普拉斯金字塔和描述符重组策略改进ORB 图像配准算法;以NSST 作为图像分解工具,构建基于视觉显著图加权(Visual Significance Map,VSM)和参数自适应脉冲耦合神经网络(PA-Pulse Coupled Neural Network,PAPCNN)的NSST 域图像融合方法(NSST_VP)。利用不同光谱下的互补特性增强缺陷特征,为后续缺陷检测提供高质量数据支撑,满足检测算法稳定性和缺陷检测精度的需求。

2 原 理

基于多光谱图像融合的IC 器件表面缺陷检测方法的总体原理框架如图1 所示。该方法主要分为图像配准模块、图像融合模块和缺陷检测模块3 部分。IC 器件的规则性和管脚区域丰富的角点特征为基于点特征进行图像配准提供了有利条件,针对可见光和红外图像配准过程中存在的尺度不一致、对比度反转等问题,在原始基于点特征的ORB 算法基础上加入拉普拉斯金字塔和特征描述符重组的策略改进ORB 算法,计算出配准参数,以红外图像为参考对可见光图像进行配准对齐。在图像已配准的基础上,为充分利用在可见光和红外图像中不同的缺陷表征能力,在NSST 域中分别设计融合包含图像不同信息的低频子带和高频子带的融合规则,以实现最大化的融合图像互补信息,通过NSST 逆变换得到高质量的融合图像。最后,将融合图像输入YOLOv8s 检测模型,得到IC 器件表面缺陷检测结果。

3 基于改进ORB 的IC 器件表面缺陷多光谱图像配准

3.1 拉普拉斯金字塔尺度空间构建

为解决在图像目标尺度不一致的场景下配准精度低的问题,在ORB 算法中构建拉普拉斯金字塔(LP)尺度空间,在金字塔的各层级提取不同尺度特征点。LP 金字塔通过计算高斯金字塔不同层之间的差异来实现,高斯金字塔为:

式中:当g=1 时,G0(x,y)为原图像,σ2为高斯核的方差。σ2的大小与图像的平滑程度成正相关,σ值越大说明图像的平滑程度越高,即图像越模糊,表示图像的高斯尺度。down()为图像的下采样操作。

LP 金字塔的每一层Ll(x,y)是由高斯金字塔相邻两层之间的差值构成的。具体公式为:

式中:Expand(Gg+1(x,y))表示对高斯金字塔的第g+1 层进行插值拓展,使它与第g层具有相同的尺寸。

3.2 IC 器件表面缺陷图像特征点判断

Fast(Features from accelerated segment test)特征点提取算法具有计算速度快、实时性好等特点,在LP 金字塔各层级上使用Fast 算法提取多尺度特征点。Fast 算法中特征点的定义是如果一个像素的灰度值远大于或小于一定范围的像素灰度值和一定数量的像素灰度值,则该点可能成为特征点。若圆上有K个连续像素Ik,以o为圆心,圆的半径由图像分辨率决定,k=1,2,…,K,判断是否为特征点的方法如下:

式中:Ik是圆上一个点的像素值,Io是点o的像素值。当CRF=1 的个数大于某个特定的固定值时,根据图像的灰度分布选择合适的阈值t,o为候选点。如图2 所示,Fast 使用快速高效的外围像素进行判断。Fast 判断图形中点o为特征点的过程如下:一个圆心为o,半径为3 个像素的圆上有16 个像素。如果有8 个连续的像素值大于Io或小于Io,则o点为特征点。

图2 特征点判断Fig.2 Feature point judgment

3.3 特征描述符构建与重组方法

特征描述是特征匹配的基础,二进制描述符的速度比SIFT[16]和SURF[17]快数十倍甚至百倍。BRIEF(Binary Robust Independent Elementary Features)算法是通过特定的方法在关键点周围选择一些点对,点对比较产生的二进制码串就是描述符。获取二进制位串的过程是比较随机点对的灰度值:

式中p(x)表示x点的像素值p。对于特征点o,其特征描述表示为基于领域内n个像素点对的n个二元特征向量:

式中:n为特征向量的长度,考虑到描述符的生成速度、分布和准确性,取n=256。

为解决BRIEF 算法不具有旋转不变性的问题,采用灰度质心法使得描述子具备旋转不变性,在一个小的图像块中得到:

根据式(6)可以得到0 阶矩m00和1 阶矩m01,m10,通过矩可以找到图像块的质心坐标:

连接图像块的几何中心O和质心C,得到一个方向向量OC,特征点方向为方向向量OC与X轴的夹角:

为了获得n位的描述,需要选择n对待测试点集,引入一个2×n矩阵Q可以定义为:

通过灰度质心法得到特征点的旋转方向θ后,求到相应的旋转矩阵Rθ,进而构造旋转匹配对矩阵Qθ:

旋转不变性描述符(Rotated BRIEF,rBRIEF)为:

为解决可见光与红外图像配准中存在的对比度反转问题,引入描述符重组策略,使θ=θ+θr,θr为反转角。经实验规律找出反转角θr=π,则重组后的旋转不变性描述符为:

描述符距离表示两个特征点之间的相似程度,因rBRIEF 描述符是二进制的,使用汉明距离作为相似性度量,相比于其他的相似性度量方式大大提高了计算效率,同时也降低了内存消耗。两个二进制字符串之间的汉明距离指的是不同数字的个数。对于可见光图像中任意一个特征点,在红外图像汉明距离最小的特征点,认为这两个特征点是匹配的。最后,通过RANSAC 算法过滤误匹配特征点对,根据正确匹配的特征点对求得正确匹配点对之间的配准参数矩阵。

4 基于NSST_VP 的IC 器件表面缺陷多光谱图像融合

为了突出IC 器件表面缺陷的显著特征,以NSST 为图像分解工具,引入视觉显著图构建融合权重矩阵指导低频子带融合;同时,为了增强IC 器件表面缺陷边缘细节特征,统筹图像像素全局相关性,采用参数自适应脉冲耦合神经网络融合高频子带,最后通过NSST 逆变换得到融合图像。

NSST_VP 图像融合原理框架如图3 所示。为了充分提取红外与可见光图像的细节信息,选用NSST 作为融合算法的图像分解与细节信息提取工具,NSST 通过把标准的剪切波滤波器从伪极化坐标系统映射到笛卡尔坐标系统,再通过傅里叶变换证明其操作可以通过二维卷积完成,避免下采样操作,从而具备平移不变性。为了方便表述,定义TNSST()为NSST 函数,其变换表达式为:

图3 NSST_VP 图像融合原理框架Fig.3 Framework of NSST_VP image fusion principle

式中:ID为待分解图像,GD,b和GD,h,t,s分别为待分解图像的低频和高频子带,D∈{R,V},t,s分别为分解尺度与方向,T,St分别为分解的最大尺度与其对应方向数,{GD,b,GD,h,t,s,t=1,2,…,T;s=1,2,…,St}为待分解图像各尺度不同方向的分解系数集合。通过式(13)分解的红外图像高频子带和低频子带分别为GR,h,t,s,GR,b,分解的可见光图像高频子带和低频子带分别为GV,h,t,s,GV,b。

图像的低频子带反映图像中的较慢变化和较大尺度的特征,包含红外与可见光图像的全局信息,决定了融合图像的亮度和对比度,采用视觉显著图(VSM)加权融合[18]规则对低频子带部分进行融合。通过计算可见光或红外图像某一像素p的灰度值gp和其他像素灰度值q的差值,获得可见光或红外图像像素p的显著值:

式中:q为其他像素灰度值,Mq为灰度值为q的像素个数,G为灰度级(灰度图像为 256)。通过标准化,显著值取值为[0,1]。

由式(14)得出红外图像和可见光图像的显著值,分别为VR和VV,则可以计算得到低频子带的融合权重:

在获得融合权重的情况下,低频融合规则为:

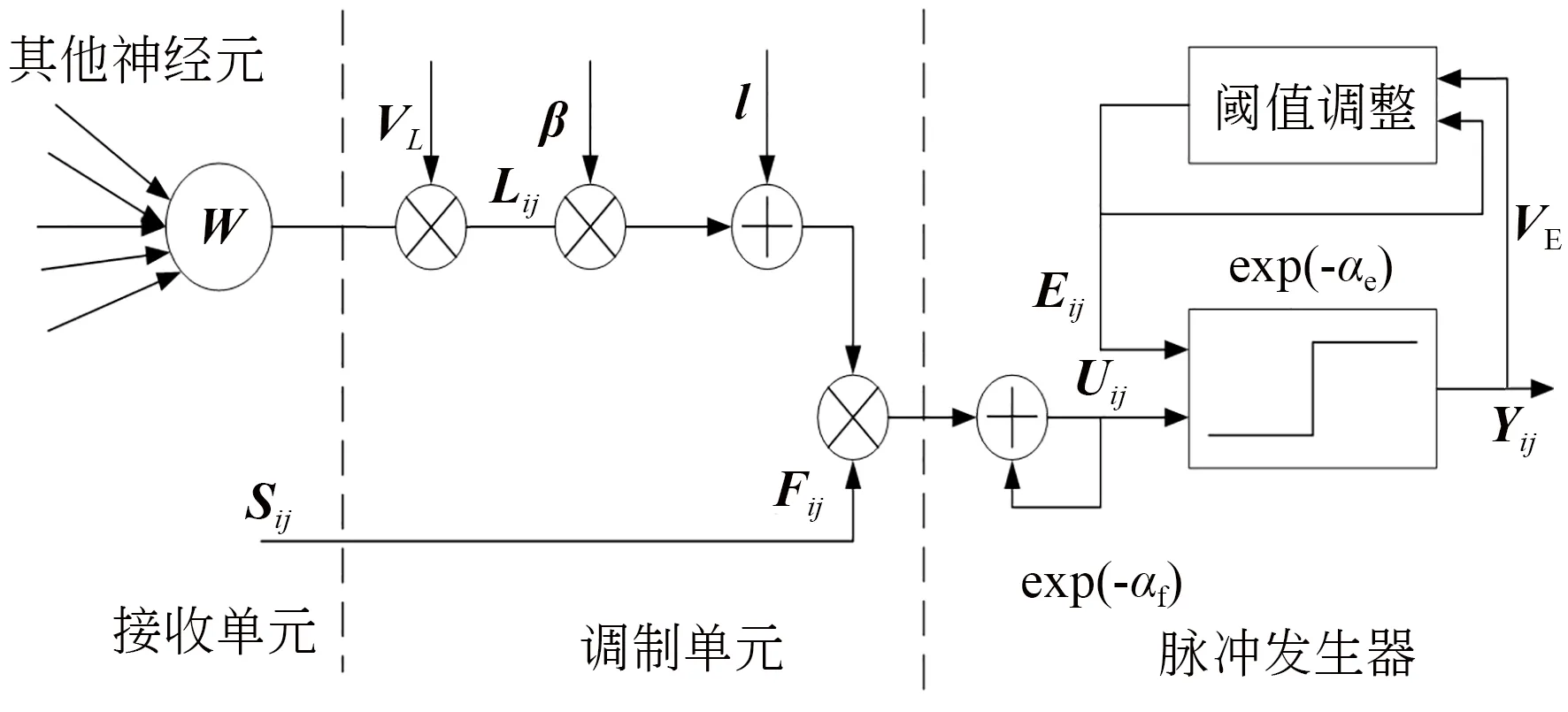

图像高频子带反映了图像中的细节和局部变化信息,为增强图像边缘细节特征,统筹图像像素全局相关性,采用PA-PCNN 决策融合规则对高频子带进行融合。PCNN[19]是一个由若干神经元相互链接组成的反馈网络,反馈网络中的每个神经元由接收单元、调制单元和脉冲发生器3 部分组成。简化的PCNN 数学模型如下:

式中:Sij为(i,j) 位置上的输入图像,Fij(n) 和Lij(n)分别为第n次迭代中(i,j)位置上神经元的反馈输入和链接输入,VL为链接输入的振幅增益,为链接权重矩阵,M×N为链接域范围,Uij(n)为神经元内部活动项,β为神经元的内部活动链接系数,Eij(n)为动态阈值,Yij(n)为神经元的脉冲输出,VE为动态阈值函数的幅度系数,αf和αe分别为反馈输入和动态阈值的时间衰减系数。

PCNN 模型性能取决于参数的设置,即αf,β,VL,αe和VE。为减少手动设置参数的个数,令λ=βVL表征加权链接强度,构建自适应脉冲耦合神经网络模型(PA-PCNN),其神经元结构如图4 所示,自适应计算过程为:

图4 PA-PCNN 模型神经元结构Fig.4 PA-PCNN model neuron structure

式中:σ(S)为图像S的标准差;S'和Smax分别为输入图像的归一化像素阈值和图像的最大像素值。

PA-PCNN 中的各个神经元会根据上述原理来判断输入信号的情况,决定是否点火。点火是指受到激发的神经元在Uij(n)>Eij(n-1)的条件下,触发一个脉冲输出。图像纹理信息丰富的高频子带GR,t,h,s和GV,t,h,s,对PA-PCNN设定点火进行计数,根据总次数来融合高频子带。

定义Txy(n)为GD,t,h,s在(x,y)处的点火次数:

设初值Txy(0)=0,则红外图像和可见光图像的高频子带在(x,y)处的点火次数分别记为TR,xy(n),TV,xy(n),高频子带的融合规则为:

最后,通过NSST 逆变换重构低频子带融合子带图像和高频子带融合图像得到融合图像:

5 实验结果与分析

5.1 数据获取和预处理

图5 为搭建的红外与可见光图像融合检测实验台。实验台由可调节可见光源、可调节相机支架、带微距镜头的K20 红外热成像仪与OPT-CC1-M050-GG1 型面阵相机组成,采集的可见光和红外图像的分辨率为640×480。将热激励源的最高输出温度设置为40 ℃,先用热激励源对IC 器件表面加热1~2 s,将IC 器件表面温度控制在其正常工作温度70 ℃以下,再在实验台下采集IC 器件的可见光-红外图像对,采集的可见光图像和红外图像常常伴随很多噪点,因此进行灰度化和双边滤波预处理,压缩图像通道,抑制噪声并保留图像目标的边缘特征信息。

图5 可见光-红外图像对采集实验台Fig.5 Test bench of visible-infrared image pair acquisition

5.2 图像配准结果与分析

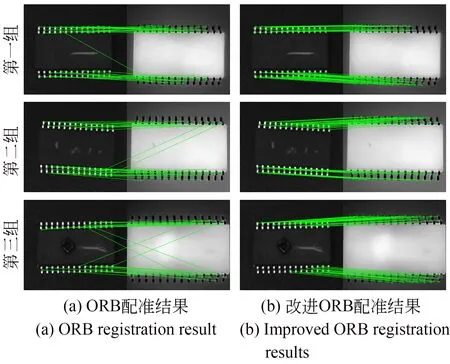

为验证本文提出的改进ORB 算法的优越性,选取3 组不同尺度的IC 器件可见光与红外图像和ORB 算法进行配准对比实验。从主观视觉效果和客观评价指标综合评价图像配准质量。

主观视觉配准效果如图6 所示。从图6 中可以看出,ORB 算法出现明显的误匹配,可见光与红外图像目标尺度差别越大,误匹配越严重;改进的ORB 算法在3 组不同尺度的图像配准中都取得了较好的匹配结果,能够适应图像尺度不一致下IC 器件可见光与红外图像配准,并很好地解决了因IC 器件可见光与红外图像中管脚区域对比度反转造成特征描述符相似性低的问题,提高了特征点匹配的准确率。

图6 图像配准结果对比Fig.6 Comparison of image registration results

图像配准客观评价分析中,采用匹配点对数量、配准精度(Precision,P)和均方根误差(Root mean square error,RMSE)评价指标[20]进行综合评价,P表示图像配准中特征点匹配的精确度;RMSE 表示配准后图像特征点与真实特征点之间的偏差,RMSE 越小表明配准效果越好。对3组不同尺度的红外与可见光图像配准结果对比如表1 所示,本文改进的ORB 算法在正确匹配到的特征点对的数量上比ORB 算法更多。本文改进的ORB 算法的配准平均精度为87.8%,比ORB 算法的配准平均精度提高了62%,同时RMSE 的平均值为1.67,比ORB 算法降低了91.2%,说明了本文改进的ORB 算法的优越性。

表1 图像配准的客观评价Tab.1 Objective evaluation of image registration

5.3 图像融合结果与分析

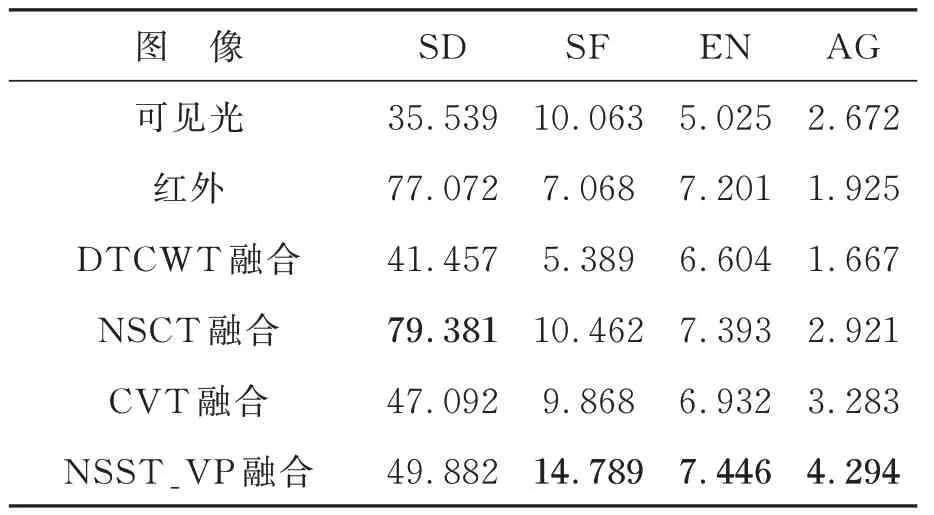

为体现本文所提图像融合算法的优越性,在用本文所提出的改进ORB 图像配准对齐算法对采集到的可见光-红外图像对进行配准对齐的基础上,选用双树复小波变换融合[21](Dual-Tree Complex Wavelet Transforms,DTCWT)、非下采样轮廓波变换融合[22](Non-Subsampled Contourlet Transform,NSCT)、曲线变换融合[23](Curvelet Transforms,CVT)等常见图像融合方法进行实验对比,从主观视觉效果和客观评价指标综合评价融合图像质量。

在主观视觉效果上,如图7 所示,划痕和凹坑在可见光图像中有着更明显的特征,但因缺陷细微,红外图像难以反映温差变化;具有不同热传导率的异物和崩边缺陷在红外图像中有着更高的对比度。DTCWT 和CVT 两种融合方法的融合图像对比度和清晰度较低、边缘轮廓模糊、图像整体偏暗、细微的凹坑缺陷被淹没,基于CVT融合图像存在明显的伪影现象;基于NSCT 融合方法的融合图像冗余了红外图像信息,整体过亮,存在缺陷目标与边缘轮廓模糊的现象,对比度低,丢失了较多的可见光图像细节信息。本文所提的NSST_VP 融合图像在各类表面缺陷中都有着较高的清晰度和对比度,充分融合了可见光图像的细节纹理信息和红外图像的热辐射信息,更好地突出低对比度缺陷特征,为后续缺陷检测提供高质量的数据支撑,同时也反映了前面所提的改进ORB 图像配准方法的有效性。

在图像质量客观评价分析中,可见光与红外图像的融合质量常用标准差(Standard Deviation,SD)、空间频率[24](Spatial Frequency,SF)、信息熵[25](Entropy,EN)和平均梯度[26](Average gradient,AG)等指标对融合结果进行客观评价。SD 用于评价图像中的像素值分布情况;SF用于评价图像像素的总体活跃程度;EN 用于评价融合图像信息量大小;AG 用于评价融合图像的清晰度,所有的客观评价指标与融合图像质量成正比。对20 组融合图像的客观指标取平均值得到表2 的结果,由表2 可以看出,相比于可见光和红外图像,以及其他3 种融合方法,本文方法在除标准差外的客观指标值上有明显提升,这与主观视觉评价的结果相一致。红外图像与NSCT融合图像的标准差较大是因为红外图像的对比度高。由此表明,本文方法所获取的融合图像总体上所含信息量更丰富,同时融合图像的反差更大、清晰度和对比度更高、更有利于识别缺陷目标。通过主观视觉评价以及客观指标评价,充分证明本文提出的NSST_VP 方法融合质量优异,优于其他3 种融合方法。

表2 图像融合质量的客观评价Tab.2 Objective evaluation of image fusion quality

5.4 缺陷检测结果与分析

为了更直观地验证红外与可见光图像融合检测的效果,采用轻量化的SOTA 目标检测模型YOLOv8s[27]进行表面缺陷检测。本文主要针对4 种缺陷进行检测,分别为划痕、异物、凹坑和崩边,在图像配准融合的基础上构建图像数据集,其分布如表3 所示。模型训练采用预训练微调的方式,学习率采用余弦函数的衰减策略,模型训练迭代次数为500 次,当验证集上的loss 收敛和验证集上的mAP 收敛时认为模型训练已到达最优。采用平均精度(Average precision,AP)和均值平均精度(Mean Average precision,mAP)指标评估模型的检测性能。

表3 数据集分布Tab.3 Dataset distribution

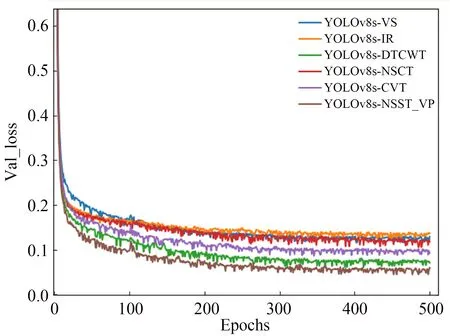

首先,在YOLOv8s 模型上分别测试了单可见光检测(YOLOv8s-VS),单红外检测(YOLOv8s-IR)和红外与可见光融合检测的效果,进而证明红外与可见光融合检测的有效性。然后,在YOLOv8s 模型上分别测试双树复小波变换融合检测(YOLOv8s-DTCWT)、基于非下采样轮廓波变换融合检测(YOLOv8s-NSCT)、基于曲线变换融合检测(YOLOv8s-CVT)和本文提出的NSST_VP 融合检测(YOLOv8s-NSST_VP)的效果,在采用本文所改进的ORB 图像配准对齐的基础上,进一步证明本文所提NSST_VP 融合方法的优越性。如图8 所示,在检测模型验证集损失曲线中,各检测模型在整个训练过程中都能平稳地下降并收敛。融合检测的loss 收敛值均比单可见光和单红外检测的loss 收敛值小,表明多光谱图像融合检测方法能够学习到全面的特征,具有更好的泛化能力。在4 种不同融合检测方法中,本文提出的YOLOv8s-NSST_VP 检测模型的loss 曲线收敛值最小,表明可见光与红外图像配准融合方法能够更好地融合互补信息,以获得更全面的缺陷特征融合图像。

图8 验证集损失曲线Fig.8 Loss curves of validation set

用YOLOv8s 检测模型对4 类缺陷进行检测,设定IOU=0.5,每类缺陷的平均精度(AP)和模型的均值平均精度(mAP)如表4 所示,YOLOv8s-VS 的mAP 为60.18%,YOLOv8s-IR 的mAP 为54.84%,YOLOv8s-DTCWT 的mAP 为70.10%,YOLOv8s-NSCT 的mAP 为62.80%,YOLOv8s-CVT 的mAP 为68.05%,YOLOv8s-NSST_VP 的mAP 为83.15%。单可见光图像检测中,崩边、异物等低对比度缺陷的测试效果很差;单红外图像检测中,划痕和凹坑缺陷检测精度很低,这是因为这两种缺陷尺寸常常很小,在红外图像中很难反应缺陷与背景的温度差异。在红外与可见光融合方法的有效性对比实验中,YOLOv8s-CVT 融合检测凹坑缺陷的AP 为57.23%,因为大量的伪影噪声会干扰凹坑缺陷的检测;YOLOv8s-NSCT 融合检测划痕缺陷和凹坑缺陷的AP 分别为55.36%和40.42%,因为红外图像信息冗余,掩盖了划痕和凹坑特征;在YOLOv8s-DTCWT 的整体测试效果比NSCT和CVT 融合检测方法要好,但整体图像过暗,划痕和崩边缺陷检测的AP 分别为65.32%,65.12%。YOLOv8s-NSST_VP 检测方法明显优于其他3 种融合方法,其中崩边和异物缺陷检测的平均精度分别达到了85.45%,88.72%。

表4 缺陷检测结果Tab.4 Defect detection result

在面向IC 器件转塔式测试分选设备中,其光照不稳定的恶劣检测环境以及IC 器件本身的低对比度的复杂特性,通过将IC 器件可见光图像和红外图像的互补信息融合在一起,更全面地表征了表面缺陷特征。以上研究结果表明,缺陷检测的准确性、可靠性和灵敏度都得到了提高,显著改进IC 器件的制造质量,同时也可考虑将IC 器件电信号的温度极限测试集成到IC 器件转塔式测试分选设备中,为实际应用提供更准确和高效的解决方案。

6 结论

本文研究多光谱图像融合的IC 器件表面缺陷检测方法,针对多光谱图像存在的尺度不一致和对比度反转问题,引入拉普拉斯金字塔和描述符重组策略改进ORB 算法,图像配准平均精度为87.8%,平均RMSE 为1.67,比ORB 算法配准精度提高了62%;研究了基于NSST_VP 的IC 器件表面缺陷多光谱图像融合方法,该方法的主观视觉效果和客观评价指标上均有所提升,有效增强了IC 器件表面缺陷特征。最后,通过YOLOv8s 模型对单可见光、单红外和融合后的IC 器件表面缺陷图像进行检测。实验表明,YOLOv8s-NSST_VP 检测比单可见光和单红外图像检测的mAP 分别提高了22.97%,28.31%,比DTCWT,CVT,NSCT 融合检测的mAP 分别提高了13.14%,15.01%,20.35%。综上,本文所提的多光谱配准融合方法有效提高了IC 器件表面缺陷的检测精度。然而,在人为设计的融合规则中轻微缺陷常常被冗余噪声淹没,在今后的工作中需要更多关注这类轻微缺陷,利用深度学习的强大特征提取能力,先分别提取可见光和红外图像的缺陷特征,再进行中间层的特征级融合,从而构建出检测性能更强的IC 器件表面缺陷检测模型。