个体攻击性对愤怒表情类别知觉的影响*

邱方晖 罗跃嘉 贾世伟

(1山东师范大学心理学院, 济南 250358) (2深圳大学情绪与社会认知科学研究所, 深圳 518060)(3北京师范大学认知神经科学与学习国家重点实验室, 北京 100875)

1 引言

面部表情是一项重要的人际交往方式, 正确表达和识别面部表情在人际交往中具有重要意义。而攻击性人群常伴有面部表情加工障碍(Marsh &Blair, 2008)。研究发现, 面部表情加工障碍存在于以攻击性为特点的问题行为中, 如间歇性爆发性障碍(Best, Williams, & Coccaro, 2002)、品行障碍(Fairchild, Stobbe, van Goozen, Calder, & Goodyer,2010; Fairchild, van Goozen, Calder, Stollery, &Goodyer, 2009)、反社会人格障碍(Schönenberg,Louis, Mayer, & Jusyte, 2013)等, 也存在于反社会暴力罪犯(Marsh & Blair, 2008; Schönenberg & Jusyte,2014)和正常人群中的高攻击个体(Hall, 2006; Larkin,Martin, & McClain, 2002; Wilkowski & Robinson,2012)当中。对攻击性个体面部表情加工障碍的研究大多集中在愤怒表情, 可能因为愤怒是最常用的表达敌意的表情(Wilkowski & Robinson, 2012)。

1.1 攻击性个体对愤怒表情的加工

攻击性个体对愤怒表情的加工模式与正常人不同, 目前主要有两种观点解释这种现象。一种是偏向观点(The Bias Perspective), 认为攻击性个体存在愤怒反应偏向, 倾向于将模糊表情、中性表情或者其它表情报告为愤怒, 表现出敌意归因偏向(Hall, 2006); 另一种是敏感性观点(The Sensitivity Perspective), 认为个体攻击性改变了对愤怒表情的敏感性, 譬如攻击性个体具有更准确知觉愤怒成分的能力, 对愤怒表情高度敏感(Wilkowski & Robinson,2012)。下面分别介绍这两种观点。

一些研究者认为攻击性个体存在敌意归因偏向, 倾向于将模糊刺激知觉为威胁性信号, 将他人意图归因为敌对意图(De Castro, Veerman, Koops,Bosch, & Monshouwer, 2002; Dodge, 2006)。由于存在敌意归因偏向, 攻击性个体可能将其它表情错误识别为具有攻击性的愤怒表情(Hall, 2006; Knyazev,Bocharov, Slobodskaya, & Ryabichenko, 2008;Larkin et al., 2002; Sato, Uono, Matsuura, & Motomi,2009)。Hall (2006)考察了大学生对快乐、悲伤、愤怒、恐惧表情的识别能力, 发现自我报告的攻击态度、言语攻击水平高的被试犯更多的替代性错误,倾向于将其它类别的表情报告为愤怒表情。敌意个体会以一种与他们的敌意倾向性相一致的方式知觉情绪性表情, 更多地将厌恶表情错误报告为愤怒表情(Larkin et al., 2002; Sato et al., 2009)。研究者通过训练来调整攻击性个体的表情类别界线, 将靠近类别界线的愤怒表情反馈给被试为快乐表情。结果发现, 与控制组被试相比, 经过调整训练的被试将模糊表情识别为快乐表情的比例增大, 自我报告和工作人员报告的攻击性水平显著下降(Penton-Voak et al., 2013)。这表明攻击性个体的愤怒知觉倾向是源于类别界线的偏移。攻击性个体基于已有的负性认知图式来知觉和解释模糊信息, 从而验证了他们的认知偏见, 使他们更加认为世界是他们所知觉到的那样充满攻击性, 知觉偏见又强化了已有的认知加工(Hall, 2006)。

与上述观点不同, Wilkowski和Robinson (2012)认为, 攻击性个体倾向于将模糊表情报告为愤怒表情并不是因为敌意归因偏向, 而是因为攻击性个体对愤怒表情具有高度敏感性, 即使模糊表情中有细微的愤怒表情也能被识别出来。研究者使用混合表情作为实验材料, 发现与低身体攻击个体相比, 高身体攻击个体更能区分不同愤怒成分(如40%、50%、60%愤怒成分)的混合表情, 并且使用信号检测分析发现, 这种差异是由于高身体攻击个体对愤怒表情的知觉敏感性, 而不是反应偏向。攻击性个体由于经常暴露于攻击环境当中, 逐渐提高了应对攻击环境的能力和技巧, 对他人的愤怒表情更加敏感(Wilkowski & Robinson, 2012)。对受虐待儿童表情识别能力的研究支持了这一观点, 与正常儿童相比, 受虐待儿童能正确识别出较低强度的愤怒表情(Pollak & Kistler, 2002; Pollak, Messner, Kistler, &Cohn, 2009; Pollak & Sinha, 2002)。然而, 也有一些研究发现, 攻击性个体识别愤怒表情存在缺陷(Best et al., 2002; Fairchild, Stobbe et al., 2010; Fairchild,van Goozen et al., 2009), 对愤怒表现出降低的敏感性,只能正确识别出较高强度的愤怒表情(Schönenberg et al., 2013)。Schönenberg等人(2013)使用中性—愤怒连续体作为实验材料, 连续体中包含51张面孔, 相邻面孔之间的情绪强度差异是2%, 刺激由完全中性逐渐变化为完全愤怒, 被试在识别出情绪类别时按键, 结果发现反社会人格障碍患者需要更高的情绪强度才能正确知觉到愤怒。也有研究认为攻击性个体识别愤怒表情与正常人没有显著差异(Bagcioglu et al., 2014; Pajer, Leininger, & Gardner, 2010)。

1.2 面部表情类别知觉

面部表情类别知觉是指连续变化的表情在人脑中按照类别表征, 且不同类别的表情之间存在明显的类别界线。刺激从一种类别到另一种类别的知觉转折点叫做类别界线, 跨类别界线的一对刺激叫做类间刺激, 属于一个类别的一对刺激叫做类内刺激。类别知觉的特征是, 与类内表情相比, 类间表情的辨别正确率更高, 反应时更短(Fugate, 2013)。类别知觉范式所使用的实验材料是渐变面部表情图片, 以情绪强度为100%的面孔作为表情原型,将两张表情原型按比例混合, 产生一系列情绪强度间距相等的表情图片。类别知觉范式(Calder, Young,Perrett, Etcoff, & Rowland, 1996; Young et al., 1997)包括识别任务(Identification Task)和辨别任务(Discrimination Task)。识别任务考察被试如何标记面部表情, 用于确定类别界线的位置以及识别不同表情的敏感性; 辨别任务评估被试辨别某一连续体中不同表情的能力, 用于确定类别界线的位置, 比较类别界线的偏移情况。

类别知觉范式已应用于受虐待儿童(Pollak &Kistler, 2002)、精神分裂症患者(Huang et al., 2011;Kee, Horan, Wynn, Mintz, & Green, 2006; Tsui et al.,2013)、抑郁症患者(Liu, Huang, Wang, Gong, &Chan, 2012)面部表情识别能力的研究中。近年来类别知觉研究中发展了一种新的数据分析方法, 通过logistic函数公式来估算类别转折点和识别曲线在类别界线处的斜率(Pollak & Kistler, 2002)。转折点(shift point, SP)是识别任务中表情类别转变的一点,反映了类别界线的偏移情况; 反应斜率体现了表情类别转变的迅速程度, 反映了被试对表情的敏感性。这种分析方法能有效地分离反应偏向与知觉敏感性(Huang et al., 2011; Kee et al., 2006; Liu et al., 2012),对于研究面部表情加工障碍的机制有重要价值。

1.3 问题提出及研究假设

攻击性是通过反应偏向还是知觉敏感性来影响个体对愤怒表情的加工, 目前结论尚不一致。实验材料选择表情原型还是情绪强度变化的渐变表情, 被试是否存在攻击性以外的影响表情识别的障碍, 以哪种攻击类型作为标准筛选被试样本, 实验范式和数据分析方法是否能区分反应偏向和敏感性, 都可能是研究结论不一致的原因。

首先, 实验材料的选择。支持反应偏向的研究大多选择表情原型作为实验材料(Hall, 2006; Knyazev et al., 2008; Larkin et al., 2002; Sato et al., 2009), 而支持敏感性观点的研究大多选择渐变表情(Wilkowski& Robinson, 2012), 这是因为表情原型较难体现攻击性与表情知觉敏感性的关系。Best等人(2002)使用表情原型也得到了攻击性与愤怒知觉敏感性之间的关系, 可能是因为研究对象是间歇性爆发性障碍患者, 表情识别能力受损较严重, 即使识别表情原型也与正常被试之间存在差异。而正常高攻击个体识别面部表情原型很可能与低攻击个体没有显著差别, 一方面, 相对于极端攻击性个体而言, 正常人群中的高攻击个体攻击性水平较低, 另一方面日常生活中很难见到愤怒原型, 高攻击个体并没有更多地练习识别愤怒原型, 因此, 当前研究使用渐变的混合表情(如Wilkowski & Robinson, 2012), 对于发现攻击性与愤怒知觉敏感性之间的关系更为有效。

第二, 被试的选择。一些研究以障碍患者作为研究对象(Best et al., 2002; Schönenberg et al., 2013),比如选择攻击性个体时没有控制精神病态这一因素(Hoaken, Allaby, & Earle, 2007), 而精神病态可能本身就影响表情识别(Hastings, Tangney, & Stuewig,2008; Kosson, Suchy, Mayer, & Libby, 2002), 因此愤怒知觉异常难以排除精神病态的作用, 也难以推广到正常人群中的高攻击个体当中。Wilkowski和Robinson (2012)以正常人群为研究对象, 使用Buss-Perry攻击问卷中的身体攻击维度得分来区分高、低攻击被试, 但是仅仅身体攻击这一攻击维度不能代表攻击性5个维度的结果, 研究表明攻击态度和言语攻击作为攻击量表的维度与敌意归因偏向有关(Hall, 2006)。另外, Wilkowski和Robinson的研究是将54名被试区分为高、低攻击组, 样本代表性较低。

第三, 实验范式和数据分析方法。以识别百分比为因变量可以考察攻击性个体与正常被试的表情识别能力差异, 在特定的实验范式中也可以考察反应偏向(Hall, 2006)或敏感性(Best et al., 2002),但是难以同时考察识别百分比的差异究竟是源于反应偏向还是敏感性(如, Fairchild et al., 2010;Schönenberg & Jusyte, 2014)。Schönenberg和Jusyte(2014)使用渐变表情连续体作为实验材料, 通过识别任务考察反社会暴力罪犯的表情识别能力, 结果发现, 与正常被试相比, 反社会暴力罪犯倾向于将愤怒—快乐、愤怒—恐惧连续体中的模糊表情知觉为愤怒表情, 而识别快乐—恐惧连续体时与正常人没有显著差异, 即暴力罪犯存在愤怒识别倾向, 然而研究者并没有对这种愤怒识别倾向的原因加以区分, 同时使用敌意归因偏向和愤怒知觉敏感性来解释实验结果。Wilkowski和Robinson (2012)使用信号检测分析的方法, 正确识别愤怒表情(击中)和将其它表情识别为愤怒表情(虚报)的比例之和作为反应偏向的指标, 正确识别愤怒表情(击中)的比例作为敏感性的指标。然而这种方法只能分别比较不同个体识别特定比例的混合面孔, 对于由多个渐变表情组成的表情连续体, 数据分析将非常复杂, 也难以体现识别率的变化趋势。Pollak和Kistler (2002)采用类别知觉范式, 使用logistic函数公式, 通过渐近线法估算出表情连续体的转折点和斜率, 分别作为反应偏向和敏感性的指标, 能够很好地将反应偏向和知觉敏感性分离。总之, 不同的数据分析方法适用于研究不同的理论假设, 从而会得到不同的结论。

我们认为, 攻击性个体既存在愤怒识别反应偏向, 同时对愤怒表情表现出高度敏感性, 之所以很少有研究支持敏感性观点, 是因为实验材料的选择不适合考察敏感性, 实验范式和数据分析方法不能区分反应偏向和敏感性。愤怒表情是传递敌意的信号(Wilkowski & Robinson, 2012), 恐惧象征着屈服或寻求帮助(Staugaard, 2010), 两者代表了攻击性的两个极端, 因此当前研究使用愤怒—恐惧连续体的渐变表情作为实验材料, 有助于我们理解高攻击个体对敌意面孔的识别模式。在被试的选择中, 使用Buss-Perry攻击问卷作为测量工具, 根据攻击问卷总分从846名大学生中筛选被试。采用经典的类别知觉范式, 其中识别任务用于比较高、低攻击个体类别界线以及知觉敏感性, 辨别任务进一步验证类别界线的偏移情况。数据处理部分, 通过logistic函数对数据进行分析, 得到每个被试的类别转折点和斜率, 考察正常人群中高、低攻击个体对愤怒—恐惧表情连续体的类别界线和知觉敏感性是否存在差异。根据前人研究(Hall, 2006; Knyazev et al.,2008; Larkin et al., 2002; Sato et al., 2009; Wilkowski& Robinson, 2012), 我们预期, 高攻击个体对愤怒—恐惧表情连续体的类别界线偏移到恐惧一端, 倾向于将模糊表情识别为愤怒, 存在敌意归因偏向,并且识别愤怒—恐惧连续体的曲线斜率更大, 对愤怒、恐惧表情类别的转变更敏感。

2 方法

2.1 被试

使用Buss和与Perry (1992)攻击问卷(Aggression Questionnaire, AQ)中文版(李献云等, 2011)作为测量工具, 该问卷包括5个分量表, 分别测量身体攻击、言语攻击、愤怒、敌意、自戕。以山东师范大学846名大学生作为调查对象, 根据AQ量表总分, 从得分最高的50名和得分最低的50名学生(各占6%)中寻找被试, 最终29名高攻击个体(12名男性)和25名低攻击个体(4名男性)愿意参加实验。54名被试的年龄范围是17~23岁, 没有生理或精神方面的疾病, 均为右利手, 视力或矫正视力正常, 自愿参加实验, 实验后获赠适量报酬。数据分析过程中,根据被试的表现剔除部分不合格的被试。

2.2 实验材料

使用E-prime制作实验程序并记录实验数据,通过CRT显示器(SyncMaster 757DFX, 分辨率为1024×768, 刷新率为85 Hz)呈现刺激。被试坐在安静的实验室中, 下巴放在头托上保持不动, 双眼与屏幕距离为1 m, 要求被试始终注视屏幕中心的位置, 在键盘上按键做出反应。

表情图片采用软件Facegen Modeller 3.4.1(http://FaceGen.com; Singular Inversions, 2009)生成。FaceGen软件是基于三维激光扫描获得的模拟人脸数据库, 可以生成不同种族、性别、年龄、表情的高仿真3D面孔, 能够准确地制作出某一强度的表情。使用FaceGen软件制作的面孔图片已被应用于行为研究(Wilkowski & Robinson, 2012)、ERP研究(Recio, Sommer, & Schacht, 2011)和fMRI研究(Said, Dotsch, & Todorov, 2010; Said, Moore, Norman,Haxby, & Todorov, 2010)中。

首先使用FaceGen软件生成一张年龄20岁、面部对称的东南亚人面孔, 表情默认为中性表情。由于面孔性别会影响男、女性被试对愤怒表情的识别(Calvo & Lundqvist, 2008), 我们将性别设置为中性。参照前人研究(Said, Moore, et al., 2010), 在此面孔基础上制作表情强度范围为0%~100%的愤怒—恐惧表情连续体。这些表情包括2张原型表情和9张渐变表情, 原型表情是100%愤怒0%恐惧表情和0%愤怒100%恐惧表情, 渐变表情是将两张原型面孔按比例混合, 相邻表情的物理差异是10%。例如, 图1中面孔0是100%愤怒成分和0%恐惧成分,面孔1是90%愤怒成分和10%恐惧成分, 面孔2是80%愤怒成分和20%恐惧成分, 依次类推, 形成了从愤怒到恐惧按照10%物理差异渐变的0~10号面孔, 共11张面部表情图片。

2.3 实验程序

图1 实验所采用的材料示意图。面孔1是90%愤怒成分和10%恐惧成分, 面孔2是80%愤怒成分和20%恐惧成分, 依次类推。

参照面部表情类别知觉研究(Calder et al., 1996;Campanella, Quinet, Bruyer, Crommelinck, & Guérit,2002), 本实验采用类别知觉实验范式, 被试先后完成辨别任务和识别任务。由于识别任务中语言标签的使用可能会影响辨别任务(Calder et al., 1996),因此辨别任务在识别任务之前进行。

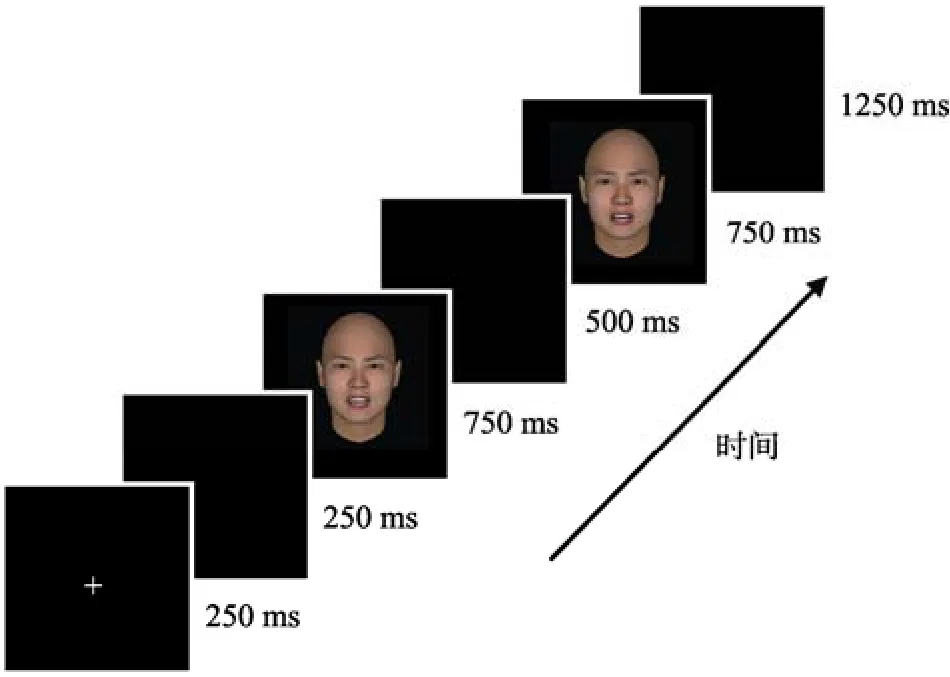

辨别实验中(图2), 先后呈现2张面孔刺激各750 ms, 被试需要在第二张面孔图片出现后尽可能准确地判断两张面孔是否完全相同, 刺激消失后呈现黑色空屏, 被试共有2000 ms的时间做出反应,250 ms黑色空屏后开始下一试次。面孔的垂直和水平视角分别为3.72°和2.41°。辨别任务所使用的面孔包括9对不同面孔和9对相同面孔, 不同面孔之间的物理差异是20%(如面孔0和2, 1和3, 依次类推), 每对刺激呈现的顺序有2种(AB和BA); 为保证不同反应与相同反应的次数相等, 相同面孔只使用面孔1~9, 且每对面孔呈现2次。这样, 9对不同面孔各2种顺序, 形成18对不同刺激; 9对相同面孔呈现两次, 形成18对相同刺激。以上36对刺激为一组(block), 组内36试次随机呈现。正式实验包括5组, 共180个试次。正式实验开始前进行18试次的练习实验, 练习试次从正式实验中随机选取。

识别实验中(图3), 为排除锚定效应或值域效应对表情识别的影响(Calder et al., 1996; Young et al., 1997), 识别任务的实验材料只使用9张渐变表情, 不使用表情原型。呈现一张面孔刺激1500 ms,被试要在刺激消失前做出反应, 刺激消失后呈现黑色空屏, 250 ms后开始下一试次。实验任务为二择一迫选任务, 被试需既快又准地判断此面孔属于愤怒表情还是恐惧表情。正式实验包含144个试次,其中每张面孔重复16次, 所有刺激随机呈现。正式实验开始前进行8次练习实验。

图2 辨别任务流程图

图3 识别任务流程图

2.4 数据分析

对于识别任务, 由于靠近原型的面孔(1、2、8、9)受类别知觉的影响很小, 因此我们首先删除面孔1、2、8、9平均正确率低于90% (Schönenberg et al.,2013)的5名(均为高攻击者, 其中4名为男性)不认真作答者的数据, 剩余低攻击个体25名, 高攻击个体24名, 然后删除无反应的数据(占1.28%)。

对于识别百分比的分析, 去掉反应过快的数据(高、低攻击组分别对9张面孔的反应时小于各对应条件下平均反应时2个标准差视为反应过快, 占0.23%)。根据Pollak和Kistler (2002)的logistic函数公式P

=c

+ (d

–c

) / (1 +e

), 可以估算类别转折点和识别曲线在类别转折点处的斜率。公式中,x

是恐惧表情刺激的信号强度,P

是识别百分比, 参数a

是函数的中点,b

反映了函数曲线变化最快处的斜率,c

和d

分别是下、上渐近线(Huang et al.,2011; Kee et al., 2006; Liu et al., 2012; Lopez-Duran,Kuhlman, George, & Kovacs, 2013; Pollak & Kistler,2002; Tsui et al., 2013)。在当前研究中, 我们考察以下两个指标:转折点SP和反应斜率。转折点是表情连续体中将表情识别为一种类别转变为另一种类别的一点, 即二择一识别任务中识别百分比P

为50%的点; 反应斜率的大小是(d

–c

)/ 4b

, 表示识别任务中表情类别转变的迅速程度, 体现了被试对表情类别的敏感性。使用Graph 4.4.2软件(http://www.padowan.dk/; Ivan Johansen, 2012)对数据进行拟合得出恐惧表情识别百分比为50%的点SP, 即类别界线, 并根据函数的导数求出SP处的斜率。如果被试是按照类别知觉来识别面部表情, 那么识别百分比与表情强度应该呈类似“S”型的关系。数据分析时, 参照前人研究(Huang et al., 2011; Liu et al., 2012), 去掉识别曲线不满足“S”型的5名被试;删除3个斜率极端值(高、低攻击组在SP点的斜率值大于对应组的平均斜率值2个标准差为极端值),剩余有效样本为低攻击个体23名, 高攻击个体18名。使用SPSS 17.0软件, 将性别作为协变量, 对转折点和斜率分别进行方差分析, 分析高、低攻击个体识别愤怒—恐惧连续体的转折点和斜率是否存在差异。为了进一步验证个体攻击性与转折点和斜率的关系, 以性别为控制变量, 使用偏相关分析考察攻击性与转折点和斜率的关系。对于识别反应时的分析, 在已经去掉反应过快的数据(占0.23%)基础上, 进一步去掉反应过慢的数据(高、低攻击组分别对9张面孔的反应时大于其对应条件下平均反应时2个标准差的数据, 占4.88%)。面孔1、2、3和7、8、9靠近原型, 容易识别, 可以将没有识别为相应原型的反应确认为错误反应。数据处理中, 去掉面孔1、2、3和7、8、9错误反应的反应时。而表情4、5、6是模糊表情,不能确定正、误反应, 保留全部数据。对实验数据进行混合设计的二因素方差分析, 分析攻击性(高、低)与面孔(1、2、3、4、5、6、7、8、9)的主效应和交互作用。

对于辨别任务正确率的分析, 我们只考察被试辨别不同表情对的情况(Calder et al., 1996), 删除1名(高攻击者)不认真作答者(正确率低于平均正确率2个标准差), 剩余高攻击个体28名, 低攻击个体25名; 删除无反应的数据(1.67%)和反应过快的试次(反应时小于对应组平均反应时2个标准差,占0.13%)。对高、低攻击组辨别不同刺激对表情的正确率进行重复测量方差分析。

3 实验结果

3.1 高、低攻击组在AQ问卷上的得分

使用独立样本t

检验考察54名高、低攻击组被试在攻击性上的差异, 两组被试的攻击问卷得分差异显著, 高攻击组得分(M

=55.72,SD

=8.35)显著大于低攻击组(M

=4.60,SD

=2.64),t

(52)=29.34,p

<0.001,Cohen's d

=8.16。识别任务41名有效被试的攻击得分差异也显著, 高攻击组得分(M

=55.14,SD

=6.88)显著大于低攻击组(M

=4.64,SD

=2.75),t

(39)=32.16,p

< 0.001,Cohen's d

=10.38; 辨别任务53名有效被试的攻击得分差异也显著, 高攻击组得分(M

=55.59,SD

=8.48)显著大于低攻击组(M

=4.60,SD

=2.64),t

(51)=28.83,p

< 0.001,Cohen's d

=8.09。3.2 攻击性对识别曲线转折点和斜率的影响

高、低攻击组识别愤怒—恐惧连续体的百分比见图4。从图中可以看出, 被试识别靠近愤怒原型的表情(面孔1、2、3)和靠近恐惧原型的表情(面孔7、8、9)的百分比都很高, 而类别界线处的表情识别百分比只有50%左右, 处于几率水平。愤怒识别曲线和恐惧识别曲线的交叉点即为该组的类别界线, 反映了愤怒、恐惧表情对于该组被试的主观分界点, 类别界线处的曲线斜率反映了该组被试对愤怒、恐惧表情的敏感性(Pollak & Kistler, 2002)。

图4 识别任务中, 高低攻击组识别愤怒—恐惧连续体的百分比。1为愤怒端, 9为恐惧端。面孔1是90%愤怒成分和10%恐惧成分, 面孔2是80%愤怒成分和20%恐惧成分, 依次类推。

使用协方差分析考察高、低攻击组被试识别愤怒—恐惧连续体的转折点和斜率的差异, 结果发现高攻击组的转折点(M

=4.83,SD

=0.63)大于低攻击组(M

=4.58,SD

=0.76), 但是这种差异没有达到统计显著,F

(1, 38)=0.76,p

=0.390; 转折点处的斜率差异显著,F

(1, 38)=5.44,p

=0.025, η=0.13,与低攻击个体(M

=0.46,SD

=0.16)相比, 高攻击个体(M

=0.62,SD

=0.25)的反应斜率更大。性别对转折点[F

(1, 38)=0.38,p

=0.542]和斜率[F

(1, 38)=0.04,p

=0.841]的影响均不显著。这表明高攻击个体对愤怒—恐惧连续体的类别界线偏移不显著, 但对愤怒、恐惧表情类别的转变表现出更高的敏感性。使用偏相关分析攻击得分与类别转折点和斜率的关系, 结果发现, 个体攻击性与愤怒—恐惧表情连续体的类别转折点不存在相关(r

=0.09,p

=0.573), 但与类别界线处的斜率存在显著相关(r

=0.33,p

=0.038)。以上结果表明, 个体的攻击性越大,对愤怒、恐惧表情的转变越敏感。3.3 高低攻击个体的识别反应时

图5 识别任务中, 高低攻击组识别愤怒—恐惧连续体的正确反应时

高、低攻击组识别愤怒—恐惧连续体的反应时见图5。从图中可以看出, 被试识别靠近表情原型的面孔反应时较短, 而识别类别界线处的面孔反应时较长, 曲线出现峰值, 表明类别界线的存在。对反应时进行2(攻击性:高、低)×9(面孔:1、2、3、4、5、6、7、8、9)的重复测量方差分析, 结果发现,面孔主效应显著,F

(8, 40)=27.30,p

< 0.001, η=0.85; 攻击性主效应不显著,F

(1, 47)=0.91,p

=0.344; 攻击性与面孔的交互作用显著,F

(8, 40)=2.62,p

=0.021, η=0.34。简单效应检验发现, 对面孔1的识别反应时低攻击组显著大于高攻击组(p

=0.001), 高、低攻击组对其它面孔的识别反应时无显著差异。3.4 高、低攻击个体的辨别正确率

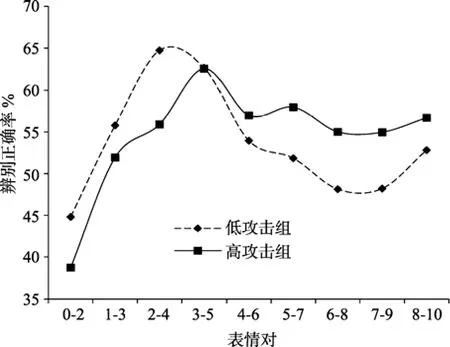

图6是高、低攻击组辨别不同刺激对表情的正确率。对数据进行2(攻击性:高、低)×9(表情对:0–2、1–3、2–4、3–5、4–6、5–7、6–8、7–9、8–10)重复测量方差分析, 结果发现, 表情对的主效应显著,F

(8, 44)=6.69,p

< 0.001, η=0.55; 攻击性主效应不显著,F

(1, 51)=0.04,p

=0.840; 攻击性与表情对的交互作用不显著,F

(8, 38)=1.00,p

=0.447。

图6 辨别任务中, 高低攻击组的辨别正确率

以上结果表明, 表情对的效应有可能在高、低攻击组上都显著。为了检验这一推测, 分别对高、低攻击组的表情对效应进行单因素方差分析, 结果发现, 低攻击组被试对不同表情对的辨别正确率差异显著,F

(8, 216)=2.14,p

=0.034; 高攻击组被试对不同表情对的辨别正确率差异也显著,F

(8, 243)=2.56,p

=0.011。我们更关注高、低攻击组辨别正确率是否在某个表情对上出现峰值, 用峰值来验证类别界线的存在; 并比较峰值所处表情对在两组间是否不同。我们对两组被试的辨别数据分别进行了多重比较。结果发现, 低攻击个体辨别面孔2–4的正确率显著高于面孔0–2、6–8、7–9 (p

s < 0.05)。这说明面孔2–4是跨类别界线的一对刺激, 属于类间刺激, 辨别正确率高; 而靠近原型的表情对(面孔0–2、6–8、7–9)属于类内刺激, 辨别正确率低。从图6来看, 低攻击组的辨别曲线有明显的峰值,愤怒—恐惧表情的类别边界在面孔3附近。高攻击个体辨别面孔2–4、3–5、4–6、7–9、8–10的正确率显著高于面孔0–2 (p

s < 0.05), 其它表情对之间的差异均不显著。从图6中可以看出, 高攻击组的辨别曲线也有峰值(面孔3–5), 与识别任务的类别界线相似。类别知觉的特点是类间刺激比类内刺激更容易辨别, 因此辨别正确率最高的表情对应该是跨类别界线的一对表情。参照Pollak和Kistler (2002)的分析方法, 在辨别任务中, 低攻击组的愤怒—恐惧连续体的类别界线位于面孔3和4之间, 高攻击组的类别界线在面孔4左右, 也就是说, 与低攻击个体相比, 高攻击个体识别愤怒—恐惧连续体的类别界线偏向恐惧, 表现出将模糊表情判断为愤怒表情的倾向, 但是这种趋势不是非常明显。

“四水同治”就是高效利用水资源、系统修复水生态、综合治理水环境、科学防治水灾害。针对存在的新老水问题,河南提出,今后各级各部门要协同联动,统筹治理水资源、水生态、水环境、水灾害,改善水生态。今后一个时期,河南将围绕实施国家节水行动、扎实推进河湖管理与保护、充分发挥南水北调工程综合效益、全面提升引黄供配水能力、加快推进重大水利工程建设、实施地下水超采区综合治理、加强水灾害防治、强化乡村水利基础设施建设、科学调配水资源、加快智慧水利建设等十方面重点任务展开“治水”。

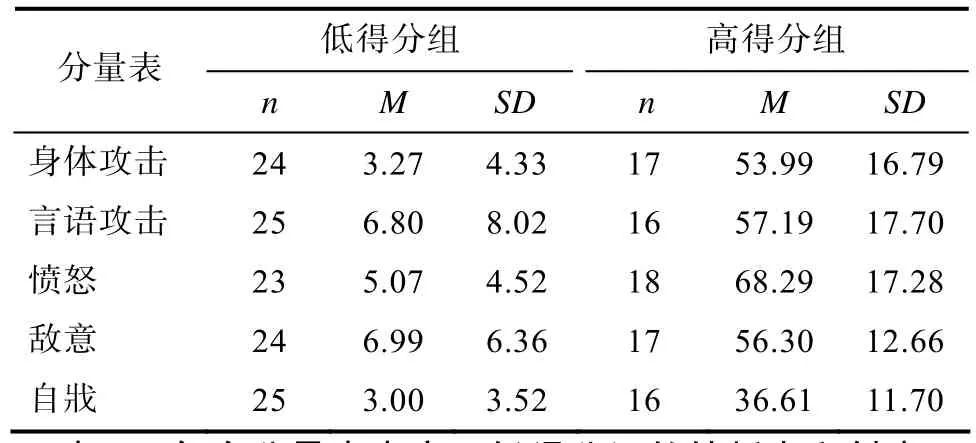

3.5 各AQ分量表中高低得分者的转折点和斜率差异

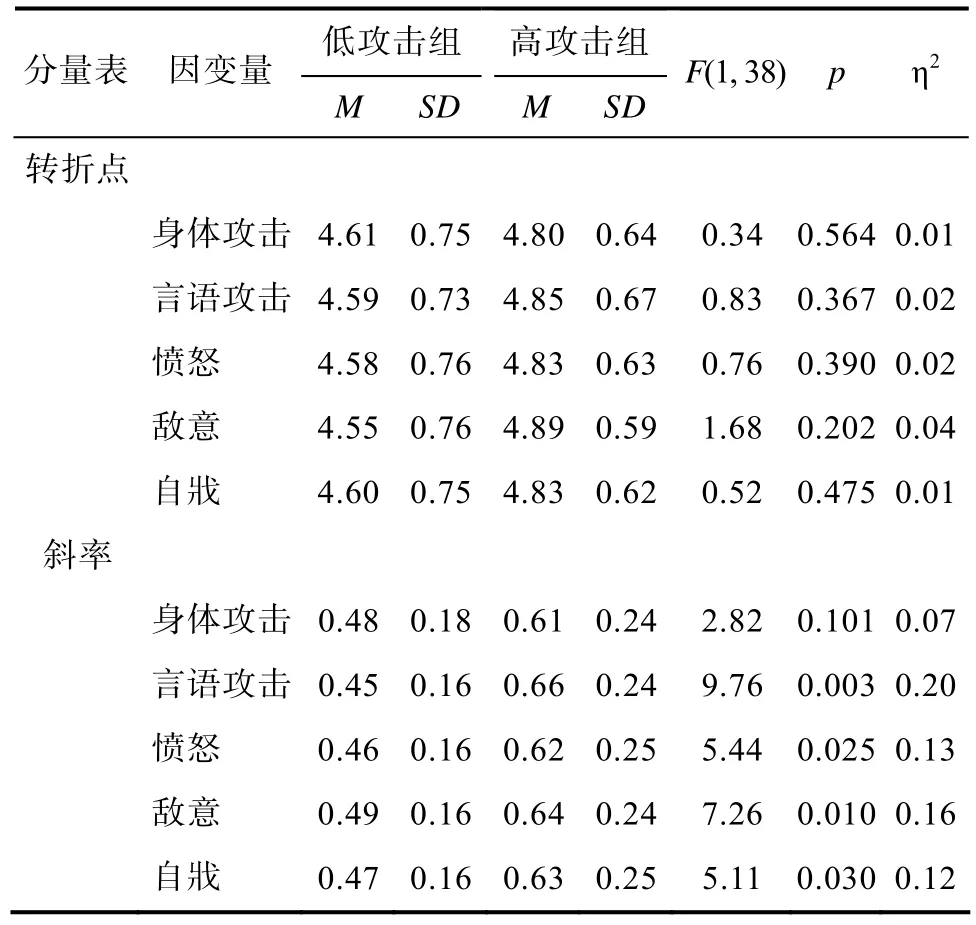

以上分析表明, 相对于低攻击个体, 高攻击个体对愤怒和恐惧表情的转变更敏感。Wilkowski和Robinson (2012)使用身体攻击问卷筛选被试, 而我们的研究是通过攻击问卷总分对被试进行分组, 不能与Wilkowski和Robinson (2012)的研究结果进行直接比较。为进一步考察攻击问卷5个分量表得分对愤怒恐惧表情类别知觉的影响, 也为了与前人研究进行比较, 我们在当前已有数据的基础上, 根据各攻击维度的得分Z分数将被试分为高得分组(Z分数大于0)和低得分组(Z分数小于0), 以性别为协变量, 对转折点和斜率进行协方差分析。每一分量表中高、低得分组量表得分见表1, 每一分量表中高攻击组得分均显著大于低攻击组(ps

< 0.001)。每个分量表中高、低得分组的转折点和斜率见表2。5个分量表中高、低得分组的转折点均没有显著差异, 但是言语攻击、愤怒、敌意、自戕四个分量表中高、低得分组被试的斜率存在显著差异,身体攻击分量表中两组被试的斜率差异不显著。性别对5个攻击维度中高、低得分组的转折点和斜率的影响均不显著(p

s > 0.100)。这表明, 言语攻击、愤怒、敌意、自戕得分高的个体对愤怒和恐惧表情的转变具有更高的敏感性。

表1 根据5个分量表得分划分的高、低得分组

表2 每个分量表中高、低得分组的转折点和斜率

使用偏相关分析攻击各维度的得分与类别转折点和斜率的关系, 结果发现, 类别转折点与各攻击维度得分不存在显著相关(身体攻击r

=0.09,p

=0.592, 言语攻击r

=0.04,p

=0.802, 愤怒r

=0.10,p

=0.546, 敌意r

=0.14,p

=0.378, 自戕r

=0.01,p

=0.936)。类别界线处的斜率与身体攻击(r

=0.35,p

=0.026)、言语攻击(r

=0.36,p

=0.025)、愤怒(r

=0.32,p

=0.043)存在显著相关, 与敌意维度的相关边缘显著(r

=0.28,p

=0.075), 与自戕维度不存在显著相关(r

=0.15,p

=0.365)。这表明, 个体的身体攻击、言语攻击、愤怒、敌意得分越高, 对愤怒、恐惧表情的转变越敏感。4 讨论

本研究使用愤怒—恐惧表情连续体作为实验材料, 采用类别知觉范式, 通过logistic函数分析转折点和敏感性, 考察了正常人群中高、低攻击个体识别愤怒—恐惧表情连续体是否存在差异, 以及这种差异的原因是反应偏向还是敏感性。识别任务结果发现, 两组被试识别愤怒—恐惧表情的类别界线差异不显著, 但是转折点处的斜率差异显著, 与低攻击组相比, 高攻击个体的反应斜率更大, 识别靠近愤怒原型的表情反应时更快。辨别任务结果发现,与低攻击个体相比, 高攻击个体识别愤怒—恐惧连续体的类别界线偏向恐惧, 表现出将模糊表情判断为愤怒表情的倾向, 尽管这种趋势不显著。除此之外, 我们还发现, 方差分析和相关分析都表明, 言语攻击、愤怒、敌意三个维度都影响着愤怒—恐惧表情类别界线处的识别曲线斜率。

与低攻击个体相比, 高攻击个体识别愤怒—恐惧连续体的曲线斜率更大, 表明高攻击个体对愤怒和恐惧表情的转变具有更高的敏感性, 这与Wilkowski和Robinson (2012)、Schönenberg和Jusyte (2014)的研究结论一致。Schönenberg和Jusyte (2014)发现,暴力罪犯更多地将涉及愤怒成分的模糊表情识别为愤怒表情, 但对不涉及愤怒成分的表情识别百分比与正常被试无显著差异, 由此推断暴力罪犯对愤怒具有更高的敏感性, 但是, 研究对象是监狱里的反社会暴力罪犯, 并且这些暴力罪犯都是具有反社会人格障碍的极端攻击性个体, 结论不能直接推广到正常高攻击人群中。Wilkowski和Robinson的研究对象是正常高攻击个体, 但是在选择被试时只根据攻击量表的身体攻击维度得分将参与实验的54名被试区分为高、低攻击组, 而我们的研究是根据攻击问卷总分从大样本中施测并筛选出高、低攻击被试, 被试具有较高的代表性。另外, 这两项研究在分析数据时都只能分别比较某一特定混合表情下的组间差异, 而我们研究所采用的分析方法可以观察到表情识别百分比的变化趋势, 同时分离转折点和敏感性, 更方便观察和理解。

前人研究表明, 攻击性个体或经常暴露于攻击环境的个体对愤怒表情表现出高度敏感性(Pollak et al., 2009; Pollak & Kistler, 2002; Pollak & Sinha,2002; Wilkowski & Robinson, 2012), 然而据我们所知并没有研究发现攻击性个体对恐惧表情敏感, 与此相反, 研究表明攻击性个体加工恐惧表情存在特异性缺陷(Blair & Coles, 2000; Carr & Lutjemeier,2005; Malone, Carroll, & Murphy, 2012), 因此我们认为当前研究所发现的敏感性更可能是对愤怒的敏感性。攻击性个体对愤怒表情表现出高度敏感性,得到神经成像研究的支持, 攻击性个体对愤怒面孔的反应表现出杏仁核过度激活(Beaver, Lawrence,Passamonti, & Calder, 2008; Carré, Murphy, & Hariri,2013; Coccaro, McCloskey, Fitzgerald, & Phan, 2007)。攻击性个体可能经常应对攻击环境, 经过足够的练习, 提高了对他人愤怒表情的知觉敏感性(Wilkowski& Robinson, 2012)。愤怒表情作为一种直接威胁信号,预示着可能要发生的危险, 攻击性个体这种对模糊环境中威胁信号的高度敏感性, 可能有助于个体及时发现危险并作出恰当反应(Wilkowski & Robinson,2012), 对于经常处于攻击环境中的个体具有一定适应性价值(Pollak et al., 2009; Pollak & Kistler,2002)。

我们预期识别任务和辨别任务会出现转折点的差异, 但结果发现高、低攻击组的类别界线并没有显著差异, 这与支持偏向观点的研究结果不一致(Hall, 2006; Knyazev et al., 2008; Larkin et al., 2002;Sato et al., 2009), 原因可能是识别任务对类别界线的研究分辨率不够高。识别任务中是根据9张面孔的识别百分比通过拟合logistic函数所估算得到的值, 而不是直接测量得出的。识别任务结果表明高、低攻击个体的类别界线都位于面孔4(40%愤怒60%恐惧表情)和面孔5(50%愤怒50%恐惧表情)之间,但高、低攻击个体的类别界线差异可能显著(比如,低攻击组类别界线为4.1, 高攻击组类别界线为4.9), 而研究中所使用的渐变刺激间距(10%)较大,导致估算的值与实际情况有差距, 可能掩盖了组间差异, 从而造成识别任务中两组被试类别界线差异不显著。另外, 当前研究所选的被试均是在校大学生, 相对于极端攻击性个体(如暴力罪犯), 当前研究中高攻击组被试的攻击性较低, 这可能是识别任务和辨别任务中转折点差异不显著的原因之一。识别任务结果还发现, 在识别面孔1时, 高攻击个体的反应时显著快于低攻击个体, 而识别其它面孔时两组被试差异不显著, 这可能是由于高攻击个体对愤怒表情更加敏感, 识别愤怒表情时更加自信。

为了进一步了解攻击问卷中各个子维度与愤怒—恐惧表情加工的关系, 我们分析了攻击问卷5个分量表中各个子维度的得分对愤怒知觉敏感性的影响。结果发现言语攻击、愤怒、敌意三个维度的高攻击个体对愤怒表情的知觉敏感性显著高于低攻击个体, 当然身体攻击(协方差分析)和自戕(偏相关分析)也一定程度上影响对愤怒表情识别的敏感性, 只是结果相对不稳定。Wilkowski和Robinson(2012)以被试在身体攻击量表上的得分来区分高、低攻击被试, 发现高攻击个体对愤怒表情更敏感;Hall (2006)发现自我报告的言语攻击和敌意态度得分与愤怒识别倾向存在正相关, 这与我们的研究结果较一致。然而, 这与Wilkowski和Robinson (2012)的研究存在不一致之处, 后者发现对愤怒的敏感性与言语攻击、愤怒特质、敌意态度没有相关, 一种可能的原因是, Wilkowski和Robinson研究中的被试是将54名大学生区分为高、低攻击组, 而我们研究的被试是从846名大学生中通过攻击问卷筛选出来的, 相对来说被试挑选更严格, 对攻击性水平的控制更可靠。

本研究具有一定的局限性。本研究采用愤怒—恐惧连续体是为了区别反应偏向和敏感性, 结果表明高攻击个体对愤怒和恐惧表情的转变具有更高的知觉敏感性。我们根据前人研究推断高攻击个体对愤怒、恐惧表情转变的高敏感性是由于对愤怒表情的敏感性, 在目前结论基础上还可以进一步验证和研究敏感性来源。中性和情绪性的混合表情更适合研究敏感性(Jusyte & Schönenberg, 2014; Wilkowski& Robinson, 2012), 因此未来研究可以使用中性—情绪性渐变表情作为材料考察攻击性个体对不同表情的知觉敏感性。另外, 我们并没有评估被试的焦虑、抑郁水平, 而焦虑、抑郁等因素可能影响表情识别类别界线的偏移(Bell et al., 2011; Liu et al.,2012), 这可能影响对攻击性与转折点和敏感性关系的考察。未来研究应选择更有代表性的被试样本,尽量排除影响表情识别的其它心理因素, 考察攻击性个体识别表情的模式是否异于正常人。

5 结论

本研究采用类别知觉范式, 通过logistic函数对数据进行分析, 考察正常人群中高、低攻击个体对愤怒表情的加工, 结果发现, 高攻击个体不存在敌意归因偏向, 而是对愤怒和恐惧表情的转变具有更高的敏感性。

Bagcioglu, E., Isikli, H., Demirel, H., Sahin, E., Kandemir, E.,Dursun, P.,... Emul, M. (2014). Facial emotion recognition in male antisocial personality disorders with or without adult attention deficit hyperactivity disorder.Comprehensive Psychiatry, 55

, 1152–1156.Beaver, J. D., Lawrence, A. D., Passamonti, L., & Calder, A. J.(2008). Appetitive motivation predicts the neural response to facial signals of aggression.Journal of Neuroscience, 28

,2719–2725.Bell, C., Bourke, C., Colhoun, H., Carter, F., Frampton, C., &Porter, R. (2011). The misclassification of facial expressions in generalised social phobia.Journal of Anxiety Disorders,25

, 278–283.Best, M., Williams, J. M., & Coccaro, E. F. (2002). Evidence for a dysfunctional prefrontal circuit in patients with an impulsive aggressive disorder.Proceedings of the National Academy of Sciences of the United States of America, 99

,8448–8453.Blair, R. J. R., & Coles, M. (2000). Expression recognition and behavioural problems in early adolescence.Cognition Development, 15

, 421–434.Buss, A. H., & Perry, M. (1992). The aggression questionnaire.Journal of Personality and Social Psychology, 63

, 452– 459.Calder, A. J., Young, A. W., Perrett, D. I., Etcoff, N. L., &Rowland, D. (1996). Categorical perception of morphed facial expressions.Visual Cognition, 3

, 81–118.Calvo, M. G., & Lundqvist, D. (2008). Facial expressions of emotion (KDEF): Identification under different displayduration conditions.Behavior Research Methods, 40

, 109– 115.Campanella, S., Quinet, P., Bruyer, R., Crommelinck, M., &Guérit, J.-M. (2002). Categorical perception of happiness and fear facial expressions: An ERP study.Journal of Cognitive Neuroscience, 14

, 210–227.Carr, M. B., & Lutjemeier, J. A. (2005). The relation of facial affect recognition and empathy to delinquency in youth offenders.Adolescence, 40

, 601–619.Carré, J. M., Murphy, K. R., & Hariri, A. R. (2013). What lies beneath the face of aggression?Social Cognitive and Affective Neuroscience, 8

, 224–229.Coccaro, E. F., McCloskey, M. S., Fitzgerald, D. A., & Phan,K. L. (2007). Amygdala and orbitofrontal reactivity to social threat in individuals with impulsive aggression.Biological Psychiatry, 62

, 168–178.De Castro, B. O., Veerman, J. W., Koops, W., Bosch, J. D., &Monshouwer, H. J. (2002). Hostile attribution of intent and aggressive behavior: A meta-analysis.Child Development,73

, 916–934.Dodge, K. A. (2006). Translational science in action: Hostile attributional style and the development of aggressive behavior problems.Development and Psychopathology,18

(3), 791–814.Fairchild, G., Stobbe, Y., van Goozen, S. H. M., Calder, A. J.,& Goodyer, I. M. (2010). Facial expression recognition,fear conditioning, and startle modulation in female subjects with conduct disorder.Biological Psychiatry, 68

, 272–279.Fairchild, G., van Goozen, S. H. M., Calder, A. J., Stollery, S.J., & Goodyer, I. M. (2009). Deficits in facial expression recognition in male adolescents with early-onset or adolescence-onset conduct disorder.Journal of Child Psychology and Psychiatry, 50

, 627–636.Fugate, J. M. B. (2013). Categorical perception for emotional faces.Emotion Review, 5

, 84–89.Hall, C. W. (2006). Self-reported aggression and the perception of anger in facial expression photos.The Journal of Psychology, 140

, 255–267.Hastings, M. E., Tangney, J. P., & Stuewig, J. (2008).Psychopathy and identification of facial expressions of emotion.Personality and Individual Difference, 44

, 1474– 1483.Hoaken, P. N. S., Allaby, D. B., & Earle, J. (2007). Executive cognitive functioning and the recognition of facial expressions of emotion in incarcerated violent offenders,non-violent offenders, and controls.Aggressive Behavior,33

, 412–421.Huang, J., Chan, R. C. K., Gollan, J. K., Liu, W. H., Ma, Z., Li,Z. J., & Gong, Q.-Y. (2011). Perceptual bias of patients with schizophrenia in morphed facial expression.Psychiatry Research, 185

, 60–65.Jusyte, A., & Schönenberg, M. (2014). Threat processing in generalized social phobia: An investigation of interpretation biases in ambiguous facial affect.Psychiatry Research, 217

, 100–106.Kee, K. S., Horan, W. P., Wynn, J. K., Mintz, J., & Green, M. F.(2006). An analysis of categorical perception of facial emotion in schizophrenia.Schizophrenia Research, 87

, 228–237.Knyazev, G. G., Bocharov, A. V., Slobodskaya, H. R., &Ryabichenko, T. I. (2008). Personality-linked biases in perception of emotional facial expressions.Personality and Individual Differences, 44

, 1093–1104.Kosson, D. S., Suchy, Y., Mayer, A. R., & Libby, J. (2002).Facial affect recognition in criminal psychopaths.Emotion,2

, 398–411.Larkin, K. T., Martin, R. R., & McClain, S. E. (2002). Cynical hostility and the accuracy of decoding facial expressions of emotions.Journal of Behavioral Medicine, 25

, 285–292.Li, X. Y., Phillips, M. R., Zhang, Y. L., Niu, Y. J., Tong, Y. S.,& Yang, S. J. (2011). Development, reliability and validity of the Chinese version of buss & Perry aggression questionnaire.Chinese Journal of Nervous and Mental Diseases, 37

, 607–613.[李献云, 费立鹏, 张亚利, 牛雅娟, 童永胜, 杨少杰. (2011).Buss和Perry攻击问卷中文版的修订和信效度.中国神经精神疾病杂志, 37

, 607–613.]Liu, W.-H, Huang, J., Wang, L.-Z., Gong, Q.-Y., & Chan, R. C.K. (2012). Facial perception bias in patients with major depression.Psychiatry Research, 197

, 217–220.Lopez-Duran, N. L., Kuhlman, K. R., George, C., & Kovacs,M. (2013). Facial emotion expression recognition by children at familial risk for depression: High-risk boys are oversensitive to sadness.Journal of Child Psychology and Psychiatry, 54

, 565–574.Malone, A., Carroll, A., & Murphy, B. P. (2012). Facial affect recognition deficits: A potential contributor to aggression in psychotic illness.Aggression and Violent Behavior, 17

, 27– 35.Marsh, A. A., & Blair R. J. R. (2008). Deficits in facial affect recognition among antisocial populations: A meta-analysis.Neuroscience and Biobehavioral Reviews, 32

, 454–465.Pajer, K., Leininger, L., & Gardner, W. (2010). Recognition of facial affect in girls with conduct disorder.Psychiatry Research, 175

, 244–251.Penton-Voak, I. S., Thomas, J., Gagel, S. H., McMurran, M.,McDonald, S., & Munafò, M. R. (2013). Increasing recognition of happiness in ambiguous facial expressions reduces anger and aggressive behavior.Psychological Science, 24

, 688–697.Pollak, S. D., & Kistler, D. J. (2002). Early experience is associated with the development of categorical representations for facial expressions of emotion.Proceedings of the National Academy of Sciences of the United States of America, 99

, 9072–9076.Pollak, S. D., Messner, M., Kistler, D. J., & Cohn, J. F. (2009).Development of perceptual expertise in emotion recognition.Cognition, 110

, 242–247.Pollak, S. D., & Sinha, P. (2002). Effects of early experience on children’s recognition of facial displays of emotion.Developmental Psychology, 38

, 784–791.Recio, G., Sommer, W., & Schacht, A. (2011). Electrophysiological correlates of perceiving and evaluating static and dynamic facial emotional expressions.Brain Research, 1376

, 66–75.Said, C. P., Dotsch, R., & Todorov, A. (2010). The amygdala and FFA track both social and non-social face dimensions.Neuropsychologia, 48

, 3596–3605.Said, C. P., Moore, C. D., Norman, K. A., Haxby, J. V., &Todorov, A. (2010). Graded representations of emotional expressions in the left superior temporal sulcus.Frontiers in Systems Neuroscience, 4

, 6.Sato, W., Uono, S., Matsuura, N., & Toichi, M. (2009).Misrecognition of facial expressions in delinquents.Child and Adolescent Psychiatry and Mental Health, 3

, 27.Schönenberg, M., & Jusyte, A. (2014). Investigation of the hostile attribution bias toward ambiguous facial cues in antisocial violent offenders.European Archives of Psychiatry and Clinical Neuroscience, 264

, 61–69.Schönenberg, M., Louis, K., Mayer, S., & Jusyte, A. (2013).Impaired identification of threat-related social information in male delinquents with antisocial personality disorder.Journal of Personality Disorders, 27

, 496–505.Staugaard, S. R. (2010). Threatening faces and social anxiety:A literature review.Clinical Psychology Review, 30

, 669– 690.Tsui, C. F., Huang, J., Lui, S. S. Y., Au, A. C. W., Leung, M. M.W., Cheung, E. F. C., & Chan, R. C. K. (2013). Facial emotion perception abnormality in patients with early schizophrenia.Schizophrenia Research, 147

, 230–235.Wilkowski, B. M., & Robinson, M. D. (2012). When aggressive individuals see the world more accurately: The case of perceptual sensitivity to subtle facial expressions of anger.Personality and Social Psychology Bulletin, 38

,540–553.Young, A. W., Rowland, D., Calder, A. J., Etcoff, N. L., Seth,A., & Perrett, D. I. (1997). Facial expression megamix:Tests of dimensional and category accounts of emotion recognition.Cognition, 63

, 271–313.