多特征融合的人脸表情识别

李春英,汤志康,黄春艳,颜春萍,张仙玉,陈 岚

(1.肇庆学院 计算机学院,广东 肇庆 526061;2.广东技术师范学院 计算机学院,广东 广州 510665)

人脸表情识别就是对面部表情信息进行特征提取并加以分析.目前表情识别已成为人机交互、情感计算、机器视觉、图像处理与模式识别等领域的重要研究课题.表情识别模型研究的重点主要集中在表情特征提取和特征分类2方面.国内外学者在此2方面已做了大量的研究,表情特征提取主要分为整体特征提取[1,2]和局部特征提取[3-5].其中,整体特征提取主要集中在面部的整体变化,并没有考虑面部肌肉的纹理、皱褶等局部变化所蕴含的信息;局部特征可以充分考虑不同尺度和方向的信息,不过特征向量维数过大、算法实时性较差.特征分类方法分为基于贝叶斯网络的分类方法[6]和基于距离度量的分类方法.前者缺点在于需要属性之间相互独立的假设,因此在一定程度上影响了算法的识别率;后者是通过计算样本之间的距离来实现表情分类,代表算法有近邻法[4]72-74和SVM算法[7].近邻法算法的存储量和计算量都比较大,而SVM算法是二类分类算法,在多类分类和大规模样本的运算上,还存在着一定的缺陷.基于以上分析,我们提出了一种表情识别模型:首先,将人脸图像预处理后,融合2种人脸表情局部特征描述算子(Gabor小波特征和多元中心化二值模式(MCBP)特征);然后通过主成份分析法(PCA)对各表情子区域的特征向量进行降维处理,避免特征向量维数过大的缺点,同时构建PCA随机子空间训练分类器,分类器采用文献[8]中心最近邻分类器(CNN),通过计算已标记点与该类中心的距离来度量样本特征的表情属性;最后,利用组合分类器实现对表情特征的精确分类.

1 表情图像预处理

为了更好的提取局部特征,原始图像的预处理是一个重要且必须的过程,目的是统一图像的灰度值及尺寸,输出纯表情区域,为表情特征提取奠定基础.预处理包括图像的归一化和表情区域的分割处理:前者包括图像的尺度归一化和灰度归一化,后者指从图像中分割出与表情最相关的区域.本文预处理的过程包括如下几个步骤:1)将人脸表情图像大小变为128×128像素,两眼之间的距离72像素;2)图像灰度的归一化,每像素是256灰度级;3)图像按照空间位置划分成64个大小为16×16且互不重叠的网格;4)根据人脸某些部位的信息对表情识别的贡献度(如眼睛、嘴部,被赋予较大的权值,而其他部位的贡献较小则被赋予较小的权值)分成13个表情子区域.表情图像预处理的流程如图1所示,其中表情贡献度按颜色深浅权值之比为1:2:4.赋予不同权值的目的是在最终分类决策的时候采用加权投票法进行融合处理.

图1 表情图像预处理

2 表情特征提取

相比全局特征描述,局部特征本身具有空间性和方向性的选择,且局部特征主要描述人脸表情的细节变化,方便进行精确识别.局部特征提取的经典方法是Gabor小波法和LBP(Local Binary Pattern)算子法[9].Gabor小波可以提取图像特定区域内不同尺度和方向空间的小波核函数,像显微镜一样放大灰度的变化,增强一些关键特征(眼睛、鼻子和嘴部).LBP特征可以更快地从原始图像中提取出来且位于较低维的空间,同时保留了有效的人脸信息;不过LBP算子本质上提取的是图像边缘、角点等局部变化特征,产生的直方图维数过长,影响识别速度,且没有考虑中心像素点的作用,因此特定情况下会丢失某些局部结构信息.综合以上因素,笔者采用Gabor小波特征和同时考虑多个尺度、中心化的LBP特征(Multi-scale Centralized Binary Pattern),简称MCBP特征.

2.1 Gabor小波特征

二维Gabor小波的核函数定义为一个用高斯包络函数约束的平面波:

其中:ku,v=kveiφu,kv=kmax/fv表示核函数的尺度(频率),φu=uπ/6表示核函数的方向,且φu∈[0,π),通常v∈{0,1,2,3},u∈{0,1,2,3,4,5},文中采用4个中心频率,6个方向组成的24个Gabor小波组成的小波簇用于表情特征的提取.Gabor变换的本质实际上是人脸图像I(z)与ψu,v(z)的卷积.

2.2 MCBP特征

MCBP特征是由不同尺度的中心化二元模式(CBP)组成的.CBP是基于局部二元模式(LBP)基础上改进得来的,CBP是一种有效的纹理描述算子,可以对灰度图像中局部邻近区域的纹理信息进行度量和提取.用CBP算子标记一幅图像f(x,y)的像素时,首先要确定中心像素及环形邻域,它由半径为R的圆周上对称分布的P个邻点构成,P和R可取任意值.需要指出的是:比较的“近邻点对”必须满足其连线穿过中心像素点gc,且中心像素点gc拥有最高权重.描述局部图像灰度特性的CBP码[4]:

其中,指gc表示环形邻域中心点的灰度值,gp表示半径为R的圆周上对称分布的P个邻点的灰度值,C是阈值,可手动设定.为进一步表征人脸各个局部区域上灰度幅值的变化,参考文献[10]引入梯度信息,即对人脸图像中每个像素点计算其梯度.假设人脸图像的f(x,y),在其坐标(x,y)的梯度则通过一个二维列向量表示: 一般来讲梯度向量指向坐标(x,y)的f最大变化率方向,向量的模值表示为:,在具体实现时文中采用作为梯度值.在人脸图像的每个像素点计算其梯度,并采用CBP在此梯度图上提取梯度直方图.对于每个网格MCBP特征的提取,通过改变参量R,分别计算出灰度的直方图和梯度的直方图(由向量表示)后,将它们串接起来构成的特征向量,得到ΦMCBP=,即融入梯度信息的特征MCBP特征向量.其中,CBPh(P,Rj)指由CBP算子产生的直方图.相比单纯由灰度的CBP直方图构成的特征,融入梯度信息的MCBP特征具有更强的鉴别能力.

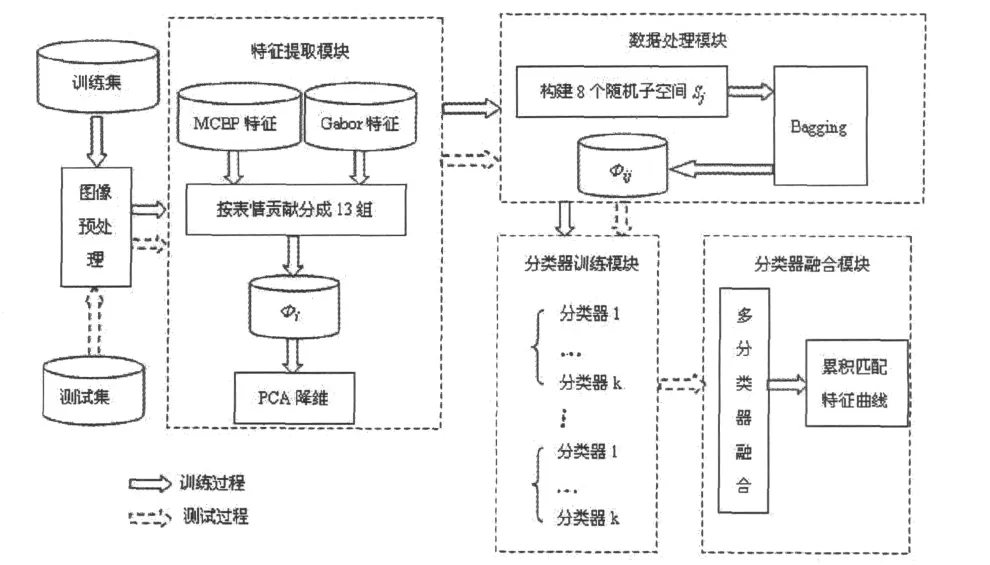

3 人脸表情识别模型

本文提出的人脸表情识别模型分成两大部分:图像的预处理和多特征融合判别分析(multi-feature fusion recognition analysis).图像预处理如前文所述进行图像的归一化和表情区域的分割处理,多特征融合判别分析分成4个部分:特征提取模块、数据处理模块、分类器训练模块、多分类器融合模块.具体过程如图2所示,为了更好地说明多特征融合判别分析的过程,将其分成训练过程和测试过程进行详细描述.

训练过程:特征提取模块将预处理后的图像按照空间位置网格化后,提取采用4个尺度、6个方向的Gabor小波,即每个网格特征向量的维数为16×16×4×6=6144.由于后续的分类器很难处理如此高维度的特征向量,我们利用4×4的空间网格对Gabor特征进行采样来降低维度,最终每个网格的Gabor特征向量的维数是384维;对于MCBP特征,提取半径R∈{1,3,5,7,9},P=(8个邻点)5个尺度8个方向的灰度直方图和梯度直方图CBP特征,然后将它们串接起来构成MCBP特征向量.单网格上每个尺度下的直方图为64(25×2)维,若把5个尺度下的直方图串接起来构成的每个网格特征维数将会是320(64×5)维.提取完2种特征后,将每种特征向量(图1)的表情子区域进行分组,2种特征向量共形成26组向量由于每组向量Φi的维度还比较高,影响识别的速度,我们通过主成份分析法(PCA)进行降维处理.假设原始数据每个样本有M个输入和N个输出.即原始数据表示为X1,X2,…,Xi∈RM,Y1,Y2,…,Yj∈RN.PCA具体算法如下:

Step1 根据相关系数公式,计算输入数据的相关矩阵R∈RM×M;

Step2 计算相关矩阵R的特征值,将非负的特征值按降序排列λ1≥λ2,…,λM≥0,对应的特征向量φ1, φ2,…,φM;

Step4 将变换矩阵Ln乘以原始输入数据,xi=Lnxi,得到反映数据主要信息量的前n个主成份.

由于整个面部按表情贡献度进行分组,分组后的部分子区域向量维数会达到上千维,为尽量避免表情图像的信息丢失,同时考虑计算量的大小,主成份分析后的向量维数保持在300维.在训练集数据处理模块中对降维处理后的特征向量Φi,通过相关矩阵中非零特征值所对应的特征向量来构建8个随机PCA子空间其中每个子空间的维数是300维,前200维由前200个固定最大的特征值所对应的特征向量整合而成,后100维在剩余的特征向量中随机抽取.这样做的目的是既能保留图像中大部分不变特征,又能抓住图像的细节特征.对每个PCA子空间利用Bagging技术从原始训练集中产生5个同等规模的训练集来训练5个单分类器.通过这种方式每个表情子区域会产生5×8个分类器.

测试过程:和训练过程一样将预处理后的图像提取2种特征向量,并按表情贡献度分组和进行PCA降维,然后经过数据处理模块处理,最后利用训练好的子空间分类器输出每个分组的判别结果.在多分类器融合模块中,分类器采用中心最近邻分类器,先利用最小-最大值规范化的方法把不同子空间分类器的输出归一化[11].然后利用加权投票法进行最终判别,权值的分配按照图1的表情贡献度(1:2:4)进行处理.

图2 人脸表情识别模型

4 仿真实验

为验证算法的有效性,选用人脸表情库(JAFFE)进行实验,此数据库包含了10名日本女性的213幅图像,每人包含6种基本表情(生气、厌恶、恐惧、高兴、悲伤、吃惊)和2~4个中性表情灰度图像.图3是数据库中的部分表情图像.实验分为2个阶段.

图3 JAFFE部分表情图像

1)检验算法的广泛适用性.从JAFFE数据库中选取210幅图像(保证6种基本表情3幅)作为样本,采用10-fold交叉验证(cross-validation)的实验方案,分类器采用中心最近邻分类器(CNN).从实验结果(见表1)可以算出7种表情的平均识别率达到91.1%.其中,高兴、惊讶、中性表情的识别率较好,厌恶、悲伤的识别率较低;因为表情变化越明显,相应的特征向量的差异越大越容易识别,而变化不明显的表情,相应的特征向量变化差异较小,识别效果相对会差一些.

2)检验模型算法的鲁棒性.实验前,根据文献[12]中算法对JAFFE人脸库中的图像做了不同程度的光照处理,得到处理后的图像210幅,加上原来选取的210幅表情图像,这样实验数据库中共有420幅表情图像.实验中,随机选取每个人每种表情的3幅图像共210幅作为训练集,剩余图像作为测试集.分别选择单独使用Gabor小波特征和MCBP特征以及采取2种特征相结合的特征描述算子,共3种方法进行实验,并生成累积匹配特征曲线(CMC),如图4所示.图中显示采用多特征融合的判别方式明显好于单一特征,即使有光照的影响,模型Rank-1的识别率也已经达到87%,具备较好的鲁棒性.需要说明的是,累积匹配特征曲线的横坐标为排名次序,纵坐标为测试者的正确表情包含在识别系统提供的最相似的候选者中的概率.如果由人脸识别系统在一个大型的人脸数据库中仅找出一幅与测试者最近的人脸图像,那么结果未必是正确的;如果允许识别系统找出多幅与测试者最相近的人脸图像,那么结果正确的概率就会增加.随着允许识别系统找出最相近的人脸图像数目的增加,结果正确的概率也会随之增加.比如:在表情识别的测试集中某人“高兴”的表情有3幅图像,累积匹配特征曲线能够指出3幅图像的排名次序,但同样都是识别正确.在JAFFE表情库上的实验表明,提出的多特征融合的判别模型具有较好的识别精度和鲁棒性.

表1 JAFFE表情识别结果统计

图4 不同方法的累积匹配特征曲线

5 结束语

提出了一种基于多特征融合的人脸表情识别模型:利用人脸识别领域被证明非常成功的2种局部描述算子(Gabor小波特征和MCBP特征),根据表情变化的先验知识将图像划分为权值不同的表情子区域,为保证识别的速度,利用主成份分析法(PCA)降低局部特征向量的维度,通过Bagging技术提高多分类器的鲁棒性.实验表明该方法具有良好的识别效果.下一步的工作重点是如何在任意采集的图像或图像序列中提取维度较低且具有代表力的局部特征,对其进行表情分类.此外,人脸表情识别是人机交互、机器学习和图像处理等领域涉及的重要研究方向,这是一项极具挑战性的研究任务,需要心理学、生理学以及计算机视觉、模式识别等不同领域的研究者共同进行探索.

[1] 周书仁,朱灿.基于ICA和HMM的表情识别[J].中国图象图形学报,2008,13(12):2321-2328.

[2] 应自炉,唐京海,李景文,等.支持向量鉴别分析及在人脸表情识别中的应用[J].电子学报,2008,36(4):725-730.

[3] KYPEROUNTAS M,TEFAS A,PITAS I.Salient feature and reliable classifier selection for facial expression classification[J]. Pattern Recognition,2010,43:972-986.

[4] 付晓峰.基于二元模式的人脸识别与表情识别研究[D].杭州.浙江大学,2008.

[5] XIE X D,LAM K M,Facial expression recognition based on shape and texture[J].Pattern Recognition,2009,42:1 003-1 011.

[6] WANG T H,LIEN J,Facial expression recognition system based on rigid and non-rigid motion separation and 3D pose estimation[J].Pattern Recognition,2009,42:962-977

[7] 徐琴珍,章品正,裴文江,等.基于混淆交叉支撑向量机树的自动面部表情分类方法[J].中国图象图形学报,2008,13(7): 1329-1334.

[8] GAO Q,WANG Z.Center-based nearest neighbor classifier[J].Pattern Recognition,2007,40:346-349.

[9] 蒋斌,贾克斌,杨国胜.人脸表情识别的研究进展[J].计算机科学,2011,38(4):25-30.

[10] OJALA T,PIETIKAINEN M,MAENPAA T.Multi-resolution gray-scale and rotation invariant texture classification with local binary patterns[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(7):971-987.

[11] LI Z F,UNSANG P,JAIN K A.A Discriminative Model for Age Invariant Face Recognition[J].IEEE Transactions on Information Forensics and Security.2011,6(3):1028-1037.

[12] 白雪飞,李茹.神经网络集成的多表情人脸识别方法[J].计算机工程与应用,2010,46(4):145-148.