基于语义分割的输送带跑偏智能检测方法

摘"要:受设备老化与表面受力不均匀的影响,带式输送机易跑偏,导致故障和物料撒落。传统监测方法成本高且安装复杂,为此,本研究提出基于深度学习的智能检测方法,构建皮带线语义分割数据集并标注;使用Unet模型检测皮带线,并通过MiT编码器优化;引入像素位置感知损失强化训练;利用概率霍夫变换提取皮带线的直线位置,定量分析偏移程度。试验结果显示,本模型在皮带线预测上IoU达61.34%,仅占12.93GFlops,具备高效实时性,适用于多种输送带场景。

关键词:深度学习;语义分割;MiT"Encoder;机器视觉

随着数字化和智能化技术的推进,无人设备在工业领域的应用使得过程更加安全高效。带式输送机因传输效率高、稳定性强,广泛应用于钢铁、煤矿等领域,正朝着智能化方向发展。然而,输送带在长期运行中容易因受力不均而跑偏,导致设备磨损、能耗增加,甚至可能引发安全事故。因此,输送带跑偏检测技术已成为工业自动化领域的研究热点,及时检测并纠正偏移对于确保设备安全至关重要[12]。

工业现场的皮带偏移检测方法分为接触式和非接触式两类。接触式检测依赖偏移传感器,通过位移感应触发报警或自动纠偏,虽然结构简单,但易受环境影响,且机械磨损大,需定期维护。非接触式检测包括激光和视觉检测,其中激光检测通过光电系统监测皮带边缘位置,当偏移时激光信号变化触发报警。参考文献[2]的研究表明,激光技术提高了检测精度,但由于成本高、环境要求苛刻,安装维护复杂,不适用于一般工业场景。

基于视觉的皮带偏移检测通过工业相机拍摄皮带运行状态,利用图像处理技术分析位置和角度。随着图像处理算法与边缘计算的发展,该方法在复杂环境中表现优异。参考文献[3]通过灰度变换、二值化、形态分析、canny边缘检测和hough线检测等操作,提取皮带边缘直线特征判断偏移,参考文献[2]也采用类似方法实现判偏。然而,这类传统算法易受成像环境和光照影响,对纹理信息敏感,且需定制化特征,难以适应新环境。近年来,基于深度学习的算法逐渐应用于皮带偏移检测。

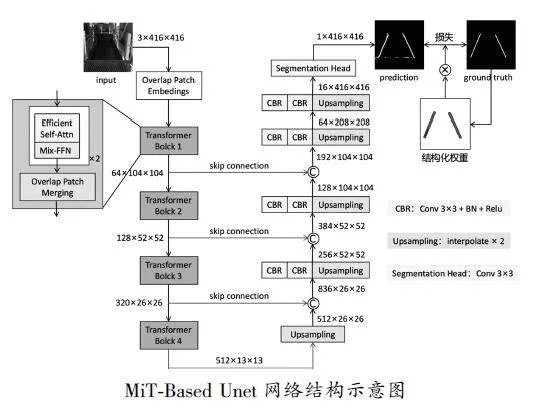

为了提高视觉检测算法的鲁棒性,我们用到了基于Unet[4]框架的语义分割网络模型,对皮带位置进行提取。由于皮带线像素占比较低且依赖全局信息,传统Unet模型难以精确识别,我们使用MiT(Mix"Transformer)[5]编码器对Unet进行了改进,同时提高了皮带线识别的精度和速度。

1"语义分割网络模型

语义分割任务对图像进行逐像素分类。传统方法依赖人工特征提取和图像处理技术,需手动设计和调整参数,泛化能力有限。自2014年全卷积网络FCN[6]提出后,基于深度学习的语义分割网络逐渐兴起。2015年,Unet[4]通过编码解码结构成为经典模型,这些网络通过端到端方式自动学习特征,消除了手动设计的需求,使得深度学习方法逐渐主导语义分割任务[7]。

1.1"Unet模型原理

Unet是一种卷积神经网络(CNN),最初用于生物医学图像的像素级分割,适合小样本数据集。其结构包括收缩路径、扩展路径和跳跃连接。收缩路径类似编码器,通过卷积和池化逐级提取抽象特征;扩展路径类似解码器,通过上采样和卷积还原图像分辨率;跳跃连接将收缩路径中的特征图传递给扩展路径,帮助保留细节信息。

1.2"引入MiT编码头

卷积神经网络受限于卷积核,仅能提取局部特征。为增大感受野,通常堆叠多个卷积块,增加池化层,导致特征图分辨率降低和细节丢失,限制了语义分割的发展。对于本研究的皮带线分割任务,因其形状细长,网络难以在全局范围内理解线状特征的同时保留边缘细节。

Transformer[8]最初为自然语言处理设计,由自注意力层和前馈全连接层组成,自注意力机制使模型能够关注输入序列中不同位置之间的关系,尤其在处理长距离依赖和序列到序列任务时表现出色,适合本研究的皮带线分割任务。近年来,Transformer在图像处理领域逐渐展现优势,出现了针对图像处理的变种[5,9]。这些编码器可与Unet模型结合,为输入图像提取特征并进行下采样,利用Unet的跳跃连接实现精确的皮带线分割。

1.3"引入像素位置感知损失

在语义分割任务中,选择合适的损失函数对模型训练至关重要。经典的二元分类损失函数包括二元交叉熵损失(BCE损失)和交并比(IoU损失),前者量化预测概率与真实分布之间的差异,后者评估预测分割与真实分割的重叠程度。然而,在皮带线分割任务中,由于边缘仅占几个像素,传统损失函数往往过于关注背景区域,无法有效集中注意力于前景。为此,本研究采用像素位置感知损失(PPA损失)[10],通过合成局部结构信息生成逐像素权重图,优先考虑前景轮廓的细节,从而提高模型训练的有效性。

2"试验结果与分析

2.1"皮带线图像数据集搭建

为了确保皮带数据集的多样性,避免从同一视频中提取大量重复帧导致模型过拟合,本项目除了使用工业生产线拍摄的皮带数据外,还通过网络收集了额外样本,确保图像样本的差异性。最终,我们获得了322个包含丰富工业场景和皮带类别的图像样本。

对于每一个图像样本,我们将其缩放到512×512像素的分辨率。利用Labelme软件进行皮带线标注,并导出成黑白掩码图,皮带线的宽度选取为8个像素点。

通过对样本按照8∶2的比例划分,我们得到258张训练样本和64张测试样本。在模型训练之前,我们对训练集图像进行预处理:先随机裁剪到416×416像素的分辨率,然后对图像进行随机旋转与翻转;最后对图像的亮度、对比度、饱和度、色调设置了随机扰动。

2.2"结果与分析

为了精确地对网络训练结果进行定量评估,我们将预测概率阈值设置为0.5,以将皮带线分割图进行二值化。通过将该图与真实标签进行比较,能够计算真阳性(TP)、真阴性(TN)、假阳性(FP)和假阴性(FN)各自的像素占比。然后可以定义不同的指标来评估分割网络性能表现,包括像素精度(Acc)、交并比(IoU)、精度(Pre)、召回率(Rec)和F1Score(F1值)。

像素精度表示分类正确的像素与图像像素总数的比率。由于本皮带线分割任务,线前景所占的像素点极低,绝大多数像素点属于背景像素,因此像素精度主要受背景像素的分类情况主导,其数值趋近于1。

Acc=TP+TNTP+TN+FP+FN(1)

交并比是某一类别的预测结果区域与真实标签区域的交集与并集的像素点数量的比值,该值越接近1表示对于该类别,预测与真实标签越接近。对于本皮带线分割任务,交并比是最主要的评价指标。

IoU=TPTP+FP+FN(2)

精度和召回的定义分别如下:

Pre=TPTP+FP(3)

Rec=TPTP+FN(4)

F1Score是精度和召回率的调和平均值,能够同时考虑召回率和精度,通常用于不平衡数据集下的算法性能评估,计算如下:

F1=2×Pre×RecPre+Rec(5)

为了便于加速训练,原始Unet和MiTBased"Unet的编码器部分使用了ImageNet预训练权重作为初始权重。模型总共训练100个Epoch,Batchsize设置为4,模型初始学习率设置为1e3,以Poly方式进递减衰减至零,多项式衰减系数为0.9,使用SGD作为优化器,权值衰减为5e4,动量系数为0.9。

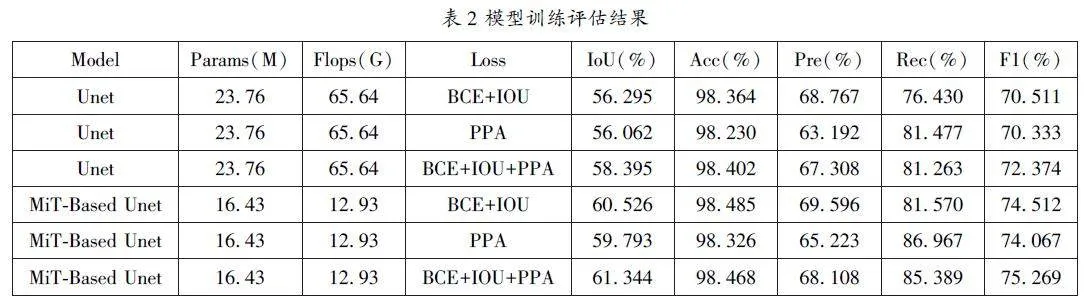

对修改后的模型进行评估,结果如表2所示。

前三组实验在Unet模型的基础上尝试了不同的损失函数,由表可知,单独的PPA损失只考虑真实前景标签的周围区域,其效果弱于经典的BCE+IOU损失组合,但当PPA损失与经典损失相结合,则可以在兼顾全局图像的基础上着重关注待分割对象区域。实验证明,模型推理的IoU指标达到58.395%,相较于原始损失函数提升了21个百分点,训练效果显著改进。

从后三组实验可知,MiTBased"Unet得益于精简高效的自注意力编码头,所需参数和计算量都小于相同深度的原始的基于cnn模型的Unet,参数量缩减了1.44倍,计算量缩减了5.08倍。训练的模型在测试集上最高达到61344%交并比,这对于只存在8个像素宽度真实标签的皮带线分割而言,已经是属于比较高的分割性能,已经接近与人工标记的误差范围。

全体实验组的像素精度指标都在98%以上,说明占绝大多数像素的环境背景类别在该项指标当中占据主导作用,进一步印证了引入MiT编码器和PPA损失对于改善分割性能的作用。

3"后处理

如下图所示,将输入图像送入神经网络后,可得到预测的分割掩码图。为了检测输送带位置并进行跑偏监测,需要进一步对掩码图进行直线拟合。由于直接采用霍夫变换可能受分割扰动影响而产生多条直线,我们采用概率霍夫变换提取短线段,并对其进行聚类与连接,从而获得完整的皮带线拟合坐标和斜率。根据模型预测结果,可以准确拟合直线位置,达到肉眼观察的判偏精度。以图像中心为参考点,可以得到左右直线在h/2位置的横坐标,即为左右皮带线的定量像素位置。最后,设置跑偏阈值(按经验选取为皮带宽度的十分之一),实现跑偏检测。

结语

本研究设计了一个基于深度学习的输送带边缘识别与跑偏检测系统,选择Unet作为线检测算法,并用MiT架构优化编码器,以增强全局语义信息的捕获能力,提高检测精度。我们搭建了实验平台,收集并标注了皮带线图像,建立了皮带线分割数据集。在数据增强后,训练过程中引入了像素位置感知损失,强化模型对皮带线前景的学习。对于模型生成的预测掩码图,使用概率霍夫变换进行直线拟合,获取直线的点斜式位置信息,以实现定量判偏监测。

参考文献:

[1]PANG"Y.Intelligent"belt"conveyor"monitoring"and"control[M].Delft:TRAIL"Research"School,2010.

[2]ZHANG"M,SHI"H,Yu"Y,et"al.Conveyor"deviation"detection"system[J].Applied"Sciences,2020:110.

[3]WANG"J,LIU"Q,DAI"M.Belt"vision"localization"and"deviation"detection[C]//YAC,IEEE,2019:269273.

[4]RONNEBERGRE"O,FISCHER"P,BROX"T.UNet"for"image"segmentation[J].Lect.Notes"Comput.Sci.,2015,9351:234241.

[5]XIE"E,WANG"W,YU"Z,et"al.SegFormer:Transformers"for"Semantic"Segmentation[J].Adv.Neural"Inf.Process.Syst.,2021,34:1207712090.

[6]LONG"J,SHELHAMER"E,DARRELL"T.Fully"Convolutional"Networks"for"Semantic"Segmentation[C]//Proc.CVPR,2015:34313440.

[7]SU"J,ZHU"X,LI"S,et"al.AI"empowered"UAVs"for"precision"agriculture[J].Neurocomputing,2023,518:242270.

[8]VASWANI"A,SHAZEER"N,Parmar"N,et"al.Attention"is"All"You"Need[J].NeurIPS,2017,30:59986008.

[9]BEYER,A"L,KOLESNIKOV"A,et"al.An"Image"is"Worth"16x16"Words:Transformers"for"Image"Recognition"at"Scale[J].Adv.Neural"Inf.Process.Syst.,2020,33:1241012421.

[10]WEI"J,WANG"S,HUANG"Q.F3Net"for"salient"object"detection[J].AAAI,2020,34(7):1232112328.

福建省区域发展项目:圆管带式输送机智能巡检技术与装备的开发及应用,项目编号:2022H4027

作者简介:李南雁(2001—"),男,汉族,湖北黄石人,硕士在读,从事机器视觉工业巡检;廖辉(1989—"),男,汉族,福建武平人,硕士,高级工程师,研究方向:大型散料输送设备智能化开发;赵龙(1996—"),男,汉族,湖南永州人,博士在读,从事机器视觉工业巡检;苏金辉(1974—"),男,汉族,福建永定人,高级工程师,研究方向:散料输送系统设计和设备智能巡检系统开发;蓝武生(1990—"),男,畲族,福建上杭人,工程师,研究方向:散料巡检系统开发;陈夕松(1970—"),男,汉族,安徽全椒人,教授,博士生导师,研究方向:先进过程控制、扰动抑制理论及其在过程中的应用。