基于注意力机制和元特征二次重加权的小样本目标检测

林润超,黄荣,董爱华

(东华大学 信息科学与技术学院,上海 201620)

0 引言

得益于飞速发展的大数据技术,大量有效标注的数据集推动了目标检测的发展。大部分基于卷积神经网络(Convolutional Neural Network,CNN)的目标检测模型需要由大量的标注数据驱动训练。然而,在一些特殊的应用场合,如病灶检测[1]和稀有动物检测[2]等,可用数据少且缺乏有效的标注。因而,基于传统CNN 的目标检测模型往往效果不佳,还可能出现过拟合等问题。为应对数据不足场景下的目标检测任务,小样本目标检测是近一段时间以来的研究热点[3-6]。

基于元学习的小样本目标检测[7-9],通过所提取的图像元特征来记忆预测梯度,从而实现小样本目标分类和检测。基于数据扩充的方法[10-12]通过视频取帧、数据增强等手段增加数据量。虽然这类方法取得了一定效果,但可能会引入噪声,从而影响检测性能。此外,文献[10,13]提出通过构建子模型来获取附加数据。然而,这类方法不但需要大量的标注数据,还需要手工设定较多的特征参数,与小样本目标检测的初衷相悖。

在小样本深度学习模型中引入注意力机制可以自适应地增强对图像前景目标区域的感知,抑制背景区域中的无关信息的干扰,是提高目标区域的元特征可区分性能的重要手段。利用Faster-RCNN(Faster-Region Convolutional Neural Networks)[14]中区域候选框提取网络(Region Proposal Network,RPN),Fan等[15]提出了一种可自适应关注目标区域的注意力机制,提取到了可区分性能较好的元特征。徐诚极等[16]在YOLOv3(You Only Look Once-version3)[17]的特征提取网络中融入了空间注意力和通道注意力机制,改善了模型对图像关键特征的筛选能力,获取了可区分性能较好的元特征,从而提升了模型在小样本场景下目标检测的准确率。

基于迁移学习的小样本目标检测方法考虑将大样本源域中学习到的图像元特征信息迁移至小样本目标域,在实现源域和目标域元特征信息共享的基础上提升小样本目标检测器的性能。Chen等[18]提出的小样本迁移检测器(Low Shot Transfer Detector,LSTD)模型中,将候选框作为额外的监督信号来筛选元特征,较好地抑制了大部分背景特征。然而,该模型未完全利用图像元特征的细节信息,缺乏关注目标区域的注意力机制。Kang等[19]提出一种基于元特征迁移的小样本目标检测模型。其中,元特征重加权模块将大样本源域中学习到的元特征迁移至小样本目标域的特征图中,实现元特征的跨域,再通过YOLOv2[20]的检测头定位小样本目标。然而该元特征迁移模型存在着两个问题:1)缺乏关注图像中待识别目标的注意力机制,对于待识别目标周边背景区域的抑制能力不强;2)基于迁移学习的方法,通常均需要对元特征进行微调来实现跨域共享,这将引起元特征偏移,从而导致模型对大样本图像检测能力的下降。

针对上述两个问题,本文基于注意力机制和元特征二次重加权机制,提出了改进的元特征迁移模型Up-YOLOv3。在PASCAL VOC2007/2012 通用目标检测数据集上的实验结果表明,与Kang等[19]的原始元特征迁移模型Base-YOLOv2 相比,Up-YOLOv3 针对小样本图像检测的平均准确率均值(mean Average Precision,mAP)提升了2.3~9.1 个百分点;同时,与原始的基于YOLOv3 元特征迁移模型Base-YOLOv3 相比,Up-YOLOv3 针对大样本图像检测的mAP 也提升了1.8~2.4 个百分点。消融实验和可视化结果表明改进后的模型对不同类别的大/小样本图像均具有良好的泛化能力和鲁棒性。

1 原始元特征迁移模型

原始元特征迁移模型Base-YOLOv2[19]的框架如图1 所示,该模型主要由元特征提取模块D、元特征重加权模块M和检测模块P构成。特征提取模块D 采用DarkNet19[20],用于提取图像的元特征。元特征重加权模块M 由一个轻量级CNN 分类网络构成,该模块将大样本图像(支撑图像)的元特征信息进行重加权获得重加权的元特征向量。经过模块M的处理,使得模型中小样本图像(查询图像)可共享大样本图像的元特征信息。最后,检测模块P利用这些重加权元特征实现针对小样本图像的目标检测。

元特征重加权模块M 的输入是原始图像和目标掩膜的拼接。其中,目标掩膜为一幅二值图像,即原始图像中目标所在对应的区域标定为0,背景所对应的区域标定为1。然而,现有的目标检测掩膜通常用一个矩形框来划定目标的位置,缺乏像素级的指导信息,无法精准定位目标的轮廓。因而,在矩形框掩膜内仍存在着无关的背景干扰,对元特征的可区分性能造成负面影响,导致模型检测性能的下降。此外,该模型未考虑元特征迁移后的补偿措施,影响了模型对大样本图像的检测性能。

2 改进的元特征迁移模型

针对上述问题,本文对原始元特征迁移模型[19]进行以下两方面的改进:首先,引入基于卷积块注意力模块(Convolution Block Attention Module,CBAM)[21]的注意力机制模块。该模块能够生成像素级掩膜,从而以像素级别聚焦图像中的目标区域,自适应地滤除背景的干扰信息,提升元特征的可区分性能,为特征提取模块D 按类别抽取目标的元特征提供支撑。其次,设计一种基于压缩-激励(Squeeze and Excitation,SE)[22]的元特征二次重加权(SE-Secondary Meta-Feature Reweighting,SE-SMFR)模块。该模块通过可学习的激活操作调整了大样本中元特征在通道的权重,自适应地补偿了大样本元特征由于特征迁移所引起的偏移,缓解大样本图像检测能力的下降。改进的元特征迁移模型Up-YOLOv3采用YOLOv3 为主干网络,元特征提取模块D 为DarkNet53。Up-YOLOv3 的整体结构如图2 所示。

本文定义输入的大样本图像(支撑图像)为I,经过元特征提取模块D 得到具有m个通道的元特征F∈Rw×h×m,表示为F=D(I),利用基于CBAM 的注意力机制模块,生成大样本图像的像素级分割掩膜Μ。同理,小样本图像(查询图像)也通过模块D 得到具有m个通道的元特征Ff∈Rw×h×m。随后,元特征一次重加权模块M 将原始图像和像素级掩膜的拼接(Ii,Μi)作为输入,其中Ii(i=1,2,…,N)表示输入的大样本图像,Mi表示对应的像素级掩膜。N表示待检测目标类别的总数,本文中N=20。重加权模块M 按类别输出重加权系数wi∈Rm,并通过式(1)实现大样本元特征向小样本元特征的迁移:

其中:⊗表示基于1×1 深度卷积的通道卷乘(channelmultiplication)。

随后,SE-SMFR 模块将Fi作为输入,通过压缩、激励和融合操作自适应地调整Fi的通道权重系数。接在二次重加权模块SE-SMFR 之后的检测模块P 以调整后的二次重加权元特征作为输入,对图像中目标类别的置信度o、目标预测框的位置信息(x,y,h,w)以及目标类别的分类得分c进行判决和预测。

本文使用Softmax 校正不同类别分类得分。具体地,第i个目标类别原始分类得分为ci,校正后的实际分类得分ĉi由式(2)计算得出:

结合交叉熵函数,得到对目标类别的损失函数Lc,如式(3)所示:

其中:I(·,i)表示目前所得到的候选检测框是否属于第i个目标类别。在本文检测任务中,定义预测框(Bounding Box)的回归损失函数为Lbbx,边框目标得分(objectness)的损失函数为Lobj,这两个损失函数与YOLOv3 定义的损失函数类似。综上所述,总损失函数如式(4)所示:

2.1 基于CBAM的注意力机制

为了使模型聚焦图像中的目标区域,本文采用CBAM 以像素级提取目标的轮廓信息。该模块嵌入在特征提取模块D 的最后一层。相较于传统通道注意力机制[22]仅关注通道维度上的元特征信息,CBAM 同时结合图像空间和通道上的特征信息,可实现图像目标边缘轮廓的像素级别分割,以便特征提取模块D 提取图像中目标关键细节元特征信息。

如图3 所示,本文所采用的基于CBAM 的注意力机制由一个通道注意力网络和一个空间注意力网络组成。通道注意力网络对输入特征的通道进行筛选,而空间注意力网络聚焦特征图中的显著区域。具体地,CBAM 的输入为D 所提取的元特征F,其维度为w×h×m。计算步骤如下:

1)通道信息修正。对于输入的元特征,以通道为单位,进行全局最大池化和全局平均池化,得到两个1 × 1 ×m的张量。将这两个张量的对应位置相加,得到一个1 × 1 ×m的融合张量。将融合张量经Sigmoid 函数激活后,与输入元特征图F按元素矩阵(element-wise)相乘,生成修正后的中间元特征F′。

2)空间信息与通道信息融合。将中间元特征F′以其空间位置为单位,对其m维的通道做平均池化和最大池化,得到两个大小为w×h的矩阵,并将这两个矩阵拼接。接着,利用一个大小为7 × 7 的卷积核对拼接后的张量进行卷积操作,降维为一个w×h× 1 的通道。经过Sigmoid 激活后再与输入的元特征F按元素矩阵相乘,生成目标区域注意力元特征F″。

为了展示该基于CBAM 的注意力机制的效果,利用Grad-CAM(Gradient-weighted Class Activation Mapping)[23]对注意力分配进行可视化,如图4 所示。

图4 是三幅输入图像(包含的目标分别为猫、鸟和船)和相对应的注意力分配可视化结果图,其中暖色调表示显著区域,冷色调表示背景区域。图4 的可视化结果表明嵌入在特征提取模块D 中的CBAM 能够较好地感知到图像中的显著区域和前景目标。

本文模型使用的像素级掩膜由上述注意力模块通过训练而生成。首先,保留元特征F″中目标区域的权重;然后,利用权重对注意力图加权求和,得到掩膜M,生成的掩膜如图5 第三行所示。与原始的矩形框掩膜图5 第二行相比,本文所用掩膜能够引导模型关注图像中与前景目标对应的显著区域,抑制背景的干扰,为提高元特征的可区分性能提供条件。

后文的消融实验显示使用改进的像素级掩膜之后,模型对于小样本图像的检测准确率有显著提升,验证了该注意力模块在元特征迁移模型中的作用。

2.2 基于SE的元特征二次重加权

为了解决微调后大样本图像的元特征发生偏移导致的检测准确率下降的问题,本文提出基于SE 的元特征二次重加权(SE-SMFR)模块。该模块通过压缩、激励和融合等操作调整大样本图像元特征的通道权重,实现二次重加权,从而补偿大样本图像中元特征的偏移。SE-SMFR 模块的结构如图6 所示。

SE-SMFR 模块的工作流程主要由以下三步构成:

1)压缩(Squeeze)。对大样本图像元特征图进行全局池化,压缩为1 × 1 ×m的向量。图6 中标记的SERadio为缩放参数,其目的在于通过减少通道数降低计算量。

2)激励(Excitation)。经过压缩后网络得到一个全局特征表达。将该特征输入两层全连接层,融合元特征中各维度信息,然后分别经过线性整流函数(Rectified Linear Unit,ReLU)函数和Sigmoid 函数激活,将元特征信息重新映射到0和1 之间。

3)元特征融合(Scale)。获得大样本图像元特征图的通道权重后,通过矩阵相乘将其与原始的元特征进行融合,从而补偿大样本图像元特征的偏移。

经过上述流程,图像元特征输入检测模块P之前进行二次加权调整,实现了大、小样本之间元特征信息的共享,同时弥补了由于特征迁移引起的元特征偏移。因此,Up-YOLOv3不但提升了小样本图像的目标检测准确率,还较好地保持了对大样本图像的检测性能。

3 实验与结果分析

3.1 实验准备

本文使用通用目标检测公开数据集PASCAL VOC2007[24]和PASCAL VOC2012[25]。将PASCAL VOC2007和PASCAL VOC2012 中的训练集和验证集用于模型训练,共16 551 张图片;PASCAL VOC2007 中的测试集用于测试模型,总共为4 952 张图片。两个数据集中一共包含20 个类别,分别为飞机、自行车、鸟、船、瓶子、小汽车、公交车、猫、狗、奶牛、沙发、马、人、饭桌、摩托车、盆栽植物、椅子、火车、电视、山羊。训练时,随机挑选其中5 个类别(后文称为新类)作为小样本图像,其余15 个类别(后文称为基类)作为本文大样本图像。为验证模型对不同类别图像的泛化能力和鲁棒性,本文设置3 组基类/新类组合,详细信息请参考3.3.1 节内容。

比如,学习儿童歌曲《小兔子乖乖》,教师可以让幼儿选择自己喜欢的角色,把自己扮演成小白兔、大灰狼,通过角色扮演的形式去把歌曲中的童话故事演绎出来,在幼儿演绎故事情节的时候能够加深他们对这首儿歌内容的理解,也能够点燃幼儿的学习兴致。然后教师可以让幼儿思考一下为什么小白兔见到大灰狼不能开门,也可以想象一下如果小白兔开了门故事会是怎样的结局,之后再相互讨论一下小白兔可以如何来化解自己的危机。教师可以鼓励幼儿将故事演绎成不同的版本,让幼儿自由地发挥自己的想象力,打破儿歌故事的束缚,大胆地对故事后续情节进行想象。

实验环境:操作系统基于Ubuntu18.04.5LTS,CPU 为Intel Xeon-2150B@3.00 GHz*20,显卡为双GeForce RTX 2080Ti,内存为32 GB,使用基于PyTorch 1.4.1 的深度学习框架。

3.2 训练步骤

本文通过双阶段训练方式来实现小样本目标检测:第一阶段针对标签信息充足的大样本图像对包括特征提取模块D、重加权模块M 和检测模块P在内的整个模型进行训练,共90 轮次。训练完成后,从大样本图像中提取元特征并获取重加权向量。第二阶段同时利用大、小样本图像进行训练,共20 轮次。此时,每个新类中只有k个图像带有标签信息。在第二阶段的训练过程中,为了平衡样本数量差异,也只从每个基类中选取k个带有标签信息的图像。该阶段训练的目标是通过模型微调,实现元特征迁移。为对比在给出不同标签信息数量的情况下模型对于小样本图像的检测效果以及检验模型鲁棒性,本文分别在k=1,2,3,5,10 的情况下进行实验。每次训练时批大小(Batch_Size)设为8,学习率设置为0.000 01。

3.3 实验结果及分析

为验证Up-YOLOv3 性能,本文设计了目标检测准确率对比实验、可视化实验和消融实验。实验采用Top-1 的检测平均准确率均值mAP 作为性能指标。

3.3.1 模型性能对比实验

本文分别设计小、大样本图像的目标检测性能对比实验。前者用于验证Up-YOLOv3 相较于Base-YOLOv2 及其他模型对小样本图像目标检测的性能优势;后者用于验证Up-YOLOv3 可以缓解对于大样本图像检测性能下降的问题。为验证模型鲁棒性,本文在这两个对比实验中均设置3 种不同的基类/新类组合进行交叉实验。

1)普通迁移模型LSTD[18],为公平地进行性能比较,对该模型的训练采用与本文类似的双阶段训练方法;

2)原始的基于YOLOv2 的元特征迁移模型Base-YOLOv2[19];

3)原始的基于YOLOv3 元特征迁移模型,称为Base-YOLOv3;

4)改进的基于YOLOv2 的元特征迁移模型,称为Up-YOLOv2;

5)改进的基于YOLOv3 的元特征迁移模型(即本文模型),称为Up-YOLOv3。

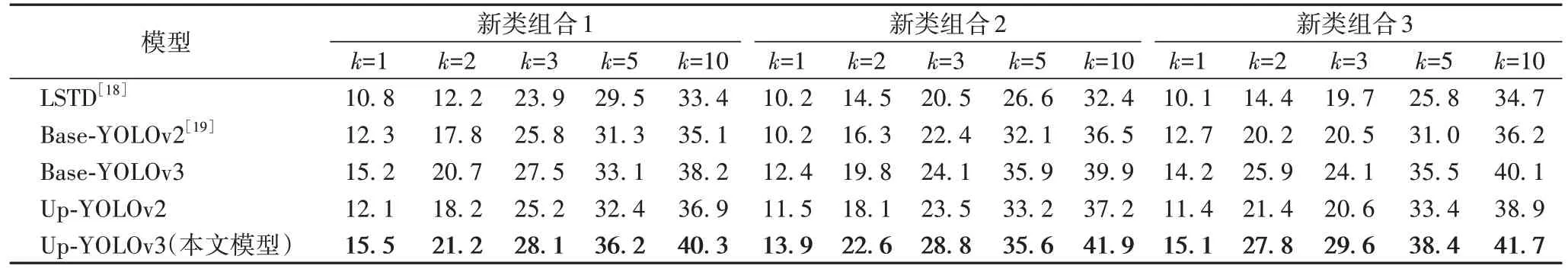

针对小样本图像检测的对比实验结果如表1 所示。新类组合1 中的小样本类别为鸟、沙发、奶牛、摩托车和公交车;新类组合2 的小样本类别为火车、电视、马、瓶子和狗;新类组合3 的小样本类别为山羊、自行车、奶牛、鸟、人。其余15 类为本文的基类。

表1 不同模型对小样本图像的mAP对比 单位:%Tab.1 Comparison of mAP among different models for few-shot object images unit:%

由表1 可知,针对小样本类图像检测,在不同新类组合中以及在标签信息k分别为1、2、3、5、10时,元特征迁移模型检测性能整体优于LSTD 模型;且相较于LSTD 模型,Up-YOLOv3 的mAP 最高提升了13.4 个百分点。对比4 个元特征迁移模型可知,基于YOLOv3 搭建的元特征迁移模型检测性能均优于基于YOLOv2 搭建的元特征迁移模型,且改进后的元特征迁移模型检测性能均优于原始元特征迁移模型。特别地,与Base-YOLOv2 相比,Up-YOLOv3 的mAP 最低提升了2.3 个百分点;随着k的增加,mAP 基本呈逐渐上升的趋势,在k=3时,mAP 最高提升了9.1 个百分点;在k=10时,mAP 提升了5.5 个百分点,此时Up-YOLOv3 的整体效果最优。该实验结果验证了Up-YOLOv3 的有效性。此外,Up-YOLOv3 在3 种不同小样本组合实验中,mAP 相对稳定,验证了Up-YOLOv3 对不同小样本组合图像识别的鲁棒性。

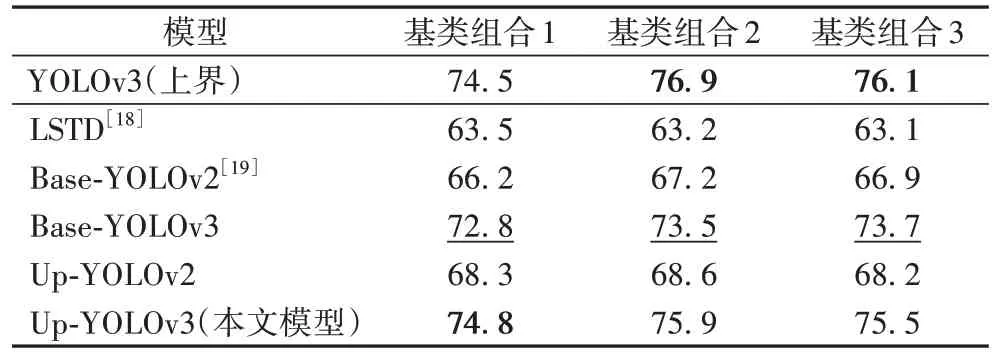

对于大样本图像的目标检测性能,除了对上述5 个模型外,增加了原始的YOLOv3 模型作为参照。该原始的YOLOv3 模型不考虑小样本目标检测问题,直接由大量带标注信息的数据驱动训练,不进行元特征重加权。因此,该模型作为目标检测性能对比的上界。大样本的检测性能的实验结果如表2 所示。

表2 中的3 种基类组合方式与表1 中的一致。下划线数据代表除Up-YOLOv3 外的次好准确率。表1 中的3 组新类组合与表2 中对应组别的基类组合共同构成PASCAL VOC数据集中的20 个类别,新类组合与基类组合之间互斥。

由表2 可知,Up-YOLOv3 在大样本图像上能达到与YOLOv3 相媲美的检测性能。注意到下划线数据,Base-YOLOv3 对大样本图像的mAP 显著高于Base-YOLOv2,原因是YOLOv3 网络本身就提升了对于对于图像的检测精度。故为展示本文模型(Up-YOLOv3)的改进效果,设计此对照实验以排除YOLOv3 网络本身对实验结果的影响。可以发现Up-YOLOv3 的mAP 比Base-YOLOv3 提升了1.8~2.4 个百分点。对于基类组合1,Up-YOLOv3 的检测效果优于原始YOLOv3。这说明SE-SMFR 可以通过调整可学习的通道权重来有效补偿元特征迁移过程中引入的偏移。从表2 中可以看出,对比其余5 个元特征迁移的模型,Up-YOLOv3 取得了最佳目标mAP;与LSTD 模型相比,Up-YOLOv3 的mAP 最高提升了12.7 个百分点。此外,对于3 组不同基类组合的实验数据验证了模型对于大样本图像的目标检测也具有较强的鲁棒性。

表2 不同模型对大样本图像的mAP对比 单位:%Tab.2 Comparison of mAP among different models for large-sample object images unit:%

3.3.2 可视化实验

为了进一步探究SE-SMFR 对于特征通道权重的调整机制,本实验对二次重加权后的特征图进行可视化。本文实验选取基类组合2,并设k=10。将图像中1 024 个通道中的元特征权重通过 t-SNE(t-distributed Stochastic Neighbor Embedding)[26]进行非线性降维,再按不同类别排序后取其平均值作为类别与类别之间的相关性系数,并绘制热力图,如图7 所示。

图7(a)为未引入二次重加权模块时大样本图像各类别间的关系映射图,图7(b)为引入二次重加权模块后对大、小样本图像类别和大样本图像类别间的关系映射图。首先,图7(a)中对角线高亮代表同一类别的相关性最高。图7(b)中,大样本图像部分元特征信息加权至小样本图像中,但对角高亮线依然存在,说明模型依旧维持了对大样本图像元特征的权重信息,验证了前述性能比较实验中改进模型可以改善由于元特征权重信息损失所带来的对大样本图像的检测性能影响。其次,图7(a)中,奶牛和山羊的元特征信息具有较强相关性,这可能会影响模型对奶牛和山羊的检测效果。引入二次重加权模块调整元特征权重后,可以发现图7(b)中的奶牛和山羊的自相关权重均有所增大,而互相关权重均有所下降,这也说明二次重加权模块可以改善大样本图像中各类别的元特征权重。最后,从图7(b)中还可以观察到,同类之间的颜色更加靠近,不同类之间的颜色更加区分,因此类别与类别之间的关系得到进一步区分,同类类别之间映射关系加强,如新加入的小样本图像中,马的元特征信息主要被映射至大样本图像的奶牛和山羊,而狗的元特征信息主要被映射至猫,瓶子的元特征信息着重映射至盆栽植物,均具有有效性和合理性。

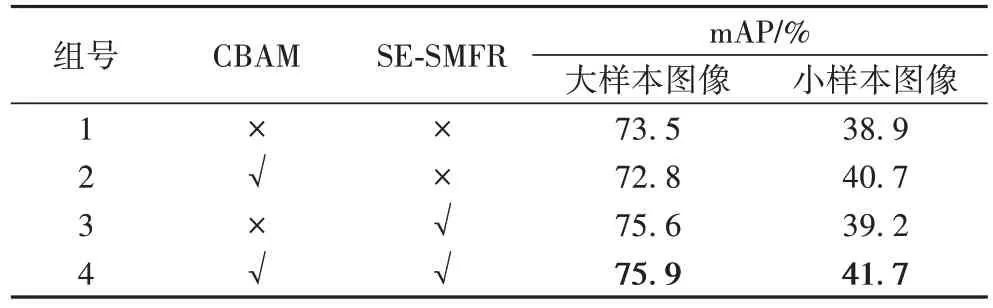

3.3.3 消融实验

消融实验用于探究基于CBAM 的注意力模块和SESMFR 模块对大样本图像和小样本图像mAP 的影响,该实验也在标签个数k=10 且在新类组合2 的条件下进行,实验结果如表3 所示。

表3 消融实验结果对比Tab.3 Comparison of ablation experimental results

由第1、2 组实验结果可知,添加基于CBAM 的注意力模块后,模型对小样本图像的mAP 提高了1.8 个百分点,但对于大样本的mAP 却下降了0.7 个百分点,验证了上文提出的结论,即:经过第一次特征重加权后大样本图像会损失部分元特征权重信息;而小样本图像由于本身缺少足够的元特征信息,在注意力机制的作用下,通过元特征重加权后获得了来自大样本图像的元特性信息,提高了模型对小样本图像的检测效果。对比第1、3 组的实验结果可知,SE-SMFR 对于大样本图像的mAP 提升了2.1 个百分点,但对于小样本图像影响较小,这验证了SE-SMFR 的设计初衷,即增强模型对于大样本图像的检测效果。第4 组实验的结果表明,在加入注意力机制和二次重加权模块后,模型对大样本图像和小样本图像的mAP 均达到最高,再次表明本文改进后的模型的有效性和合理性。

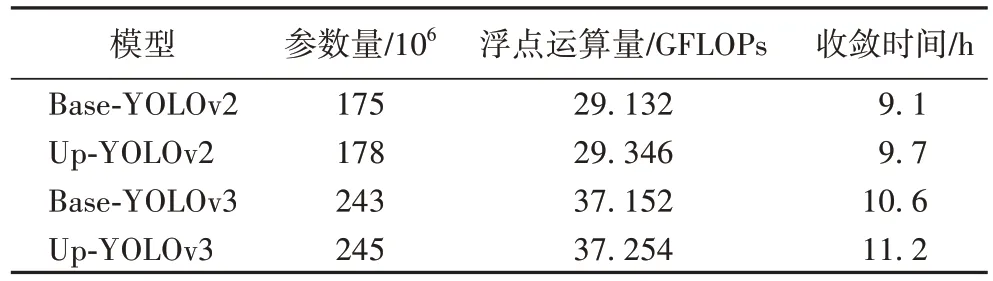

为探究改进后的模型与原始元特征迁移模型的参数量变化以及模型收敛时间变化,给出各模型的模型大小与收敛时间对比,如表4 所示。

表4 模型大小与收敛时间的对比Tab.4 Comparison of model size and convergence time

结合表1~4 可看出,增加基于CBAM 的注意力模块和SE-SMFR 模块后,Up-YOLOv2 相较于Base-YOLOv2 在大幅提升mAP 的同时,参数量仅增加约1.7%,浮点运算量和收敛时间均未显著增加。同样,Up-YOLOv3 相较于Base-YOLOv3也仅增加了约0.8%的参数量,浮点运算量也仅增加了约0.1 GFLOPs,均可近似忽略,且收敛时间也并有未显著增加。这充分说明了Up-YOLOv3 的优越性。

4 结语

在现有用于解决小样本目标检测问题的元特征迁移模型基础上,本文提出了基于CBAM 的注意力机制模块和SESMFR 模块的改进元特征迁移模型。其中,基于CBAM 的注意力机制模块能对输入图像目标类别实现像素级分割,获取图像上目标类别的关键元特征信息,同时通过自主学习生成掩膜,帮助模型聚焦图像目标类别区域,有效避免了图像中无关背景区域对于模型的干扰,提升模型对图像中关键目标的细节特征提取能力。考虑到将大样本图像元特征信息迁移至小样本图像中时,会导致模型对于大样本图像元特征的偏移,设计了SE-SMFR。SE-SMFR 能对大样本图像元特征信息进行二次重加权,在提升小样本图像mAP 的同时也能减少模型对大样本图像元特征权重信息的损失。实验结果表明,与Kang等[19]提出的原始元特征迁移模型Base-YOLOv2相比,本文模型对小样本图像的mAP 提升了2.3~9.1 个百分点;与Base-YOLOv3 相比,本文模型对大样本图像的mAP 提升了1.3~2.4 个百分点。与普通迁移模型LSTD 相比,对小样本图像、大样本图像的mAP 分别最高提升了13.4 和12.7个百分点。在大幅提升检测准确率的同时,本文模型保持了与未改进前模型相近的参数量、计算量和收敛时间。下一步的工作将研究图像类别之间的关系对模型检测性能的影响。