用于肿瘤调强放射治疗影像分析与转换的深度学习方法

刘国才 顾冬冬 刘 骁 刘劲光 刘焰飞 张毛蛋

1(湖南大学电气与信息工程学院,长沙 410082)

2(机器人视觉感知与控制技术国家工程研究中心,长沙 410082)

引言

恶性肿瘤(癌症)已成为严重威胁中国人群健康的主要公共卫生问题之一。 中国癌症负担总体仍呈现持续上升趋势,癌症防控形势依然严峻。 根据2019年发布的“2015年中国癌症统计报告”[1]:恶性肿瘤死亡占居民全部死因的23.91%,近十几年来恶性肿瘤的发病和死亡均呈持续上升态势,恶性肿瘤发病率保持每年约3.9%的增幅,死亡率保持每年2.5%的增幅,恶性肿瘤所致的医疗花费每年超过2 200 亿,防控形势严峻。 2015年中国恶性肿瘤新发病约392.9 万人,死亡约233.8 万人,平均每天超过1 万人被确诊为癌症。 根据2019年发布的“2016年美国癌症统计报告”[2]:2016年美国新增约176.2 万癌症患者,死亡约60.6 万人,占死亡患者的22%。 根据2019年发布的“2018年全球癌症统计报告”[3]:2018年全球185 个国家共新增约1 810万癌症患者,死亡约960 万人,中国位居第一。恶性肿瘤现代临床放射治疗(简称放疗),是一个由多模态医学影像引导的,从肿瘤分期、定位、治疗到疗效评估的复杂诊疗过程[4],精确定位、精确计划和精确治疗是百余年来一直追求的临床放疗目标。

计算机断层扫描(computerized tomography,CT)影像开创了现代临床三维适形放疗(3-dimentional conformal radiotherapy,3DCRT)技术时代。 正电子发射断层扫描(positron emission tomography,PET)功能分子影像,开启了以肿瘤分子生物学特性为基础的生物调强放疗(biological intensity-modulated radiotherapy,BIMRT)技术时代。 PET/CT,PET/MRI(magnetic resonance imaging,磁共振成像),锥形束CT(cone beam CT,CBCT)/Linac(线性电子加速器)、MRI/Linac 与深度学习技术相结合,使肿瘤放疗技术进入到一个崭新的个体化、高精度、自适应和智能化新时代。

影像图像引导调强放疗(intensity modulated radiotherapy,IMRT)是当前主要的肿瘤患者临床放疗技术。 设计和制定临床可接受、可执行的肿瘤调强放疗计划,涉及大量临床任务。 目前,主要由临床放疗物理师,根据患者的模拟放疗定位CT 影像勾画放疗危及器官(organs at risks,OARs),并根据临床放疗医生勾画的放疗靶区﹝包括:大体肿瘤区(gross tumor volume,GTV)、临床靶区(clinical target volume ,CTV)、计划靶区(planned target volume,PTV)﹞和放疗处方剂量、各种放疗剂量学目标和约束,以及其它临床放疗先验知识,通过逆向IMRT 计划系统软件,对IMRT 计划进行优化。

最近几年,人工智能方法已经用于肿瘤IMRT计划和自适应放疗计划研究[5],以便提高工作效率和质量。 前期研究发现,通过深度学习技术[6-15],可更好地实现放疗计划设计优化过程的智能化。 无监督深度学习[13]和生成对抗网络(generative adversarial network,GAN)[14]已经成为该领域的研究热点。 基于深度学习、采用CT/CBCT/MRI/PET联合引导的智能放疗是当前肿瘤精确放疗的前沿研究内容。

尽管近几年采用深度学习方法进行恶性肿瘤的CT、MRI、CBCT 和PET 影像配准、放疗靶区分割、放疗计划MRI-CT 影像转换合成已取得很大进展,但当前的配准、分割和影像转换精度在多数情况下还不能满足临床精确放疗的要求。

1 肿瘤放疗靶区分割深度学习方法

高精度自适应智能调强放疗计划,既需要高空间分辨率的组织解剖结构CT 和MRI 成像系统,提供肿瘤放疗靶区和危及器官精确的位置信息,还需要高灵敏性及高特异性的肿瘤生物学和放射肿瘤学特性PET 成像系统,提供肿瘤葡萄糖代谢、增殖、乏氧等生物学特性和放射敏感性(抗辐射)的特性信息。 因此,临床放疗专家通常需要联合使用肿瘤放疗模拟定位CT 或诊断CT、MRI、PET/CT、 PET/MRI、机载CBCT、MRI 等影像,手动或半自动分割肿瘤放疗靶区和危及器官。

目前,大多数情况下,多数基于深度学习的放疗危及器官分割结果和临床物理师勾画的相应危及器官的Dice 相似性系数已经超过了80%。 但是,联合肿瘤CT/CBCT/MRI/PET 影像自动分割放疗靶区的方法还缺乏一致性和有效性,多数情况下,基于深度学习的肿瘤放疗靶区高精度分割问题仍没有取得突破性进展,自动分割结果和临床医师勾画的靶区Dice 相似性系数不足60%,仍无法满足临床放疗精度要求。

近几年生成对抗网络(generative adversarial networks, GAN) 和深度卷积神经网络( deep convolutional neural network,DCNN)在肿瘤放疗靶区分割中的主要研究成果和进展,如表1 所示。

表1 主要的肿瘤放疗靶区分割深度学习方法汇总表Tab.1 Summary of tumor segmentation methods based on deep learning

1.1 基于GAN 的肿瘤靶区分割方法

由于CT 影像软组织的对比度低,对位于纵隔等部位软组织附近或周围的肺癌组织很难准确分割,因此临床上通常需要联合软组织对比度高的MRI 影像对肺癌靶区进行高精度分割。 最近,Jue 等[16]等提出了一种联合肿瘤MRI 和CT 影像进行训练学习的肺癌CT 分割方法。 作者联合条件生成对抗网络cGAN[25]和循环一致生成对抗网络CycleGAN[26]训练两个生成对抗网络,分别将CT 和MRI 转换成对应的pMRI 和pCT,并增加根据VGG19 网络提取的MRI 和pMRI 的高层特征余弦相似性计算的对抗性损失正则项,迫使生成的pMRI 和MRI 具有相似的结构。 与此同时,联合训练两个类似U-Net 或密集全卷积网络DFCN 的分割网络,分别分割CT 和pMRI 中的肺癌组织,并在训练时直接比较两个分割网络高层特征和分割结果,迫使两个分割结果尽可能一致。 整个联合训练过程是无监督的,转换网络和分割网络轮流交替训练优化。 应用非小细胞肺癌患者CT 影像测试表明,联合T2 加权MRI 影像训练的肺癌靶区分割方法比仅使用CT 影像的分割方法更精确,平均Dice 相似系数分别为0.72±0.14(U-Net)、0.73±0.12(D-FCN),相应提高4%~5%。

为了实现跨模态(MRI,CT)影像的前列腺癌放疗靶区高精度分割,Girum 等[17]提出了一种嵌入式生成网络,用于前列腺形状学习,生成前列腺区域标注影像。 他们将形状生成网络嵌入类似U-Net 的分割主网络,采用分割网络编码层高层特征作为输入,通过有监督的训练,自动生成前列腺区域标注影像,并将其和分割网络解码高层进行像素级的融合,最终分割前列腺。 在联合训练形状网络时,采用少量的、有4 个前列腺外轮廓标志点坐标的高对比度MRI 影像作为训练样本,通过形状生成网络预测每个切片上相应的标志点位置,并最终生成前列腺区域标注影像。 采用交叉熵切片分类和标志点位置绝对误差光滑近似作为形状生成网络损失函数,同时,采用交叉熵和Dice 相似性系数作为分割网络损失函数。 测试结果表明,采用MRI 影像联合训练好的形状和分割网络,可直接应用于低对比度的CT 影像前列腺高精度分割,平均Dice 相似性系数达到CT:89%,MRI:93%,优于现有其他方法。

目前,放疗直线加速器机载的锥形束CT(CBCT)已被广泛应用于肿瘤精确放疗前的患者在线摆位验证和自适应放疗肿瘤和危及器官定位。然而,由于CBCT 影像质量较差、软组织对比度低、肿瘤和危及器官分割标签难以获取等原因,肿瘤和危及器官CBCT 影像分割非常困难,导致目前临床上基于CBCT 的肿瘤自适应放疗难以有效实施。

最近,Jia 等[18]利用肿瘤放疗模拟定位CT 影像及其临床医师勾画的肿瘤和危及器官CT 标签信息,提出了一个无监督的跨域(CT,CBCT)肿瘤和危及器官分割网络。 采用循环一致生成对抗网络CycleGAN[26]将CT 转换合成sCBCT,同时,将CBCT转换合成sCT,在联合训练合成网络时,增加解剖结构不变转换对抗性损失正则项,以便将CT 结构信息转换到合成的sCBCT。 与此同时,利用高质量的放疗模拟定位CT 影像及其临床医师勾画的肿瘤和危及器官CT 标签信息,训练学习一个生成对抗性域自适应肿瘤和危及器官分割网络。 训练该分割网络时,同时将有标签的CT 合成的sCBCT 和无标签的CBCT 影像作为训练样本,通过CT 相应的肿瘤和危及器官标签信息监督训练,提供sCBCT 分割Dice 相似系数度量对抗性损失正则项,而且,通过CBCT 和sCBCT 分割结果判别网络,提供分割网络对抗性损失。 膀胱癌CBCT 分割实验表明,与现有方法相比,采用对抗性域自适应的CBCT 分割方法,平均Dice 相似性系数为83.6%,而仅基于CBCT 的分割结果平均Dice 相似性系数为70.1%。

Yuan 等[19]基于StarGAN 和U-Net 提出了多模态影像生成对抗转换- 分割双流联合网络(UAGAN),联合非配对的多模态影像训练学习统一的脑肿瘤多模态影像分割网络模型。 UAGAN 生成对抗的多模态影像转换网络和分割网络通过共享相同的编码器最高层,实现语义分割信息共享和转换-分割任务相互约束。 在训练多模态影像转换网络时,引入目标域影像模态类别标签,和源域模态影像一起,同时作为条件生成对抗转换网络cGAN前向生成网络通道的条件输入,而在其反向源域模态影像重建网络通道,引入源域影像模态类别标签作为输入,但采用相同的前向生成网络,因此,提供模态分类和影像重建两个对抗性损失正则项,从而实现多模态影像之间的任意相互转换。 与此同时,为了在模态转换时保留肿瘤的结构信息,通过分割网络提供肿瘤形状对抗性损失正则项。 在训练条件生成对抗转换网络cGAN 的判别网络时,采用多任务训练方式,判别网络同时输出转换后影像的真实性和模态分类概率,提供影像真实性和模态分类两个对抗性损失正则项。 另一方面,多模态影像转换-分割双流联合网络采用两个改进的U-Net,并且,通过引入注意力机制,使分割网络解码层融合学习聚焦于转换网络各相应编码层的肿瘤语义分割特征,提高分割精度。 同时,使转换网络解码层融合学习聚焦于分割网络各相应编码层的肿瘤语义分割特征,从而使转换后的影像保留模态不变的肿瘤形状特征。 在推理测试时,分割网络不仅接受被测试影像作为输入,而且接收影像的模态类别作为输入,因此,同一个分割网络可以对同一个目标肿瘤的多个不同模态的影像进行正确分割。 T1Gd、FLAIR 和T2 MRI 影像的脑肿瘤分割实验表明,不同模态影像越相似,UAGAN 分割精度相互提高越多。

1.2 基于DCNN 的肿瘤靶区分割方法

核磁共振影像中鼻咽癌放疗靶区的自动分割仍然具有挑战性,因为鼻咽癌是浸润性的,通常体积很小,甚至是微小,使其与周围紧密相连的组织难以区分。 针对这一问题,最近,Huang 等[20]提出了一种具有递归注意力机制(recurrent attention mechanism,RAM)的鼻咽癌靶区分割残差网络。 他们将高层语义特征引入长短期记忆(long short term memory,LSTM)注意力递归神经网络,级联生成特征通道级和空间区域级注意力映射,逐层指导较低层特征的学习,最终聚焦于肿瘤语义分割特征的提取。 在训练分割网络时,采用到肿瘤的距离加权的交叉熵作为损失函数。 联合肿瘤T1、T1c 和T2 MRI进行训练和测试,实验结果表明:鼻咽癌分割Dice相似性系数达到0.796 3,而经典SE 注意力机制Dice 相似性系数为0.697 6。

Chen 等[27]提出了一种新的联合FLAIR、T1、T1c 和T2 MRI 影像进行脑肿瘤分割的多组变分编码-解码网络。 他们使用每个模态相应的解码网络将影像分解成依赖于模态类型的外观编码和独立于模态类型的内容编码。 然后将所有模态影像的内容编码通过一个共享的融合子网络合成为一个共享的内容编码,并以此作为输入,通过一个肿瘤分割编码子网络生成肿瘤分割标签。 在编码-解码网络训练时,同时为每种模态影像构建一个相应的编码子网络。 采用类似U-Net 的残差网络构建编码-解码网络。 通过一个两层的卷积网络构建内容编码融合子网络,并随机的将某些模态的内容编码设置为0,以增加网络对缺失模态影像的鲁棒性。联合Dice 和加权交叉熵进行端到端的训练,并增加所有模态影像解码子网络重建误差损失正则项。测试结果表明:在各种模态影像缺失的情况下,分割网络性能的鲁棒性好。 联合所有4 种模态影像脑肿瘤分割平均Dice 相似性系数比现有最好的分割方法高出6%。

肿瘤放疗临床靶区(CTV)包含CT 影像上可见的大体肿瘤区(GTV)和亚临床肿瘤区(通常CT 影像上不可见),因此,通常不能完全基于CT 影像勾画CTV。 Jin 等[21]提出了一个简单、有效的3 D 渐进整体嵌套网络(progressive global nested network,PHNN)[28],采用到食管癌患者肿瘤、淋巴结和放疗危及器官的符号距离对这些解剖结构先验上下文信息进行编码,并将这些上下文信息编码信息和CT影像一起作为PHNN 的输入训练网络,使深度网络能够更好地学习和模拟人类医生基于肿瘤边缘和外观进行CTV 勾画。 实验表明,编码解剖结构先验上下文信息可以提高食管癌放疗临床靶区CTV 分割性能,平均Dice 相似性达到83.9%。

Men 等[22]提出DDNN 网络用于鼻咽癌CT 影像放疗大体肿瘤区GTV 和临床靶区CTV 分割。DDNN 网络由两个重要组件组成,包括编码器部分和解码器部分。 编码器基于VGG-16 架构,与VGG-16 不同的是,在解码器网络上执行反卷积操作,从低分辨率逐层重建高分辨率特征图,在网络最后采用全卷积层代替全连接层。 鼻咽癌测试表明:GTVnx、GTVnd 和CTV 的Dice 相似性系数均值分别为80.9%、62.3%和82.6%。

Chen 等[23]提出了一种新的半监督脑胶质瘤MRI 重建和分割U-Net 网络。 该网络共享一个编码子网络,但包含一个分割子网络和一个重建子网络。 采用有监督的Dice 损失函数训练分割子网络,而采用无监督方式训练重建子网络。 训练时,采用同样数量有标注的样本和无标注的样本,轮流训练分割子网络和重建子网络,并且,采用分割子网络预测的肿瘤目标区域和背景区域掩膜,对影像重建均方误差损失按目标和背景区域进行加权(注意机制)。 测试结果表明:注意力机制和无监督训练的重建网络有助于提高分割性能。

Huang 等[24]提出了3 D 磁共振MRI 结直肠肿瘤区域定位和分割多任务多尺度网络3 D RU-Net,两个任务共享一个编码子网络。 利用肿瘤区域定位子网络预测的区域掩膜,从编码子网络中裁剪出多层次感兴趣区域特征,作为分割解码子网络的输入。 进一步,通过集成多尺度特征分割结果,提高最终分割精度。 测试结果表明:联合肿瘤区域检测和分割的结直肠肿瘤分割性能优于U-Net,分割精度平均Dice 相似性系数达到75.5%,而U-Net 仅为61.7%,而且速度更快,占GPU 内存更少。

2 肿瘤影像配准深度学习方法

为了联合利用肿瘤多模态影像对肿瘤放疗靶区和危及器官进行高精度地定位和分割,进行肿瘤自适应放疗计划设计优化和疗效评估,需要对肿瘤多模态影像进行高精度的配准。 7~10 周的肿瘤放疗过程中,肿瘤和危及器官一般都会因治疗而发生大的形变,经典影像配准方法配准位置误差一般达不到肿瘤临床放疗计划时靶区和危及器官定位误差小于2 mm 的要求,而且配准速度也不能满足肿瘤影像在线配准和在线自适应放疗计划设计与优化。 基于深度学习的配准方法,目前大多针对单模态的医学影像配准,而肿瘤放疗全过程放疗靶区和危及器官形变很大,所需影像模态多样,在线自适应放疗计划要求实时且高精度地配准多模态影像,因此,至今临床上还没有一种高效高精度的肿瘤放疗多模态影像配准方法。

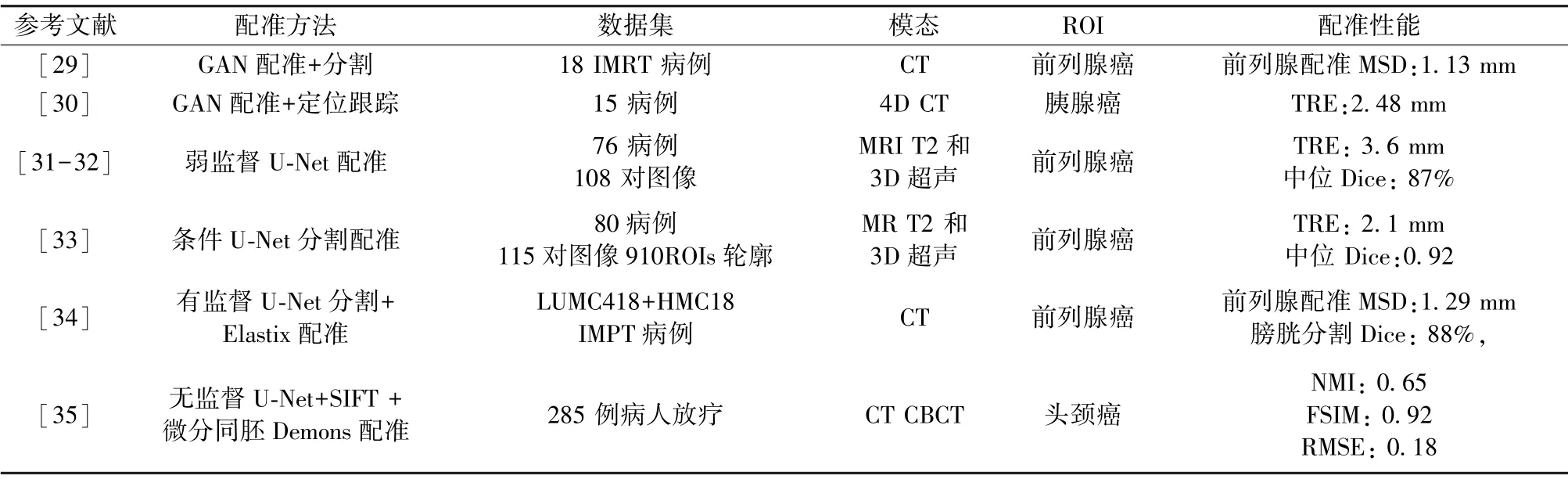

GAN 配准、分割与弱监督配准多任务、无监督深度学习配准,在肿瘤放疗多模态影像中的主要研究进展,如表2 所示。

表2 主要的肿瘤放疗影像配准深度学习方法及性能总结Tab.2 Summary of deep learning registration methods for tumor radiotherapy and their performance

2.1 生成对抗网络GAN 配准方法

由于影像配准是一个不适定的问题,通常使用正则化来约束形变场和防止形变后的影像出现折叠等不真实的形变。 常用的正则化项包括形变场光滑约束、反折叠约束和双向一致性约束。 然而,这些人工设计的配准正则化约束并不能保证形变的物理真实性。 另一方面,对于多模态医学影像的配准,通过深度卷积神经网络直接预测形变场时,配准性能不如单模态影像配准,这是因为不同模态间的巨大差异导致不同模态影像之间的相似性度量更加困难。 最近,基于生成对抗网络GAN 的医学影像配准研究表明,GAN 有望更好地解决复杂医学影像形变配准问题,其核心思想是训练一个生成对抗网络。 一方面,通过生成器网络直接生成预测形变场,或者形变速度场实现微分同胚形变配准,这是肿瘤自适应放疗多模态影像配准临床应用特别期待的配准变换特性。 另一方面,通过判别器网络,引入一个基于学习的配准对抗性损失形变场正则化约束项,用于解决配准算法中手动设计正则项的问题。 基于GAN 的影像转换,还可有效地将更具挑战性的多模态配准问题转化为相对容易的单模态影像配准问题,使得许多现有的单模态配准算法可以应用于多模态影像的配准。

Elmahdy 等[29]最近开展的一项基于对抗生成网络的前列腺癌放疗计划模拟定位CT 和放疗全过程7~10 个分次放疗前CT 影像联合配准和靶区分割研究表明,该方法不仅配准速度快(0.6 s),能够满足在线自适应放疗计划要求,而且配准精度高﹝靶区定位平均位置误差为(1.13 ± 0.4)mm ﹞,基本能够满足靶区和危及器官定位精度要求。 该配准方法不仅在配准速度上大大超过经典配准方法(13 s),而且配准精度也超过了经典的Elastix 配准方法的精度(4.0 ± 1.7)mm。 具体地,先通过配准生成网络直接预测形变场,再通过空间形变网络实现放疗计划CT 到每个分次放疗前CT 影像的无监督配准和肿瘤放疗靶区与危及器官轮廓的形变演化。 采用更利于网络训练的Wasserstein GAN 损失函数进行配准网络训练,通过PatchGAN 训练配准判别网络。 不仅通过配准判别网络直接判断影像块之间是否已经配准、配准演化后的放疗靶区与危及器官轮廓是否与临床专家手工勾画的轮廓相似,为配准生成网络提供配准对抗性损失项,而且通过配准影像块之间的归一化互相关NCC 度量和放疗靶区与危及器官分割Dice 相似性系数度量,为配准生成网络提供间接、附加的形变场正则项,同时提高配准和分割的精度。

Lei 等[30]最近一项基于对抗生成网络的胰腺癌放疗过程肿瘤和危及器官定位、运动跟踪和放疗门控4 D-CT 10 个时相中任意两个时相影像配准研究表明,胰腺癌标记点配准误差均值为2.48 mm,配准时间小于1 min。 他们通过配准生成网络直接预测形变场,通过空间形变网络层实现任意两个时相影像的无监督配准,通过配准判别网络判断影像块之间是否已经配准,为配准生成网络提供对抗性配准损失度量(交叉熵)。 该方法有望用于肺癌、胰腺癌等受呼吸运动影响较大的肿瘤实时定位、运动跟踪和放疗门控计划与自适应放疗计划。

2.2 配准和分割多任务DCNN 方法

目前,国内外许多相关研究表明,联合临床专家勾画的正常组织器官和肿瘤轮廓等解剖学信息,可提高无监督配准网络性能。 同时,配准形变场既可以直接用于解剖结构轮廓的演化,也可以用于提高分割网络性能,这对肿瘤放疗临床应用尤其重要。 临床上肿瘤自适应放疗计划优化时,需要将放疗计划时在放疗模拟定位CT 上分割的肿瘤放疗靶区和危及器官高精度演化到每次放疗时在线获取的CTCT,或MRI 影像上,同时,还需要将每次放疗时患者每个靶区和危及器官实际接受的照射剂量反向高精度地映射到计划CT 上,进行各分次放疗剂量的累计计算和评估。 因此,联合配准和分割等多个不同但相关的任务,相互约束,训练多个相关的深度神经网络,是一种非常好的多任务学习方法。

Hu 等[31-32]最先提出利用组织解剖结构标注等更高层语义结构信息进行配准网络训练。 他们认为这样的解剖结构信息更可靠,更符合临床实际。他们在训练T2-MR-US 前列腺影像配准深度神经网络时,使用高质量标注的前列腺区域掩膜,采用多尺度Dice 相似性度量配准误差,但测试推理阶段不需要任何解剖结构标签信息。 他们采用改进的U-Net 网络结构,引入多尺度融合的解码网络,实现较大的刚性和形变配准。 测试表明:标志点配准中位绝对误差为3.6 mm,中位Dice0.87。 配准性能大大优于其它基于影像强度相似性的配准方法。 进一步考虑到临床影像配准的主要目的是通过影像配准空间变换演化肿瘤(病灶)和相关解剖结构等感兴趣区域(region of interest,ROI)的轮廓,ROI 之外的点对应关系通常临床价值较小,Hu 等[33]提出了一种条件分割网络,以移动影像及其某个ROI 轮廓作为条件,通过该条件分割网络对固定目标影像进行分割(分类)预测,直接将移动影像中的ROI 轮廓映射(演化)到固定影像中,而不需要通过配准空间变换,因此训练时也不需要配准形变场正则化约束。 训练U-Net 分割网络时,他们采用固定影像多ROI 分割加权交叉熵损失函数,网络输入为待配准影像对和移动影像ROI 标签,每次输入一对影像对应的单个解剖结构或区域ROI。 训练集的ROI 无需配对,单个影像对可具有不同的多个ROI 对。 在推理过程中,给定一对新的影像和一个移动影像的ROI,训练好的网络可以预测该ROI 在固定的影像空间中位置。 前列腺治疗前MRI(移动影像)和治疗中超声(固定影像)测试结果表明:专家勾画的超声前列腺轮廓ROI 与治疗前MR 前列腺轮廓演化得到的轮廓中位标志点绝对误差(target registration error,TRE)为2.1 mm,中位Dice 相似性系数为0.92。 与基于配准网络预测的空间变换演化ROI轮廓方法[31-32]相比,相应的TRE显著降低(>34%)。

为实现前列腺癌自适应放疗靶区和危及器官高精度和鲁棒的自动分割,Elmahdy 等[34]联合预先训练好的膀胱分割深度神经网络U-Net,提出了一个三阶段的前列腺癌质子调强放疗靶区和危及器官分割与配准网络,实现从放疗计划CT 到每天放疗时CT 的前列腺癌、膀胱、淋巴结和精囊的自适应轮廓演化(自动高精度鲁棒分割)。 采用有监督的训练方法,先训练膀胱CT 影像深度神经网络UNet,然后在迭代优化放疗计划CT 到每天放疗前CT的配准Elastix 算法过程中,先采用自动提取的患者人体掩膜作为解剖结构先验信息,基于互信息配准准则,实现仿射刚性变换;再采用训练好的膀胱分割网络预测分割计划CT 影像中的膀胱掩膜,为第二阶段形变配准网络提供膀胱解剖学先验信息正则项(采用膀胱轮廓距离均方差),联合互信息配准准则,实现前列腺癌、膀胱、淋巴结、直肠的形变配准和轮廓演化。 最后,在第三阶段,采用分演化后的直肠轮廓作为解剖结构先验,高精度配准和演化(分割)直肠和精囊轮廓。 此外,为了提高分割配准方法的鲁棒性,还通过训练生成对抗测网络,对CT影像膀胱、直肠和精囊中的空气部分进行修复与处理,对CT 进行“加窗[-330,300]”对比度增强。 测试结果表明:膀胱分割Dice 相似性系数88%,前列腺,精囊,淋巴结的平均表面距离配准误差分别达到(1.29 ±0.39)mm ,(1.48±1.16)mm,(1.49 ±0.44)mm,满足临床放疗高精度定位要求(小于2 mm)。由于配准过程由膀胱和直肠解剖结构(分割)驱动,该靶区和危及器官演化(分割)结果更准确和更鲁棒。 相应的前列腺靶区和危及器官调强放疗计划剂量覆盖指标V95 和V107 明显优于仅基于影像强度相似性配准演化轮廓的相应计划,基于该方法自动轮廓演化结果自动生成的放疗计划80%临床上可以直接接受,无需人工修正,系统的鲁棒性有了很大的提高。

2.3 无监督DCNN 配准方法

无监督的深度学习影像配准方法,可以避免临床医学影像配准真实形变场无法获取的问题。 在无监督训练学习配准网络参数时,只需要提供配准影像对作为形变场预测网络模型输入,不需要提供真实形变场。 训练过程中,直接采用预测的形变场,通过空间变换网络( spatial transformation network,STN)对移动影像进行形变插值,获得配准后的影像,并通过直接计算配准前后影像的相似性度量值作为预测网络模型损失函数值,进行误差反向传播学习。 各种配准正则化约束项的提出也使得配准网络能够预测到尽可能合理的形变场,但是,目前大多数无监督医学影像配准方法的研究都集中在某个单一模态影像的配准,无监督的多模态影像配准深度神经网络有待深入研究。

Kearney 等[35]提出了一种用于头颈患者CBCT到CT 影像配准高层特征提取的深度神经网络DCIGN,网络结构类似自编码-解码网络。 首先,他们使用分布式、无监督方式训练DCIGN,然后,采用训练好的DCIGN 编码网络最高层提取的8 通道CBCT 和CT 特征,通过经典的尺度不变特征转换SIFT 算法提取用于配准的特征点集。 最后,采用多通道微分同胚Demons 配准算法实现形变配准。 测试表明:该方法配准性能优于现有经典配准算法,配准后的平均互信息为0.653,平均配准时间3.5 s。

临床肿瘤自适应放疗计划中,要求配准每次放疗前的CBCT 影像到放疗计划时的模拟定位CT 影像的形变场是可逆的、光滑的,并应保持肿瘤和危及器官解剖结构的一致性。 经典配准方法可通过微分同胚形变配准实现,但计算量大、耗时长。 最近,顾冬冬等[36]提出了一种新的无监督深度学习配准方法,在训练配准网络时,引入双向和多级形变一致性约束和循环形变一致性损失正则项,实现可逆、一致的配准。 与现有的配准方法相比,该方法具有较高的配准一致性和较好的配准精度。 顾冬冬等[37]进一步提出了基于形变场w-PCA 先验投影图像的多级配准框架,通过高维形变场统计分布先验模型生成先验图像来增强弹性配准的鲁棒性和精度。 通过高维形变场的w-PCA 分析估计高维形变场的先验分布,利用先验分布分别生成与两个输入图像相似的中间先验图像,使得任意两个图像的配准能够以两个中间图像为桥梁,将输入图像对的配准转换成采用可逆一致的深度配准网络分别配准对应的中间生成图像和输入图像。 由于中间图像在形状上和对应输入图像更为相似,该方法可以达到较高的准确性和较好的一致性,尤其是在形状外观差别较大的输入图像之间,能够产生平滑一致的形变场。 顾冬冬等[38]提出利用形变场先验知识进行数据增强的配准网络。 从一组由微分同胚配准方法SyN 生成的有效形变,通过训练变分编解码网络,得到形变场在隐空间的流形,然后对隐空间进行统计采样,并将解码器重构后的形变和对应形变后的图像作为金标准,对配准网络进行有监督训练。 此外,顾冬冬等[39]提出了一种两阶段级联的无监督深度学习配准方法,第一阶段的深度卷积网络学习影像级的全局仿射变换参数,第二阶段深度卷积网络学习体素级的局部形变场。 该方法由于加入第一阶段的仿射配准网络,预处理阶段无需进行影像刚性配准,可提高实际临床配准中的效率。 结果表明,配准精度和效率优于现有配准方法。

3 肿瘤放疗多模态影像转换方法

调强放疗计划优化过程中放射治疗计划系统(therapy planning system,TPS)需要根据肿瘤组织和正常器官的电子密度值计算(估计)肿瘤放疗靶区和危及器官接收到的累计剂量值(放疗高能射线照射辐射能量)。 目前,临床上主要根据肿瘤患者的放疗模拟定位CT 影像HU 值进行放疗剂量计算。

最近几年,国内外肿瘤医院都在部署新一代集成的MRI/Linac 核磁加速器放疗系统,这使得直接利用MRI 影像取替CT 影像进行肿瘤放疗靶区与危及器官定位和放疗剂量计算的临床需求更加紧迫。这不仅可以通过MRI 更加准确地定位肿瘤和危及器官,而且可避免MRI/CT 配准,使在线实时进行MRI 引导的自适应放疗计划更加容易实现,同时减少患者使用CT 进行模拟放疗定位和使用放疗加速器机载CTCB 摆位时受到额外的辐射照射。 但是MRI 不能提供放疗剂量计算时需要的各组织器官和肿瘤组织的电子密度定量信息。 目前,临床上采用MRI/Linac 进行放疗计划时通常还需要获取患者的放疗模拟定位CT 影像。

为克服以上不足,国内外研究人员尝试了很多不同的从肿瘤放疗MRI 影像到CT 影像的转换方法[40]。 Maspero 等[41]较早提出利用深度学习方法,根据MRI 影像快速生成放疗模拟定位CT 影像,实现盆腔肿瘤在线自适应放疗。 几乎同时,Nie 等[42]提出利用3 D 全卷积网络(FCN)根据MRI 来生成CT 影像,更好地保留和预测CT 影像中的邻域信息。 目前,研究人员提出了许多改进的深度学习类影像转换方法,如表3 所示。 目前,仅少数研究基于转换合成的CT 进行了放疗计划剂量计算的对比评估研究,结果表明基本能满足相应的临床放疗计划要求,但还缺乏大规模、多中心的临床实验,因此,这些影像转换方法并未得到临床应用。

表3 主要的肿瘤放疗影像转换深度学习方法及性能总结Tab.3 Summary of deep learning image translation methods for tumor radiotherapy and their performance

3.1 基于GAN 的影像转换方法

最近几年,基于GAN 的肿瘤MRI 影像到肿瘤放疗模拟定位CT 影像的转换合成,取得了很大的进展,主要包括改进的经典GAN 方法、循环一致的GAN 方法、条件GAN 方法三大类。 下面分别综述如下:

1)改进的经典GAN 方法

Emami 等[43]将残差网络加入到经典GAN,其生成器为残差网络,鉴别器为经典CNN 网络。 15名患者脑部MR 及CT 影像数据集作为该网络的训练和测试集。 实验结果表明:该网络合成的CT 影像与真实的CT 影像之间的平均绝对误差(mean absolute error,MAE)为(89.30 ± 10.25)HU,平均峰值信噪比(peak signal to noise ratio,PSNR)为26.64±1.17,平均结构相似性(structural similarity,SSIM)为0.83 ± 0.03,效果好于经典U-Net 网络。 Armanious等[44]对GAN 网络进行了改进,提出了MedGAN。作者将鉴别器作为一个可训练的特征提取器,以便于惩罚转换后的影像与目标影像之间的CNN 视觉特征差异,同时利用影像纹理结构转换损失项,使转换后的影像和目标影像的纹理和精细结构匹配。 同时,作者提出了名为CasNet 的新型生成器网络结构,通过级联的编码-解码U 形网络块,逐步提升转换后影像的锐度。 实验结果表明,MAE为264.6 HU,效果远好于一般GAN 网络的313.2 HU。

2)循环一致的GAN 方法

在多模态或多序列MR 影像转换网络中,通常需要预先对患者的多序列MR 影像或单序列MR 影像和CT 影像样本对进行配准,但是,在实际临床应用中,高精度的多模态影像和多序列MR 影像配准本身也很困难。 为了解决该问题,研究人员基于CycleGAN 框架,提出了MRI 到CT 影像的转换网络模型。 最近,Wu 等[45]通过改进的U-Net 作为生成网络,采用CycleGAN,提出了MRI 到CT 的自动生成网络UC-GAN,测试表明,MAE 为(76.7 ± 4.5)HU,PSNR 为46.1 ± 1.5,性能优于原CycleGAN 方法。 由于输入影像与输出影像之间缺乏直接的约束,Cycle GAN 不能保证输入-输出影像之间的结构一致性,而这种一致性在医学成像中极为重要,因此Yang 等[46]提出了一种局部结构约束的CycleGAN(structure-constrained CycleGAN)。 该网络使用未配准的MRI-CT 影像数据集,基于影像模态独立邻域描述方法(MIND)提取影像的局部结构特征,并构建局部结构一致性损失项,使转换后的影像和目标影像局部结构保持一致,测试表明,MAE 为122.7 HU,性能优于一般的CycleGAN 网络。 Prokopenko 等[47]则采用非配准的MRI 和CT样本集训练两个生成对抗网络(DualGAN),以便保证MRI-CT 影像双向转换的一致性,并通过一个预训练的VGG16 提取合成CT 影像的高层视觉特征,从而引入视觉感知特征损失对抗性正则项。 测试表明,MAE 为60.83 HU ,PSNR 为17.21 dB, 结构相似性为0.8。

3)条件GAN 方法及不同GAN 方法对比研究

条件生成对抗网络(cGAN)也是一种常见的影像转换网络,但需要有配对的影像作为输入进行训练。 Peng 等[48]比较了cGAN 网络和CycleGAN 网络合成CT 影像的性能。 作者使用普通的U-Net 作为cGAN 网络的生成器,使用残差U-Net 作为CycleGAN 的生成器。 173 例鼻咽癌患者头颈部的T1 加权MR 影像和相应的CT 影像作为训练和测试样本集。 对于cGAN 网络,使用形变配准后的MRCT 影像对进行训练。 而对于CycleGAN 网络,则使用未配准的MR 和CT 影像进行训练。 实验结果表明:cGAN 和CycleGAN 生成CT 影像的MAE 分别为(69.67±9.27)HU 和(100.62±7.39)HU。 当MR 和CT 影像已配准时,训练好的cGAN 网络可以合成质量更好的CT 影像。 Hemsley 等[49]对cGAN 进行了改进使得该网络可以预测转换合成影像CT 值的不确定性。 该网络使用贝叶斯神经网络来对模型不确定性进行估计。 105 组脑部MR 及CT 影像数据集实验结果表明,转换合成的CT 影像与真实CT 影像间的MAE 为(89 ± 8) HU,并且能够同时生成合成影像CT 值的不确定性估计值。 Li 等[50]比较了有监督与无监督深度学习网络在生成CT 影像效果上的差异。 采用经典的U-Net 网络代表有监督深度学习网络,CycleGAN 网络代表无监督深度学习网络,Leaky ReLU 函数作为卷积之前的激活函数对UNet 网络进行了改进。 34 组头部T2 加权MR 影像和CT 影像对作为网络训练和测试样本集,其中刚性配准样本对作为U-Net 训练的数据集,然后再将这些已配准的MRI-CT 影像集进行随机配对作为CycleGAN 的训练数据集。 实验结果表明,MAE:UNet 为65.36 ± 4.08、CycleGAN 为93.95 ± 5.89;SSIM:U-Net 为0.972 ± 0.004、CycleGAN 为0.955 ±0.007;PSNR:U-Net 为28.84 ± 0.57、CycleGAN 为26.32 ± 0.55。 合成CT 影像的质量总体上有监督的U-Net 网络优于无监督的CycleGAN 网络。 Zhang等[51]发现联合训练影像转换和影像分割网络,可同时提供两个任务的性能。 特别地,将影像转换CycleGAN 网络与分割网络相结合,在训练时将转换网络生成的合成CT 影像和真实的CT 影像一同送入分割网络,可实现生成CT 影像时分割目标对象的体积与形状约束。 实验结果表明:联合转换合成的CT 影像质量更好。

3.2 基于U-Net 的影像转换方法

Han 等[52]较早提出了一个基于U-Net 的2 D MRI 到CT 影像转换合成模型,其MAE 为85 HU,而基于图谱方法合成CT 的MAE 为95 HU。 Xiang等[53]提出了深度嵌入卷积神经网络(DECNN)转换方法,将转换网络CNN 中间层的特征图合成出相应的中间层CT 影像,并将其和相应的中间层特征图进行级联作为后续中间层的输入进一步提取高层特征。 脑部数据集和前列腺数据集实验结果表明,MAE 分别为85.4 和42.3 HU,而基于图谱的合成方法分别为169.5 HU 以及64.6 HU。 Dinkla 等[54]提出了基于影像块的3 D U-Net 影像转换网络,实验结果表明,MAE 为(75 ± 9) HU。 Wu 等[55]将UNet 影像转换网络与CycleGAN 转换网络相结合,提出了UC-GAN 影像转换网络,其MAE 为(76.7 ±4.5) HU,而经典CycleGAN 的MAE 为(94.0 ±4.3) HU。 Baydoun 等[56]则研究了U-Net 与cGAN结合之后的影像转换性能,其平均绝对百分比误差MAPE 为75.25 ± 25.42,均方根 误差RMSE 为115.74 ± 21.84,PSNR 为63.41 ± 1.67,SSIM 为0.839 ± 0.044。 Han 等[52]参考U-Net 网络结构提出了DCNN 网络,在编码部分作者使用了VGG 16网络,其MAE 值可达84.8 HU。

3.3 多序列MR 影像到CT 影像的转换方法

MRI 影像具有多种不同序列的扫描方式,不同的扫描序列表征不同的组织病理信息,联合多个序列MRI 的CT 影像合成方法取得了较大的进展。 Qi等[57]针对鼻咽癌患者头颈部多个序列MRI 合成CT影像进行了对比研究。 作者收集了45 例鼻咽癌患者的4 个MR 序列影像(T1、T2、T1C、T1DixonCwater),联合4 种MRI 序列影像训练转换网络cGAN合成的CT 影像,其MAE 仅为(69.98 ± 12.02)HU,效果远好于仅采用单一MR 序列影像训练的结果。 Tie 等[58]在U-Net 网络的基础上提出了多路径多通道生成对抗影像转换网络(MCMP-GAN)。 该网络将经典U-Net 网络的网络块全部替换为残差卷积块,并且将网络的编码路径从原先的单通道扩展为了三通道,分别用于3 个不同序列的MRI 影像,并进行联合网络训练,但每个通道都有各自的特征提取网络层,并在分别进行四层的残差块操作后将这3 个通道提取的不同序列MRI 影像特征信息进行级联后再送入四层的解码网络进行解码,以获得合成的CT 影像,同时将合成CT 影像送入判别器进行对抗性鉴别。 32 名鼻咽癌患者头颈部MR 和CT影像作为训练测试数据集,其中MR 影像包括了3种不同序列的影像:T1 加权、T1 加权脂肪饱和、T2加权。 结果表明,其MAE 为(79.2 ± 13.0) HU,PSNR 为28.8 ± 1.2,影像转换性能好于经典的UNet 影像转换网络。

3.4 合成CT 影像对放疗计划剂量计算的影响评估

临床上,MR 影像转换为CT 影像的目的是为了放疗计划剂量计算和剂量分布优化。 因此通过患者合成CT 影像计算的放疗计划剂量值是否准确是关键。 近期Chen 等[59]对采用U-Net 网络合成的CT 影像计算肿瘤放疗计划剂量的准确性进行了评估:根据合成CT 影像计算的91 例前列腺癌患者调强放疗(IMRT)计划剂量分布,其1%1 和2%2 mm准则下的γ 通过率[62]分别超过98.03%和99.36%,平均绝对点剂量差分别小于0.4%和0.6%。 Neppl等[60]比较了根据2 D U-Net 和3 D U-Net 网络合成的CT 影像计算的快速容积弧形旋转调强放疗(volumetric arc intensity modulated radiotherapy,VMAT)对应的计划剂量可行性:光子治疗计划1%1 mm和质子治疗计划2%2 mm 三维伽马通过率均可达95%以上。 Maspero 等[41]研究了同一转换网络cGAN 生成的相同部位的CT 影像在不同肿瘤类型VMAT 放疗计划剂量计算上的差异,其中包括59名前列腺癌患者、18 名直肠癌患者和14 名宫颈癌患者。 随机使用32 名前列腺癌患者的影像数据进行训练,并随机使用每种癌症中的10 名患者影像数据作为测试集。 实验结果表明:3 种癌症患者放疗计划剂量分布的2%2 和3%3 mm 三维伽马通过率均可达94%以上。

Largent 等[61]比较了根据不同的MRI 到CT 影像转换合成网络(U-Net 或GAN)和同一网络在使用不同损失函数训练后合成的CT 影像,计算39 组前列腺癌患者放疗计划剂量:根据GAN 或者U-Net 网络转换合成的CT 影像计算的放疗剂量不确定度均小于0.6%。 1%1 mm 三维伽马通过率均可达99%以上。

4 未来研究方向和研究内容

目前,恶性肿瘤放疗先进技术主要包括IMRT、VMAT、螺旋断层调强放疗Tomotherapy、IGRT、剂量引导放疗、质子和重离子放疗。 智能化、个性化、精确化、自适应放疗计划是肿瘤放疗的未来趋势。

肿瘤智能放疗IRT 建立在肿瘤CT、CBCT、MRI、PET/CT、PET/MRI 等现代医学影像和人工智能技术之上。 成功实施智能放疗,可以获得高度物理和生物学适形的剂量分布和陡峭的剂量梯度,最大限度地提高肿瘤局控率和避免正常组织器官损伤,但其前提条件是精确的靶区分割、精确的放疗计划和精确的计划执行。

由于复杂和多样的恶性肿瘤生物学特性、5~7周时间内分多次执行的放疗方式和复杂的肿瘤与危及器官放疗响应生化和物理机理,目前,还没有一个临床上高效可行的恶性肿瘤CT、CBCT、MRI 、PET 放疗靶区分割、影像配准与转换方法,这是当前实施高精度智能调强放疗的技术瓶颈之一,也是未来的研究重点内容之一。 未来智能放疗的主要研究方向是:联合肿瘤放疗计划过程中的所有可用医学影像,通过深度学习等新一代人工智能技术和方法,建立肿瘤多模态影像高质量成像模型、配准与转换模型和放疗靶区分割模型,进一步提出放疗剂量分布预测模型和放疗疗效预测模型,实现实时自适应放疗计划多目标智能优化和精确执行,解决肿瘤智能放疗关键技术瓶颈的科学问题。 未来几年肿瘤放疗靶区分割、多模态影像配准和转换的重点研究内容如下:

1) 跨模态影像肿瘤靶区高精度分割生成对抗网络学习建模方法;

2) 联合多模态影像肿瘤靶区高精度分割生成对抗网络学习建模方法;

3) 肿瘤放疗多模态影像高精度配准的多级深度神经网络无监督学习建模方法;

4) 肿瘤放疗多模态影像高精度配准、转换和分割多任务的生成对抗网络学习建模方法。

5 结论

本文基于近十年相关学者对肿瘤精确放疗计划领域的研究分析和近几年国内外最新的有关研究成果,系统性地综述了恶性肿瘤放射治疗的现状与发展趋势,重点论述了深度学习技术和方法在多模态影像引导肿瘤精确放射治疗计划中的应用研究的成果,并分析了存在的关键科学问题和发展趋势,随后提出了未来几年肿瘤放疗靶区分割、多模态影像配准与转换的重要研究方向和重点研究内容。