改进卷积神经网络的前列腺癌格里森分级研究

单怡晴,黄梦醒,张 雨,李玉春,张新华,冯思玲,陈 晶

1.海南大学 计算机与网络空间安全学院,海口 570228

2.海南大学 信息与通信工程学院,海口 570228

3.海口市人民医院 放射科,海口 570228

在最新的全球癌症统计报告中,男性病例中最常见的肺癌(14.5%),其次是前列腺癌(13.5%),男性患癌率最高的疾病是前列腺癌的国家已经超过100个[1]。在传统的前列腺癌诊断过程中,病理学专家通过穿刺活检取得病例样本,经过H&E染色得到病理图像并在显微镜下观察细胞的组织形态模式,确认该组织中是否有癌症存在并进行Gleason评级[2]。

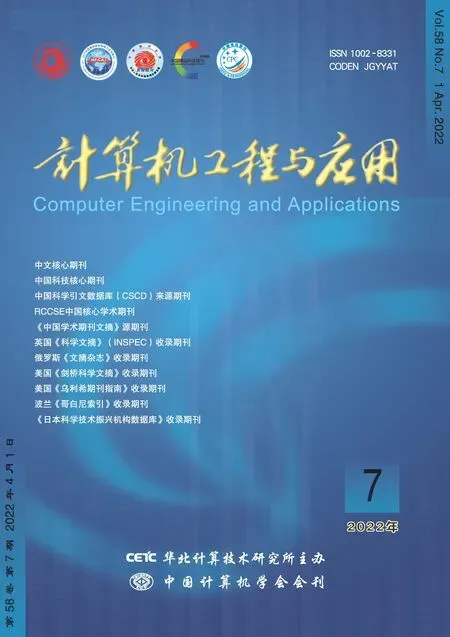

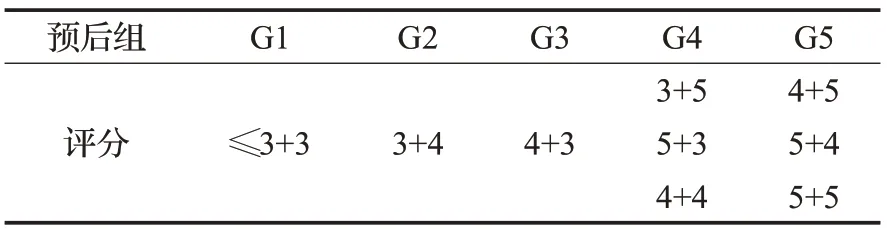

Gleason(格里森)评级模式[3]在评估前列腺癌组织微阵列中是被广泛接受且认可的一种标准,自1966年发展至今,由国际泌尿病理学学会修订多次并已应用于临床阶段[4],不仅仅是病理学的评价指标,也能在临床诊断中为医生诊断提供可靠的依据。包含活检的切片中可以显示前列腺腺体结构的形态学组织,在低级别的肿瘤中,上皮细胞仍然是腺体结构,然而在高级别肿瘤中,腺体结构最终丢失。Gleason中前列腺癌微阵列组织被分为5种生长模式,1到5对应不同细胞组织形态,从预后较好,与正常组织基本无差别到预后较差,细胞分化较差的组织,1和2在前列腺癌诊断中较少出现。按照生长模式的占比大小,将一张病理切片的生长模式分为主要结构和次要结构,最终评分结果由主要结构和次要结构相加得出,根据分数不同归类为不同的预后组,当不超过6分时通常有较好的预后结果。如表1所示,在最新修改的Gleason评级模式中被分为5个不同的预后组。当分数不高于3+3时为G1;3+4为G2;4+3为G3;3+5、5+3及4+4为G4;更高的分数为G5。如图1所示,分别代表良性,Gleason为6分、8分和10分。

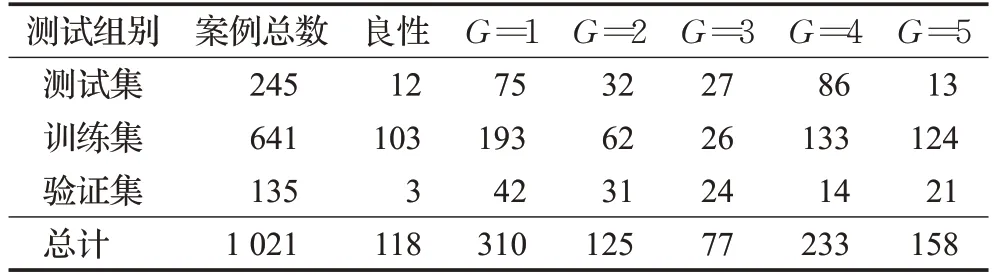

表1 Gleason评级预后组分布Table 1 Gleason rating prognostic group distribution

图1 前列腺癌组织微阵列示例Fig.1 Prostate cancer tissue microarray example

前列腺癌Gleason自动分级系统中常用的方法是提取特征组织,然后对所选择的特征使用如SVM(support vector machine,支持向量机)、随机森林或Bayesian分类器等进行分类。文献[5]采用ResNet18为基础模型,认为神经网络可分为区分网络和生成网络,区分网络采用分类模型。文献[6]首先利用腺体的纹理特征识别单个腺体结构的存在,然后从腺体单元获得的纹理特征和形态计量学应用到分类阶段,最后将图像标记为1到5级。文献[7]的研究表明图像的纹理特征是根据图像不同的功率谱进行表示,将输入的图像通过分类器分配不同的Gleason评分。除此之外,另一种方法是基于深度学习,特别是卷积神经网络(convolutional neural network,CNN),能在一个框架内同时执行特征学习和分类步骤,当训练数据达到一定规模时能取得较好结果,同时并不过度依附于手工标注。

深度学习和计算机视觉[8]的发展使得CAD(计算机辅助诊断系统)在越来越多的医疗临床治疗中得以使用[9-10]。文献[11]利用inceptionv3训练12万张图片,通过分类算法达到了皮肤科医生专家级的水平。文献[12]在使用具有确诊及最佳转诊的组织图进行上万次扫描训练后,使用深度网络分类器得出预测诊断概率和转诊建议。相比较于全卷积神经网络(fully convolutional network,FCN)[13],U-Net[14]在医疗图像处理方面更具有优势,两者共用一个经典思路-编码和解码(enconderdecoder),U-Net的网络架构两侧是完全对称,并且使用的是叠操作(concatenation),与FCN的不同之处在于FCN采用的是加操作(summation)[15-16]。

由于容易受到病理学专家观察者之间主观因素的影响,手工观片工作量大耗时高效率低,且不同的观察者之间对同一切片的评级也会存在差异,随着人口老龄化,前列腺癌患者逐年增多,需要进行活检的人数也呈现递增趋势[17];CAD工具观察范围是切片的所有区域,CAD工具的优势是避免了人工观察所发生漏查;并且CAD工具只与内部算法有关,与劳动强度和时间大小无关,能够复用计算机资源来提供可重复的结果,能大大提高诊断治疗效率,缓解医患紧张局势[18]。

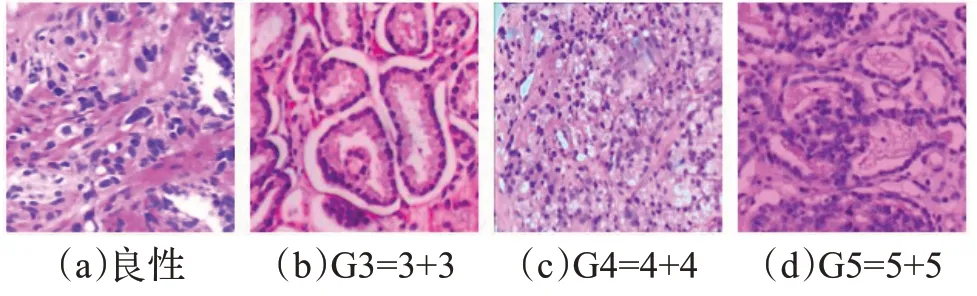

与分类器算法不同,本文提出了一种基于卷积神经网络的前列腺癌组织微阵列区域分割格里森分级研究,如图2所示,在前列腺癌诊断治疗中具有重大的临床意义。有不少研究表明区域分割可以成功应用到临床试验中[19-20],多数研究中只注重Gleason3和Gloason4的区分,本文的研究范围涵盖良性及Gleason1~5所有类型,范围更广。与对MR图像及X光片图像进行分割不同点在于,组织微阵列图像的分割基于细胞形态学组织,不同的细胞组织形态之间,尤其是格里森3级与4级生长模式识别难度系数高,在癌症存在的情况下,前列腺活检中的癌组织细胞占比不高于1%[21],活检的评估步骤繁琐易出错,这将导致在前列腺癌检测的过程中不能给出正确的格里森评级。本文在原始U-Net基础上进行改进,增加密集连接块,经过合并特征映射后网络增加了梯度路径,使各层之间的计算趋于平衡,既改善了原始U-Net网络存在的梯度及模型特征利用率不高的问题,又能防止过度重复的信息流占用内存流量。通过公开数据集上进行训练和测试,并在海口市人民医院病理科现存的前列腺癌病理图像上进行验证,使得实验结果更加真实可靠。

图2 基于区域分割的Gleason分级Fig.2 Gleason classification based on region segmentation

1 方法

1.1 数据预处理

在本研究中所使用的前列腺组织微阵列图像由两部分组成:第一部分来自公开数据库总计886张,带有详细的病理学专家注释;另一部分来自海口市人民医院病理科在存前列腺癌病理切片图像,从中筛选出135张。这些图像数据被分成训练组、验证组、测试组3组,每组的详细情况如表2所示。

表2 Gleason评分在训练、测试和验证集中的分布Table 2 Distribution of Gleason scores in training,testing and validation sets

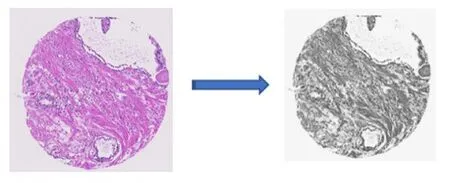

在组织病理学中,扫描样本通常具有百万级像素,当前内存和显存限制了对整个图像的训练,如图3所示,原始图像尺寸为3 100×3 100的RGB图像,为了获取最优实验结果,本文对获取的原始前列腺癌组织微阵列图像,首先利用对所有用于测试训练及验证中所有的图像数据的原有进行灰度化处理,再将每幅灰度化后的原图和标签图按照对应的顺序分割成不重叠的100份,大小为256×256。

图3 微阵列组织病理切片灰度化Fig.3 Gray processing of microarray histopathological sections

1.2 网络模型

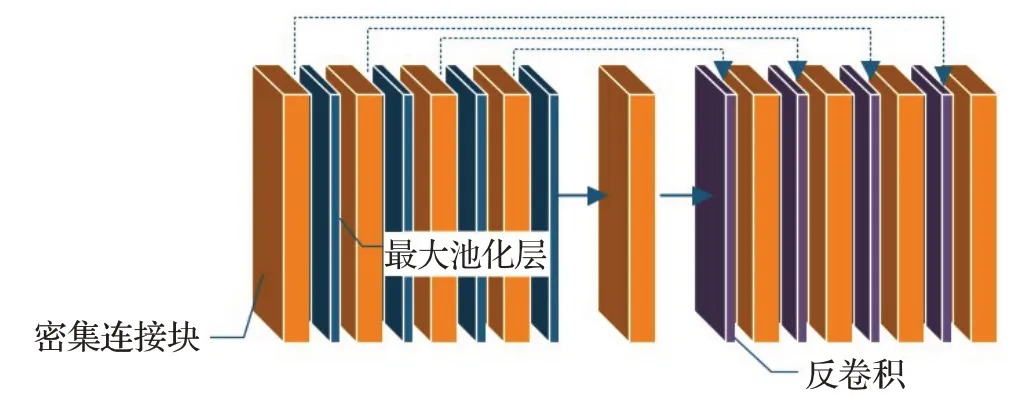

在医疗图像分割区域,惯用的网络模型有全卷积神经网络(FCN)、DenseNet和U-Net。U-Net网络架构能够在数据集并不充足的基础上进行模型训练,并能将底层信息和高层进行结合,原始的U-Net网络模型,以端到端的模式从网络阶段的开始到结束通过特征映射的集成来解决梯度的可变形,经过4次,共16倍的下采样,相对应的再进行4次上采样,将下采样过程中得到的特征信息恢复到与原图相同的大小,并在相互对应的阶段采用跳跃链接,使得特征图能融合了底层的信息,使分割和预测结果更精准。

在分割网络中,可以被描述为编码阶段U,后面紧跟解码操作R。当输入图像为x时,模型可用g(x)来表示,公式如下:

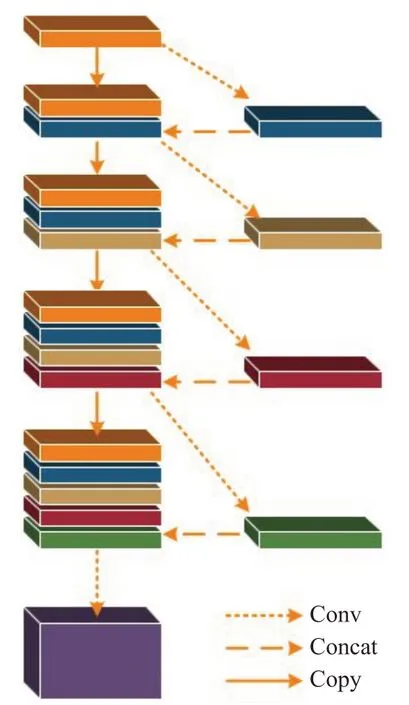

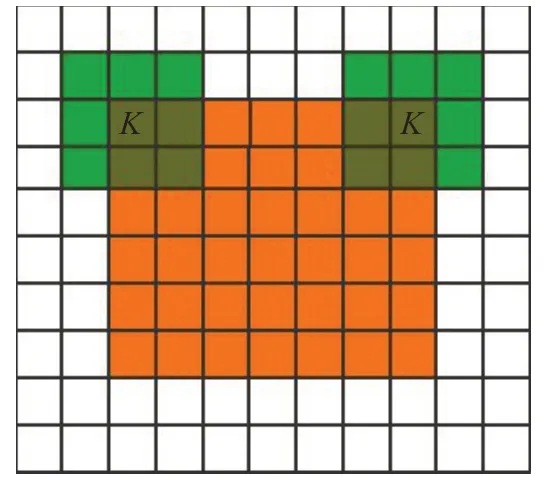

U表示将输入图像x降维并对图像内容进行编码,R把获得的特征信息重构回像素空间。网络架构的目标是在U-Net架构中,先对输入的图像下采样,再上采样,最后进行回归操作。前一层需通过卷积操作将学习到的特征信息传递给靠后的一层,但每层之间的联系稀疏。为了使每一层网络的特征信息得以充分利用,采用密集连接,使层与层之间的信息进行传递,最后一层能获取丰富的特征信息,实现特征信息复用如图4所示,特征维度上的拼接使参数总量比传统结构少。

图4 密集连接块Fig.4 Densely connected blocks

本文在U-Net架构中增加部分密集链接模块和部分过渡层,如图4所示将底层特征映射通过部分密集连接块,新的特征图融合上一层输出的结果,作为下一个模块的输入,每经过一个密集连接块将进行两次卷积和特征融合操作,改进后的网络架构如图5所示。为了提高网络的性能,避免过度拟合及正则项参数选择的问题在卷积层后增加了BN层和ReLu激活层。ReLu层能减轻梯度消失问题,相比sigmoid能训练更深的网络,速度快,计算代价小。变换重构能恢复本层归一化操作对已存在特征信息的影响,引入可学习的重构参数后,BN层的定义如下:

图5 改进后的网络架构Fig.5 Improved network architecture

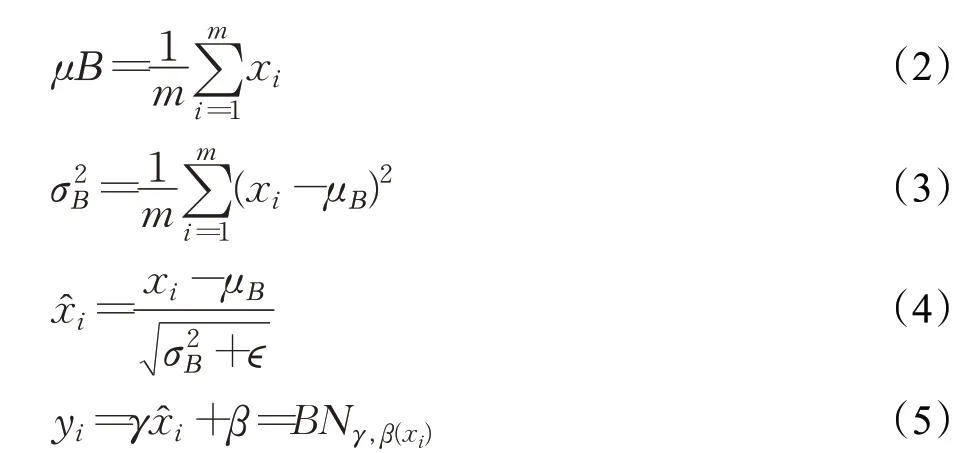

其中,μ是平移参数,σ是缩放函数,m为块的大小,γ、β为重构参数。上述公式的计算结果分别为均值、标准差、归一化、重构变换。

1.3 损失函数

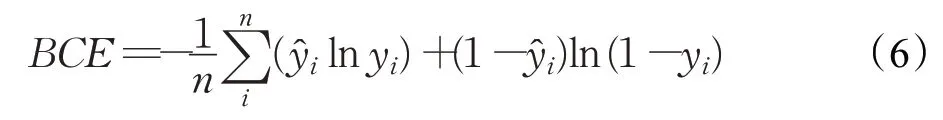

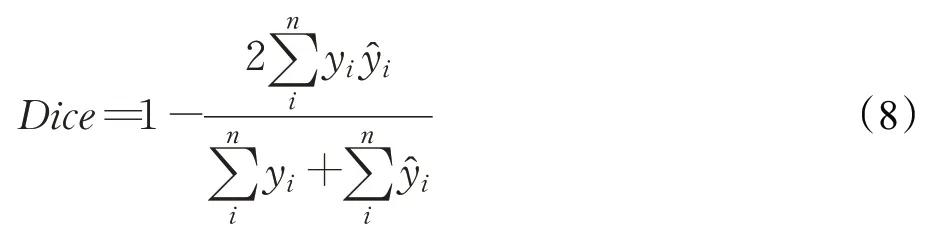

本文通过定义loss来优化目标函数,网络架构模型设计的目标在于把训练的标签与网络模型输出层之间的像素损失最小化。本文在训练过程中,采用sigmoid作为神经元的激活函数且每个训练标签是独立的,在二分类任务中经常采用二元交叉熵损失函数(binary cross entropy),公式如下:

其中,yi为像素点的预测结果,为像素点的真实分类。假设当标签为1,预测结果越大时,loss越小,在理想的情况下预测结果为1,返回的loss为0;反之预测结果为0时,预测结果越小时loss越小。如图6所示,预测结果在数据分布比较均衡时具有良好的计算效果,并对反向传播造成不利的影响,容易使训练变得不稳定。针对本研究中像素类别不平衡明显,使用二元交叉熵损失函数会被像素较多的类主导,在先前实验中,当损失函数采用二元交叉熵为损失函数时,测试集预测图像结果并不理想。

图6 二元交叉熵损失函数Fig.6 Binary cross entropy loss function

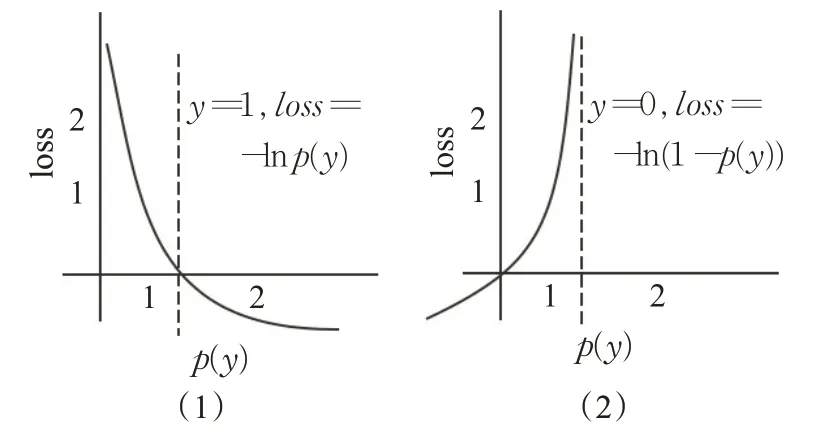

Dice函数的提出最初是在V-Net[22]中,对于类别不均衡的问题效果更优,常被用来计算两个样本的相似度,取值范围在0到1之间。假设用A、B表示两个轮廓区域像素相同的集合,那么Dice的定义如下:

也可以表示为:

当目标值和预测值过小时,会导致梯度发生剧烈变化,不利于模型训练。

本文将二元交叉熵损失函数和Dice相结合BCE_Dice_loss作为本实验的损失函数,公式如下:

2 实验及结果分析

2.1 数据集

本研究中,每个被训练的对象x都必须有与之对应的标签y,选择与输入输出具有相同高度和宽度的标签图像完成语义分割任务。卷积神经网络执行的语义分割基于像素级。与分类算法不同的是输出结果是一个标签图像,每个像素都有一个固定的值。共采用了641张标注详细的前列腺癌病理切片训练模型,245张数字病理切片做测试训练,并在验证集中随机抽取一定的数量进行评价,测试集中由两位病理学专家进行标注。由于原病理切片较大,首先要用Matlab对每张图像进行灰度化,再将每张图分割成大小相同且不重叠的100份,切分完成后的图像数据集扩充了100倍,训练集和测试集共88 600条数据。再把大小设置成256×256,将每张图按照位置顺序从0编码重命名,然后将预处理的图像数据送入模型中。为了更好地体现该研究的性能,从验证队列中随机抽取若干张图像进行预测,将结果与ground truth进行比对。

2.2 参数设置

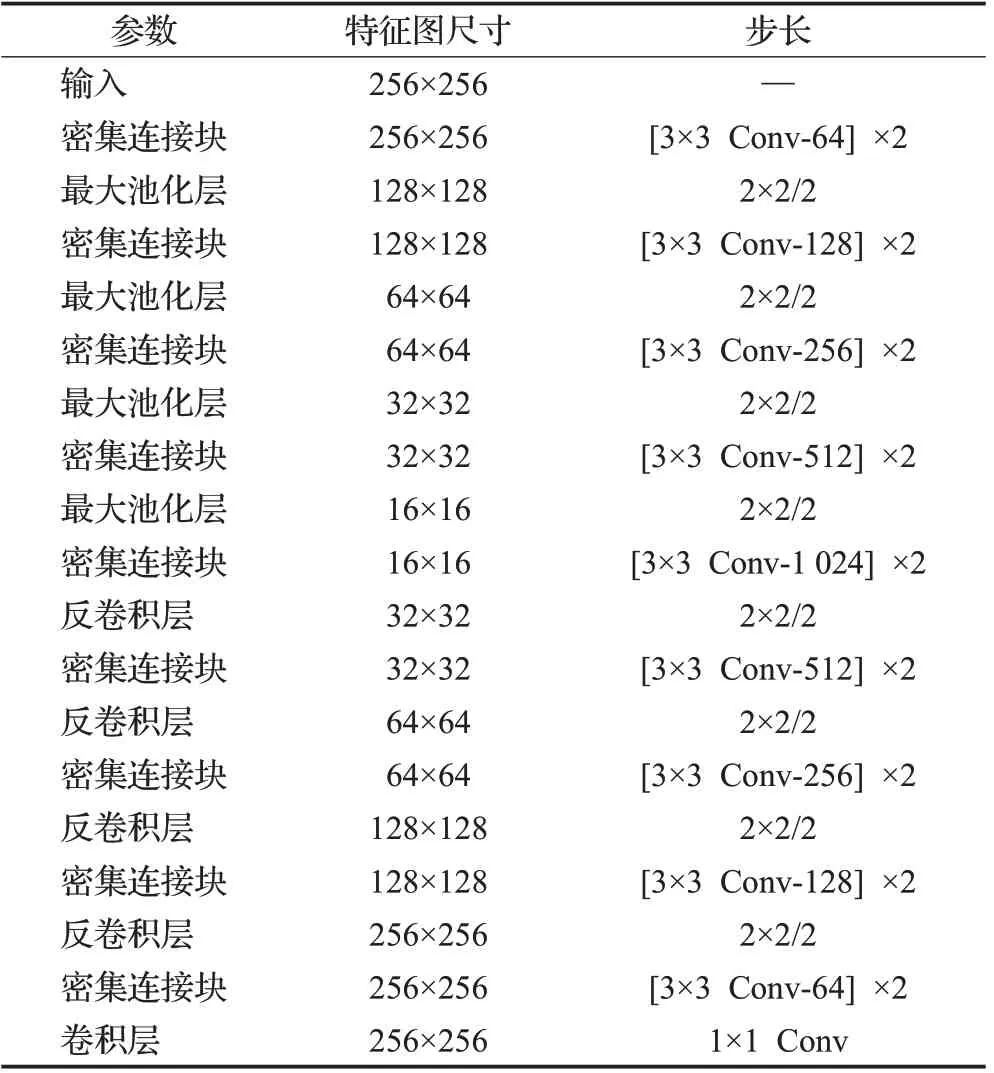

本文在训练过程中,采用Adam优化器进行优化,学习率lr为0.001,选择BCE_Dice_loss作为目标函数。在测试集上,采用混合矩阵和Cohen’s Kappa指标。表3是改进后U-Net模型中各层参数设置。

表3 网络模型各层的参数设置Table 3 Parameters setting of each layer of network model

如图7所示Padding设置为same,metrics为accuracy。

图7 Padding设置为sameFig.7 Padding set to same

2.3 实验及结果

2.3.1 评价指标

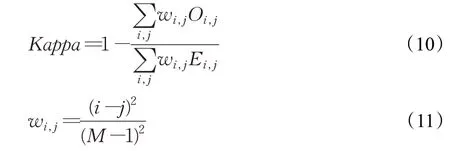

本文采用Kappa系数对NU-Net模型试验预测结果与专家手工标注结果进行一致性检验,公式如下:

其中,M为图像数据类目数,i和j代表不同图像类别,1≤I,j≤M,O i,j是被第一位评分者分类为i且被第二位评分者分类为j的个数,E i,j指预期里希望第一位评分者把图像标注为i类且第二位评分者把图像标注为j类的个数。

2.3.2 实验

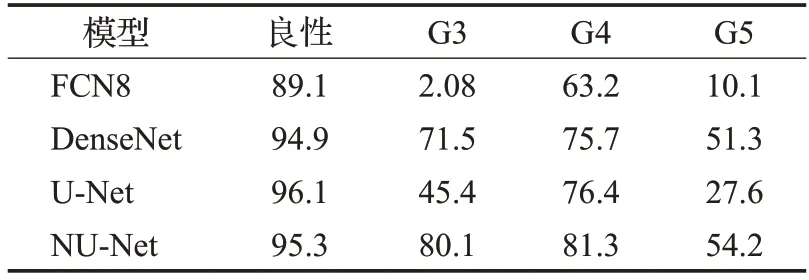

为了对比改进前后U-Net模型与FCN、DenseNet性能,本文在相同训练集、测试集上训练和测试上述4个模型。FCN8以预先训练好的VGG16模型为基础,步长为8;DenseNet在ImageNet数据集上进行测试,步长为2;U-Net模型以标准配置为架构;NU-Net中添加了密集连接模块。

本研究在公开数据集和海口市人民医院放射科中分别选择886和135张前列腺癌微阵列组织图像进行预处理,拥有良好的病理学家标注,分为训练集、测试集、验证集三部分,每个数据集中的图像相互独立且不重复。通过预先训练好的FCN8、DenseNet、原始U-Net模型及改进后NU-Net的模型在验证集里随机抽取的80张图像进行在实验对比,结果如表4所示。

表4 不同模型Gleason分割结果精确度对比Table 4 Comparison of accuracy of Gleason segmentation results of different models %

改进后的NU-Net模型相比较于原U-Net模型和另外两个分割算法中主流的模型,在不同等级的Gleason模式识别上都展示了良好的性能,其中原U-Net和DenseNet在识别良性组织和G3、G4、G5的L平均值分别为61.37%、73.35%,结果显示在本文的数据集上DenseNet模型的性能优于U-Net,性能表现最差的是FCN8模型。添加了密集连接块的U-Net模型L平均值达到了77.73%,在Gleason为3级、4级5级的分割性能上较原U-Net模型均有不同程度的改善。

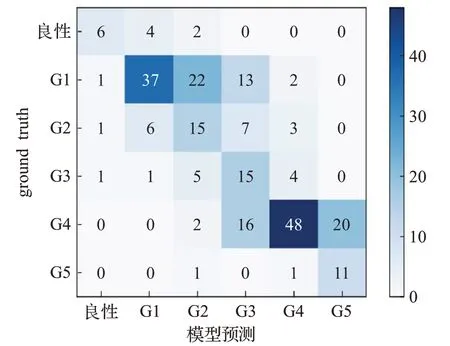

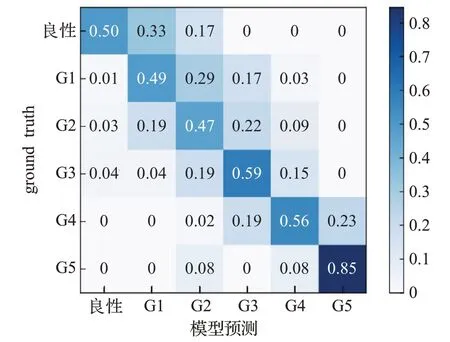

为了计算改进后NU-Net模型实验结果与手动观片标注结果ground truth之间的一致性,本文在测试集上进行实验并使用了Kappa指标进行评价,将模型预测结果与ground truth标注结果进行一致性检验。实验结果如图8和图9所示,其中相对Kappa值为每个单元格中的案例数除以每行的总案例数,模型实验结果与ground truth之间的一致性达到了0.797,误差集中出现在G2、G3上,其次是G4。

图8 测试集上一致性检测绝对Kappa值Fig.8 Absolute Kappa value for consistency detection on test set

图9 测试集上一致性检测相对Kappa值Fig.9 Relative Kappa value for consistency detection on test set

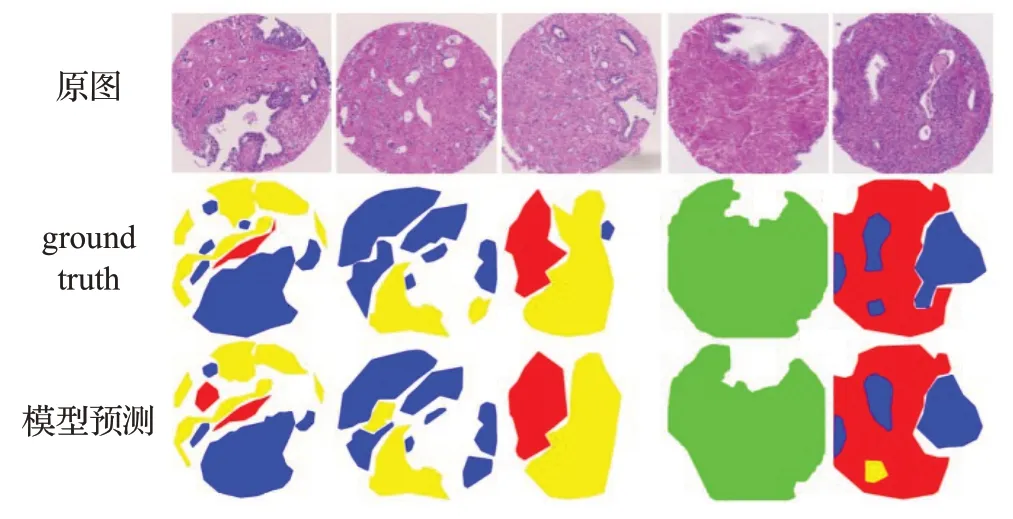

模型预测与ground truth间的对比如图10所示,第一行为前列腺癌微阵列组织原图,中间为ground truth,最后一行为本研究改进后NU-Net模型预测结果,从整理分割效果来看,NU-Net的分割结果大体上与ground truth相当。为了更好地展示实验结果,标签图根据不同的细胞组织形态进行了彩色处理,绿色、蓝色、黄色、红色分别代表良性、Gleason为3级、4级和5级。

图10 专家标示与模型预测结果对比Fig.10 Comparison of expert mark and model prediction results

实验结果表明NU-Net网络拥有更强的学习能力,能够批量的进行归一化操作,对分布均匀的训练数据良好,收敛速度得到改善,模型的性能也有所提高,区域分割更加准确。

3 结束语

本文提出了一个改进的U-Net模型对前列腺癌微阵列组织进行评级,实验结果表明在测试集和验证集中,在相同评价参照标准下,该模型的实验结果与病理学家手工标注结果具有很高的相似性。本文通过对4种不同的网络在验证集上进行实验,结果显示改进后的NU-Net在良性、G3、G4和G5分割效果最优,L均值为77.73%。在测试集上NU-Net模型的分割结果在良性、G1、G2等不同评级中与病理学家手工标注结果具有很高的一致性,Kappa值为0.797。先前研究侧重点在区分G3和G4,本文对Gleason的评级涵盖G1~G5,研究更全面。

目前的研究还有需改进之处:首先没有结合临床诊断中病理学家最常见的错误;模型关注的重点是前列腺癌微阵列组织分级,在穿刺活检结果中可能存在其他类型的细胞组织;实验中所用到的图像数据染色完好,清晰度高,图像质量好,理想的系统应该能同时处理染色和扫描仪校准等外在技术因素带来的差异;本研究中每一个活检组织检查都是由病理学家和深度学习模型独立完成的,在临床实践中,需要对每个前列腺不同部位进行多次穿刺检查;此外,研究中所使用的数据基于活检组织而不是患者,可能会导致过度估计。在新的深度学习模型中,应该立足于多个穿刺活检组织,并从患者角度出发给出Gleason等级预测。