基于深度学习的课堂表情识别研究

毕洪波 洪庆成 谢春丽 孙磊

摘要:学生的课堂表情常常反映了学生对知识的理解和掌握情况,这对分析学生的学习状态是非常有帮助的。然而,这些微妙的表情变化往往不能被及时发现和引起关注。鉴于此,作者构建了深度学习标签识别模型,利用采集的课堂图像,实时捕捉每个学生的课堂表情,并分析学生的表情特征,对表情特征进行标识和分类,从而为线下、线上教学提供有价值的教学反馈。

关键词:深度学习;微表情识别;教学分析;学习状态分析;教学反馈

中图分类号:TP391.1 文献标识码:A 论文编号:1674-2117(2022)05-0091-05

● 引言

目前,课堂教学多是以班级为单位,在一个固定的时间对几十名学生进行教学,但学生存在个体差异,教师很难照顾到每个学生的学习情况,也无法及时了解学生的课堂学习状态。

学生在课堂上的动作、微妙表情,都能体现出学生的听课效果。尽管这些也能被有经验的教师偶尔捕捉到和有效解读,但是要捕获大多数学生的表情、动作并分析其听课效果还是非常困难的。近年来,随着深度学习算法的日渐成熟,借助智能化技术改进学习行为、变革传统课堂、提高教育教学质量已经成为一种必然趋势,这也为有效改善教学环节、提高教学质量提供了新的科学方法。[1]

笔者利用深度学习的方法,通过图像识别等技术实时捕获学生的微妙课堂表情[2],实时分析学生课堂表情,以揭示学生对课堂知识的掌握情况。该方法实时采集课堂学生的图像,建立相应的算法模型,利用深度学习的方法分析学生的课堂表情特征,并对相应的表情分类标识,以反映学生对课堂知识的学习情况,从而及时得到有价值的教学反馈。

● 相关工作

从心理学角度看,人的面部表情是情感信息表达的一种主要途径,是情感最真实、最直接的反映,可以折射人的不同情感状态,如高兴、悲伤、愤怒、恐惧、惊讶、厌恶等。[3-4]已有研究者尝试把表情识别引入教育教学领域,用于分析学生的学习状态。冯满堂等人将表情识别技术引入传统智能网络教学系统中,实现了网络环境下兼顾认知和情感两方面的个性化教学,从而提高网络环境下的教学效率。[5]程萌萌等人构建了包括教师、学生、课程、情感四部分的智能教学系统结构模型,利用表情识别与视线跟踪技术实现情感模块的反馈,为网络学习中情感反馈机制的发展提供技术支持。[6]孙波等人通过将个体的人脸特征与表情特征相分离,排除无关因素对表情识别效果的干扰,提高了表情识别的准确性,并將此应用在师生情感交互系统上,成功实现了基于面部表情的学习者情感识别及情感干预功能。[7]詹泽慧等人开发的基于智能Agent的远程学习者情感与认知识别模型,结合了表情识别和眼动追踪技术,提高了远程环境下学习者状态判断的准确率,改进了Agent对学习者的情感和认知支持。[8]杨金朋等人将人脸表情识别算法应用到在线学习平台,对人脸表情数据进行实时收集和情感状态计算,通过数据分析在线学习者的脸部表情会在一定程度上反映出其当前的学习状态,为学习者提供个性化的学习服务。[9]

以上列出的研究方法多数是属于实证研究范畴[10-14],而随着计算机视觉领域的快速崛起,利用人脸识别技术已经在某些领域,如人脸打卡、智能门禁、刑侦办案、安全驾驶等领域产生了有效应用。但在教育领域,利用计算机技术识别学生课堂表情的研究还较少。周建国等人通过智能手机采集到课堂上学生上课时不同时刻的面部表情图像,提出用卷积神经网络与迭代决策树融合的方法提取面部图像特征,根据表情将其分为专心与不专心两类样本。[15]钟志鹏等人提出了多核学习特征融合的人脸表情识别,并在学生听课表情库上做了实验。[16]已有的课堂面部表情识别方法采用手工提取特征,随着参数越来越多,模型训练很容易陷入过拟合的状态。而随着深度学习计算能力的大幅度提高,可获得的训练数据量迅猛增加,尤其是卷积神经网络在图像识别方面的表现,使得课堂表情识别更加科学可行。[17-20]

● 表情识别系统

1.系统实现框架

系统通过学生对不同知识点的微表情变化,分析学生的课堂学习状态,从而为教师提供有价值的教学反馈,优化教学过程和教学方法。系统主要包括数据收集和预处理、表情识别模型训练以及基于该深度学习模型设计的表情识别模块。

为了获取课堂学生的面部特征,进而识别学生表情,设计了人脸表情识别系统的实现框架(如图1)。本设计主要分两部分功能:人脸识别和表情识别。首先收集人脸数据集和用于训练的表情数据集。其次采用线上API的方式,实时采集课堂上学生的人脸,并将采集到的人脸数据按照指定要求上传到服务端;然后将采集到的人脸数据划分为测试集和训练集,将训练数据输入到CNN模型进行训练,当一轮训练结束后,利用测试集对训练结果进行测试,并评估表情识别的准确率,如果准确率没有达到预期,则调整参数继续训练,直到找到最优解并保存解集。最后,针对人脸识别和表情识别的软件接口,设计相应的用户服务接口,用于接收用户输入的参数,并将分析结果反馈给用户。

2.数据预处理

对人脸识别和表情识别数据集采用不同的方法进行预处理。由于本设计中人脸识别数据集的数量并不大,所以主要采取人工筛选的方法筛掉内存过大、亮度过高或者过暗、遮挡过多等噪声大的图片。对于表情识别fer2013数据集,由于它已经是标准数据集,所以没有再做关于图片格式的相关预处理。但是为了进一步优化模型性能,深度学习需要规模较大的数据。虽然fer2013数据集已经有了2万多的数据量,但是实际情况反映这并不够。因此,采用了数据增强技术,即一种通过让有限的数据产生更多的等价数据来人工扩展训练数据集的技术。它是克服训练数据不足的有效手段。

3.人脸识别模型

由于现实生活中个人收集人脸数据集的难度大,如果自己训练一定达不到理想的准确度,所以本设计采用了腾讯云的机器学习API的方式,以达成更为理想的识别率。腾讯云人脸识别API是基于腾讯优图的人脸分析技术,主要提供了人脸检测与分析、五官定位、人脸对比、人员库管理、人脸验证、人脸搜索等功能。本设计中主要用到了该接口的人员库管理以及人脸搜索功能,建立人员库的好处在于将各个不同的数据集隔离开来,这样既便于区分,也便于查找比对,当数据量足够大时能大大提升查询效率。本设计采用的是Python SDK的调用方式,能高效地完成工作。

4.表情识别模型

实验选择了mini_Xception和MobilenetV2两种轻量级模型分别进行表情识别训练。mini_Xception模型是卷积网络的改进模型,增加了深度分离卷积(Separable Convolution)算法,此算法思想是将传统的卷积运算分解为逐通道卷积与逐点卷积两步进行。假设输入层为一张4*64像素、3通道的图片,对于常规卷积运算,经过一个包含4个过滤器的卷积层,每个分类器包含3个3*3的Kernel,最终输出4个特征图,且尺寸与输入层相同,那么卷积层参数数量为108个。对于深度分离卷积运算,首先进行逐通道卷积,与常规卷积不同的是卷积完全在二维平面上进行,且分类器数量通道数相同,所以一个3通道图像运算后生成了3个特征,参数个数只有27个,然后特征图在深度方向上进行加权组合,生成新的特征图,有几个分类器就有几个特征图,这一步的参数个数为12。从以上分析可以看出可分离卷积的参数数量为27+12=29个,约为常规卷积的三分之一。因此,在参数量相同的情况下,采用可分离卷积的神经网络层数可以更深,能获得更好的性能。MobilenetV2模型是Google针对手机等嵌入式设备提出的一种轻量级的深层神经网络,核心思想也是深度可分离卷积,此处不再赘述。

● 实验与分析

1.数据集简介

(1)人脸识别数据集

首先,本系统采集笔者所在的智慧教育学院17智(71)班的学生的照片作为人脸识别数据集。该数据集包含了40个人,每个人有15张左右的照片,其中5张上传至腾讯云,其余为测试数据。本设计的人脸识别功能的实现主要依赖于腾讯云的人脸识别API,主要用到了该接口的人员库管理以及人脸搜索功能。

(2)表情数据集与数据增强

本设计选择的fer2013数据集是Kaggle为了举办人脸表情识别比赛而公开的。fer2013数据集一共包含了35000多张表情图片,包含生气、厌恶、害怕、高兴、惊奇、中立七种类别的表情图像,其中有近29000张训练图片。

众所周知,在机器学习中,数据集可以说是最难解决的问题之一,其难处不在于数据集的优化,而在于数据量。虽然fer2013数据集已经有了20000多的数据量,但并不够。所以,笔者对fer2013数据集进行了數据增强,增强过后的数据集可以从原来的28000多增加到80000多,而七个表情准确度则平均上升了20%左右。

2.实验设计和分析

(1)实验设计

本设计的深度学习框架选择了谷歌Tensorflow+Keras以及百度Paddlepaddle两者对比实现。由于传统的卷积神经网络算法进行表情识别的准确率没有达到最优,所以本设计的神经网络算法选择了MobilenetV2和mini_Xception两种模型进行训练,提高了表情识别的准确率。两者都是新出的轻量级模型,运用到了深度分离卷积算法,在很大程度上简化了运算量,从而减少了模型训练所需要的时间。就最终实测的结果而言,Tensorflow+Keras+mini_Xception的组合更加高效准确。

(2)实验结果

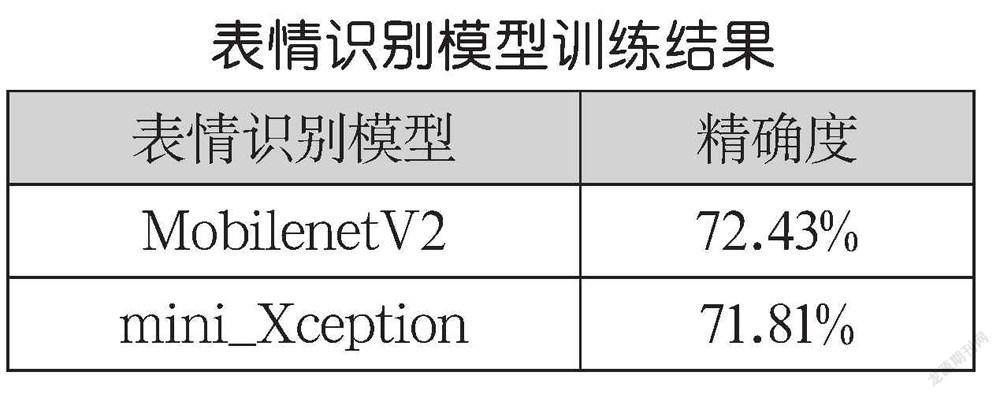

实验结果如上表所示。MobilenetV2和mini_Xception两个模型在测试数据集上的准确度都超过了70%,已经达到了相等条件下的最优。实验过程中笔者发现,mini_Xception模型对高兴和惊讶这两种表情的正确识别率最高,分别达到87%和77%,识别正确率最低的为害怕表情,只有42%。图2和图3分别是对GUI系统的展示,通过自定义图片和调用实时摄像头进行分析的结果。图2是加载图片的人脸识别结果和表情分类结果,图3是实时捕获摄像头并识别的结果,虽然该学生并不在人脸库中,但仍然能够识别其表情状态。

最后,关于表情与学生课堂学习效率的关系,笔者对录入系统的学生进行了课后问卷调查。调查结果显示,本系统对人脸的识别和表情识别的结果基本准确。在调查报告中,表情为中立的学生对知识的掌握效率要高于表现为其他的几种表情的学生;其中表现为生气、害怕、厌恶的学生对知识的掌握效率低于平均水平。由此可见,表情与学生对知识掌握效率有着一定的联系。所以,可以通过对学生的面部表情特征的实时分析得到班级学生对当前知识掌握的总体情况,从而为线下、线上教学提供有价值的教学反馈数据,帮助教师进行针对性的教学方案修改,提高课堂效率。

● 结语

本设计作为“学习者的微表情研究”课题的一部分,在一定的理论基础上,主要承担三方面工作:其一是搜寻可用于实际使用和训练的数据集,包括人脸数据库和表情识别数据集;其二是选择高效便捷的实现方案,建立准确度更高的模型并保存训练结果;其三是在前两项工作完成的情况下设计出直观、可用的交互式应用程序,方便测试与使用。本设计基本完成了以上任务,并采用了许多成熟且实用的工具和模块,如PyQt5、Python-OpenCV等。

参考文献:

[1]郑庆华,董博,钱步月,等.智慧教育研究现状与发展趋势[J].计算机研究与发展,2019,56(01):1-16.

[2]郑怡文,陈红星,白云晖.基于大数据在课堂教学中对学生精准关注的实验研究[J].现代教育科学,2016(02):54-57.

[3]侯洪涛.一种课堂环境下学生表情识别系统的研究[D].北京:北京工业大学,2015.

[4]刘三女牙,刘智,高菊,等.慕课环境下学习者学习行为差异性分析研究[J].电化教育研究,2016(10):57-63.

[5]冯满堂,马青玉,王瑞杰.基于人脸表情识别的智能网络教学系统研究[J].计算机技术与发展,2011(06):193-196.

[6]程萌萌,林茂松,王中飞.应用表情识别与视线跟踪的智能教学系统研究[J].中国远程教育,2013(03):59-64.

[7]孙波,刘永娜,陈玖冰,等.智慧学习环境中基于面部表情的情感分析[J].现代远程教育研究,2015(02):96-103.

[8]詹泽慧.基于智能Agent的远程学习者情感与认知识别模型——眼动追踪与表情识别技术支持下的耦合[J].现代远程教育研究,2013(05):100-105.

[9]杨金朋,薛耀锋,李佳璇,等.基于人脸表情识别的在线学习情感计算研究[J].中国教育技术装备,2017,18(35):35-43.

[10]李勇帆,李里程.情感计算在网络远程教育系统中的应用:功能、研究现状及关键问题[J].现代远程教育研究,2013(02):100-106.

[11]晋欣泉,王林丽,杨现民.基于大数据的在线学习情绪测量模型构建[J].现代教育技术, 2016(12):5-11.

[12]苏耶亚塔·兰尼.用以提升教学效果的情感分析系统[J].计算科学评论,2017,6(01):34-41.

[13]单存杰.教室场景中学生定位与身份识别[D].武汉:华中师范大学,2016.

[14]韩丽,李洋,周子佳,等.课堂环境中基于面部表情的教学效果分析[J].现代远程教育研究,2017(04):97-103+112.

[15]周建国,唐东明,彭争,等.基于卷积神经网络的课堂表情分析软件研究与实现[J].成都信息工程大学学报,2017,32(05):508-512.

[16]钟志鹏,张立保.基于多核学习特征融合的人脸表情识别[J].计算机应用,2015,35(S2):245-249.

[17]Zhang T,Zheng W,Cui Z,Zong Y,Yan J and Yan K. A Deep Neural Network-Driven Feature Learning Method for Multi-view Facial Expression Recognition[J].IEEE Transactions on Multimedia,2016,18(12):2528-2536.

[18]Li S and Deng W. Reliable Crowdsourcing and Deep Locality-Preserving Learning for Unconstrained Facial Expression Recognition[J].IEEE Transactions on Image Processing,2019,28(01):356-370.

[19]Rao Y, Lu J and Zhou J.Attention-Aware Deep Reinforcement Learning for Video Face Recognition[Z].Proceedings of 2017 IEEE International Conference on Computer Vision (ICCV),Venice,2017:3951-3960.

[20]Arriaga O,Ploger P G.,Valdenegro M.Real-time Convolutional Neural Networks for Emotion and Gender Classification[C].ICRA,2017(10).

作者簡介:毕洪波,男,徐州市第二中学教师,徐州教育督导室专职督学,研究方向为教育信息化;谢春丽,通讯作者,女,副教授,研究方向为教育智能化;洪庆成,男,江苏师范大学本科生;孙磊,男,江苏师范大学本科生。

基金项目:江苏省高等学校大学生创新创业训练计划项目(202010320035Z),教育部产学合作协同育人项目(d2a33dac-9bb7-4408-a778-19fbc71d68de)。

3797500589292