基于改进型Gbvs模型的眼底图像视盘检测方法

吴 骏 ,张亚男 ,肖志涛 ,耿 磊 ,张 芳 ,杨 嵩 ,张东霞 ,宋舒雅

(1.天津工业大学电子与信息工程学院,天津 300387;2.天津工业大学 天津市光电检测技术与系统重点实验室,天津 300387)

视盘是视神经的起始端和眼底血管的发源地,其内部汇聚着大量较粗的血管.在彩色眼底图像中,视盘呈类圆形,是一个近似黄色或白色的亮斑,直径约占眼底图像的1/7.准确的视盘检测不仅可以辅助定位血管、黄斑等重要的眼底组织结构,还可辅助确定渗出物、微动脉瘤等病变的位置,对眼底图像分析具有重要的意义.

视盘检测包括定位和分割2个步骤.根据视盘具有的特性,国内外研究人员提出了诸多视盘定位方法,大致可以分为2类.第1类是利用视盘的亮度、形状等外观特性定位视盘,例如邹北骥等[1]首先通过剪裁眼底图像来避免图像边缘高亮环对视盘定位的影响,然后选取灰度值处于前0.2%的像素点定位视盘;柯鑫等[2]利用Itti模型对眼底图像提取颜色、亮度和方向3个特征,将所得显著图中特征最显著的区域视为视盘.这类方法对于正常的眼底图像适用性良好,但是在病变眼底图像上,眼底疾病会造成视盘缺损或亮度变化,还有些与视盘外观相似的病变也会对视盘定位造成干扰.第2类是基于血管特性的视盘定位方法.由于视盘区域的血管密度较大,且主血管延伸曲线近似于2条相切抛物线,Foracchia等[3]采用2条几何抛物线分别描述主血管的延伸路径,利用2条抛物线的顶点位于视盘区域内这一特性定位视盘;Soares等[4]首先进行血管增强,然后利用血管方向信息进行视盘初定位,再利用血管汇聚度和亮度信息定位视盘.相较第1类方法,第2类方法准确率相对较高,鲁棒性较好,但是该类方法对血管的分割精度要求很高.在视盘分割方面,常用的方法是基于霍夫变换(Hough Transform)和主动轮廓模型(Snake)的.例如 Sekhar等[5]根据视盘的形状类似圆形的这一特性,利用圆形Hough变换分割视盘;李筱涵等[6]提出了结合迭代Otsu阈值化和Hough变换进行视盘分割的方法.Yin等[7]结合边缘检测和圆形Hough变换提取视盘的初始轮廓,再利用Snake模型来检测视盘边缘检;基于Hough变换的方法分割精度较低,而基于Snake模型的方法分割精度较高,但效果依赖于初始轮廓的选取.

观察一幅图像,并非所有的区域都会使观察者产生同样的视觉或心理感受,最重要的信息通常会集中在一些显著区域,人类视觉系统筛选显著区域主要利用的就是视觉注意机制.为了模仿人类视觉系统筛选信息的过程,1998年,Itti等[8]提出了最具代表性的基于视觉注意的图像显著性检测模型—Itti模型,之后Harel等[9]在其基础上提出了基于图的显著性(Graph based visual saliency,Gbvs)模型.这2个模型的主要区别在于在特征图生成阶段,Gbvs模型改进了Itti模型中的“中心—周边差”操作,在计算显著图时引入了马尔科夫链,利用马尔科夫链的稳态平衡来衡量图像的显著性,更加全局、动态地考虑了图像中点与点之间的显著性差异,从而检测出更多的感兴趣区域.

本文充分研究了视盘的视觉特征,将视觉注意机制与相位一致性[10]结合,对Gbvs模型进行了改进,提出了一种基于改进型Gbvs模型的视盘检测方法.

1 图像预处理

视盘进行检测前,首先要对图像进行预处理,分为颜色通道选取和感兴趣区域提取2个步骤.

1.1 颜色通道的选取

彩色眼底图像的红(R)、绿(G)、蓝(B)3个通道的图像如图1所示.

图1 彩色眼底图像的RGB通道图像Fig.1 RGB channel images

由图1可见,R通道图像整体亮度偏高、对比度较低;B通道图像整体偏暗,图像对比度最差;而G通道图像中视盘和血管结构清晰,对比度高,因此选取G通道进行视盘定位.

1.2 感兴趣区域提取

为了避免眼底图像边缘存在的高亮环对定位结果产生的不利影响,需要求取眼底图像的掩模图像,以确定眼底图像的感兴趣区域(region of interest,ROI).

具体方法如下:首先提取RGB通道的R通道,利用Otsu阈值分割方法出眼底图像的掩模;然后对所得的掩模进行先腐蚀再开运算的形态学操作,得到新的掩膜模板;再将新的掩膜模板与G通道图像相乘,得到相应的ROI区域.感兴趣区域提取结果如图2所示.

图2 感兴趣区域提取Fig.2 ROI extraction

2 基于改进型Gbvs模型的眼底图像显著性检测

在对图像进行预处理后,利用改进型Gbvs模型对预处理后的图像进行显著性检测.该模型可以分为3个部分:视觉特征提取、特征图生成和显著图生成.在视觉特征提取阶段,Gbvs模型与Itti模型类似,都提取了颜色、亮度、方向3类特征.由于眼底图像的颜色容易受到被试个体差异以及拍摄环境的影响,因此其特征不稳定.Gbvs模型利用Gabor滤波器仅在θ∈{0°,45°,90°,135°}4 个方向上对图像进行滤波并提取特征,不能全面描述视盘的边缘特征.因此本文方法没有提取颜色和方向两类特征,而是针对眼底图像的特点,提取了亮度、对比度和PC 3类特征.

2.1 视觉特征提取

PC特征[11]是一种基于相位信息的图像特征.相关生理学实验证明[12],人类的视觉系统对于图像中相位信息高度一致的点会更加敏感,因此PC检测符合人类视觉感知特性.PC特征可用于检测阶跃型边缘和屋脊型边缘,对图像亮度或对比度变化不敏感,具有很强的通用性,应用于眼底图像中能很好地描述图像边缘特征.此外,视盘亮度较高,与眼底其他组织相比对比度较强,因此本文方法提取了亮度、对比度和相位一致性3类特征.

提取特征的过程为:首先把输入图像表示为3层高斯金字塔.其中第1层是输入图像,第2、3层金字塔数据是利用线性高斯滤波器对图像进行平滑和降采样得到的结果,尺度分别为第1层图像的1/2、1/4.然后对金字塔每一层分别提取3类特征,形成亮度高斯金字塔、对比度高斯金字塔和相位一致性高斯金字塔,一共得到9幅图像,其中亮度3幅、对比度3幅、相位一致性3幅.3类特征提取的计算公式如下:

(1)亮度特征:设r、g、b分别代表彩色图像的红、绿、蓝3色分量,由于本文方法只使用了眼底图像的绿色通道,所以亮度特征为I=g.

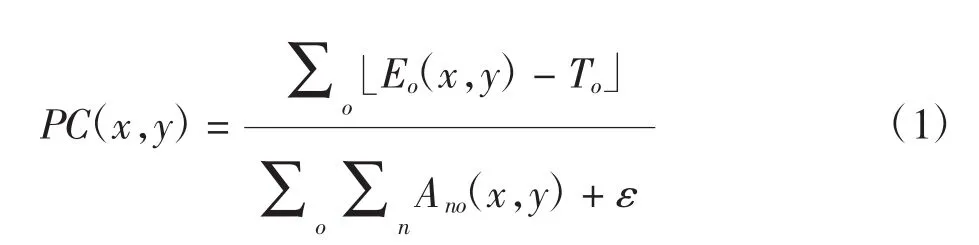

(3)相位一致性特征[12]:

式中:o表示方向;n表示小波函数的尺度;E为局部能量;T为所有尺度上滤波器对噪声的响应;⎿·」中的值为正则取值不变,若为其他值则取0;A表示单个滤波器的幅度;ε是为了防止分母为0而引入的常量,其值设为 0.000 1;PC(x,y)表示在点(x,y)的相位一致性.

本文方法选取了滤波器响应最大的6个方向,令o=6;为不丢失眼底细节,选取了3个尺度,令n=3.局部能量E可由信号与一对正交滤波器的卷积来计算,Field[13]指出使用对数频率尺度上传递函数为高斯函数的滤波器可以对图像进行更有效地编码,而且人类视觉系统的度量也显示出有响应在对数频率尺度上呈现对称性的细胞,因此本文方法采用Log-Gabor小波来计算局部能量,其传递函数的形式为:

式中:ω0为滤波器的中心频率.

2.2 特征图生成

特征图生成运用了图论的知识,其基本原理为:设各金字塔每一层图像为M,以像素为节点,将M的每个像素点都两两连接起来,将图像M映射为1个无向图GM.图像中的每一个节点对应的值代表其当前状态,其所有边的权重代表其转移概率.基于马尔科夫链的局部特性,马尔科夫链会收敛于那些和周围节点不相似的节点,由此即可计算得到特征图.

具体过程为:对于图GM,首先利用节点之间的距离d,计算出任意像素之间的差异性,将其作为其对应节点连成的边的权重ω,并归一化到[0,1];然后计算出权重矩阵,将其按列归一化,归一化后的矩阵称为马尔科夫矩阵,用以反映GM中任意一个节点和其他所有顶点的联系;最后计算马尔科夫矩阵最大谱对应的特征向量,插值回原图得到特征图.由此计算出特征图9幅,其中亮度3幅、对比度3幅、相位一致性3幅.连接权重定义如下:

式中:M(i,j)和 M(p,q)分别表示像素(i,j)和(p,q)的像素值;d((i,j)‖(p,q))表示(i,j)和(p,q)两节点之间的距离;式(3)中 ω((i,j),(p,q))表示(i,j)和(p,q)两节点的权重;式(4)中σ是一个参数,其大小与邻域范围大小成正比.

2.3 显著图生成

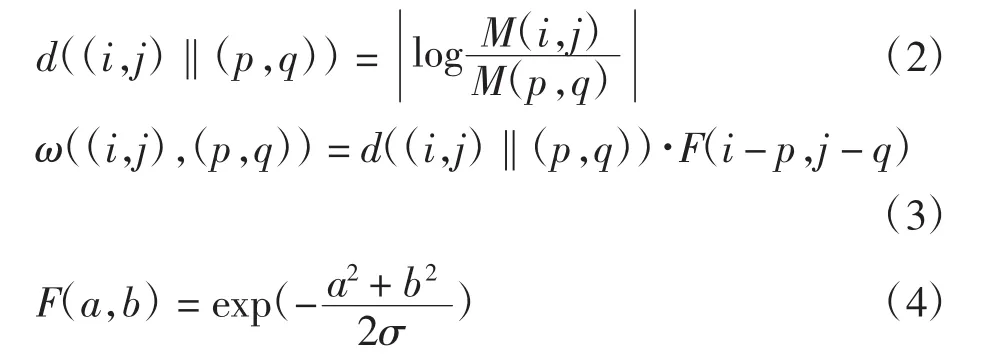

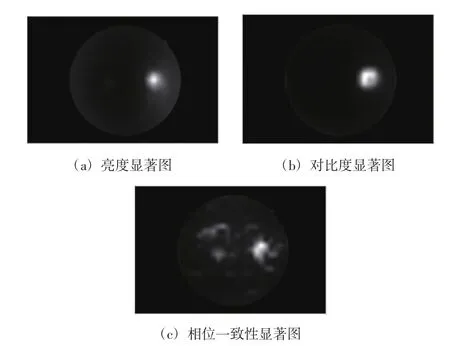

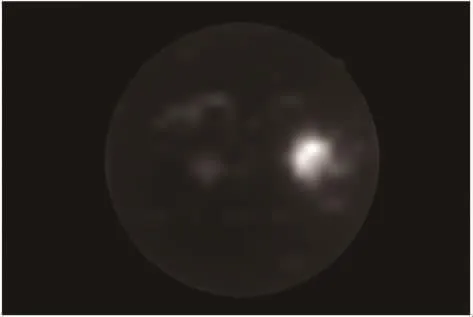

首先对3个特征各自的特征图进行尺寸归一化,再将每个特征的特征图分别相加,得到3张显著图,如图3所示.再将这3张显著图按照1∶1∶1的比例进行线性相加,最终得到的总显著图表示为S,如图4所示.

图3 各特征显著图Fig.3 Saliency maps of features

图4 总显著图Fig.4 Integrated saliency map

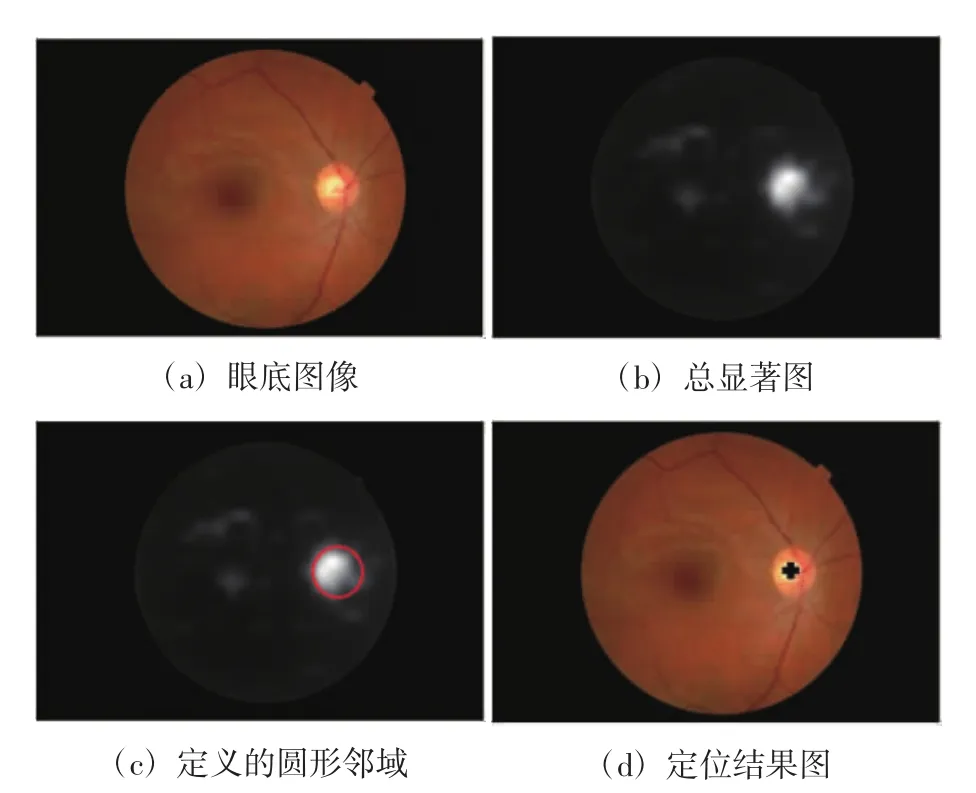

3 视盘定位

利用Gbvs模型得到的总显著图S是一张灰度图像,其像素值的大小反映眼底图像显著性的大小.视盘通常是眼底图像中显著性较高的区域,因此可以利用窗口扫描的方法找到灰度均值最大的地方来定位视盘.在视盘定位中,滑动窗口的大小即视盘直径D的合理选取,对定位结果至关重要.根据文献[14]的描述,视盘直径与眼底图像宽度大小的比例为1/8~1/5.因此,对于一幅尺寸为m×n的彩色眼底图像,本文方法依据图像的大小自动获取视盘直径D为m/7.

窗口扫描具体步骤如下:

(1)首先定义一个直径为视盘直径D的滑动窗口,利用此滑动窗口以1个像素为步长,对S从左向右、从上到下进行扫描;

(2)统计窗口内像素灰度均值,像素均值最大时窗口所对应的中心坐标,将坐标值反馈到原图作为最终的视盘中心位置,在检测结果图中用黑色“+”标记.视盘定位示例如图5所示.

图5 视盘定位示例Fig.5 An example of optic disc location

4 视盘分割

眼底图像RGB三通道中,虽然R通道图像对比度较低,但是R通道图中视盘区域最明显,视盘内部血管信息模糊、视盘的整体轮廓信息较为完整,因此在视盘分割过程中采用R通道作为预处理灰度图像.视盘定位之后,本文采用基于邻域插值运算进行消除血管,具体操作如图6所示.

图6 基于邻域插值运算消除血管Fig.6 Remove vessles based on neighborhood interpolation

首先,为了避免其他眼底组织的干扰,对R通道图像截取以定位点为中心,长度约为2个视盘直径(2D)大小的方形区域作为感兴趣区域,如图6(a)所示.为了减少视盘区域内血管对视盘分割结果的影响,在进行视盘分割之前,先把视盘区域的主血管消除掉.本文首先利用低帽变换以及Otsu阈值分割方法提取出视盘中的血管,如图6(b)所示,在提取出血管之后,利用减除操作消除血管,然后利用最邻近插值法在邻域中填充被移除的血管位置的像素,消除血管后的结果如图6(c)所示.邻域插值算法能够自动寻找背景中最接近血管的像素填补血管位置像素的灰度值,所以在经过插值运算后的图像看上去会比较平滑干净,同时可以较好的保护视盘边界.

消除血管之后,即可进行后续的视盘分割.本文利用C-V模型在消除血管后的图像上进行视盘分割.首先设定一个初始位置,本文设定了一个以定位点作为中心,1倍视盘直径(D)大小的圆作为初始轮廓,然后进行曲线演化.C-V模型的基本思想是隐式表达一条平面封闭的曲线,写成一个随着曲线的运动而演化的二维曲面函数的水平集形式,其能量函数定义如下:

该模型假设有一条目标曲线C将图像分为目标区和背景区2个部分,其中,I表示图像,c1和c2分别表示着 2 个区域对应的平均灰度值.λ2、λ1、μ、υ为各项的加权系数,通常令λ1=λ2=1.公式前2项共同推动曲线向目标边界运动,称为保真项,在轮廓曲线收敛到目标边界时,EC-V(C,c1,c2)达到最小值;公式的后 2项用来正规化曲线轮廓,被称为正则约束项[15].其中length(C)表示轮廓曲线C的长度,与C的光滑程度有关,其值越小闭合曲线越光滑;而S0(inside(C))代表闭合曲线C的内部区域面积.利用C-V模型求取目标边界的问题其实就是在求EC-V(C,c1,c2)的最小值.

C-V模型不依赖于图像的梯度,而是根据强度均匀的同质区域进行水平集演化,对初始轮廓不敏感,并且可以捕捉图像全局信息,因此能够分割梯度信息不确定的模糊边界,适用于视盘分割.

5 实验结果分析

MESSIDOR眼底图像数据集是法国国防研究部资助的一个项目,其中的眼底图像都是在常规临床检查中使用眼底相机拍摄的.该数据集是当前国际上已公开的包含眼底图像数最多的图像数据集,因此本文方法选择在该数据集上进行实验来验证方法性能.MESSIDOR数据集共包含1 200幅彩色眼底图像,其中540幅健康眼底图像,660幅病变眼底图像.本文方法利用改进后的Gbvs模型计算显著图,加入了对亮度和对比度不敏感的PC特征,因此对于一些对比度低的图像仍然可以定位出视盘,部分定位结果如图7所示.在对MESSIDOR数据集测试后,本文方法的平均定位准确率为98.83%.

图7 MESSIDOR数据集视盘定位结果Fig.7 Optic disc location results on MESSIDOR database

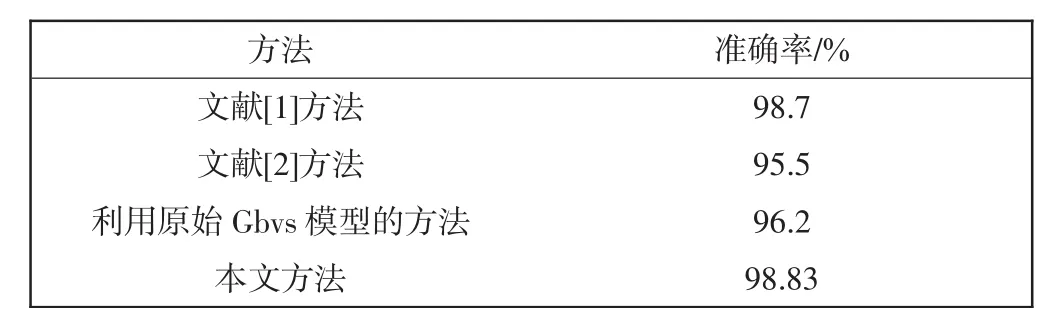

将本文方法与2种现有代表性方法[1-2]对于MESSIDOR眼底数据集测试的定位准确率进行比较,对比结果如表1所示.

表1 不同方法的视盘定位准确率比较Tab.1 Comparison of disc localization accuracies among different methods

由表1可知,文献[1]通过剪裁眼底图像,然后利用图像亮度特征进行视盘定位,文献[2]则利用Itti模型计算亮度、颜色、方向3类特征的综合显著图进行视盘定位.由于文献[1-2]中的方法只利用视盘外观特性定位,容易受到病变影响.本文方法利用改进后的Gbvs模型计算显著图,以马尔科夫链的稳态平衡来衡量图像的显著性,更加全局地考虑了像素点之间的显著性差异,能够检测出图像中更多的ROI,而且改进后的Gbvs模型加入了对亮度对比度不敏感的PC特征,因此本文方法与文献[1-2]的方法相比效果更好.

此外,表1还给出了利用原始Gbvs模型及本文方法的准确率比较结果.原始的Gbvs模型在视觉特征提取时选择了的方向特征和颜色特征,但是受被试个体差异的影响以及Gabor滤波器只进行4个方向滤波的局限性,这2个特征并不适合视盘检测,而本文方法对Gbvs模型进行了改进,改进型Gbvs模型加入了对比度以及对亮度变换不敏感的PC特征,对于一些视盘亮度不显著的眼底图像,可以通过提取对比度和PC特征来获得眼底视盘的显著性,因此准确率更高.

利用本文方法在MESSDIOR数据集上进行视盘分割,部分分割结果如图8所示.

图8 MESSDIOR数据集部分眼底图像视盘分割结果Fig.8 Partial fundus image segmentation results in MESSDIOR dataset

图8为部分眼底图像的视盘分割结果,图中黑色线画的圆圈表示采用本文方法的视盘边界拟合结果.其中图8(a)—图8(c)边界较为清晰,利用C-V模型可以较为精确的分割出视盘边界.图8(d)中视盘边界比较模糊,图8(e)和图8(f)中视盘边界分别被异物以及大量血管遮挡,但是采用由于本文方法在进行视盘分割之前首先进行了血管消除,因此仍能较好地检测出视盘边界.

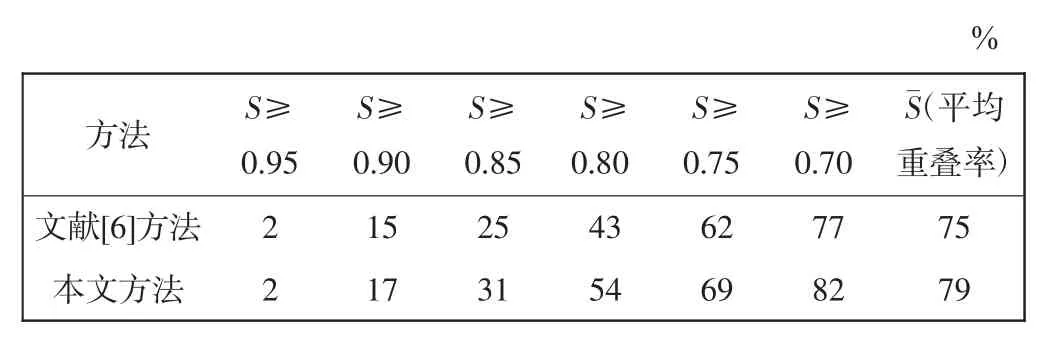

为了验证本文方法的视盘分割性能,将本文方法与代表性方法[6]的视盘分割方法进行比较,文献[6]是利用结合迭代Otsu阈值化和Hough变换进行视盘分割的.首先计算专家标注的视盘区域与本文方法分割出的视盘区域之间的面积重叠比S,S定义如下:

式中:GT表示由专家手动标注的视盘区域;C表示利用本文方法分割出的视盘区域;GT∩C为这2个区域之间的交集;GT∪C为这2个区域的并集;S则表示着2个区域之间的重叠率,其中0≤S≤1,S的值越趋近于1,表示这2个区域重叠度越高,同时也就说明方法分割精度更高.

表2 本文方法和文献[6]方法的重叠率比较Tab.2 Overlap rate comparison between the proposed method and the method of literature[6]

采用本文方法和文献[6]方法对MESSIDOR数据集测试之后,计算数据集里所有图像的重叠率S,表2中的数据代表不同面积重叠率对应的图像数占所有图像数的百分比.例如表第2行第3列的数据表示本文方法分割的面积重叠率S≥0.95的图像数占全部1 200幅图像的2%.最后一列表示2种方法对MESSIDOR数据集所有图像测试后的平均重叠率文献[6]的方法利用Hough变换进行视盘分割为75%;而利用本文方法得到的为79%,与文献[6]方法相比,本文方法利用C-V模型进行视盘分割,分割精度更高.表2中不同面积重叠率S对应的视盘分割示例图如图9所示,图中白色曲线是专家分割的视盘边界,黑色曲线是本文方法的分割出的视盘边界.

虽然本文方法整体检测效果较好,但是对于一些眼底图像也会检测失败,如图10所示.

由于眼底图像中存在着一些病变,其亮度、对比度、相位一致性这3类视觉特征显著性要高于视盘,使得视盘定位失败;眼底图像中视盘周边有亮度大的病变干扰,而且视盘边界比较模糊,因此造成视盘分割错误.由于视盘既是眼底图像中显著性较高的区域,又是血管的发源地,因此针对上述视盘检测时存在的问题,如果加入血管特征对本文方法进行改进,检测准确率会进一步提高,因此本文方法还值得进一步研究.

图9 不同面积重叠率的视盘分割结果示例Fig.9 Examples of optic disc segmentation for different area overlap rates

图10 本文方法检测失败的结果示例Fig.10 Example of incorrect result of proposed method

6 结 语

本文提出一种结合视觉注意机制和相位一致性的眼底图像视盘检测方法.该方法将Gbvs模型所提取的颜色、亮度和方向3类视觉特征改为亮度、对比度和PC特征,其中PC特征符合人眼视觉特性,且不受亮度变化影响,因此可以弥补只利用亮度和对比度进行视盘定位时受拍摄光照条件、视盘亮度变化干扰的不足;在进行视盘分割前,首先采取邻域插值方法消除血管,使视盘的真实边界得以保留.由于本文方法全面地考虑了视盘的视觉特征,可以克服仅根据视盘亮度、形状等外观特性进行定位与分割的缺陷.在MESSIDOR眼底图像数据集上进行测试,平均定位准确率为98.83%,平均重叠率为79%,实验结果表明了本文方法的视盘定位准确率和分割精度高于现有代表性方法,证明了该方法的有效性.

[1]邹北骥,张思剑,朱承璋.彩色眼底图像视盘自动定位与分割[J].光学精密工程,2015,23(4):1187-1195.ZOU B J,ZHANG S J,ZHU C Z.Automatic localization and segmentation of optic disk in color fundus image[J].Optics and Precision Engineering,2015,23 (4):1187-1195 (in Chinese).

[2]柯鑫,江威,朱江兵.基于视觉注意机制的眼底图像视盘快速定位与分割[J].科学技术与工程,2015,15(35):47-53.KE X,JIANG W,ZHU J B.Fast location and segmentation of optic disk in the fundus image based on visual attention[J].Science Technology and Engineering,2015,15(35):47-53(in Chinese).

[3]FORACCHIA M,GRISAN E,RUGGER A.Detection of optic disc in retinal images by means of a geometrical model of vessel structure[J].IEEE Transactions on Medical Imaging,2004,23(10):1189-1195.

[4]SOARES I,CASTELO-BRANCO M,PINHEIRO A.Optic disk localization in retinal images based on cumulative sum fields[J].IEEE Journal of Biomedical and Health Informatics,2016,20(2):574-585.

[5]SEKHAR S,AL-NUAIMY W,NANDI A K.Automated localization of retinal optic disk using hough transform[C]//Proceedings of 5th IEEE International S ymposium on Biomedical Imaging:From Nano to Macro,Paris,France:IEEE,2008:1577-1580.

[6]李筱涵.基于相位信息的眼底图像视盘定位与分割方法研究[D].天津:天津工业大学,2012.LI X H.Fundus optic disc localization and segmentation method based on phase congruency[D].Tianjin:Tianjin Polytechnic University,2012(in Chinese).

[7]YIN F,LIU J,ONG S H,et al.Model-based optic nerve head segmentation on retinal fundus images[C]//Proceedings of 2011 Annual International Conference of the IEEE Engineering in Medicine and Biology Society.Boston,USA:IEEE,2011:2626-2629.

[8]ITTI L,KOCH C,NIEBUR E.A model of saliency-based visual attention for rapid scene analysis[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1998,20(11):1254-1259.

[9]HAREL J,KOCH C,PERONA P.Graph-based visual saliency[J].Advances in Neural Information Processing Systems,2007,19:545-552.

[10]吴骏,刘健,肖志涛,等.结合相位一致性和脉冲耦合神经网络的图像检索[J].天津工业大学学报,2014,33(3):48-54.WU J,LIU J,XIAO Z T,et al.Image retrieval combining phase congruency and PCNN[J].Journal of Tianjin Polytechnic University,2014,33(3):48-54(in Chinese).

[11]KOVESI P.Image features from phase congruency[J].Journal of Computer Vision Research,1999,1(3):1-26.

[12]MORRONE M C,BURR D C.Feature detection in human vision:A phase-dependent model[J].Proceedings of the Royal Society of London,Series B,Biological Sciences,1988,235(1280):221-245.

[13]FIELD D J.Relations between the statistics of natural images and the response properties of cortical cells[J].Journal of Optical Society of America,1987,4(12):2379-2394.

[14]TASMAN W,JAEGER E A.Duane′s Ophthalmology[M].15th ed.Philadelphia:Lippincott Williams&Wilkins,2009.

[15]周昌雄.基于活动轮廓模型的图像分割方法研究[D].南京:南京航空航天大学,2005.ZHOU C X.Research on method of image segmentation based on active contour model[D].Nanjing:Nanjing University of Aeronautics and Astronautics,2005(in Chinese).