基于分层特征对齐网络的小样本马铃薯病害叶片检测

牛玉霞 孙宙红 任伟 陈林琳 陈莉莉

摘要:針对传统马铃薯病害叶片检测方法过度依赖大量训练数据以及对未知病害识别泛化性不强的问题,提出一种基于分层特征对齐网络的小样本马铃薯病害叶片检测模型。首先,收集并整理包含多种病害类型的弱标注马铃薯病害叶片数据集。其次,在支持分支中建立文本语义和视觉语义的多模态双层特征语义表示,并利用预训练网络生成多个候选框。再次,利用卷积神经网络将候选框区域映射到深度特征空间,并借助无参数的度量方法实现文本语义与视觉语义的特征对齐。最后,将查询分支中的未知类病害图片与多模态视觉和文本语义关联集进行度量计算,根据相似度值快速给出待测图片中未知新类的病害类别。通过在自建的马铃薯病害叶片数据集和开源数据集上进行测试,所提出模型分别可以实现93.55%和96.35%的识别精度,在跨域数据集上可以实现95.15%和94.06%的识别精度,优于当前经典的目标检测模型,具有一定的实际应用价值。

关键词:马铃薯病害;叶片检测;分层特征对齐网络;文本语义;视觉语义

中图分类号:TP391

文献标识码:A

文章编号:20955553 (2024) 02025009

收稿日期:2023年9月20日 修回日期:2023年11月1日

基金项目:江苏省农业农村污染防治技术与装备工程研究中心开发资金资助(GCZXYB2305)

第一作者:牛玉霞,女,1981年生,山西壶关人,硕士,讲师;研究方向为计算机应用技术、智慧农业、病害检测。Email: niuyuxia533@sina.com

通讯作者:陈林琳,女,1979年生,江苏南通人,硕士,副教授;研究方向为数字农业、大数据技术。Email: youjiu1640628ke@163.com

Fewshot potato disease leaf detection based on hierarchical feature alignment network

Niu Yuxia1, 2, Sun Zhouhong3, Ren Wei1, 2, Chen Linlin1, 2, Chen Lili1, 2

(1. School of Information and Intelligent Engineering, Nantong College of Science and Technology, Nantong,

226007, China; 2. Jiangsu Province Engineering Research Center of Agricultural and Rural Pollution Prevention

Technology and Equipment, Nantong, 226007, China; 3. Yunnan University, Kunming, 650000, China)

Abstract:

In order to address the problems of the overreliance on large amounts of training data and the poor generalization of unseen disease identification in traditional potato disease leaf detection methods, a fewshot potato disease leaf detection model based on hierarchical feature alignment network is proposed. Firstly, a weakly labeled dataset containing various types of potato diseases were collected and annotated. Secondly, the multimodal bimodal feature semantic representations of textual and visual semantics in the support branch were established, and multiple candidate boxes were generated using a pretrained region proposal network. Thirdly, a convolutional neural network was adopted to map the candidate box regions into deep feature space, and feature alignment was performed between textual and visual semantics using an unparameterized metric method. Finally, the similarity was computed between the unseen class disease images in the query branch and the multimodal visual and textual semantic association set, and the disease category of the unseen new class was quickly provided according to the similarity value. Through testing on selfbuilt potato disease leaf datasets and open source datasets, the proposed models can achieve recognition accuracy of 93.55% and 96.35% on the test sets, respectively, and 95.15% and 94.06% on the crossdomain datasets, which is superior to the current classical object detection models. The proposed method has certain practical application value.

Keywords:

potato disease; leaf detection; hierarchical feature alignment network; textual semantics; visual semantics

0 引言

作为全球最重要的粮食作物之一,马铃薯在主食领域发挥着重要作用,同时在工业和饲料方面也具有巨大潜力。然而,随着全球气候变化的不断加剧,马铃薯叶片的病害频率和严重程度也在不断上升,这给马铃薯的产量和质量带来了巨大的挑战。因此,研究马铃薯病害叶片检测技术显得尤为重要。

传统的马铃薯病害叶片检测主要依赖于人工田间巡查和肉眼观察,这种方法存在耗时、费力且准确性不高的问题[12]。近年来,随着机器学习和图像处理技术的快速发展,基于计算机视觉的马铃薯病害检测技术应运而生[3]。这种技术利用高精度设备获取马铃薯植株的图像数据,并结合深度学习算法进行图像分析和识别,从而实现对马铃薯病害的自动检测和分类[4]。如赵越等[5]利用Faster RCNN设计了一种新的马铃薯叶片病害检测方法,针对数据集有限的问题,利用数据增强的方式对多种病害图片进行扩展,并采用参数迁移的方式对模型进行初始化,通过与Yolo V3和V4等模型进行对比,验证了所设计模型在处理马铃薯病害叶片识别任务中的优越性。类似的工作还包括王林柏等[6]提出的基于卷积神经网络的马铃薯叶片病害识别方法,该方法通过改进Inception V3网络提出了一种新的CenterSPP模型,并在多个场景下验证了模型的有效性。肖志云等[7]提出了一种基于自适应特征融合网络的马铃薯叶片病害识别方法,通过利用多种机器学习算法定位给定图片中的病害区域,根据颜色、纹理和形状等特征对病害区域特征进行主成分分析,利用分析结果快速判定病害类型。虽然上述利用机器学习或专家经验进行病害区域定位的方法在多个场景下取得了令人满意的结果,但该类方法的识别性能过度依赖大量带标注的训练样本,不利于实际应用。

针对识别性能过于依赖训练数据的问题,章广传等[8]利用迁移学习算法提出了一种马铃薯病害叶片识别方法,首先在特征提取阶段利用多种迁移方式进行特征提取,其次,借助混淆矩阵对多种迁移效果进行评估,最后,在自建数据集上进行测试,验证了所设计模型的有效性。邢鹏康等[9]提出了一种小样本学习的马铃薯叶片病害检测模型,旨在缓解数据样本标注费时费力、新类识别的泛化性能不强的问题,该方法主要借助动态卷积神经网络捕获病害区域特征,提高了不规则病害区域的定位精度。上述利用参数迁移或模型迁移的方式可以有效缓解模型因数据样本不足导致过拟合的问题,并且在开源和自建数据集上验证了模型的有效性。然而在实际应用中,马铃薯早期病害类型诊断难度大,只有确定病害类型后才将病害图片加入马铃薯病害叶片数据集中,这使得已训练过的深度神经网络模型很难泛化到未知马铃薯叶片新病害识别任务中,识别性能难以满足实际应用。

针对传统马铃薯叶片病害识别方法的性能过度依赖带标注的数据样本问题以及已训练过的深度模型对未知新类病害泛化性能不强的问题,本文提出一种基于视觉和文本语义分层特征对齐网络的小样本马铃薯病害叶片识别模型。首先,利用预训练网络生成多个候选框,并利用卷积神经网络将候选框区域映射到深度特征空间;其次,建立病害文本库;再次,借助一种无参数的度量实现视觉语义与文本语义的特征对齐;最后,将待识别的查询图片映射到深度特征空间,并计算特征与文本视觉语义对之间的相似度值,根据相似度值快速判定待测马铃薯病害叶片的类型。

1 马铃薯病害叶片数据集

依托甘肃定西某马铃薯生产基地构造本文所采用的马铃薯叶片病害叶片数据集,采用佳能(Canon)EOS R8 RF 24-50搭载STM镜头作为拍摄设备。拍摄的所有图片统一大小为448像素×448像素,总共包含1137张原始图片,并经过旋转、遮挡、部分裁剪、滤镜等方式进行数据增强,最后获得7534张图片作为模型的训练集,107张图片作为测试集。其中,训练集包含炭疽病、叶枯病、黑斑病、灰霉病、黄叶病和健康叶片等六种,测试集包含叶斑病、褐斑病和锈病三种,详细信息如表1所示。训练集中的不同病害样本和健康样本示例如图1所示。经过数据增强的训练样本示例如图2所示。

2 马铃薯病害叶片检测方法

2.1 模型结构

本文提出的基于分层特征对齐网络的小样本马铃薯病害叶片检测方法采用小样本元学习框架,即在支持分支中学习迁移知识,并将其推广到查询集中未知新类的定位与识别任务中,主要包括5部分。(1)候选区域生成:利用预训练的区域生成网络裁剪出多个目标的候选区域;并借助上采样操作统一区域特征图的大小。(2)视觉特征提取:利用预训练的Vgg16网络提取多个候选区域的特征,并构造特征集。(3)利用预训练的BERT将病害库中的文本映射到文本语义空间。(4)利用无参数的度量方法实现文本与视觉语义的特征对齐。(5)在测试阶段,将利用预训练的特征提取器将查询图片映射到视觉语义空间,通过计算每一位置处的特征与文本—视觉特征之间的相似度,快速定位病害区域并给出病害类型。模型结构如图3所示。

2.2 候选区域生成

整张图片中马铃薯叶片病害区域占比较小,尤其是早期病害区域极小、并且病害区域颜色较模糊,这给利用整张图片进行病害区域定位与识别增加了难度。为此,本文首先利用候选区域生成网络(Region Proposal Network,RPN)[1011]细粒度地提取目标对应的局部区域,有效缓解整张图片中无关背景噪声对模型性能的干扰。RPN网络是目标检测领域常用的神经网络框架,自從2014年Jitendra等提出后,其在计算机视觉领域得到了广泛的应用。RPN的原理是基于卷积神经网络,首先使用预训练的卷积神经网络模型将给定图片映射到深度特征空间,并利用滑动窗口、偏移转置等操作在提取的特征图中生成一系列候选区域框,并通过不断调整使得候选框区域尽可能包含目标前景信息,这在一定程度上会降低无关噪声信息的干扰。RPN的工作原理如图4所示。

值得注意的是,由于候选框设定的比例不同,导致生成滑动窗口区域大小也不尽相同[12],此处采用的滑动窗口大小设定为3×3、5×5和7×7,并利用非极大值抑制方法对生成的候选区域框进行筛选,最终设定候选框的纵横比为1∶1、1∶2和2∶1,对应的区域框图大小为128×128、256×256和512×512。

然而,提取不同大小的候选框区域势必导致特征图大小不相同,增加了特征提取阶段的运算成本[13]。为此,在特征提取之前,利用RoI Alignment技术将不同候选框对应的特征图统一为相同大小[14]。具体地,此处选择所有候选框中最大面积区域的长和宽,并采用双线性插值算法将不同候选框统一为预定的长和宽,并以归一化后的特征图作为视觉特征提取模型的输入。

2.3 视觉特征提取

利用预训练的主干网络将图片映射到深度特征空间已成为计算机视觉任务中一个标准的步骤[15]。考虑到深度模型对硬件资源的高要求,选择在ImageNet数据集上预训练的Vgg16、ResNet50和ResNet101网络作为主干网络提取多个候选区域的深度视觉语义特征。马铃薯叶片病害区域相比整张图片占比较小,利用当前主流的大模型或深度网络极易造成深度语义特征的丢失,尤其是经过16倍率或32倍率的下采样后,小目标病害区域的特征极易被当做背景而忽略[1617]。以Vgg16网络为例,进行阐述特征提取的流程,Vgg16网络总共包括16层,其中13层为卷积层和池化层,剩余3层为全连接层。利用Vgg16提取的多个候选框的视觉语义特征可表示为式(1)。

Fv=∑H×Wh×wσ(Fs)

(1)

式中:

h、w——滑動窗口的长、宽;

H、W——原始图片的长、宽;

σ(·)——Vgg-16网络;

Fs——候选框区域对应的特征图;

Fv——多个候选框对应的特征集。

2.4 文本特征提取

传统的马铃薯病害叶片识别方法过多依赖已见过的病害,对于未知的病害识别性能不佳[18]。存在的潜在原因是马铃薯病害类型多样,前期病害类型的诊断与命名需要依赖专家经验,并且病害类型与对应的图片需要人工建立监督信息。这极大地增加了人工标注的开销,并且模型的泛化性能依赖网络模型的微调,不利于实际应用。针对上述问题,本文设计了一种离线式的文本与视觉语义对齐网络,主要优势是当新的马铃薯病害类添加时,所提出的模型无需进一步微调网络模型,仅在病害文本库中添加对应的病害文本,并经过词向量转换模型建立与视觉语义的对齐。此处,采用预训练的BERT词向量映射网络模型[19],BERT网络结构如图5所示。

BERT是一种自然语言处理模型,近年来在文本分类、情感分析和说话人识别领域应用广泛。结合图5,每一文本标签可表示为lb={l1,l2,…,ln},马铃薯病害文本标签集可表示为LB={lb1,lb2,…,lbm},其中m表示病害类型的总数,n表示词向量的长度,TE表示预训练的多层双向Transformer编码器[18],利用TE将每一文本标签转换为对应的词向量矩阵V,具体计算如式(2)所示。

V=∑ni=1s(li)

(2)

式中:

V——

每一病害类型的词向量矩阵,V={v1,v2,…,vn};

li——

文本标签中第i个词的向量化表示;

s(·)——文本词向量转换函数。

最后,将所有词向量矩阵存储在列表中,构造马铃薯病害词库VB={V1,V2,…,Vm}。

2.5 视觉文本语义对齐

为了实现马铃薯病害叶片的视觉语义特征与文本词库之间的语义对齐,采用无参数的度量方法计算视觉语义与文本词库中每一标签语义的相似度[20],根据相似度值快速给出待测马铃薯叶片区域的标签,实现病害区域的定位与分类。此处,考虑到视觉语义特征与文本语义特征在深度空间中分布的一致性[21],选择余弦相似度方法计算视觉语义特征与文本语义特征间的相似度,具体计算如式(3)所示。

Sc=Fvi·Vj‖Fvi‖‖Vj‖

(3)

式中:

Sc——相似度分数。

根据相似度值建立视觉与文本语义对之间的关联,即构造视觉—文本语义对{(Fv1,v1),(Fv2,v2),…,(Fvn,vn)}。

2.6 病害叶片识别

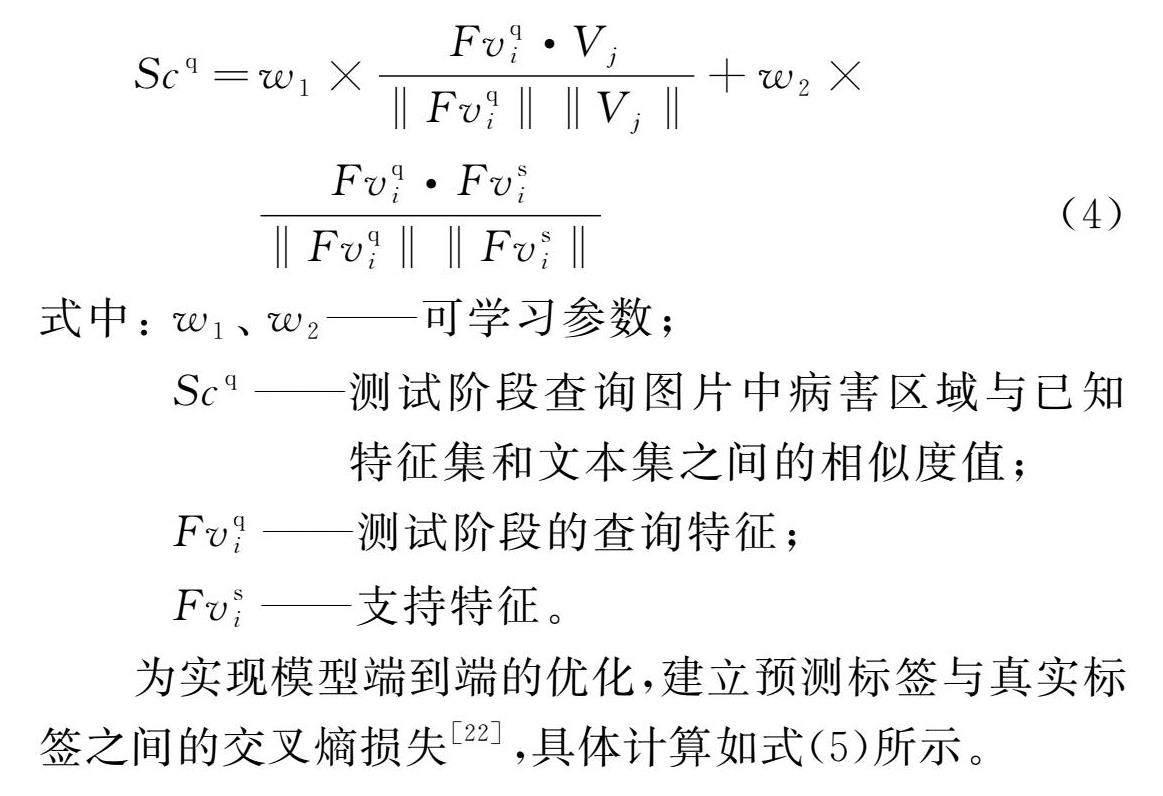

为了提高模型对未知马铃薯病害叶片的泛化性能,采用小样本元学习范式,即将任务划定为多个子任务,在每个子任务中利用支持图片和对应的标签信息指导查询图片中未知新类的识别与定位。在测试阶段采用相同的学习范式,将测试集划分为多个子任务,每个任务中利用支持信息指导查询图片中未知病害区域的定位和病害类型的识别,这极大地促进了模型对于未知新类的泛化性能。此处,仍然采用无参数的度量实现待测马铃薯病害叶片的视觉特征与文本标签库中每一标签之间的相似度值,并根据相似度值给出对应的预测标签。具体计算如式(4)所示。

Scq=

w1×Fvqi·Vj‖Fvqi‖‖Vj‖+w2×

Fvqi·Fvsi‖Fvqi‖‖Fvsi‖

(4)

式中:

w1、w2——可学习参数;

Scq——

测试阶段查询图片中病害区域与已知特征集和文本集之间的相似度值;

Fvqi——测试阶段的查询特征;

Fvsi——支持特征。

为实现模型端到端的优化,建立预测标签与真实标签之间的交叉熵损失[22],具体计算如式(5)所示。

ls=-∑lb×log(pl)

(5)

式中:

ls——

预测值与真实值间的交叉熵损失;

pl——预测的马铃薯病害叶片标签;

lb——真实的标签;

log(·)——对数函数。

3 试验

3.1 试验环境与评价指标

所有试验均基于Linux操作系统,搭载cuDNN深度学习加速库、NVIDIA CUDA 11.1。深度学习框架选择PyTorch,编程语言采用Python 3.7.1,编辑器选择PyCharm,GPU为NVIDIA Tesla A100 80GB。设定初始学习率为0.008,batch的大小设定为8,选择SGD作为优化器。模型迭代次数设定为300,候选框的个数设定为3。所有超参数的设定依据如图6、图7所示。

(a) 学习率与精准率的对应关系

(b) 候选框个数与精准率的对应关系

(c) Batch大小与精准率的对应关系

为了公平地与当前主流的马铃薯病害叶片检测模型相比,选择主流的评价指标:精准率Precision、召回率Recall和F1score。具体计算如式(6)~式(8)所示。

Precision=TPTP+FP×100%

(5)

Recall=TPTP+FN×100%

(6)

F1score=2×Precision×RecallPrecision+Recall×100%

(7)

式中:

TP——

模型正確预测的马铃薯病害叶片总数;

FP——

模型将健康样本错误的预测为病害叶片的总数;

FN——

模型没有检测出的马铃薯病害叶片总数。

(a) 精准率曲线

(b) 损失曲线

3.2 试验结果与分析

本文模型的训练和测试在自建的马铃薯病害叶片数据集和开源的AI Challenger 2018数据集上进行[23]。开源马铃薯病害叶片数据集中主要包括健康马铃薯叶片、黑痣病、黄叶病、炭疽病、青枯病、灰霉病。选择3000张图片,并按照7∶3的比例划分为训练集和测试集。

1) 开源数据集上测试结果。为验证所设计模型的有效性,在相同的数据集和评价指标下与当前经典的马铃薯病害叶片检测模型进行对比试验,详细结果如表2所示。可以看出,所提出的三个模型检测性能均优于当前经典的马铃薯病害叶片识别方法。以Vgg16、ResNet50和ResNet101作为主干网络时,所提出模型的性能呈现递增趋势,主要原因是ResNet网络比Vgg网络具有更多的卷积层和池化层,更能捕获深度空间中病害区域的关键信息。相比所有对比模型中性能最好的FLDNet模型,以ResNet101为主干网络的检测模型在精准率方面提高了2.54%,在召回率方面提高了3.07%。特别是,在F1score方面,相比Transformer网络提高了2.78%。

上述结果也验证了所设计模型在开源数据集上的有效性,究其原因是:所提出模型利用区域生成网络细粒度提取了多个包含目标信息的候选区域,更有助于模型捕获到更有效的病害信息,极大程度降低了无关噪声的干扰;所提出模型结合了文本语义和视觉语义的多模态信息,更有助于提高模型的泛化性能,因为在文本标签库中标签特征映射模型无需再次微调,新添加标签可以实时更新;采用的小样本元学习范式在多个子任务中学习泛化性能,并将其学习规则推广到未知新病害类的识别任务中,进一步提高了模型对未知新类的定位与识别能力。

此外,为了进一步展示所提出模型的有效性,选择部分测试样本进行可视化,并与多种经典模型进行对比,不同模型的可视化结果如图8所示。可以看出,所提出模型可以捕获到更多的细节信息。

2) 自建数据集上的测试结果。为验证所提出模型在实际场景中的识别性能,在自建的马铃薯病害叶片小样本数据集上进行测试,并与上述提到的经典模型进行对比试验,详细结果如表3所示。

从表3可以看出,相比开源数据集上的测试结果,在自建数据集上的测试结果整体性能呈现下降趋势,因为自建数据集样本量较少,另外人工标注还不够完善,在一定程度上增加了误差。具体地,与所有经典的目标检测模型相比,所提出模型仍然具有很大的优势,在精准率方面,相比Faster RCNN和FLDNet,以ResNet101为主干网络的检测模型提高了2.72%和2.84%;在召回率方面,相比FLDNet和Transformer网络,提高了2.74%和2.87%;在F1score方面,相比Transformer网络和Faster RCNN模型,提高了1.90%和1.92%。上述结果进一步验证了所设计模型在更复杂的环境下同样具有可竞争性。

为进一步验证所提出模型对每一种病害叶片的识别精度,设计了如图9所示的混淆矩阵。可以看出,所设计的模型在叶斑病、褐斑病和锈病三种病害类型上实现了92.07%、93.59%和93.28%的识别精度。上述结果进一步验证了所提出模型在实际场景中的有效性,这为实现智能农业提供了理论和技术指导。

3) 交叉域上的测试结果。虽然开源数据集和自建数据集存在相同的病害类别,但由于病害区域的大小、外观形态、遮挡和光照等因素的影响,导致相同类别之间存在类内变化,这种跨域测试可以看做是一种更加严格的泛化性测试。此处,为验证所提出模型的泛化性能,设计了两组交叉域验证试验,一组是模型在开源数据集上进行训练,在自建数据集上进行测试;另一组是在自建数据集上进行训练,在开源数据集上进行测试。详细的试验结果如表4所示。

从表4中可以看出,所设计模型在以开源数据集为训练集,自建数据集为测试集的任务中,三个主干网络上的检测结果均高于单一自建数据集上的测试结果。这些结果表明,只要训练数据样本充足,所提出模型的识别性能有望进一步提高,这也为后期的工作提供了一种新的思路。其次,在以自建数据集为训练集,开源数据集为测试集的任务中,三个主干网络上的识别结果均低于先前单一的开源数据集测试结果,主要原因是自建数据集的样本数量远少于开源数据集,这些结果也进一步验证了上述的猜想。

3.3 消融试验

为分析所提出模型中候选区域生成和无参数度量在模型识别性能中扮演的角色,设计了以下两组消融试验。此处,以支持图片的全局特征为视觉语义,以有参数学习的解碼器为度量工具,并利用上述设定为基线模型,详细的试验结果如表5所示。

在表5中,对比试验1和试验2可以发现,本文利用候选区域生成网络生成多个特征图对识别性能是有效的。具体地,相比基线模型,在开源数据集上利用候选区域生成网络生成多个特征图可以提高13.74%的精准率,在自建数据集上可以提高12.08%的精准率。对比试验1和试验3可以发现,无参数的度量方法可以有效降低目标识别的时间开销,主要原因是本文使用的度量方法采用余弦相似度,没有任何可学习的参数参考,通过减少模型参数降低了系统的识别时间开销,这有助于促进所提出模型在实际场景中的应用。

此外,从试验2和试验4中可以发现,有参数学习的编码方式有助于提高模型的识别性能,但提升效果不明显,然而有参数学习的编码方式涉及的网络参数较多,导致模型测试时间开销较大。综合识别性能和时间开销,在利用候选区域生成多个特征图的基础上,利用无参数的度量方式整体效果最佳,这也验证了本文模型设计的合理性和有效性。

4 结论

本文提出了一种基于分层特征对齐网络的小样本马铃薯病害叶片检测方法,主要包括视觉特征提取、文本特征提取和视觉与文本语义对齐三部分。本文主要借助支持分支和查询分支的双分支网络建立支持图片和查询图片之间的视觉与文本语义关联,旨在提高模型对未知新类的泛化性能。通过在自建的马铃薯病害叶片数据集和开源的数据集上进行测试,验证了所提出模型的有效性。

1) 在自建的马铃薯病害叶片数据集上,所提出模型可以实现93.55%的识别精度,在开源数据集上可以实现96.35%的识别精度。此外,还设计了两组跨域测试,分别可以实现95.15%和94.06%的识别精度。

2) 利用区域生成网络将马铃薯叶片划分为多个候选区域,并利用卷积神经网络将每个区域映射到深度特征空间,这有助于捕获到更加细粒度的病害区域,缓解无关背景噪声对于模型识别性能的干扰。

3) 在文本和视觉语义特征关联集相似度计算过程中,采用无参数度量方法可以显著降低时间开销,所提出方法的时间开销仅为12 ms。

未来工作中,将尝试利用深度可分离卷积对Vgg16、ResNet50和ResNet101主干网络进行改进,通过减少网络参数来降低模型对GPU等硬件资源的依赖,进一步降低模型时间开销,为模型应用在实际场景的病害检测任务中提供可能。

参 考 文 献

[1]赵建敏, 芦建文. 基于字典学习的马铃薯叶片病害图像识别算法[J]. 河南农业科学, 2018, 47(4): 154-160.

Zhao Jianmin, Lu Jianwen. Identification algorithm of potato diseases on leaves using dictionary learning theory [J]. Journal of Henan Agricultural Sciences, 2018, 47(4): 154-160.

[2]Pal A, Kumar V. AgriDet: Plant leaf disease severity classification using agriculture detection framework [J]. Engineering Applications of Artificial Intelligence, 2023, 119: 105754.

[3]赵建敏, 李艳, 李琦, 等. 基于卷积神经网络的马铃薯叶片病害识别系统[J]. 江苏农业科学, 2018, 46(24): 251-255.

Zhao Jianmin, Li Yan, Li Qi, et al. Potato leaf disease identification system based on convolutional neural network [J]. Jiangsu Agricultural Sciences, 2018, 46(24): 251-255.

[4]Chakraborty K K, Mukherjee R, Chakroborty C, et al. Automated recognition of optical image based potato leaf blight diseases using deep learning [J]. Physiological and Molecular Plant Pathology, 2022, 117: 101781.

[5]赵越, 赵辉, 姜永成, 等. 基于深度学习的马铃薯叶片病害检测方法[J]. 中国农机化学报, 2022, 43(10): 183-189.

Zhao Yue, Zhao Hui, Jiang Yongcheng, et al. Detection method of potato leaf diseases based on deep learning [J]. Journal of Chinese Agricultural Mechanization, 2022, 43(10): 183-189.

[6]王林柏, 张博, 姚竟发, 等. 基于卷积神经网络马铃薯叶片病害识别和病斑检测[J]. 中国农机化学报, 2021, 42(11): 122-129.

Wang Linbai, Zhang Bo, Yao Jingfa, et al. Potato leaf disease recognition and potato leaf disease spot detection based on Convolutional Neural Network [J]. Journal of Chinese Agricultural Mechanization, 2021, 42(11): 122-129.

[7]肖志云, 刘洪. 马铃薯典型病害图像自适应特征融合与快速识别[J]. 农业机械学报, 2017, 48(12): 26-32.

Xiao Zhiyun, Liu Hong. Adaptive features fusion and fast recognition of potato typical disease images [J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(12): 26-32.

[8]章广传, 李彤, 何云, 等. 基于迁移模型集成的马铃薯叶片病害识别方法[J]. 江苏农业科学, 2023, 51(15): 216-224.

Zhang Guangchuan, Li Tong, He Yun, et al. A method for identifying potato leaf diseases based on migration model integration [J]. Jiangsu Agricultural Science, 2023, 51(15): 216-224.

[9]邢鹏康, 李久朋. 基于小样本学习的马铃薯叶片病害检测[J]. 江苏农业科学, 2023, 51(15): 203-210.

Xing Pengkang, Li Jiupeng. Potato leaf disease detection based on small sample learning [J]. Jiangsu Agricultural Science, 2023, 51(15): 203-210.

[10]Zhou Ji, Li Jiuxi, Wang Chunshan, et al. A vegetable disease recognition model for complex background based on region proposal and progressive learning [J]. Computers and Electronics in Agriculture, 2021, 184: 106101.

[11]劉阗宇, 冯全. 基于卷积神经网络的葡萄叶片检测[J]. 西北大学学报(自然科学版), 2017, 47(4): 505-512.

Liu Tianyu, Feng Quan. Detecting grape leaves based on convolutional neural network [J]. Journal of Northwest University (Natural Science Edition), 2017, 47(4): 505-512.

[12]Bifta S, Mdnahidul I, Mamunur R, et al. A realtime approach of diagnosing rice leaf disease using deep learningbased faster RCNN framework [J]. PeerJ Computer Science, 2021, 7: e432.

[13]Prabhjot K, Shilpi H, Vinay G, et al. An approach for characterization of infected area in tomato leaf disease based on deep learning and object detection technique [J]. Engineering Applications of Artificial Intelligence, 2022, 115: 105210.

[14]范振军, 李小霞. 基于ROI快速检测与融合特征的马铃薯病害识别[J]. 西南农业学报, 2019, 32(3): 544-550.

Fan Zhenjun, Li Xiaoxia. Recognition of potato diseases based on fast detection and fusion features of ROI [J]. Southwest China Journal of Agricultural Sciences, 2019, 32(3): 544-550.

[15]Kavitha R, Savarimuthu N, Savarimuthu N. DPDDS for plant disease detection based on instance segmentation[J]. Journal of Ambient Intelligence and Humanized Computing, 2021: 1-11.

[16]Mao B, Wang L, Xiang S, et al. Taskaware adaptive attention learning for fewshot semantic segmentation [J].Neurocomputing, 2022, 494: 104-115.

[17]卢珊妹, 郭强, 王任, 等. 基于多特征注意力循环网络的显著性检测[J]. 计算机辅助设计与图形学学报, 2020, 32(12): 1926-1937.

Lu Shanmei, Guo Qiang, Wang Ren, et al. Salient object detection using multiscale features with attention recurrent mechanism [J]. Journal of ComputerAided Design & Computer Graphics, 2020, 32(12): 1926-1937.

[18]杨国峰, 杨勇. 基于BERT的常见作物病害问答系统问句分类[J]. 计算机应用, 2020, 40(6): 1580-1586.

Yang Guofeng, Yang Yong. Question classification of common crop disease question answering system based on BERT [J]. Journal of Computer Applications, 2020, 40(6): 1580-1586.

[19]徐艳蕾, 孔朔琳, 陈清源, 等. 基于Transformer的强泛化苹果叶片病害识别模型[J]. 农业工程学报, 2022, 38(16): 198-206.

Xu Yanlei, Kong Shuolin, Chen Qingyuan, et al. Model for identifying strong generalization apple leaf disease using Transformer [J]. Transactions of the Chinese Society of Agricultural Engineering, 2022, 38(16):198-206.

[20]Zhong Y, Yang J, Zhang P, et al. RegionCLIP: Regionbased languageimage pretraining [C]. Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2022: 16793-16803.

[21]Yang K, Deng J, An X, et al. ALIP: Adaptive languageimage pretraining with synthetic caption [C]. Proceedings of the IEEE/CVF International Conference on Computer Vision, 2023: 2922-2931.

[22]Chen Yipeng, Xu Ke, Zhou Peng, et al. Improved cross entropy loss for noisy labels in vision leaf disease classification [J]. IET Image Processing, 2022, 16(6): 1511-1519.

[23]杜海順, 张春海, 安文昊, 等. 基于多层信息融合和显著性特征增强的农作物病害识别[J]. 农业机械学报, 2023, 54(7): 214-222.

Du Haishun, Zhang Chunhai, An Wenhao, et al. Crop disease recognition based on multilayer information fusion and saliency feature enhancement [J]. Transactions of the Chinese Society for Agricultural Machinery, 2023, 54(7): 214-222.