代价敏感的空中目标意图识别方法

丁鹏,宋亚飞

空军工程大学 防空反导学院,西安 710051

决策中心战、联合全域作战等新型作战概念都对指挥控制系统提出了新的能力需求,迫切需要加速信息优势向决策优势的转变,谁能够更快地处理战场信息、理解态势、实施决策并执行打击,谁就能赢得主动。意图识别是从信息域向认知域过渡的关键,是指挥决策的基本依据,也是战场认知和智能决策的前提和基础,一直被认为是战场态势感知的核心内容。对于防空反导这一空天领域的激烈对抗而言,对空中目标作战意图的准确识别,显得尤为重要[1-2]。

意图识别本质上属于模式识别的范畴,已经广泛应用于诸多领域,在军事领域的研究中也取得了一些成果。传统的意图识别方法主要包括模板匹配[3]、专家系统[4]、贝叶斯网络[5-6]等。文献[3]首先根据专家经验构建态势模板,使用D-S 证据理论构建推理模型进行意图识别,但是这种方式将战场态势割裂来看,没有考虑意图的欺骗性和灵活性;文献[4]通过专家经验构建知识库,使用推理机得到推理结果,通过对专家系统进行分析,其主要依靠知识库与完善的推理规则进行抽象处理,而战场环境复杂多变,仅凭借推理规则的力量很难实现全面覆盖;文献[5-6]基于贝叶斯定理,通过概率论与图论的结合构建贝叶斯网络,实现了意图识别。随着深度学习的理论发展和广泛应用,文献[7]主要针对误差反向传播算法(Back Propagation,BP)在目标意图识别过程中存在的收敛速度慢、容易陷入局部最优的问题进行改进,引入了Relu 激活函数和Adam 优化算法明显提高了收敛速度;文献[8]通过建立全连接残差网络进行空战目标威胁评估,在较快的收敛速度下取得了较好的效果;文献[9]通过仿真推演平台推演目标数据,使用长短期记忆网络(Long Short-Term Memory,LSTM)构建深度学习模型,取得了比传统分类器更好的效果;文献[10]利用随机森林方法在抗噪声性能、数据集适应力、训练速度和实现方式等方面的优势,实现了意图识别,准确率有一定提升。然而,文献[7-10]虽然克服了传统意图识别方法存在的弊端,有效突破了传统方法面临的一些瓶颈,提高了空中目标意图识别的准确率,但是没有考虑作战的时序特点,把作战的各个阶段孤立地分开考虑,不符合防空作战的实际情况。文献[11-14]针对文献[7-10]所提的模型存在的问题,基于卷积神经网络(Convolutional Neural Networks,CNN)[15-16]和循环神经网络(Recurrent Neural Network,RNN)[16-17]将战场态势的时序数据用于意图识别建模,取得了更高的准确率。

然而,随着空防博弈对抗的加剧,意图识别方法的准确率始终不可能达到100%,也就是说,每种方法在识别过程中都存在或多或少的误判问题,而对于敌意图的误判则有可能造成重大损失甚至导致整场战斗的失败。在空防对抗中,敌空中作战力量的不同作战意图往往会对我方的领空安全造成不同的威胁,例如,敌方的攻击意图对我领空造成的威胁程度明显高于其撤退意图。因此,如果将敌方的“撤退”意图误判为攻击意图和将其攻击意图误判为撤退意图造成的风险必然是不等价的,前者可能仅仅会导致我方组织一次无用的防空行动,而后者则可能带来毁灭性打击,可见后者产生的代价将会远远高于前者,因此,在目标意图识别中需要考虑误判代价的影响。

加入空战意图误判代价后的意图识别问题可归类为代价敏感分类问题,但是又不同于一般的代价敏感分类,主要体现在2 个方面:一是一般的代价敏感分类问题主要优化目标是使所有样本误分类产生的代价总和最小,例如股民购买多类股票的投资问题,人们最在乎的往往是整体投资的收益,而空战意图的误分类问题则同时要通过强调高威胁意图的准确率来减少关键错误,即在保证意图识别准确率的情况下,优先降低高威胁意图误判为低威胁意图的概率,使意图识别的误判倾向于低威胁意图识别为高威胁意图,生成更加保守的决策,保证我方安全;二是一般的代价敏感分类问题需要构建代价矩阵,对于多分类目标来讲,代价矩阵的构建容易导致模型具有很大的不确定性,特别是对于防空作战领域意图误判的代价矩阵,没有统一的衡量标准,因此如果将一般的代价敏感分类模型用于空中目标的意图识别问题,可能会导致模型的可靠性偏低。

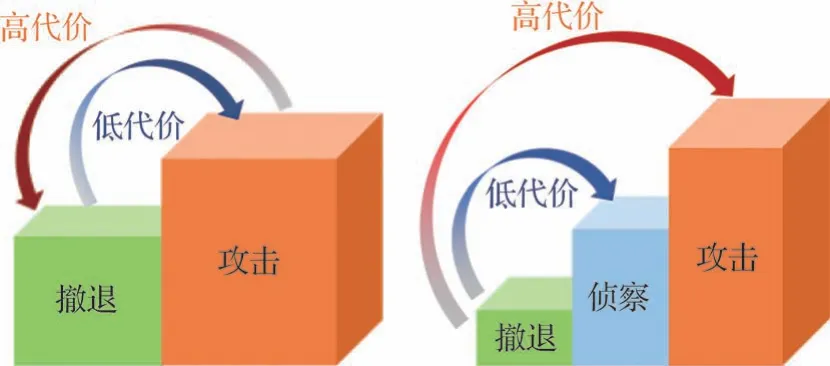

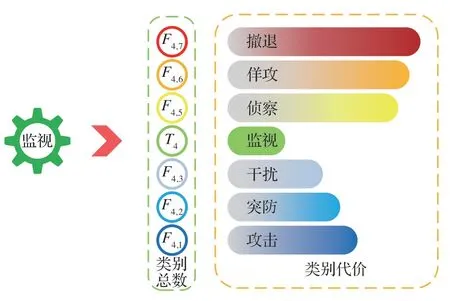

针对上述问题,本文设计了GRU-FCN 深度学习模型实现空中目标意图识别,并且针对该模型提出了一种空中目标意图识别的代价敏感(Cost-sensitive Air target combat Intention Recognition,CAIR)改进策略,主要从2 个方面减少高代价误判的情况:一是减少高威胁意图到低威胁意图的误判;二是减少在威胁上存在较大差距的意图之间的误判,如图1 所示。

图1 意图识别的误判代价Fig.1 Misjudgment cost of intention recognition

在模型中,门控循环单元(Gated Recurrent Unit,GRU)[18-19]有着比LSTM[20-22]网络更小的块结构,并显示出与其相当的性能,而且不需要额外的算法来支持该模型,具有更少的训练参数、更少的内存需求、更少的训练时间、更简单的硬件实现,具备较强的提取长距离依赖信息的能力。CNN 由1986 年引入,广泛应用与图像和时间序列中,CNN 内的层可以从很少甚至没有预处理的情况下从数据中提取出复杂的特征表示。全卷积网络(Fully Convolutional Networks,FCN)[23-26]将CNN 模型后面的全连接层替换为卷积层,可以较好地提取意图样本的空间特征,同时避免了CNN重复存储和计算卷积的问题,使模型更加高效。通过将GRU 和FCN 模型相结合,可以充分考虑空中目标意图样本的时间特征和空间特征,进一步提升意图识别的效果。CAIR 则通过提出一种代价敏感的损失函数和代价敏感的评价指标,使GRU-FCN 模型具备代价敏感空中目标意图识别的能力,然后通过实验验证了CAIR 改进在代价敏感意图识别中的效果,并通过与其他模型的对比实验证明了其对其他基于深度学习的空中目标意图识别模型同样具有普适性。

1 代价敏感空中目标意图识别问题描述

1.1 作战意图类型选取

在不同的作战环境下,敌方的空中作战力量可能存在的意图类型会有不同,确定意图类型空间需要根据战场环境、我方防空力量类型、敌方空中目标种类和任务背景等因素共同考虑。例如,文献[27]根据海上防空的特点,将敌方空中目标的可选意图空间确定为{撤退,掩护,攻击,侦察};文献[11]以敌方空中目标近岸空袭军事建筑为研究背景,建立的敌方空中目标的意图空间为{攻击,突防,侦察,佯攻,电子干扰,监视,撤退},本文所针对的防空作战场景与文献[11]类似,因此,建立包含7 种意图类型的作战空间,包括{攻击,突防,干扰,监视,侦察,佯攻,撤退}。

在确定了作战意图空间后,参考仿真推演的结果数据,结合专家经验,将各意图类型对我方的威胁程度由大到小进行排序,并且分别设置{1,2,3,4,5,6,7}对各意图类型进行映射处理,将意图类型对应为模型能够识别并训练的编码,编码越小,威胁程度越高,意图威胁程度的排序及其相应编码如图2 所示。根据威胁程度排序,以攻击和侦察意图为例,将攻击意图编码为1,侦察意图编码为5,如果模型的最终输出结果为1,则可认为模型将敌方空中目标的作战意图识别为攻击。

图2 作战意图排序与编码Fig.2 Sequencing and coding of operational intention

1.2 作战意图特征选取

敌机意图特征的选取同样需要考虑多方面因素,意图识别的目的就是根据雷达等传感器获取的敌空中作战力量的时序数据判断敌机的作战意图。在执行空中任务时,敌机同一种意图类型往往表现出相同或相似的特征,例如,敌歼击机在空战攻击时通常采用较高的飞行速度,最高可达1 400 km/h,执行高空突防任务的敌机飞行高度往往会在10~11 km[8]。同样,执行侦察任务时,通常会保持所有机载雷达处在开启状态,轰炸机在执行轰炸任务时敌我距离随着时间的推移逐渐接近,在撤退时敌我距离逐渐增大。

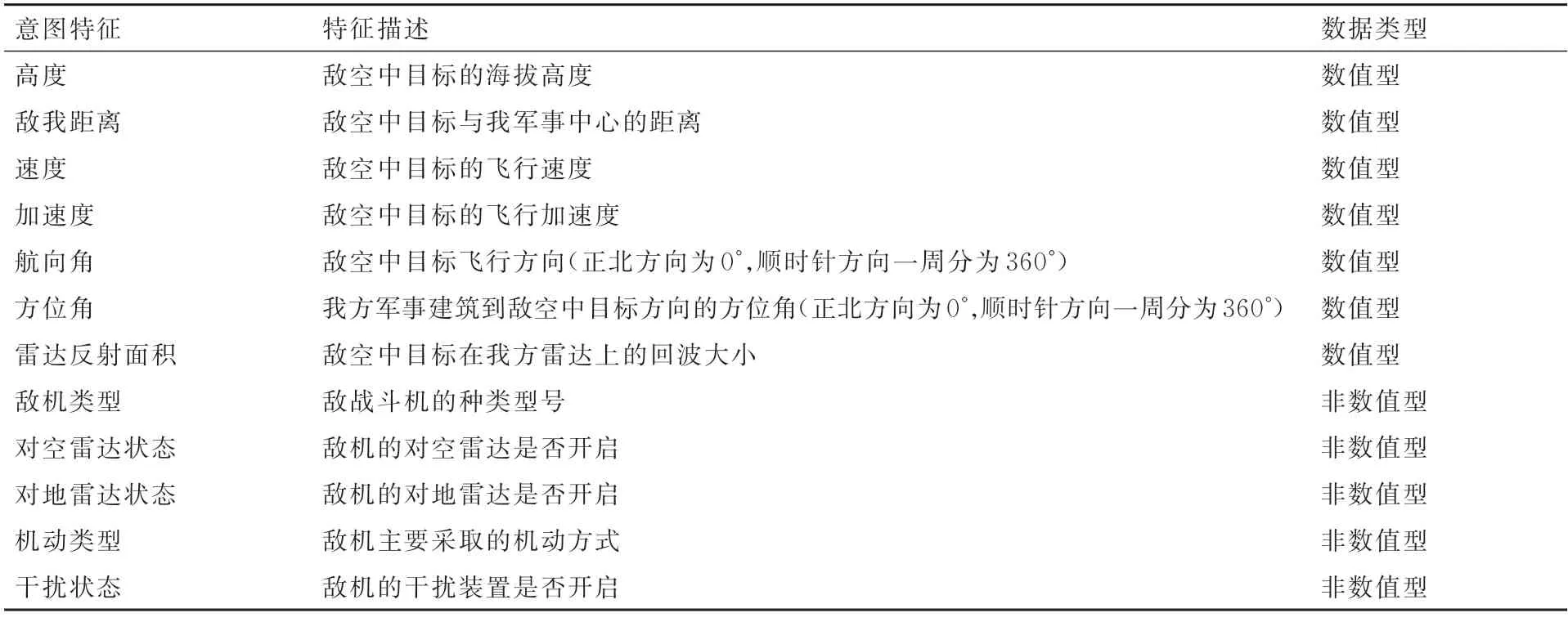

综上所述,本文选取12 种与敌机作战意图紧密相关的特征信息构成空中目标意图特征空间,经过预处理后输入代价敏感的GRU-FCN 模型进行意图识别。意图特征空间主要包括数值型和非数值型2 种数据,数值型数据包括{高度,敌我距离,速度,加速度,航向角,方位角,雷达反射面积},非数值型数据包括{敌机类型,对空雷达状态,对地雷达状态,机动类型,干扰状态},如表1所示。

表1 空中目标意图特征空间Table 1 Feature space of air target intention

对于数值型数据,使用1 个浮点型数据反映其大小,并对其按照式(1)进行Min-Max 标准化。对于任意数值型数据x,标准化后的数据x′为

式中:X为数据x所属的特征种类的数据集合;max{X}为数据集合X中的最大值;min{X}为数据集合X中的最小值。

对于非数值型数据,敌机类型数据按照敌机的种类型号进行编码;对空雷达状态、对地雷达状态和干扰状态编码为1 或0,1 表示开启,0 表示关闭;机动类型主要以美国国家航空咨询委员会(NASA)学者根据空战中最常用的机动方式提出的“基本操纵动作库”[28]进行编码,包括{最大加速,最大减速,最大过载爬升,最大过载俯冲,最大过载右转,最大过载左转,稳定分型}7种机动动作。

2 意图识别模型描述

本节详细介绍本文提出的GRU-FCN 网络和CAIR 改进方法,GRU 可以捕捉一系列的长期时序依赖,完成对敌方空中目标的时序特征学习。FCN 模型善于提取时间序列数据细节变化规律,有效提高意图识别的准确率。为了充分利用它们的优点,将其组合成一个新的混合模型,以进一步提高意图识别精度,实验证明该模型在当前空中目标意图识别领域准确率、损失值等评价指标上超越了其他模型,取得了最好的效果。CAIR 主要通过2 个方面的改进,使模型具备防空作战代价敏感意图识别的能力。在2.1~2.3 节中分别对GRU、FCN 和CAIR 进行了介绍,在2.4 节中给出了所提模型整体框架的结构细节。

2.1 门控循环单元

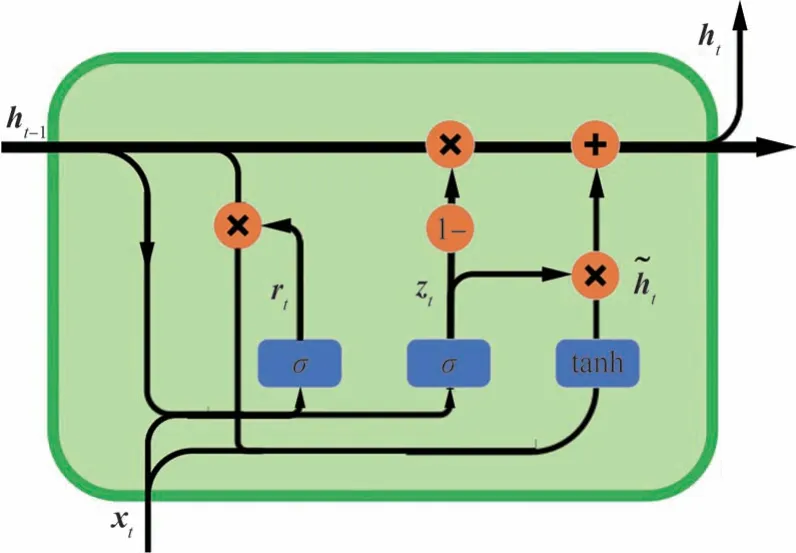

GRU 作为RNN 的变体,具有和RNN 相类似的递归结构,在处理时间序列数据是具有很好的“记忆”功能。GRU 由2 个门(重置门和更新门)组成,能够有效缓解深度RNN 训练过程中可能出现的梯度消失和梯度爆炸的问题,同时结构较为简单,训练效率高,可以满足防空作战对于时间紧迫性的要求。

GRU 的内部结构如图3 所示。GRU 分别使用上一时刻的输出状态ht-1和当前时刻的输入序列值xt作为输入,输出为当前时刻的状态ht。其主要通过重置门rt和更新门zt来更新模型状态,重置门rt控制遗忘历史状态信息的程度,使网络能够丢掉不重要的信息,重置门的值越大说明遗忘的信息越少,反之越多。更新门zt控制前一时刻的状态信息被代入当前状态之后在当前状态中的比重,使网络能够记忆较长时间的信息[29],更新门的值越小说明传递的信息越少,反之则越多。其内部计算公式为

图3 GRU 内部结构Fig.3 Internal structure of GRU

式中:σ为sigmoid 激活函数,其作用是将中间状态转换到[0,1]范围内,如果其值接近于0,则表示没有新的信息被记忆;ht-1、ht分别是t—1 时刻和t时刻的输出状态;xt为t时刻的输入序列值;为候选输出状态;为各部分相对应的权值系数矩阵;tanh 为双曲正切函数,作为激活函数使用,因为它的二阶导数在趋于0 之前可以保持很长的范围,所以使用tanh 函数可以有效地解决循环神经网络中普遍面临的梯度消失问题;⊙为矩阵的哈达马积。

2.2 全卷积网络

CNN 在处理类似网格结构的数据时表现优异,现已广泛应用于时间序列分类[30-32]领域。CNN 一般由卷积层、池化层和全连接层组成。其中卷积层的作用是提取数据的复杂局部特征,主要通过稀疏交互、参数共享和等变表示等来提高学习效率,卷积后通过不同的激活函数实现非线性变换;池化层在保证输入的表示近似不变的情况下,根据不同的池化函数对输入值进行少量平移调整或特征降维,并在一定程度上防止过拟合;卷积层和池化层产生的特征图在经过全连接层后将会映射为一个固定长度的特征向量。与CNN 在卷积层之后使用若干全连接层得到固定长度特征向量不同,FCN 使用不同参数的卷积层替换所有的全连接层。近年来,越来越多的学者将FCN 用于时序数据处理问题,而且在处理时序数据时可以以任意序列长度作为输入,因此FCN在处理时序数据方面比CNN 更加灵活,经过FCN 后能够保留更多的序列数据特征。空中目标意图的特征空间属于一种高维度的时间序列数据,可以使用FCN 提取时序特征。

FCN 模块由3 个时序卷积(Temporal Convolutional)模块组成,每个时序卷积模块均包括1 个一维卷积层、1 个Batch Normalization 层(后接1 个ReLU 激活函数)和1 个Dropout 层(丢弃率为0.3)组成。根据空中目标意图特征数量,设置第1 个卷积层的输入通道数为12,输出通道数为128,卷积核大小为8;第2 个卷积层的输入通道数为128,输出通道数为256,卷积核大小为5;第3 个卷积层的输入通道数为256,输出通道数为128,卷积核大小为3。由此,切片后的航迹数据特征从12 维映射到了128 维,扩展了特征数量。

2.3 空中目标意图识别的代价敏感改进方法

GRU-FCN 模型的输出不具备代价敏感的特性,本节将重点介绍针对空中目标意图识别的代价敏感改进方法,通过加入本文提出的CAIR改进使模型具有代价敏感意图识别的能力。

在训练阶段,GRU-FCN 模型采用交叉熵损失(Cross Entropy,CE)[33]函数计算损失值,网络在整个训练集上的损失函数为

式中:N表示训练集中训练样本的总数;M为训练集中意图标签种类总数;p(xn,m)为训练集中第n个样本对应于真实标签类别m的概率;q(xn,m)为网络模型输出值的第n个样本对应于第m个类别的概率。

如果对式(3)表示的CE 函数按照标签的类别进行变换,得到

式中:Hm(p,q)表示数据集中样本真实分类为m的所有样本的总交叉熵损失,通过式(4)可以看出,模型对于不同的样本分类具有相同的权重,因此CE 函数不能处理代价敏感问题。

针对引言中提到的代价敏感的空中目标意图识别问题区别于一般代价敏感问题的2 个特点,本文提出了针对代价敏感的空中目标意图识别的CAIR 改进方法,CAIR 主要由改进损失函数和改进评价指标2 个部分组成。

1)损失函数

由式(4),p为随机变量的真实分布,q为模型的实时输出,为近似分布,深度学习中交叉熵损失函数的作用是通过训练使模型的近似分布q逼近真实分布p,q与p越接近,损失值越小,反之则越大。根据式(3),每个样本的交叉熵为

在对数据集中每个样本的交叉熵计算中,如果将对数函数在x∈(0,1)区间的函数中转换为正值并且进行左右对称变换后统计分类错误的函数值之和,将式(5)替换为

理论上同样可以达到使模型的近似分布逼近真实分布的效果。

然而在实际训练的过程中对数函数的求和会出现梯度损失或者梯度爆炸的问题,因此考虑将对数函数替换为函数值控制在(0,+∞)的指数函数。

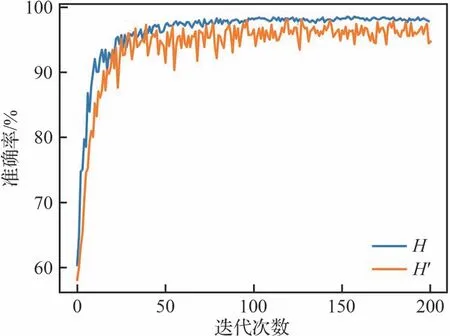

通过实验对比式(5)和式(7)在GRU-FCN模型训练中的效果,结果如图4 所示。图4 中,H代表使用式(5)中H(p,q|xn)损失函数,准确率为98.57%,H′代表使用式(7)中H′(p,q|xn)损失函数,准确率为97.95%。表明式(7)中的H′(p,q|xn)函数成功在训练过程中取得了与H(p,q|xn)类似的效果。

图4 损失函数效果对比Fig.4 Comparison of loss function effects

按照意图的威胁程度对敌空中目标的7 种作战意图排序为:攻击>突防>干扰>监视>侦察>佯攻>撤退,意图误判的差距越大,损失也就越大。同时,高威胁意图误判为低威胁意图造成的损失也应当大于低威胁意图误判为高威胁意图造成的损失。以此思路改进H′(p,q|xn)函数得到C-CE 损失函数L(p,q),当数据集中第n条数据的真实标签值为yn时

式中:K1表示低风险意图误判为高风险意图的代价因子;K2表示高风险意图误判为低风险意图的代价因子,且K1<K2。

2)评价指标

GRU-FCN 模型一般采用准确率(Accuracy,ACC)作为评价指标,对于给定的测试数据集,分类模型中的准确率对应于所有预测正确的样本数与数据集中总样本数的比值

式中:Ti表示数据集中真实标签类别为i的样本中被正确分类的总数;Fi,j表示数据集中真实标签类别为i的样本中被错误分类到类别j的总数,如图5 所示。图5 中以监视意图为例展示了F、T和模型意图之间的对应关系,预测为监视意图时代价为0,预测为其他意图时长度越长,代价越高。通过式(9)也可以得到,ACC 评价指标对于不同的样本分类同样具有相同的权重,因此对于代价敏感的意图识别问题同样不能使用ACC 作为评价指标。

图5 监视意图的可能意图识别结果Fig.5 Possible identification results of monitoring intention

评价指标,决定我们对于模型想要得到的结果的期望,同样需要体现代价敏感特性,因此在ACC 指标中加入惩罚机制,对于分类差距过大的样本在评价指标中给予较高的惩罚,对于高威胁样本误判与低威胁样本的情况同样给予较高的惩罚,对式(9)进行改进,加入惩罚因子,得到CACC 评价指标

式中:J1表示低风险意图误判为高风险意图的惩罚因子;J2表示高风险意图误判为低风险意图的惩罚因子,且J1<J2。

通过调整CAIR 中的参数,可以调节空中目标意图识别的代价敏感程度,本文通过调试和对比筛选实验中整体代价最小的参数取值作为模型中CAIR 的参数取值,定义高威胁意图误判为低威胁意图的情况为关键误判,筛选关键误判为0 的情况时的模型称为CAIR-key 模型,此时的参数取值作为CAIR-key 模型中的CAIR 参数取值。

2.4 模型整体框架

模型结构的主体包括1 个GRU 模块和1 个FCN 模块。GRU 模块负责学习时间序列数据的长期趋势,FCN 模块负责对切片后的时序数据进行特征提取,由于采用了全卷积网络,模型能更好地捕捉到空战意图时序数据的局部信息。GRU 模块与FCN 模块组合后,既能学习空战意图时序数据的长期变化趋势,又能提取出数据内部的细节变化规律。图6 展示了模型的整体框架。图6 中,第i维度的意图特征使用Xi表示将包含不同空战意图特征的时间序列数据由GRU 层进行处理。同时,将相同的时间序列数据通过由滤波器大小为128、256 和128 的一维卷积层实现的全卷积网络。这可以分3 个步骤进行,每个步骤的全卷积网络都涉及到ReLU 激活和批处理规范化。应用全局平均池化,将转换后的时间序列数据输出包含目标类可靠性的特征图,减少了网络的参数数量,消除了过拟合的风险。池化层和GRU 层的输出结果通过连接层进行连接得到输出值h。最后,应用softmax 来进行多类分类。此时的softmax 层数等于输出层数即空战意图标签类别总数。

图6 整体模型框架Fig.6 Overall model framework

式中:标量y′为模型预测的意图结果;w为需要学习的权重矩阵;b为偏置向量。

模型训练的过程中,采用C-CE 损失函数计算损失值,使用C-ACC 评价指标根据样本意图标签对模型进行评价,使GRU-FCN 模型保留代价敏感意图识别的结果,具备代价敏感意图识别的能力。在测试阶段,将测试集的数据输入CAIR 改进的GRU-FCN 模型,获得敌空中目标的意图识别结果。

3 实验分析

3.1 实验数据与环境

实验数据来源于Air Combat Maneuvering Generator(ACMG),由空战领域专家对其标签进行修订。共10 500 个样本,包括8 400 个训练样本和2 100 个测试样本,每类意图占比为14.3%。时间步长为12 个采样周期,特征维度为12。

实验使用Python3.9 语言,在Quadro RTX 5000/PCle/SSE2 GPU 和CUDA11.5 加速环境下进行,采用Pytorch 深度学习框架,电脑配置为x86-64 CentOS7 PC 系统、Intel® Xeon(R)Sliver 4110 CPU @2.10 GHz、64 GB 内存。实验设置的训练轮次为200,批量大小为32。

3.2 性能评估指标

为验证本文提出的GRU-FCN-CAIR 代价敏感空中目标作战意图识别模型的性能,采用了4 种指标来评估网络的分类情况,即准确率(Accuracy)、误判代价(Cost)、高威胁误判量(Herror)、低威胁误判量(L-error)。它们的计算公式为

式中:WA、WC、WH、WL分别为准确率、误判代价、高威胁误判量、低威胁误判量的取值。

评价指标C-ACC 的取值WCA和WA、WC指标之间的关系为

实验中为了更直观形象地表现模型的效果,使用Accuracy和Cost代替C-ACC 作为评价指标。

3.3 实验参数设置

模型中的超参数影响着实验结果和运行速度,因此,本文通过实验测试选取能使模型达到满意性能的超参数,不同超参数下的准确率对比如表2~表4 所示。

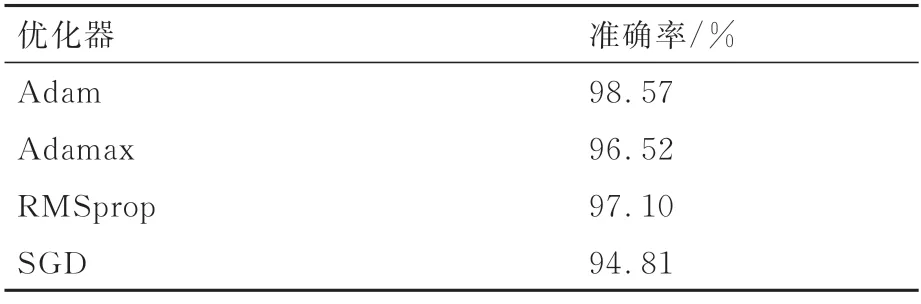

表2 不同优化器下准确率对比Table 2 Comparison of accuracy under different optimizers

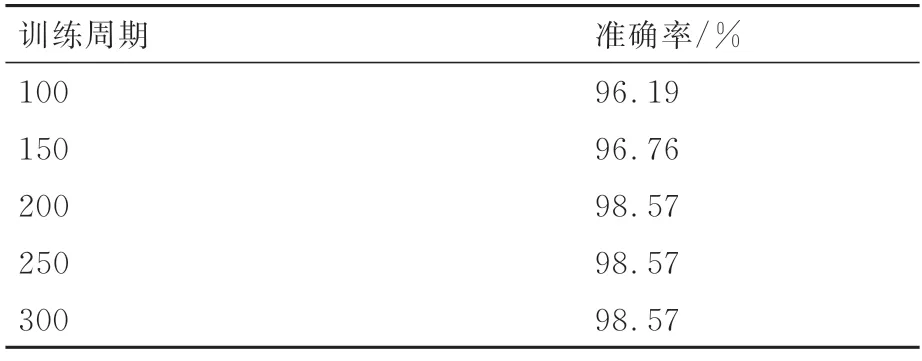

表3 不同训练周期下准确率对比Table 3 Comparison of accuracy under different training cycles

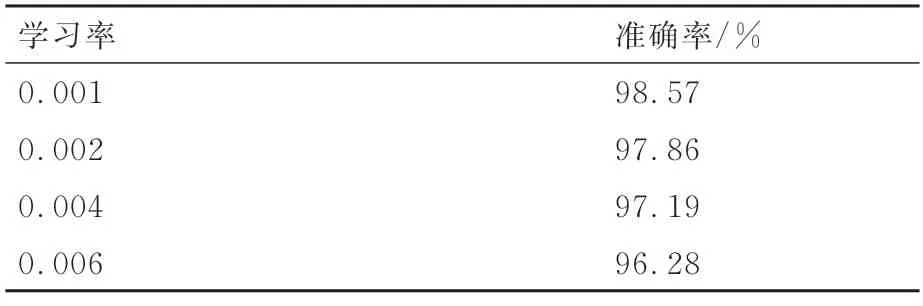

表4 不同学习率下准确率对比Table 4 Comparison of accuracy under different learning rates

关于优化器,本文比较了4 种优化算法,Stochastic Gradient Descent(SGD)[34]、Root Mean Square prop(RMSprop)[35]、Adaptive Moment Estimation(Adam)[36]和Adamax[36]。从表2 可以看出,与其他优化器相比,Adam 优化器准确率最高。因此,选择Adam 为本文模型的优化器。

对于训练周期,在200 轮以后随着训练周期的增加,模型的准确率没有提升,因此本文选取200 个训练周期。

从表4 得到,模型在学习率为0.001 的时候准确率最高,且与其他学习率时的准确率相比有着明显的优势,因此采用0.001 的学习率。

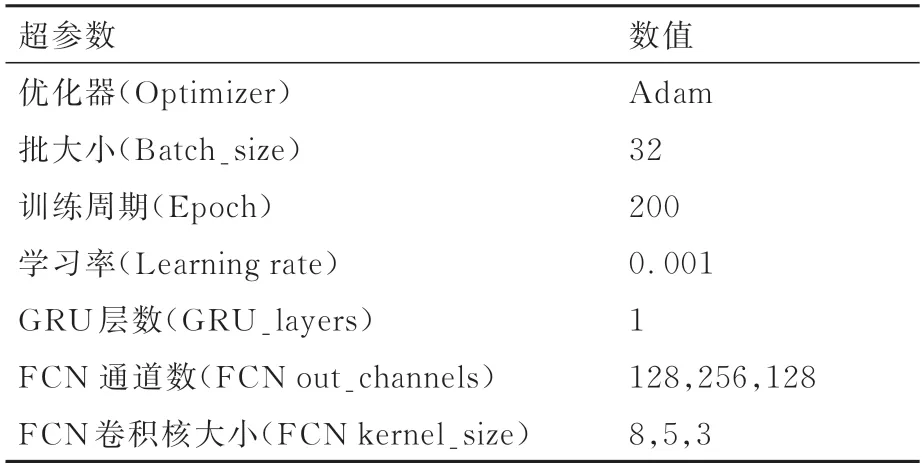

将以上对比实验结果确定的实验训练过程中的超参数以及所选模型的默认具体结构数据汇总如表5 所示。

表5 模型中的超参数Table 5 Hyperparameters in model

3.4 实验结果与分析

3.4.1 GRU-FCN 结果分析

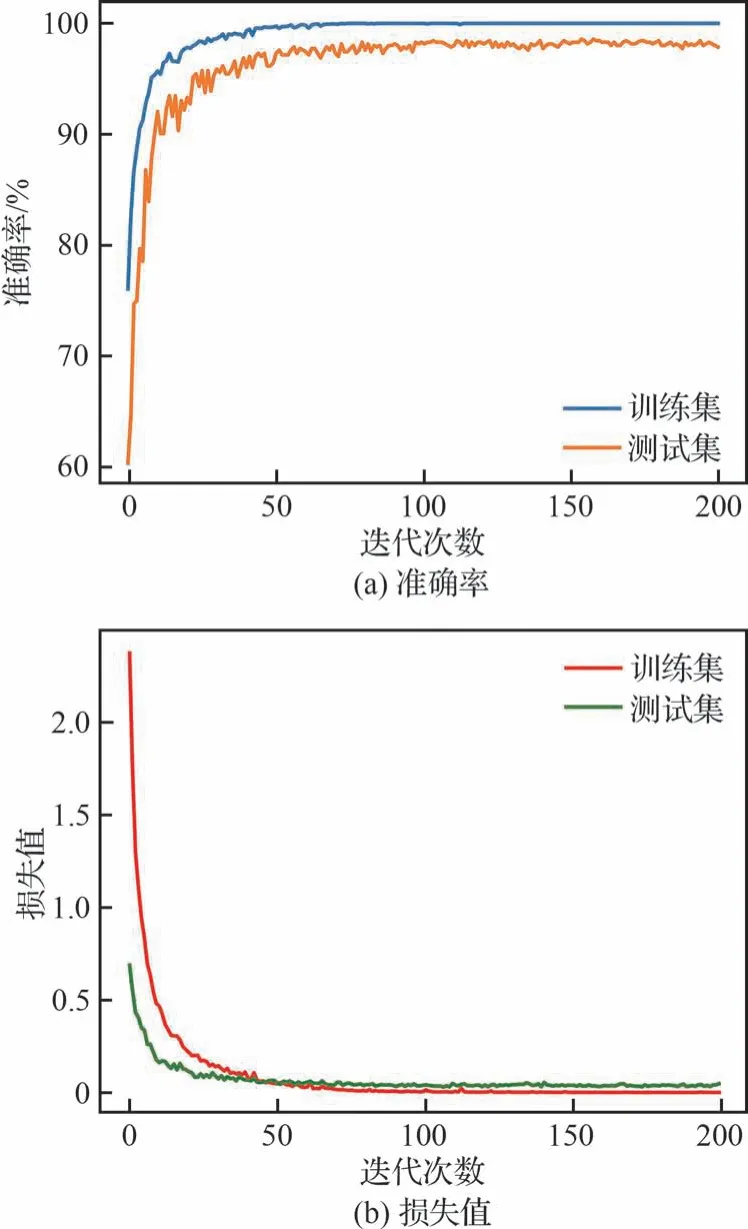

GRU-FCN 空中目标意图识别模型的实验结果如图7 所示,在60 轮左右达到收敛状态,训练集的准确率最高可达100%,测试集的准确率在98%上下浮动,最高可达到98.57%。

图7 GRU-FCN 模型的准确率和损失值Fig.7 Accuracy and loss value of GRU-FCN

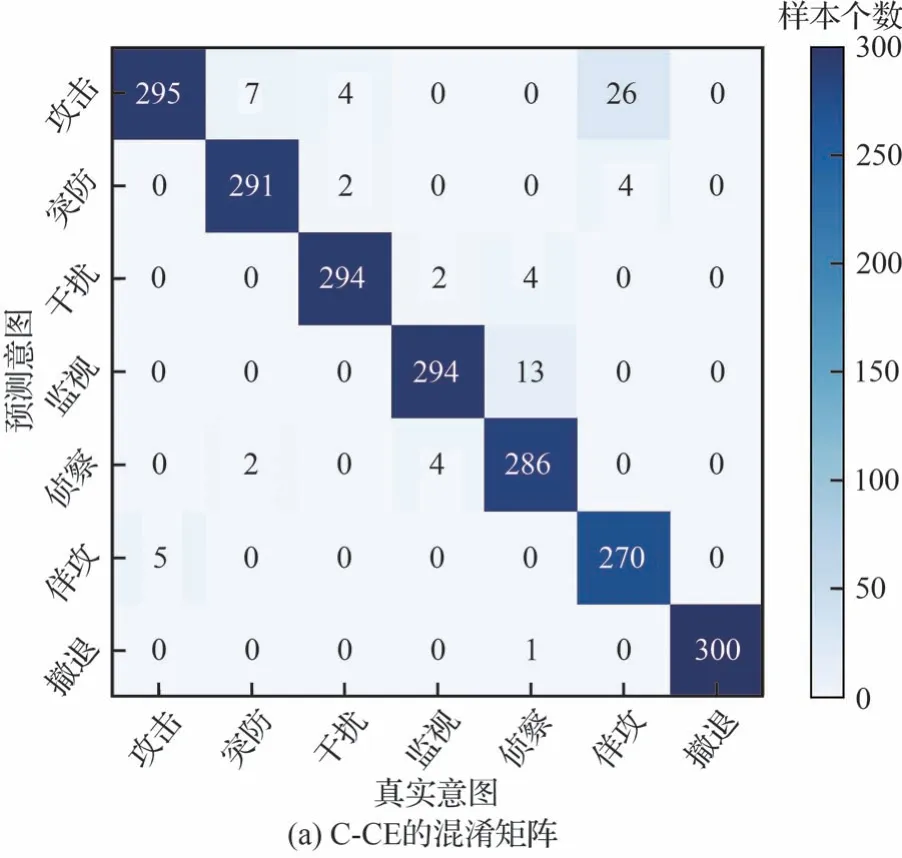

为进一步观测模型的意图识别结果,制作了如图8 所示的混淆矩阵表示真实意图与模型的各预测意图之间的关系,对角线表示识别正确的样本个数,对角线以上表示从各低威胁的意图误判为高威胁的意图的样本个数,对角线以下表示从各高威胁的意图误判为低威胁的意图的样本个数,混淆矩阵中数据的颜色越深代表数值越大。从图中可以看出,模型对于7 种意图识别的准确率都较高,其中撤退的意图识别精度最高,可以达到100%,攻击和佯攻的意图识别精度最低,分别为95.33%和97.0%。除此之外发现,攻击和佯攻、监视和侦察意图间会出现部分识别混淆的情况。通过分析,以上2 组意图之间特征相似度较高,特别是佯攻意图对防空作战一方具有很强的欺骗性,因此2 类意图的样本本身可能不存在较大的差异,出现2 类意图相互混淆的情况,符合实际[37]。

图8 GRU-FCN 意图识别结果的混淆矩阵Fig.8 Confusion matrix of GRU-FCN intention recognition results

为直观显示GRU-FCN 提取意图特征信息的效果,使用T-distributed Stochastic Neighbor Embedding(T-SNE)[38]算法将其提取到的特征降维,映射为二维特征,作为横纵坐标点,绘制特征投影图。如图9 所示。由图9 可以看出,模型的类内距离较近,类间距离较远,说明GRUFCN 的特征提取效果较好,对于不同的意图类型都进行了较好地分类。

图9 GRU-FCN 提取特征降维后投影效果Fig.9 Projection effect after dimension reduction of features extracted by GRU-FCN

综上,通过GRU-FCN 模型的准确率、混淆矩阵、提取特征降维后的投影图可以发现,GRUFCN 在非代价敏感的空中目标意图识别上表现优异,一定程度上达到了在战时辅助指挥员作战决策的要求。

3.4.2 加入CAIR 后模型的代价敏感对比分析

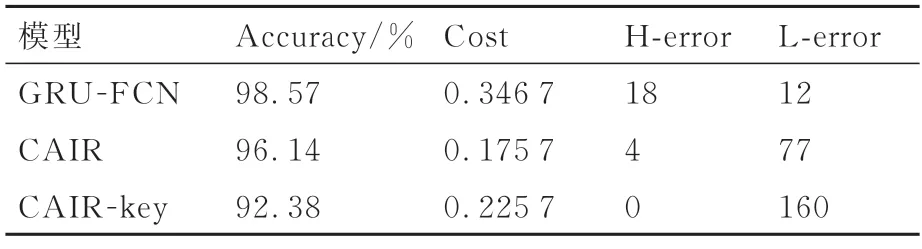

为验证本文提出的针对代价敏感空中目标意图识别的CAIR 方法的有效性,现对原始的GRU-FCN 模型、加入CAIR 的GRU-FCN 模型和加入CAIR 后通过调整参数使关键误判为0 的模型进行对比分析,通过调试和对比选取较好实验结果的CAIR 中的参数,如表6 所示,实验结果如表7、图10、图11 所示。

表6 CAIR 中参数取值Table 6 Parameter value in CAIR

表7 模型的代价敏感对比Table 7 Comparison of cost sensitivity of models

图11 CAIR 和CAIR-key 的混淆矩阵Fig.11 Confusion matrix of CAIR and CAIR-key

图10 展示了不同模型训练过程中的准确率和损失值的变化情况,“train”代表训练集上的表现,“test”代表测试集上的表现,CAIR 表示加入CAIR 改进的GRU-FCN 模型,CAIR-key 表示加入CAIR 后关键误判为0 的模型。表7 展示了不同模型在4 种评价指标下的表现,可以发现,加入CAIR 之后的模型Accuracy 为96.14%,相比于原始模型虽略有下降但是仍然保持在较高的水平,Cost 从原有的0.346 7 降到了0.175 7,误判代价有了明显下降,H-error 也从18 降到了4,L-error 有所上升,说明加入CAIR 后模型将空中目标的意图识别倾向于决策更加保守的方向。通过调整参数使模型的H-error 变为0 后,模型的Accuracy 有些许下降,但是依旧能够超过90%,达到92.38%,Cost 变为0.225 7,相比于原有的GRU-FCN 模型同样有较为明显下降,达到了代价敏感的空中目标意图识别的效果。为了更加直观呈现出CAIR 的效果对比,对于测试集的所有样本识别结果绘制了如图11 的混淆矩阵,分别展示了加入CAIR 和CAIR-key 的代价敏感意图识别情况,并与图8 中未加入CAIR 的识别结果作对比,可以看出在加入CAIR 后的模型将高威胁意图误判为低威胁意图的情况明显减少。

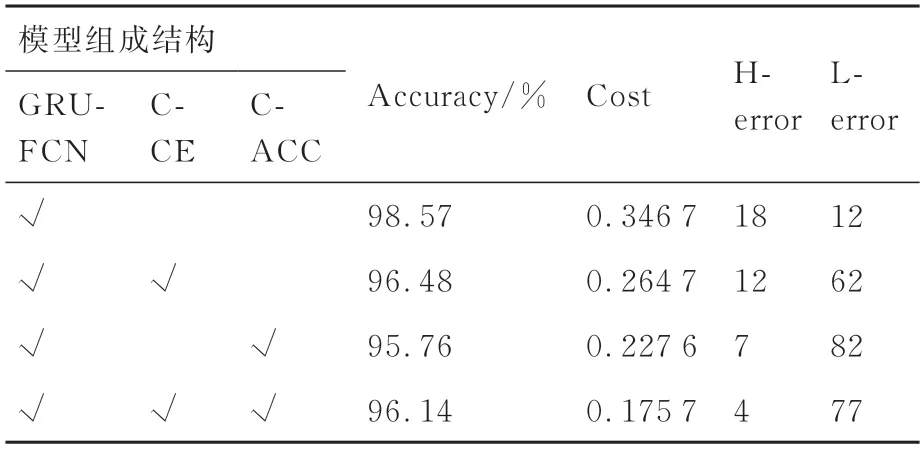

3.4.3 消融实验分析

为进一步论证本文所提的CAIR 方法的CCE 和C-ACC 的有效性,通过消融实验进行对比实验分析,通过表8 和图12 发现,只加入C-CE 的模型和只加入C-ACC 的模型Cost分别为0.264 7和0.227 6,H-error 分别为12 和7,相比于原始GRU-FCN 模型的0.346 7 和18,Cost 和H-error均有明显降低,证实了C-CE 和C-ACC 的在代价敏感意图识别方面的有效性。另外,3 个模型相对于原始GRU-FCN 都对将攻击意图误判为佯攻意图这一代价较高的关键误判情况进行了改善,并且,同时加入C-CE 和C-ACC 的模型Cost为0.175 7,H-error 为4,相比于其他3 个模型的效果最好,进一步证明了CAIR 的代价敏感意图识别效果。

表8 消融实验结果Table 8 Results of ablation experiment

图12 C-CE 和C-ACC 的混淆矩阵Fig.12 Confusion matrix of C-CE and C-ACC

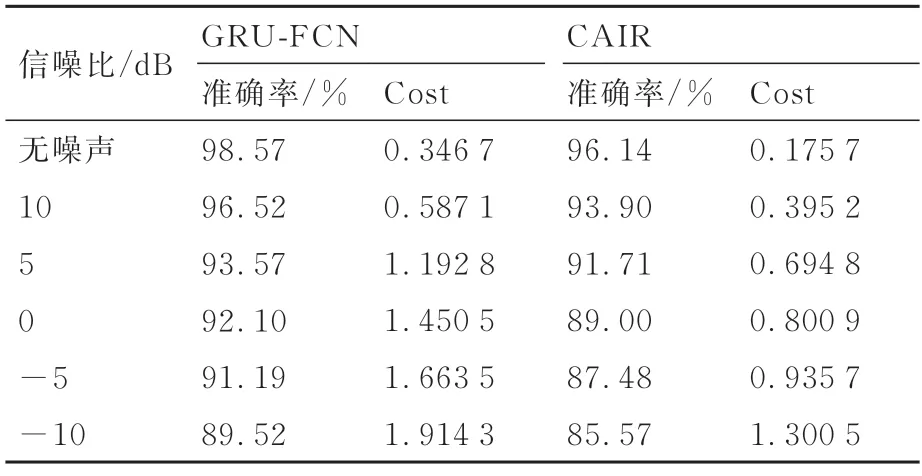

3.4.4 模型鲁棒性分析

为验证实战条件下如果无法获取某一特征或者部分特征数据获取错误对模型意图识别结果造成的影响,验证本文所提模型的鲁棒性,对原有的数据集按下式分别添加信噪比为10、5、0、—5、—10 dB 的高斯白噪声。

式中:x为原始信号;n为噪声信号;N为原始信号长度;S为信噪比;y为通过信噪比计算得到的噪声信号。在不同信噪比下训练测试模型,并对比不同信噪比条件下的意图识别效果,结果如表9 所示。表9 中,使用原始的GRU-FCN 模型和加入CAIR 后的GRU-FCN 模型在不同信噪比下进行对比。通过表9 发现,随着信噪比的降低,模型的准确率呈现下降趋势且总代价呈现上升趋势,但是在信噪比为-10 dB 时模型的准确率仍可以超过85%,且加入CAIR 的模型总误判代价低于1.5,远低于未加入CAIR 的原始GRU-FCN 模型。证明本文所提的模型在应对环境噪声时准确率变化波动较小,鲁棒性较好。

表9 模型在不同信噪比时识别情况对比Table 9 Comparison of recognition of models with different SNRs

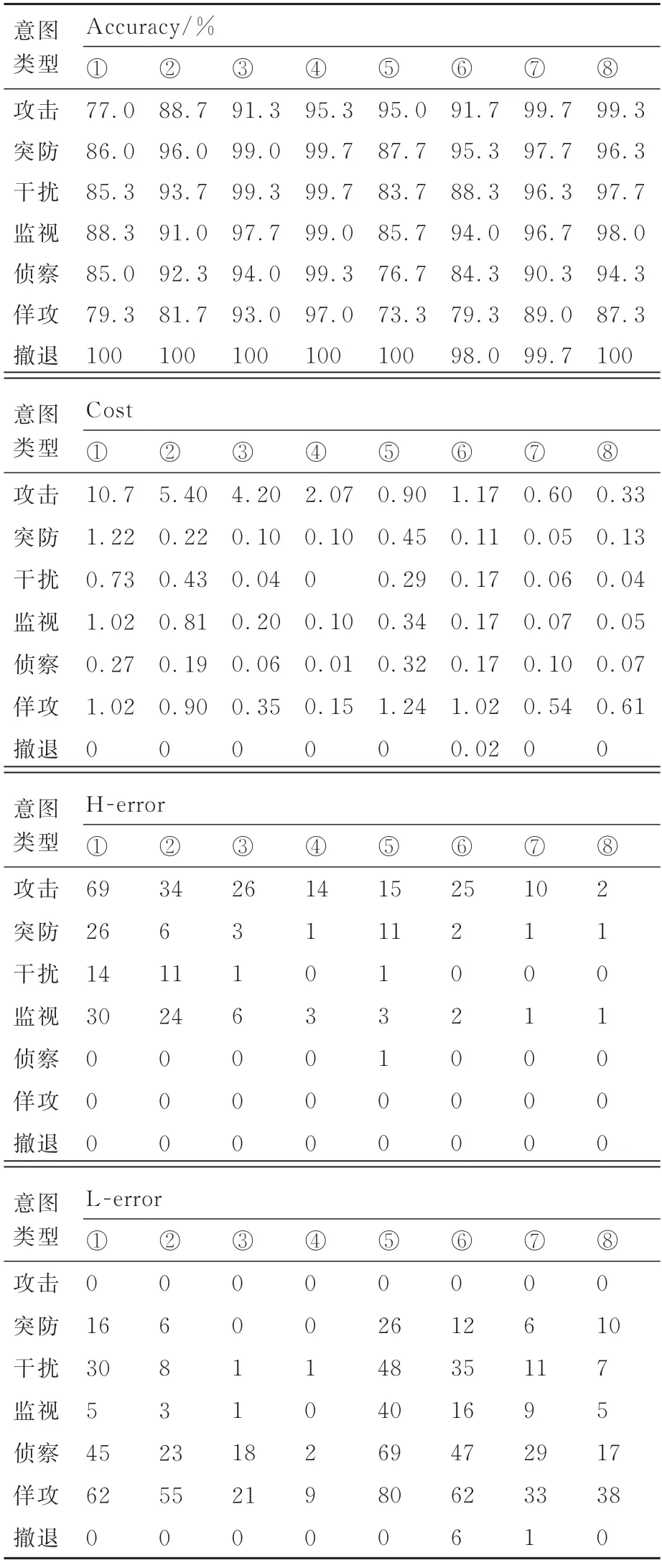

3.4.5 不同模型应用CAIR 对比分析

为验证本文提出的模型相比于现有模型的优越性以及本文所提CAIR 方法的普适性,现将其分别与文献[9]提出的基于长短期记忆网络(LSTM)的战场对敌目标战术意图识别模型;文献[13]提出的基于BiGRU-Attention 的空中目标作战意图识别方法;文献[11]提出的Attention-TCN-BiGRU空中目标意图识别模型等3 种现今常用的表现优异的空中目标意图识别模型进行对比实验,实验结果如表10和图13所示。

表10 不同意图模型对比Table 10 Comparison of different intention recognition models

图13 模型对比实验的准确率和损失值Fig.13 Accuracy and loss value of model comparison experiment

由图13 可以看出,以上对比模型均在训练60轮左右时达到收敛状态,各模型在加入CAIR 后准确率略有降低,但是并没有影响模型的收敛速度。各模型在加入CAIR 后均有准确率降低的现象,考虑是因为未加入CAIR 的模型的结果单一追求准确率最高,在加入CAIR 后,模型的结果为综合准确率和代价敏感属性后的结果,并不一定在准确率方面取得极大值。通过表10 中可以发现,本文提出的GRU-FCN 意图识别模型相对于其他3 种意图识别模型的准确率明显提高,同时,加入CAIR 的GRU-FCN 模型获得了最小的误判代价。通过对比发现,所有的意图识别模型在加入CAIR 后的误判代价均明显降低,且H-error 减少、L-error 增加,说明误判成功向着减少关键代价、决策更加保守的方向靠拢,成功证明了本文所提代价敏感空中目标意图识别方法的普适性。

为了探究CAIR 机制对不同意图类型的效果和规律,按照意图类型分类别计算不同模型在4 种评估指标上的结果,如表11所示。表11中,①~④分别代表LSTM、BiGRU-Attention、Attention-TCN-BiGRU 和GRU-FCN;⑤~⑧分别代表加入 CAIR 后的 LSTM、BiGRU-Attention、Attention-TCN-BiGRU 和GRU-FCN 模型。

表11 不同模型对比中各评估指标结果Table 11 Results of evaluation indexes of ablation experiment

从表11 得出,在加入CAIR 后,对于攻击意图的识别准确率有明显提高,误判代价明显大幅度降低,分析原因,是攻击意图的威胁性最大,通过优先保证攻击意图的准确率减少了出现关键代价误判的情况;对于撤退意图所有模型的准确率都接近100%,因此误判代价几乎为0,考虑是因为撤退意图带有明显区别于其他意图的特征,自身容易分类;在加入CAIR 后几乎所有模型的H-error 减少,L-error 增加,证明了该方法的代价敏感效果,同样有效减少了关键代价的误判;对于进攻意图和佯攻意图,在加入CAIR 模型后,不同模型对进攻意图识别的准确率明显上升,误判代价明显减小,对佯攻意图识别的准确率下降,代价增大,分析原因,由于进攻和佯攻意图本身欺骗性强、不易区分,可能是模型为使决策偏于保守,将介于进攻和佯攻意图之间的情况向识别为进攻的方向靠拢。

4 结论

通过理论研究和实验发现,空中目标的意图识别问题还存在以下突出问题,在接下来的工作中对于以下问题将重点关注。

1)作战中对于时间的紧迫性要求高,如何将意图识别发展为准确有效的意图预测,为作战决策争取更多宝贵时间的问题。

2)对于相似性高的意图如何区分的问题。

3)现有的研究多是将数据的时序特征与位置、速度和加速度等空间特征当作独立的变量分开考虑,实际的防空作战应该是时间信息和空间信息相对应的统一整体,考虑时间信息与空间特征的融合可能会使模型的效果有进一步的提升。