YCbCr空间分治的双分支低照度图像增强网络

闫晓阳,王华珂,侯兴松,顿玉洁

西安交通大学信息与通信工程学院,西安 710049

0 引言

在当今时代,图像是信息的重要载体,占人类获取外界信息的75%。然而,受成像设备和恶劣环境的影响,在低照度环境中往往难以获得高质量图像。尤其是夜间或背光条件下,获取的图像大多能见度较差,图像的细节隐藏在黑暗中难以被发觉,并且由于光照不足和曝光时间有限,入射光子数目减少,导致图像中含有大量不可忽视的噪声。单独增强图像对比度会放大原本隐藏在黑暗中的噪声,降低图像的视觉质量,同时噪声在RGB(red,green,blue)通道之间复杂的耦合关系,往往导致增强图像颜色失真。这不仅影响图像的美学体验,更会对后续的图像分类、目标检测与识别等高级视觉任务带来一定困难(马龙 等,2022)。

低照度图像增强旨在改善较差的光照环境下采集的图像质量,以获得细节清晰可见、较低噪声水平以及较少颜色失真的正常亮度图像。传统的低照度图像增强方法直接在RGB 空间中对像素值进行操作,如Celik 和Tjahjadi(2011)和Lee 等人(2013)利用直方图均衡扩展图像的动态范围,原理简单、操作速度快,但不适用于非均匀光照图像,容易引起图像中较亮区域细节的丢失;Rahman等人(2016)利用自适应的Gamma 校正算法缓解使用全局参数时导致的过度增强或欠增强问题。这些直接在RGB 空间中通过灰度值的映射来调整图像对比度的方法,忽略了图像噪声。经典的Retinex 理论(Land 和McCann,1971)能够将RGB 图像分解为与光照无关的反射分量和与光照相关的照明分量,因此Li 等人(2018)采用Retinex理论对RGB图像进行分解,并考虑了噪声项的影响,解决了单独图像增强不能有效处理噪声的问题。

随着深度学习的逐渐火热,卷积神经网络广泛应用于低照度图像增强,Lore 等人(2017)首次将卷积神经网络引入了低照度图像增强任务,提出的LLNet(low-light image enhancement network)采用叠加稀疏去噪自动编码器,同时对RGB 颜色空间中的低光照图像进行增亮和去噪。在此之后,更多的研究者选择在RGB 颜色空间中将低照度图像增强这个复杂的问题分解为几个子问题,通过多分支网络减小模型学习的难度并提高算法性能(Lyu 等,2018;王知音 等,2022;赵明华 等,2022)。例如,Lyu等人(2018)提出的MBLLEN(multi-branch low-light enhancement net-work),采用端到端的多分支增强网络,通过多个模块完成特征提取、图像增强与融合,在RGB 颜色空间中实现低照度图像对比度的增强、噪声和伪影的抑制。另外,由于Retinex 理论可以将RGB 图像分解为不同的子分量,便于采用多个子网络对不同分量进行处理,因此,许多研究者通过将卷积神经网络与Retinex理论相结合,在RGB颜色空间通过多个子网络分别实现图像分解、亮度增强和噪声去除。例如Wei 等人(2018)提出的RetinexNet(Retinex decomposition for low-light enhancement network)和Zhang 等人(2019,2021)提出的KinD(kindling the darkness)及KinD++等,取得了较好的性能提升,但却将去噪做为后处理,难以在去噪不足和过度去噪间取得均衡,容易导致图像细节过度平滑。注意到低照度图像与噪声难以分离,后去噪的方式效果不佳的问题,Zhu 等人(2020)提出了一个三分支网络RRDNet(robust Retinex decomposition network),将输入的RGB 图像分解为光照、反射率和噪声3 个分量,使得光照的调整和噪声的预测同步进行,以防止噪声在对比度拉伸后被放大或过度去噪使细节模糊,但是由于缺乏真实的反射率和光照度图像做约束,往往需要精心设计损失函数才能确保分解的有效和准确。虽然低照度图像增强的方法普遍采用基于RGB 颜色空间的方法,但是由于噪声和RGB 三通道的复杂耦合关系往往导致增强结果不理想(Wang等,2019)。

针对以上问题,为了在低照度条件下有效提升图像的亮度和对比度,抑制图像中的噪声,得到较少颜色失真和较低噪声污染的增强图像,本文对比了不同颜色空间的特性,发现相比于RGB 颜色空间,YCbCr 颜色空间亮度和色度信息相互分离的特性,有助于实现亮度增强和去噪的解耦,更适合于低照度图像增强任务。基于此,本文提出了一个基于分治策略的双分支低照度图像增强网络。该方法首先将低照度图像从RGB 颜色空间转换至YCbCr 颜色空间,再针对亮度通道和色度通道不同的降质模式分别进行亮度恢复与图像去噪;在去噪网络中采用多尺度融合机制提升去噪性能;并引入亮度监督模块和色度监督模块进行分段监督和约束以缓解网络的学习难度。该方法能在保证图像亮度恢复的同时,获得较好的去噪结果,避免因去噪不足降低图像质量或过度去噪引起细节丢失。相比于其他经典的低照度图像增强方法,显著提高了增强图像的峰值信噪比(peak signal-to-noise,PSNR)、结构相似性(structure similarity index measure,SSIM)和视觉质量。

1 基于YCbCr的低照度图像增强

对于低照度图像增强,常见的做法是在RGB 颜色空间中先对输入的低照度图像进行亮度和对比度的提升,然后再对增强图像进行去噪。但是图像增强的过程必然放大隐藏在黑暗中的图像噪声,使得后续的去噪变得困难(Liu 等,2021;Wei 等,2018)。同时进行噪声去除和亮度提升是一种更有效的方式,但低照度图像噪声与亮度复杂的关系又难以同时保证对比度提升与去噪的效果。因此,本文重点关注如何有效地分离低照度图像亮度增强和噪声去除任务,使得噪声去除和亮度提升同时取得最佳的效果。

为了实现低照度图像对比度增强和去噪的目的,本文考虑YCbCr 颜色空间中色度信息与亮度信息相互分离的特性,使得增强和去噪可以同时分通道进行,下面将重点介绍采用的YCbCr 颜色空间及双分支增强网络。

1.1 YCbCr颜色空间

YCbCr 是视频产品常用的色彩编码方案,由RGB 颜色空间转换而来,与RGB 颜色空间之间的相互转换关系为

式中,Y、Cb和Cr分别代表YCbCr颜色空间中的亮度分量和蓝色、红色两个色度分量,R、G和B分别为RGB颜色空间的红色、绿色和蓝色分量。

RGB 颜色空间中亮度失真与颜色通道耦合在一起,而YCbCr 颜色空间可以直接获得图像的亮度信息,在处理低照度图像增强任务时,有助于降低处理方法的复杂度。因此,在图像恢复任务中结合YCbCr 颜色空间,可以更加方便地对具有不同重要性的亮度通道和色度通道进行不同的处理。

本文统计了LOL(low-light dataset)数据集(Wei等,2018)中的500对正常∕低照度图像对在不同颜色空间和不同通道上的差异,如表1 所示。其中R、G、B 和Y、Cb、Cr 分别为RGB 和YCbCr 空间的各通道。表1 的结果说明,在RGB 颜色空间中3 个通道均存在严重的降质,而YCbCr 颜色空间中各个通道的降质并不均匀。相比色度通道,亮度通道具有更低的PSNR、SSIM 和更高的均方误差(mean squared error,MSE),说明亮度通道存在更严重的图像质量损失。对于低照度图像增强,通道间的重要性不同,适合采用分通道的方式对不同通道进行更加合理的处理。

表1 各颜色空间低照度图像与正常照度图像之间的灰度值差异Table 1 The difference between normal-light images and low-light images in RGB space and YCbCr space

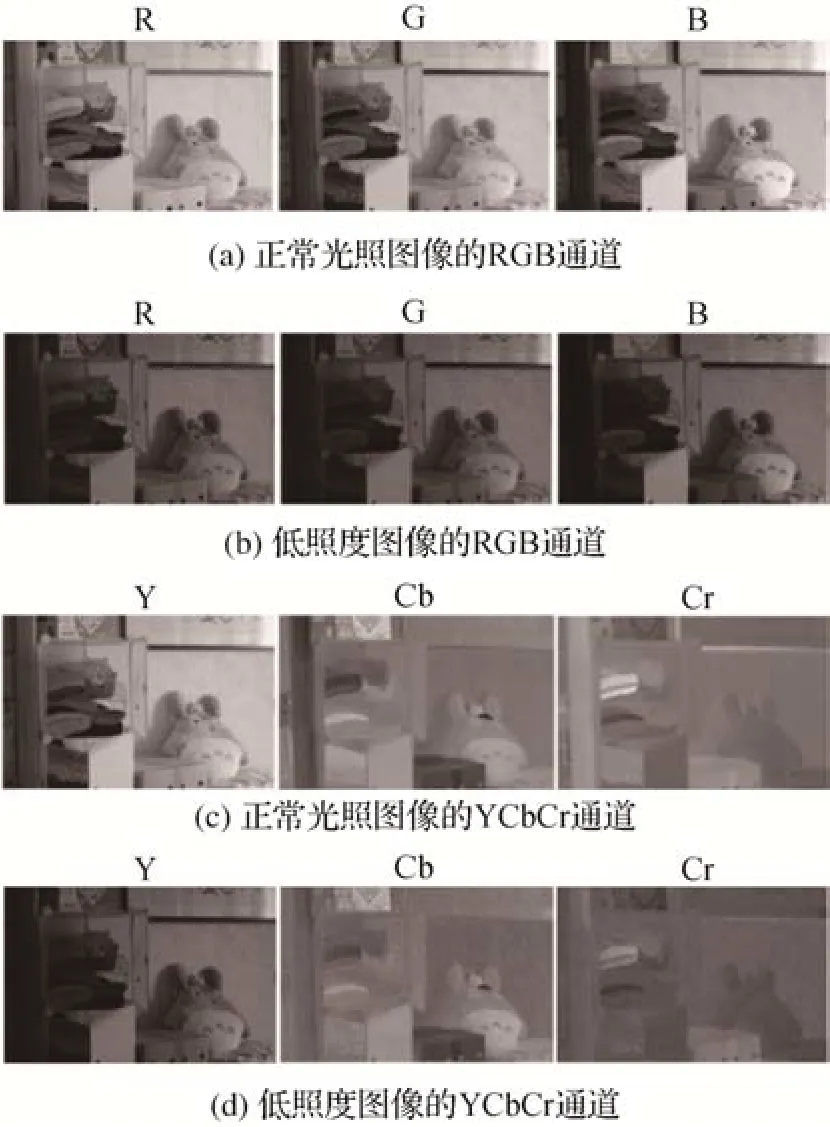

图1直观地展示了正常光照∕低照度图像对的不同颜色通道,其中图1(a)(b)分别为正常光照和低照度图像的RGB 通道;图1(c)(d)分别为图1(a)(b)对应的YCbCr 通道。图1 从视觉结果上证实了低照度图像的RGB 通道分解无法实现亮度和噪声的解耦,3 个通道均存在亮度的损失与大量噪声。而YCbCr 通道的分解结果显示,亮度的差异主要存在于Y 通道,Cb、Cr 通道深受噪声的污染。因此,相比于RGB颜色空间,在低照度图像增强任务中,YCbCr颜色空间有利于分离亮度失真和噪声干扰。

图1 RGB与YCbCr颜色空间低照度图像与正常光照图像各通道对比Fig.1 Comparison between normal images and low-light images in RGB and YCbCr color space((a)RGB channels of normal image;(b)RGB channels of low-light image;(c)YCbCr channels of normal image;(d)YCbCr channels of low-light image)

1.2 双分支增强网络

基于图1 对图像亮度通道和色度通道的观察和分析,根据分治策略,本文设计了一个基于YCbCr颜色空间的双分支网络,分别对亮度通道和色度通道进行亮度增强和去噪,用于解决低照度图像对比度不足和噪声污染的问题。整体框架如图2 所示,网络主要由3 部分组成:亮度增强模块、噪声去除模块和融合模块。在将低照度图像输入网络进行处理之前,首先将其由RGB 颜色空间转换至YCbCr 颜色空间,再将亮度通道Y 和色度通道Cb、Cr 分开处理,分别作为亮度增强模块和噪声去除模块的输入,通过端到端的训练得到处理后的亮度通道和色度通道,并拼接两个模块的结果进行深层特征的融合,得到最终的增强结果。

图2 双分支增强网络整体框图Fig.2 The framework of dual-branch enhancement network

相比于通常在RGB 颜色空间中对所有通道进行相同处理的方法,YCbCr 颜色空间中分通道处理的方式便于针对不同的降质模式设计相应的网络结构,使不同的模块更有效地处理各自所面临的失真,减少网络学习的难度。

亮度增强模块和噪声去除模块如图3 所示。低照度图像的亮度通道主要反映了图像的亮度信息,可以用Ylow来表示。由于亮度失真往往是非局部的,为获得图像的全局亮度信息,采用了经典的U-Net(U-shaped network)(Ronneberger 等,2015)网络结构,如图3(a)所示。在U-Net 网络中,编码器端通过逐层池化操作扩大卷积的感受野,在网络的瓶颈层,较大的感受野可以提取用于对比度恢复的非局部亮度信息,在解码器端通过逐层上采样将非局部信息扩展至全局。

图3 亮度增强模块和噪声去除模块网络细节Fig.3 The detail of dual-branch enhancement network((a)U-Net in luminance enhancement module;(b)multi-channel attention block;(c)channel attention block;(d)supervised attention module)

低照度图像的色度通道Cr 和Cb 具有相似的降质模式,可以用Wlow同时表示。根据图像的噪声主要分布在色度通道的特点,为了增强图像的细节并有效学习图像的多尺度特征,采用多尺度融合的图像去噪网络。使用Shuffle 和Unshuffle 操作进行尺度变换获得多尺度的输入图像,并帮助完成多尺度特征的融合,相比于损失信息的上下采样操作,像素重排不会导致图像信息的丢失,更有助于实现图像噪声的去除。采用多重通道注意力机制(multichannel attention block,MCAB)作为多尺度特征提取的基础模块,如图3(b)所示,该模块由两个卷积操作和多个通道注意力层(channel attention block,CAB)串接组成,其中CAB如图3(c)所示。

为了监督网络训练的正常进行,确保两个子网络可以实现有效的亮度增强和噪声去除任务,引入两个卷积作为亮度监督模块对亮度增强的中间结果进行监督,同时引入监督注意力模块(supervised attention module,SAM)(Zamir 等,2021)作为色度监督模块对噪声去除的中间结果进行监督,SAM 模块如图3(d)所示,Wfeats表示经SAM 模块处理后输入融合模块的色度特征。

在此基础上,设计了一种新的低照度图像增强损失,包括图像内容损失、亮度损失和去噪损失。由于Cb、Cr两个色度通道降质模式相似,为方便表示,使用W同时表示两个色度通道Cb和Cr。因此,总的损失函数为

式中,Ires表示网络的输出,Yres和Wres表示亮度增强模块的输出和噪声去除模块的输出,Ihigh、Yhigh和Whigh分别表示输入低照度图像对应的正常光照图像、亮度和色度通道。Loss1表示图像内容损失,它衡量了低照度图像与正常光照的目标图像之间的差异。Loss2和Loss3表示亮度损失和去噪损失,分别衡量亮度增强模块和噪声去除模块的阶段性结果,与无噪声污染的正常光照图像的亮度通道和色度通道之间的误差。在实验中,3 个损失函数Loss1、Loss2和Loss3均采用Charbonnier loss(Lai 等,2019)和SSIM loss(Wang等,2004)损失函数进行约束,其定义式相同,以Loss1为例,其定义为

式中,Lchar表示Charbonnier loss,Lssim表示SSIM loss,λ1和λ2为超参数,在本文实验中均设为1;以Loss1为例,Charbonnier loss如式(4)所示,SSIM loss如式(5)所示。

式中,SSIM为结构相似度函数,定义为

式中,P和Q分别表示增强图像和参考图像,uP、uQ表示均值,σP、σQ表示方差,σPQ表示协方差,c1、c2为常数。

2 实验结果和分析

本文使用PyTorch 框架构建网络结构,并在NVIDIA GTX 3050GPU、Intel(R)Core i5-10400F 2.90 GHz CPU 计算机上训练模型。下面的实验分别验证了提出算法的优异性能及泛化能力,并通过消融实验证明了提出算法的有效性。

2.1 数据集及训练细节

本文采用LOL 与VE-LOL-L(vision enhancement in the low-light condition for low level)(Liu 等,2021)数据集作为训练集进行有监督的训练,LOL 与VELOL-L 均包含训练集和测试集,本文分别在各自的训练集上训练得到训练模型,并在对应的测试集上测试得到对比结果,确保测试结果的有效性。其中,LOL数据集包含500对真实场景下的正常∕低照度图像,图像大小为600 × 400像素,其中485对作为训练集,15 对作为测试集。VE-LOL-L 数据集共包含2 500 对低照度∕正常光照图像对,1 000 对由RAISE(raw images dataset)数据集(Dang-Nguyen 等,2015)合成而来,图像的大小为384 × 384像素(其中900对为训练集,100 对为测试集);500 对为真实场景的低照度∕正常图像对(其中400 对为训练集,100 对为测试集);1 000 对为多种欠曝光水平下的低照度图像与正常图像对,图像大小为600 × 400 像素。本文对VE-LOL-L数据集中由RAISE 合成的1 000对数据集和真实场景下的500 对图像对进行整合,共得到1 300 对训练集图像作为训练数据集,200 对测试集图像作为模型性能评估的测试集,由于本文关注的重点并非多曝光场景下的图像增强,因此未采用1 000对多种欠曝光水平下的数据集作为训练集。

训练图像被随机切分为128 × 128 像素的图像作为网络的输入,并使用随机裁剪、随机反转和随机旋转等方式作为数据增强手段扩充样本量。使用Adam优化器,设置初始学习率为1 × 10-4,β1=0.9,β2=0.999,ε=10-8,使用余弦退火算法稳定地将学习率降低至1 × 10-5。

2.2 评价指标及对比方法

为了定量地评估所提方法对低照度图像的增强效果,本文采用峰值信噪比PSNR、结构相似性SSIM、自然图像质量评价指标(natural image quality evaluator,NIQE)(Mittal等,2013)以及学习感知图像分块相似度(learned perceptual image patch similarity,LPIPS)(Zhang等,2018)作为评价指标。其中,PSNR和SSIM是低级视觉任务普遍采用的图像质量评价指标,值越大代表图像质量越好;NIQE和LPIPS广泛应用于低照度图像处理任务中,NIQE值越小,代表图像质量越好;LPIPS 比传统方法更符合人类的感知情况,其值越低表示两幅图像越相似,反之,则差异越大。

对比本文方法与主流的经典低照度图像增强方法的增强结果,包括BIMEF(bio-inspired multiexposure fusion framework)(Ying 等,2017)、Zero-DCE(zero-reference deep curve estimation)(Guo 等,2020)、LIME(low-light image enhancement)(Guo 等,2017)、EnlightenGAN(deep light enhancement without paired supervision)(Jiang 等,2021)、GLAD(global illumination-aware and detail-preserving network)(Wang 等,2018)、ReinexNet、KinD、KinD++以及URetinex(Retinex-based deep unfolding network)(Wu 等,2022)。其中,BIMEF、LIME 为传统算法;BIMEF 采用多曝光融合框架进行对比度增强;LIME基于Retinex理论,采用RGB通道中的最大值作为初始光照图,通过结构先验对其进行精细化并合成增强图像;Zero-DCE 为无需任何成对或不成对数据训练的无参考训练模型;EnlightenGAN 为基于生成对抗网络的无监督增强算法,采用全局—局部鉴别器保证图像局部的增强效果;GLAD、RetinexNet、KinD、KinD++和URetinex 为基于Retinex 理论的深度学习方法,其中GLAD 先进行全局光照估计再进行细节重建;RetinexNet、KinD和KinD++采用多个子网络分别实现图像的分解、增强和去噪;URetinex 精心设计了3个基于学习的模块,分别负责数据初始化、展开优化和光照增强。对于上述方法,本文采用其公开的预训练模型及所推荐的参数设置进行测试。

2.3 结果对比

表2 和表3 展示了在LOL 和VE-LOL 测试集上,本文方法与对比方法在PSNR、SSIM、NIQE和LPIPS 上的对比结果。结果显示,本文方法有更高的PSNR 和SSIM 值,这表明本文方法能够更好地抑制噪声并恢复图像的细节,自然图像评价指标NIQE 值也说明了本文方法的优越性,在为人类感知设计的指标LPIPS 上本文方法也取得最佳结果,这表明本文方法更加符合人类感知。

表2 LOL数据集上结果对比Table 2 The experimental comparisons on LOL

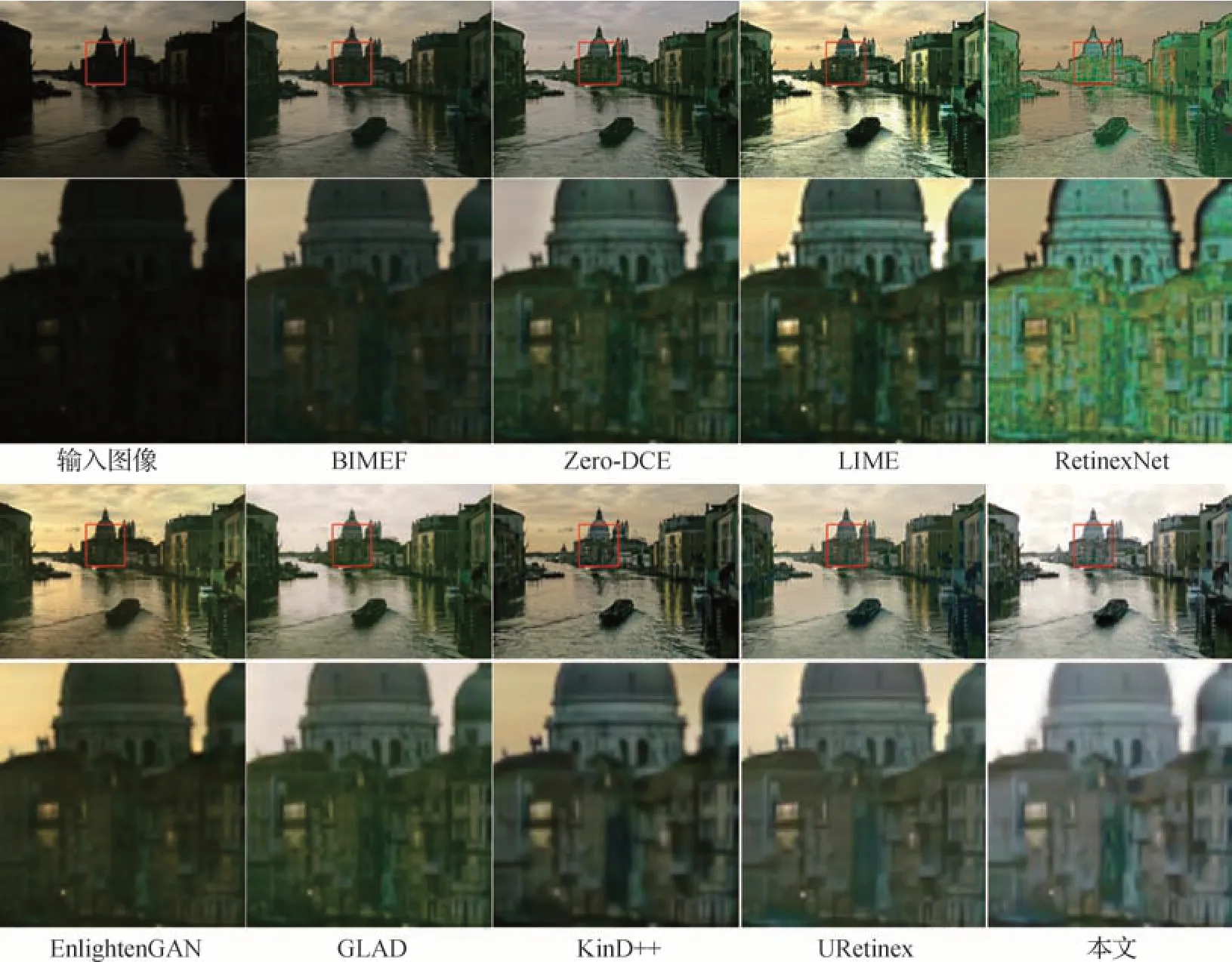

为了进一步直观地进行对比,图4 展示了LOL测试集上的增强结果。图4 的结果显示,BIMEF、Zero-DCE 不能有效提升图像的亮度,仍有大片区域淹没在黑暗中;LIME、RetinexNet 的增强结果具有更鲜艳的色彩,但增强图像中存在大量明显的彩色斑点,尤其RetinexNet 的增强结果锐化严重,图像明显失真;EnlightenGAN 和GLAD 能够在一定程度上恢复图像细节,但是抑制噪声的能力有限;KinD 和KinD++虽然能有效地去除图像的噪声,但图像过度平滑,细节信息几乎全部丢失;URetinex 能够较好地恢复图像细节,但图像色彩暗淡;本文方法在细节和色彩恢复方面做得更好。

与图4 整体图像笼罩在黑暗中不同,本文特别选取VE-LOL 数据集中具有非均匀光照的图像展示本文算法的性能,如图5所示。图5除了身处黑暗的大部分区域外,还存在较为明亮的灯光区域,在处理此类非均匀光照场景时,本文算法仍能取得较好的增强结果。对比其他的算法,BIMEF、Zero-DCE的增强能力有限,图像整体亮度较暗;LIME、RetinexNet、EnlightenGAN 和GLAD 均存在颜色失真,其中LIME放大了图像噪声,RetinexNet 存在不恰当的颜色增强,尤其是在右侧玻璃区域,色彩失真严重;EnlightenGAN 和GLAD 也无法有效去除噪声,增强结果色调偏黄,且在灯光部分引入了伪影;KinD 能够恢复图像正常的色彩,但图像左侧红色部分变得模糊;相比KinD,KinD++在红色字体部分有所改善,但仍然存在黑色伪影,右侧玻璃区域存在不恰当的绿色,左上城堡部分锐化严重;URetinex 仍然存在颜色失真。本文方法能够在亮度增强的同时,最大程度地去除噪声和抑制伪影。

图6 展示了在VE-LOL 数据集上更多的测试结果,该图像为具有丰富细节信息的风景图像,对比各种算法的增强结果,Zero-DCE、EnlightenGAN、KinD和KinD++均存在不同程度的颜色失真;Zero-DCE背景天空部分色彩异常;EnlightenGAN 的整体色彩偏黄,与真实图像的色彩相差甚远;KinD 和KinD++增强结果过度平滑,不仅丢失了图像细节,也偏离了山峰应该有的绿色色彩;BIMEF、Zero-DCE、LIME、RetinexNet、GLAD 和URetinex 能够保持正常的颜色和色调,并尽可能地恢复图像细节,但无法有效去除噪声,存在彩色斑点。本文方法可以保持图像应有的正常色调,恢复图像的细节纹理,如山峰部分的颜色保持和江水部分的波浪纹理恢复。

图6 VE-LOL数据集结果对比2Fig.6 The visual results(Ⅱ)on VE-LOL dataset

图7 和图8 展示了在MEF(multi-exposure image fusion)和NPE(naturalness preserved enhancement)数据集的结果对比,用于验证本文方法的泛化能力。结果显示,本文方法可以尽可能地恢复图像细节,并确保增强结果的颜色准确。在图7 中,本文方法可以恢复建筑的纹理,使隐藏在黑暗中的房屋结构变得清晰可见。在图8 中,本文方法可以更好地去除噪声并恢复正常色彩,尤其在背景的黑色夜空部分。另外,本文方法也避免了引入不恰当的增强色彩。注意,在图7和图8中省去了KinD 的结果,这是由于KinD++是KinD 的改进版本,在图像亮度提升和去噪方面性能都更优越,尤其是在图7 所对应的MEF数据集和图8 所对应的NPE 数据集上,KinD++的表现都明显优于KinD,因此出于排版的需要,此处未保留KinD的结果。

图7 MEF数据集结果对比Fig.7 The visual results on MEF dataset

图8 NPE数据集结果对比Fig.8 The visual results on NPE dataset

2.4 消融实验

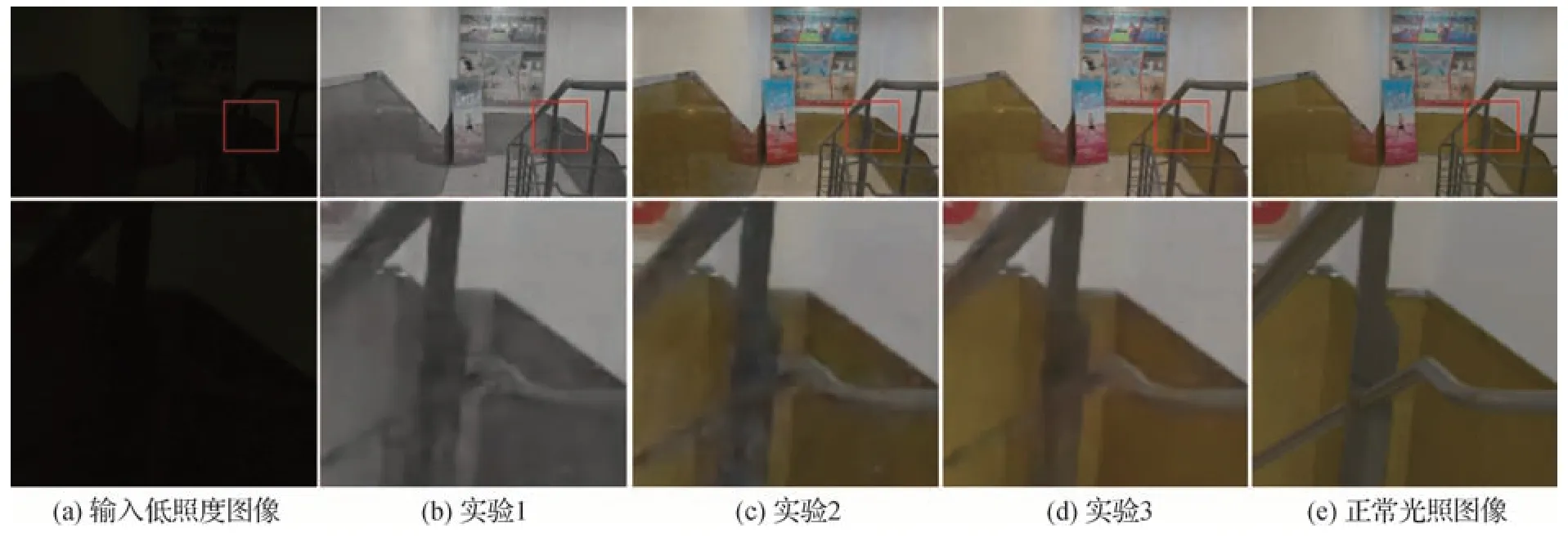

为了验证本文算法的有效性,进行了多组消融实验,其结果如表4 所示。另外,图9 展示了消融实验的视觉结果对比。由表4 和图9 的结果显示,实验1 仅采用本文提出的亮度增强模块处理Y通道便可恢复大部分的图像细节,但图像色彩无法恢复;实验2 采用本文的亮度增强模块和噪声去除模块,可以有效恢复图像边缘并抑制噪声;实验3 的结果表明额外采用两个监督模块:亮度监督模块和色度监督模块可以获得更好的去噪效果和色彩恢复效果,增强结果的颜色更接近真实的正常光照图像。

图9 消融实验结果对比Fig.9 The visual results of ablation experiments((a)input low-light images;(b)experiment 1;(c)experiment 2;(d)experiment 3;(e)ground truth)

表4 消融实验Table 4 The ablation experiment results

2.5 模型复杂度分析

表5 列出了各个模型的参数量、浮点数运算量和测试时间,测试采用LOL 数据集485 幅图像,图像尺寸均为600 × 400 像素,测试时间为485 幅图像的平均测试时间。其中,KinD++的浮点数运算量最大,远远超过本文方法;本文方法可以在适度的浮点数运算量下获得最佳的低照度增强结果。此外,本文方法还具有较快的推理速度,处理相同的图像,本文方法仅需KinD++方法1∕41(0.213 9∕8.807 9)的时间,兼顾了效率与性能。

表5 模型复杂度分析Table 5 The model complexity comparison

3 结论

针对低照度图像中亮度失真与RGB 通道之间高度耦合导致增强图像存在颜色失真和噪声污染的现象,受YCbCr 颜色空间亮度信息和色度信息相互分离的启发,提出了一种基于YCbCr 颜色空间的双分支低照度增强网络。该增强网络采用双分支结构分别对亮度通道进行对比度增强和对色度通道进行噪声抑制。实验结果表明,本文方法可以有效进行亮度增强和图像纹理恢复,获得的图像细节更加丰富、颜色更加真实、含有更少噪声。相比经典的低照度增强算法,在多个指标和多个数据集上取得了较大的增益提高,模型更加轻量、处理速度更快。

虽然本文方法可以有效提高低照度图像的视觉质量,但对于非均匀光照图像的增强效果仍然有待进一步提高,尤其对于过曝光区域缺乏有效的约束,导致增强结果不理想。后续工作中,如何进一步利用YCbCr 颜色空间的特性,设计更加有效的增强网络结构,提高网络的泛化能力,值得进一步深入探索。