农业害虫智能视觉检测研究综述

王春桃 梁炜健 郭庆文 钟浩 甘雨 肖德琴

摘要:農业害虫智能视觉检测是实现虫情自动实时监测的重要技术,首先介绍经典机器学习技术在国内外害虫智能视觉检测中的应用,然后整理以R-CNN、Fast R-CNN、Faster R-CNN、SSD和YOLO等深度学习技术为核心的新一代害虫智能视觉检测方法的研究进展。接着,剖析农业害虫智能视觉检测方法在研究及实际应用中存在的问题,其中基于经典机器学习的方法存在特征捕获能力和检测精度较低、资源消耗较大以及鲁棒性较弱等问题;基于深度学习的方法比基于经典机器学习的方法拥有更高检测性能,但存在数据分布不同和目标较小时识别效果较差、检测精度低和速度慢等问题。最后,针对基于深度学习的方法在农业昆虫数据库的制作、数据分布偏移的鲁棒性处理、深度特征学习、多场景应用4个方面对未来研究方向进行展望。

关键词:虫情监测;计算机视觉;目标检测;机器学习;深度学习

中图分类号:TP391

文献标识码:A

文章编号:20955553 (2023) 070207

07

Review on computer-vision-based detection of agricultural pests

Wang Chuntao1, 2, 3, 4, Liang Weijian1, Guo Qingwen1, Zhong Hao1, Gan Yu1, Xiao Deqin1, 2, 3

(1. College of Mathematics and Informatics, South China Agricultural University, Guangzhou, 510642, China;

2. Key Laboratory of Smart Agricultural Technology in Tropical South China, Ministry of Agriculture and

Rural Affairs, Guangzhou, 510642, China; 3. Guangdong Provincial Key Laboratory of Agricultural Artificial

Intelligence (GDKL-AAI), Guangzhou, 510642, China; 4. Guangzhou Key Laboratory of

Intelligent Agriculture, Guangzhou, 510642, China)

Abstract: Vision-based detection of agricultural pests is an important technology for achieving automated and real-time monitoring of pest conditions. Firstly, this paper introduces the application of traditional machine learning techniques in the vision-based detection of pests in China and internationally. Then, this paper summarizes the research progress of the new generation of vision-based detection methods for pests, which are based on deep learning techniques such as R-CNN, Fast R-CNN, Faster R-CNN, SSD, and YOLO. Next, this paper analyzes the problems that exist in the research and practical applications of vision-based detection methods for agricultural pests. The traditional machine learning-based methods have problems such as low feature capture ability, detection accuracy, and robustness, as well as high resource consumption. The deep learning-based methods have higher detection performance than the traditional machine learning-based methods but have problems such as poor performance on small and differently distributed targets, low detection accuracy, and slow speed. Finally, this paper discusses possible research directions in the future for the vision-based detection of agricultural pests based on deep learning techniques, including the development of public resources for agricultural pest image data, robust handling for data distribution shifts, deep feature learning, and multi-scene applications.

Keywords: pest monitoring; computer vision; object detection; machine learning; deep learning

0 引言

我国作为农业大国,气候环境优越,光热水资源充足,特别适合种植业发展。以蔬菜产业为例,全国农业技术推广服务中心的统计数据显示,截至2021年底,我国累计登记的蔬菜品种高达16 610个[1]。然而,优越的气候环境也为害虫的生长繁殖提供了有利条件,连年频发的农业虫害严重地影响了种植业的健康发展。因此,害虫防控具有十分重要的意义。

针对保护地作物虫害发生特点,我国主要的害虫防控策略为“实时监测、提前预防、压前控后、多策并举”,以减少虫源基数技术为基础,以释放天敌和应用生物农药为主要手段,将害虫危害损失控制在经济危害水平以下[2]。其中,实时监测是害虫防控的重要前提。现阶段我国大部分地区普遍采用人工方式进行虫情监测,先采用田间拍查、灯诱和粘虫板诱捕等方式捕获害虫,再由植保专家根据害虫特征进行视觉检测,从而估计虫源基数。然而人工方式劳动和时间成本日益增高,且我国基层农技测报人员的逐年流失,传统虫情监测面临巨大威胁。为此,我国现代农业需加快完善虫情自动监测基础设施建设。

害虫智能视觉检测是除昆虫雷达外实现虫情自动监测的一种重要技术手段,为方便相关科研人员和农业工作者快速了解害虫智能视觉检测研究现状,本文对该领域进行综述。首先,本文介绍了经典机器学习技术在国内外害虫智能视觉检测中的研究现状;然后,整理了以深度学习技术为核心的新一代害虫智能视觉检测方法的研究进展;接着,剖析了农业害虫智能视觉检测方法在研究及实际应用中存在的问题;最后,针对基于深度学习的方法对未来研究方向进行了展望。

1 害虫智能视觉检测概述

害虫智能视觉检测由农业物联网和计算机视觉检测构成,其中计算机视觉检测是实现害虫智能视觉检测的核心构件。根据所采用的计算机视觉检测技术,常见的害虫智能视觉检测方法可分为两类:基于经典机器学习的方法和基于深度学习的方法。

在早期基于经典机器学习的害虫智能视觉检测方法中,常用的评价指标有:平均识别准确率(Average Accuracy of Recognition,AAR)和平均计数准确率(Average Accuracy of Counting,AAC)。在基于深度学习的害虫智能视觉检测方法中,常用的评价指标则包括:查准率(Precision,P)、查全率(Recall,R)、平均精确度(Average Precision,AP)、平均精确度均值(mean of Average Precision,mAP)、调和均值(F-Measure,F1)和平均准确率(Average Accuracy,AA)。这些指标的具体定义可参阅文献[3-4]。一般而言,上述评价指标值越高表明算法在给定数据集上的检测效果越好。

2 基于经典机器学习的害虫智能视觉检测

在2012年深度学习兴起之前,研究人员主要基于經典机器学习设计害虫智能视觉检测方法。这些方法大致可分为5类:基于支持向量机(Support Vector Machine,SVM)的方法、基于反向传播(Back Propagation,BP)神经网络的方法、基于决策树的方法、基于聚类的方法和基于连通域分析的方法。其中,前3类为有监督学习,后2类为无监督学习。这些方法的主要步骤归纳如下。

1) 由农技专家分析害虫特征。

2) 根据害虫特征使用预处理技术初步定位害虫区域并设计相应特征算子。

3) 使用人工设计的特征算子提取图中害虫的特征向量。

4) 基于特征向量用统计学习方法实现图像害虫智能视觉检测。

2.1 基于支持向量机的方法

韩瑞珍[5]利用图像分割和SVM结合终端设备搭建了基于物联网的害虫远程检测系统。Yao等[67]和杨国国[8]基于Haar特征和SVM等设计了中华稻蝗与稻飞虱检测器。田冉等[9]和Rustia等[10]结合红外传感器和SVM图像处理方法自动检测果树害虫。肖德琴等[11]结合SIFT特征、边缘检测、视觉词袋和SVM等自动统计出黄板图像中各类蔬菜害虫的数量,平均正确率达93%。

总体而言,支持向量机对小样本非线性害虫图像数据具有良好泛化能力,在农业害虫智能视觉检测中得到了较为广泛的应用。然而,支持向量机需要消耗空间存储训练样本和核矩阵,当数据量较大时面临巨大挑战,支持向量机的核函数及其超参数设置也较难确定。

2.2 基于决策树的方法

卜俊怡等[12]提出温室番茄作物害虫检测方法,算法先基于诱虫板图像背景均匀化对图中害虫进行分割,然后以颜色特征、形状特征和纹理特征等作为输入,最后用随机森林算法识别感兴趣区域内的害虫种类。

决策树是直观运用概率分析的一种图解法,便于理解和解释,但是决策树非常容易产生过拟合问题,并且简单的if-then规则使得决策树较难学习到数据特征间的复杂关系。

2.3 基于反向传播神经网络的方法

邹修国等[13]用灰度图和大津阈值法对图像进行预处理提取出稻飞虱的所在位置,随后基于4种不变矩和BP神经网络对白背飞虱、褐飞虱和灰飞虱进行识别。李震等[14]提出实蝇成虫图像识别算法,用BP神经网络识别图中橘小实蝇、南瓜实蝇和瓜实蝇,算法准确率达95.56%,单次识别平均耗时500ms。

该类方法一般能够取得获得良好检测准确率,尽管反向传播神经网络有点类似近年出现的深度学习卷积神经网络中的全连接层,但相比深度学习其局限性在于过度依赖人工设计特征提取器进行特征提取,还可能陷于局部最优。

2.4 基于聚类的方法

李震等[15]利用K-means聚类检测图像中的柑橘红蜘蛛,在试验中算法不仅在高清害虫图像上取得了好成绩,也在低清晰度图像上获得了88%的识别率,但是该方法消耗时间过长。王志彬等[16]提出了基于K-means聚类和椭圆拟合方法的白粉虱计数算法。

聚类方法原理简单,不需要额外的训练操作,运行简单且效率高。但该类方法很难区分多类别害虫,且K-means等聚类算法时间复杂度很高,对初始参数值的设置和离群点很敏感,当图像背景较复杂时该类方法作用有限。

2.5 基于连通域分析的方法

李季等[17]利用图像灰度处理和大津阈值法对黄色诱虫板上的枸杞害虫进行预处理,然后通过计算连通区域个数实现枸杞害虫计数。

基于连通域分析的方法较简单,但多数情况下只能用于计数,而且无法处理复杂的多种类害虫的应用场景。

基于经典机器学习的害虫智能视觉检测步骤较为简单,对运行环境要求不高。其涉及的预处理技术中,SIFT、HOG技术对遮挡、平移、旋转、噪声等较鲁棒,适用于检测作物中的害虫,但对图片清晰度要求较高;基于HSV颜色特征的技术不易受明度影响,可以提高图像中害虫与背景的对比度;基于LBP、Harr特征和红外传感器的技术对光照较鲁棒,但是对遮挡比较敏感;基于FAST的技术速度较快,但是对图像尺度、噪声等较为敏感。

基于聚类的方法和基于连通域分析的方法属于无监督方法,这两类方法较为简单且运行效率较高,具有一定的可行效果;但这两类方法多数只能用于分类和计数,无法有效处理多种类害虫图片。相比之下,基于支持向量机、决策树和反向传播神经网络的方法属于有监督的方法,它们能够有效识别多种类害虫而被广泛应用;其中支持向量机和反向传播神经网络由于对害虫图像具有更好的泛化能力,因此比决策树更受欢迎。

3 基于深度学习的害虫智能视觉检测

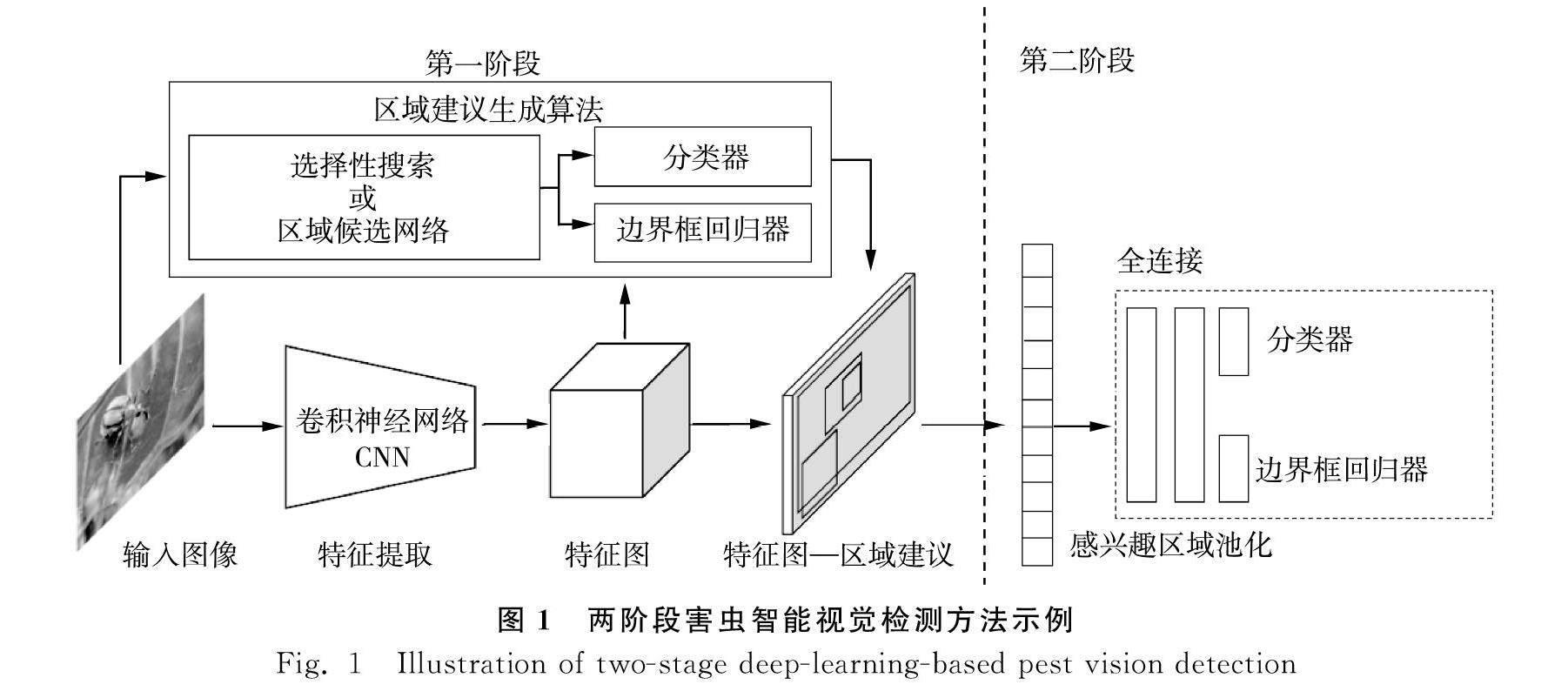

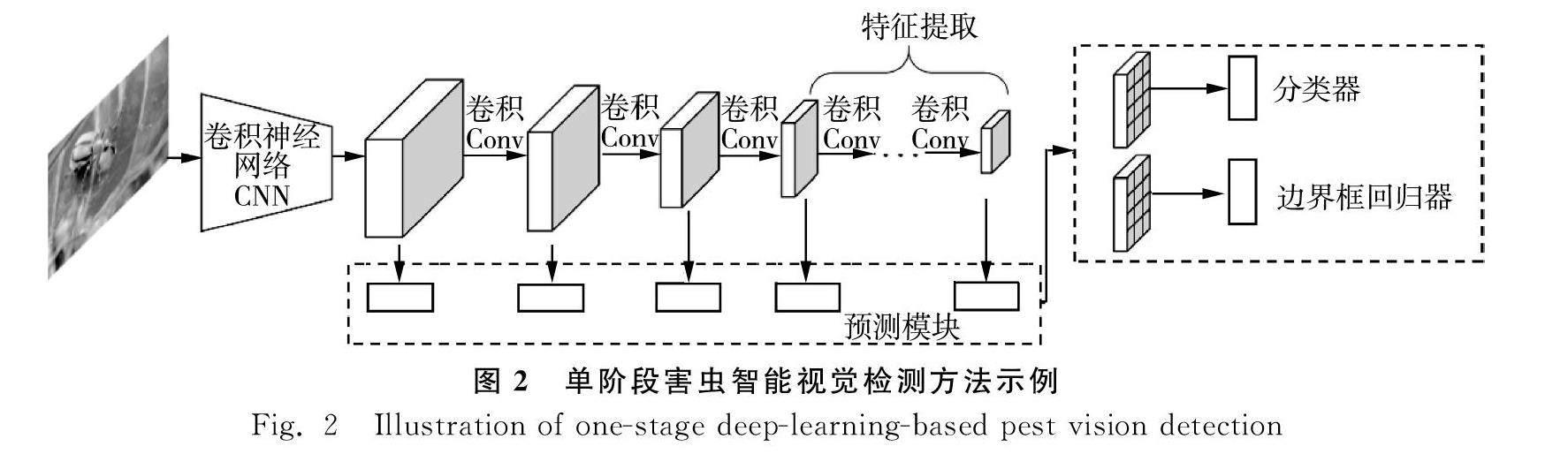

相比于经典机器学习算法,深度学习中的卷积神经网络(Convolutional Neural Network,CNN)具有自适应提取特征的优势。在CNN基础上,研究人员拓展出诸多图像分类和检测网络,如AlexNet[18]、VGG[19]、GoogLeNet[20]、ResNet[21]和EfficientNet[22]等可用于视觉识别,在ILSVRC数据集上的性能远超经典机器学习算法;R-CNN[23]、Fast R-CNN[24]、Faster R-CNN[25]、YOLO[26]和SSD[27]等可用于视觉检测,在Pascal VOC和COCO等数据集上取得了突破性成绩。鉴于CNN取得的巨大成功,研究人员开始基于CNN设计新一代害虫智能视觉检测方法,它们大致可分为两类:以R-CNN、FastR-CNN、Faster R-CNN等为主要模块的两阶段方法和以YOLO、SSD等为主要模块的单阶段方法,具体介绍如下。

3.1 两阶段方法

Liu等[28]和杨国国等[29]通过图像显著性获取图中害虫位置,接着用AlexNet网络对害虫的种类进行识别,算法的mAP和AA指标超过90%。Jiao等[30]将无锚点区域建议网络和Fast R-CNN相结合,实现了对图像中24种害虫的精准定位和精确分类。Dong等[31]基于Fast R-CNN提出CRA-Net网络,显著提高了对小目标害虫的检测能力。Wang等[32]改进了特征提取网络并结合Fast R-CNN对21类害虫进行检测,R和mAP分别达到89%和78.7%。

Shen等[33]用Inception结合Faster R-CNN实现害虫视觉检测。肖德琴等[34]基于ResNet-101和Faster R-CNN检测飞蛾与黄板蔬菜害虫,mAP达到87.14%。Li等[35]基于FasterR-CNN对储粮害虫等微小害虫进行检测,mAP达到了95.2%。

研究人员也提出了其他两阶段害虫智能视觉检测方法,Li等[36]先用区域建议网络和NMS生成感兴趣区域,然后用深度网络检测感兴趣区域中的害虫,仿真实验表明mAP达到了88.5%。Wang等[37]基于两阶段框架设计了一个级联害虫检测模型,先通过上下文感知注意网络对图像进行粗分类,然后用CNN检测图中害虫,实验结果优于先进的目标检测方法。Liu等[38]通过改进特征提取网络和分类回归网络提出一个新的两阶段害虫检测算法,在工业环境下mAP性能比Faster R-CNN高5.03%。

3.2 单阶段方法

两阶段检测方法检测精度虽高,但其计算成本也相应较高,因此研究人员开始基于单阶段方法研究害虫智能视觉检测方法。Ding等[39]基于全卷积CNN和滑动窗口提出多尺度害虫检测器,可用于检测诱捕器上捕捉到的飞蛾并进而实现飞蛾计数。这类方法具有显著的速度优势,但精度不如Faster R-CNN。后来出现的YOLO和SSD框架,都继承了这类方法的速度优势,并不断提升其检测精度。

Partel等[40]开发出一款农用摩托车自动捕获亚洲柑橘木虱,接着用YOLOv1和YOLOv3检测所拍摄图像中的亚洲柑橘木虱。Chen等[41]和Zha等[42]設计了基于YOLOv4的害虫检测系统,F1和mAP性能均超过了88%。Chen等[43]优化了YOLOv3,并结合无人机实现了果园害虫精准农药喷洒,不仅提高了作物产量,还减少了对环境的破坏。He等[44]基于改进的SSD提出了作物害虫检测方法。

两阶段和单阶段方法的基本框架分别如图1、图2所示,两种方法的最大区别在于是否包括生成区域建议的预处理步骤。两阶段方法识别精度较高但速度相对较慢,单阶段方法可以实现端对端、单阶段对害虫进行检测,极大地提高了运行速度,满足了实时监测的需求,但是检测精度一般比两阶段方法低。

目前,科研人员普遍采用基于深度学习的害虫智能视觉检测方法,主要从特征提取网络、候选框的选取、训练策略等方面对现有方法进行改进。在特征提取网络的选取上,两阶段方法会引入层数较深的网络,如ResNet、DenseNet,这些网络可以提取较高层的语义信息而不会出现梯度消失和梯度爆炸的问题,因此相比传统的VGG、GooLeNet更受欢迎;而单阶段方法则倾向于选择轻量级网络,如EfficientNet、MobileNet,便于在移动端上加速运行。而在候选框的选取上,大多数研究仍然采用基于NMS的方法,该方法原理简单,但是运算效率和定位准确性还有待提高。在训练策略方面,注意力机制逐渐得到应用,通过增强对空间、通道维度的关注来提升模型的检测效果;一些研究还通过使用数据增强、特征融合、困难样本挖掘等策略来学习丰富的语义特征和提高模型在多场景的检测性能。

4 存在问题

虽然基于经典机器学习的方法在害虫智能视觉检测上取得了不错的效果,但依然存在着一些尚未解决的问题,具体如下。

1) 人工设计特征算子难以捕获深层语义特征。不少研究人员基于Haar、HOG等人工特征设计了出了许多检测模型,这些方法可以较好地描述浅层特征,提升了害虫智能视觉检测的效果。但在实际应用场景下,由于人工设计的特征算子鲁棒性较差,常常会因为遮挡、光照、距离等因素导致难以提取到特征,且提取到的特征所包含的信息有限。

2) 数据量大时无法满足农业生产需要。近年来,研究人员通过改进特征提取器、分类器等在害虫智能视觉检测上取得了不错的进展,对数据量较少的害虫数据集具有良好的检测能力,但大部分是基于滑动窗口的区域选择方式导致检测效率低下,当害虫数据量较大、类别较多时则显示出计算能力的不足。因此,在时间消耗、内存使用、检测精度方面都面临巨大挑战,无法满足生产需要。

3) 方法过于简单易导致模型过拟合,且难以表达数据特征间的复杂关系。目前,虽然现有基于经典机器学习方法较多计算量小、结构简单、容易实现,但是这类方法学到的特征较难表达出复杂的关系。此外,由于训练效果受到模型初始化参数的影响较大,容易出现过拟合现象。

相比基于经典机器学习的方法,基于深度学习的害虫智能视觉检测方法拥有更高检测性能。然而,基于深度学习的害虫智能视觉检测方法仍然存在一些尚未解决的问题。

1) 训练数据和测试数据分布不同时效果不佳。目前,研究人员通过对现有基于深度学习方法的害虫智能视觉检测模型结构和训练策略进行改进和优化,在速度、精度上均取得了较大的进展。但现有的研究普遍采用有监督的学习方法,这类方法通常假设训练数据和测试数据是独立同分布的,然而现实中较难满足该前提,如同类害虫的不同图片因拍摄角度等关系变得不同。此外,测试图片里会出现与训练图片不同的新种类害虫。

2) 害虫目标在图像中占比小时较难识别。近几年来,不少研究人员基于公开或者构建的害虫数据库在害虫智能视觉检测方面取得了飞速的发展,现了害虫细粒度的检测。但多数情况下害虫在图像中的覆盖面积较小,而且害虫具有类间差异小而类内差异大的特点,仅有少数局部辨别性区域有助于细粒度检测,因此如何使模型以数据驱动方式从图像原始稀疏特征中自适应学到关键知识仍是一大挑战难题。此外,在自然环境中光照、模糊等复杂场景也会影响害虫细粒度检测的效果。

3) 检测精度和速度还有较大的提高空间。当前主流的基于深度学习的方法主要针对目标检测公共数据集。对于农业害虫智能视觉检测场景,由于虫情是动态变化的,因此对检测的实时性有较高的要求。此外,准确识别害虫并定位其位置有助于采取措施,实现精准防控,以免影响更大的范围。然而,随着害虫类别数和图像分辨率的增加、图像背景的复杂化,结构简单的网络不足以对害虫图像中蕴含的信息进行有效表达,从而导致害虫检测精度较低,较深的网络由于参数量的增加导致运行速度较慢,因此如何实现检测精度和运行速度的最佳平衡是目前亟需解决地难题。

5 展望

与基于经典机器学习的害虫智能视觉检测方法相比,基于深度学习的害虫智能视觉检测方法更具优势,未来在解决害虫智能视觉检测效果不佳、检测精度较低、模型鲁棒性较弱等问题上有着很大的潜力,具体可从以下4个方面进行考虑。

1) 制作完备的昆虫图像数据库。针对农业昆虫图像采集困难的问题,根据农业4.0模式对农机装备进行升级[45],如设计更适合在野外作业的智能机器人、采用高清摄像头采集害虫图像等,以此促进扩充农业昆虫图像资源,同时,对昆虫图像进行标注,建立相当规模的高质量标注昆虫数据库;制定合理数据管理策略,鼓励农业昆虫图像公共资源的共享。

2) 针对数据分布偏移进行鲁棒性处理。对于测试图像与训练图像里同类害虫不相似的问题,需要研究分布外泛化技术[46]。而对于可能突然出现训练集中未标注的新种类害虫的问题,需研究对比学习、孪生网络等开放世界视觉检测技术[47]。

3) 加强深度特征的学习。鉴于CNN等深度学习在多方面性能远超经典机器学习,应重点研究基于深度学习的害虫智能视觉检测方法。利用Vision Transformer等構建更优越的骨干网络使模型更好地从害虫图像辨别性区域中学习关键知识,当数据量较少时优先考虑基于迁移学习的检测方法,在一个训练好的初始参数上进行微调,可以大大提高害虫检测模型的性能。

4) 优化网络,提高多场景检测效果。为了更适应农业场景下的害虫检测需求,可以采用现有的技术来优化现有网络。例如,可以通过参数共享的方式提升骨干网络的处理效率,提升害虫检测运行速度;还可以采用数据增强技术来增加数据集的多样性,从而提高模型的泛化能力;同时,利用特征融合技术更好地捕捉害虫图像中的关键信息,进一步提升害虫检测的精确度。

6 结语

随着重大病虫疫情监测预警及防控服务体系覆盖到村级,对实现自动化、数字化、智能化监测预警和防控指导服务的需求越来越大,未来农业害虫智能视觉检测将起重要作用。

参 考 文 献

[1] 陈永宁, 周娜, 陈婕, 等. 我国蔬菜种业发展现状、融资结构及经营绩效研究[J]. 北方金融, 2023(2): 40-46.

[2] 中华人民共和国农业农村部. 2021年保护地蔬菜重要害虫生物防治技术方案[EB/OL]. http://www.moa.gov.cn/gk/nszd_1/2021/202103/t20210311_6363457.htm, 2021-03-11.

[3] Liu L, Ouyang W, Wang X, et al. Deep learning for generic object detection: A survey [J]. International Journal of Computer Vision, 2020, 128(2): 261-318.

[4] 周志华. 机器学习[M]. 北京: 清华大学出版社, 2018.

[5] 韩瑞珍. 基于机器视觉的农田害虫快速检测与识别研究[D]. 杭州: 浙江大学, 2014.

Han Ruizhen. Research on fast detection and identification of field pests based on machine vision [D]. Hangzhou: Zhejiang University, 2014.

[6] Yao Q, Xian D, Liu Q, et al. Automated counting of rice planthoppers in paddy fields based on image processing [J]. Journal of Integrative Agriculture, 2014, 13(8): 1736-1745.

[7] Yao Q, Chen G, Wang Z, et al. Automated detection and identification of white-backed planthoppers in paddy fields using image processing [J]. Journal of Integrative Agriculture, 2017, 16(7): 1547-1557.

[8] 杨国国. 基于机器视觉的中华稻蝗早期蝗蝻的识别和检测研究[D]. 杭州: 浙江大学, 2017.

Yang Guoguo. The research of recognition and detection of oxya chinensis larva based on computer vision [D]. Hangzhou: Zhejiang University, 2017.

[9] 田冉, 陈梅香, 董大明, 等. 红外传感器与机器视觉融合的果树害虫识别及计数方法[J]. 农业工程学报, 2016, 32(20): 195-201.

Tian Ran, Chen Meixiang, Dong Daming, et al. Identification and counting method of orchard pests based on fusion method of infrared sensor and machine vision [J]. Transactions of the Chinese Society of Agricultural Engineering, 2016, 32(20): 195-201.

[10] Rustia D J A, Lin C E, Chung J Y, et al. Application of an image and environmental sensor network for automated greenhouse insect pest monitoring [J]. Journal of Asia-Pacific Entomology, 2019, 23(1): 17-28.

[11] 肖德琴, 張玉康, 范梅红, 等. 基于视觉感知的蔬菜害虫诱捕计数算法[J]. 农业机械学报, 2018, 49(3): 51-58.

Xiao Deqin, Zhang Yukang, Fan Meihong, et al. Vegetable pest counting algorithm based on visual perception [J]. Transactions of the Chinese Society for Agricultural Machinery, 2018, 49(3): 51-58.

[12] 卜俊怡, 孙国祥, 王迎旭, 等. 基于诱虫板图像的温室番茄作物害虫识别与监测方法[J]. 南京农业大学学报, 2021, 44(2): 373-383.

Bu Junyi, Sun Guoxiang, Wang Yingxu, et al.Identification and monitoring method of tomato crop pests in greenhouse based on trapping board image [J]. Journal of Nanjing Agricultural University, 2021, 44(2): 373-383.

[13] 邹修国, 丁为民, 刘德营, 等. 基于4种不变矩和BP神经网络的稻飞虱分类[J]. 农业工程学报, 2013, 29(18): 171-178.

Zou Xiuguo, Ding Weimin, Liu Deying, et al. Classification of rice planthopper based on invariant moments and BP neural network [J]. Transactions of the Chinese Society of Agricultural Engineering, 2013, 29(18): 171-178.

[14] 李震, 鄧忠易, 洪添胜, 等. 基于神经网络的实蝇成虫图像识别算法[J]. 农业机械学报, 2017, 48(S1): 129-135.

Li Zhen, Deng Zhongyi, Hong Tiansheng, et al. Image recognition algorithm for fruit flies based on bp neural network [J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(S1): 129-135.

[15] 李震, 洪添胜, 曾祥业, 等. 基于K-means聚类的柑橘红蜘蛛图像目标识别[J]. 农业工程学报, 2012, 28(23): 147-153, 299.

Li Zhen, Hong Tiansheng, Zeng Xiangye, et al. Citrus red mite image target identification based on K-means clustering [J]. Transactions of the Chinese Society of Agricultural Engineering, 2012, 28(23): 147-153, 299.

[16] 王志彬, 王开义, 张水发, 等. 基于K-means聚类和椭圆拟合方法的白粉虱计数算法[J]. 农业工程学报, 2014, 30(1): 105-112.

Wang Zhibin, Wang Kaiyi, Zhang Shuifa, et al.Whiteflies counting with K-means clustering and ellipse fitting [J]. Transactions of the Chinese Society of Agricultural Engineering, 2014, 30(1): 105-112.

[17] 李季, 杨淑婷, 马菁. 基于计算机视觉的枸杞虫害计数方法研究[J]. 宁夏农林科技, 2018, 59(10): 50-52.

Li Ji, Yang Shuting, Ma Jing. Counting method of wolfberry pests based on computer vision [J]. Ningxia Journal of Agriculture and Forestry Science and Technology, 2018, 59(10): 50-52.

[18] Krizhevsky A, Sutskever I, Hinton G E. ImageNet classification with deep convolutional neural networks [C]. Curran Associates Inc. International Conference on Neural Information Processing Systems, 2012.

[19] Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition [J]. arXiv Preprint, 2014: 1409.1556.

[20] Szegedy C, Liu W, Jia Y, et al. Going deeper with convolutions [C]. CVPR. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, 2015: 1-9.

[21] He K, Zhang X, Ren S, et al. Deep residual learning for image recognition [C]. CVPR. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, 2016: 770-778.

[22] Tan M, Le Q V. EfficientNetV2: Smaller models and faster training [J]. ArXiv Preprint, 2021: 2104.00298v3.

[23] Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation [C]. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2014: 580-587.

[24] Girshick R. Fast R-CNN [C]. Proceedings of the IEEE International Conference on Computer Vision (ICCV), 2015: 1440-1448.

[25] Ren S, He K, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks [C]. Proceedings of Advances in Neural Information Processing Systems 2015, 2015: 91-99.

[26] Redmon J, Divvala S, Girshick R, et al. You only look once: Unified, real-time object detection [C]. Proceedings of the 29th IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR), 2015: 779-788.

[27] Liu W, Anguelov D, Erhan D, et al. SSD: Single shot multibox detector [C]. Proceedings Lecture Notes in Computer Science. Computer Vision-14th European Conference (ECCV 2016), 2016: 21-37.

[28] Liu Z, Gao J, Yang G, et al. Localization and classification of paddy field pests using a saliency map and deep convolutional neural network [J]. Scientific Reports, 2016, 6: 20410.

[29] 楊国国, 鲍一丹, 刘子毅. 基于图像显著性分析与卷积神经网络的茶园害虫定位与识别[J]. 农业工程学报, 2017, 33(6): 156-162.

Yang Guoguo, Bao Yidan, Liu Ziyi. Localization and recognition of pests in tea plantation based on image saliency analysis and convolutional neural network [J]. Transactions of the Chinese Society of Agricultural Engineering, 2017, 33(6): 156-162.

[30] Jiao L, Dong S, Zhang S, et al. AF-RCNN: An anchor-free convolutional neural network for multi-categories agricultural pest detection [J]. Computers and Electronics in Agriculture, 2020, 174: 105522.

[31] Dong S, Wang R, Liu K, et al. CRA-Net: A channel recalibration feature pyramid network for detecting small pests [J]. Computers and Electronics in Agriculture, 2021, 191: 106518.

[32] Wang R, Jiao L, Xie C, et al. S-RPN: Sampling-balanced region proposal network for small crop pest detection [J]. Computers and Electronics in Agriculture, 2021, 187: 106290.

[33] Shen Y, Zhou H, Li J, et al. Detection of stored-grain insects using deep learning [J]. Computers and Electronics in Agriculture, 2018, 145: 319-325.

[34] 肖德琴, 黄一桂, 张远琴, 等. 基于改进Faster R-CNN的田间黄板害虫检测算法[J]. 农业机械学报, 2021, 52(6): 242-251.

Xiao Deqin, Huang Yigui, Zhang Yuanqin, et al. Pest detection algorithm of yellow plate in field based on improved Faster R-CNN [J]. Transactions of the Chinese Society for agricultural Machinery, 2021, 52(6): 242-251.

[35] Li W, Wang D, Li M, et al. Field detection of tiny pests from sticky trap images using deep learning in agricultural greenhouse [J]. Computers and Electronics in Agriculture, 2021, 183: 106048.

[36] Li W, Chen P, Wang B, et al. Automatic localization and count of agricultural crop pests based on an improved deep learning pipeline [J]. Scientific Reports, 2019, 9: 7024-7033.

[37] Wang F, Wang R, Xie C, et al. Fusing multi-scale context-aware information representation for automatic in-field pest detection and recognition[J]. Computers and Electronics in Agriculture, 2020, 169: 105222.

[38] Liu L, Xie C, Wang R, et al. Deep learning based automatic multiclass wild pest monitoring approach using hybrid global and local activated features [J]. IEEE Transactions on Industrial Informatics, 2020, 17(11): 7589-7598.

[39] Ding W, Taylor G. Automatic moth detection from trap images for pest management [J]. Computers and Electronics in Agriculture, 2016, 123: 17-28.

[40] Partel V, Nunes L, Stansly P, et al. Automated vision-based system for monitoring Asian citrus psyllid in orchards utilizing artificial intelligence [J]. Computers and Electronics in Agriculture, 2019, 162: 328-336.

[41] Chen J, Lin W, Cheng H, et al. A smartphone-based application for scale pest detection using multiple-object detection methods [J]. Electronics, 2021, 10(4): 372.

[42] Zha M, Qian W, Yi W, et al. A lightweight YOLOv4-based forestry pest detection method using coordinate attention and feature fusion [J]. Entropy, 2021, 23(12): 1587.

[43] Chen C J, Huang YY, Li Y S, et al. Identification of fruit tree pests with deep learning on embedded drone to achieve accurate pesticide spraying [J]. IEEE Access, 2021, 9: 21986-21997.

[44] He Y, Zeng H, Fan Y, et al. Application of deep learning in integrated pest management: A real-time system for detection and diagnosis of oilseed rape pests [J]. Mobile Information Systems, 2019, 2019: 1-14.

[45] 吳丽芳. 基于智慧时代的农业4.0模式及发展策略研究[J]. 农业经济, 2021(5): 9-11.

[46] Shen Z, Liu J, He Y, et al. Towards out-of-distribution generalization: A survey [J]. arXiv Preprint, 2021: 2108.13624.

[47] Joseph K J, Khan S, Khan F S, et al. Towards open world object detection [C]. Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2021: 5830-5840.