Harris与SURF特征点检测的手术器械机器视觉识别方法*

陈贤儿,梁 丹,傅云龙,梁冬泰,刘 涛

(宁波大学 机械工程与力学学院,浙江 宁波 315211)

0 引 言

随着科技进步,机器人应用的领域越来越来越广泛[1]。在医疗领域,外科手术器械护士机器人能够完成对手术器械的识别、拾取、传递以及回收手术器械的任务,减轻器械护士的工作负担,减少医护人员在手术中感染疾病的风险。目前,器械护士机器人多利用存放位置的编码信息,仅可对固定位置器械进行存放和拿取,无法灵活实现手术器械的识别、定位和存取[2,3]。

近年来,机器视觉技术在工业零部件缺陷检测方面得到广泛应用,展现出较好的检测效果和应用价值[4]。将机器视觉技术用于手术器械的识别与定位,将有助于提高器械护士机器人的灵活性和适应性。在基于机器视觉的目标识别与定位方面,国内外许多研究学者开展了一系列相关研究。例如,俞辉等人[5]提出了一种基于轮廓特征的图像拼接算法,用形状签名代替链码来描述轮廓,提高了计算速度,降低由噪声干扰和镜头形变造成的影响。谢昕等人[6]提出了一种基于压缩感知的SIFT图像匹配算法,利用压缩感知技术,结合SIFT算法提取图像的特征点进行图像快速匹配搜索,找到最佳匹配位置。Zhang N L等人[7]使用采用模糊K-means算法对SIFT算法进行改进,能够保持较高的图像匹配精度。蔡慧英等人[8]提出了一种仿射变换下基于凸包和多尺度积分特征的形状匹配方法,适用于复杂形状的匹配。上述方法中,基于轮廓以及凸包的方法虽然能够提升运算的效率与速度,但存在鲁棒性较差的问题,容易受到外界因素的干扰。基于SIFT算子的方法虽然能够提升局部特征的匹配准确率,但存在计算时间较长的缺点。

针对手术器械快速识别以及定位需求,本文提出一种基于Harris与SURF特征点检测的手术器械视觉检测方法。搭建手术器械机器视觉检测平台,通过视觉识别与定位实验对本文方法的有效性进行验证。

1 方 法

基于机器视觉的手术机械识别与分类方法的流程,如图1所示。1)通过形态学操作以及MASK匀光校正算法对采集的手术器械图像进行预处理,消除噪声和由于手术器械金属表面光泽反射造成的干扰。2)通过改进的基于几何映射的Harris角点检测算法实现无堆叠手术器械的匹配,并通过基于轮廓的质心法进行定位。3)通过基于SURF特征+FLANN搜索的匹配算法实现堆叠手术器械的匹配。4)通过基于SURF特征点的质心定位方法对堆叠手术器械进行定位。

图1 本文算法总体流程

1.1 图像预处理

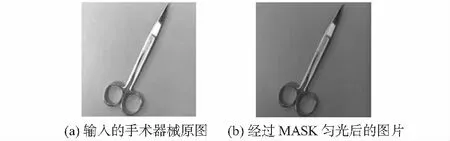

在图像获取过程中,由于外部光照不均、血污以及图像传输等因素造成的噪音和干扰,会影响成像质量的好坏,从而直接影响识别效果。为减少由金属器械光照反射对边缘轮廓提取的影响,对被采集图像进行MASK匀光亮度校正处理[9],如图2所示。

图2 MASK匀光算法处理示意

1.2 基于几何映射的Harris角点检测改进算法

Harris角点检测算法是通过图像的相关性及微分运算来计算特征点,具有旋转不变性以及高准确度等特点[10]。通过固定窗口在输入图像中进行任意方向滑动,对比滑动前后窗口内的灰度变化,进而确定窗口内是否存在角点。窗口内像素点灰度变化描述如下

(1)

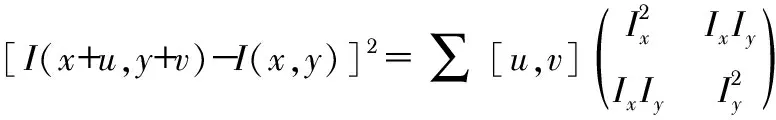

式中 (u,v)为窗口偏移量;(x,y)为窗口内像素点的坐标值;w(x,y)为窗口函数。将E(u,v)进行泰勒展开如下

(2)

即E(u,v)表达式为

(3)

其中,M为

(4)

式(3)为二次项函数,通过对比M矩阵的特征值λ1、λ2确定是否存在角点。当λ1,λ2均为较小值时,说明像素点所在区域为“平坦区域”;当λ1,λ2为一小一大时,说明像素点处于图像边界上;当λ1、λ2均为较大值且近似相等时,则说明像素点所在区域为角点。定义角点响应函数R如下

R=detM-K(traceM)2,detM=λ1λ2,traceM=λ1+λ2

(5)

式中 detM为矩阵M的行列式值,traceM为矩阵M的迹,K为经验常数。当R(x,y)大于设置的阈值时,则判定该像素点(x,y)为角点。

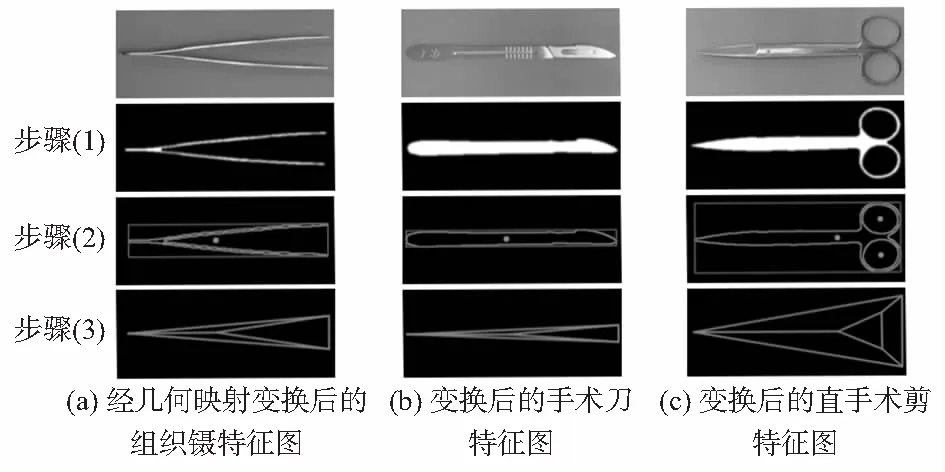

Harris角点提取的效果完全依赖于单阈值的设定。若阈值较大,会失去部分角点信息;若阈值较小,则会产生许多伪角点,并且加大算法的计算量。在现实场景的噪声干扰下,也易出现误匹配的现象,不利于实时角点匹配以及定位的要求。对此,本文设计一种基于几何映射的Harris角点匹配算法。1)通过K-means聚类分割提取背景轮廓,得到背景遮罩。2)使用Canny边缘检测算法提取遮罩边缘轮廓,提取轮廓质心,并构建轮廓最小外接矩形。3)连接轮廓质心、外接矩形远质心端端点和近质心短边中点,构建新的几何特征,建立轮廓与几何特征的映射关系。4)通过Harris角点检测算法对新的几何特征进行检测与匹配。

Harris角点检测算法示意如图3所示。

图3 改进的基于几何映射的Harris角点检测算法示意

1.3 基于SURF算子的堆叠手术器械检测

本文设计改进的Harris角点检测算法主要基于图像轮廓质心,在面对堆叠物体的情况下易构建出错误的几何特征,进而影响识别效果。本文设计基于SURF算子的特征匹配方法以有效检测器械的堆叠,主要包括以下6个步骤:SURF特征点检测、构建尺度空间、特征点定位、选取特征点方向、生成特征点描述子和FLANN特征匹配。

1.3.1 SURF特征点检测

Hessian矩阵是SURF算子的核心,计算Hessian矩阵的极值来获得稳定点,通过矩阵行列式的最大值来确定特征点的位置。设图像为f(x,y),则其图像上的像素点的Hessian矩阵可表示为

(6)

Hessian矩阵的判别式为

(7)

特征点需要具备尺度无关性,在构造Hessian矩阵前需进行高斯滤波,如下所示

(8)

为提高运算速度,采用盒式滤波器来代替高斯滤波器在x,y,xy这3个方向的近似值[11],并分别记为Lxx,Lyy,Lxy,则Hessian矩阵判别式的近似计算可以表示为

det(H)=LxxLyy-(0.9Lxy)2

(9)

当Hessian矩阵的判别式在局部取极大值时,说明其像素点在周围区域内更亮或更暗,从而定位出兴趣点的位置。

1.3.2 尺度空间构建与特征点定位

在SURF算法中,保持高斯模板不变,通过对目标图像进行降采样得到多幅图像,并利用图像金字塔计算得到其差分图像[12]。在图像不同尺寸中定位特征点,需选择合适的阈值。采用3×3×3邻域进行非最大值抑制,对选出的兴趣点采用3维线性插值法得到亚像素级的特征点。

1.3.3 生成特征点描述子与FLANN特征匹配

通过计算出特征点的位置与主方向,在局部区域内生成特征点描述子。由于SURF特征向量的高维空间计算量较大,目前相对有效的方法是采用FLANN算法中的KD-TREE进行高速匹配。本文采用文献[13]的基于随机抽样一致性(random sample consensus,RANSAC)算法删除错误匹配点,可处理错误率超过50 %的匹配对,进而提高匹配的鲁棒性并减少错匹配点。图4为目标物体与匹配图像。

图4 目标物体与左图像的匹配

1.4 目标定位

对于无堆叠的手术器械,可直接提取外部轮廓的质心作为定位坐标点。而堆叠的手术器械轮廓难以确定质心,本文采用基于SURF特征点的质心定位方法进行计算。

1)提取模板图像的质心(rchar,cchar),计算各个邻近SURF特征点之间和特征点与模板质心之间的距离

(10)

式中r为模板图像特征点与模板图像质心的距离,l为模板SURF特征点与邻近特征点的距离。[r,c]为模板图像SURF特征点坐标数组。

2)计算待定位目标各个邻近SURF特征点之间的距离Li,并计算模板特征点距离的比值ki,通过票选法得到通用比例系数K

(11)

3)待定位目标内的任意SURF特征点坐标与其质心点坐标(x,y)关系可用如下矩阵形式描述

(12)

2 实验结果与分析

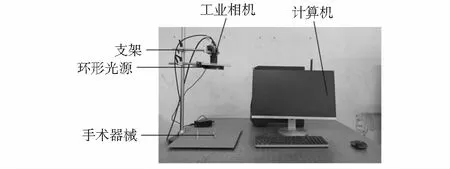

利用工业相机拍摄的100张随机组合摆放的手术器械图片进行识别实验。实验平台如图5所示,由工业相机、环形光源和计算机组成。其中,工业相机为海康威视MV—CE120—10GM/GC,最大分辨率为4 024×3 036;镜头型号为WL281236—5MP—2;环形光源型号为CCSCHPR—100SE。检测目标手术器械如图6所示。

图5 实验平台

图6 目标手术器械

通过Visual Studio 2019、OpenCV 3.4.1进行算法编程实验,并将本文方法与Harris角点检测、SIFT算法、文献[14]和文献[15]进行比对。采用手术器械中常见的直手术剪、组织镊和手术刀等进行识别实验。采用查准率ρ、查全率φ和算法时间T来测试算法性能ρ=IT/IA,φ=IT/WT。其中,IT为识别目标器械数量,IA为识别器械的数量,WT为待匹配器械中目标器械的数量。

如表1所示,本文平均查准率和平均查全率分别为90.2 %和92.4 %,算法平均匹配时间为3.15 s。可取得较好的识别效果和识别速度。

表1 5种图像匹配方法性能比较

由表2中数据分析可知,文献[16]直接提取轮廓外接矩形中心进行定位,平均消耗时间最短,但无法处理堆叠图像,其平均定位准确率最低。文献[17]通过仿射变换提取的匹配点个数较多,准确率较高,但平均消耗时间过长。本文方法提取的匹配点个数适中,匹配率较高、耗时较少,平均匹配点数为21.8对,平均定位准确率为93.2 %,算法平均消耗时间为1.61 s。

表2 3种定位方法性能比较

3 结 论

本文提出一种基于Harris和SURF特征点的手术器械视觉识别与定位方法。针对Harris角点检测算法依赖于单阈值设定的问题,构造目标器械的全局特征,采用改进的Harris角点检测算法实现无堆叠手术器械的快速识别。利用 SURF 算法提取图像特征信息,采用KD-Tree搜索相似的特征矢量,通过SURF特征点实现堆叠手术器械的快速识别与定位。实验结果表明:本文方法的识别准确率和识别时间分别为92.4 %和3.15 s。本文提出的手术器械机器视觉检测方法,识别效果和稳定性好,可应用于手术器械的快速识别与定位。