中国人微渐变情绪面孔库的建立及分析评估

郑飞宇,冯正直

(1.解放军第94833部队医院,南昌 332100;2.陆军军医大学医学心理系,重庆 400038)

人常说:“月有阴晴圆缺,人有喜怒哀乐。”可以说情绪与生俱来,又无时无刻不在影响着人们,在我们的日常生活和工作中扮演着举足轻重的角色。情绪是包含神经系统在内的多个系统综合作用的结果,也是感知觉、记忆、思维等多个认知过程整合作用的结果,是人对环境与自身需要之间关系的评价产物。情绪既包括认知评价后的主观感受,也包括由此引起的生理反应和外部表现,后者即是我们常说的表情。表情包含面部表情、姿态表情和语调表情,其中面部表情是最直接也最基本的表达方式之一(彭聃龄,2012)。古诗云:“嬉笑怒骂皆传情,一颦一嗔总是诗。”达尔文也早在1872年就提出了面部表情在人类社交活动中起着至关重要的作用,是人类适应社会的基本功能(Charles et al.,1956)。心理学家Mehrabian认为面部表情在情绪表达上所占的作用达到55%以上(Wu et al.,2005)。可见,面部表情是人类进行信息沟通传递的重要途径,人们既可以通过面部表情来表达自己的态度和情感,也可以通过观察对方的面部表情来了解和判断对方的意图和情绪。因此,面部表情一直被研究者们公认为是情绪认知研究的重要刺激材料,这不仅因为面部表情在人类社交活动中的重要性,也因为面部表情能较好地诱导被试的情绪,且其刺激相对纯净,便于操控(乐洪波 等,2009)。

正因为面部表情作为研究刺激材料的种种优点,心理学家们从上世纪70年代起,开始一系列标准化的面孔情绪刺激材料的创建,其中不能不提的就是表情研究的先驱和专家Ekman及其团队创建的IAPS(Bradley &Lang,2007;Limbrecht-Ecklundt et al.,2013)。然而多项研究发现,不同种族和文化背景的人们在情绪加工上存在显著差异(Grossmann et al.,2012;Marsh et al.,2003;Okazaki et al.,2002;Riley et al.,2002;Yan et al.,2016;杨红升,黄希庭,2008)。因此,本世纪初开始,中国的科学家们也开始进行本土化表情图片系统的创建和研究,其中被应用最为广泛的是罗跃嘉等人创建的中国面孔表情图片系统(龚栩 等,2011)。这些本土化的情绪刺激材料被广泛应用于中国人的情绪认知研究中,但研究者们在使用这些材料的同时也发现了一些不足之处,比如缺乏同一面孔的多种情绪类型图片,或者即使有同一面孔的某类情绪图片,也缺乏其不同强度或不同愉悦度的序列图片(刘静 等,2019;赵艳丽 等,2020)。而有研究发现即使相同情绪强度的刺激材料,如果愉悦度不同,不仅其诱导的主观体验不同、生理唤醒不同,而且被试对之的识别正确率和认知倾向均有显著差异,尤其对于情绪障碍个体,愉悦度指标相较于情绪强度更敏感(滕腾 等,2007)。因此,我们拟创建一个能呈现同一个人从中性情绪向各种情绪转变的不同情绪愉悦度等级的动态图片系统,以增加情绪面孔刺激材料在研究应用中的生态效度,进一步丰富中国人情绪研究刺激材料。为情绪认知研究尤其是情绪障碍病人的甄别和预测提供有效的标准化工具。

1 对象与方法

1.1 研究对象

1.1.1 面部表情表演组为重庆市某高校表演系在校学生,共20人,其中男10人,女10人,年龄18~22岁,平均年龄(19.16±1.119)岁,身体健康,无精神疾患及重大心理问题。表演前告知实验内容,并获得知情同意。

1.1.2 面部表情评定者为重庆市另一所高校的在校学生,共84人,年龄18~23岁,平均年龄(21.04±1.041)岁,身体健康,无精神疾患及家族史,视力或矫正视力正常。评定前告知实验内容,并获得知情同意,实验后付报酬。

本研究实施前已预先通过陆军军医大学伦理委员会审核,所有被试实验前均已知情同意。

1.2 研究材料

1.2.1 情绪面孔图片的制备

每种情绪表演前让表演者充分想象诱发这种情绪的场景,并给予表演者充足的时间酝酿情绪;表演时并不指导他们应该做怎样的面部动作,只是提示他们表现出相应的表情,该方法已被证明是一种采集情绪面孔图片的有效方法(龚栩 等,2011)。情绪诱导方法并未采用JAFFE表情数据库样本示例(Lyons et al.,1999)和相应表情的面部肌肉动作指导语(Cohn et al.,2007),原因是考虑到不同种族不同文化群体具有表情特异性(Srinivasan &Martinez,2018;Tang et al.,2011),西方白人的表情指导并不一定适合中国人的情绪表达。

让每位表演者分别表演出开心、悲伤、厌恶、恐惧、愤怒、惊奇、平静7种基本面部表情,除平静表情外的其它6种表情以低、中、高3个强度等级进行表演,每种情绪的同一强度等级拍摄8张。同一名专业人像摄影师使用同一台数码相机,在同一白色背景、相同光线条件下进行拍摄。拍摄前,将表演者的头发刘海及耳边碎发等都用发箍或发夹梳上去,保证整个面部(包括额头、眉毛、眼睛、耳朵、鼻子、嘴巴)无遮挡,并摘掉配饰(包括眼镜、耳环、项链等),仅拍摄颈部以上区域。所有拍摄统一用图片处理系统PhotoshopCC2017进行处理,抠除头发、耳朵和颈部等外部特征后只保留完整面部区域。并采用黑白图片,统一为分辨率2904×3744像素,共得到情绪面孔图片3040张。

1.2.2 情绪面孔图片的筛选

先请本课题组参与拍摄过程的5名成员根据图片拍摄质量的好坏、图片是否具有明确的情绪及表情表演者的自我反馈对收集到的图片进行初步筛选,得到情绪面孔图片2221张。然后由未参与拍摄的4名心理学专业研究生(男:女=1:1)依据图片对所代表的情绪类型是否具有代表性和每名表演者的不同表情是否具有情绪强度的低中高三个等级进行再次筛选,最终筛选出图片1133张(要求表演类型分别为愤怒179张,厌恶180张,恐惧178张,快乐179张,悲伤178张,惊奇179张,平静60张)。

1.2.3 评价手册的制作

研究对筛选出的1133张图片进行了认可率和唤醒度、愉悦度、优势度的评定。评定方式是采取自评模式,评分者根据看到图片时的即时感受判断面部表情图片的情绪类型,并采用瑟斯顿式9点量表对每张表情图片进行唤醒度、愉悦度和优势度的评分(1为最弱,9为最强)。认可率:是指评定某图片为某特定情绪的人数占总评分人数的百分比。唤醒度:图片所表现的情绪强烈程度,情绪越弱,评分越接近1;情绪越强,评分越接近9。愉悦度:图片让评分者感受到的愉快程度,评分越接近9越愉快;评分越接近1越不愉快。优势度:评分者对图片影响的控制程度,评分越接近9,评分者对图片影响的控制程度越高;评分越接近1,评分者对图片影响的控制程度越低。

1.3 评价测试实施

用Eprime2.0软件编制程序呈现图片,图片大小统一为2904像素×3744像素。呈现图片的电脑显示器对比度、亮度、色彩均统一设置。图片呈现时,请评定者以评价手册为标准,根据自己的即时感受对图片进行情绪类型的判断和情绪唤醒度、愉悦度和优势度的9点量表评分。图片呈现时间由评分者掌握,每完成一张图片的情绪类型分类和三维度评分后,程序会自动转到下一张图片,要求评分者以即时感受判断,不做长时间思考。正式实验前对评分者进行举例讲解并安排练习,练习的图片来自罗跃嘉表情库(龚栩 等,2011),每种情绪类型一张,共7张。目的在于帮助被试了解实验流程和评分标准。正式实验时,每100张图片休息一次。为避免疲劳对实验结果的影响,实验共分4次进行,分别为判断情绪类型、唤醒度评分、愉悦度评分和优势度评分。同一评分者的4次实验在一天内完成。另外,从除平静表情外(考虑到平静表情在情绪类型判断上容易产生歧义)的所有图片中,每种情绪类型图片随机选出6张(共36张),复制后以随机顺序混入图片识别实验程序中作为评分稳定性指标。

1.4 统计分析

所有数据用SPSS 20.0统计软件包进行统计分析,统计方法采用描述统计分析,独立样本t检验,单因素方差分析等。

1.5 图组排列标准

将筛选出的所有合格图片按同一表演者同一情绪类型分组,在正性情绪的图组内从平静表情按愉悦度数值从低往高排序,在负性情绪图组内从平静表情按愉悦度数值从高往低排序。

2 研究结果

2.1 评分稳定性筛选

将评分者对36张重复呈现的图片的情绪类型前后判断一致的图片所占比例作为判断评分者认真完成实验的指标。剔除一致率在0.6以下的评分者,共13人。得到71名评分者的有效数据。

2.2 各情绪类型面孔图片的的认同率

认同率标准是指参评人中认同某图片为某特定情绪类型的人数占评分者总人数的百分比。有效数据表明,评分者对快乐表情的认同率最高,79.3%的快乐表情图片认同率达到80%以上;而厌恶和恐惧表情的认同率在50%以下的图片最多(见表1)。快乐表情的认同率绝大多数都很高的原因与评分者都是健康人群有关,也与既往相关研究结果相符;厌恶、恐惧表情的认同率多集中在低分段的原因与这两种表情属于比较复杂的情绪有关,也与既往研究结果相符。

表1 稳定性筛选后的各类情绪图片在不同认可率分数段所占百分比%

2.3 各情绪类型面孔图片的强烈程度分析

在1133张图片中选出认同率70%以上的图片(平静表情图片的认同率60%以上即可)。筛选平静表情图片的认可率低于其它情绪类型的表情图片,是考虑到平静表情的情绪强度低于其它情绪类型,容易产生歧义,而且此标准亦为既往相似研究常用(龚栩 等,2011;刘明矾 等,2012)。按此标准筛选后共得到图片603张,其中愤怒86张,厌恶54张,恐惧2张,快乐165张,悲伤135张,惊奇54张,平静107张。平静表情的情绪唤醒度平均值最低,明显低于其他情绪类型,且其标准差远小于其它情绪类型,说明平静表情的情绪唤醒度分数最为集中,且集中于低强度区域,符合预期且说明筛选出的图片具有较高的可靠性。剩余的6种情绪类型图片中,除选出的恐惧表情过少(仅2张)不方便进行统计分析外,其它情绪类型图片的强度分值域分布较宽,涵盖了从低强度到高强度全域(具体见表2),这与我们的研究选取低中高3个情绪强度等级进行拍摄的情况基本相符。

表2 达到认可率筛选标准的图片表情强度描述统计结果

我们对比了男女表演者的图片被筛选出来的选出率(男52%,女54.1%),不同性别间没有显著差异(χ2=0.509,p=0.476)。

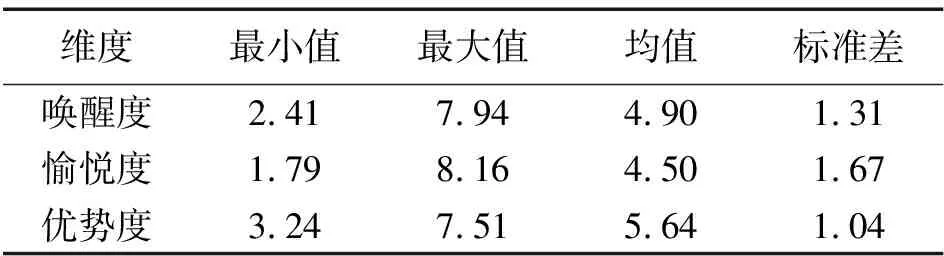

2.4 情绪三维度的描述统计分析

对最终筛选出的603张图片进行唤醒度、愉悦度、优势度的描述性统计分析,可以看出唤醒度和优势度的标准差比愉悦度小,说明愉悦度评分分值分布更广,且均值最小(见表3),这与以往研究结果一致(刘明矾 等,2012)。

表3 603张图片情绪三维度评分的描述性统计分析

然后针对各情绪类型图片分别进行情绪三维度的分析,数据见表4。表中可见,快乐表情的数量最多,其唤醒度和愉悦度最高,优势度最低;而平静表情的唤醒度最低且优势度最高。说明快乐表情感染力更强,对评分者情绪的影响更大,而平静表情则对评分者情绪的影响最小。

表4 各情绪类型面孔图片的三维度分析

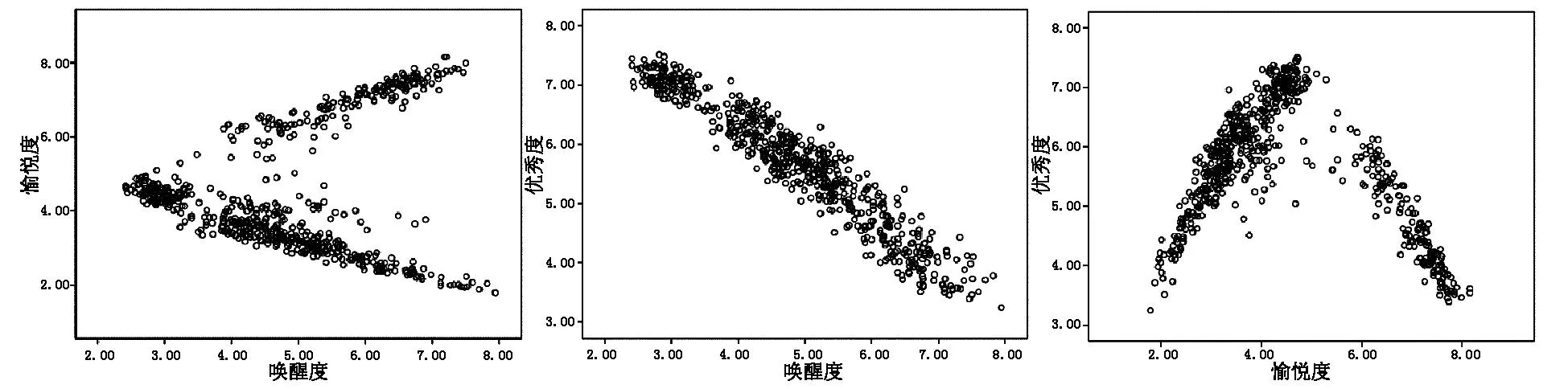

为了进一步说明三个情绪维度之间的关系,我们做了三者两两之间的分布散点图。结果发现唤醒度与愉悦度成以愉悦度约4.5为对称轴的侧V型关系。当愉悦度大于4.5时,愉悦度与唤醒度呈高度正相关(r=0.954,p<0.01);当愉悦度小于4.5时,愉悦度与唤醒度呈高度负相关(r=-0.861,p<0.01)。优势度与愉悦度以愉悦度约4.5为对称轴呈倒V型关系。当愉悦度大于4.5时,愉悦度与优势度呈高度负相关(r=-0.959,p<0.01);当愉悦度小于4.5时,愉悦度与优势度呈高度正相关(r=0.874,p<0.01)。唤醒度与优势度呈负相关,说明随唤醒度的增加,评分者对图片影响的控制程度降低,更容易被图片影响。详见图1。

图1 情绪唤醒度、愉悦度、优势度两两之间的散点图

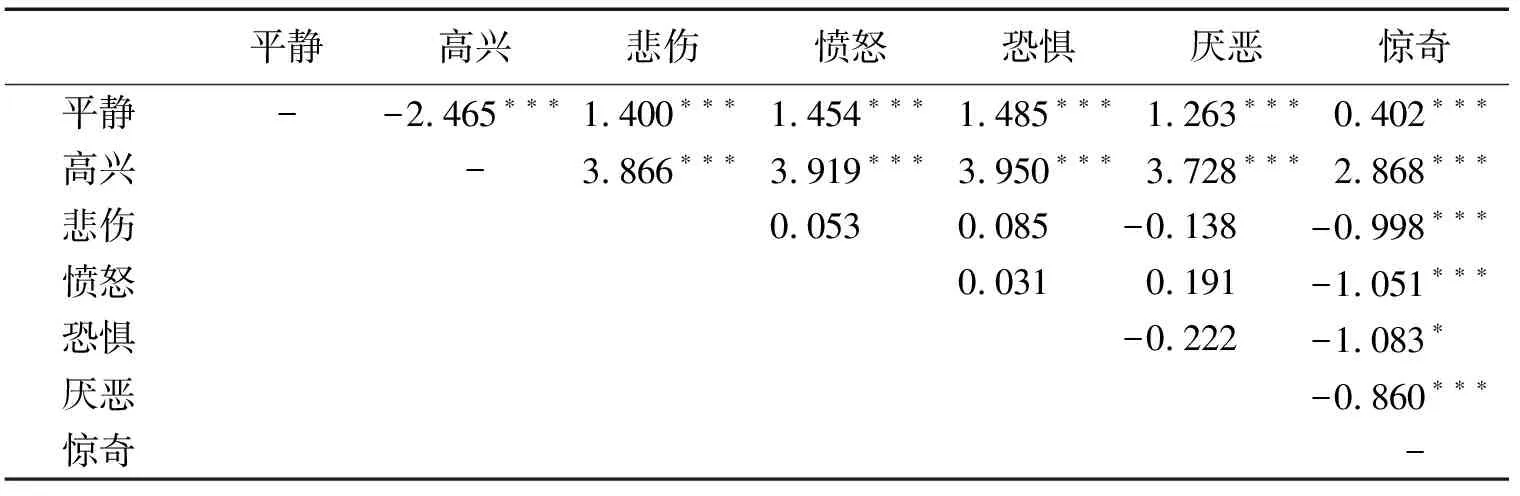

2.5 不同情绪效价图片的评分差异

按照日常生活对情绪效价的常识,我们将愤怒、厌恶、恐惧、悲伤归为负性表情,快乐表情归为正性表情,平静表情归为中性表情。为检验这种分类的有效性,我们对7类表情的愉悦度进行单因素方差分析,结果表明中性表情、快乐表情和惊奇表情与各类负性情绪之间两两差异显著,而各类负性情绪之间的愉悦度无显著差异,说明我们的分类有效(见表5)。

表5 各情绪类型图片的愉悦度差异分析

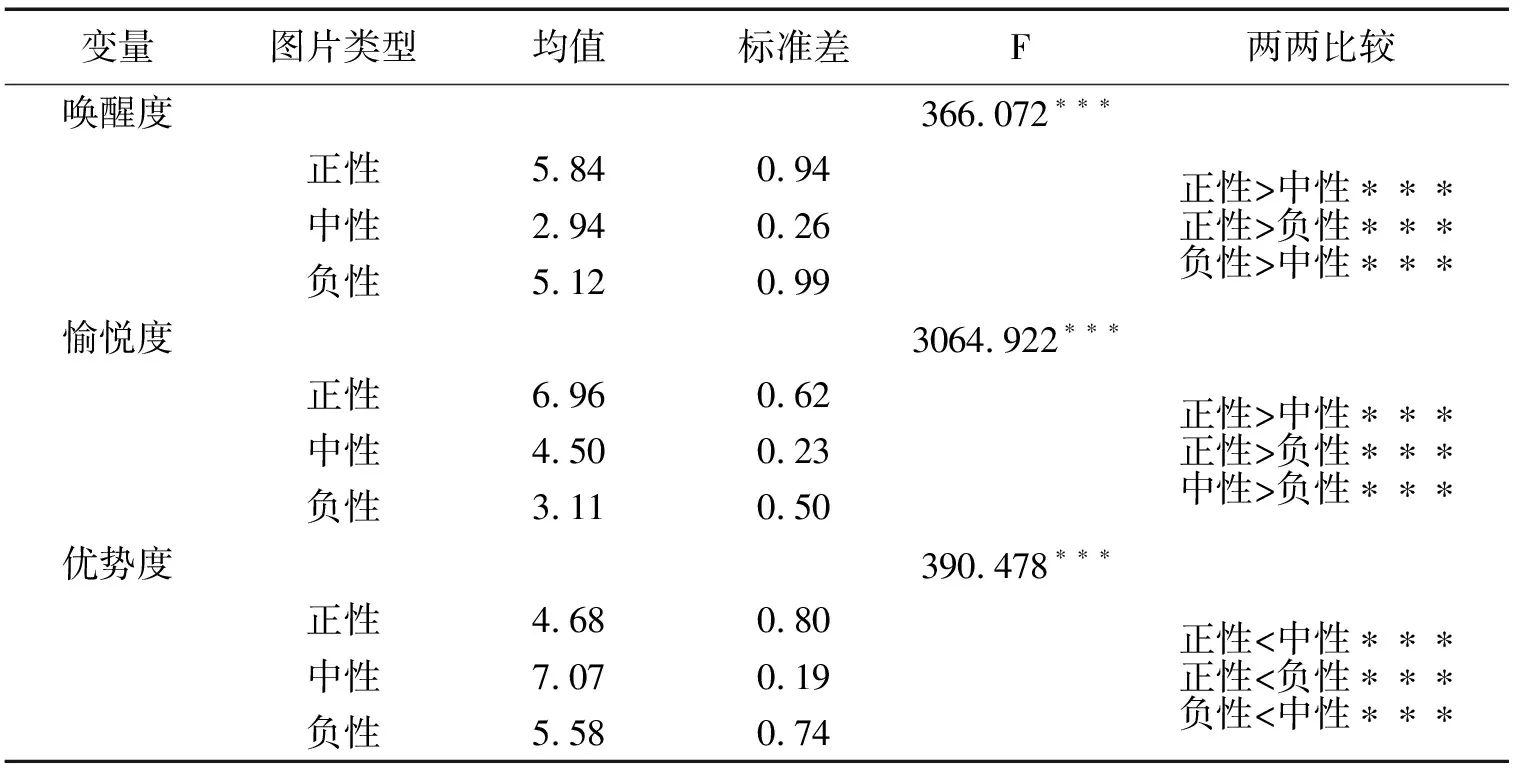

之后,我们对按效价分类后的正中负性图片在各情绪维度上进行了单因素方差分析,发现不同情绪效价的图片给在各维度上的评分均有显著差异。正负性表情的唤醒度显著高于中性表情,优势度显著低于中性表情;而正性表情的愉悦度显著高于中性表情,中性表情的愉悦度显著高于负性表情,这充分说明收录的这些图片具有良好的效价区分度(见表6)。

表6 不同效价表情图片的情绪三维度比较

此外,我们对正中负三种情绪效价的图片做愉悦度与唤醒度的分布散点图(图2),发现正负性表情的二者都高度正相关(r正=0.910,r负=-0.915,p<0.001),中性表情的愉悦度与唤醒度也显著相关(r中=-0.260,p<0.01)。

浅灰点:中性图片;中灰点:正性图片;深灰点:负性图片

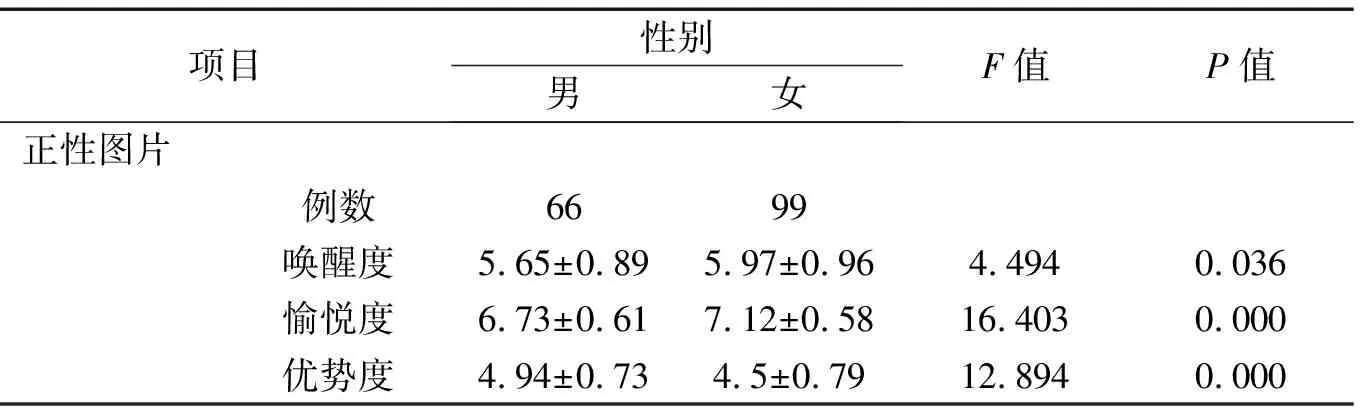

最后,我们对不同性别表演者的表情图片按不同效价做了情绪三维度的对比,发现正负性图片在唤醒度和愉悦度上都存在显著的性别差异,中性图片则未发现此类差异(见表7)。

表7 不同效价图片情绪三维度的性别差异

2.6 图片序列分组结果

经筛选后共得到图片603张,其中正性表情图片165张(男66张,女99张),全部为快乐表情;中性表情图片107张(男53张,女54张),全部为平静表情;负性表情图片277张,包含愤怒表情图片86张(男55张,女31张),悲伤表情图片135张(男42张,女93张),恐惧表情图片2张(女2张),厌恶表情图片54张(男24张,女30张);另有因效价不明确而未纳入正、中、负性表情图片的惊奇表情图片,共54张(男26张,女28张)。每张图片都有独立的情绪唤醒度、愉悦度及优势度评分、表情类别、性别及认同率指标。形成的图片组系统共包含同一个人面孔的不同情绪类型图片序列78组,每一组包括同一个人的平静表情和某种特定表情。其中,正性表情系列共有20组平静-高兴表情组图片序列;负性表情系列共有44组表情组图片序列,包括15组平静-愤怒表情组图片,18组平静-悲伤表情组图片序列,1组平静-恐惧表情组图片序列,10组平静-厌恶表情组图片序列;另有14组平静-惊奇表情组图片序列。每组序列都依愉悦度数值大小从平静面孔向情绪面孔排列。

3 讨论

本研究从取样阶段,增加了表演者从弱到强三个情绪强度的演绎,从实验材料硬件设施、人员配备到实验环境的设置、图片的制作都保持同一性,并严格按标准进行筛选和评价,保证了入库图片的可靠性。图片的选出率未发现显著的性别差异,也说明不同性别表演者的演绎水平匹配,进一步说明入库图片的稳定性。

除平静表情认同率标准稍低以外,其它各类情绪类型图片的认同率都在70%以上,说明纳入本系统的图片信度较高。所有图片的愉悦度、唤醒度和优势度都显著的高度相关,愉悦度处于两极时,唤醒度都较高,评分者对图片的情绪优势度较低;而愉悦度处于中间水平时,则唤醒度较低,优势度较高。这与人类的情绪规律吻合,即非常愉快和非常不愉快的情绪,其情绪程度必然强烈,图片刺激对情绪的支配也就越明显。这也进一步说明本图片系统图片有较高的可靠性和代表性。

国内最先编制也是应用最为广泛的CAPS和CAFPS(白露 等,2005;龚栩 等,2011;王妍,罗跃嘉,2005),在中国人的情绪认知研究,特别是情绪障碍性疾病患者的认知研究中取得了良好的信效度(韩冰雪 等,2020;李大志 等,2020;王芬 等,2021)。但是我们发现,既往这些常用表情图库均按情绪类型分类,多为不同表演者的不同情绪类型图片,缺乏同一面孔的多种情绪类型的系列图片。而不同面孔由于面部结构特征差异造成对实验被试者影响不同,有可能会影响研究的基线比较。而本图组系统的特点是收录了同一个表演者的各种基本情绪面孔,使得研究更具有比较性。而且,同一面孔同一类情绪并非仅收录一张而是收录了由低到高的不同愉悦度等级的序列图片。既往研究都是以情绪强度作为分级的标准(赵艳丽 等,2020),而对于情绪障碍类的研究,愉悦度是比情绪强度更为敏感的指标,实验表明愉悦度不仅影响主观体验和生理唤醒度,而且影响被试对情绪面孔的识别准确率和认知偏向(Reilly et al.,2006)。因此我们采用的是愉悦度作为等级划分的维度,是一套新的可靠的标准化刺激材料。由于每组图片都提供了该表演者的平静表情图片,因此可以使用图片MORPH软件生成从平静表情到相应表情的任意唤醒度或愉悦度的动态图片。有研究表明,动态表情对情绪障碍类疾病的鉴别效能优于静态图片(Sato et al.,2010;Xia et al.,2018),这与人类在社交活动中的适应功能有关。而国内鲜见此类刺激材料,本研究为动态表情的制作提供了标准化的素材。

本系统存在以下不足:一是经筛选后不能保证每个表演者都有7种基本情绪的系列图组,因此并不完整,还需后期继续增大样本量,扩充并完善本系列图组;二是纳入的恐惧情绪图片数量非常少,这与前人研究结果相似(龚栩等,2011;刘明矾等,2012;王妍&罗跃嘉,2005)。恐惧表情图片的认同率较低,原因可能是因为恐惧表情不仅在表演者演绎时,而且在评分者辨别时都较容易与其它一些表情,尤其是惊奇表情相混淆(Ekman et al.,1987)。曾有研究者对恐惧表情的认同率较低做了验证性研究,结果发现有约40%的被试将恐惧表情误判为惊奇。从表情的形成与发展过程来看,恐惧表情经常始于惊奇,因此含有与惊奇相似的成分。且现实生活中,人们对于恐惧情绪的识别不止依赖面部表情,身体表情是更受关注的线索,因此人们仅从面部表情来判断恐惧情绪的能力有限(刘明矾 等,2012;赵科 等,2018)。将来补充恐惧表情时,一方面可以通过对表演者的精细化培训和指导以增加其对该情绪的理解即表现的准确性,另一方面可在符合伦理的前提下适当给予表演者相应的情绪诱导。