基于深度残差网络的医学图像鲁棒可逆水印算法

李智 周旭阳 殷昕旺 张丽

摘 要:医学图像作为医生诊断的重要依据,其版权保护一直是研究重点。在对医学图像进行版权保护时,必须保证图像修改后能无损恢复。但是,当前大多数应用于医学图像的可逆水印算法并未考虑鲁棒性。因此,本文针对具有一定鲁棒性的可逆水印算法进行研究,提出一种基于深度残差网络ResNet的鲁棒可逆医学图像水印算法。首先,算法利用深度残差模型提取医学图像的深度特征信息,自适应确定最优嵌入强度,均衡水印的不可见性和鲁棒性;此外,结合遗传算法和模糊C-均值的聚类算法对水印区域动态划分,根据聚类结果提取水印信息,有效克服信号攻击对含水印图像的影响,提高可逆水印算法的鲁棒性。实验结果表明:在嵌入水印后,含水印医学图像的PSNR值都可以达到36 dB以上,具有较好的图像质量;在提取水印后,算法可以完全無损恢复医学图像;在受到高斯噪声、椒盐噪声、JPEG压缩等常见信号攻击后,算法仍然可以准确提取水印信息,表现出较强的鲁棒性。

关键词:医学图像;版权保护;深度残差网络;聚类算法;鲁棒可逆水印

中图分类号:TP309

文献标识码: A

随着网络技术的快速发展,智能医学和远程诊断技术日趋成熟。大量医学图像经常在网络上进行传输和使用,未授权者可轻易通过网络获取、存储、使用和篡改网络上的医学图像[1]。因而,保护医学图像的版权信息显得十分重要。数字水印算法是一种常用的信息隐藏技术,可用于医学图像的版权保护[2]。

在对医学图像进行保护时,为了不影响医生的诊断,不可破坏原始医学图像的信息,因此,基于医学图像的可逆水印算法成为研究者们关注的重点。郑洪英等[3]提出了基于位平面的可逆信息隐藏算法。首先,将医学图像分解为八位平面,通过压缩最高的四位平面获得对空间进行像素填充后的重建图像;其次,分别对重建图像的头部、中间、尾部进行加密;再次,利用直方图移位的方法将水印信息嵌入图像中。DENG等[4]针对医学图像的分区域典型特征,提出一种基于直方图平移的高容量无损信息隐藏水印算法。利用最大类间距方法确定前景区域和背景区域,通过使用聚合多边形和图像拟合算法确定前景嵌入区域,最终在前景和背景区域分别嵌入不同的水印。李智等[5]提出基于实质区域的精确分割算法获取医学图像中的实质区域为嵌入区域,以及基于隶属度的不规则实质区域拟合方法,并将多比特的基于编码的直方图平移(Code based Histogram Shifting, CHS)算法应用于整数小波变换中高频子带, 实现可逆水印嵌入。同时,使用增强奇异值分解在整数小波变换低频子带构建零水印, 实现医学图像的版权保护和篡改定位。现有的医学图像可逆水印算法大多在无损环境中运行,即载体在嵌入信息后不能受到任何攻击和修改。而在现实场景中,时常出现诸如图像压缩和几何变换等图像操作和攻击[6-7]。

在图像水印算法的研究中,通常是利用人工设定水印的嵌入强度参数,但是人工设定的参数具有较强的随机性,且得到的参数无法较好地均衡水印不可见性和鲁棒性[8]。水印的嵌入强度越大,则水印的鲁棒性越强,但不可见性越差; 水印嵌入强度越小,则水印的不可见性越好,但鲁棒性就越弱[9]。文献[10]对载体图像进行Contourlet变换后,对低频部分做块奇异值分解,其水印的主成分是通过修改块的最大奇异值的方式进行嵌入,虽然在数值上达到了不可见性的标准,但具有明显的块效应。文献[11]提出了一种基于奇异值分解和蜂群优化的鲁棒水印算法。嵌入强度的参数采用蜂群优化算法来选取,自适应均衡水印算法的鲁棒性与透明性,但蜂群优化算法收敛速度慢,寻找最优解时间较长。文献[12-13]基于群智能算法对水印嵌入强度进行优化,能够根据不同的图像确定最优的嵌入强度,但这些算法普遍不能较好地抵抗信号攻击。人类视觉系统(Human Visual System, HVS) 具有纹理掩蔽、频率掩蔽、亮度掩蔽等特性[14]。文献[15]基于HVS 特性确定图像掩蔽因子,并将其作为水印嵌入的强度,此类算法能降低载体图像的视觉失真,但算法较为复杂。ResNet是一种在图像处理领域应用的深度学习方法,它不仅可以提取图像的高维复杂特征,而且可以解决网络层数增多引起的精度退化问题,提升深度网络的性能[16-17]。

在平衡水印的不可见性和鲁棒性的同时,以上文献有一个共同特征为鲁棒性并不能满足需求。文献[18]在提取水印信息过程中引入K-means聚类方法,实现了水印区域的动态划分,但是初始聚类中心的选择对聚类结果影响很大,这就会造成水印算法性能不稳定。遗传模糊C-均值作为另一种聚类算法[19],先应用遗传算法确定最优初始化聚类中心,再使用

模糊C-均值(Fuzzy C-Means,FCM)方法得到最终的聚类结果,聚类结果不受聚类中心选择的影响,可解决水印算法性能不稳定的问题。

结合以上问题,本文提出一种基于ResNet的医学图像鲁棒可逆水印算法,利用改进的ResNet计算水印嵌入强度以平衡水印的不可见性和鲁棒性。在提取水印信息过程中,利用遗传模糊C-均值方法,有效提高了水印提取算法的鲁棒性。从嵌入和提取两个角度使基于医学图像的鲁棒可逆水印具有一定的实用性。

1 相关技术

1.1 残差学习

深度学习的基础网络从ALexNet(5个卷积层)、VGG(19个卷积层)到GoogLeNet(22个卷积层),网络的结构在不断变深,更深的网络可以提取更复杂的特征[20-21]。但是,随着网络的加深,出现了训练集准确率下降的现象。HE等[22]提出ResNet,该网络结构可以避免简单堆叠的卷积神经网络梯度消失或爆炸以及精度退化问题,模型更容易优化,性能提升明显。

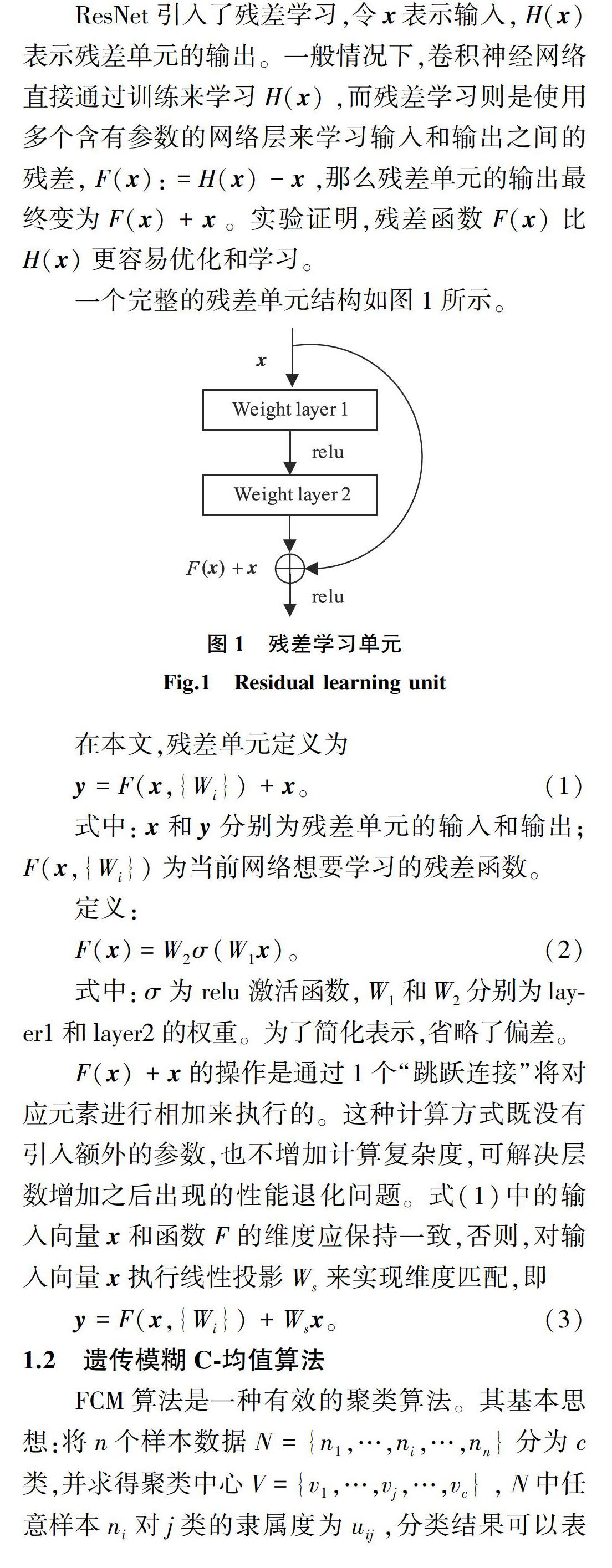

ResNet引入了残差学习,令x表示输入,H(x)表示残差单元的输出。一般情况下,卷积神经网络直接通过训练来学习H(x),而残差学习则是使用多个含有参数的网络层来学习输入和输出之间的残差,F(x):=H(x)-x,那么残差单元的输出最终变为F(x)+x。实验证明,残差函数F(x)比H(x)更容易优化和学习。

一个完整的残差单元结构如图1所示。

2 算法实现

2.1 深度残差网络模型

在现有算法中,大多是依靠经验手动设置嵌入强度,不仅没有理论依据,也很难获取最优嵌入强度平衡不可感知性和鲁棒性。为了实现不可感知性与鲁棒性的有效折衷,本文提出一种深度残差网络模型。它通过残差学习可以提高提取图像尺度、亮度、纹理等复杂特征的能力,更为精确地评估图像对噪声的局部敏感性,自适应获得水印嵌入强度λ。

此深度残差网络模型以医学图像作为输入,由医学图像对应的嵌入强度作为标签,学习医学图像和图像嵌入强度之间的映射关系。模型训练完成后,可以直接通过医学图像预测嵌入强度。由于医学图像的大小一般较大,为了提高网络的拟合速度和增加样本数量,医学图像被分成 32×32的图像块作为输入。

2.1.1 网络结构

如图3所示,网络模型一共有19层,包括卷积层、残差单元、全局平均池化层和全连接层。网络输入大小为32×32的医学图像。首先,通过的1个卷积层(使用大小为3×3×16的卷积核);其次,经过9个残差单元(分别使用大小为3×3×16、3×3×32、3×3×64的卷积核),为了获取更多、更丰富的特征信息,卷积核的数目随着网络的深入不断增加;再次,网络以全局平均池化层和全连接层结束,输出大小为1×1的嵌入强度。网络通过步长为2的卷积层直接进行下采样。为了保持特征图的大小与输入一致,将步长和边缘填充都设置为 1。

残差单元由2个卷积层和1个“跳跃连接”组成,卷积层主要有大小为3×3的卷积核,并遵循2个简单的设计规则[22]:(i)当输入和输出特征图的大小相同时,该卷积层和上一层具有相同数量的卷积核;(ii)如果特征图的大小减半,则卷积核的数量加倍,以便保持每层的时间复杂度。在跳跃连接中,当输入和输出的维度是相同时,可以直接使用式(1)连接(如图3实曲线);当维度增加一倍时,用式(3)中的线性投影匹配维数(如图3虚曲线)。线性投影通过卷积核大小为1×1、步长为2的卷积实现。

3.2.3 子带分块大小

子带分块大小也是影响容量、不可感知性和鲁棒性的重要因素。实验选取小波子带中的低高频子带(LH)和高低频子带(HL)、嵌入强度为10,当子带分块大小选取4×4、8×8、16×16、32×32时,研究子带分块大小对各性能的影响。

子带分块越大,子带分块个数越少,感兴趣块的个数就越少,水印嵌入容量随着块大小的增加而减少。由图12可以看出,随着块大小的减少,水印嵌入容量增加,反之亦然。由图13可以看出,随着子带分块大小的增加,PSNR 呈下降趋势。由图14可以看出,从整体上来说,随着子带分块大小的增加,抵抗攻击能力越强,鲁棒性呈增加趋势。

3.3 实验仿真

为了验证本文算法的有效性,给出以不同部位医学图像为载体的水印嵌入和提取测试,实验结果如图15所示。图15中,(a1)、(b1)、(c1)、(d1)为原始图像,(a2)、(b2)、(c2)、(d2)为含水印的图像。从视觉效果来看,含水印图像与原始图像相比没有明显变化,具有良好的不可感知性;采用PSNR客观评价含水印图像与原始图像的质量差别,可以得出含水印图像的PSNR值分别为

38.9、36.5、37.5、39.0 dB,都可以达到36 dB以上,图像的质量都表现良好。图15中,(a3)、(b3)、(c3)、(d3)为含水印图像与原始图像的差值图。可以明显看出水印嵌入前后的图像差别,以证明水印信息已嵌入载体图像。图15中,(a4)、(b4)、(c4)、(d4)为提取水印信息后的恢复图像,(a5)、(b5)、(c5)、(d5)为恢复图像与原始图像的差值图。差值图为全黑则表明恢复图像和原始图像完全一致,在没有受到攻击的情况下,算法没有更改原始图像的像素,IER值为0,说明本文算法实现了完全可逆的效果。

为了检测本算法具有较好的鲁棒性,对含水印图像分别进行高斯噪声(方差为0.01)、椒盐噪声(方差为0.005)、JPEG压缩(质量因子为25)和 JPEG 2000压缩等常规攻击。表1列出了含水印图像在受到不同攻击后所提取水印的BER值。从表可以看出:攻击对提取出的水印 BER 值有一定的影响,但BER值都低于9%,特别是腹腔和肝脏受到压缩攻击时,提取出來的水印 BER 值大部分都能低于1%,说明本算法可以有效抵抗各种常规攻击,具有较强的鲁棒性。

3.4 实验对比

为了进一步说明本文算法的优越性,从可逆性、不可感知性、鲁棒性和容量4个方面与文献[18][24]进行性能对比。文献[18]是基于聚类和小波变换的鲁棒可逆水印算法,文献[24]是基于卷积神经网络的鲁棒可逆水印算法。

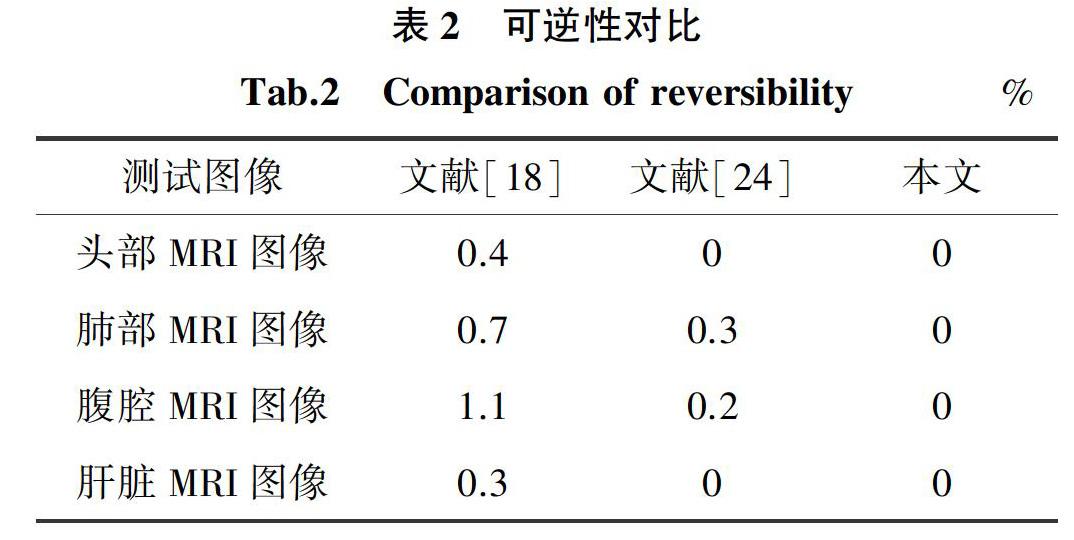

(1)可逆性对比

我们采用 IER 来评估不同算法的可逆性,它在无损环境下衡量是否能实现图像与水印的无失真恢复。实验结果如表2所示,前2种算法接近实现可逆,相比之下,本文算法可以完全实现可逆效果。

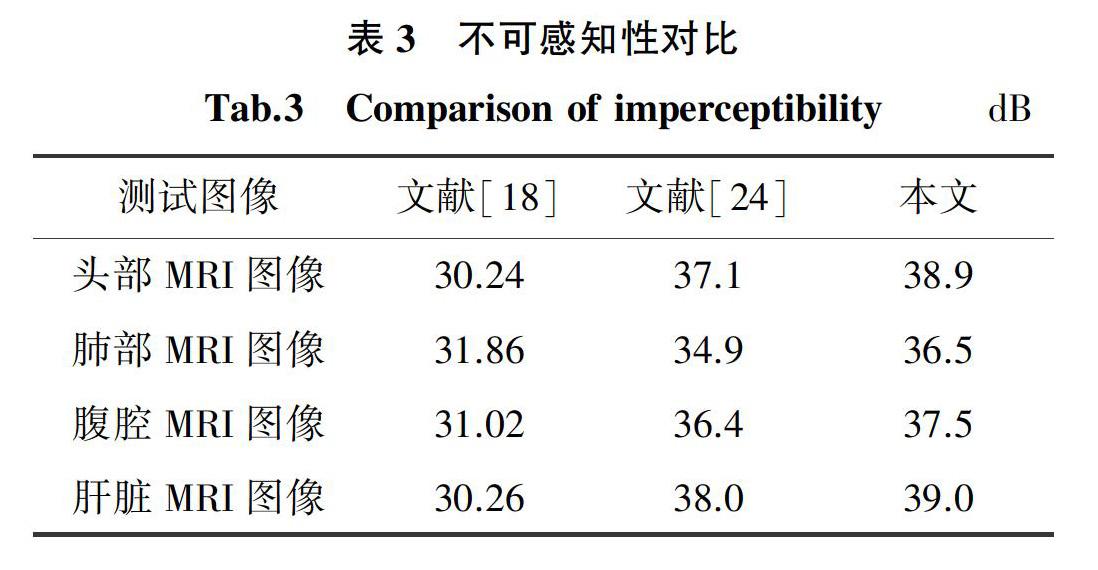

(2)不可感知性对比

不可感知性是对水印图像的失真情况进行评估,表3对比了不同算法的PSNR值。可以看出,本文的算法的PSNR值高达390 dB,图像质量要好于文献[18]和文献[24]。

(3)鲁棒性对比

本文用BER对不同算法进行鲁棒性对比,表4—表7显示了实验结果。可以看出:文献[18]抗椒盐噪声和高斯噪声的鲁棒性比较差, 本文算法要优于所对比的方法,尤其在抗JPEG压缩和JPEG2000压缩时,肝脏图像的错误率可以低至0.7%和0.6%。

(4)容量對比

表8对比了不同算法的容量,算法中设置块大小为8×8。本文算法的容量略高于文献[24],明显高于文献[18]。因为本文算法选取了2个小波子带嵌入水印信息,而文献[18]只使用了1个小波子带,所以本文算法容量近似文献[18]的2倍。

4 结语

针对当前医学图像可逆水印算法抗攻击能力不足问题,本文提出一种基于深度残差网络的医学图像鲁棒可逆水印算法。首先,根据像素调整策略预处理医学图像,避免像素溢出;其次,利用深度残差模型自适应确定嵌入强度;再次,采用基于直方图平移和聚类算法嵌入与提取水印信息。实验结果表明:本文算法可以无损恢复医学图像,保证了医学图像的完整性;并且对于常见的信号攻击具有较好的稳健性,提高了可逆水印的鲁棒性;同时嵌入水印后的医学图像PSNR 值均达到36 dB 以上,较好地均衡了水印的不可见性和鲁棒性;此外,与现有算法相比,在嵌入容量上具有一定优势。本文算法在无损恢复医学图像的基础上,还可以抵抗常见的信号攻击,实现了对医学图像的版权保护。下一步的研究工作考虑将深度学习应用于整个医学图像版权保护算法中,在保证医学无损恢复的前提下,使得该算法对于攻击具有更好的普适性。

参考文献:

[1]SINGH S, RATHORE V S, SINGH R. Hybrid NSCT domain multiple watermarking for medical images[J]. Multimedia Tools and Applications, 2016, 76(3):3557-3575.

[2]LEI B, TAN E L, CHEN S, et al. Reversible watermarking scheme for medical image based on differential evolution[J]. Expert Systems with Applications, 2014, 41(7):3178-3188.

[3]郑洪英,任雯,程惠惠.基于位平面压缩的密文医学图像可逆信息隐藏算法[J].计算机应用,2016,36(11):3088-3092.

[4]DENG X H, CHEN Z G, LIANG D Q, et al. Region-based lossless data hiding with high capacity for medical images[J]. Journal on Communications, 2015, 36(1):189-198.

[5]李智,陈怡,王丽会,等.基于实质区域的医学图像双水印算法研究[J].贵州大学学报(自然科学版),2018,35(5):55-62,73.

[6]NAIK K, TRIVEDY S, PAL A K. An IWT based blind and robust image watermarking scheme using secret keymatrix[J]. Multimedia Tools and Applications, 2018, 77(11): 13721-13752.

[7]熊祥光.空域强鲁棒零水印方案[J].自动化学报, 2018,44(1):160-175.

[8]项世军,杨乐.基于同态加密系统的图像鲁棒可逆水印算法[J].软件学报,2018,29(4):957-972.

[9]李智,陈淑琴,程欣宇,等.ASIFT与SVD相结合的Contourlet域的抗几何攻击视频双水印算法[J].贵州大学学报(自然科学版),2019,36(4):59-67.

[10]VLEESCHOUWER C D, DELAIGLE J F, MACQ B M. Circular interpretation of bijective transformations in lossless watermarking for media asset management[J]. IEEE Transactions on Multimedia, 2003, 5(1):97-105.

[11]NI Z, SHI Y Q, ANSARI N, et al. Robust lossless image data hiding[C]//2004 IEEE International Conference on Multimedia and Expo (ICME). Taipei: IEEE,2004: 2199-2202.

[12]NI Z, SHI Y Q, ANSARI N, et al. Robust lossless image data hiding designed for semi-fragile image authentication[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2008, 18(4):497-509.

[13]ZOU D, SHI Y Q, NI Z, et al. A semi-fragile lossless digital watermarking scheme based on integer wavelet transform[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2006, 16(10):1294-1300.

[14]毕胜,梁德群.基于人类视觉特性的纹理分割方法[J].计算机应用,2006(5):1015-1017.

[15]AN L, GAO X, LI X, et al. Robust reversible watermarking via clustering and enhanced pixel-wisemasking[J]. IEEE Transactions on Image Processing, 2012, 21(8):3598-3611.

[16]ZHU J, KAPLAN R,JOHNSON J, et al. Hidden: hiding data with deep networks[C]//Proceedings of the European Conference on Computer Vision (ECCV). Germany: Springer, 2018: 657-672.

[17]MUN S M, NAM S H, JANG H, et al. Finding robust domain from attacks: a learning framework for blindwatermarking[J]. Neurocomputing, 2019, 337: 191-202.

[18]AN L, GAO X, YUAN Y, et al. Robust lossless data hiding using clustering and statistical quantity histogram[J].Neurocomputing, 2012, 77(1): 1-11.

[19]李同強,周天弋,吴斌.基于改进遗传算法的加权模糊C-均值聚类算法[J].计算机应用,2009,29(S2):260-262.

[20]KRIZHEVSKY A, SUTSKEVER I, HINTON G E.Imagenet classification with deep convolutional neural networks[C]//Advances in neural information processing systems. USA:ACM,2012: 1097-1105.

[21]SZEGEDY C, LIU W, JIA Y, et al. Going deeper with convolutions[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR). USA: IEEE Computer Society, 2015: 1-9.

[22]HE K M, ZHANG X, REN S, et al. Deep residual learning for image recognition[C]// 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). USA: IEEE Computer Society, 2016:770-778.

[23]马永杰,云文霞.遗传算法研究进展[J].计算机应用研究,2012,29(4):1201-1206,1210.

[24]KANDI H, MISHRA D, GORTHI S R K S. Exploring the learning capabilities of convolutional neural networks for robust image water-marking[J]. Computers & Security, 2017, 65:247-268.

(责任编辑:周晓南)