尺度方向自适应视觉目标跟踪方法综述

单玉刚,胡卫国

1.湖北文理学院 教育学院,湖北 襄阳441053

2.中国人民解放军 某部队

1 引言

视频图像序列目标跟踪是计算机视觉中的一个重要研究方向,广泛地应用在视频监控、无人驾驶、人机交互、医学诊断以及精确制导武器等领域[1]。近十几年来,视觉跟踪技术取得了长足进步,研究人员提出了许多有效的跟踪算法。但当存在视频跟踪目标外观的变化和外部环境复杂时,跟踪精度会下降[2],因此,要对目标进行长时间稳定的跟踪,就需要合理地处理光照变化、目标姿态的改变、目标的形变、视角的改变、目标旋转变化和目标尺度变化,否则会导致跟踪失败。

视频目标跟踪发展到现在,从时间上可划分为四个阶段,第一阶段:生成式模型[3]。生成式模型通过在线学习方式建立目标模型,然后使用模型搜索重建误差最小的图像区域,完成目标定位,典型模型有粒子滤波、相关匹配、Meanshift 和Camshift 等。第二阶段:判别式模型[3]。通过机器学习方法,提取图像特征,并训练分类器进行分类,典型模型有MIL、TLD、SVM、随机森林等。第三阶段:相关滤波[4],严格说是判别式的一种,由于其独特特性另成一类。2014 年,KCF[5](Kernel Correlation Filter,核相关滤波算法)的出现轰动一时。从VOT2014到VOT2018,相关滤波跟踪效果一直处于领先地位。第四阶段:深度学习[6]。深度学习的应用起于2013 年DLT[7]的提出,在2019年,SiamMask[8]和SiamRPN++[9]的产生真正意义超过了相关滤波,性能达到了state of the art(目前最好的)。本文对近年来已发表的国内外目标跟踪领域的SCI 文献按照关键词搜索,进行了数量统计,如图1所示。生成式模型跟踪文献数量从2012年达到顶峰,之后开始逐年减少;判别式模型跟踪文献数保持在每年20 篇左右;相关滤波跟踪文献数量从2015 年达到顶峰,之后有所下降。深度学习跟踪文献数量从2012 年出现到2018 年一直处于显著上升趋势,2018 年发表200 多篇文献,2019 年到9 月不完全统计达150 篇。由图1表明深度学习跟踪是视频目标跟踪发展趋势。

图1 目标跟踪发展历程

尺度方向自适应目标跟踪是在跟踪过程中为了适应目标尺度和方向变化,而采取的自动调整尺度和方向策略,这样可减少目标中的背景信息,提高跟踪精度。文献[10-12]把尺度和方向自适应跟踪定义为多自由度跟踪。多自由度的目标跟踪是指采用椭圆或矩形描述目标,具有中心坐标、长短轴和旋转角度等多个自由度。因此,每个目标不仅仅有位置,而且能够在水平和垂直两个方向上独立描述目标的大小变化,并通过加入目标倾角,还可以描述目标旋转运动。由于并没有国际组织或协会定义多自由度概念,这里使用尺度方向自适应来描述对目标尺度和方向的跟踪。一个鲁棒的目标跟踪算法应该能够有效处理目标尺度和旋转等变化,对于提高目标跟踪算法的鲁棒性具有非常重要的意义。

为了解决跟踪过程中目标尺度方向变化问题,国内外的专家学者进行了大量的研究,提出了很多有效的算法,算法在特定场合下测试效果较好。这些算法大致可以分为如下几类:(1)增量式搜索;(2)MeanShift 迭代;(3)区域二阶矩;(4)角点匹配;(5)粒子滤波;(6)相关滤波器;(7)深度学习。本文对上述算法进行了总结,介绍了具有代表性的算法,重点分析了深度学习方法,并分析了各种算法优缺点。最后,展望了尺度方向自适应研究未来发展趋势。

2 尺度和方向自适应跟踪算法

2.1 增量式搜索

2.1.1 MeanShift增量式

核跟踪方法[13]使用核窗口描述目标形状,包括矩形、椭圆形或其他固定形状的目标。核跟踪在第一帧中先确定目标模板,在后续帧中用候选块与模板进行匹配来实现跟踪。MeanShift 算法[14]是典型的核跟踪方法,其通过改变核窗口目标角度实现目标角度跟踪。设S是带宽,即:目标的缩放因子,初始化目标模式时一般取为1,Sx和Sy是坐标归一化系数,目标旋转角度是θ,则核窗口为:

Comaniciu 等[15]采用对目标±10%的增量方式的核窗口宽度进行修正的方法。马伟[16]提出了在每一次MeanShift迭代过程中,调整目标跟踪框的高和宽,然后调整3 次跟踪框方位角的方法获取局部最优解达到自适应跟踪方法。贾静平等[17]采用方式是重复对单个目标的一次跟踪过程3 次,倾角a值分别为原倾角值和原倾角值±10°,然后比较3 次收敛后的Bhattacharyya 系数,取对应系数较大的a 为新的倾角值。同时,采用横轴增减10%方法自适应获取新的横轴值和新的竖轴值。

2.1.2 相关匹配增量式

文献[18]采用最小外接矩形对目标建模,并采用最小外接矩形的两步块匹配搜索方式实现对目标的中心定位,然后采用增量式搜索匹配方法获取最优尺度和方向角度。通过动态评估不同目标模型在不同跟踪场景中的置信度,对目标模型进行更新。候选区上的点(x,y)绕中心点旋转变为(u,v)公式为:

增量式搜索匹配最优角度时,带倾角的候选区域移动在搜索区域中,用候选区域的直方图与模板直方图进行巴氏系数比较,取最大巴氏系数的最大处即为所求位置。搜索时以上一帧尺寸和倾角为基础,根据式(2)将候选区旋转,使用角度增减步长Δβ,改变倾角值,分别为原倾角值θ 增加3Δβ、2Δβ、增加Δβ、减少Δβ、减少2Δβ 和减少3Δβ,然后比较6 次匹配的Bhattacharyya 系数,并取对应系数最大的角度为新的倾角值。最优尺度获取亦采取同样方法。

2.2 MeanShift迭代

文献[19]介绍了非对称核尺度和方向选择方法。

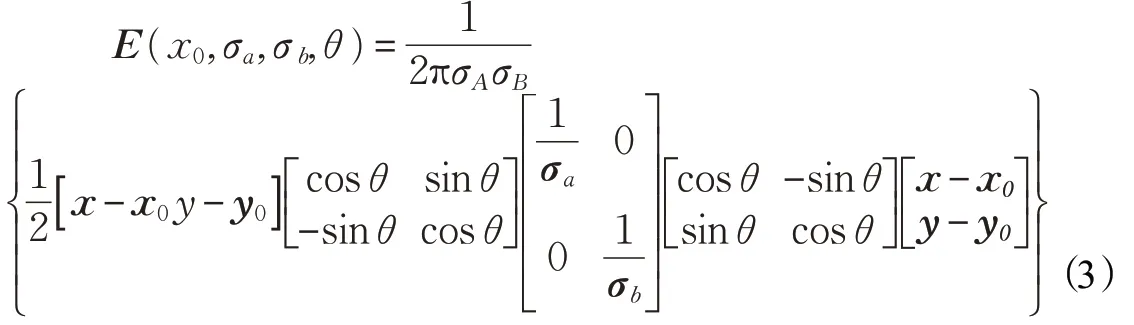

文献[20]推导出了角度均值迭代公式定义带方向的二维椭圆高斯算子:

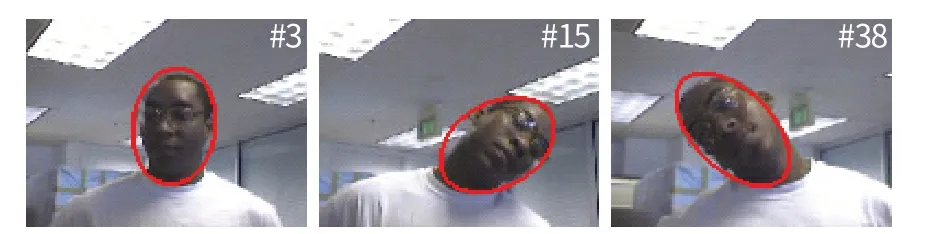

使用椭圆高斯算子进行均值迭代可求取连续帧目标的空间位置x1、尺度(σa1,σb1)和角度参数θ1。MeanShift迭代算法跟踪在背景较单一场景跟踪效果较好,跟踪效果如图2所示。

图2 MeanShift迭代跟踪效果

2.3 角点匹配

角点能够很好地刻画目标空间结构。常用的角点特征有:SIFT[21]特征、SURF[22]特征、Harris[23]角点。文献[24]采用Harris角点特征匹配进行跟踪,董蓉[25]、侯志强[26]和赵钦君[27]等人通过提取图像SIFT 角点,根据SIFT 角点的匹配情况来计算被跟踪目标的旋转角度,用以解决目标跟踪中的旋转问题。

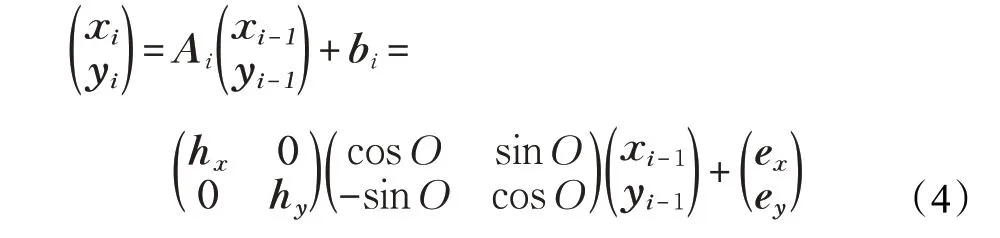

通过将前后两帧中跟踪窗口中匹配的角点作为样本来对仿射模型参数进行估算。应用仿射变换原理,相邻两帧间的特征点位置关系满足:

只需3 个匹配点对就可以计算出连续帧间的仿射变换参数。为了去除错误匹配以保证变换矩阵的准确性,通常采用RANSAC[28](随机采样一致性)方法得到有效数据。Sift角点匹配效果如图3所示。

图3 Sift匹配

2.4 区域二阶矩

区域二阶矩方法通过计算目标候选区域二阶矩,求得目标大小和方向,典型算法有Camshift[29]和Soamst[30]等。Camshift 算法基本过程是:在第一帧初始化目标模板大小和位置后,在接下来的帧里在搜索窗口内将图像中每个像素的值用其颜色出现的概率对当前帧替换,可得到颜色概率分布图即反向投影图。然后,运行Mean‐Shift 算法搜索获得目标新的位置,并用椭圆锁定目标,由零阶矩、一阶矩和二阶矩计算获得椭圆的长轴、短轴及方向角。

Soamst[30]算法根据目标模板计算候选目标区域像素点颜色值与目标颜色直方图模型对应分量的相似性权值,得到候选区域的权重分布图,用权重分布图的不变矩统计特征来反映目标区域。通过计算二阶中心矩构成协方差矩阵来估计目标的宽度、高度和方向。Soamst算法跟踪效果如图4所示。

图4 Soamst跟踪效果

2.5 粒子滤波跟踪

粒子滤波[31]是求解贝叶斯概率的一种算法,其大概思想是用贝叶斯概率模型构造目标的先验知识、目标状态转变模型和观测模型,求解表征目标状态的后验概率。

为求取目标尺度和方向,目标状态矢量设为st=[xt,yt,rt,dt]T,其中xt,yt为目标位置,rt为目标尺度,dt为目标方向。观测矢量ot,跟踪就是对后验分布p(st|o1:t)最大化的过程。

其中,o1:t是到t 时刻观测值集合,状态转移模型为p(st|st-1),观测模型为p(ot|st)。则,当前目标状态可以用后验分布p(st|o1:t)估计得到,即:其中,N 为粒子数量,ω为第k个粒子权重。

Satoh[32]应用贝叶斯理论实现基于粒子滤波的尺度和方向自适应运动目标跟踪。文献[33]使用颜色和DMG 测度为特征实现粒子滤波轮廓跟踪。粒子滤波跟踪效果如图5所示。

图5 粒子滤波跟踪效果

2.6 尺度方向自适应相关滤波跟踪

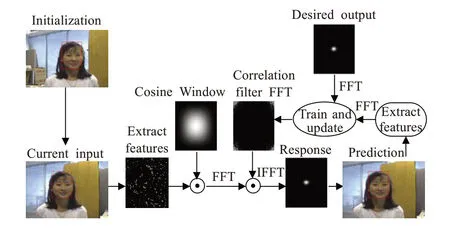

相关滤波跟踪方法[4]具有较强的鲁棒性和超高的跟踪速度,受到了国内外学者广泛的关注。其思想是:在首帧对目标学习一个相关滤波器,在随后帧中使用相关滤波器与候选区域相乘运算,响应值最大处为目标位置。相关滤波跟踪流程如图6 所示。最初的相关滤波跟踪没有考虑尺度和角度变化。SAMF[34]使用尺度池解决目标跟踪过程中目标尺度变化的问题,尺度池大小为7。SAMF 只需要一个滤波器,但需要计算7 次才能获得目标位置和尺度。DSST[35]在二维位置平移滤波器的基础上增加一维尺度滤波器。两个滤波器串联起来并独立工作,分别进行目标定位与尺度缩放。文献[36]提出RAJSSC 跟踪器算法,其将笛卡尔坐标(x,y)变换成对数极坐标(ρ,θ)来构建方向滤波器实现旋转估计。文献[37]提出一种鲁棒的旋转角度估计算法,以核相关滤波器理论为基础,通过在目标中心等角度间隔来采样一个样本金字塔,单独训练一个角度估计滤波器,从而将目标旋转角估计问题变为一个检测问题。算法单独训练一个位移跟踪滤波器、一个尺度估计滤波器和一个角度估计滤波器来实现目标尺度和方向自适应跟踪。

图6 相关滤波跟踪流程

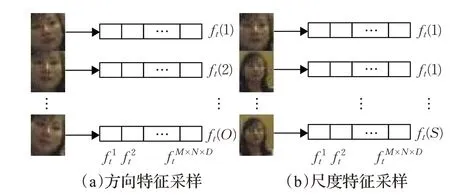

文献[37]构建方向滤波器时,对目标图像进行等角度间隔旋转采样,得到n 幅图像,对每幅图像缩放到固定的尺寸,用高斯函数给每个样本赋生成一个标签值。同样,构建尺度滤波器时,对目标图像进行等比例缩放采样。方向特征采样如图7(a)所示,尺度特征采样如图7(b)所示。利用样本特征和样本标签,并使用带核的最小二乘回归来训练回归器。

图7 方向和尺度特征采样

2.7 深度学习预测尺度方向

2.7.1 基于深度学习目标跟踪

由于深度特征对目标拥有强大的表示能力,深度学习方法广泛应用到图像识别、目标检测和目标跟踪中[6]。卷积神经网具有权值数量少,训练速度快等优点[38],目前,基于深度学习的跟踪主要使用深度卷积神经网。深度学习在目标跟踪上的应用可以分为三种方法:

(1)深度学习与其他跟踪框架结合。这类方法利用深度网络提取深度特征,在其他跟踪框架下执行跟踪过程,如:HCF[39]、ECO[40]等。

(2)基于经典分类的方法。这类方法使用深度学习网络作为跟踪框架,可以在线更新分类器或目标外观模型,跟踪性能优越,但是大多数这类算法的速度都很慢,如:MDNet[41]、FCNT[42]等。

(3)基于匹配的跟踪方法。这类方法使用目标模板来匹配候选样本,通常不需要在线更新目标模型,所以达到了速度和精度的平衡。如:Siamese-FC[43]和GOTURN[44]等。

2017 年,Bertinetto[43]提出了Siamese-FC 跟踪框架,其利用孪生网络将跟踪问题转化为图像对的匹配问题。Siamese-FC 结构简单,跟踪速度快,精度高,受到了广泛关注,成为了当前目标跟踪领域研究最热点之一。以Siamese-FC 为基础,衍生出了众多优秀的跟踪器,如:SiamRPN[45]、DSiam[46]、Siam-BM[47]、SiamMask[8]和SiamRPN++[9]等。

2.7.2 基于深度学习目标尺度方向跟踪分类

基于深度学习目标跟踪解决尺度和方向自适应问题有四种方法:

(1)利用深度特征,结合粒子滤波[48-50]多伯努利滤波[51]和光流[52]等框架获得尺度和方向。

(2)采用选择性搜索获得尺度和方向,可以采用FPN[53](特征金字塔网络)和RPN[54](区域候选网络)等方式。FPN 利用不同层的特征图预测不同尺度的目标。通过使用RPN可生成候选区域ROI,然后对不同尺寸的目标,选用不同尺寸的特征图去做识别。

(3)采用线性回归方程训练并预测目标Boundingbox[55-56](边框)。

(4)训练并预测目标Mask(掩码)。

基于深度学习的目标尺度方向跟踪方法分类如图8所示。

图8 深度学习尺度方向自适应方法

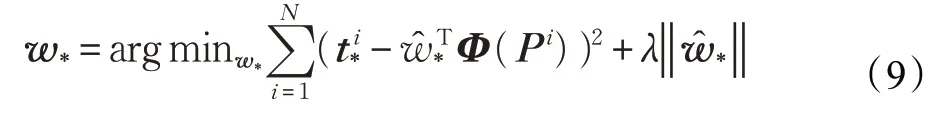

Bounding-box 回归方法一般用于预测目标尺度。文献[55-56]增加了目标旋转角度作为方向参数。其思想是:设定候选区目标边框位置为(Px,Py,Pw,Ph,Pθ),真实目标边框位置为(Gx,Gy,Gw,Gh,Gθ),寻找映射f 使得f(Px,Py,Pw,Ph,Pθ)=(Gx,Gy,Gw,Gh,Gθ),根据约束关系可得:

Φ(P)为输入的特征向量,w*为要学习的参数,∗代表x,y,w,h,θ,d*(P)为得到的预测值。设损失函数为:

则函数优化目标为:

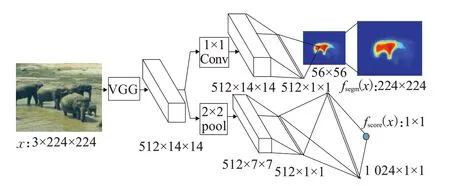

利用梯度下降法或者最小二乘法就可以得到w*。边框回归框架可采用AlexNet[57]、VGGNet[58]、ResNet[59]、LeNet[60]网络等。一种典型网络结构如图9 所示。图中全连接层可以使用1×1卷积替换变为卷积层。

图9 LeNet边框回归网络结构

选择性搜索典型例子是Siam-BM 模型[46],Siam-BM以Siamese-FC为基础,包含一个语义分支和一个用于特征提取的外观分支。通过角度评估模块和空间Mask模块分别来解决目标旋转和网络区分相似目标(提高分割精度)的能力。目标块尺度为127×127,候选块尺度为255×255。每个候选块都与一个(s,a)对相关联,s 是比例因子,a是旋转角度。候选块及其相应的比例角度设置为(1.037 5,0),(0.964,0),(1,0),(1,π/8),(1,-π/8)。Si‐am-BM候选块设置如图10所示。

图10 Siam-BM候选块

目标掩码预测是目标跟踪与目标分割(实例分割)技术的结合。深度卷积神经网络已进入目标分割领域,相继出现了DeepMask[61]、SharpMask[62]、Mask-RCNN[63]等分割模型。通过深度卷积神经网络训练目标掩码,当输入测试图片后,用网络预测出目标掩码。DeepMask是实例分割典型模型,模型网络结构如图11 所示。分割模型在共享特征提取层之后,网络被分成两个分支。顶部分支预测目标分割掩码,底部分支预测输入块的目标得分。在训练阶段,两个网络联合学习,即端到端训练,每个训练样本包含RGB 图像块xk和它的二进制掩码mk,标记yk说明这个图像块是否包含目标。检测时以16像素为步长进行滑窗检测。

图11 DeepMask实例分割模型

Mask 预测尺度方向方法典型实例是SiamMask 模型,该模型结合了Siamese-FC 和SharpMask 优点,将目标跟踪与目标分割有机地结合起来,实时给出目标的像素级标注,通过求取掩码的最小外接矩形可获取目标尺度和方向。SiamMask 有三个输出score、bounding-box回归和Mask。SiamMask 网络结构如图12 所示。Siam‐Mask目标跟踪效果如图13所示。

图12 SiamMask模型

图13 SiamMask跟踪效果

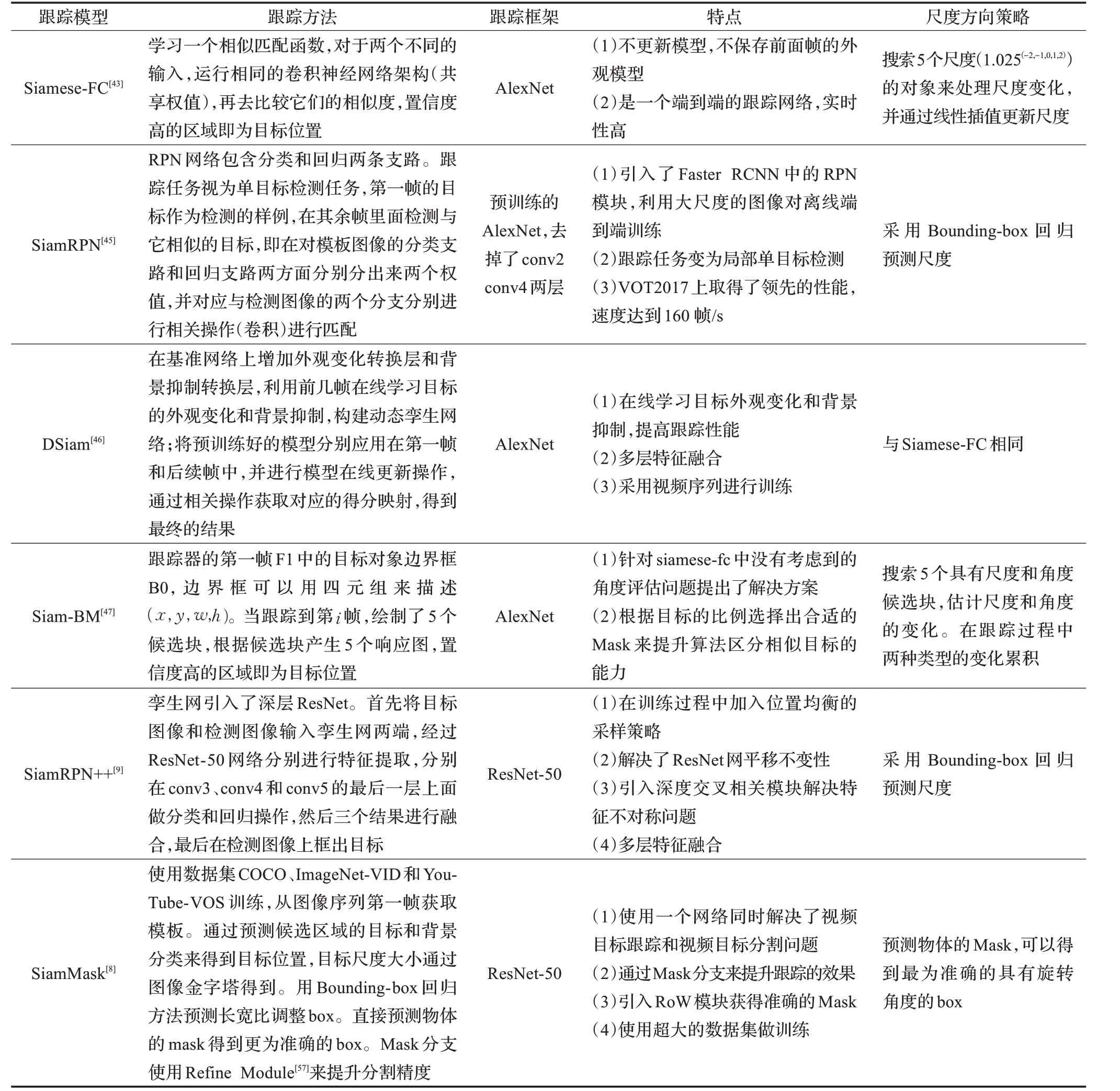

SiamMask 和Siam-BM 都采用了孪生网结构,表1列出了2017 年以来出现的几种经典孪生网络跟踪算法对尺度和方向处理策略。

目标分割的一个重要分支是视频目标分割,它的任务是在视频的每一连续帧中寻找感兴趣目标的对应像素。2016年时出现了两个最重要的视频目标分割方法:OSVOS[64]和MaskTrack[65]。OSVOS 独立地分割视频的每一帧,而MaskTrack还需要考虑视频中的时序信息。

MaskTrack 以VGG-16 网络为基础,每一帧将前一帧的预测掩膜作为额外输入送给网络,输入有四个通道,包括当前帧的RGB 图像和前一帧的掩膜。使用第一帧的标注初始化该流程。同时,增加一个基于光流场输入的相同的网络,这个网络模型的权重和RGB 输入流的权重相同。通过将两个网络输出融合取平均得到最终结果。MaskTrack 在目标跟踪上应用的分割效果很好。

3 算法性能分析

目标跟踪度量指标[66]用来衡量跟踪性能。常用的指标有精确度(Precision)、中心误差距离(CLE)、准确率(Accuracy)、实时性等指标。VOT2015[67]增加了平均重叠期望(EAO)和鲁棒性(Robustness)两个指标对跟踪结果进行评估。

表1 几种典型孪生网络对比

(1)精确度是跟踪算法估计的目标位置(bounding box)的中心点与人工标注(ground-truth)的目标的中心点,这两者的距离小于给定阈值的视频帧的百分比。一般阈值设定为20个像素点。

(2)中心误差距离表示跟踪结果的目标位置与目标真实位置的误差距离。

(3)准确率是指跟踪器在单个测试序列下的平均重叠率(跟踪结果和真实目标两矩形框的相交部分面积除以两矩形框的相并部分的面积)。

(4)跟踪算法的速度,采用帧/s表示算法的实时性。

(5)平均重叠期望是对跟踪器在一个短时图像序列上的非重置重叠的期望值,综合了准确率和鲁棒性指标。

(6)鲁棒性是指单个测试序列下的跟踪器失败次数,当重叠率为0时即可判定为失败。

前述的几种自适应尺度和方向跟踪算法性能如表2所示。

一个良好的目标跟踪算法一般应满足两个要求:一是算法鲁棒性强;二是实时性好,算法计算量少,否则无法实现正常跟踪。由表2可知,增量式搜索、MeanShift迭代、区域二阶矩、角点匹配、粒子滤波和相关滤波器等算法使用专门测试视频或取标准测试数据集的部分视频,说明其应用场景较简单,而且这些算法主要使用颜色特征,特征表示能力不强。深度学习方法使用深度卷积特征,特征表达更有优势,并在标准测试数据集上测试,能适应各种复杂环境。MasTrack 算法在DAVIS 数据集上的测试准确率达到了较高的0.748,SiamMask 和Siam-BM 在VOT 数据集测试上也取得了良好性能,说明深度学习方法算法鲁棒性强。传统算法具有运行速度上的优势,仅仅使用CPU 可以满足实时性,而深度学习方法在使用GPU情况下也可以满足实时性。

4 算法优缺点分析

相关匹配增量式和MeanShift增量式算法为了获取目标角度和横轴和纵轴尺度,进行多次均值迭代,精度与迭代次数有关。因此,为了获取更高精度,需要增加迭代次数,计算量较大,这样会影响实时性。为了兼顾精度和速度需要合理选择迭代次数。MeanShift 迭代算法大大减少了迭代步骤,只需少量次数迭代就可获取目标的位置、尺度和旋转角度,相比增量式算法,实时性得到明显改善。增量式方法和MeanShift迭代方法使用颜色直方图特征描述目标。因此,两种算法对目标形变和小范围遮挡不敏感,但对光照变化敏感。而且,由于算法简单其适于目标快速运动。

计算区域二阶矩方法的优点是简单,计算量较少,跟踪速度快。由于算法采用直方图反投影获得二值图像,所以其对目标形变和部分遮挡不敏感。如果跟踪背景较为复杂或者物体的纹理较为丰富,那么此二值图像的噪声就很多,影响对目标位置的判断,导致跟踪效果下降,所以区域二阶矩方法适用于物体表面颜色较为单一,并且和背景颜色差距较大,尤其适合于固定背景下的目标跟踪,如:水中目标跟踪[68]、手势跟踪[69]等。区域二阶矩有很多改进算法,如采用中值滤波抗干扰[70]能适合较复杂环境。

角点特征对于图像旋转、缩放、仿射变换、普通光照变化等均保持一定不变性,其独特性、稳定性较好,较小的物体也能产生较多的SIFT 特征点,适合于匹配跟踪。但在形变和光照变化大情况下,角点匹配精度不高。因此,角点匹配算法适合于对刚体目标的跟踪,不太适合于复杂环境和对非刚体的目标跟踪,易导致跟踪失败。而且,角点检测和RANSAC 算法时间开销较多,影响跟踪的实时性。

表2 算法的跟踪性能

粒子滤波跟踪在系统初始状态未知情况下,使用大量的粒子对系统状态进行预估,个别粒子的漂移不会显著地影响系统状态,所以其对目标形变、部分遮挡具有鲁棒性。粒子数量影响跟踪精度和实时性,为了实现两者平衡,需合理选择粒子数量。粒子数量的选择可根据场景情况自适应确定[71]。另外,由于传统粒子滤波算法采用RGB 颜色特征描述目标,因此跟踪对光照变化比较敏感。可以采用多种特征描述目标以适应跟踪场景和光照的变化,并自适应分配各种特征的权重以提升算法的精度和鲁棒性[72]。

基于相关滤波器的尺度和方向自适应跟踪构造三级滤波器[35-36]:定位滤波器、角度滤波器和尺度滤波器。根据定义的尺度池和方向池,每帧尺度检测需要采样多个图像块,之后分别计算特征、加窗、FFT 运算等,因此,方向滤波器和尺度滤波器比平移滤波器慢很多。方向精度和尺度精度分别取决于方向池和尺度池大小设置。与上述尺度和方向自适应方法相比,由于相关滤波跟踪算法采用了核回归和循环移位等技术,其可以有效解决目标形变、快速运动、部分遮挡等问题,并且由于使用了HOG空间特征,其对光照变化有鲁棒性。

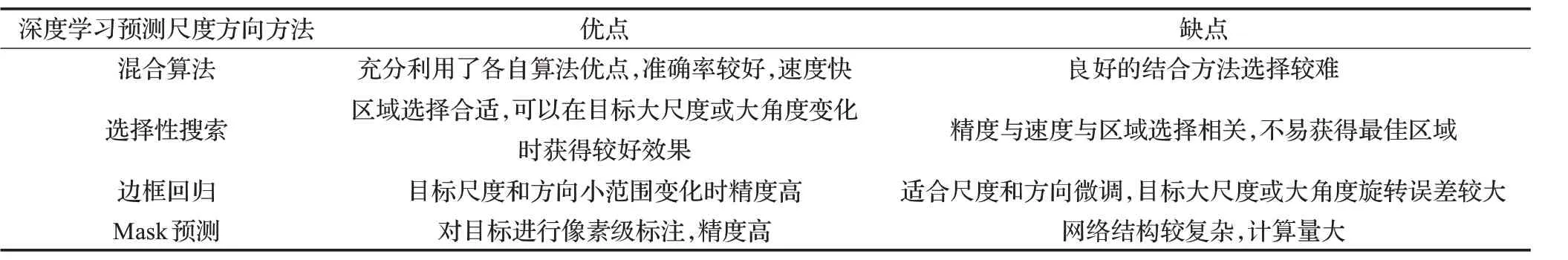

深度学习预测尺度和方向的几种方法在实验中都取得了较好效果,对部分遮挡、光照变化有较好适应,适合于复杂环境的目标跟踪任务。深度学习网络目标表示能力强以及预测任何输出,粒子滤波、相关滤波和光流等算法具有良好的目标尺度和方向变化处理能力,并有速度上优势,所以两者有机结合会提高跟踪性能。传统算法如何融入到深度学习框架中以及深度学习网络如何融入到传统算法框架中是关键;选择性搜索方法用多尺度、多方向测试,增加了计算量且不够精确;边框回归方法训练时选择的样本与Groundtruth 距离比较近,在one-shot detection 时,训练出的回归模型适合于前后帧目标变化较小情况;Mask 预测方法使用Mask 分支预测精度并不高,一般使用Refine Module 来提升分割精度,导致网络结构较为复杂。表3 给出了深度学习预测尺度和方向各种方法的优缺点。基于孪生网络的在跟踪精度和跟踪速度上得到了较好平衡。但孪生网络设计方案不需要在线模型更新,当目标发生较大的外观变化时,会造成目标候选框与目标模板出现较大差异,易导致跟踪失败,若要提升跟踪稳定性,需要有高效在线学习算法。另外,孪生网络对小目标跟踪效果不好,也是需要改进的地方。用卷积神经网实现目标分割,一般使用较深层次的卷积神经网,构建快速的小网络更具有实际意义。

5 展望

综上所述,未来的研究方向可以从以下几个方面来进行:

(1)基于深度学习尺度方自适应跟踪是主流研究方向。孪生网络框架下的目标跟踪是目前研究热点,孪生网络结构优化一直在进行中,出现了许多改进算法,主要是从均衡采样,多层特征融合,在线更新等方面考虑,改进后的跟踪性能得到了明显提升。对于孪生网尺度方向自适应未来研究可以从以下几个方面考虑:①Mask分支选择何种网络结构是关键,为了加快分割速度,简化结构是趋势,而且分割精度与数据量有关,需要大量训练样本。②视觉目标跟踪具有时空的相关性,可以使用深度学习模型来获取这种相关性。③多种尺度方向自适应策略结合有助于提高跟踪性能,因此,多种自适应策略结合方法,并增加全局优化是应该考虑的。如:采用MaskTrack 和SiamMask 多分支深度学习网络结构。④高效在线学习模型。分析环境上下文关系,自适应根据场景进行学习。⑤提升泛化性能。引入学习方法使深度网络具有one-shot learning 能力,提升对未知类别的泛化性能。⑥更精确预测。深度网络要能很好地分辨出目标差异,提高跟踪精确度。

(2)深度学习跟踪与其他算法结合使用具有潜力。文献[73]提出了MFT 跟踪算法,该算法基于ECO,并加入了卡尔曼滤波运动估计模块,深度模型使用ResNet。Danelljan[74]提出ATOM 模型,使用粒子滤波搭配IOU 预测,经过多次迭代得到目标结果。两种算法在VOT 测试中表现了良好效果。所以,传统算法与深度学习取长补短,两者结合具有潜力。

(3)长时间目标尺度和方向自适应跟踪仍是难题。目标跟踪的目标是保持长时间稳定的跟踪。正确跟踪时间要达到几分钟或十几分钟。但是,在各种复杂环境下,随着跟踪进行模板必然会漂移。所以,short-term tracker+detecter(短期跟踪+检测)配合才能实现正确的长时间跟踪。跟踪过程中不仅要考虑尺度、方向变化、而且考虑目标形变、快速运动、以及遮挡、光照等情况。

表3 深度学习预测尺度和方向方法比较

6 结语

在VOT2015[67]时提出使用旋转矩形框来标识目标,在VOT2016[75]时提出自动的通过Mask掩码来生成旋转框的方法,Ground_truth 标注的跟踪框转向像素级。可见尺度和方向自适应目标跟踪已成为今后目标跟踪发展趋势。

本文对现有主要尺度和方向自适应目标跟踪主要算法进行分析和总结,可以得出:基于深度学习的尺度和方向自适应跟踪已成为了一个研究热点。其不论是在精度或是鲁棒性上,表现都比经典的跟踪方法有较大的提升。但是由于跟踪场景的复杂性,仍然没有完美的解决方案。因此,设计出一种鲁棒性强、实时性好、适用面广的自适应尺度和方向的目标跟踪算法是业界内的一个长期奋斗目标。