起毛工艺后织物表面绒毛质量的视觉检测方法

金守峰,林强强,唐 凡,高 磊

(西安工程大学 机电工程学院,陕西 西安 710048)

随着人们物质生活质量的提高,对织物的时尚性、舒适性等性能要求也在不断提升。为了增加织物的外观时尚性、手感及保暖性,在织物表面进行起毛整理,使织物表面获得一定厚度,且分布一致的绒毛,该绒毛的状态影响着起毛后织物表面的性能和质量[1-2]。由于织物起毛后其表面绒毛的长度和形态较为复杂,现阶段对织物起毛的绒毛质量的检测方法主要以有经验的工艺人员通过视觉和触觉的主观判断为主,检测人员的主观经验起主导作用,无法量化绒毛质量参数,检测的精度和效率较低。

机器视觉技术在纺织品表面检测中已广泛应用,在织物表面疵点检测中,MAK等[3]利用可匹配多层次的Gabor函数滤波器检测织物瑕疵;JING等[4]利用Mean Shift滤波算法、小波变换和神经网络融合算法有效的提取了织物疵点的细节特征;李春雷等[5]利用方向梯度直方图和低秩分解算法实现了织物疵点的快速分离,有效提取织物疵点特征;杨曼等[6]利用二维Otsu算法在效保留织物图像的边缘信息的同时快速检测出织物疵点;何峰等[7]提出窗口跳步形态学法纹理织物疵点检测算法,该方法检测速度超过80 m/min,疵点检测精度为0.1 mm;KIM等[8]利用织物纹理的周期性,采用傅里叶变换将织物图像变换至频域,在频域内完成了织物表面起球的有效分割;汪亚明等[9]应用小波变换及Gabor滤波实现了织物毛球的分割;周圆圆等[10]在频域中完成织物图像分割的基础上,建立织物起毛起球等级评价指标;杨松林等[11]将织物表面弯折一定角度,采用0.7~4.5倍的放大镜头获取织物表面绒毛的微观截面图像,建立了绒毛率检测的数学模型,实现了织物表面采样长度400 mm内的表面绒毛率的测量,该方法由于采样长度较小,不能真实反映整幅织物表面的绒毛状态。

为了提高织物在起毛工艺后的绒毛质量检测效率、量化绒毛质量参数,本文提出了面向纺织智能检测的织物起毛后表面绒毛质量参数的视觉检测方法。该方法通过视觉系统获取织物表面绒毛的切向图像,提取绒毛与底布的亚像素边界,以最小二乘法拟合基准线,在此基础上构建绒毛厚度、间距的数学模型,实现绒毛质量的量化及高效率检测。

1 光切成像原理与自适应图像分割

1.1 光切成像原理

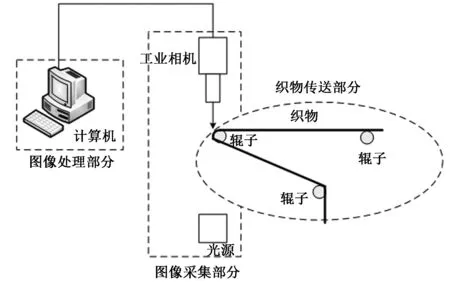

通过起毛工艺在织物表面形成具有一定厚度的致密绒毛,为了获取织物表面绒毛厚度与分布状态信息,本文采用光切成像原理,如图1所示。

图1 光切成像原理

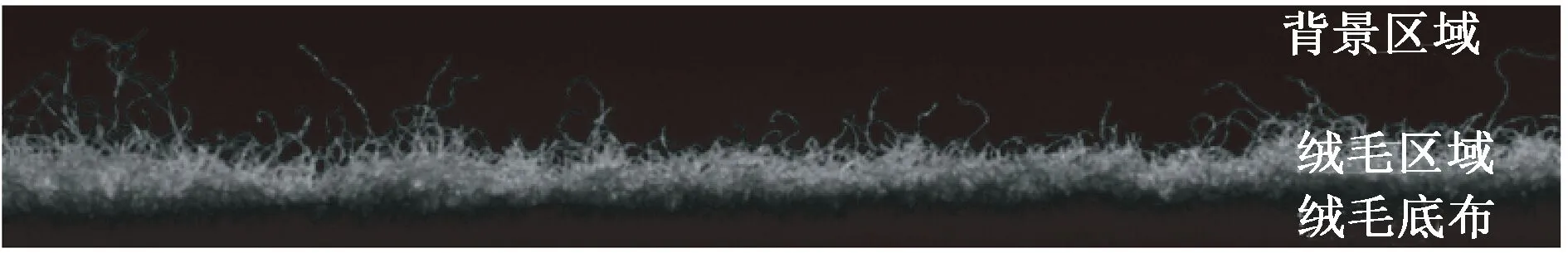

相机与条形光源分别置于被测织物的两侧,条形光源置于辊子的正下方,使光线与辊子轴向轮廓边缘相切,采用背景光成像可以避免受织物表面纹理及颜色特征的干扰,突出被测织物表面的绒毛边缘轮廓。织物包覆在辊子表面,随辊子匀速转动,当旋转至拍摄位置时,织物表面的绒毛在辊子的张力作用下绒毛厚度及分布状态最为明显,此时相机所获取到织物图像如图2所示。

图2 绒毛织物切向图像

1.2 自适应图像分割

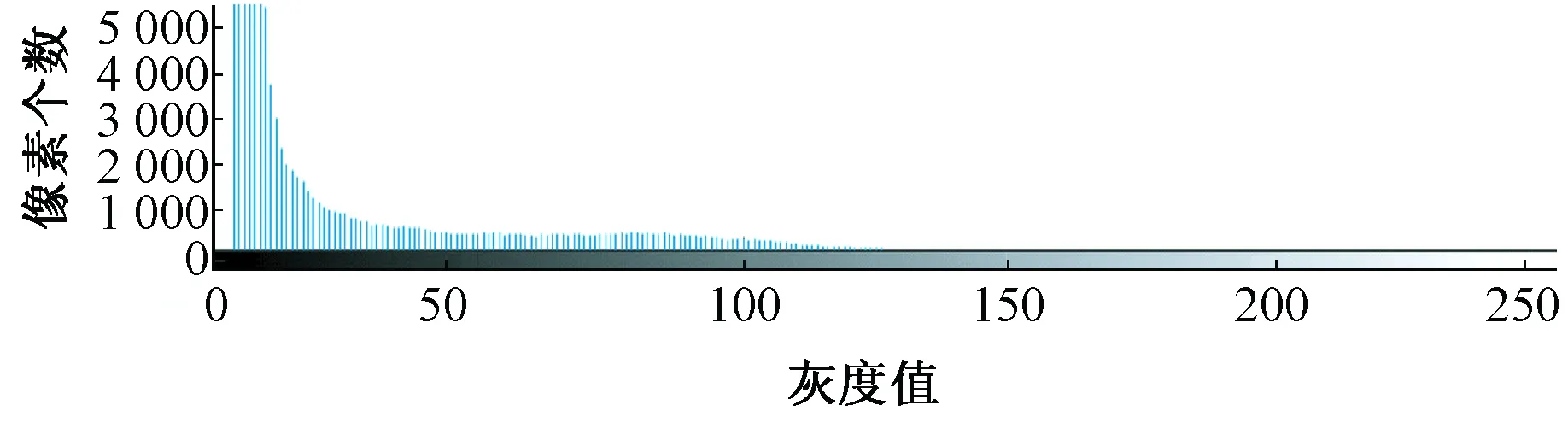

将图像进行分割,将绒毛区域的特征提取出来,同时将背景区域和底布分开。由图3所示的灰度直方图分布特征,利用最大类间方差法对图像进行自适应分割来提取绒毛区域特征,如图4所示。

图3 灰度直方图

图4 绒毛区域

2 基于绒毛与底布边缘的基准线拟合

2.1 绒毛与底布边缘的亚像素定位

绒毛与底布边缘是绒毛区域的开始,以此作为绒毛厚度评定的基准。在经典的Canny算子进行边缘像素级检测的基础上,利用改进的Zernike矩对边缘进行亚像素的精确定位。

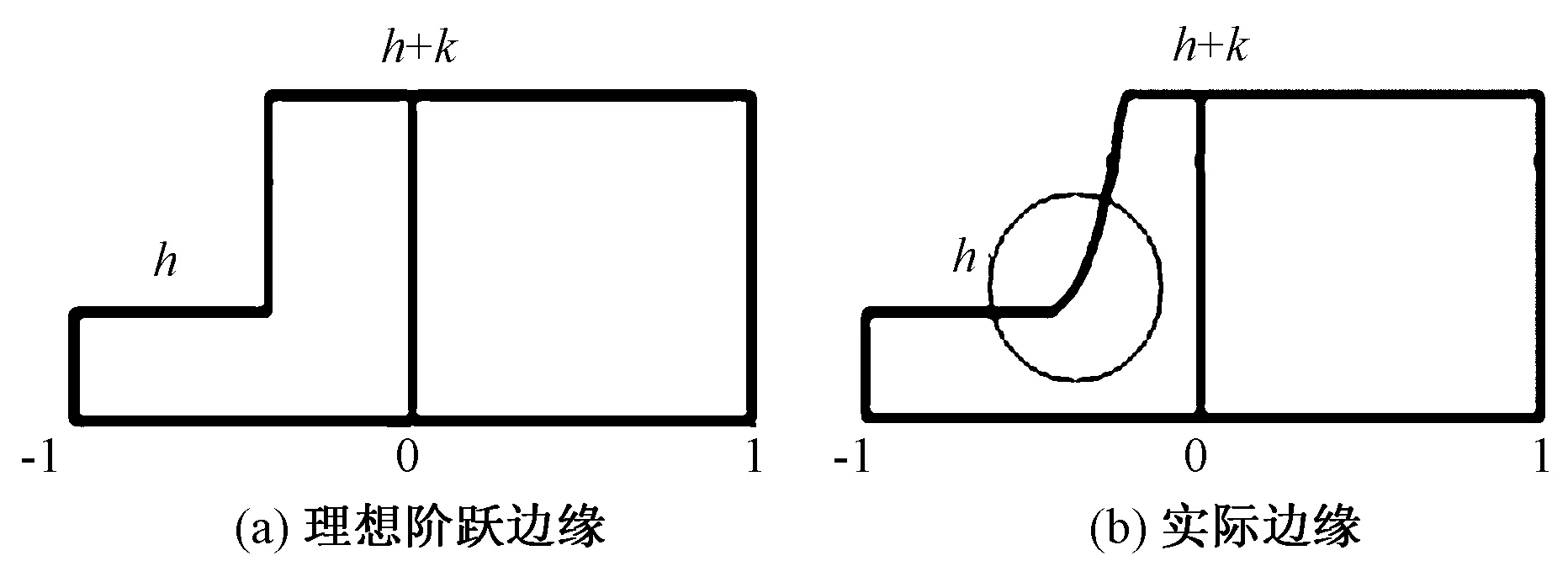

绒毛图像构造的边缘模型如图5所示。其中:圆心位置O为绒毛图像中的某个像素点,h为绒毛图像的背景灰度,k为阶跃灰度,则斜线部分的灰度值为h+k,在边缘垂直线与x轴的夹角为ø时,圆心到边缘的垂直距离为l。设绒毛与底布边缘为f(x,y)将该圆分割成2个部分,则边缘f(x,y)的n阶m次Zernike矩定义为[12-13]:

(1)

图5 构造的边缘模型

将图像顺时针旋转角度φ(图5(b)),使φ=0,则边缘f(x,y)与y轴平行,旋转后的边缘为f′(x,y),则有:

∬x2+y2≤1f′(x,y)ydxdy=0

(2)

(3)

图像旋转角度为:

φ=arctan(ImA11/ReA11)

(4)

由于Zernike矩具有旋转前后相角改变,幅值不变的特性。由此可推导出A00、A11、A20所对应的积分核函数为:

V00=1

V11=x+jy

V20=2x2+2y2-1

旋转后图像的Zernike矩为:

(5)

(6)

(7)

由(5)、(6)、(7)式联立可求解其参数为:

在绒毛与底布边缘检测中采用N×N的模板,其中N为模板大小/(pixel);对放大效应进行修正,利用Zernike矩进行亚像素边缘检测的计算公式为:

(8)

式中:xi,yi为亚像素坐标值;x,y为原点坐标值;l为垂直距离。

由式(8)推导出的理想阶跃模型边缘如图6(a)所示,但由于获取的绒毛与底布边缘存在如图6(b)所示的过渡区域。

图6 亚像素边缘模型

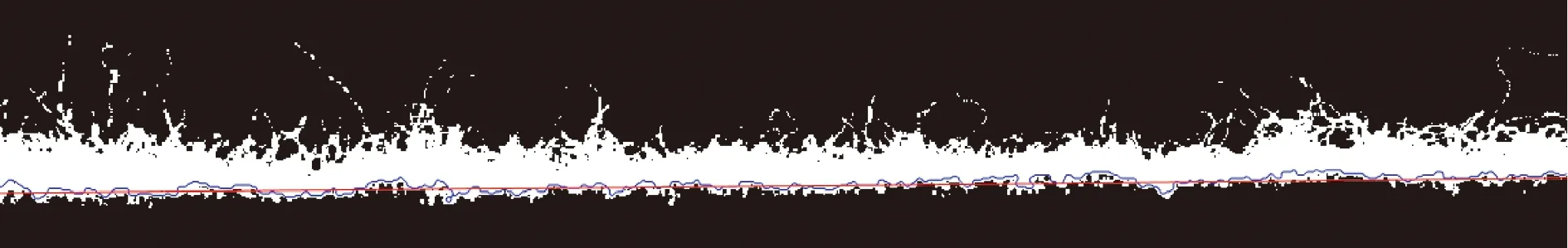

在传统的Zernike算法中,由于阶跃灰度k的范围较大,阈值T制约着绒毛与底布边缘的判断结果以及算法的精度。本文根据绒毛与底布边缘的过渡区域的灰度值与阶跃灰度值在同一像素点具有变化趋势相同的特点,基于阶跃灰度的最大类间方差法到最优的阈值T。通过改进的Zernike算法得到如图7中蓝色线所示的绒毛与底布的亚像素边缘。

图7 绒毛与底布的亚像素边缘

2.2 基准线拟合

将绒毛与底布的边缘进行最小二乘法拟合后,将其作为评定绒毛厚度的基准线。设图像坐标系为x-o-y,绒毛与底布边的亚像素边缘为f(x),最小二乘拟合基准线的回归方程为

y=ax+b

(9)

回归系数分别为:

(10)

(11)

式中:m为采样点数;xi为采样点x轴坐标;yi为采样点y轴坐标。

3 绒毛质量参数评定模型

为了对起毛工艺后的绒毛表面状态进行量化评定,本文建立了厚度参数模型和间距参数模型,综合评定绒毛质量。

3.1 厚度参数

对于起毛厚度的量化评定,建立了厚度参数(Ra),在采样幅宽范围内,绒毛边缘各点距离基准线距离的算数平均值,设绒毛边缘为g(x),则厚度参数可表示为

(12)

式中:K为物面分辨率;n为幅宽内边缘点个数。

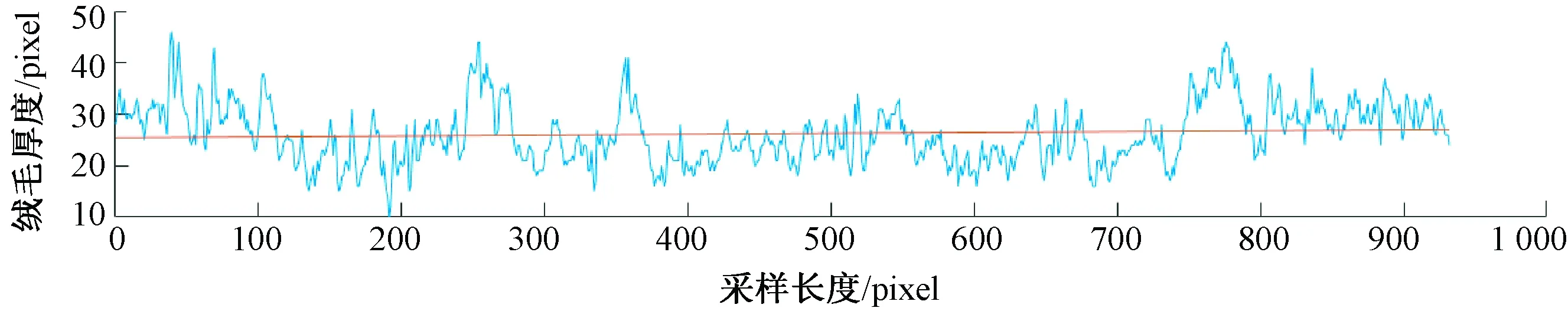

对图7所示的绒毛区域进行Y轴方向的投影计算,得到厚度变化曲线如图8所示,其均值为Ra。Ra越大,则绒毛越高、越厚,客观地反映绒毛在厚度上的几何状态。

图8 绒毛厚度变化曲线

3.2 间距参数

对于起毛后绒毛在织物表面的分布稀疏程度,本文在厚度参数评定基础上,通过厚度变化曲线建立间距参数来评定。间距参数是以厚度均值作为基准线,厚度曲线被基准线所截取的线段综合与幅宽的比值作为间距评定参数,可以表示为:

(13)

式中:m为轮廓单元的个数;其能Xs为轮廓单元。

Rsm越大,则绒毛越致密,客观地反映绒毛在间距上的特性。

4 试验与数据分析

4.1 试验平台

由图1的成像原理构建了如图9所示的织物起毛后表面质量的视觉检测试验平台,起毛后的织物放置在传送带上,由控制装置调节其运行速度,调速范围为0~50 m/min。视觉采集系统采用AVT GE1050工业相机,分辨率为1 024 pixel×1 024 pixel,帧率为59 fps。镜头选用Computar镜头,焦距为8 mm。光源为条形LED光源,光线经磨砂玻璃形成散射,保证亮度和照射方向的均匀性。相机安装在距离织物表面300 mm的位置,相机光轴与传送带的中线垂直,采集绒毛织物的幅宽范围为500~800 mm。

图9 视觉检测试验平台

4.2 视觉系统的标定

相机将视觉坐标系中的绒毛表面映射到图像坐标系的像素点,二者的位置之间存在确定的对应关系,要得到织物表面绒毛的信息必须确定每个像素所代表的真实物理尺寸,即物面分辨率。实验中以标准量块作为标定物,将标准量块置于传送带上,调节相同的照明条件与物距,经多次测量得到的物面分辨率K=0.358 mm/pixel。

4.3 试验结果与分析

为了验证本文方法的精度和稳定性,对4种绒毛织物在运行速度为20 m/min,采样幅宽700 mm的试验条件下进行多次测量,起毛织物试样见图10。可以看出,图10(a)为头道起毛工艺后的织物,织物表面生成的绒毛厚度不致密,且分布不均;图10(b)、(c)、(d)为不同颜色织物的末道起毛工艺后的表面状态,绒毛致密且分布均匀。

对图10的4种不同颜色、不同起毛工艺的织物表面绒毛状态采用本文方法及人工方法进行评定结果如表1所示。由表1可知,根据本文方法得到评定参数对织物表面绒毛质量的评定结果与人工评定的结果保持一致,且给出了织物绒毛的客观评定参数,将其作为质量评定的依据。本文方法对织物的颜色不敏感,具有较好的评定效果,可实现代替人工来进行织物起毛后表面质量的评价。

5 结 论

①为了客观评定起毛工艺后织物表面绒毛质量,提出了基于机器视觉的绒毛质量检测方法,具有客观、量化、快速、准确的特点,能够在起毛工艺的终端及过程中对绒毛质量进行在线检测。

②采用光切成像原理获得了清晰的绒毛轮廓图像,以最大类间方差法有效地分割出绒毛区域。在分析Zernike矩算法的基础上结合绒毛与底布边缘的特征,提出了改进的Zernike矩算法提高了绒毛与底布边缘的亚像素定位精度,并通过最小二乘法拟合出基准线。

③建立了评定绒毛质量的厚度参数模型和间距参数模型,采用标准量块对试验平台的视觉系统进行标定,对4种不同织物进行绒毛厚度和覆盖率的测量,并与人工评价结果进行对比,结果表明:所研究方法实现织物起毛后表面绒毛质量的参数量化,且对织物颜色不敏感,评价结果与人工评价相一致。