韩国人工智能规制现状研究

[韩 ]尹玟燮 著

栗鹏飞 王 淼 译

2016年3月,在与李世石九段的5局对弈中,谷歌(Google)制造的人工智能“阿尔法狗”以4比1获胜,令全世界瞩目。在李世石和“阿尔法狗”的围棋对弈之后,韩国对人工智能的兴趣日益高涨,最近结合第4次工业革命的热点,全产业领域利用人工智能技术的事例正在增加。人工智能主要被用于经营策略树立、金融资产运营、客户答疑、撰写文章和音乐创作等多种目的。在韩国金融领域中因使用人工智能的“机器人顾问”而闻名①机器人投顾(RoboAdvisor)作为机器人(Robot)和顾问(Adviser)的合成词,指的是通过事先程序性的规则(主要以价格数据等为对象,借助大数据分析、最佳投资战略)可以进行投资决定和财产配定的程序性行为,抑或者指的是该程序本身。,最近在互联网门户网站Naver上的报道排列据称也运用了人工智能。在“11号街”等网上购物中心,为了接待顾客及推荐商品,也正在使用人工智能。据推测,像这样使用人工智能的事例并不是仅限于金融领域,而是在各个领域都存在。

在韩国,对人工智能的看法既存在肯定的方面,也有否定的方面。使用人工智能的情况下,交易成本降低、产量缩减、与市场环境相适应的最佳价格设定等工作效率的提高是肯定的层面;就业岗位减少、个人信息侵害等类似的副作用是否定的层面。但是仔细审视报道内容,比起否定性的报道,肯定性的报导形成了主流。韩国目前关于人工智能的规制体系和内容并不明确,还处于热议的初始阶段。但是,随着民间领域使用人工智能事例的不断出现,对人工智能相关的规则和内容的动向加以分析研究就很有必要。

一、关于人工智能的概括性规制

(一)智能机器人开发和普及促进法

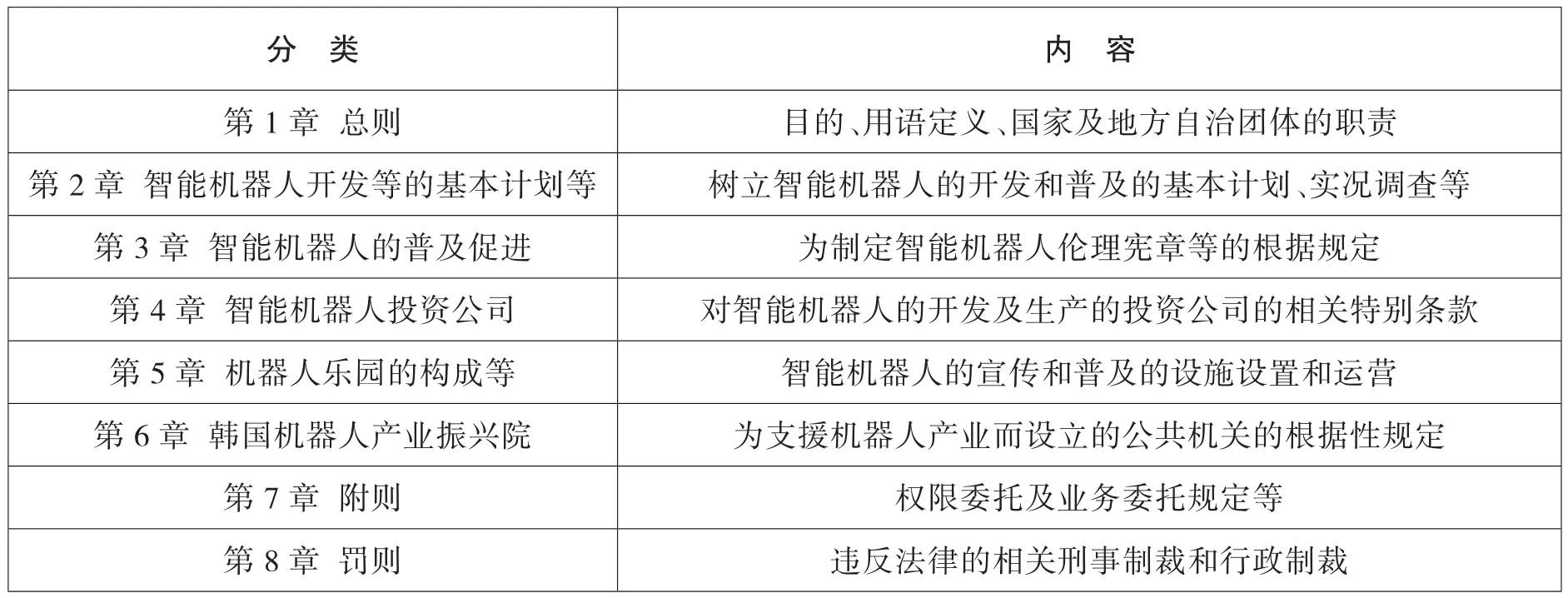

为了促进智能机器人的开发和相关产业的发展,《智能机器人开发和普及促进法》(以下简称“《智能机器人法》”)于2008年制定。该法对“智能机器人”定义为“自行识别外部环境并判断情况,进而自主操作的机械装置”,根据这一定义,仅以软件形式存在的人工智能很难被囊括其中。于是,2018年6月12日通过修正案以包含软件在内的形式变更了定义(表1)。因此,除了单纯的电算装置外,与之相连的人工智能也包含在智能机器人中。

表1 “智能机器人”的定义修订

表2 《智能机器人法》主要内容

《智能机器人法》共由8章49个条文构成,根据该法规定,要针对智能机器人制定伦理宪章,但迄今为止尚未制定。据悉,最近韩国科学技术信息通信部考虑到智能信息技术的复杂特性,为制定伦理宪章提出了公共性、责任性、可控性和透明度等4大原则和其指导下的开发者、供应者、使用者的细部方针,而酝酿中的“第4次工业革命时代伦理方针”草案等相关程序正在进行。

(二)制造物责任法

《制造物责任法》于2000年制定,旨在保护消费者因产品缺陷造成的损害,并被视为是针对韩国《民法》第750条规定的一般损害赔偿责任的特别法。关于人工智能是否适用《制造物责任法》的研讨正在进行中。下文中对人工智能是否能适用《制造物责任法》进行研究。

1.人工智能的制造物属性

要适用《制造物责任法》,首先要判断人工智能是否属于《制造物责任法》上的制造物。《制造物责任法》第2条第1号规定“制造物”是指制造或加工而成的动产(包括其他动产或部分不动产的一部分)。一方面,《制造物责任法》第4条第1项第4号规定:“原材料和零部件的情形,是因使用该原材料或零部件的制造业者对设计或制造的相关指示而发生缺陷的事实”,确定了放入产品的原材料或零部件的制造业者的免责事由。换言之,制造物责任法不仅认定了产品的制造业者的制造物责任,而且也认定了对原材料或零部件制造业者的制造物责任。①要求制造物的部件制造者承担制造物责任的立法例有:《美国不法行为法》第3次法律重述第5条,《法国缺陷制造物责任法》第1389条之8,《德国制造物责任法》第4条第1项,《欧共体立法指南》第3条第1项,《日本制造物责任法》第4条第2号等。参见李相洙:《关于嵌入软件缺陷与适用制造物责任的考察》,《法学论文集》第39辑第2号,中央大学法学研究院(2015),第93页。因此,如果人工智能可以被视为一种制造物,受害者就可以选择向人工智能的制造商或运营商要求损害赔偿。讨论人工智能算法的制造物属性的意义在于,如果人工智能算法的制造物属性得到认可,那么对受害者的救济有相当大的帮助。

对于人工智能是否可以被视为《制造物责任法》上的制造物,肯定与否定的见解并存。首先,从认可人工智能的制造物属性的观点来看,根据人工智能提供服务的方式存在些许差异。人工智能向消费者提供服务的方式大致可分为两种,一种是采用软件与硬件相结合的形态提供服务的方式,另一种是仅凭人工智能提供服务的方式。近来流行的智能音箱就是前一种方式,机器人顾问等形式与后一种方式相同。就前者而言,有观点认为,认定其制造物没有太大困难;②梁宗模:《人工智能的危险特性和法律限制方案》,《弘益法学》第17卷第4号,弘益大学法学研究所(2016),第553页。在后一种情况下,人工智能也是软件,不能与存储媒介分离,由此其制造物属性被认定。③许明国:《标准电脑程序交易的法律性质:对授权说及混合合同说的批判性立场》,《比较私法》第16卷第3号,韩国比较私法协会(2009) ,第38页;金敏仲:《制造物责任法立法化的最新国际动向》, 《Justice》第25卷第2号,韩国法学院(1992),第31页。在美国和德国,多数观点认为,当软件在USB等类同存储媒介中物化时,通常被视为制造物。④郑龙寿等:《制造物责任法修订方案》,《政策研究》,韩国消费者院(2010),第26页;李相洙:《关于嵌入软件缺陷与适用制造物责任的考察》,《法学论文集》第39辑第2号,中央大学法学研究院(2015),第26页。相反,否定说认为,软件既非有形物又非自然力,因此其产品属性难以被认定。⑤裴大宪:《扩大作为交易对象的数码信息和物品概念的相关检讨》, 《商事判例研究》第14卷,韩国商事判例学会(2003),第307页。

目前,对人工智能的产品属性的研讨不足。前面的观察探讨也是以普通软件而非人工智能为前提。虽然人工智能也可以被称作软件,但与现有的普通软件的不同点在于,它并没有像商品一样销售,而是以向消费者提供服务为目的。另外,人工智能与硬件或存储装置的结合并不能说是必须要素。例如,像最近的智能音箱等类似的情况,可以看到人工智能和音箱相结合,但如果音箱未和网络连接,则无法提供人工智能服务。最终,智能音箱中音箱只不过是网络连接装置,人工智能是通过网络连接提供服务。另一方面,《制造物责任法》自2000年制定以来就以有形物为前提,其间经过两次修订,这个大前提没有变更,因此,根据目前的《制造物责任法》难以认定人工智能的制造物属性。

2.是否属于《制造物责任法》上的缺陷

即使可以认定人工智能的制造物属性,也会产生一个争议点,即因为人工智能造成的损害能否被认定为缺陷。《制造物责任法》第2条第2号规定:“所谓‘缺陷’是指相关产品符合下列各项中任何一项的制造、设计或标识缺陷,或其他通常可预期的安全缺陷。”此时对安全性没有明确定义,但该法第3条第1项规定,因缺陷导致生命、身体或财产损害发生的情况,考虑到让制造业者承担损害赔偿责任这点,所谓安全性的意思可以说是制造物不会给使用者造成生命、身体或财产损害。

那么,因人工智能给消费者等造成了损害的话,能否判断人工智能有缺陷?对此没有明确的定论,甚至连探讨也没有。只是安全性要件包括财产损害,所以因人工智能的行为给消费者造成了损害的话,则可能被判断为缺乏安全性,也可能被判断为属于制造物责任法上的缺陷。例如,智能音箱在消费者预订饭店时出错,给消费者造成了财产损失的情形,可以被称为制造物责任法上的缺陷吗?《制造物责任法》规定的财产损失是指因制造物造成的任何物理事故以及由此产生的财产损失。因此,很难说由于人工智能的错误而未能正常实现服务属于产品责任法案中的缺陷。只是,如果搭载人工智能的机动车辆自动驾驶中,由于运转不正常踩下了急刹车,从而给消费者造成身体上、财产上的损害,则可以看作是由于缺陷而引起的。

假设像这样人工智能的制造物属性可以认定的情况下,对人工智能的《制造物责任法》上的缺陷能否认定则取决于具体事例。但是,如果人工智能直接向消费者提供服务,同时伴随物理现象的情况,可以认定为《制造物责任法》上的缺陷。反之,如果情况并非如此,则难以认定存在缺陷。即使是基于人工智能的数字卡特尔也能帮助经营者作出决策,或者代为履行职责,所以人工智能也可以说和《制造物责任法》没有关联性。

3.“监管沙箱”的相关法案

所谓“监管沙箱”可以被称为是在一定期限内对现有规制免除或者推迟的制度。沙箱是填满沙子供儿童玩耍的空间,是儿童在游戏过程即使摔倒,沙子也能最大限度减少负伤等安全隐患的空间。因此,为了促进事业发展,减少因规制等造成的危险,我们需要创建一个像沙箱这样的制度。

关于人工智能,在进入规制、营业行为规制等事前规制强有力的领域的情境,树立内部经营战略,利用人工智能并不受限,但在投资咨询、全权委托投资等同类营业活动上,全面使用人工智能事实上是不可能的。越是在规制强力的领域,“法律没有规定的就不能做”的认识越强烈,所以人工智能和相关产业处于困难的发展环境。为了解决这一难题,最近“监管沙箱”和相关的《行政规制基本法部分修订法案》《金融革新支持特别法案》《产业融合促进法部分修订法案》《信息通信振兴及融合活性化等相关特别法部分修订法案》等5项法案在国会上被提出。

从5项法案的主要内容来看,核心是新项目推进者可以就相关规制向政府提出质疑,经过审查被认定为特例的情形时,在一定期间内免责适用相关规则。

二、具体的规制现状及讨论

韩国目前对人工智能的相关规制是以事前规制的方式进行的,没有明确规定事后规制方式。根据前述的《智能机器人法》,预计只采取《伦理宪章》等基本的事后规制为原则的方式。

原则上,人工智能适用什么样的规制是根据使用的方式不同而不同。例如,在金融领域,金融公司为了内部的资产运营而使用机器人顾问的情况下,无需接受金融监督当局的事前审查。金融公司的机器人顾问接受事前审查的理由是使用该机器人顾问运营顾客资产。在下文中,将对有关金融领域的机器人顾问的规制现状、有关数字卡特尔的规制讨论等有关问题加以探讨。

(一)对机器人顾问的规制

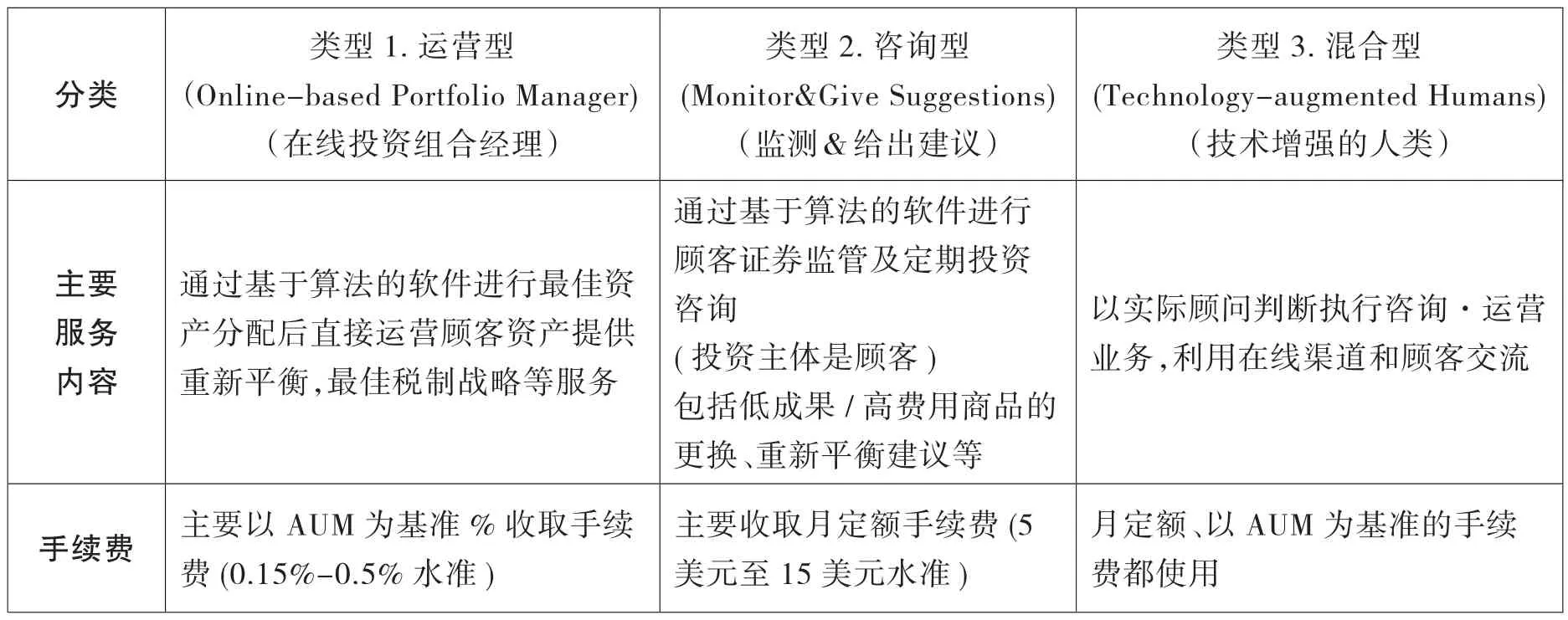

机器人顾问(RoboAdvisor)是“以机器人(Robot)和顾问(Advisor)的合成词为基础,基于对算法、大数据分析等技术反映的个人投资倾向等,自动生成‘构建投资组合’‘再平衡(重组)’,并加以‘应用’的在线资产管理服务。”①李根永:《国内外智能投顾的动向及现状分析》, 《电子金融与金融安全》第6号(2016),第38页。简略地说,就是使用人工智能的资产管理服务。过去的资产管理服务是金融公司以资本家顾客为对象提供的服务,但由于人工智能的问世,其对象扩大到普通大众。在美国,机器人顾问已经得到广泛应用,机器人顾问的类型可以分为运营型、咨询型、混合型等。

表3 机器人顾问的类型②参见 金融投资协会: 《全球网络资产管理产业动向及启示》,2014年7月8日。

韩国拥有以规制为中心的法律体系,所以,在个别金融业法中严格规定了金融规制的要件和课税与否等,监管当局能够赋予的自由裁量余地非常有限。因此,现行的金融服务仅能通过启动在和实际金融市场相类似的虚拟环境中才能进行事前检测的虚拟测试台(Virtual Test-Bed)来允许合格的机器人顾问的方式进行规制。

为此,金融委员会已于2017年5月通过部分修订《金融投资业规定》,制订“电子投资建议装置(机器人顾问)细部要件(第4-73条的2)”,以搞活投资咨询业相关事宜,维护为执行机器人顾问投资咨询及全权委托的投资行为。规定了具备确保维护人员、禁止有偏见的投资咨询、通过测试床等要件。

在韩国,机器人顾问现在处于起步阶段,向投资者推荐资产构成等,可以分为投资者直接运营的“咨询型”和机器人顾问不只是推荐而且还直接参与资产运营的“全权委托型”。届时,根据顾客及咨询人员的参与与否,可以分为4个阶段。

表4 使用机器人顾问(RA)的服务类型分类

目前,韩国对机器人顾问的测试台正在运营中,但至今为止非会面的全权委托尚不被允许,第4阶段是不可能的。但据悉,最近金融委员会在具备要件的情况下,将允许非会面全权委托方式,所以,预计不久后第4阶段将被允许。

如果今后引进“监管沙箱”,可以预想“虚拟试验台”(Virtual Test-Bed)通过与否的审查基准将取决于人工智能的使用方式。但是,即使引入“监管沙箱”,在金融领域的人工智能使用给消费者的财产等带来直接影响的情况下,预计事前审查仍是义务,这一点毋庸置疑。

(二)数字卡特尔(digital-cartel)

1.“数字卡特尔”概述

“数字卡特尔”是指人工智能被用于公司之间的串谋,也被OECD(经济合作与发展组织,Organization for Economic Cooperation and Development)作为主要议题讨论过。①OECD, “Algorithm and Collusion-Background Note by Secretariat” (2017)(https://one.oecd.org/document/DAF/COMP(2017)4/en/pdf).根据OECD推出的白皮书,②OECD, supra note 3.企业们不要求通过算法在传统反垄断的意义上达成“合意”,甚至以都不要求人类互动的新方式提供能够引出串谋结果的机会,③白皮书促进了算法对竞争法无法掩盖的市场成果(market outcome)的默认性调整(tacit co-ordination),这就表明可以向公司提供发送信号、采取同样的政策、脱离消费者监督的惩罚的自动化算法。并且强调了所谓的随着时间的推移扩张“垄断问题”的范围的话将实现进入高壁垒、高透明度的寡头垄断市场与传统的默示性串谋结果,在难以维持的市场中比起算法如何达成默示性的串谋更应该明白算法能否实现这一目的。由此可见竞争格局将如何被改变。

谷歌的人工智能研究的DeepMind最近发表的研究资料中对人工智能在类似“囚徒困境”的状况中如何行动的研究结果显示,④Joel Z.Leibo·Vinicius Zambaldi·JanuszMarecki·Marc Lanctot·Thore Graepel, Multi-agent Reinforcement Learning in Sequential Social Dilemmas, Proceedings of the 16th Conference on Autonomous Agentsand MultiAgentSystems(AA-MAS 2017)(S.Das et al.eds.,2017)(https://storage.googleapis.com/deepmind-media/papers/multi-agent-rl-in-ssd.pdf;https://arxiv.org/pdf/1702.03037.pdf).人工智能会根据目标采取不同的行动,表现出和人类相似的行动模式。DeepMind进行了两项实验:第1项是收集很多苹果的游戏。在这个游戏中,如果苹果充足的话,人工智能不会攻击其他人工智能,但如果苹果不足的话,则看到人工智能攻击并清除其他人工智能的行动。据说,如果是更强大的人工智能,即更被精心设计的人工智能,尽管自己收集的苹果充足,也会为了独占先攻击其他人工智能。如果将其适用于现实,有类似规模的经营者的情况下,起初并不互相攻击,但在资源或市场萎缩的时候,就会采取诽谤或攻击其它经营者的态度,可以想象一旦大企业出现,大企业就会攻击其他中小经营者以垄断市场。第2项游戏是“狼群”(Wolfpack)游戏。狼群游戏的内容是狼组队狩猎,若是一个玩家狩猎成功,周围的其他玩家都会得分,所以这是一种人工智能成为狼追寻食物,捕获到食物的时候给它周围所有的人工智能予以补偿的游戏。即,这算是一场合作比攻击更有利的游戏。在这个游戏中展现出越是被精心设计出来的人工智能就越不是独自而是与其他人工智能合作狩猎的面貌。也就是说将此应用于现实的话,人工智能之间也有相互合作的样态,换句话说,它们也可能相互串谋。

总之,该研究结果证明,根据规则和情况,人工智能采取的行动不同。换句话说,在攻击会取得利益的规则下,人工智能会采取攻击性的行动;在合作能看到利益的情况下则会进行合作。最近,在美国和欧洲等地的数字卡特尔事例中,经观察出现了人工智能伙同串谋和以人工智能为媒介的串谋等现象。

韩国公正交易委员会也曾在2017年7月24日对成为全球热点话题的“数字卡特尔”的监督加以阐明,提及竞争企业有可能会利用算法一致决定商品价格、供应量的行为进行串谋,具有可见隐患,①电子新闻(Electronic Times)2017年7月24日版报道,“公平交易委员会委员长金相祚表示‘数字经济’与算法合谋”,http://www.etnews.com/20170724000405。以学界为代表的诸多领域也开始着手研究数字卡特尔。②崔兰雪轩:《通过算法交换价格信息和竞争法的评价》,《经济法研究》第35卷(2017);金建优:《用算法运作的经济数码卡特尔增大的可能性》, LG经济研究院 (2017)。

2.数字卡特尔的事例

具有代表性的数字卡特尔的事例有:Topkins·Aston③Plea Agreement, United States v.David Topkins (April 30, 2015) ; Information, Plea Agreement, United States v.David Topkins(April 6, 2015).,Uber,ATPCO④United States v.Aston, No.3:15-cr-00149 WHO (N.D.Cal.Aug.27, 2015).,E-turas⑤Case C-74/14 Eutras, ECLI:EU:C:2016:42, 21 January 2016.等。本文对Uber事例简略观察如下:

居住在康涅狄格州的Uber顾客Spencer Meyer以Uber和 Uber的CEO Travis Kalanick为被告向纽约南区联邦地区法院提起了禁止串谋的诉讼。当时Uber向出租车司机提供了搭载根据供求状况自动调节费用的“弹性收费制”(Surge pricing)算法的人工智能服务。当时出租车司机直接将Uber提供的出租车计费标准适用于消费者。Spencer Meyer主张:“Uber公司在同一公司的计算机平台的算法中企图通过限制司机之间的价格竞争,起到构筑和推进固定价格的卡特尔的作用。”但是Uber公司辩称:“每一个司机都是独立行事的,只不过是与Uber公司分别签订了合同,并不存在横向垄断协议。”纽约南区联邦地区法院判决认定:“根据Uber公司的合同条件和应用程序(app),有可能有横向的共谋(串谋)。Uber公司的系统会遏制司机进行降价竞争,使卡特尔稳定化获得超额利润的可能性提高的同时,以人工智能为媒介的Uber和使用它的出租车司机共谋出租车费用,形成卡特尔垄断。⑥U.S.District court Southern District of New York (2016), “Meyer v.Kalanick”, Opinion and Order.

3.数据卡特尔的类型

OECD把重点放在了人工智能的行为上,并将其分类如下:

表5 OECD的数字卡特尔类型

(1)第一种类型的监控算法,是使用人工智能对已经参与串谋的经营者,在串谋中是否有脱离的行为进行监控。监控算法的运作方式相当简单,通过各种数据将收集的价格等交易信息与特定的价格(例如串谋价格)相比较,一致的话维持串谋,不一致的话,看到脱离串谋,将与其他经营者一起对脱离的经营者给予报复性攻击。虽然这是在人工智能出现之前就已经存在的方法,但如果使用人工智能,价格等要素的分析就会更快实现,由此对脱离经营者的攻击也会迅速完成。因此,从经营者的立场来看,串谋中脱离的诱因将会减少,而持续串谋的诱因会增大。监控算法可以避开不必要的价格战,助长非法协议(illegal agreements),通过经营者之间的监视,使串谋更有效率。然而,由于卡特尔在形成和实现的过程中需要明确的沟通,只要价格和其他交易条件由人类调整,传统的反垄断工具就可以用来防止这种行为。①OECD, supra not 5, at 25~27.

(2)第二种类型的并行算法,意味着即使在参与串谋的经营者之间并没有明确的意思交流,也能为了使经营者及时对市场变化自动应对,而使用共同的人工智能,将经营者的交易条件等因素统一并固定下来。②Id.at 26.该类型大致可以区分为两种方式:一种是作为与前述相类似的Hub-and-Spoke类型,是经营者以同一人工智能为中心轴进行使用,经营者之间不存在相互的意思交流而进行的串谋行为的类型;另一种是即使经营者各自利用不同的人工智能,通过相似性的功能或者类似的设定,使得经营者中的1个人的价格发生变化,其他经营者也随之变更价格的类型。因为在价格跃动性非常高的市场中,经营者们为了对价格、生产量、其他交易条件等进行调整,需要随时以会议、电话通话、电子邮件或第三者进行沟通,但如果运用并行算法,经营者之间无需额外的程序也可以进行实际上的沟通。

(3)第三种信令算法的类型,是特定的领军经营者单方面地发布价格变动的信号,竞争经营者受领相应信号后变更价格的形态。领军经营者在其他经营者没有形成串谋价格的情况下,变动自己的价格时,重新向竞争经营者发送信号,最终达成一致的串谋价格,可以说是通过某种追从行为操纵价格的行为。由这样的追从行为导致与串谋相同的结果的情况下,对此是否可以认定为违法行为值得商榷。美国著名的竞争法专家Richard Posner教授曾担任联邦法院法官,在2002年审理的“玉米糖浆”一案的判决中判定:“如果某企业提高价格的同时,期待自己的竞争对手也会那样做,也实际上发生了那样的事的话,该企业的行为可以通过提出要求其他企业提高价格的单方面合同(offer of a unilateral contract)实现概念化。”即,如果能够预测到竞争经营者会做出追从行为的话,领军经营者的行为就可以看作是串谋提案的意思表示,竞争对手的追从行为则可以视为默示性的协议。

(4)第四种自我学习算法类型,是指人工智能通过深度学习和类似的自我学习算法,作为经营者追求利益的行为,对其他市场参与者的行为持续学习和再适应,以使具有强大预测能力的某种算法可以在没有人类介入的情况下进行串谋的类型。该类型与Ezrachi教授和Stucke教授分类中的 Autonomous Machine 类型相同。在这一类型中,经营者将各种原始数据(Raw Data)投入人工智能,人工智能对此加以分析,针对市场状况计算出最佳战略,此时经营者对其人工智能是否向竞争者发出信号,人工智能通过怎样的过程得出的结论都是无从知悉的。即,具有自我学习能力的人工智能与前述的谷歌的“deep mind”研究资料一样,可能会发生串谋和相同的结果,而自我学习算法类型的使用经营者可能不会认识到这个过程。但是如果市场状况很容易形成串谋局面的话,比人类学习速度更快的算法经过高速的反复试错,最终达到合作均衡(cooperative equilibrium)的可能性将更高。最终,依靠把经营决策从人类转移到用电脑机械学习,经营者们可以在串谋的开始与实现阶段中避免明确的沟通,即使无休止的反竞争性价格持续,自我学习算法也可以更容易地确定共同利益最大化并严重损害消费者的价格。①Id.at 31-32.像这样,企业依靠深度学习,串谋何时发生都无从得知就可以达成串谋的结果,使得传统的反垄断手段的使用变得更加困难,如果深度学习算法存在违法情形,企业是否承担责任将引发复杂的问题。②Id.at 32.

4.《限制垄断与公正交易法》的适用探讨

《限制垄断与公正交易法》(下称“《公正交易法》”)是旨在确保市场秩序及交易公正性的法律。公正交易法为确保市场秩序,在第19条规定“禁止不当共同行为即串谋”,在第23条规定,为了交易公正性,禁止不公正交易行为。《公正交易法》第19条规定:“经营者不得以合同、协定、决议等其他任何方式与其他经营者共同以不当的限制竞争而达成下列的任何一项协议(以下称为“不当的共同行为”)或不能让其他经营者从事该事项。”根据该条的规定,虽然对共同行为的方法没有限制,但是禁止为不当的限制竞争的行为进行“协议”,禁止让其他经营者不正当地限制竞争的行为。公正交易委员会对“行为和不当性”在“共同行为审查标准(公正交易委员会例规第235号)”中进行了明确。根据共同行为审查标准:2人以上的经营者进行协议的,不仅包括合同、协定、协议、决议、谅解备忘录、同意书等明示性的协议,还包括经营者之间的“默认协议”。为了认定默示协议经营者通过自己的行为与其他经营者串谋或者发生同样结果的,必须认识到其他经营者会效仿追随自身的行为。因为此时要证明存在协议是一件非常困难的事情,即使没有关于协议的明确证据,通过市场与结果分析,无法推定没有发生串谋就推定协议存在。

那么,以现行的不当行为规制体系来规范数字卡特尔是否行得通? 如上所述,数字卡特尔的类型大体分为两类。OECD把数字卡特尔分为监控算法、并行算法、信号算法、自我学习算法。

第一,监控算法是基于起初经营者之间存在协议为前提的,人工智能履行了监视其他经营者行为的作用。因此,以经营者之间的串谋为前提,所以可以直接适用现行的不当共同行为规则。

第二,并行算法是经营者用来共享相同或者相似的人工智能,被认为是很难利用第三方提供的人工智能系统在经营者之间达成明示性的串谋协议。但是,经营者可以通过灵活地运用人工智能来做出与其他经营者相同的定价决策。据此,可以判断出存在一个隐含的默示性协议。例如,当人工智能被认为是一个商业组织时(从经营者团体的角度看),可以看到并行算法与商业实体的交易条件策略相同。因此,如果可以推断出2人以上经营者之间存在的要求与默示性协议,就可以适用现行的不当共同行为规则。

第三,信号算法是指经营者通过自己的行为,使其他经营者公开或者传播追踪信息的行为。因为,此时经营者单方面地公开或者传播信息,其他经营者只是收取相应信息的行为,很难判断存在无条件的默示性协议。这是因为根据收取信息的经营者的行为不仅会发生串谋的结果,而且信息公开或者传播的经营者的意图也是重要的因素。但是即使公开信息的经营者的意图不明确,如果因为收集信息的经营者的行为发生了串谋的结果,根据共同行为审查标准,推定为串谋的可能性更高。据此,判断以目前的不当共同行为规则进行规制是可能的。

第四,自我学习演算法的情形,如果没有经营者的介入,仅根据人工智能发生了合谋的结果,就判断为经营者之间存在明示性的或者默示性的串谋是很难的。如前所述,自我学习演算法是指利用人工智能的经营者也无法得知相应结果的过程,因此,经营者对串谋的发生都很难进行预测。再者,现行法律体系下并没有承认人工智能具有法人人格,实际上在想要承认人工智能法人人格讨论的开始阶段,都很难将人工智能的行为直接认定为经营者的行为。①Jerry Kaplan, Humans Need Not Apply: A Guide to Wealth and Work in the Age of Arti ficial Intelligence, Yale University Press(2015) (设定‘arti ficial persons’).所以,自我学习演算法应该可以说是现行的不当共同行为规则最难适用的类型。但是,如前面提到的谷歌“Deep Mind”事例一样,证明了人工智能之间的合作,即人工智能也有串谋行为存在的可能性,因此,相关研究也会持续下去。另外,灵活运用人工智能的经营者们,可以充分预见人工智能之间的相互勾结(串谋)。这样一来,经营者在独自运用人工智能时,就有义务采取预防措施,防止人工智能相互间发生串谋。尽管可以预测到会发生数字卡特尔,但是如果没有采取预防措施,可以看作是利用人工智能工具回避法律规定的做法。因此,即使不承认人工智能的法人格,也可以把人工智能视为经营者的工具,可以通过现行不当共同行为规范来进行规制。

如果赋予人工智能法人人格,作为使用人的经营者的责任形态将发生变化。首先,赋予人工智能法人人格的情况下,经营者要承担使用人的责任,现行法对使用人责任的形态并没有规定为无过失责任,并且还规定在履行监督和监视义务时,经营者的使用人责任可以获得免除。但是如果不赋予人工智能法人人格,经营者以工具的形式使用人工智能,经营者承担的不再是使用人责任而是本人自己的责任。因此,对于依照人工智能的行为而发生的结果要承担本人的侵权行为责任。

如上所述,可以认为,对数字卡特尔的情形能够以现行的不当共同行为规则进行规制。但问题在于,认定数字卡特尔比现有的串谋行为更难。利用人工智能的串谋行为比以往更隐秘, 再加上市场也会发生细微的变化,所以揭发数字卡特尔是很困难的。因此,为了确保市场秩序,应该高度化地采用数字识别、实时市场监控、异常交易探知等类似的市场监督与分析方法,以此来适用人工智能时代。

三、对侵害消费者权益的规制

经营者使用人工智能时可能会发生黑客侵入或挪用个人信息等多种问题,从而可能对消费者造成损害。因黑客或挪用个人信息使用等对消费者造成的损失显然是需要讨论的焦点问题。但是该研究的目的是预测利用人工智能的经营者和消费者之间在正常的交易关系中可能发生的侵害消费者权益的行为,并寻求妥当地改善方案,因此本文不提及黑客及挪用个人信息等问题。

(一)歧视消费者的差别交易条件行为

经营者利用人工智能,分析访问自己营业场所的消费者的行动方式、职业及收入等信息,然后根据不同的消费者,采取不同交易条件的行为。据2017年5月《华尔街日报》的报道称,荷兰一家品牌加油站为了制定价格,正在利用人工智能学习市场数据,对支付意向较高的顾客来访时提高价格,反之,则会降低价格。该人工智能自动运作的方式如下:第一阶段,人工智能算法首先要将过去的交易信息构建成数据库;第二阶段,收集实时购买的数据和主要影响消费者购买的天气、交通等数据;第三阶段,学习加油站市场的人工智能算法(第1阶段)以市场实时数据(第2阶段)为基础,依据价格水平预测需求;第四阶段,加油站的经营者设定销售的目标、利润和最低价格等制约条件;第五阶段,人工智能算法实时预测需求、自动决定价格;第六阶段,重新学习通过人工智能算法发生的交易数据,更加准确地改善需求预测和价格决定的算法。

这种行为在网上购物商城中更为明显。目前,网上购物中心对现存的消费者购物明细进行分析,当该消费者登录购物中心的网站时,该购物中心的网站就会以分析资料为基础,提供商品介绍服务。但是,如果不仅仅是分析购买明细,而进行更详细的分析,那么不仅可以预测消费模式,还可以预测收入水平及消费意向等。如果这样的话,根据消费者个人的不同,制定不同的价格或配送费等也是有可能的。

另外,最近活跃起来的智能投顾也可能出现歧视消费者的行为问题,智能投顾根据消费者的投资倾向、消费模式、资产规模等因素,金融公司向对自己更有利的消费者提供更优质的信息服务,或者向特定消费者提供不利的信息。例如,现在类似投资咨询业者根据会员的等级不同提供不同的信息。

(二)地域性的差别交易条件行为

事实上,因人口的构成、偏好等不同地域性因素形成的消费模式也是存在差异的。例如,韩国世宗市平均年龄低、适龄生育人口占比较高的地区婴幼儿用品的销量会很高;而高龄化的地区对白银制品的需求会很高。流通企业在确定卖场的产品构成时,将反映各个地区的差异。但是,如果流通企业利用人工智能实时变更各类产品的价格,那么各地区的特性也可以反映在价格上。换句话说,在婴幼儿用品销售额较高的地区,可以决定幼儿用品的价格要高于其他地区;而在老龄化地区可以采取上调白银产品价格的行为。这种地域性的差别交易条件行为在不存在人工智能的市场也有,但现在更加蔓延开来。当然,目前地域性的差别交易条件行为不仅仅是在一个国家内,而是在世界范围内出现国家歧视行为。例如,根据2013年和2017年的国政监察披露的 “现代汽车”的“内需用和出口用产品差别”那样,其在召回GDi-2发动机时对韩国消费者采取逆向歧视,即,在汽车产业中存在韩国消费者和美国消费者不同的差别。据悉,最近苹果的“旧电池门”也与损害赔偿诉讼有关,出现了韩国消费者和美国消费者差别化的歧视行为。这种对各国消费者的差别歧视行为可以将各国的法律、环境等方面的差异视为其中的原因之一,也可以说不是歧视差别,而是差异使然。但是,由于在同一个国家其法律、环境及消费趋势等方面都相同的,因此,出现各地区交易条件差别的歧视行为很难被认定为是存在“差异”。

(三)企业的歧视行为

上述分析的两种差别行为主要是以消费者为对象的歧视行为。但是,经营者即使不以消费者为对象进行歧视行为,而是对其他经营者进行差别对待,也是采取限制消费者选择权等侵害权益的行为。例如,Stitch Fix公司与智能投顾的事例,基本上是遵循人工智能的分析及推荐程序。那么,在经营者向消费者推荐商品等的过程中,可以设定人工智能推荐或排除特定经营者的商品。在没有正当理由的情况下对其他经营者采取差别的行为虽然违反了《公平交易法》第23条第1项,对于手续费及广告费等方面的差异很难将其视为是不公正的反映。但是,差别对待经营者的行为可能会限制消费者的选择权,对此如何判断是个问题。

(四)规范性的检讨

串谋是规范性责难的对象,被作为规制对象的理由是因为通过与其他经营者进行意思交流,人为性地控制价格等交易条件。也就是说,因为交易条件不会随市场变化而改变。但是,正如前面所分析到的,非数字垄断的侵害消费者权益的行为并不表现为经营者的共同行为,即并非是串谋,而是个别经营者的单独行为。在决定价格等交易条件时,经营者不与其他经营者进行沟通就直接决定,这可以算是不道德的吗?价格等交易条件原则上应由经营者和消费者协商而决定,但实际上一般是由经营者决定的。此时,经营者的判断取决于市场的需求和供给等多种因素。也就是说,即使是同一地区、同一经营者、同一消费者、同一产品其交易条件也会根据其他条件要素发生变化。住宿业已区分旺季和淡季并以此制定不同的价格,而且饭店也在圣诞节实行预约制,上调价格,在发生放弃预定时也不退款。在资本主义社会,市场的交易条件已经由多种因素所改变是理所应当的事情,而且从某种角度看,这是不成文的规定。

如果说不正当共同行为规制的主要目的是防止经营者通过串谋造成市场秩序混乱,那么不公平交易行为则是以确保经营者交易行为的公正性为目的。因此,抛开经营者之间的共同行为或者经营者的市场支配力等,都将个别经营者不公平交易行为作为规制的对象。

《公平交易法》第23条列举了5个不公正交易行为的类型,包括:(1)不当拒绝交易或歧视对方的行为;(2)不当排挤竞争者的行为;(3)不当引诱或者强迫竞争者的客户与自己进行交易的行为;(4)不当地利用自己在交易上的地位与相对方进行交易的行为;(5)以不当拘束交易相对方的事业活动为条件进行的交易或妨碍其他经营者活动的行为等。前述的数字卡特尔以外的侵害消费者权益的行为与不公正交易行为有关联性。

特别是与消费者关系密切的不公平交易行为是典型的差别对待行为。根据《公正交易法施行令》第36条第1项和附表1之2“不公正交易行为的类型及标准”明确了“不正当地根据交易地区或交易对象以明显有利或以不利的价格进行交易的行为”“对特定经营者在数量、质量等交易条件或交易内容上明显有利或不利的行为”等是不公正交易行为。从对这种不公正交易行为的规制来看,成为规制对象的行为应该具有“不当性”,认定为差别歧视行为的标准应该是“明显”。即,若将根据人工智能进行的消费者差别歧视行为等作为不公正交易行为进行规制,该行为的内容就必须具有不当和明显的内容。

像歧视消费者的行为等将通过人工智能的行为作为不公正交易行为进行规制,对该行为应当证明的不是伦理上受到谴责的程度,而是作为法定规制对象应当对其不当性的程度进行证明。实际上对于不当性的证明非常难。特别是要消费者个人证明自己的权利受到侵害,证明其侵害是由经营者不公平交易行为造成的,这几乎是不可能的。

四、结 论

如前所述,经营者内部性的使用人工智能时不受规定的限制。但是,在使用人工智能对消费者等第三人有影响时,将成为被规制的对象。另一方面,到目前为止,人工智能所带来的影响在现实中还属于不可预测的。虽然现在只能展望人工智能的美好未来,但这也可能是商家们包装后的未来。如前所述,经营者们根据人工智能制定的战略采取行动,市场秩序可能会被扭曲,消费者的权益也可能会受到损害。依据人工智能而采取的行为中的串谋或者不正当交易行为,即使不承认人工智能的法人人格,也可以惩罚经营者。但是人工智能的行为比人的行为更隐秘,甚至利用人工智能的经营者也可能无法预测人工智能的行为。现在韩国也认识到了这样的问题,制定了作为行为规范的伦理宪章等原则,对于具体的问题应该是处于适时制定应对方案的准备阶段。