基于视觉显著性特征的自适应目标跟踪

张亚红,杨 欣,2,沈 雷,周延培,周大可

(1.南京航空航天大学自动化学院,南京210016;2.东南大学自动化学院,南京210096)

0 引 言

运动目标跟踪是在连续变化的视频序列中估计出目标的位置和状态信息的过程,而实现其跟踪的实时性、准确性和鲁棒性则是要解决的关键性技术问题。视觉注意机制使人类能迅速地优化处理复杂场景中的显著信息,自主的屏蔽和忽略非显著区域。国内外研究学者利用计算机建立视觉注意模型模拟人类注意机制[1],并将视觉注意机制引入到目标检测[2]、目标识别和运动目标跟踪[3,4]过程中,使目标处理过程能更加接近于人类认知机制,提高算法的有效性。该研究方向已经成为模式识别领域的研究热点之一。

传统的均值漂移算法是基于目标颜色特征直方图匹配搜索的过程,但颜色特征对噪声和遮挡不敏感。针对传统算法的不足,文献[5,6]中采用背景信息直方图修正候选区域模板,选取3倍于目标区域的环形区域作为背景模板,并对背景信息进行实时更新,减少背景信息的干扰。文献[7]根据背景与目标区域对比度大小的不同,赋予不同的显著度权值,结合mean-shift算法实现复杂背景下运动目标跟踪。文献[8]将视觉注意机制引入粒子滤波的框架中,以检测到的显著区域为全局建议分布进行粒子采样,实现突变运动目标跟踪。笔者在借鉴上述研究成果的基础上,提出一种基于视觉显著性特征的自适应目标跟踪算法。该算法基于频域滤波原理检测目标视觉显著图,结合颜色特征和视觉显著性特征描述目标模型,并根据相似系数的大小自适应地调节转移向量融合权值,有效地克服了单一颜色特征表示的跟踪不稳定性和背景融合干扰,实现了复杂背景下的准确目标跟踪。

1 视觉显著图检测

视觉显著图(Saliency Map)为图像的视觉特征,表示场景中显著目标的位置和显著性大小信息。基于频域分析的显著性信息提取算法[9],在图像频域变换的重构过程中,仅采用图像的相位谱信息重构能保留原图像的大部分信息,且图像的相位谱与高斯核滤波器的卷积操作可实现对图像显著性信息的提取,相当于图像显著性检测器。文献[10]分别提取R,G,B 3个通道的显著图,然后进行简单的叠加得到最终的目标显著图。该算法仅依靠图像的颜色特征,信息量少,检测准确性不高。笔者采用相位谱四元数傅立叶变换法[11](PQFT:Phase Spectrum of Quaternion Fourier Transform)检测图像时空视觉显著图,采用四元数模型可实现对图像特征的并行处理,提高算法的实时性。选择图像的颜色和颜色变化(fRG(t),fBY(t))、运动(M(t))和强度(I(t))4个通道的特征信息构建图像高维四元数模型

其中 μi(i=1,2,3)满足条件= -1,μ1⊥μ2,μ2⊥μ3,μ3⊥μ1。根据彩色图像的超复数傅里叶变换的定义,采用傅里叶变换相位谱信息得到重构图像q'(t),并与高斯滤波函数进行卷积操作,得到视觉显著图S(t),即

其中g(x,y,σ)为二维高斯函数,Ph(·)为图像的幅度谱。采用上述算法得到的视觉显著图如图1所示。

图1 视觉显著图检测结果Fig.1 Result of the visual detection

2 基于视觉显著性特征的目标跟踪

视觉显著性特征能有效增强目标和抑制干扰,融合视觉显著区域特征,从而强化候选区域中目标的信息描述,弱化背景信息的干扰。利用视觉注意机制有效筛选显著性信息,提供给目标跟踪算法,能提高信息处理的效率和跟踪算法的有效性。均值漂移算法是基于核密度函数的无参数估计算法,能实现对目标的实时跟踪。但是,基于颜色直方图描述目标模板抗干扰性差且受环境因素影响较大,特别是在背景与目标信息相似情况下不能很好地跟踪目标。笔者引进视觉显著性特征进行自适应加权融合,克服了背景融合干扰,并实现了复杂背景下目标的准确跟踪。

2.1 视觉显著性特征和相似性度量

基于上述检测得到的视觉显著图S(t),采用统计直方图的方法描述目标视觉显著性特征,同时结合显著区域的空间位置属性,赋予距离目标中心位置较近的像素点更大的权值,同时削弱目标边缘特征。笔者选取核函数k(x)为

其中x为某像素点到目标中心位置的距离,d表示空间维数。

选取矩形区域作为目标模板。假设模板中各像素点的归一化位置为,定 义 函 数b:R2→{1,2,…,m}为像素点到目标视觉显著性特征的映射,u为直方图中等级的索引,得到目标模板视觉显著性直方图为

同理假设候选模板中心位置为y,模板半径为h,‖y-xi/h‖表示模板中像素点到模板中心的归一化距离,得到候选模板视觉显著性直方图为

2.2 视觉显著性特征融合算法

笔者采用视觉显著性特征与颜色特征进行自适应加权融合,能有效克服单一颜色特征的不稳定性。当ρs小于某一阈值时,即视觉显著图之间的相似性较小,表明检测到的视觉显著图中有可能包含干扰信息或背景信息,无法有效表征目标。此时采用该特征跟踪目标会影响结果的有效性,故应适当减少该特征对跟踪权值的贡献,增加颜色特征的贡献值。根据图像不同特征之间相似度的大小,确定自适应融合权值

其中ρs,ρc分别为目标模板与候选模板之间视觉显著性特征和颜色特征的相似系数。

为使目标与候选区域间的相似度最大,融合视觉显著性特征与颜色特征加权,从而得到新的目标位置。将视觉显著性特征和颜色特征的相似度系数在)处泰勒展开得

式(9)表明,融合权值λ越大,则目标跟踪过程视觉显著性特征对跟踪结果的影响越大。在跟踪过程中该权值会根据视觉显著图中是否能准确包含目标信息而自适应地调整,保证在出现背景融合和复杂场景情况下,特征选取的可靠性。

3 实验结果与分析

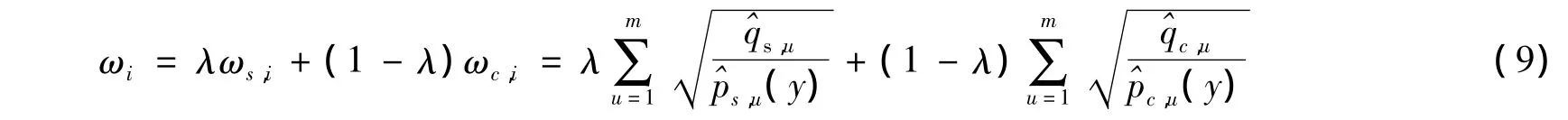

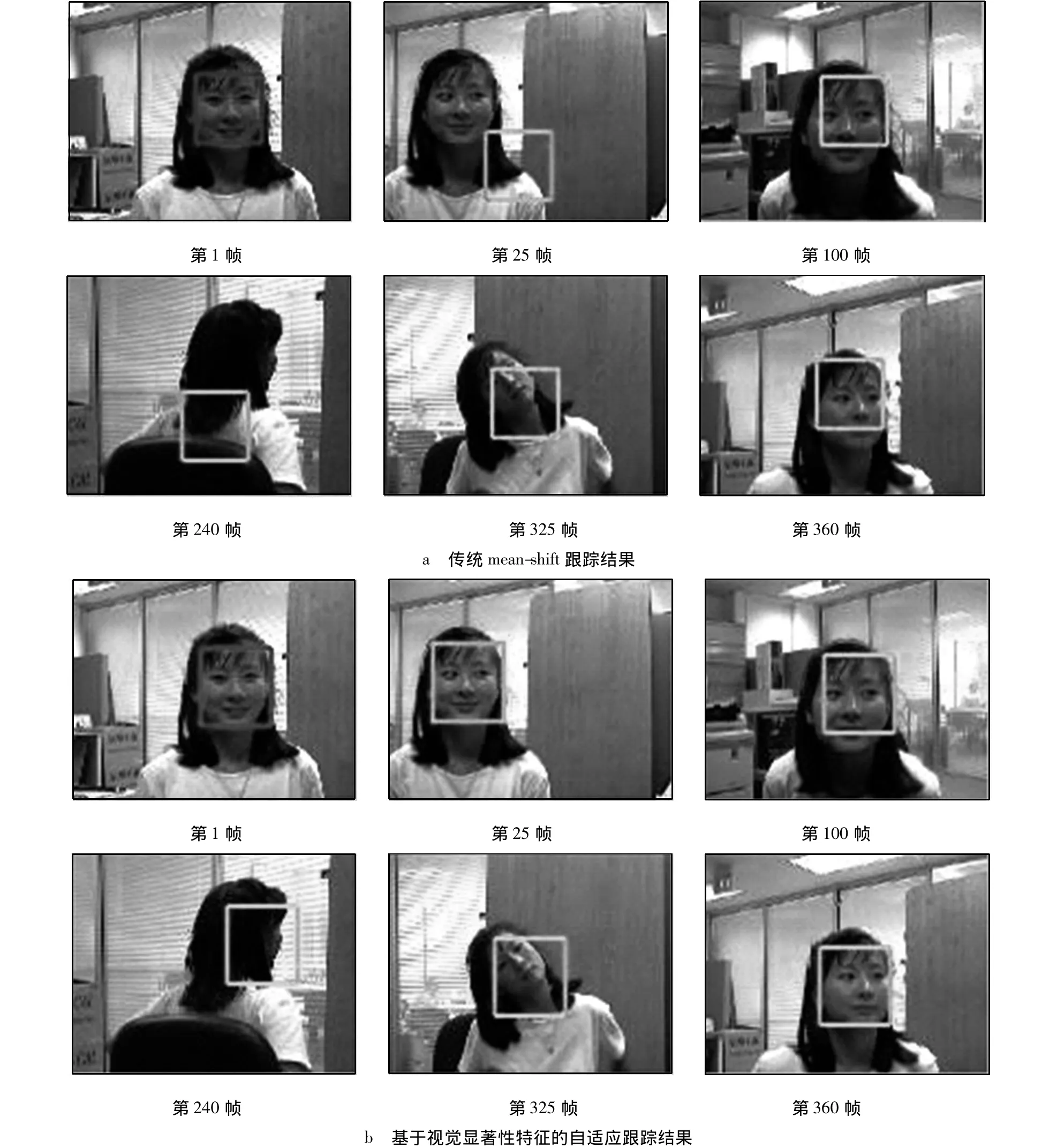

为验证该算法的有效性和优越性,笔者选取两段不同视频,分别为人脸跟踪视频和飞机模型运动视频,采用Matlab编程实现。旨在出现目标大小发生变化、目标旋转、目标部分遮挡、背景信息融合和复杂场景情况下验证算法能否准确跟踪目标,并与传统均值漂移算法进行对比。图2、图3分别为人脸目标跟踪结果和飞机模型目标跟踪结果。

图2 人脸目标跟踪结果Fig.2 Result of the face target tracking

图3 飞机模型目标跟踪结果Fig.3 Result of the plane model target tracking

上述实验结果表明,笔者算法能有效克服背景融合干扰和部分遮挡问题,并且在复杂场景下能有效跟踪目标。在场景信息中出现与目标模板相似的干扰时,目标与背景间的对比度较低,传统算法跟踪结果出现目标漂移现象。而笔者算法能有效减小跟踪误差,目标形状发生变化时,颜色特征可靠性下降,算法自适应调整融合权值,准确跟踪目标。同时,跟踪结果充分验证了复杂背景下笔者算法的有效性。

4 结语

笔者引入视觉显著性特征,提取图像颜色、颜色的变化、强度和运动4个通道的特征信息,采用四元数函数幅度谱重构算法提取显著图。采用颜色直方图和视觉显著性特征直方图融合,并自适应调节融合权值。该算法针对复杂背景下目标跟踪取得很好的效果,实时性较好。实验结果表明,笔者算法能在目标发生旋转、大小变化和部分遮挡时有效跟踪目标,能有效克服背景融合干扰,但是对全部遮挡和较长时间的遮挡效果不理想。今后研究的重点会针对以上不足之处,结合多种有效跟踪算法和模型特征,提高跟踪效率和鲁棒性。

[1]黎万义,王鹏,乔红.引入视觉注意机制的目标跟踪方法综述[J].自动化学报,2014,40(4):561-576.

LI Wanyi,WANG Peng,QIAO Hong.A Survey of Visual Attention Based Methods for Object Tracking[J].Acta Automatica Sinica,2014,40(4):561-576.

[2]LI Z,XU J,WANG Y,et al.Saliency Detection Based on Proto-Objects and Topic Model[C]∥Applications of Computer Vision(WACV),2011 IEEE Workshop on.[S.l.]:IEEE,2011:125-131.

[3]张巧荣,冯新扬.利用视觉显著性和粒子滤波的运动目标跟踪[J].中国图象图形学报,2013,18(5):515-522.

ZHANG Qiaorong,FENG Xinyang.Object Tracking Based on Visual Saliency and Particle Filter[J].Journal of Image and Graphics,2013,18(5):515-522.

[4]LI Z,WANG W,WANG Y,et al.Visual Tracking by Proto-Objects[J].Pattern Recognition,2013,46(8):2187-2201.

[5]NING J,ZHANG L,ZHANG D,et al.Robust Mean-Shift Tracking with Corrected Background-Weighted Histogram [J].Computer Vision,IET,2012,6(1):62-69.

[6]李茂林,刘小平,胡凌燕,等.基于部分背景加权更新的均值漂移跟踪算法[J].计算机应用研究,2013,30(12):3810-3813.

LI Maolin,LIU Xiaoping,HU Lingyan,et al.Mean Shift Tracking Algorithm Based on Background Weighted Update Approach[J].Application Research of Computers,2013,30(12):3810-3813.

[7]张恒,李由,李立春,等.基于显著性加权的 Mean Shift跟踪方法[J].光学技术,2008,34(3):404-407.

ZHANG Heng,LI You,LI Lichun,et al.A New Significance Weighted Mean Shift Tracking Method[J].Optical Technique,2008,34(3):404-407.

[8]苏迎娅,赵清杰,郭伟,等.基于视觉显著性的突变运动目标跟踪[J].东南大学学报:自然科学版,2013,43(1):174-178.

SU Yingya,ZHAO Qingjie,GUO Wei,et al.Visual Saliency Based Abrupt Motion Object Tracking[J].Journal of Southeast University:Natural Science Edition,2013,43(1):174-178.

[9]LI J,LEVINE M D,AN X,et al.Visual Saliency Based on Scale-Space Analysis in the Frequency Domain[J].Pattern Analysis and Machine Intelligence,IEEE Transactions on,2013,35(4):996-1010.

[10]孟琭.基于视觉注意机制的彩色图像显著性区域提取[J].计算机应用研究,2013,30(10):3159-3161.

MENG Lu.Saliency Detection for Color Image Based on Visual Attention Mechanism [J].Application Research of Computer,2013,30(10):3159-3161.

[11]GUO C,MA Q,ZHANG L.Spatio-Temporal Saliency Detection Using Phase Spectrum of Quaternion Fourier Transform[C]∥Computer Vision and Pattern Recognition,CVPR 2008 IEEE Conference on.[S.l.]:IEEE,2008:1-8.