基于AIGC技术的民族服饰设计研究

摘要:民族服饰的当代创新需要在创作过程中寻求民族传统与现代审美的最佳平衡点,生成式人工智能(AIGC)技术的出现为民族服饰的当代设计应用提供了新的路径和方法。文章通过分析目前人工智能技术在民族服饰生成过程中遇到的问题,提出基于专属资源库模型训练的方法并以畲族服饰为例进行实验。实验表明,通过对畲族资源库中的服饰样本进行品类归纳和图像标注进行专属模型的训练,可以使被训练的模型理解、学习到资源库样本中畲族服饰的特征,进而使生成的内容具有畲族服饰风格的图像。通过这一实验,展示了人工智能技术给民族服饰创新设计带来的全新思路和方法,旨在建立一条民族服饰设计与AIGC技术相结合的创新实践路径,通过AIGC技术能促进民族服饰设计的创新性发展和创造性转化。

关键词:AIGC;民族服饰;辅助设计;畲族;Stable Diffusion;Low-Rank Adaptation;Checkpoints

中图分类号:TS941.26

文献标志码:A

文章编号:10017003(2025)01002010

DOI:10.3969 j.issn.1001-7003.2025.01.003

基金项目:浙江省哲学社会科学年度课题项目(22NDJC077YB),浙江省大学生科技创新活动计划(新苗人才计划)项目(2024R406B073)

作者简介:吴海鸣(1999),男,硕士研究生,研究方向为民族服饰与数字化。通信作者:陈敬玉,教授,chenjy@zstu.edu.cn。

民族服饰是民族文化的重要组成部分,也是民族文化传承与发展研究的主要构成部分。民族服饰中蕴含着丰富的历史、风俗、信仰、技术和审美情趣。在人工智能飞速发展的时代背景下,新技术逐渐应用于生产生活的方方面面,民族服饰设计创新领域对人工智能技术的需求也随之不断上升。新技术的革命为传统的设计方法和文化保护工作打开了全新的赛道,亟待结合人工智能技术对传统理念和方法进行更新迭代,对设计方式进行创新才能更好地为民族服饰研究提供支持。

生成式人工智能(AIGC)是一种基于人工智能技术的衍生技术。AIGC技术依赖于生成对抗网络和大型预训练模型,通过对已有数据的学习和识别,以适当的泛化能力生成相关内容[1]。2014年,Goodfellow等[2]提出了生成对抗网络(GANs),GANs由生成器和判别器两个神经网络组成,通过相互对抗生成逼真的数据样本,在图像生成、图像修复和艺术品生成等方面广泛应用。如NVIDIA利用GANs技术开发的StyleGAN可以生成高度逼真的人脸图像,GANs的引入标志着生成模型领域的革命性进展。2020年,Ho等[3]提出了去噪扩散概率模型(Denoising Diffusion Probabilistic Models, DDPM),为扩散模型的研究奠定了基础,基于该框架扩散模型逐渐发展出多种变体,其中Stable Diffusion是其在图像生成方面的代表性成果。2024年,丁子龙等[4]将低秩适配器(Low-Rank Adaptation,LoRA)模型应用于Stable Diffusion中进行清代配饰生成,通过LoRA模型的图像微调优化,使得大模型能够更高效地适应特定任务的生成工作,然后将提示词、参数进行优化得到符合预期的图像。检查点(Checkpoint,CKPT)模型又称大模型,通过大量图像文本数据对基础大模型进行全量微调训练而产生的,在Stable Diffusion中CKPT模型可以根据文本、图像输入独立生成图像。2022年起,基于文本图像识别技术、自然语言处理、生成对抗网络技术和扩散模型等研究成果的大量应用问世,使得文学、艺术和设计等行业在AIGC技术的影响下迎来了技术革新的浪潮。

基于以上研究成果,在民族服饰的设计创新中可以引入人工智能技术进行辅助设计,通过对目前AIGC模型输出问题进行分析,提出模型训练的解决方案,进而在此基础上根据设计所需的提示词生成设计雏形,并据此进行完善最终形成完整设计。本文以畲族为例,通过对畲族族服饰元素信息的萃取与人工修正进行模型训练,使得AIGC模型学习畲族服饰的相关特征,通过文本图像输入生成畲族风格服饰,为民族服饰的创新研究提供创新思路。

1 民族服饰中对AIGC应用的需求与问题分析

1.1 民族服饰研究中对数智技术的应用需求

近年来,随着生成式人工智能的迅猛发展,民族服饰研究迎来了新赛道和新方向。人工智能技术为服饰文化保护提供了全新的手段,在辅助设计中展现出巨大的潜力为民族服饰文化遗产的保护和传承提供更多元的思路,推动其更好地融入现代社会,实现文化与科技的深度融合。

民族服饰的创新设计是当前设计领域的重要方向之一。设计师需要深入解读传统服饰的纹样、色彩、款式和配饰,并结合现代设计理念,创造出既保留民族特色又符合现代审美的服饰设计。在AIGC技术的辅助下设计师可以通过人工智能技术对大量民族服饰数据进行分析和学习,然后利用Midjourney、Stable Diffusion和DALL-E等AIGC平台将设计灵感进行具象化呈现,帮助设计师创造出既具有传统元素又符合现代审美的服饰。相较于传统设计工作流,AIGC技术的介入不仅能协助设计师拓展创新思路,还能快速迭代生成设计方案,提高设计效率,减少实际制作中的试错成本,通过在设计过程中提供即时反馈和多样化的创意功能,使设计师能够探索更多可能性,并进行实时调整和优化,如图1所示。AIGC技术应用于民族服饰设计不仅可以提升设计素材的收集整理时间、极大地提高出图速度和效率,还可以便捷地对电子素材进行调整和更换,高精度模拟服装成品效果,从而推动民族服饰在全球时尚舞台上的创新性发展。

1.2 现有AIGC技术生成问题分析

从现有AIGC模型生成角度来看,AIGC技术能够使设计师更好地表达自己的想法,并借助AIGC技术辅助设计出更具创新性的产品。然而,现有的AIGC数据库并未涵盖国内外所有民族风格,无法生成具有特定民族风格的服饰和纹样。以畲族为例在目前主流的AIGC应用中输入10个描述畲族风格特征的关键词“畲族、霞浦式、畲族服饰、凤凰装、领口织带、腰上系着围兜、盘发、头上戴着凤凰冠、围兜、棉麻面料”和Prompt“She ethnic group, Xiapu style, costumes of She ethnic group, phoenix costume, collar ribbon, bib on the waist, hair in a bun, phoenix crown on the head, bib, cotton and linen fabrics”,生成的图片呈现出各个民族风格混淆现象,服装风格更偏向于西式,如表1所示。经过多平台的测试结果得出,AIGC技术在民族服饰设计方面存在一定的缺陷,由于其训练资源库中的图片基本来自国外平台,因此对东方民族风格的理解也大多偏向于日韩风格,并未对中国56个民族服饰进行分类整理,对于各民族专有的服饰名称及服饰特征的理解并不准确。

2 基于AIGC的民族服饰设计创新

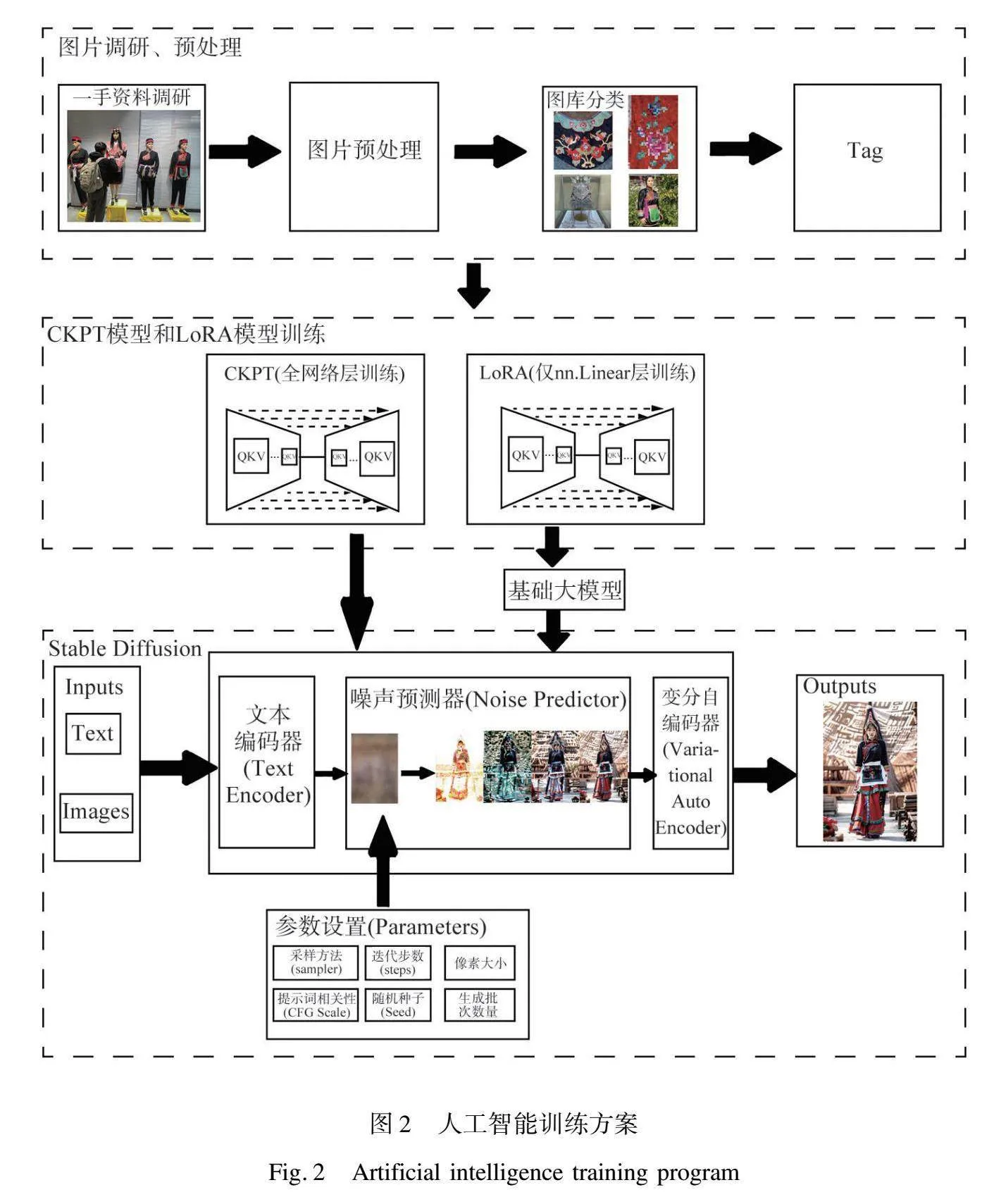

本文以畲族为例,通过搭建专属畲族模型资源库,使用专属资源库对AIGC模型进行微调训练以解决AIGC模型在生成图片时出现的民族风格混淆,以及设计师在设计时的效率和质量问题。研究流程如图2所示。

训练过程包括以下几个关键步骤:首先,通过对民族服饰、配饰和纹样的专著、论文资料和古籍等相关文献整理收集,获取详尽的历史背景和文化内涵,旨在确保设计师和模型都能准确理解民族元素的文化意义和象征意义,文献整理包括对传统服饰的起源、演变、工艺技术、使用场合及文化象征的全面研究,为后续的数据收集和模型训练提供理论基础;其次,通过对民族主要分布地区实地调研,包括走访民族聚居地,采访当地居民、专家和传承人,拍摄服饰的高清图片和视频,记录服饰的细节、材质、颜色搭配及佩戴方式,了解当地民族服饰的实际使用情况进行调查并收集图片数据资料,更准确地理解其文化背景和设计特点;再次,根据服饰类型、配饰种类、纹样图案等多维度对资源库进行分类与完善,以确保资源库的完整性和准确性;然后,使用Stable Diffusion基础大模型进行LoRA模型和CKPT模型的民族专属模型训练,在训练过程中,通过高质量的民族服饰图像数据作为输入,使模型逐渐学习和捕捉民族服饰的独特风格和设计元素,并生成具有民族风格的图像;最后,通过训练的专属AIGC模型进行生成民族服饰的创意设计方案,然后进一步地优化和调整。结合了人工智能和人类创意的设计流程,大大提高了设计效率和质量,使设计师能够更专注于创意和创新,而非重复性劳动。通过训练的AIGC模型生成的图片不仅能够准确反映民族服饰的文化特征,还能融入现代审美元素,创造出既有民族特色又符合现代潮流的服饰设计。

Stable Diffusion是基于扩散过程图像生成技术的一种深度学习模型,能够根据文本描述生成详细的图像[5]。Stable Diffusion由扩散模型(Diffusion Model)和变分自编码器(VAE)组成,扩散模型是一类基于概率的方法,用于生成高质量的图像,变分自编码器由编码器和解码器组成,编码器负责将大数据训练集中的图像压缩成低维的隐向量,而解码器则负责将这些隐向量还原成图像[6]。

CKPT模型是通过向基础大模型注入新主题进行全量微调训练而输出的模型,能够和基础大模型一样进行独立生成图像,在接收到图像文字输入后,CKPT模型通过其神经网络结构将输入转换成参数,参数随后被送入Stable Diffusion的解码器以生成图像[7]。CKPT模型的训练风格与输出结果紧密相关,因此使用民族专属CKPT模型会生成符合民族服饰风格的图像。LoRA模型通过对大模型进行低秩微调实现民族风格的迁移,LoRA模型需要与CKPT模型或基础大模型搭配使用,可以在不改变基础大模型的基础上,通过少量数据训练出特定的画风或特有的服饰风格。LoRA模型的应用原理是通过在Stable Diffusion预训练模型的权重矩阵W∈Rd×d(d是网络维度)左右两侧分别乘以一个低秩矩阵U∈Rd×a和V∈Ra×d(a是网络Alpha)低秩的维度,一般a小于或等于d,从而得到一个新的权重矩阵W1=UWV∈Rd×d,用来替代原来的权重矩阵进行输出图像。因此,LoRA只需要训练U和V两个低秩矩阵,从而在风格上影响CKPT模型或基础大模型的整个网络层,它可以显著减少训练的参数量和计算量[1]。这使得LoRA成为实现定制化需求的高效工具。

3 畲族服饰AIGC模型实验

计算机实验环境CPU:13th Gen Intel(R)Core(TM)i5-13600KF、GPU:NVIDIA GeForce RTX 3090 24G,编程语言Python,版本Python 3.10.11,使用软件Stable Diffusion Web UI,基础大模型Stable Diffusion v1.5、chilloutmix。

3.1 前期准备

在进行实验前,通过对福建宁德霞浦、福安、罗源,以及浙江丽水云和、景宁,浙江温州文成等浙闽畲族主要居住地区的博物馆、文化艺术馆进行田野调研。在调研过程中,采访了5名畲族传承人,了解了当地畲族的生活方式、传统文化及服饰特色,并且通过田野调研共收集了300余张一手图像资料。经过筛选和整理,最终挑选出适用于AIGC训练的100余张图像资料,以确保训练过程中的数据质量和有效性。

3.2 CKPT模型与LoRA模型训练

CKPT模型和LoRA模型的训练过程涉及不同的训练库量和预训练模型的选取。CKPT模型选取了130张图片进行全量微调训练,LoRA模型选取了45张图片进行低秩微调训练。根据畲族服饰的构成将实验图片细分为服饰库、纹样库及银饰库,使模型能够更好地理解和学习畲族服饰品类。

3.2.1 图片提示词设置

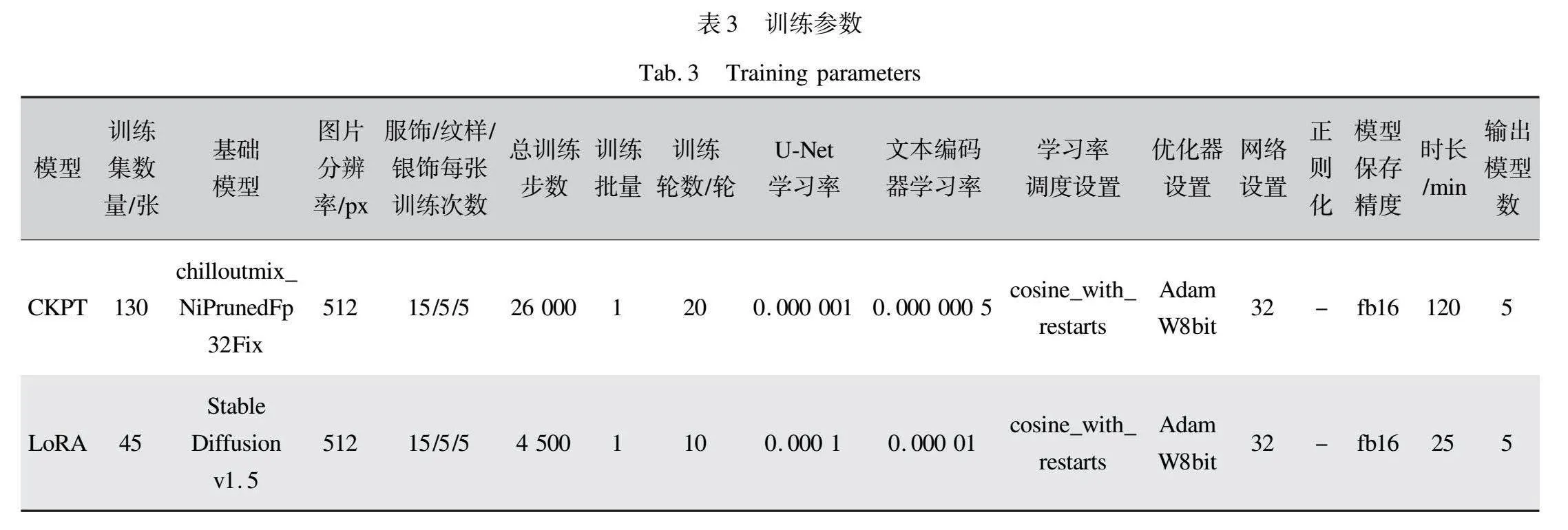

实验采用机器描述与人工修饰的方法对图片进行提示词设置,旨在增强人工智能对畲族服饰的理解与生成能力,如表2所示。首先,通过WD1.4图像识别标签器对资源库中图像进行初步批量图像提示词描述,通过该方式来呈现机器对图片识别与理解的目的。随后,在机器批量理解图像构成的基础上,根据畲族服饰特征进行人工修饰,加入特定畲族服饰描述词,使AICG模型能够生成更符合畲族传统的图像,达到更加精确和可控的输出效果。最后,在每张服饰图片的提示词前加入了“She ethnic group”作为核心触发词,通过核心触发词引导模型生成具有畲族特色的服饰设计,以确保模型能够准确、高效地生成符合设计需求的创意作品。

3.2.2 模型适配及参数调控

模型的适配是训练模型的关键步骤,实验中LoRA模型选用Stable Diffusion v1.5作为适配预训练模型,CKPT模型由于需要独立进行内容生成任务,因此选用适配的亚洲人chilloutmix模型作为预训练模型进行训练。在训练之前,通过Photoshop对图片进行抠像、高清化及裁剪等处理,以确保图像符合训练要求。抠像步骤主要是为了去除图片背景,使得模型更专注于主体部分;高清化处理则提升了图像的细节表现能力,确保在生成过程中不失真;裁剪步骤则是调整图片尺寸至512×512像素,以满足模型输入的要求,确保生成的图片质量和准确性都达到预期标准,最终满足实验目的。

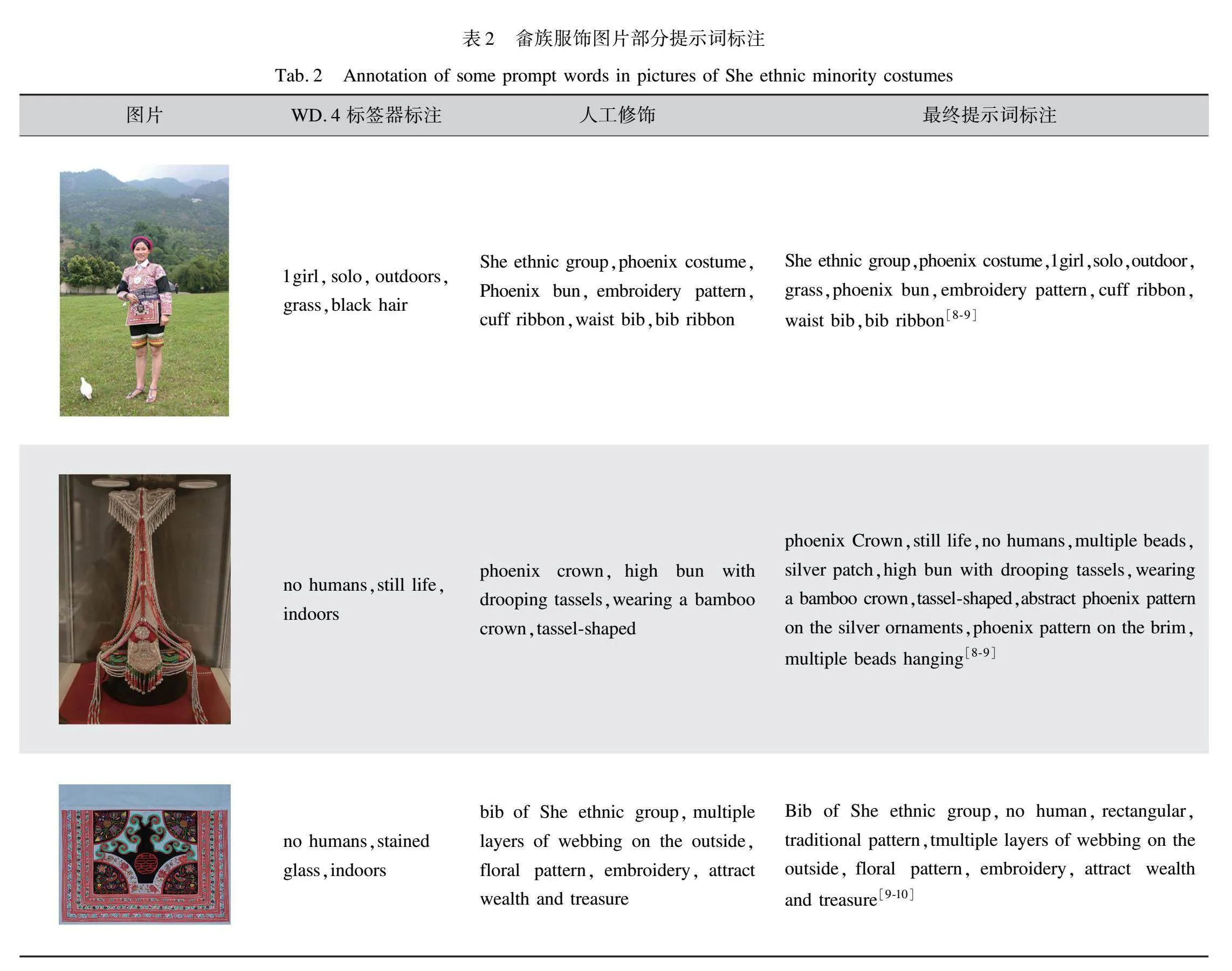

训练参数的调控对输出的训练结果起着至关重要的作用,涉及多个方面的参数调整和设置。训练的次数和轮数是控制训练过程的两个关键变量,适当的训练步数是确保模型能够充分学习数据分布的关键因素,步数过少可能导致模型欠拟合,无法充分学习数据中的特征,步数过多则可能导致过拟合,无法进行创意生成。文本编码器用于将文本信息嵌入特定的表示空间中,文本编码器的学习率过高会使文本特征不稳定,过低则可能导致训练速度过慢。U-Net是Stable Diffusion模型的核心组件之一,U-Net学习率决定了每次参数更新的幅度,使用学习率衰减策略逐步降低学习率,以保持训练的稳定性和效率。学习率调度是一种动态调整学习率的方法,用在训练过程中逐步降低学习率,以提高模型的收敛速度和稳定性。优化器是用于调整模型参数以最小化损失函数的算法,优化器能够显著影响模型的最终表现,实验选用Adam优化器,Adam优化器结合了动量和自适应学习率调整的优点,适用于大多数情况。网络设置包括网络的层数、每层的节点数等,网络层数和宽度影响模型的表示能力和计算复杂度,层数和宽度过大会导致过拟合,过小则可能无法捕捉数据的复杂特征。模型保存精度决定了模型权重在保存时的数值精度,常见的选择有FP32,保存模型参数的完整精度,适用于大部分场景;FP16,减少模型大小和显存占用,有助于加速训练和推理。实验中CKPT模型和LoRA模型的训练参数如表3所示。

3.3 实验结果分析

3.3.1 CKPT模型和LoRA模型输出loss值分析

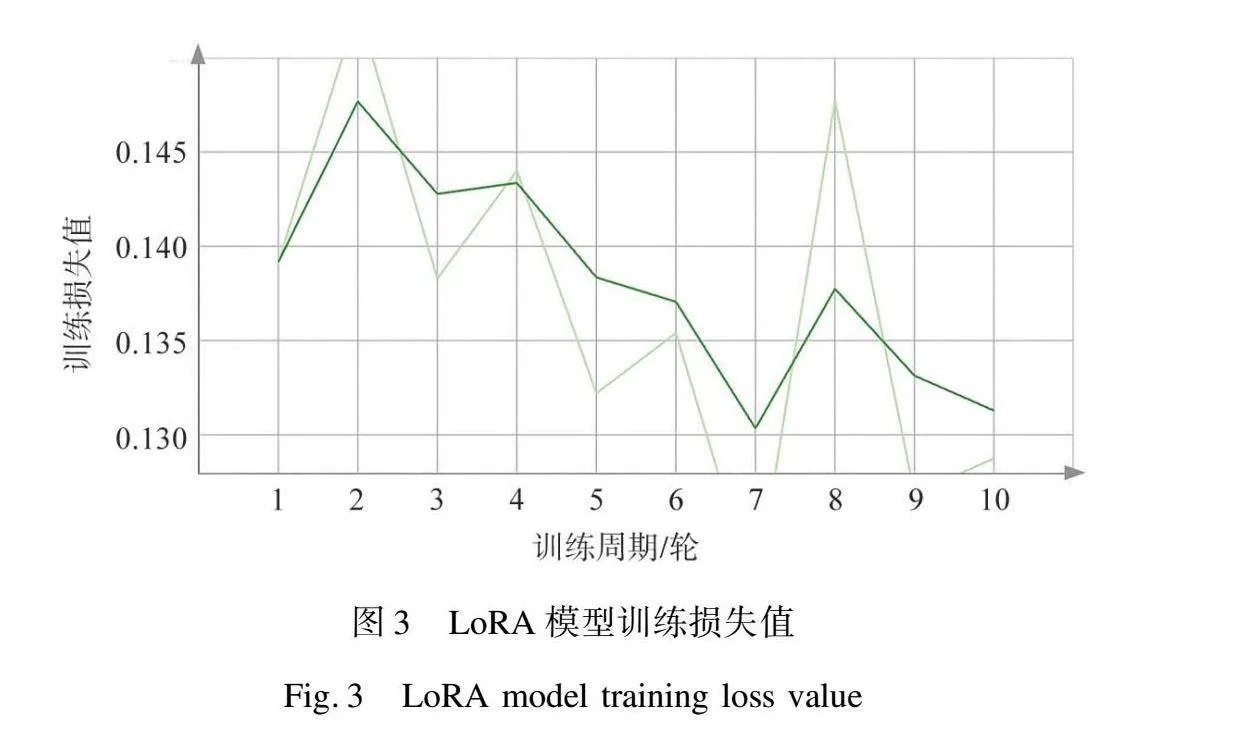

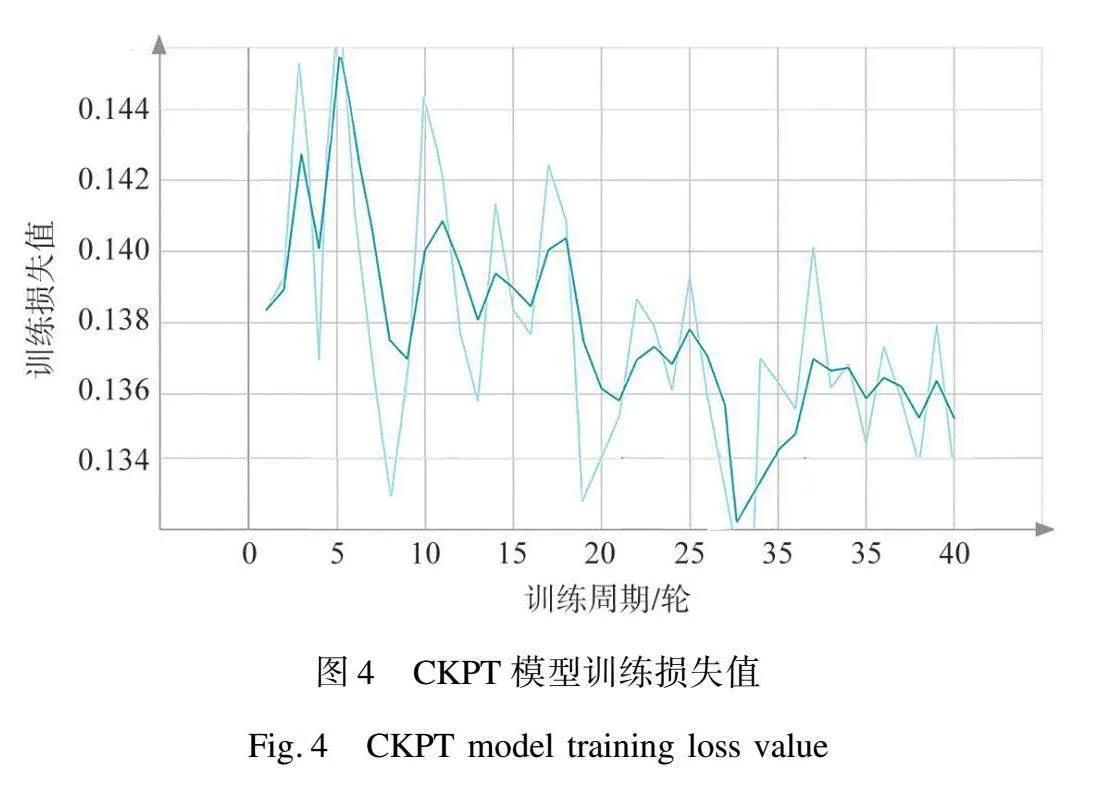

AIGC模型的训练过程中会产生损失函数值(loss值),loss值是衡量模型预测结果与实际结果之间差异的一个重要指标。loss值越高表示模型在训练过程中对图片学习的损失量越大,可能导致模型欠拟合,即无法准确学习训练集中的内容;相反,loss值越低表示模型在训练过程中对图片学习的损失量越小,但过低的loss值可能会导致模型过拟合,即模型过度适应训练集的内容,从而在实际应用中表现不佳。适度的loss值能够表明模型在训练过程中达到了良好的平衡,既能准确学习训练数据,又不至于过拟合。当模型训练的loss值经过波动趋于稳定时,损失值不再显著下降,则可以认为模型已经收敛到一个较好的状态,理论上0.1≤loss值≤0.15被认为是一个理想的范围[11]。

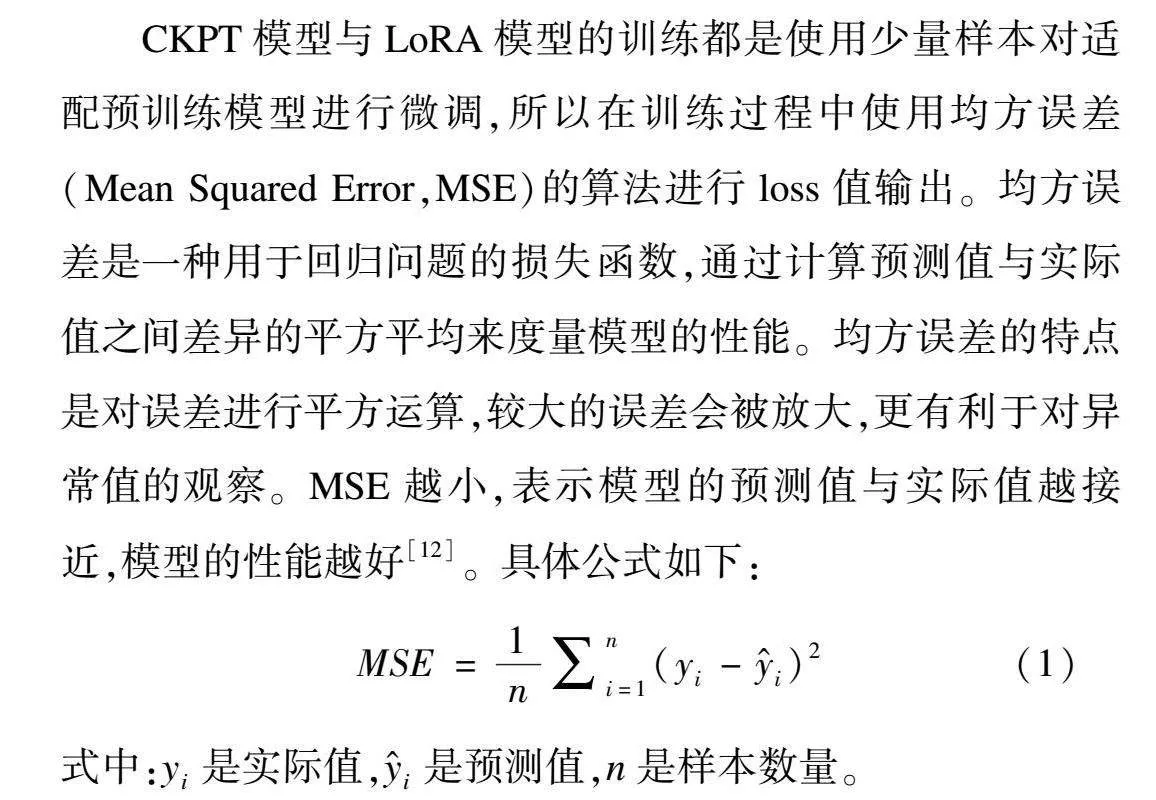

CKPT模型与LoRA模型的训练都是使用少量样本对适配预训练模型进行微调,所以在训练过程中使用均方误差(Mean Squared Error,MSE)的算法进行loss值输出。均方误差是一种用于回归问题的损失函数,通过计算预测值与实际值之间差异的平方平均来度量模型的性能。均方误差的特点是对误差进行平方运算,较大的误差会被放大,更有利于对异常值的观察。MSE越小,表示模型的预测值与实际值越接近,模型的性能越好[12]。具体公式如下:

MSE=1n∑ni=1(yi-y^i)2(1)

式中:yi是实际值,y^i是预测值,n是样本数量。

根据均方误差算法,LoRA模型与CKPT模型在训练过程中损失值随训练周期的变化情况如图3、如图4所示,横轴表示训练周期,纵轴表示模型训练损失值。LoRA模型每2个训练周期输出1个模型,共10个训练周期。第1至第2个训练周期时,由于训练初期较高的学习率导致参数更新幅度较大,模型暂时偏离最优路径导致损失值上升,属于正常现象。第8个训练周期时,由于模型过度拟合训练数据,导致泛化能力下降,引起了损失值的回升现象。随后,通过继续优化和调整,损失值逐渐下降,表明模型逐渐摆脱了局部最小值并改善了泛化性能。CKPT模型每8个训练周期输出1个模型,共40个训练周期。前5个训练周期时,由于训练初期参数尚未调整到理想状态,模型需要一定时间适应数据并找到有效的参数配置,因此导致损失值呈现上升趋势。第25到35个训练周期时,由于优化器在训练过程中根据梯度信息动态自适应调整学习率和参数,导致短期内损失值波动;在第32个训练周期时,损失值开始稳定下降,表明优化器的调整和模型参数的优化逐渐收敛,模型的表现趋于稳定。

LoRA模型和CKPT模型在训练过程中尽管存在一定范围的波动,但是整体的损失值呈现下降趋势,表明模型逐渐收敛和优化。模型训练损失值范围处于0.1~0.15,从数值上可初步判断实验输出的CKPT模型和LoRA模型符合模型输出的精度要求。

3.3.2 模型筛选

为了确保模型输出的准确性和可靠性,本文通过控制变量法对实验输出的LoRA模型和CKPT模型进行择优选取。在保持其他变量稳定的情况下,仅改变一个主要变量,从而准确地观察和衡量该变量对模型输出的影响。本文使用Stable Diffusion平台配合控制网(ControlNet)进行测试,ControlNet是对画面进行精准控制的工具,通过ControlNet工具中的画面人物姿态控制(Openpose)和图片深度控制(Depth)功能,对人物的姿态及服饰的深度轮廓进行精确控制。Openpose提供了姿态识别功能,能够实时准确地捕捉人体的各个关节和肢体动作,Depth专注于分析图像中的深度信息,以重建服饰的三维深度轮廓。通过该方式不仅提高了模型对人体动作和外观变化的适应性,也显著降低了这些变量可能对比较结果带来的干扰。

LoRA模型搭配人物大模型进行使用,在变量中设置相同的Seed值使模型产生相同的随机数序列,从而确保实验的可重复性,步数和正反向画质词保持一致,通过输入核心触发词“She ethnic group”,并改变LoRA的权重值进行对比,如图5(a)所示。其中LoRA模型1、2、3在权重升高值1.0时,图片中服装款式的结构出现错乱,服饰穿着方式及畲族纹样位置存在混乱的情况,表现为欠拟合的状况;LoRA模型5在权重为0.8和1.0时,图片中对服饰裙摆的缘饰进行了过渡处理,出现了流苏等元素,而权重为1.0时围兜中纹样以缘饰表现在中间,模型表现为过拟合的情况。模型4在权重小于1.0时,保持畲族元素位置准确的同时融入了AIGC独立的思维,权重大于1.0时模型呈现畲族风格无过拟合问题存在。通过对比最终选择模型4作为畲族LoRA模型投入创新设计使用中。

CKPT模型在变量中通过控制核心触发词“She ethnic group”,其余参数设置一致,观察CKPT模型对畲族服饰的学习程度对服装直接产出效果,如图5(b)所示。其中CKPT1、2模型在使用核心触发词时裙子下摆出现与畲族无关的色彩,以及服装纹样无畲族特征;CKPT 3、4模型在使用核心触发词时脚部出现不合理的装饰物,故为训练不足的特征;CKPT 5模型在不使用核心触发词词时输出图片带有较弱的畲族款式特征,保持了畲族的围兜、领部的基本款式,其余细节可以搭配其他关键词进行创造设计,在使用核心触发词时输出图片带有较强的畲族特征,没有出现款式错乱问题。最终选取CKPT 5模型投入畲族服饰创新设计中。

4 AIGC辅助服饰设计生成

为探索实验模型在民族元素融入现代服饰创意设计中的能力,本文通过实验得到的LoRA4和CKPT5模型结合现代基础服饰款式辅助生成畲族风格的现代服饰。利用ControNet工具精准控制基础服装款式,通过模型以图生图与局部重绘的方式将畲族元素巧妙融入服装设计中,如图6所示。在设计卫衣款式时,保持原有款式不变的前提下,在胸口融入畲族纹样,并增加畲族交领作为假领设计;大衣款式中,通过在帽檐、袖口、肩部部分加入畲族织带元素作为装饰,且在胸前巧妙加入畲族标志性交领设计及纹样,实现了民族元素与现代服装的有机结合;羽绒服款式则采用解构设计,以拼贴的工艺融入畲族元素,并在口袋拉链处加入织带元素,增添独特的民族风情;在衬衫款式中,将翻领改为畲族特色的立领,并在胸前加入织带元素和假交领,展现了民族元素的独特魅力;裤子

款式则在腰头部分加入畲族织带作为腰头装饰,同时在裤门襟部位加入畲族花纹刺绣元素,呈现别具一格的设计风貌;连衣裙款式中,将圆领领口更改为立交领,并在交领部分加入畲族特有的领口花纹,同时对连衣裙的边缘加入织带和纹样作为装饰,呈现一种融合了传统与现代的时尚感。通过畲族AIGC模型辅助设计,将畲族元素与现代服饰融合,不仅在设计中呈现了民族文化的丰富内涵与独特魅力,同时也为服装设计带来了前所未有的创新与变革,开拓了时尚设计的新视野和可能性。

5 结 语

以畲族为例,通过对民族服饰提示词的深入分析和AIGC技术的结合,实现了面向民族服饰的AICG模型专属训练,从而得到了定制的LoRA模型和CKPT模型。有效地解决了原AIGC模型在生成民族服饰时存在的民族服饰风格混淆问题,同时也提升了设计师在创新设计中的质量和效率。设计师可以通过输入提示词和调整参数实现模型控制,从而生成具有鲜明民族特色的服装设计款式,同时通过模型对基础款式进行二次创意设计。本文通过AIGC模型训练方式实现了畲族服饰生成式输出及现代服饰风格迁移,此方法同样适用于其他民族服饰的模型训练,通过模型实验进一步推动民族服饰与人工智能科技的结合,为民族文化的传承与创新开辟新的路径。

参考文献:

[1]詹希旎, 李白杨. 数智融合环境下AIGC的场景化应用与发展机遇[J]. 图书情报知识, 2023, 40(1): 75-85.

ZHAN X N, LI B Y. Application scenarios and development opportunities of AIGC in the digital intelligence integration environment[J]. Documentation, Information amp; Knowledge, 2023, 40(1): 75-85.

[2]GOODFELLOW I, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets[J]. Advances in Neural Information Processing Systems, 2014, 27: 12-19.

[3]HO J, AJAY J, PIETER A. Denoising diffusion probabilistic models[J]. Advances in Neural Information Processing Systems, 2020, 33: 6840-6851.

[4]丁子龙,李妍,刘琦,等. 基于人工智能生成内容(AIGC)图像扩散模型的清代佩饰活化传承方法研究[J]. 宝石和宝石学杂志, 2024, 26 (5): 100-110.

DING Z L, LI Y, LIU Q, et al. Revitalization and Inheritance Methods of Qing DynastyAdornments Based on Artificial Intelligence GeneratedContent (AIGC) Image Diffusion Model[J]. Journal of Gems amp; Gemmology, 2024, 26(5): 100-110.

[5]WANG Z Z, ZHAO L, XING W. Style diffusion: Controllable disentangled style transfer via diffusion models[C]" Proceedings of the IEEE CVF International Conference on Computer Vision. Paris: IEEE, 2023.

[6]黄威. 基于深度表示学习的小样本图像分类的研究[D]. 合肥: 中国科学技术大学, 2021.

HUANG W. Research of Few-Shot Image Classification Based on Deep Representation Learning[D]. Hefei: University of Science and Technology of China, 2021.

[7]ROMBACH R, BLATTMANN A, LORENZ D, et al. High-resolution image synthesis with latent diffusion models[C]" Proceedings of the IEEE CVF Conference on Computer Vision and Pattern Recognition. New Orleans: IEEE, 2022.

[8]俞敏, 崔荣荣. 凤凰装与畲族传统服饰文化探究[J]. 纺织学报, 2011, 32(10): 113-117.

YU M, CUI R R. Investigation into culture of phoenix-style dress and She nationality traditional costumes[J]. Journal of Textile Research, 2011, 32(10): 113-117.

[9]王子璇, 徐强. 湖州畲族服饰纹样研究[J]. 轻纺工业与技术, 2022, 51(1): 32-35.

WANG Z X, XU Q. Research on the clothing patterns of the She people in Huzhou[J]. Light and Textile Industry and Technology, 2022, 51(1): 32-35.

[10]李方园, 陈敬玉. 艺术人类学视角下的畲族服饰图案解读[J]. 包装工程, 2019, 40(2): 109-113.

LI F Y, CHEN J Y. Interpretation of She nationality’s costume pattern based the perspective of artistic anthropology[J]. Packaging Engineering, 2019, 40(2): 109-113.

[11]CHEN S, CHEN B, SHU P, et al. Real-time unmanned aerial vehicle flight path prediction using a bi-directional long short-term memory network with error compensation[J]. Journal of Computational Design and Engineering, 2023, 10(1): 16-35.

[12]于鹏, 张毅. 从特征辨识到图像生成: 基于AIGC范式的苗族服饰设计[J]. 丝绸, 2024, 61(3): 1-10.

YU P, ZHANG Y. From feature recognition to image generation: Miao ethnic costume design based on the AIGC paradigm[J]. Journal of Silk, 2024, 61(3): 1-10.

Research on ethnic costume design based on AIGC technology: Taking the She ethnic group as an example

WU Haiming1, CHEN Jingyu1,2

(

1.School of Fashion Design amp; Engineering, Zhejiang Sci-Tech University, Hangzhou 311103, China; 2.Zhejiang Sci-Tech University Digital

Intelligence Style and Creative Design Research Center, Key Research Center of Philosophy and Social Sciences, Hangzhou 310018, China)

Abstract:The inheritance and innovation of ethnic clothing are critical aspects of preserving and developing cultural heritage. As modern design demands evolve, the integration of traditional ethnic clothing elements into contemporary fashion faces increasing challenges. Designers must navigate the complex task of balancing the preservation of cultural essence with modern aesthetic integration. The rise of

artificial intelligence-generated content (AIGC) technology offers promising solutions for the innovative design and application of ethnic clothing elements. This study focuses on She ethnic group clothing and explores the application of digital generation techniques and innovative design methods through the training of Low-Rank Adaptation (LoRA) and Checkpoints (CKPT) models.

A key aspect of this study is the development of a custom model based on a specialized She ethnic group clothing resource database. The clothing samples within this database were systematically categorized and annotated to facilitate the training of the LoRA and CKPT models. These models were specifically trained to recognize, learn, and generate images that accurately depict the distinctive characteristics of She ethnic group clothing. During the training process, deep learning algorithms were employed to optimize the generated images, ensuring high levels of detail fidelity and consistency in style. To evaluate the effectiveness of these models, comparative analyses were conducted to assess the accuracy and alignment of the generated images with traditional She ethnic group clothing designs.

The study introduced AIGC technology into the digital translation and innovative design of She ethnic group clothing by leveraging a specialized resource database for model training. This approach ensured the precise capture and creative transformation of traditional She ethnic group clothing elements. The in-depth analysis of the database samples enabled the high-precision reproduction of both style and detail in the generated images, offering a feasible technological pathway for the modern design of ethnic clothing.

Experimental results demonstrate that the images generated by the trained models effectively preserve the traditional style of She ethnic group clothing while incorporating modern aesthetic elementd. Compared to conventional manual design methods, this approach significantly enhances design efficiency while outperforming in terms of style consistency and detail fidelity. The study’s findings highlight the broad potential of AIGC technology in the innovative design of ethnic clothing, validating the practicality and forward-thinking nature of AIGC methods based on custom model training in driving ethnic clothing innovation.

The successful application of AIGC technology in the digital restoration and innovative design of She ethnic group clothing contributes new technological insights to the broader field of ethnic clothing innovation. As the field continues to evolve, the fusion of advanced technology and traditional craftsmanship will play an increasingly important role in the ongoing effort to preserve and innovate ethnic clothing design.

Key words:AIGC; ethnic clothing; assisted design; the She ethnic group; Stable Diffusion; Low-Rank Adaptation; Checkpoints