基于改进YOLOv5的驾驶员疲劳状态检测

李浩 马晓 周万珍

摘 要:

为了减少因疲劳驾驶而造成的意外交通事故,提出了一种基于改进的YOLOv5网络模型,对驾驶员的疲劳状态进行检测。首先,使用轻量型网络MobileNetV3替换原YOLOv5主干网络;其次,在颈部网络各个C3模块中融入ECA注意力机制;最后,通过检测网络对眼睛的开合度和嘴巴有无打哈的状态进行定位和识别,使用多指标对驾驶员进行疲劳判定,并自建疲劳检测数据集进行实验。结果表明:改进的YOLOv5模型参数量、计算量、体积分别减小至原模型的48%、38%、50%,解决了原模型参数量、计算量、体积过大的问题;mAP值由98.6%提升至99.1%,精确率由95.9%提升至96.8%,检测速率由115 f/s提升至119 f/s,进一步提高了模型的检测精度和检测速度。改进的YOLOv5模型具备轻量化、高精度、高速率的特点,可为疲劳驾驶预警提供参考。

关键词:

计算机图像处理;YOLOv5;MobileNetV3;ECA;轻量化;疲劳驾驶

中图分类号:TP391 文献标识码:A

DOI: 10.7535/hbgykj.2024yx01003

Driver fatigue state detection based on improved YOLOv5

LI Hao1, MA Xiao2, ZHOU Wanzhen1

(1School of Information Science and Engineering, Hebei University of Science and Technology, Shijiazhuang, Hebei 050018, China; 2Supervision Office, Cangzhou Open University, Cangzhou, Hebei 061001, China)

[HQK]Abstract:[HJ2.0mm]

In order to reduce the sudden traffic accidents caused by fatigue driving, a network model based on improved YOLOv5 was proposed to detect the fatigue state of drivers. Firstly, the original YOLOv5 backbone network was replaced by the lightweight network MobileNetV3. Secondly, the ECA attention mechanism was incorporated into each C3 module of the neck network. Finally, the degree of eyes opening and closing and mouth with or without snorting were located and identified by the detection network, and then the multiple indexes were used to judge the fatigue state of the driver, and the self-built fatigue detection dataset was used for experiments. The results show that the improved YOLOv5 model′s number of parameters, computations, and volume are reduced to 48%, 38%, 50% of the original model, respectively, which solves the problem of excessive number of parameters, computations and volume of the original model. The mAP value is increased from 98[DK(].[DK)]6% to 99[DK(].[DK)]1%, the accuracy is increased from 95[DK(].[DK)]9% to 96[DK(].[DK)]8%, and the detection rate is increased from 115 f/s to 119 f/s, all of which further improves the detection accuracy and speed of the mode. The improved YOLOv5 model has the characteristics of lightweight, high precision and high speed, which can provide reference for fatigue driving early warning.

Keywords:

computer image processing; YOLOv5; MobileNetV3; ECA; light weight; fatigue driving

隨着人们生活水平的不断提高,轿车作为代步工具极大地便利了出行体验,但是随之而来的交通事故也越来越多。通过对交通事故统计分析发现,因疲劳驾驶而引起的交通事故约占总数的20%,占特大交通事故的40%以上[1-3]。因此,对驾驶员的疲劳状态进行检测研究显得格外重要。

目前驾驶员疲劳状态的检测方法主要有接触式和非接触式[4]。LAL等[5]指出,人在疲劳时脑电图中的delta波和theta波活性显著加强,提出了一种接触式检测方法,是一种用脑电设备测量大脑纺锤波的早期疲劳检测方法[6]。随着深度学习技术的发展,基于视觉面部特征的非接触式检测方法开始兴起[7]。YANG等[8]提出通过Dlib算法获取眼睛关键点图像,利用决策网络判断眼睛开合度,根据眼睛开合度判断驾驶员的疲劳状态;ANSARI等[9]提出了将ReLU-BiLSTM网络与头部姿态变化相结合,通过ReLU-BiLSTM获取头部空间关键点,依据得出的头部倾斜角度判断驾驶员的疲劳状态;ADHINATA等[10]提出了将FaceNet算法与K近邻算法相结合,其中FaceNet算法用于面部特征器官点的提取,K近邻算法用于划定分类,该方法的准确率达到94.68%,符合疲劳检测要求。

然而,以上几种非接触式检测方法需要进行大量特征器官点定位,使得训练过程中的参数量和计算量大大提升,模型体积变大,难以达到在实际场景中轻量化部署的要求,且这些算法模型检测速度慢,会降低实时疲劳检测的效率[11-12]。本文通过使用YOLOv5模型[13-15],直接对眼睛和嘴巴的面部特征器官进行定位和识别,可大幅提高检测速度,并对YOLOv5模型进行改进,使其在达到轻量化要求的同时,提高检测精度[16-17]。最后利用基于面部特征器官的多指标融合的疲劳判定模式,根据驾驶员的闭眼帧数占比、眨眼频率、打哈频率综合实现对驾驶员疲劳状态的高效检测[18]。

1 相关理论基础

1.1 YOLOv5-6.1网络模型

YOLOv5网络模型将求解过程统一为一个回归问题,舍弃候选框的选取,直接在输出层对目标的位置和类别进行回归,提高检测速度。本文以YOLOv5s为基础模型,使用YOLOv5-6.1版本对其进行改进。YOLOv5s模型结构分为输入端(Input)、主干网络(Backbone)、颈部网络(Neck)、检测网络(Head),其模型结构示意图如图1所示。

Input输入端就是图片或帧图像的输入。Backbone主干网络用来对输入图像进行特征提取,并不断缩小特征图尺寸,包含有Conv模块、C3模块、SPPF模块。其中,Conv模块的作用是对特征图进行升维或降维、归一化等操作;C3模块则是更为重要的进行特征提取模块;SPPF模块的主要作用是将同一特征图不同尺度下的特征表现合并到一起。Neck颈部网络用来将不同层次的特征图进行融合,以获得更为完整的特征。Head检测网络仅包含Detect模块,Detect模块由3个1×1卷积构成,对应3个检测特征层,用来确定检测目标的位置和类别。

1.2 MobileNetV3模块

MobileNetV3模块(简称MNV3模块)是一种轻量级模块,图2为MNV3模块结构示意图[19]。输入特征先通过1×1卷积扩充通道数,然后在高维空间上对特征图进行3×3的深度卷积。接着对经过深度卷积的输出特征进行全局平均池化操作,以压缩特征得到通道级的全局特征。再将全局特征依次输入激活函数为ReLU和h-swish的2个全连接层得到特征向量,对特征向量进行权重赋值得到输出特征。最后用1×1卷积对输出特征降维从而得到最终特征。整个过程中前2个卷积使用非线性激活函数,最后1个卷积使用线性激活函数。使用线性激活函数是要确保在最后通道降维输出后,使特征信息丢失的损失达到最小。过程中使用的非线性激活函数如式(1)—式(3)所示:

h-swishx=xReLU6x+36,(1)

ReLU6x= min6,max0,x,(2)

ReLUx=max0,x,(3)

式中:x表示神经元输入值。

1.3 ECA注意力模块

有效通道注意力(efficient channel attention,ECA)模塊是针对SE通道注意力模块的不足提出的,它解决了通道降维的不利影响,获取了不同通道间的依赖性关系,如图3所示[20-21]。

首先用全局平均池化方法把输入特征大小从(H,W,C)转化为(1,1,C),以此得到通道级的全局特征;然后对全局特征进行一维卷积(1×K卷积)操作,以实现不同通道间的信息交互,得出不同通道的权重,其中K值可以自适应地由式(4)确定。

K=ψC=log2Cγ+bγodd,(4)

式中:b和γ均表示拟合系数,一般设定b值为1,γ值为2;todd表示最接近t的奇数。接着使用Sigmoid激活函数将得到的权重值映射到0~1,权重值的映射如式(5)所示。

ω=σx=11+e-x,(5)

式中:x表示映射前的权重值;ω表示映射后得到的权重值。将重塑后的权重值与原始输入特征图对应元素相乘,得到不同权重的输出特征图。

2 YOLOv5-6.1模型的改进

2.1 MobileNetV3轻量型网络替换原主干网络

在驾驶员疲劳检测过程中,检测模型需要部署在嵌入式设备中,这就使得模型要足够轻量化。原始主干网络虽然可以有效提取到细节特征,但在提取过程中参数量和计算量较多,导致模型体积变大,不利于轻量化部署,而使用MobileNetV3网络替换原YOLOv5s模型的主干网络,可以在不降低模型检测精度的前提下,大幅减少模型的参数量和计算量,使模型达到轻量化的效果。

本文使用的MobileNetV3网络共包含有12层网络结构,由Conv模块和MNV3模块组成。Conv模块用来对输入的图像进行3×3的标准卷积操作,以此得到特征图并扩充特征图通道数;MNV3模块则用来对特征图进行特征提取操作,同时有效减少提取过程中的参数量和计算量;输入图像经Input端输入,然后到達MobileNetV3组成的主干网络,其中MobileNetV3网络包含了多个MNV3模块,以达到提取更多详细特征信息的目的,每个特征层的MNV3模块依次进行连接,最后将得到的特征输出到颈部网络。所采用的MobileNetV3网络结构的具体配置如表1所示,其中逆残差扩张通道数表示MNV3模块中第1个1×1卷积的输出通道数;深度卷积部分的卷积核大小表示MNV3模块中进行深度卷积操作的卷积核大小。

2.2 颈部C3模块里添加ECA注意力机制

原始颈部网络共有4个C3模块,每个C3模块由Conv模块、Bottleneck模块、Concat模块组成。其中,Conv模块为1×1卷积,用来对特征图进行升维或降维操作;Bottleneck模块起到特征提取的作用; Concat模块则将特征图的不同尺度合并融合到一起。原始C3模块结构如图4所示。

输入特征图经原始C3模块虽能提取到特征,但对这些特征没有主次之分,而将ECA有效通道注意力机制融入到颈部网络各个C3模块的Bott-leneck层里面,构成C3ECA模块,可以做到在没有进行通道降维的前提下,达到强化有用特征、抑制不重要特征的效果。同时,由于在特征融合阶段进行了注意力调整,这样可以有效提高模型的检测精度。ECA注意力机制的具体添加位置如图5所示。

2.3 改进的网络模型

本文对YOLOv5s模型进行改进,使用有12层结构的MobileNetV3轻量型网络代替原YOLOv5s模型的主干网络,并将MobileNetV3网络中的第3个MNV3模块和第8个MNV3模块分别和颈部网络中对应的Concat模块进行连接;将最后1个MNV3模块和颈部网络中的第1个Conv模块进行连接,同时在颈部网络各个C3模块的瓶颈层中添加ECA注意力机制,构成C3ECA模块。如图6所示,图像首先经Input端输入;然后由MobileNetV3网络结构组成的主干网络对其进行特征提取,将得到的特征图传递到Neck颈部网络进行特征融合;最后由Head检测网络确定待检测目标的位置和类别。

3 疲劳状态识别方法

3.1 基于面部特征多指标融合的疲劳判定模式

当人出现疲劳时,会在面部器官上产生一些疲劳特征,例如眨眼频率增加、持续闭眼时间延长、频繁打哈等。根据这些面部疲劳特征,通过多指标融合对驾驶员进行疲劳(perclos)判定[22]。perclos标准是指眼睛闭合时间占某一特定时间的百分比。通常选用P80作为眼部疲劳判别标准,P80指眼皮盖过眼球的面积超过80%时为眼睛闭合状态,然后计算在一定时间内眼睛闭合状态所占的时间比例。可以依据P80准则,转换为使用闭眼帧数占比来判断眼部状态。当闭眼帧数占比大于0.4时,认为是疲劳状态,如式(6)所示:

perclos=闭眼帧数检测时间段总帧数。(6)

人体在处于正常状态下的眨眼频率大概是每20 s眨3~10次眼睛,以20 s为一个周期,若在一个周期内眨眼频率不在正常取值范围,则判定为疲劳状态。驾驶员在正常驾驶中,很少会出现打哈的情况,频繁打哈则意味着驾驶员处于疲劳状态,打哈频率按照每分钟不超过3次为正常标准,超过这个频率则判定为疲劳状态。以上3种判定方式若因某一指标出现失效现象时,依据其余指标依然可以正确判断疲劳状态。

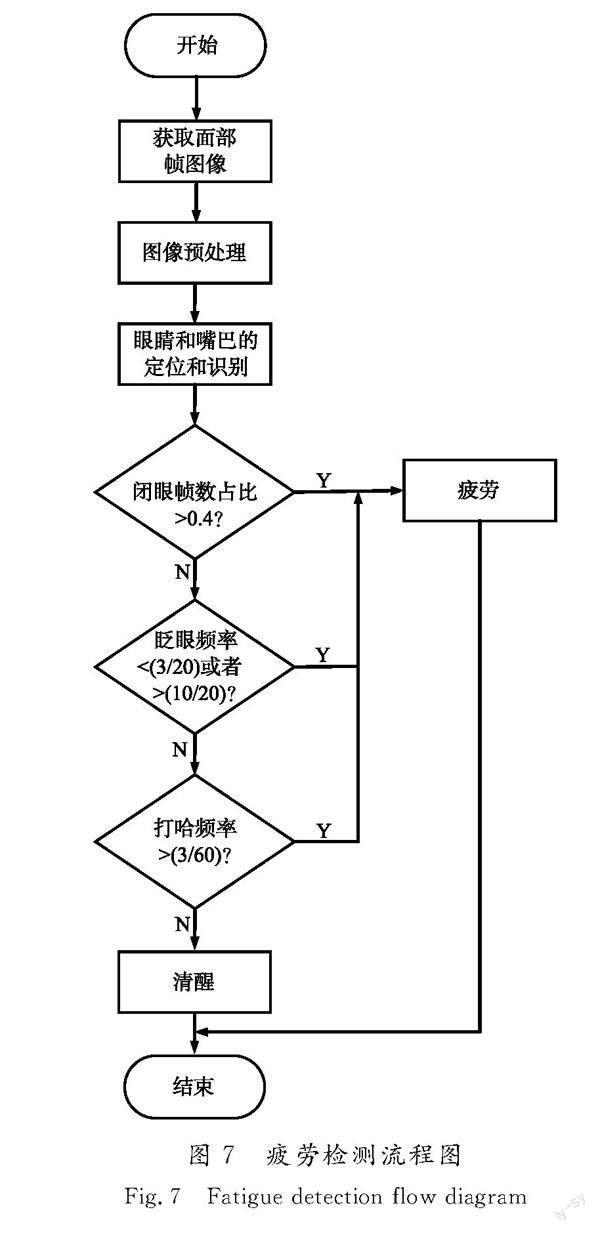

3.2 疲劳检测流程

疲劳检测流程如图7所示。首先,通过摄像头等设备实时获取驾驶员面部帧图像,模型对输入图像进行预处理操作后,直接在输出层定位和识别出眼睛和嘴巴的状态[23],包括眼睛的睁闭和嘴巴有无打哈的状态。然后,根据perclos标准下的闭眼帧数占比、眨眼频率、打哈频率对驾驶员进行多指标疲劳判定,当闭眼帧数占比>0.4时,判定为疲劳。否则继续看眨眼频率是否<(3/20),或者>(10/20),若是,则为疲劳;否则继续看打哈频率是否>(3/60),若是则为疲劳,否则输出为清醒状态,即以上3种情况都不满足。

4 实验与结果分析

4.1 实验环境及训练参数

实验环境配置和训练过程中的具体参数如表2及表3所示。

4.2 数据集采集与预处理

通过采用将开源的打哈检测数据集YawDD、闭眼数据集CEW,以及自采集数据集相融合的方式,来构建疲劳检测数据集Fatigue_add,其中Fatigue_add包含了在不同照明、不同种族、不同人脸偏转角度,以及驾驶员有无戴眼镜条件下的共计5 500张图片。

YawDD数据集包含驾驶者在正常驾驶(不说话)、开车时说话、开车时打哈欠3种状态下的视频。由于YawDD数据集为视频数据集,从中选择需要的视频,然后以30 f/s的帧率进行分帧截取操作,最终获取所需的关键帧图片;CEW数据集为不同人脸闭眼的图片数据集,可用于检测眼睛的睁闭状态;自采集数据集是通过2位男性驾驶者,分别采集人脸有大角度偏转动作时的图片数据。

首先,使用labelImg标注工具对Fatigue_add数据集中的眼睛目标和嘴巴目标进行一一标注,标注格式为voc格式,标注类别及对应序号为open_eyes(0)、close_eyes(1)、have_yawn(2)、no_yawn(3),每张图片标注完成后的标签文件名要与数据集中的图片文件名一一对应。然后,将Fatigue_add数据集按照8∶1∶1的比例划分为训练集、验证集和测试集,其中训练集4 400张图片,验证集550张图片,测试集550张图片。最后,由于YOLO系列算法只能处理txt格式的标签,所以还需把所有voc格式的标签转化为YOLO的txt格式。

4.3 评测指标

目标检测中常选用精确率(precision,P)、召回率(recall,R)、平均精度均值(mean average precision,mAP)作为评判模型性能的指标。具体如式(7)—式(10)所示:

P=TPTP+FP,(7)

R=TPTP+FN,(8)

mAP=∑Ci=1APiC,(9)

AP=∫10P(R)dR。(10)

式中:TP表示正样本被模型正确识别的数量;FP表示负样本被模型错误地识别为正样本的数量;FN表示正样本被模型错误地识别为负样本的数量;C为类别数目;APi为第i个类别的平均精度。

为了降低模型的复杂度,使模型足够轻量化,选用参数量、计算量、模型体积作为评判指标,同时因为驾驶员的疲劳检测对实时性也有较高要求,所以把检测速率也加入到指标中。

4.4 实验结果分析

4.4.1 不同轻量型网络对原模型的影响

本文分别使用3种不同的轻量型网络替换原YOLOv5s的主干网络进行实验,并在测试集上评测指标。从表4中可以看出,GhostNet网络的平均精度最高,但其参数量、计算量、体积较大,没有其他2种网络轻量化效果明显,且其检测速率最慢;PP-LCNet的轻量化效果最好,但其检测精度的各项指标不如MobileNetV3;只有MobileNetV3网络在保证各种精度指标的前提下,达到了比较好的轻量化效果,同时又保持着较高的检测速率,故选用MobileNetV3网络对原YOLOv5s模型进行轻量化处理。

4.4.2 不同注意力机制对原模型的影响

本文分别将4种不同的注意力机制加入到原YOLOv5s模型颈部网络的各个C3模块中进行实验,并在测试集上评测指标。从表5可以看出,4种注意力机制在轻量化效果方面没有差别,它们的参数量、计算量和体积基本一致;在检测精度方面,ECA注意力机制的mAP值为99.0%,是所有注意力机制中最高的;在召回率R方面,虽然ECA注意力机制没有CA注意力机制高,但其召回率仍然达到了97.4%,优于SE和CBAM注意力机制。同时在检测速度方面,ECA注意力机制也是最优秀的,达到了104 f/s。故选用ECA注意力机制對原YOLOv5s模型进行改进。

4.4.3 消融实验

为验证改进模型的有效性,在自建数据集Fatigue_add上进行消融实验,结果如表6所示。从表6可以看出,在YOLOv5s原模型的基础上加入MobileNetV3轻量型网络后,平均精度有小幅提高,模型的参数量、计算量和体积大幅缩减,同时检测速度有所提高;在YOLOv5s原模型颈部网络的C3模块中融入ECA注意力机制后,在召回率保持不变的前提下,精确率和平均精度

均有提高,但没有使模型轻量化;而将这两者均加入到YOLOv5s原模型中,最终使得改进模型参数量缩减为原模型的48%,计算量缩减为原来的38%,体积变为原来的50%,精确率提高了0.9个百分点,召回率提高了0.2个百分点,平均精度均值提高了0.5个百分点,达到了99.1%,检测速率也有小幅提高,达到了119 f/s。这使得改进后的YOLOv5s模型既实现了在嵌入式设备上轻量化部署的目的,又提高了检测精度,同时兼顾了检测实时性。

4.4.4 改进模型与基础模型对比

改进模型与原始YOLOv5s模型的平均精度均值和分类损失的对比如图8、图9所示。从图8可以看出,在迭代50轮之后,改进模型的mAP开始与原模型持平,并在迭代100轮左右时,改进模型的mAP开始逐渐优于原模型。从图9可以看出,在训练达到50轮左右时,在测试集上的分类损失性能开始比原模型更加优越。

4.4.5 不同模型对比

本文将改进的YOLOv5s模型与其他主流目标检测模型进行比较,从表7可以看出,改进的YOLOv5s模型的体积是所有对比模型中最小的,仅有6.83 MB;在召回率方面,改进的YOLOv5s模型的召回率也是最高的,达到了97.6%,均优于其他模型;在平均精度均值方面,虽然改进的[CM(22]YOLOv5s模型的mAP值低于YOLOv7模型和[CM)]YOLOv8模型,但仍然达到了99.1%,保持着较高的检测精度,满足疲劳检测精度上的要求。同时改进的YOLOv5s模型的检测速率虽略低于YOLOv7,但强于其他所有对比模型,达到了119 f/s,表现出良好的检测实时性。综上,改进的YOLOv5s模型的性能总体优于其他对比模型。

4.5 疲劳状态判定结果

如图10所示,若眨眼频率为每20 s眨3~10次眼睛且打哈频率为每分钟不超过3次时,则被判定为清醒状态,左上角会显示有“Awake”字样,图10-图12中“per 20 seconds blink_count”表示每20 s的眨眼次数,“per 60 seconds yawn_count”表示每60 s的打哈次数。当处于闭眼状态时,由于此时的perclos闭眼帧数占比大于0.4,所以被判定为疲劳状态,左上角会显示“Fatigue”字样,如图11所示。当处于打哈状态时,若打哈频率超过每分钟3次时,则也会被判定为疲劳状态,同样会显示“Fatigue”字样,如图12所示。

5 结 语

本文提出了一种基于改进YOLOv5的网络模型对驾驶员的疲劳状态进行检测,以减少因疲劳驾驶而造成的交通事故,对疲劳驾驶预警技术的应用有一定参考价值。

1)通过探讨不同轻量型网络对原模型的影响,得出MobileNetV3网络在保证精确率、召回率和平均精度的前提下,具有较好的轻量化效果;使用MobileNetV3网络替换原模型的主干网络,替换后模型的参数量、计算量、体积分别缩减至原来的48%、38%、50%,轻量化效果明显。

2)通过探讨不同注意力机制对原模型的影响,得出将ECA注意力机制加入到原模型颈部网络的各个C3模块中后,使得模型的mAP值为99%,检测速率为104 f/s,是所有对比注意力机制中表现最好的。

3)使用MobileNetV3网络替换原模型的主干网络,同时将ECA注意力机制加入到颈部网络各个C3模块中后,使得改进模型的召回率达到了97.6%,精确率达到了96.8%,平均精度均值达到了99.1%,分别较原模型提高了0.2、0.9和0.5个百分点,同时模型体积缩小至6.83 MB,检测速率也由115 f/s提升至119 f/s;且经实验对比,改进后的YOLOv5模型性能优于目前主流的目标检测模型。

本文改进的YOLOv5模型虽然可以高效地对驾驶员进行疲劳检测,但当人脸面部特征器官被实物遮挡时,由于无法判断特征器官状态,使得检测效果欠佳。今后将致力于提升模型对实物遮挡特征器官时的检测性能,以便能够完成更加复杂的疲劳检测任务。

参考文献/References:

[1]

朱永鹏.道路交通事故成因分析及预防措施[J].交通企业管理,2015,30(4):59-60.

ZHU Yongpeng.Cause analysis and preventive measures of road traffic accidents[J].Transportation Enterprise Management,2015,30(4):59-60.

[2] 李都厚,刘群,袁伟,等.疲劳驾驶与交通事故关系[J].交通运输工程学报,2010,10(2):104-109.

LI Douhou,LIU Qun,YUAN Wei,et al.Relationship between fatigue driving and traffic accident[J].Journal of Traffic and Transportation Engineering,2010,10(2):104-109.

[3] 劉秀,王长君,何庆.疲劳驾驶交通事故的特点分析与预防[J].中国安全生产科学技术,2008,4(1):128-131.

LIU Xiu,WANG Changjun,HE Qing.Characteristic analysis and prevention of traffic accidents by fatigue driving[J].Journal of Safety Science and Technology,2008,4(1):128-131.

[4] 张瑞,朱天军,邹志亮,等.驾驶员疲劳驾驶检测方法研究综述[J].计算机工程与应用,2022,58(21):53-66.

ZHANG Rui,ZHU Tianjun,ZOU Zhiliang,et al.Review of research on driver fatigue driving detection methods[J].Computer Engineering and Applications,2022,58(21):53-66.

[5] LAL S K L,CRAIG A.Driver fatigue:Electroencephalography and psychological assessment[J].Psychophysiology,2002,39(3):313-321.

[6] ZHANG Yongqi,ZHENG Weilong,LU Baolu.Transfer compo-nents between subjects for EEG-based driving fatigue detection[C]//Neural Information Processing:22nd International Conference,ICONIP 2015.Cham:Springer,2015:61-68.

[7] 廖明明,赵波.基于面部特征融合的驾驶员疲劳检测[J].智能计算机与应用,2021,11(10):77-81.

LIAO Mingming,ZHAO Bo.Driver fatigue detection based on facial feature fusion[J].Intelligent Computer and Applications,2021,11(10):77-81.

[8] YANG Zhuangqian,ZHANG Kehua,WANG Jiayi,et al.Driver fatigue detection method based on eye states with pupil and iris segmentation[J].IEEE Access,2020,8:173440-173449.

[9] ANSARI S,NAGHDY F,DU H P,et al.Driver mental fatigue detection based on head posture using new modified ReLU-BiLSTM deep neural network[J].IEEE Transactions on Intelligent Transportation Systems,2022,23(8):10957-10969.

[10]ADHINATA F D,RAKHMADANI D P,WIJAYANTO D.Fatigue detection on face image using facenet algorithm and k-nearest neighbor classifier[J].Journal of Information Systems Engineering and Business Intelligence,2021,7(1):22-30.

[11]娄平,杨欣,胡辑伟,等.基于边缘计算的疲劳驾驶检测方法[J].计算机工程,2021,47(7):13-20.

LOU Ping,YANG Xin,HU Jiwei,et al.Fatigue driving detection method based on edge computing[J].Computer Engineering,2021,47(7):13-20.

[12]史瑞鹏,钱屹,蒋丹妮.一种基于卷积神经网络的疲劳驾驶检测方法[J].计算机应用研究,2020,37(11):3481-3486.

SHI Ruipeng,QIAN Yi,JIANG Danni.Fatigue driving detection method based on CNN[J].Application Research of Compu-ters,2020,37(11):3481-3486.

[13]李孟成,羅甜,张琰,等.基于YOLOv5的疲劳与危险驾驶行为检测系统研究[J].内蒙古科技与经济,2023(6):107-110.

LI Mengcheng,LUO Tian,ZHANG Yan,et al.Research on fatigue and dangerous driving behavior detection system based on YOLOv5[J].Inner Mongolia Science Technology and Economy,2023(6):107-110.

[14]张上,陈益方,王申涛,等.基于YOLOv5的改进舰船目标检测算法[J].电光与控制,2023,30(12):66-72.

ZHANG Shang,CHEN Yifang,WANG Shentao,et al.An improved ship target detection algorithm based on YOLOv5[J].Electronics Optics & Control,2023,30(12):66-72.

[15]李然.基于改进YOLOv5模型的安全帽佩戴检测[D].哈尔滨:东北农业大学,2022.

LI Ran.Helmet Wear Detection Base on Improved YOLOv5[D].Harbin:Northeast Agricultural University,2022.

[16]程泽,林富生,靳朝,等.基于轻量化卷积神经网络的疲劳驾驶检测[J].重庆理工大学学报(自然科学),2022,36(2):142-150.

CHENG Ze,LIN Fusheng,JIN Chao,et al.Fatigue driving detection method based on lightweight convolutional neural network[J].Journal of Chongqing University of Technology (Natural Science),2022,36(2):142-150.

[17]李光明,弓皓斌,袁凯.基于轻量化YOLOv5s的花椒簇检测研究[J].中国农机化学报,2023,44(4):153-158.

LI Guangming,GONG Haobin,YUAN Kai.Research on lightweight pepper cluster detection based on YOLOv5s[J].Journal of Chinese Agricultural Mechanization,2023,44(4):153-158.

[18]韩翠英,张翠青.基于PERCLOS的疲劳驾驶检测系统的实现[J].内蒙古农业大学学报(自然科学版),2012,33(4):202-206.

HAN Cuiying,ZHANG Cuiqing.Fatigue driving detection system implement based on PERCLOS[J].Journal of Inner Mongolia Agricultural University(Natural Science Edition),2012,33(4):202-206.

[19]张鹏飞,王淑青,王年涛,等.基于改进MobileNetV3的PCB裸板缺陷检测[J].湖北工业大学学报,2023,38(1):27-32.

ZHANG Pengfei,WANG Shuqing,WANG Niantao,et al.PCB bare board defect detection based on improved MobileNetV3[J].Journal of Hubei University of Technology,2023,38(1):27-32.

[20]宋怀波,李嵘,王云飞,等.基于ECA-YOLO v5s网络的重度遮挡肉牛目标识别方法[J].农业机械学报,2023,54(3):274-281.

SONG Huaibo,LI Rong,WANG Yunfei,et al.Recognition method of heavily occluded beef cattle targets based on ECA-YOLOv5s[J].Transactions of the Chinese Society for Agricultural Machinery,2023,54(3):274-281.

[21]皇甫晓瑛,钱惠敏,黄敏.结合注意力机制的深度神经网络综述[J].计算机与现代化,2023(2):40-49.

HUANGFU Xiaoying,QIAN Huimin,HUANG Min.A review of deep neural networks combined with attention mechanism[J].Computer and Modernization,2023(2):40-49.

[22]吕秀丽,刘希凤,白永强.基于SSD的多因素融合的驾驶疲劳检测研究[J].电子测量技术,2022,45(15):138-143.

LYU Xiuli,LIU Xifeng,BAI Yongqiang.Research on driving fatigue detection based on SSD muti-factor fusion[J].Electronic Measurement Technology,2022,45(15):138-143.

[23]邹昕彤,王世刚,赵文婷,等.基于眼睛与嘴部状态识别的疲劳驾驶检测[J].吉林大学学报(信息科学版),2017,35(2):204-211.

ZOU Xintong,WANG Shigang,ZHAO Wenting,et al.Fatigue driving detection based on state recognition of eyes and mouth[J].Journal of Jilin University (Information Science Edition),2017,35(2):204-211.

李浩,馬晓,周万珍.基于改进YOLOv5的驾驶员疲劳状态检测

[J].河北工业科技,2024,41(1):17-26.LI Hao, MA Xiao, ZHOU Wanzhen.

Driver fatigue state detection based on improved YOLOv5

[J]. Hebei Journal of Industrial Science and Technology,2024,41(1):17-26.