基于三维空间旋转平移的自适应知识表示方法

李子茂 汤先毅 尹帆 王灿 姜海

摘 要:现有知识图谱表示学习研究中普遍存在忽视特定关系的语义空间、难以建模非单射复杂关系或多种关系模式等问题,尤其是在不可交换的组合以及子关系两种关系模式上表现不佳。针对该问题,在对实体自适应投影的基础上,利用罗德里格斯旋转公式将旋转操作从二维空间拓展到三维空间并进行平移优化,提出一种新的具有强表征能力的模型ATR3DKRL。通过理论推导可以证明该模型能够建模非单射复杂关系以及多种关系模式。在多个通用数据集上的实验结果表明,该模型可以有效提高链接预测精度,在数据集DB100K与FB15K-237中四个指标上领先现有基线模型,其中在DB100K上评价指标MRR和H@1相较于基线模型RotatE分别大幅提高了3.3%以及6.5%。

关键词:知识图谱; 表示学习; 自适应投影; 旋转平移

中图分类号:TP391.1 文献标志码:A 文章编号:1001-3695(2024)01-009-0059-06

doi:10.19734/j.issn.1001-3695.2023.05.0282

Adaptive knowledge representation method based on rotation and translation in 3D space

Abstract:The existing knowledge graph representation learning studies generally suffer from the problems of neglecting the semantic space of specific relations, or difficulty in modeling non-injective complex relations, or difficulty in modeling multiple relation patterns, especially poor performance on two relation patterns of non-commutative combinations as well as sub-relations. To address this problem, based on the adaptive projection of entities, this paper proposed a new model with strong representation ability, called ATR3DKRL. By extending the rotation operation from 2D to 3D using the Rodrigues rotation formula with translation optimization, it could be demonstrated through theoretical derivation that the model could model non-injective complex relationships and multiple relation patterns. The experimental results on several generic datasets show that the model can effectively improve link prediction accuracy, leading existing baseline models in four metrics in dataset DB100K and FB15K-237. Comparing to the baseline model RotatE on the evaluation indicators MRR and H@1 in DB100K, it can significantly increase by 3.3% and 6.5%.

Key words:knowledge graph; representation learning; adaptive projection; rotation and translation

0 引言

知識图谱常用三元组(h,r,t)表示,h、r、t分别代表头实体、关系和尾实体,其中存在大量缺失的信息,而知识表示学习,也称知识图谱嵌入,通过将实体和关系嵌入到低维向量空间,进而预测知识图谱缺失的事实三元组,达到知识图谱补全的目的。现有成功构建的大型知识图谱,如Freebase[1]、DBpedia[2]、YAGO[3]等已被广泛应用于推荐系统[4]、智能搜索[5]、知识库问答[6]以及自然语言处理[7]等下游任务领域。现有知识表示学习主要存在以下难点:难以自适应地有效建模一对多、多对一、多对多的非单射复杂关系[8];难以有效建模不可交换组合[9]以及子关系[10]两种关系模式,进而同时满足对称、反对称、自反、可交换组合、不可交换组合以及子关系六种关系模式[9~11]。假设存在人物关系知识图谱如图1所示,在预测张壹男母亲是谁时,仅与图中右侧描述的亲属关系有联系,与图中左侧描述的职业关系无关;在导演关系中,张艺谋与电影《十面埋伏》以及《英雄》就是非单射复杂关系中一对多的情况;张艺谋父亲的妻子与妻子的父亲分别指代张孝友与陈继宗,因此“父亲”与“妻子”属于不可交换的组合关系;张艺谋既是张壹男的父亲也是张壹男的长辈,长辈关系称为父亲关系的子关系。

在知识表示学习中,研究者们主要考虑对复杂关系的建模,现有研究如RotatE[11],在对称、反对称、自反以及可交换组合关系中取得良好成效,但受限于向量Hadamard乘积的特性,在关系模式中很难区分不可交换组合关系以及子关系,同时忽略了对非单射复杂关系的建模。部份考虑到非单射复杂关系的模型,如TransH[12],却又只能建模对称和反对称两种关系模式。

本文考虑到实体在不同关系下的语义,以及对非单射复杂关系和六种关系模式的建模,将实体进行自适应投影,并把RotatE模型中的二维旋转通过罗德里格斯旋转公式[13]拓展到三维,结合平移思想提出了一种新的模型ATR3DKRL。在FB15K[8]、FB15K-237[14]以及DB100K[15]三个数据集中进行实验,并验证了本文模型尤其是在组合关系以及子关系的有效性。

1 相关工作

目前,知识表示学习的方法主要分为基于语义匹配的模型和基于翻译的模型两类。

1.1 语义匹配模型

RESCAL模型[16]用向量表示实体,用矩阵表示关系,以此模拟各个要素之间成对的相互影响,但是产生了大量的参数导致模型难以训练。DistMult模型[17]通过限制关系矩阵为对角矩阵,极大地减少了RESCAL模型中的参数,但是过于简化了关系矩阵,导致仅适用于模拟对称关系问题,大多情况下表示能力反而不如RESCAL模型。ComplEx[18]首次引入复数向量空间,通过将关系和实体嵌入到复数向量空间来改进DistMult,满足对称、反对称以及自反三种关系模式。HolE模型[19]对头尾实体的维度循环操作,再联合关系进行语义匹配计算得分,兼具了RESCAL模型和DistMult模型两者的优势。Anology模型[20]则将关系矩阵解释为实体的线性变换,利用矩阵的交换性约束建模类似平行四边形的类比推理属性。上述语义匹配模型均难以建模非单射复杂关系,以及子关系、可交换组合与不可交换组合关系两种关系模式。ComplEx-NNE+AER[15]则在ComplEx的基础上添加了子关系约束,仅能够使其额外建模出子关系。CrossE[21]通过交互矩阵让实体能够根据特定关系自适应表示,但是难以建模非单射复杂关系以及对称、子关系两种关系模式。SEEK[22]综合考虑了模型的复杂性以及表达性,使用分段的方式提出了一种輕量化模型,增强了对称与反对称关系模式的建模,并且统一了DistMult与ComplEx作为该模型的特殊情况,但忽视了非单射复杂关系以及不可交换的组合关系。

1.2 基于翻译的模型

基于翻译的模型具有更强的可解释性,更适合建模复杂的关系,是当前研究的热点。TransE模型[8]受到word2vec[23]的启发,将关系看作头实体与尾实体之间的距离,模型效果虽然不错,但是过于简单,且无法建模非单射的复杂关系。TransH模型和TransR模型[24]为了能够建模非单射的复杂关系,分别将实体映射到关系的超平面中以及通过矩阵变换将实体嵌入到关系的特定向量空间中去,但是TransH与TransR只能够满足对称与反对称两种关系模式。TransD模型[25]优化了TransR,将映射矩阵拆分为头尾两个部分,且将映射矩阵简化为向量,减少了计算量,但是实体和关系都需要两个向量来表示,相较于TransH增大了参数量。TransA模型[26]增加了一个非负的权重矩阵为每一维学习不同的权重,从而达到实体自适应的目的,但是无法建模非单射复杂关系以及多种关系模式。TransAD模型[27]则结合了TransD与TransA的优势,却同样无法建模多种关系模式。

RotatE模型[11]与Trans系列的平移思想不同,受到欧拉公式的启发将实体与关系嵌入到复数空间,把关系解释为头实体与尾实体之间的旋转操作,满足了对称、反对称、自反、可交换组合四种关系模式,但是二维空间的旋转缺乏对不可交换组合、子关系以及非单射复杂关系的建模能力。Rotate3D[9]将二维空间拓展到三维空间,利用四元数将关系解释为三维空间中头实体与尾实体之间的旋转操作,增加了对不可交换组合的关系模式的建模能力,但缺乏对非单射复杂关系的建模能力。RotatCT[28]同样对RotatE进行了改进,将旋转操作拓展为旋转与平移,增强了模型对不可交换组合的关系模式的建模能力,但也存在与Rotate3D同样的问题。RotatH[29]引入超平面,将RotatE与TransH结合,解决了非单射复杂关系的建模问题,但依然缺乏对不可交换组合以及子关系两种关系模式的建模能力。HRotat[30]使用逆反嵌入的方式结合了RotatE以及SimplE[31],提升了RotatE模型对自反关系的建模能力,但并没有带来其他提升。

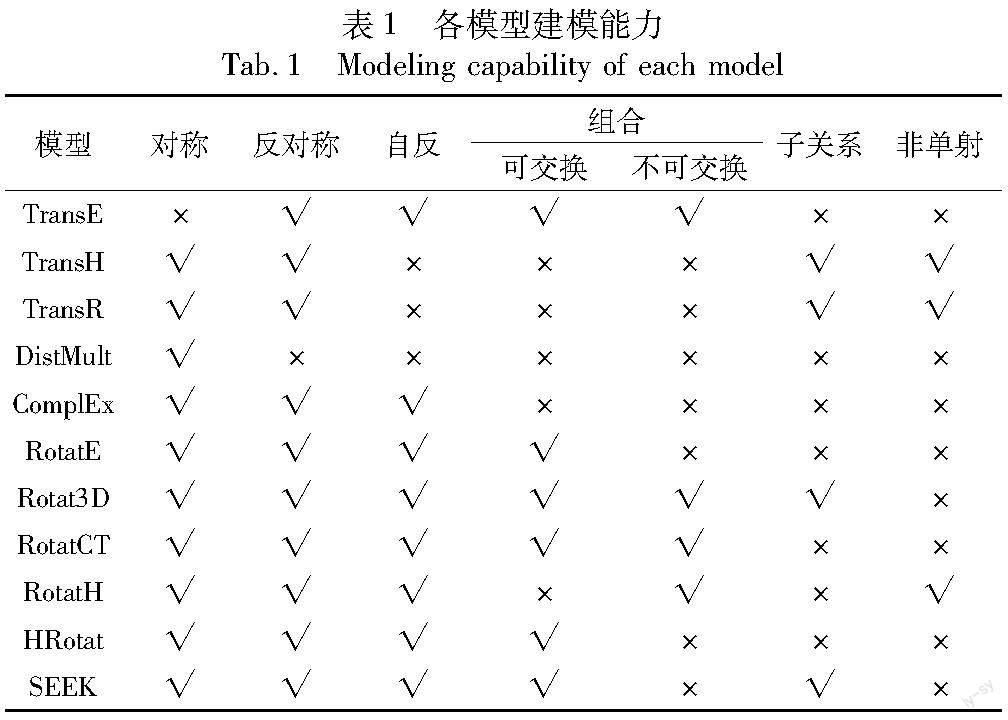

当前主流模型的建模能力如表1所示,无论是语义匹配模型还是翻译模型,均不能很好地同时建模出非单射复杂关系以及六种关系模式。

2 关系模式定义

本文使用E表示实体的集合,R表示关系的集合,令S表示所有真实三元组的集合,S-表示所有负样本三元组的集合。知识图谱中主要存在对称、反对称、自反、可交换的组合关系、不可交换的组合关系以及子关系六种关系模式,定义如下:

定义1 关系r是对称关系,如果:

x,y∈E,(x,r,y)∈S(y,r,x)∈S

定义2 关系r是反对称关系,如果:

x,y∈E,(x,r,y)∈S(y,r,x)∈S-

定义3 关系r1和r2是自反关系,如果:

x,y∈E,(x,r1,y)∈S(y,r2,x)∈S

定义4 关系r3是由r1和r2构成的组合关系,则如果:

x,y,z∈E,(x,r1,y)∈S∧(y,r2,z)∈S(x,r3,z)∈S

定义4.1 当r1和r2是可交换的,如果:

x,y∈E,(x,r1r2,y)∈S(x,r2r1,y)∈S

定义4.2 当r1和r2是不可交换的,如果:

x,y∈E,(x,r1r2,y)∈S(x,r2r1,y)∈S-

定义5 关系r2为r1的子关系,如果:

x,y∈E,(x,r1,y)∈S(x,r2,y)∈S

3 ATR3DKRL模型设计

本文ATR3DKRL模型通过实体的自适应投影与实体的三维空间旋转平移两个步骤解决上述难点。

3.1 实体的自适应投影

本文采用图2所示的方式进行实体向量的投影,由于实体通过由关系决定的超平面进行投影,使得实体拥有根据不同关系下的语义空间进行自适应表示的能力;同时不同实体也能够投影成相同的向量,解决了非单射复杂关系的建模问题。

投影后的头尾实体可表示为

hA=h-nTrhn(1)

tA=t-nTrtn(2)

其中:nr,hA,tA∈RAp3d。nr由关系决定,是关系的超平面法向量;hA和tA则分别代表投影后的头尾实体;超平面法向量nr的模长对实体投影没有影响,所以限制‖nr‖=1,使其成为该方向上的单位向量。

3.2 实体的三维空间旋转平移

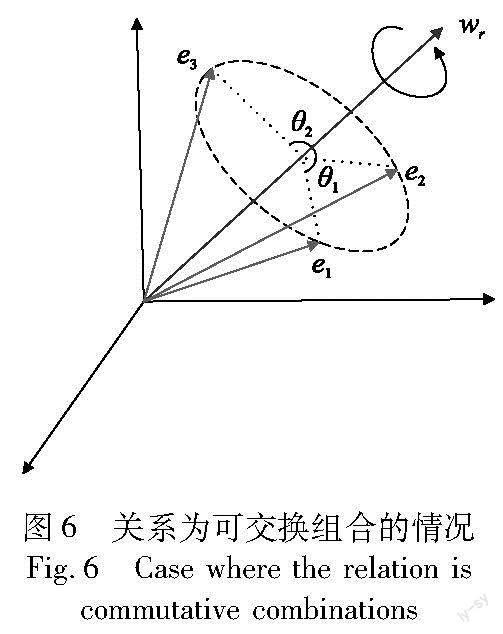

二维空间的旋转模型RotatE仅考虑了四种关系模式就已经取得不错的成绩,说明了在翻译模型中旋转的有效性。但是二维空间的旋转无法区分旋转的先后顺序,所以不能建模出不可交换的组合关系,同时在头尾实体固定的情况下,旋转角度也被固定,所以也无法建模子关系。为了额外建模出不可交换组合以及子关系两种关系模式,本文借助罗德里格斯旋转公式[12]将旋转拓展到三维空间,提出了三维空间中的旋转平移模型,将每个关系定义为从头部实体h到尾部实体t的旋转与平移。对于每一个关系r都有一个旋转轴wr,一个旋转角度θ以及一个平移向量dr。由于并不关心旋转轴wr的模长,所以为了使关系r与头尾实体维度保持一致,将wr的模长定义为θ。旋转和平移的过程如图3所示。

根据罗德里格斯旋转公式,假设wr=(wrx,wry,wrz)T,其中wrx、wry、wrz分别表示在三维空间中的三个分量,则旋转后的头向量hR定义为

hR=RhA(3)

其中:R∈SO(3),代表旋轉矩阵,属于特殊正交群,可表示为

式(3)表明旋转操作可以看作投影后的头实体hA经过由关系r所决定的旋转矩阵R作空间变换,可以得到旋转后的头实体hR,而旋转矩阵R由旋转轴wr以及旋转角度θ所决定。一次三维空间的旋转操作可以解释为头实体hA绕旋转轴wr旋转θ度得到旋转后的头实体hR。

单一的旋转操作不会影响实体的模长,表征空间限制在球面上,适当增加平移操作能够起到缩放模长的效果,使得表征空间拓展成实心球体。旋转以及平移得到的头实体hT定义为

hT=hR+λdr=RhA+λdr(6)

其中:λ为超参数表示平移的影响因子;dr∈RAp3d表示平移向量。将式(6)进一步化简,引入齐次坐标变换,得到:

其中:T∈SE(3),属于特殊欧氏群,表示变换矩阵,即旋转平移矩阵。对于一个三元组(h,r,t),可以定义一个基于距离的得分函数,如式(8)所示。

3.3 关系模式证明

本文ATR3DKRL模型能够建模出对称、反对称、自反、可交换组合、不可交换组合、子关系六种关系模式。图4~8中的头尾实体用红色表示,旋转轴用紫色表示,平移向量用蓝色表示,旋转后的向量用绿色表示(见电子版)。

定理1 ATR3DKRL模型能够建模对称、反对称、自反、可交换组合关系、不可交换组合关系以及子关系六种关系模式。

证明如下:

1)r为对称关系时

如果(e1,r,e2)∈S,并且(e2,r,e1)∈S,则

T[eT11]T=[eT21]T∧T[eT21]T=[eT11]T

TT[eT11]T=[eT11]TTT=E

如图4所示,头实体e1与尾实体e2均能绕旋转轴旋转180°以后加上相同的平移分量得到对方。因此,当旋转角度满足θ=π,平移向量dr在由旋转轴wr为法向量的平面上时,变换矩阵T满足TT=E。

2)r为反对称关系时

如果(e1,r,e2)∈S,并且 (e2,r,e1)∈S-,则

T[eT11]T=[eT21]T∧T[eT21]T≠[eT11]T

TT[eT11]T≠[eT11]TTT≠E

从图4可以看出,只要旋转角度θ≠π或者平移向量dr不在由旋转轴wr为法向量的平面上时,变换矩阵T满足TT≠E。

3)r1与r2为自反关系时

如果(e1,r1,e2)∈S,并且(e2,r1,e1)∈S,则

T1[eT11]T=[eT21]T∧T2[eT21]T=[eT11]T

T1T2[eT21]T=[eT21]TT1T2=E

如图5所示,关系r1确定旋转轴wr1、旋转角度θ1与平移向量dr1;关系r2确定旋转轴wr2、旋转角度θ2与平移向量dr2。头实体e1先绕旋转轴wr1旋转θ1度,然后加上平移向量dr1到达尾实体e2,尾实体e2则可以绕旋转轴wr2旋转θ2度,然后加上平移向量dr2回到头实体e1。这样的两组由关系r1和r2决定的旋转轴,旋转角以及平移向量使得等式T1T2=E成立,从而使得r1与r2满足自反关系。

4)r3为r1与r2的组合关系时

如果(e1,r1,e2)∈S,(e2,r2,e3)∈S,并且(e1,r3,e3)∈S,则

T1[eT11]T=[eT21]T

T2[eT21]T=[eT31]T∧T3[eT11]T=[eT31]TT1T2[eT11]T=[eT31]T∧T3[eT11]T=[eT31]TT1T2=T3

a)当r3为r1与r2的可交换组合关系时:

T1T2=T2T1

b)当r3为r1与r2的不可交换组合关系时:

T1T2≠T2T1

由于变化过程被分解为旋转与平移两个部分,而平移部份的平移向量在计算过程中做加法运算,加法运算满足交换律,因此平移部份的先后顺序在任何情况下都是可交换的,可以得出结论只有旋转部份影响组合关系是否可交换。

如图6所示,实体e1先绕旋转轴wr旋转θ1度得到实体e2,再绕同一个旋转轴wr旋转θ2度得到实体e3,等价于实体e1绕旋转轴wr旋转θ1+θ2度得到实体e3,由于两次旋转的旋转轴wr相同,两次旋转均在同一个平面上,此时三维空间的旋转退化为二维空间的旋转,所以旋转的先后顺序无关,最终均等于θ1+θ2度,满足可交换组合关系,而两次旋转操作的旋转轴不同时,则无法保证组合的可交换性。故而得出结论,当关系r1与r2的旋转轴wr相同时,变换矩阵满足T1T2=T2T1,此时为可交换组合关系;当关系r1与r2的旋转轴wr不同时,变换矩阵满足T1T2≠T2T1,此时为不可交换组合关系。

5)r2为r1的子关系

如果(e1,r1,e2)∈S,能得到(e1,r2,e2)∈S,则

T1[eT11]T=[eT21]TT2[eT11]T=[eT21]T

T1[eT11]T=T2[eT11]T

当把变换操作看作旋转和平移两个单独操作时,假设不同关系中的平移向量dr相同,如图7所示,存在一个过原点的平面均等分割头尾实体,在此平面中从原点出发的任意向量均可作为旋转轴wr,因此存在多组不同的旋转轴wr与旋转角θ使得变换矩阵T满足条件。

当把变换操作看作整体时,则如图8所示,头实体e1绕旋转轴wr1旋转θ1度再加上平移向量dr1得到尾实体e2。同时也存在无数个由不相同的关系ri所决定的旋转轴、旋转角度以及平移向量,使得头实体e1仍然能够变换到尾实体e2,其中平移向量dr起到调节旋转操作的作用。因此这类情况下也存在多组不同的旋转轴wr、旋转角θ以及平移向量dr使得变换矩阵T满足条件。

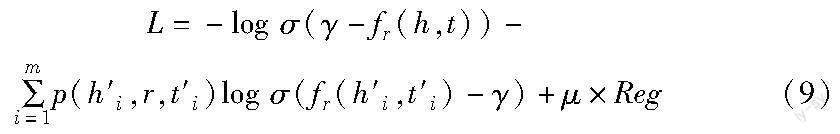

3.4 损失函数

在知识图谱的数据及样本中,往往只有正例样本,在构建负样本时,本文按照RotatE提出的自对抗采样方式,对生成的负样本附加一个权重,模型的损失函数为

其中:γ是一个超参数表示固定的间隔;σ表示sigmoid函数;(h′i,r,t′i)是第i个负样本;m是负样本的数目;μ是正则化系数;Reg表示正则化项,表示为

其中:α≥0为采样的温度。当α=0时就是均匀采样;当α>0时,越具有训练价值的负样本生成的概率越高。

3.5 模型算法设计

ATR3DKRL的训练算法见算法1。

算法1 ATR3DKRL的训练算法

输入:训练集S={(h,r,t)};知识图谱实体集E和关系集R;嵌入维度d;学习率η;平移系数λ;固定间隔γ;自对抗采样温度α;批次大小b;负样本的数目m;模型训练的轮数max_step;正则化系数μ。

输出:实体集E与关系集R的向量表示。

初始化实体集E和关系集R。

for step≤max_step:

采样大小为b的一批正样本Sbatch

for (h,r,t)∈Sbatch do

随机替换头实体或尾实体,构造m个负样本

end

根据式(8)计算正样本和负样本的得分

根据式(9)计算损失函数的值

通过Adam优化器更新实体集E和关系集R

end

输入为实体集合E、关系集合R、训练样本S={(h,r,t)}以及训练时的超参数。其中实体集合E表示实体向量的集合,由头实体h和尾实体t构成,进行随机初始化,关系集合R中每个关系由超平面法向量nr、旋转轴wr、旋转角度θ以及平移向量dr构成,初始值分別进行随机初始化。在每一轮的训练中,模型按照上述损失函数公式计算出结果,然后采用Adam优化器梯度下降反向传播更新实体集合E与关系集合R。

4 实验与分析

4.1 实验数据集

本文使用数据集的统计结果见表2所示。数据集主要有FB15K[8]、FB15K-237[14]和DB100K[15]三个。FB15K是知识图谱Freebase的子集,数据集中的关系模式主要是对称、反对称以及自反。FB15K-237是FB15K的子集,删除了其中的自反关系,只保留了237种关系,数据集中关系模式多为对称、反对称以及组合。DB100K是从DBpedia中构建的,主要关系模式为组合、自反以及子关系。本实验通过数据集FB15K来验证模型建模非单射复杂关系的有效性;通过数据集FB15K-237来验证在不可交换的组合关系下模型具有良好的效果;通过数据集DB100K来验证模型能够有效建模子关系。

4.2 实验结果分析

实验代码在RotatE提供的框架基础上进行,因此在数据集FB15K和FB15K-237上所选参数为RotatE文献中所提供的最佳参数,与基线模型保持一致,而在数据集DB100K上由于RotatE没有进行实验,所以所选参数参考了前两个数据集的最佳参数,并通过实验确定最终参数选择,且复现的RotatE结果选取同样的参数。

本文在DB100K数据集上将嵌入维度设置为d=1 000,边距γ=14.0,批次大小b=512,负样本批次大小m=256,采样温度α=0.5,平移系数λ=0.1,最大训练次数max_step=150 000,学习率η=0.000 05。实验结果如表3所示,RotatE结果为本文复现结果,其余对比模型结果取自SEEK[23]。

由于数据集DB100K数据量庞大,且有大量的子关系存在,更加适合复杂模型的训练,所以本文模型ATR3DKRL在MRR、H@1、H@3、H@10四个指标中表现最佳,且具有明显优势。表中RotatE的结果为本文复现的结果。相较RotatE,本文模型的優势在于能够对子关系进行有效建模,因此在MRR、H@1、H@3、H@10中分别提升3.3%、6.5%、0.7%以及0.6%。而同样能建模子关系的SEEK由于不能对不可交换的组合关系建模,导致在各项指标中也远远落后本文模型。

本文在FB15k-237数据集上将嵌入维度设置为d=1 000,边距γ=12.0,批次大小b=512,负样本批次大小m=256,采样温度α=1.0,平移系数λ=0.1,最大训练次数max_step=150 000,学习率η=0.000 05。实验结果如表4所示,其余对比实验结果均取自对应文献。

在消除了自反关系以后的子集FB15K-237中,包含可交换与不可交换两类的组合关系占比增大,使得能够同时建模出这两种关系模式的模型更具优势。本文模型在四个指标上均取得了最优结果,相较于基线模型RotatE,在MR中提升了11名,在MRR、H@1、H@3、H@10中分别提升了1.3%、1.2%、1.4%以及1.6%。反映出RotatE缺乏对不可交换组合关系的建模,同时也验证了本文模型在此关系模式上建模的有效性。

本文在FB15K数据集上将嵌入维度设置为d=1 000,边距γ=12.0,批次大小b=512,负样本批次大小m=256,采样温度α=0.5,平移系数λ=0.1,最大训练次数max_step=150 000,学习率η=0.00 005。实验结果如表5所示,其余结果均取自对应文献。

本文模型在FB15K上表现良好,在H@3以及H@10两个指标上取得最优,相较于基线模型RotatE分别提升了0.4%以及1%,但是在MRR以及H@1上均有降低,尤其是在H@1上,可能是由于FB15K中有大量简单学习的自反关系,相比于RotatE,本文模型表征能力更强,但不易学习到最优的结果,在处理简单关系时选择唯一正确结果的能力不如简单模型。

为了验证模型对非单射复杂关系的建模能力,本文在FB15K数据集中对复杂关系分别进行实验,以H@10作为评价指标,结果如表6所示,其余结果取自RotatE。

在处理复杂非单射复杂关系中,本文模型在处理N-1以及N-N关系时表现最佳,同时也在所有非单射复杂关系中领先基线模型RotatE,在一对一、一对多、多对一、多对多四个方面分别提升了9.4%、0.6%、5.2%、0.4%,验证了本文模型处理非单射复杂关系的能力。

5 结束语

本文提出了ATR3DKRL模型,利用关系超平面进行投影,并借助罗德里格斯旋转公式将旋转操作由二维空间引拓展到三维空间,同时引入平移操作,使模型拥有对非单射复杂关系以及六种关系模式的建模能力。本文从理论以及实验中相互印证了模型的有效性,尤其是在不可交换组合以及子关系居多的数据集中表现良好。但是,本文模型同样存在模型复杂度高的局限性,在关系简单、数据量不充分的数据集中难以取得突出的效果,例如在关系简单的FB15K中仅取得两个指标的领先,且领先幅度很小,模型训练时间也较长。未来,可以考虑对模型参数就行优化,也可以进一步把研究拓展到时序知识图谱中去,同时还可以考虑融合一些辅助信息,如文本描述、图片、关系路径、关系类型等。

参考文献:

[1]Bollacker K. Freebase:a collaboratively created graph database for structuring human knowledge[C]//Proc of ACM SIGMOD International Conference on Management of Data.New York:ACM Press,2008:1247-1250.

[2]Bizer C, Lehmann J, Kobilarov G, et al. DBpedia—a crystallization point for the web of data[J].Web Semantics Science Services & Agents on the World Wide Web,2009,7(3):154-165.

[3]Suchanek F M, Kasneci G, Weikum G. YAGO:a core of semantic knowledge[C]//Proc of the 16th International Conference on World Wide Web.New York:ACM Press,2007:697-706.

[4]Ma Weizhi, Zhang Ming, Cao Yue, et al. Jointly learning explainable rules for recommendation with knowledge graph[C]//Proc of the World Wide Web Conference.New York:ACM Press,2019:1210-1221.

[5]Xiong Chenyan, Power R, Callan J. Explicit semantic ranking for academic search via knowledge graph embedding[C]//Proc of the 26th International Conference on World Wide Web.New York:ACM Press,2017:1271-1279.

[6]Hao Yanchao, Zhang Yuanzhe, Kang Liu, et al. An end-to-end model for question answering over knowledge base with cross-attention combining global knowledge[C]//Proc of the 55th Annual Meeting of the Association for Computational Linguistics.Stroudsburg,PA:Association for Computational Linguistics,2017:221-231.

[7]Yang Bishan, Mitchell T. Leveraging knowledge bases in LSTMs for improving machine reading[C]//Proc of the 55th Annual Meeting of the Association for Computational Linguistics. Stroudsburg,PA:Association for Computational Linguistics, 2017:1436-1446.

[8]Bordes A, Usunier N, Garcia-Durán A, et al. Translating embeddings for modeling multi-relational data[C]//Proc of the 26th International Conference on Neural Information Processing Systems.Red Hook,NY:Curran Associates Inc.,2013:2787-2795.

[9]Gao Chang, Sun Chengjie, Shan Lili, et al. Rotate3D: representing relations as rotations in three-dimensional space for knowledge graph embedding[C]//Proc of the 29th ACM International Conference on Information & Knowledge Management.New York:ACM Press,2020:385-394.

[10]Qu Meng, Tang Jian. Probabilistic logic neural networks for reasoning[C]//Proc of the 33rd International Conference on Neural Information Processing Systems.New York:ACM Press,2019:7712-7722.

[11]Sun Zhiqing, Deng Z H, Nie J Y, et al. Rotate:knowledge graph embedding by relational rotation in complex space[EB/OL].(2019-02-26).https://arxiv.org/abs/1902.10197.

[12]Wang Zhen, Zhang Jianwen, Feng Jianlin, et al. Knowledge graph embedding by translating on hyperplanes[C]//Proc of the 28th AAAI Conference on Artificial Intelligence.Palo Alto,CA:AAAI Press,2014,28:1112-1119.

[13]Rodrigues O. Des lois géométriques qui régissent les déplacements dun système solide dans lespace, et de la variation des coordonnées provenant de ses déplacements consideéerés indépendamment des causes qui peuvent les produire[J].Journal des Mathématiques Pures et Appliquées,1840,5(1):380-440.

[14]Toutanova K, Chen Danqi. Observed versus latent features for know-ledge base and text inference[C]//Proc of the 3rd Workshop on Continuous Vector Space Models and Their Compositionality.Stroudsburg,PA:Association for Computational Linguistics,2015:57-66.

[15]Ding Boyang, Wang Quan, Wang Bin, et al. Improving knowledge graph embedding using simple constraints[EB/OL].(2018-05-08).https://arxiv.org/abs/1805.02408.

[16]Nickel M, Tresp V, Kriegel H P. A three-way model for collective learning on multi-relational data[C]//Proc of the 28th International Conference on International Conference on Machine Learning.Madison,WI:Omnipress,2011:809-816.

[17]Yang Bishan, Yih W T, He Xiaodong, et al. Embedding entities and relations for learning and inference in knowledge bases[EB/OL].(2014-12-20).https://arxiv.org/abs/1412.6575.

[18]Trouillon T, Welbl J, Riedel S, et al. Complex embeddings for simple link prediction[C]//Proc of the 33rd International Conference on International Conference on Machine Learning.[S.l.]:JMLR.org,2016:2071-2080.

[19]Nickel M, Rosasco L, Poggio T. Holographic embeddings of know-ledge graphs[C]//Proc of AAAI Conference on Artificial Intel-ligence.Palo Alto,CA:AAAI Press,2016:1955-1961.

[20]Liu Hanxiao, Wu Yuexin, Yang Yiming. Analogical inference for multi-relational embeddings[C]//Proc of the 34th International Conference on Machine Learning.[S.l.]:JMLR.org,2017:2168-2178.

[21]Zhang Wen, Paudel B, Zhang Wei, et al. Interaction embeddings for prediction and explanation in knowledge graphs[C]//Proc of the 20th ACM International Conference on Web Search and Data Mining.New York:ACM Press,2019:96-104.

[22]Xu Wentao, Zheng Shun, He Liang, et al. SEEK: segmented embedding of knowledge graphs[EB/OL].(2020-06-23).https://arxiv.org/abs/2005.00856.

[23]Mikolov T, Chen Kai, Corrado G, et al. Efficient estimation of word representations in vector space[EB/OL].(2013-09-07).https://arxiv.org/abs/1301.3781.

[24]Lin Yankai, Liu Zhiyuan, Sun Maosong, et al. Learning entity and relation embeddings for knowledge graph completion[C]//Proc of AAAI Conference on Artificial Intelligence.Palo Alto,CA:AAAI Press,2015:2181-2187.

[25]Ji Guoliang, He Shizhu, Xu Liheng, et al. Knowledge graph embedding via dynamic mapping matrix[C]//Proc of the 53rd Annual Mee-ting of the Association for Computational Linguistics and the 7th International Joint Conference on Natural Language Processing.Stroudsburg,PA:Association for Computational Linguistics,2015:687-696.

[26]Xiao Han, Huang Minlie, Hao Yu, et al. TransA:an adaptive app-roach for knowledge graph embedding[EB/OL].(2015-09-28).https://arxiv.org/abs/1509.05490.

[27]孟小艷,蒋同海,周喜,等.一种改进的自适应知识图谱嵌入式表示方法[J].计算机应用研究,2021,38(1):39-43.(Meng Xiao-yan, Jiang Tonghai, Zhou Xi, et al. Improved adaptive embedding method for knowledge graph representation[J].Application Research of Computers,2021,38(1):39-43.)

[28]Dong Yao, Wang Lei, Xiang Ji, et al. RotateCT: knowledge graph embedding by rotation and coordinate transformation in complex space[C]//Proc of the 29th International Conference on Computational Linguistics.New York:International Committee on Computational Linguistics,2022:4918-4932.

[29]Wei Yuyang, Chen Wei, Li Zhixu, et al. Incremental update of knowledge graph embedding by rotating on hyperplanes[C]//Proc of IEEE International Conference on Web Services.Piscataway,NJ:IEEE Press,2021:516-524.

[30]Shah A, Molokwu B, Kobti Z. Hrotate: hybrid relational rotation embedding for knowledge graph[C]//Proc of International Joint Confe-rence on Neural Networks.Piscataway,NJ:IEEE Press,2021:1-8.

[31]Kazemi S M, Poole D. Simple embedding for link prediction in knowledge graphs[C]//Proc of the 32nd International Conference on Neural Information Processing Systems.Red Hook,NY:Curran Associates Inc.,2018:4289-4300.