基于HRNet的胃肠道图像分割方法的设计与实现

凌 飞,吴延凯

河南工业职业技术学院,河南 南阳 473000

0 引言

截至2022年底,全球有600多万人被诊断出患有消化道癌症,在这些患者中,约有一半符合接受放射治疗的条件,在放射治疗的过程中须避开肠道和胃。传统方式须借助先进仪器成像体内结构,并手动勾画出胃和肠道的位置,耗时且劳动密集,但胃和肠道的位置每天都在发生着变化,因此增加了医疗工作量,降低了患者的医疗体验。

本文提出使用语义分割模型HRNet精确定位胃和肠道的掩码,然后对掩码进行开、闭运算去除成像中的噪点和被误分的小块,得到胃和肠道的连通域,从而给出精确的边缘信息。使用该方法能够替代医务人员进行医疗影像中胃肠道区域分割,使癌症患者得到有效治疗的同时,降低了治疗时间。

1 相关技术

1.1 HRnet语义分割模型

最近的研究表明,深度卷积神经网络已具有先进的性能,大多数现有方法通过一个由高分辨率到低分辨率的子网传递输入,然后通过对称的低到高分辨率来生成高分辨率的表示。HRNet[1]从高分辨率子网作为第一阶段始,逐步增加高分辨率到低分辨率的子网,形成更多的阶段,并将多分辨率子网并行连接。在整个过程中,通过在并行的多分辨率子网络上反复交换信息来进行多尺度的重复融合,最后通过网络输出高分辨率来生成对应的掩码,得到精确的图像类别信息。

1.2 轻量化网络

网络模型性能的提升伴随着网络模型参数量和计算量的增加,这会导致硬件成本的提升、实时性的降低,而模型加速的方法主要包括轻量化模型设计、模型压缩与剪枝、知识蒸馏这3种方法。

轻量化模型是在保持模型骨干网络精度的基础上,通过降低神经网络的深度或宽度,从而降低模型的参数量和计算量。Zhang et al.提出ShuffleNet,该结构利用分组逐点卷积和通道重排的方式提高了模型的推理速度,使其可以达到移动端运行的要求[2];2017年Howard et al.提出将常规卷积替换为深度可分离卷积方式构建网络,这种方式降低了模型的参数量和运算复杂度;Mark Sandler等提出MobileNetV2,在MobileNetV1的基础上,通过引入倒残差结构(Inverted Residuals) 和Linear Bottlenecks,提高了模型的精度且模型更小[3]。

1.3 多尺度特征提取

多尺度特征提取是一种从图像中提取特征的技术,其从不同尺度提取图像特征,并将这些特征转换为高维数据。该方法主要分为2步:首先利用图像金字塔或者其他尺度变化的技术,获取不同尺度的图像,然后利用图像处理技术提取不同尺度下图像的特征,不同尺度的特征包含很丰富的语义信息,能够提高模型的检测精度[4]。

为了捕获多尺度特征,图像金字塔将原始图片进行不同尺度的缩放,然后在不同尺度上进行特征提取,SSD(single shot detector)采用这种多尺度特征融合的方式,没有上采样过程,即从网络不同层抽取不同尺度的特征做预测,这种方式不会增加额外计算量,并且能够获取足够低层的特征,对于捕获小目标有很大的帮助[5]。受到SPP(spatial pyramid pooling)的启发,语义分割模型DeepLabv2中提出了ASPP(atrous spatial pyramid pooling)模块,该模块使用具有不同采样率的多个并行空洞卷积层,为每个采样率提取的特征在单独的分支中进一步处理,并融合以生成最终结果[6]。该模块通过不同的空洞率构建不同感受野的卷积核,用来获取多尺度物体信息,提升模型捕捉多尺度特征的能力。

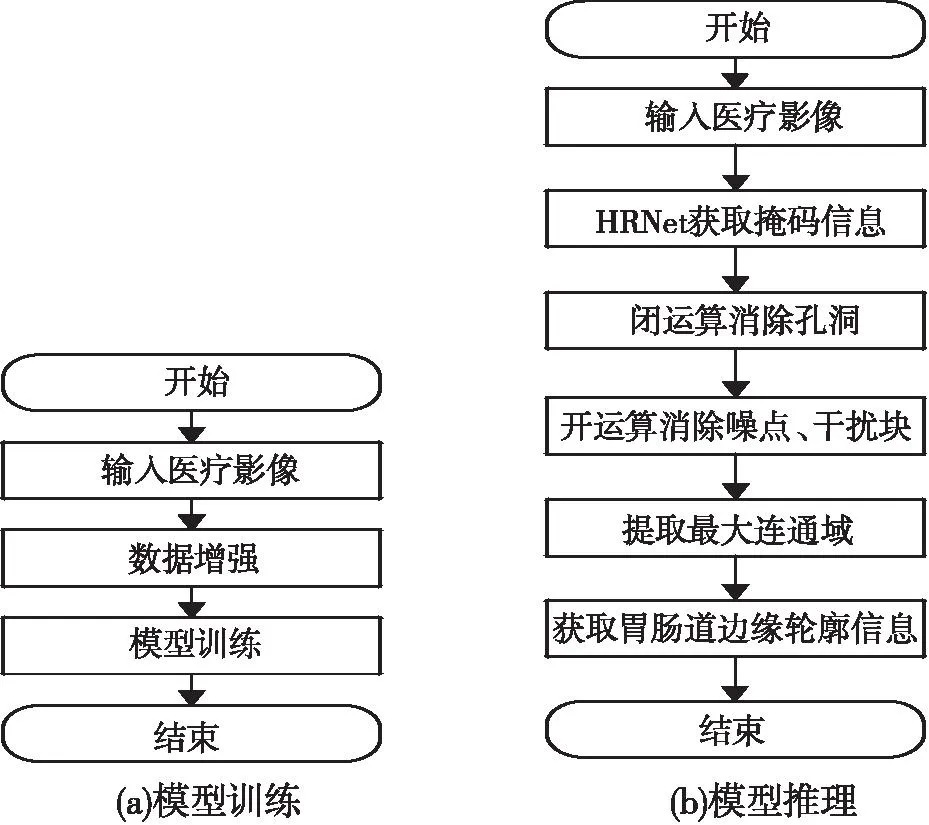

2 胃肠道图像分割

基于HRNet的胃肠道图像分割方法借助于医疗影像对人体胃肠道进行精确定位,从而实现辅助治疗的目的,该方法整体训练、推理流程如图1所示。

图1 胃肠道图像分割方法流程

2.1 数据增强

数据增强是指通过对原始训练数据进行一系列变换和修改,生成新的训练样本,从而扩展训练集的规模和多样性。在实际的应用场景中,足量且高保真的优质数据集通常是可遇不可求的,为提高模型的鲁棒性,本文在模型训练阶段采用工业中常用的降低成本的方法,即利用数据增强技术来减少对训练数据的依赖,从而构建高精度的模型。

本文采用了Cutout、Random erasing、GridMask、Cropping and resizing、随机翻转方式对原始数据进行增强,提高模型的泛化性能。

2.2 模型轻量化

为提高模型的实时性,本文采用调整网络结构的方式,引入轻量化模型MobileNetV2中的倒置残差模块替代HRNet网络中的BasicBlock模块,通过使用深度可分离卷积的方式,弱化在通道维度上的特征提取过程,降低了参数量,更符合实际应用场景下的需求,如图2所示。

图2 HRNet Basicblock模块与倒置残差模块结构

2.3 损失函数优化

语义分割任务实际上是一种像素层面的分类,需要识别图像中存在的内容和位置,同样也存在与分类相似的问题——样本类别不均衡,对于医疗影像更多的是前景区域的样本远远小于背景区域,针对类别不均衡的问题,本文在Loss层面进行了优化,选择Dice Loss替换交叉熵,为了防止分母为0,对损失函数进行了平滑处理。其损失函数为:

(1)

式中:X表示GT分割图像,Y表示Pred分割图像。

2.4 ASPP特征提取

受到DeepLabv2中ASPP模块的启发,本文决定在HRnet模型的head部分引入ASPP[7]模块,使得图片提取的特征具有更大的感受野,并且保证分辨率不受影响,增强获取多尺度物体信息的能力。模型整体结构如图3所示。

图3 模型整体结构

2.5 模型效果

为验证算法的效果,本文使用了威斯康星大学卡本癌症中心(UW-Madison Carbone Cancer Center)公布的胃肠道医疗影像数据集进行模型训练及调优,为了比较模型在准确性方面的差异,在表1中给出各模型的平均交并比(mean intersection over union,MIOU)。通过表1可知,相较于其他模型,改进的模型在模型预测精度上有了较大的提升。

为验证模型的实际效果,本文在验证集上进行了效果测试,效果如图4所示。

由试验可知,医疗影像中医务人员手工绘制的胃肠道区域与模型推理出的胃肠道区域吻合,故使用该方法能够精确的预测出医疗影像中胃肠道的位置,从而替代医务人员手工绘制,大大降低医疗工作量、提高工作效率、提升了患者体验,具有实际应用价值。

3 结束语

本文提出了一种改进HRNet算法进行医疗影像胃肠道分割的方法,采用了模型轻量化、添加ASPP模块、优化损失函数等技巧以提高模型的检测精度、稳定性和实时性。

试验结果表明,该方法能够替代人工自动化完成医疗影像中胃肠道分割工作,大大提高医务人员工作效率,可以有效地应用于实际场景中。与传统的图像分割方法相比,本文提出的方法具有更高的准确性和更好的泛化性能。

今后,将进一步优化现有网络结构,进一步提高模型的精度和泛化性能,使其更加符合实际医疗场景的需求。