基于深度学习的水下生物目标检测方法综述

于雨 郭保琪 初士博 李恒 杨鹏儒

摘要:水下生物目标识别对水产养殖、濒危生物保护、生态环境监测具有重要意义。综合分析了当前各种深度学习方法在水下生物目标检测中的应用情况。首先介绍了常用的水下生物目标检测数据集;然后,按照两阶段和单阶段对当前常用目标检测方法进行分类、分析和总结,详细阐述了各类检测方法的实际应用状况,并重点对上述各类检测方法优化策略的优势与不足进行了分析和总结;最后,对基于深度学习的水下生物目标检测提出今后的研究重点,为该领域的研究人员提供了资料性的参考依据。

关键词:深度学习;目标检测;水下生物目标检测

中图分类号:TP181 文献标志码:A 文章编号:1002-4026(2023)06-0001-07

Survey of underwater biological object detection methods based on deep learning

YU Yu1a,1b , GUO Baoqi2, CHU Shibo1a,1b, LI Heng1a,1b,YANG Pengru1a,1b

(1.a. Institute of Oceanographic Instrumentation;b. National Marine Monitoring Equipment Engineerin

g Technology

Research Center ,Qilu University of Technology(Shandong Academy of Sciences),Qingdao 266100,China;

2. Qingdao Haida Xinxing Software Consulting Co., Ltd., Qingdao 266114, China)

Abstract∶Underwater biological object detection is crucial for aquaculture, endangered species protection,and ecological environment monitoring. This study comprehensively analyzes the applications of various deep learning methods in underwater biological object detection. The commonly used underwater biological object detection datasets are introduced. The state-of-the-art underwater biological object detection methods are classified, analyzed, and summarized by two stages and one stage. The actual applications of various detection methods are thoroughly described, and the advantages and disadvantages of their optimization strategies are analyzed and summarized. Future works in the field of underwater biological object detection based on deep learning are presented. This study provides a reference basis for researchers in the field of underwater biological object detection.

Key words∶deep learning;object detection;underwater biological object detection

水下生物目標检测对于水产养殖、濒危生物保护、生态环境监测等有着重要的意义。传统的目标检测算法在准确度、实时性等方面难以满足水下复杂场景的应用需求。随着计算机视觉领域智能化的发展,基于深度学习的目标检测算法取得了突破性的进展,相继出现了精度高但速度较慢的两阶段目标检测方法和实时性好但精度略低的单阶段目标检测方法,并在水下生物目标检测领域得到了广泛的应用,成为该领域的研究热点之一。

林森等[1]从水下图像预处理、目标检测识别、跟踪关键技术等多个视觉任务的角度对水下光学图像中目标探测关键技术进行了宏观综述。Fayaz等[2]按照R-CNN(region-based convolutional neural network)系列、YOLO(you only look once)系列及其他系列对水下目标识别的相关方法进行了综述及实验验证。檀盼龙等[3]针对基于声呐图像的水下目标识别问题,论述了图像去噪、图像分割以及水下目标识别等方面的主要进展。于红等[4]系统阐述了数据集构建、数据预处理、水产动物目标识别、水产动物目标跟踪等技术研究进展,并重点对其在海洋渔业领域的应用现状进行了详细的描述。董金耐等[5]对水下光学目标检测图像数据集进行了总结与分析,以Faster RCNN和YOLO-v3为基础对两种典型的提高目标检测性能的方法进行了实验验证。然而,针对基于深度学习的水下生物目标检测方法的综述十分匮乏,不利于该领域的科学研究及工程应用。基于此,本文对基于深度学习的水下生物目标检测方法进行归纳和总结,梳理了基于深度学习的水下生物目标检测方法的优化策略,并对比分析了优化策略的优势与不足,最后对研究趋势进行了展望,并提出了今后的研究方向和重点。

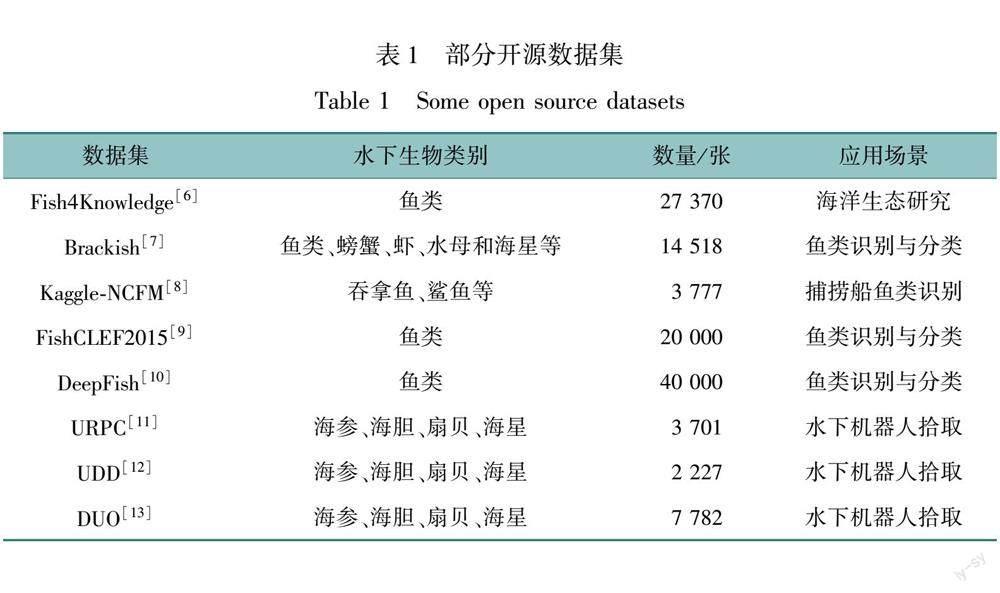

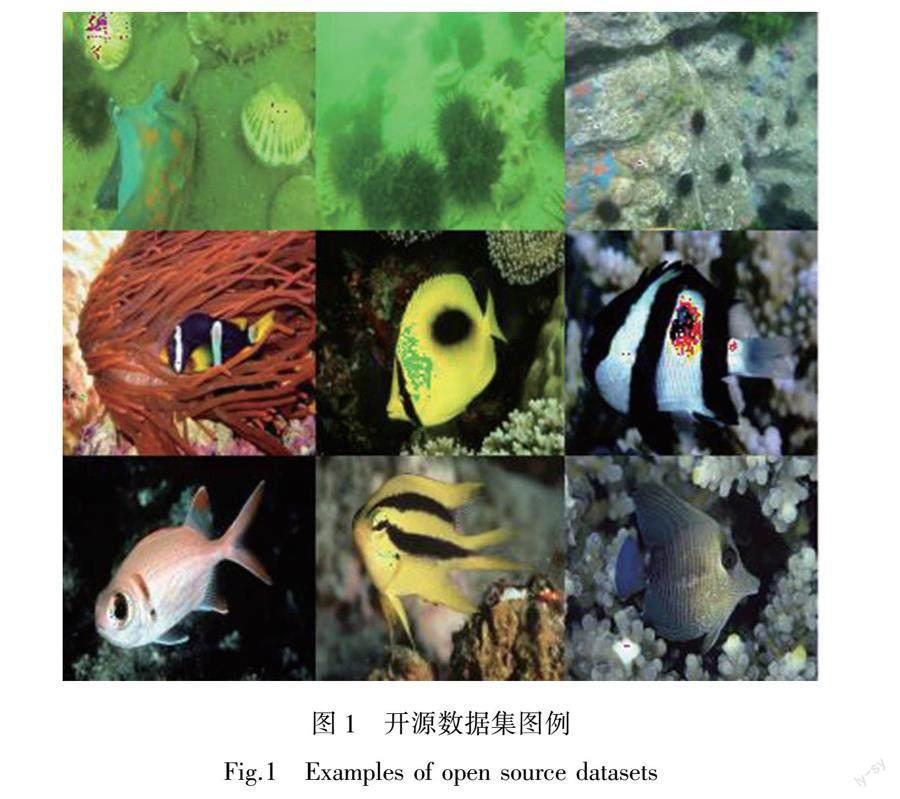

1 数据集

数据是基于深度学习目标检测的基础,ImageNet LSVRC(large scale visual recognition challenge)、PASCAL VOC(pascal visual object classes)、MS COCO(Microsoft common objects in context)等大规模开源数据库的出现极大推动了相关算法的发展,并成为领域内相关算法性能测试的基准。在水下生物目标识别领域,大多数研究都是根据研究任务构建的小型数据集,缺乏大规模、高质量标注的开源数据集,一定程度上制约了相关技术的发展。学者们在构建开源数据集方面进行了一系列的尝试,如表1所示。相关数据集的图例如图1所示。

2 基于两阶段的水下生物目标检测方法

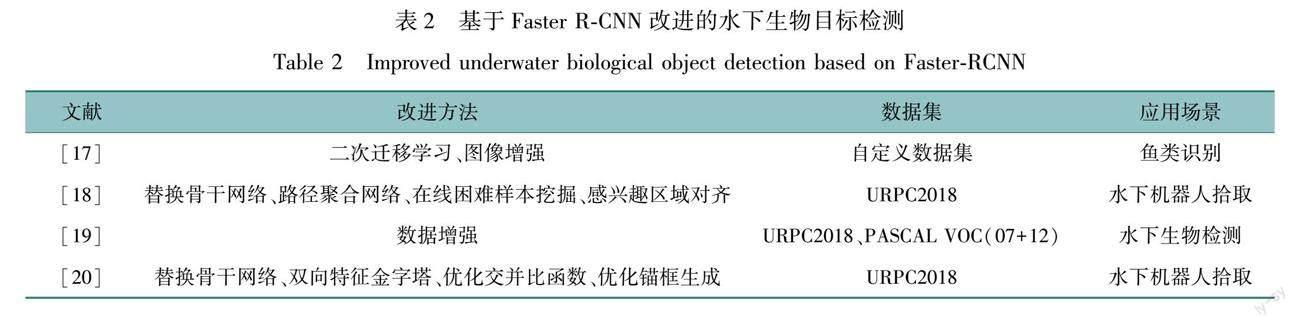

两阶段的目标检测方法将检测问题划分为两个阶段:首先产生候选区域,其次进行分类与预测位置的微调。这种检测方法在检测准确率和定位精度上优于单阶段的目标检测方法。Girshick等[14]2013年提出了R-CNN算法,开创性地使用卷积神经网络实现目标检测任务,此算法也是两阶段目标检测算法的开篇之作。Girshick等[15]、Ren等[16]在其基础之上相继提出了Fast R-CNN、Faster R-CNN算法,形成了R-CNN系列算法。当前,基于两阶段的水下生物目标检测仍属于新兴领域,大多数研究者仍聚焦于对Faster R-CNN等经典算法的改进。

袁红春等[17]提出了一种基于Faster R-CNN二次迁移学习和带色彩恢复的多尺度视网膜增强算法的方法。首先通过ImageNet预训练模型对Open Images高清鱼类数据集进行一次迁移学习初步训练网络,然后固定检测模型低3层的卷积网络参数,再用水下拍摄的小规模鱼类数据集进行二次迁移学习微调网络,最后通过MSRCR(multi-scale retinex with color restoration)算法对水下拍摄的图像进行处理以增强其与高清鱼类图像的相似性,解决水下图像降质问题。结果表明,该方法利用小规模水下拍摄鱼类数据集训练出的网络查准率可达到98.12%。

Liu等[18]在Faster R-CNN算法的基础上进行了多处改进。首先将骨干网络替换为Transformer结构,其次添加了路径聚合网络,使得深、浅层特征图更好地叠加和融合,然后使用在线困难样本挖掘技术平衡难易样本数量,最终使用感兴趣区域对齐替换感兴趣区域池化,增加定位精度。相关改进在URPC2018数据集上进行了实验验证,平均准确率达到80.54%。

Lin等[19]提出了一种适用于Faster R-CNN系列算法的数据增强方法RoIMix。RoIMix创新性地将多张图片中提取的感兴趣区域进行融合,以模拟水下生物的重叠和遮挡,从而使得模型能够更好地检测密集物体。相关方法在URPC2018数据集上进行了实验验证,平均准确率在Faster R-CNN算法73.74%的基础上提升到74.92%。此外,相关方法也在PASCAL VOC(07+12)数据集上进行了训练,在VOC 2007测试集上进行了测试,平均准确率在Faster R-CNN算法80.0%的基础上提升到80.8%。与URPC2018数据集上的实验结果相比,相关方法在PASCAL VOC(07+12)数据集上的效果并不明显。显然,RoIMix更适用于具备重叠、遮挡和模糊特征的URPC2018数据集。

Shi等[20]在Faster R-CNN算法的基础上进行了多处改进,将骨干网络从VGG替换为ResNet(residual neural network),引入Bi-FPN(feature pyramid network)结构以增强网络模型的特征提取能力和多尺度特征融合能力,使用EIoU(efficient intersection over union)替换原有的IoU(Intersection over Union),将K-means++聚类算法应用于锚框生成,替代原有的默认锚框。相关改进在URPC2018数据集上进行了实验验证,平均准确率达到88.94%,优于Faster-RCNN算法的80.68%及YOLO-v4算法的71.36%。

上述方法在Faster R-CNN模型基础上的改进方法归纳总结如表2所示。

3 基于单阶段的水下生物目标检测方法

单阶段的目标检测方法不需要产生候选区域,直接将检测问题转化为端到端的回归问题,与两阶段的目标检测方法相比,在检测速度上有较大的优势,能够更好地应用于水下机器人等智能化设备的水下生物目标检测。单阶段的目标检测方法主要是YOLO系列算法等[21-24]。单阶段目标检测算法因为良好的性能和较高的精度,在水下生物目标检测领域得到了广泛的应用。

Wang等[25]对YOLO-v2算法进行了优化改进,以用于鱼类图像的快速分类和识别。首先,将模型最后一个卷积层的网格数从7×7更改为9×9,提升对小型鱼类目标的检测效果。其次,根据实际的应用场景,大幅减少了模型最后一个卷积层的过滤器数量。使用Kaggle-NCFM数据集进行了实验验证。相关算法的平均准确率达到91.2%,检测速度达到28.3 帧/s,能够满足对渔船捕捞的海洋生物种类进行实时检测和分类的需求。

Muksit等[26]对YOLO-v3算法进行了加强。首先,通过对上采样步长大小的改进,减少了对于小尺寸鱼类目标的误检(YOLO-Fish-1)。其次,在YOLO-Fish-1的基礎上,通过增加空间金字塔池化,进一步增强了模型在动态环境中检测鱼类外观的能力(YOLO-Fish-2)。相关算法在基于DeepFish和OzFish数据集基础上的自定义数据集进行了实验验证,YOLO-Fish-1和YOLO-Fish-2分别取得了76.56%和75.70%的平均准确率,与YOLO-v4算法水平相当。

Chen等[27]在YOLO-v4算法的基础上进行了改进。首先,通过残差块与通道注意力机制相结合,对YOLO-v4骨干网络CSPDarknet53(cross stage partial network darknet53)的特征提取能力进行增强,以获得加权多尺度特征。其次,通过特征金字塔对加权多尺度特征进行反复的提取,以分离出最显著的加权多尺度特征。最后,将最显著的加权多尺度特征用于水下生物检测。相关算法在Brackish数据集进行了实验验证,与YOLO-v4算法相比平均精度提升了5.03%,检测速度达到15 帧/s。

Isa等[28]重点对YOLO-v5算法的优化器进行了参数优化。通过优化算法对学习率及动量等关键参数进行了优化,得到的优化模型在Brackish数据集上的平均准确率达到了98.6%,检测速度达到

106 帧/s。

Zhai等[29]在YOLO-v5s算法的基础上进行了改进,以用于水下海参的识别。首先,使用带色彩恢复的多尺度视网膜增强算法对图像进行预处理。其次,引入了卷积注意力模块,并在YOLO-v5s的头部网络中添加了检测层。最后,在自定义数据集上进行了实验验证。实验结果表明,改进算法较YOLO-v5s算法在精度和召回率上分别提升了9%和11.5%。

Lei等[30]在YOLO-v5s模型的基础上进行三方面的改进。将骨干网络替换为Swin Transformer,改进了多分辨率特征融合方法,并改进了置信损失函数。在URPC数据集的基础上,制作了包含海参、海胆、扇贝、海星等4类生物,总共6 034张图片的自定义数据集。结果表明,改进的YOLO-v5s模型的平均准确率达到了87.2%,优于SSD、YOLO-v4、YOLO-v5s和YOLO-v5x。

上述方法在YOLO模型基础上的改进方法归纳总结如表3所示。

4 基于深度学习的水下生物目标检测改进策略

针对水下生物目标检测中常见的重叠与遮挡、小目标检测、成像模糊等问题,学者们在数据增强、框架结构改进、样本平衡、锚框优化等方面提出了相应的改进策略,以提升水下生物目标检测方法的整体性能,如表4所示。

5 总结与展望

本文综合分析了当前各种深度学习方法在水下生物目标检测中的应用情况,对水下生物目标检测数据集及检测方法进行了综述。希望能够为研究人员提供资料性的参考依据以及研究思路和方法,促进相关检测方法的推广和应用。结合现有的研究现状,基于深度学习的水下生物目标检测方法在以下三个方面亟待开展更深入的研究工作:

(1)构建大规模、高质量标注的开源数据集。在水下生物目标检测领域,大多数研究都是根据研究任务构建的小型数据集,缺乏大规模、高质量标注的开源数据集,一定程度上制约了相关技术的发展。

(2)引入语义分割促进目标检测性能。语义分割通常需要像素级别标注的图像数据集进行训练,在完成语义分割的同时提升分类及定位的精度。此外,分割任务可作为仅在训练阶段使用的额外分支引入到原有的检测算法中,并使用分割损失、检测损失的多任务损失函数来训练模型。

(3)基于半监督或弱监督学习的水下生物目标检测。在半监督或弱监督学习中,通过弱标注信息对模型进行训练,让模型学习到有效的水下生物特征,减少数据标注的人工工作量。

参考文献:

[1]林森, 赵颍. 水下光学图像中目標探测关键技术研究综述[J]. 激光与光电子学进展, 2020, 57(6): 26-37. DOI: 10.3788/LOP57.060002.

[2]FAYAZ S, PARAH S A, QURESHI G J. Underwater object detection: architectures and algorithms-a comprehensive review[J]. Multimedia Tools and Applications, 2022, 81(15): 20871-20916. DOI: 10.1007/s11042-022-12502-1.

[3]檀盼龙, 吴小兵, 张晓宇. 基于声呐图像的水下目标识别研究综述[J]. 数字海洋与水下攻防, 2022, 5(4): 342-353. DOI: 10.19838/j.issn.2096-5753.2022.04.010.

[4]于红. 水产动物目标探测与追踪技术及应用研究进展[J]. 大连海洋大学学报, 2020, 35(6): 793-804. DOI: 10.16535/j.cnki.dlhyxb.2020-263.

[5]董金耐, 杨淼, 谢卓冉, 等. 水下图像目标检测数据集及检测算法综述[J]. 海洋技术学报, 2022, 41(5): 60-72. DOI: 10.3969/j.issn.1003-2029.2022.05.007.

[6]FISHER R B, CHEN-BURGERY H, GIORDANO D, et al. Fish4Knowledge: collecting and analyzing massive coral reef fish video data[M]. Berlin, Germany: Springer. DOI:10.10071978-3-319-3208-9.

[7]PEDERSEN M, HAURUM J B, GADE R, et al. Detection of marine animals in a new underwater dataset with varying visibility[C]// 2019 IEEE Conference on Computer Vision and Pattern Recognition(CVPR). Long Beach, USA: IEEE, 2019:18-26.

[8]Kaggle-NCFM [DB/OL].[2023-01-02]. https://www.kaggle.com/c/the-natureconservancy-fisheries-monitoring.

[9]FishCLEF2015 [DB/OL].[2023-01-02]. https://www.imageclef.org/lifeclef/2015/fish.

[10]GARCIA-D′URSO N, GALAN-CUENCA A, PéREZ-SNCHEZ P, et al. TheDeepFish computer vision dataset for fish instance segmentation, classification, and size estimation[J]. Scientific Data, 2022, 9(1): 1-7. DOI: 10.1038/s41597-022-01416-0.

[11]URPC [DB/OL].[2023-01-02]. http://www.urpc.org.cn/index.html.

[12]WANG Z H, LIU C W, WANG S J, et al. UDD: an underwater open-sea farm object detection dataset for underwater robotpicking[EB/OL]. [2023-01-03]. https://arxiv.org/abs/2003.01446.

[13]LIU C W, LI H J, WANG S C, et al. A dataset and benchmark of underwater object detection for robot picking[C]//2021 IEEE International Conference on Multimedia & Expo Workshops (ICMEW). Shenzhen, China: IEEE, 2021: 1-6. DOI: 10.1109/ICMEW53276.2021.9455997.

[14]GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//2014 IEEE Conference on Computer Vision and Pattern Recognition. Columbus, USA: IEEE, 2014: 580-587. DOI: 10.1109/CVPR.2014.81.

[15]GIRSHICK R. Fast R-CNN[C]//2015 IEEE International Conference on Computer Vision (ICCV). Santiago,Chile: IEEE, 2016: 1440-1448.DOI: 10.1109/ICCV.2015.169.

[16]REN S Q, HE K M, GIRSHICKR, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149. DOI: 10.1109/TPAMI.2016.2577031.

[17]袁紅春, 张硕. 基于Faster R-CNN和图像增强的水下鱼类目标检测方法[J]. 大连海洋大学学报, 2020, 35(4): 612-619. DOI: 10.16535/j.cnki.dlhyxb.2019-146.

[18]LIU J, LIU S, XU S J, et al. Two-stage underwater object detection network usingswin transformer[J]. IEEE Access, 2022, 10: 117235-117247. DOI: 10.1109/ACCESS.2022.3219592.

[19]LIN W H, ZHONG J X, LIU S, et al. ROIMIX: proposal-fusion among multiple images for underwater object detection[C]//ICASSP 2020—2020 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). Barcelona, Spain: IEEE, 2020: 2588-2592. DOI:10.1109/ICASSP40776.2020.9053829.

[20]SHI P F, XU X W, NI JJ, et al. Underwater biological detection algorithm based on improved faster-RCNN[J]. Water, 2021, 13(17): 2420. DOI: 10.3390/w13172420.

[21]REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas, USA: IEEE, 2016: 779-788. DOI: 10.1109/CVPR.2016.91.

[22]REDMON J, FARHADI A. YOLO9000: better, faster, stronger[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu, USA. IEEE, 2017: 6517-6525. DOI: 10.1109/CVPR.2017.690.

[23]REDMON J, FARHADI A. YOLOv3: An incrementalimprovement[EB/OL].[2023-01-03]. https://arxiv.org/abs/1804.02767.pdf.

[24]BOCHKOVSKIY A, WANG C Y, LIAO H Y M. YOLOv4: Optimal speed and accuracy of objectdetection[EB/OL].[2023-01-03].https://arxiv.org/abs/2004.10934.pdf.

[25]WANG M F, LIU M Y, ZHANG F H, et al. Fast classification and detection of fish images with YOLOv2[C]//2018 OCEANS - MTS/IEEE Kobe Techno-Oceans (OTO). Kobe, Japan: IEEE, 2018: 1-4. DOI: 10.1109/OCEANSKOBE.2018.8559141.

[26]AL MUKSIT A, HASAN F, HASAN BHUIYAN EMON M F, et al. YOLO-Fish: a robust fish detection model to detect fish in realistic underwater environment[J]. Ecological Informatics, 2022, 72: 101847. DOI: 10.1016/j.ecoinf.2022.101847.

[27]CHEN L, LIU Z H, TONG L, et al. Underwater object detection using Invert Multi-ClassAdaboost with deep learning[C]//2020 International Joint Conference on Neural Networks (IJCNN). Glasgow, UK: IEEE, 2020: 1-8. DOI: 10.1109/IJCNN48605.2020.9207506.

[28]ISA I S, ROSLI M S A, YUSOF U K, et al. Optimizing the hyperparameter tuning of YOLOv5 for underwater detection[J]. IEEE Access, 2022, 10: 52818-52831. DOI: 10.1109/ACCESS.2022.3174583.

[29]ZHAI X Y, WEI H L, HE YY, et al. Underwater Sea cucumber identification based on improved YOLOv5[J]. Applied Sciences, 2022, 12(18): 9105. DOI: 10.3390/app12189105.

[30]LEI F, TANG FF, LI S H. Underwater target detection algorithm based on improved YOLOv5[J]. Journal of Marine Science and Engineering, 2022, 10(3): 310. DOI: 10.3390/jmse10030310.

[31]LI X, SHANG M, QIN H W, et al. Fast accurate fish detection and recognition of underwater images with Fast R-CNN[C]//OCEANS 2015-MTS/IEEE Washington. Washington, DC: IEEE, 2016: 1-5.

[32]XU W W, MATZNER S. Underwater fish detection using deep learning for water power applications[C]//2018 International Conference on Computational Science and Computational Intelligence (CSCI). Las Vegas, USA: IEEE, 2020: 313-318. DOI: 10.1109/CSCI46756.2018.00067.

[33]劉萍, 杨鸿波, 宋阳. 改进YOLOv3网络的海洋生物识别算法[J]. 计算机应用研究, 2020, 37(S1): 394-397.

[34]KNAUSGRD K M, WIKLUND A, SRDALEN T K, et al. Temperate fish detection and classification: a deep learning based approach[J]. Applied Intelligence, 2022, 52(6): 6988-7001. DOI: 10.1007/s10489-020-02154-9.

[35]LI A L, YU L, TIAN S W. Underwater biological detection based on YOLOv4 combined with channel attention[J]. Journal of Marine Science and Engineering, 2022, 10(4): 469. DOI:10.3390/jmse10040469.

[36]张琳, 葛艳, 杜军威, 等. 改进FCOS网络的海洋鱼类目标检测[J]. 计算机系统应用,2023,32(3):309-315. DOI: 10.15888/j.cnki.csa.008965.