“避风港”变革下网络服务提供者版权注意义务之重构

王若朴

[中国地质大学(武汉) 公共管理学院, 湖北 武汉 430074]

一、问题的提出

进入Web3.0与算法时代,抖音等短视频平台迅速崛起,著作权被暴露在极易受侵害的网络环境中。观各国立法,均以“避风港”规则为基础,为激励互联网产业发展,普遍要求网络服务提供者承担较轻的版权注意义务,在版权人发出侵权通知后,平台仅被动移除侵权内容,即可在“避风港”的庇护下免责。然而此种责任配置模式并未契合时代发展,不仅多样化侵权行为使判定平台是否承担间接侵权责任的主客观因素复杂化,且事前主动审查版权义务的缺位亦将版权人置于不利境地,亟须更新网络服务提供者的责任配置路径。

目前研究较为单一:从事后规制角度出发,主张对“避风港”规则原有的运行机制进行优化;从事前预防角度出发,主张引入新制度构建全新的网络版权规制体系。但更多学者希望网络服务提供者的注意义务以通过“版权过滤”的方式来提高。鉴于此,本文希望通过构建以事前预防与事后规制为内容的双重注意义务,以规制网络版权侵权频发的现状。

二、网络服务提供者版权注意义务的现有理据

(一)法律规范:“避风港”下平台的责任认定

美国《数字千年版权法》中的“避风港”规则为网络服务提供者设立了“通知—删除”的版权责任规则,即网络平台无需尽事前审查义务,在收到侵权通知后及时采取删除等措施即可免责[1],但在满足“红旗标准”(侵权内容如红旗般高高飘扬)时便无法通过事后删除免责。该制度因契合当时互联网发展而被欧盟各国借鉴,并发展为通行的网络版权侵权治理范本,我国概莫能外。

但与美国不同,本土化后的“避风港”规则之性质由责任排除规则转变为责任构成要件。尽管2006年《信息网络传播权保护条例》在条文表述上坚持将“避风港”作为责任排除规则的基本模式,但2009年《侵权责任法》从责任构成要件角度,在“特殊侵权责任主体”一章中对网络服务提供者间接侵权责任做了专门规定,并将其适用于所有类型的民事权利,奠定了我国网络服务提供者间接侵权责任的法律基础。《民法典》第1194条至1197条同样深受影响,并形成了“权利人侵权通知—平台采取必要措施—用户不侵权声明—平台恢复内容”四个基本环节。

在我国“避风港”规则制度框架下,网络服务提供者的过错归责条款以“通知—删除”规则和“明知或应知”规则为基础。具言之,权利人向平台发出通知后,若平台未及时删除侵权内容,则需担责;若平台明知或应知侵权内容存在却未采取必要措施,即便权利人未发出通知,也应认定其主观存在过错而需担责,这种过错归责形成了网络平台共同侵权责任认定框架。

(二)理论基础:“避风港”下平台的免责事由

“避风港”规则的制定和运行与其所处时代的技术条件密不可分,也正是“技术中立”和“技术不能”两大时代背景促成“避风港”规则的出台。

1.“技术中立”理论

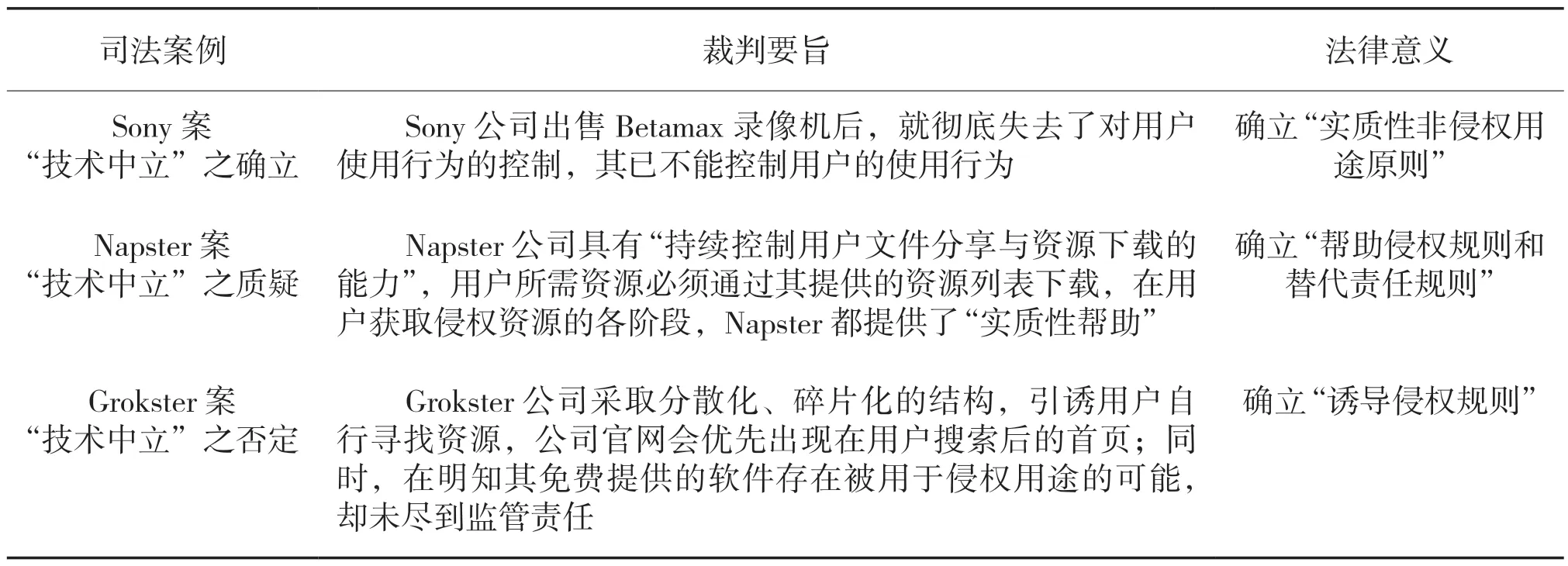

“技术中立”是“避风港”规则建立的理论基础,特指著作权领域“实质性非侵权用途原则”,强调技术本无善恶,技术提供者不能干预技术使用。但仅以“实质性非侵权用途”为标准,对技术提供者完全免责有失公平。因此,“技术中立”亦在不断修正,主要体现在以下几次标志性案件中(见表1)。

表1 “技术中立”理论发展历程

我国网络版权法律体系亦确立了“技术中立”理论。“快播”案中辩方主张快播的行为属于实质性非侵权用途,控方则认为其通过相关技术在可控环境下间接放任淫秽信息传播,与Napster案相似。事实上“技术中立”既要求技术本身符合实质性非侵权用途原则,亦强调平台对网络应用服务和内容保持中立。

2.“技术不能”理论

网络服务提供者被要求承担严格的直接侵权责任,在美国20世纪90年代的判例中即显露端倪。然而,要求平台主动承担事前审查义务或阻断侵权作品传输,在技术上并不可行:其一,没有全球版权数据库供平台来检查作品是否受保护或已获许可;其二,即便有数据库,期待平台比对查找侵权材料亦不合理;其三,若传输某作品的一小部分便要求平台停止或阻断传输耗资巨大。

“技术不能”逐渐发展为平台不承担事前审查义务的依据和侵权后抗辩的理由。虽然事前审查义务的缺位保障了一段时间内信息自由传播与互联网产业发展,但“避风港”规则与“技术不能”理论作为Web1.0的产物,显然只是技术不成熟背景下的法律妥协。

三、网络服务提供者版权注意义务的适用局限

(一)“事后规制”之无力:人工版权审查模式动力性不足

“避风港”规则设立时所受的技术限制决定其只能事后人工审查侵权内容。但Web3.0的到来、AI的迅猛发展彻底颠覆了“事后规制”的法律地位。根据第51次《中国互联网络发展状况统计报告》可知,截至2022年末,网络音乐用户、网络文学用户、网络视频用户规模已分别达到6.84亿、4.92亿、10.31亿[2]。若想以人工对海量内容进行全面审查,不仅难以预估投入成本,且主观性强、效率低下,在高效精准的AI审查面前更显得动力不足。

第一,场域危险控制力欠缺。网络平台类似于现实的公共场所,参照公共场所“善良管理人”义务,网络平台亦需承担与其专业和能力相符的安全义务①最高人民法院关于审理侵害信息网络传播权案件司法解释的第九条,也阐明了平台的注意义务应与其信息管理能力相适应。当平台的信息管控力提升时,应相应提升其版权注意义务。。但显然,仅依靠人工无法达到相应标准,对侵权预防制止的能力远不及算法覆盖全面、反应及时。是故,提高场域危险控制力需借算法之力。

第二,权利救济滞后性明显。算法时代的信息推送效率高、速度快,但也使侵权内容易扩散、危害大、难定位。平台可在事后采取删除等必要措施,但权利人的通知、侵权的初步证据是平台决定采取必要措施之依据,此过程由于耗时长而导致救济滞后。或许互联网产业发展初期,以“通知—删除”的方式能缓和版权冲突,但在算法时代,很难通过人工审查来应对海量侵权通知,必要措施亦失去及时性价值。

第三,经济效率正当性削弱。传统人工审查造成侵权通知滞后处理,会增加平台涉侵权诉讼、承担侵权赔偿之风险,且增加人工成本的方式在算法时代已不具备经济上的正当性。以上均表明传统“避风港”规则下依靠人工审查移除侵权内容的规制模式已是被动,依据法经济学边际汉德公式(B<PL),平台若采取某项依靠算法便可完成的预防措施,满足减少损失(获益)大于预防成本(损耗)的要求,便契合法之效率追求。

(二)“技术中立”之挑战:算法推荐技术带有倾向性偏好

算法推荐作为网络内容筛选和传播的关键技术已成为行业共识,然而该技术的频繁使用显然在动摇“技术中立”作为免责事由的法律地位。

第一,算法推荐挑战“技术中立”的本质。算法推荐对数据进行整合、分析、输出、反馈、再分析、优化输出,通过各阶段有效串联,形成技术应用的闭式循环,描绘出“用户画像”,精准提供信息服务。其具有明显价值性倾向,也存在加速侵权内容传播的风险,违背实质性非侵权用途之本质。

第二,算法推荐改变网络平台的“中立”角色。平台在内容传播过程中逐步从“中立者”转变为“参与者”。以往,用户按需检索,网站提供消极的技术服务,其只是相对中立的局外人,既不介入网络服务的用途,亦不干预网络内容的传播。然当下为吸引用户流量、增强用户黏性、实现流量变现,平台所使用的算法推荐,无形中意味着平台开始介入信息筛选、过滤及投放的过程,其角色不再中立。

更重要的是,平台使用算法推荐并不必然被认为是“技术中立”而被免除责任,反而导致平台版权侵权责任认定复杂化。有学者认为,虽然通过算法自动向用户推荐短视频,但算法设计体现平台意志,平台自主决定是否采用算法推荐向用户推送短视频,不能因为算法推荐自动化就虚化平台主体责任[3]。也有学者认为,判定平台是否对权利人承担损害赔偿的关键,在于平台是否明知或应知存在侵权[4]。争论不休之际,实务裁判正指明方向:网络平台身披算法推荐外衣难言“技术中立”,反而需承担更高注意义务。全国首例算法推荐案例中①北京市海淀区人民法院(2018)京0108民初49421号民事判决书。,法院认为字节跳动利用算法推荐在获取更多流量和市场竞争优势的同时也带来更大的侵权风险,因此,与其他不使用算法推荐的平台相比,字节跳动应对侵权行为承担更高注意义务。无独有偶,荔支案中②北京知识产权法院(2021)京73民终字4293号民事判决书。,荔支公司诉称其推荐行为是平台自带的算法推荐引发的,构成“技术中立”。法院不予认可,认为其使用算法推荐获取经济价值时必然伴随更多侵权风险,应在能力范围内承担更高注意义务。

(三)“技术不能”之崩塌:过滤技术增强平台信息管理能力

随着AI深度学习的突破以及算法技术的变革,网络平台信息管理能力今非昔比。在“技术不能”时代,平台得以免除事前审查义务或事出有因,而如今一些互联网巨头开始依靠算法过滤,在侵权通知发出前便能实现版权的合规管理。具言之,平台利用文本相似度检测和哈希值算法对文本、音视频文件进行版权过滤,及时制止侵权内容产生和传播。总之,这些技术的发展使得版权检测的效度、精度远出乎立法者在提出技术不能时的预料。

美国YouTube平台的Content ID系统与Vimeo平台的Copyright Watch系统,早已为网络版权治理提供创新模式并证实可行。在Dafra诉Google案中,Dafra既要求Google删除被告知侵权的内容,还要求删除其他未经授权的内容。巴西高等法院最终驳回了Google以“技术不能”为由的抗辩,因为Google完全可以通过内容识别技术来实现这一诉求。观之我国,同样强调算法侵权比对之重要性。腾讯公司的视频基因比对技术可实现用户内容与现有内容数据库的比对,通过相似度判断是否侵权。国内首个版权AI审阅系统,填补了图片查重领域的空白,具有单图溯源、创新比对等功能,已有10万多件备案的艺术作品作为溯源数据录入系统,实现权利人图片一键式溯源。上述案例均在印证,以事前治理为导向的算法过滤已在网络版权合规管理中得到应用,而网络平台所使用的算法侵权识别、算法推荐等网络服务,无不在展示其远超过往的信息管理能力。在算法赋能下,网络平台对版权侵权之危险有更强的认知和控制能力。“技术不能”大势已去,应要求平台承担与其危险认知能力和预防控制能力相适应的注意义务。

四、网络服务提供者版权注意义务的重构方向

互联网多元治理体系是网络法治的必然要求,这是因为传统“避风港”模式下事后治理难以满足日新月异的规制需求。事实上,通过过滤技术发现侵权内容,或及时采取措施避免侵权结果发生,应属于注意义务基本范畴[5]。当算法逐步支配网络环境,著作权法有必要在完善原有“事后规制”法律体系的基础上,重新考虑以技术为支撑的“事前治理”模式,推动“事前预防”与“事后规制”并行的双重注意义务构建。

(一)事前预防:构建未通知阶段的主动注意义务

1.以算法技术为支撑的版权过滤义务确立

随着“技术不能”理论的瓦解,依靠算法实现事前版权审查在技术层面已具备实施可能性,版权过滤机制构建的呼声不断高涨。该机制的运行机理在于,通过内容元数据搜索、文件哈希值算法等技术,将待上传作品与平台建立的正版数据库进行比对,大于设定阈值的作品将被阻断上传。该机制的构建将凭借其自动高效、预防侵权等功能成为网络平台版权合规管理的不二之选。放眼国际社会,美国在实践中形成了私人创制的内容过滤机制,欧盟的《单一数字市场版权指令》(以下简称《指令》)在立法上构建了“寻求版权授权+内容审查过滤+异议反馈救济”的版权责任体系。虽然美国和欧盟遵循了一软一硬两种相反的路径,但就要求平台承担更高注意义务已达成共识。且《指令》第17条第8款认为平台无需承担“一般性审查义务”,即网络平台不需审查所有内容,而只需审查版权人提供作品信息的特定内容。一方面,限制审查义务范围,避免与不承担普遍审查义务的网络服务提供者发生冲突;另一方面,强化平台责任,以应对日益加剧的网络侵权情势要求。

本文认为,未通知阶段平台所承担的主动版权过滤义务应定性为特殊审查义务,而特殊审查义务可纳入注意义务体系[6]。一是从损害最小化的角度出发,由于算法误判的局限性无法避免,极易对言论自由与合理使用造成侵害,确保用户正常上传便成为版权过滤措施适用的主要限制,而限缩算法过滤的使用范围,可避免误判扩大。二是基于效益最大化的立场分析,版权过滤系统的安装与运行成本不菲,要求其耗资巨大对所有作品进行审查确无必要亦不合理。因此,在特殊审查义务下,平台需要对部分作品尽主动的过滤义务,包括但不限于以下三种。

第一,直接获益作品。网络平台从用户内容中获取收益时,也应承担更高注意义务,这在经济层面具备合理性,也符合分配正义的要求。从平台收入来源来看,广告收入、用户付费以及运营服务费是最典型的直接收益方式。《最高人民法院关于审理侵害信息网络传播权民事纠纷案件适用法律若干问题的规定》同样明确广告收益是平台直接获益的渠道之一①《最高人民法院关于审理侵害信息网络传播权民事纠纷案件适用法律若干问题的规定》第11条第2款:“网络服务提供者针对特定作品、表演、录音录像制品投放广告获取收益,或者获取与其传播的作品、表演、录音录像制品存在其他特定联系的经济利益,应当认定为前款规定的直接获得经济利益。网络服务提供者因提供网络服务而收取一般性广告费、服务费等,不属于本款规定的情形。”。但在实践中,并非所有的广告投放行为都会被认定为直接获益。且“流量为王”的时代带来新思考:靠用户流量获益能否被认作平台的直接收益?美国Napster案中判定被告通过侵权音乐文件传输所积累的用户量属于直接获益。我国存在类似判决,搜狐诉中文集团侵害作品信息网络传播权纠纷案中②北京知识产权法院(2018)京73民终字922号民事判决书。,法官认为平台对用户内容进行编辑、整理、加精,有助于吸引更多用户以获益,应承担更高注意义务。实际上,还需在“存在特定的经济利益关系”的基础上加以界定。具言之,一般情况下平台长期经营所维系的用户黏度与流量,与特定用户、特定内容不存在特定关系,不应将此视为直接收益。

第二,知名作品。知名作品带来的流量与关注度使其极易满足“红旗规则”之标准,知名作品的侵权就如同红旗高高飘扬,平台须为此负担较高注意义务。然“知名”的界定面临不确定性,在韩寒诉百度案中③北京市海淀区人民法院(2012)海民初字第5558号民事判决书。,《像少年啦飞驰》被认定为知名作品,故法院要求百度对该作品的上传承担审查义务;而在中青文诉百度案中④北京市高级人民法院(2014)高民终字第2045号民事判决书。,原告主张案涉作品为畅销书,但法院认为,案涉书籍是否为畅销书被告难以知晓,且仅由于作品知名度便给平台施以事先审查义务并不合理。为提升审查义务范围的确定性,法院引入安全阀概念,即当浏览量超过一定次数时触发平台审查义务。由此可知,知名作品的界定是综合浏览量、点击量、销售量、收益率等可量化指标的考虑。

第三,重复侵权作品。该审查义务的渊源可溯至民法的物权请求权。当物的圆满状态受妨害或有被妨害之虞,物权人得以请求妨害人或将为妨害之人为一定行为,以排除妨害或防止妨害发生。具体到网络版权保护,当版权陷入重复侵权风险,权利人有权请求侵权人或潜在侵权人排除侵害或防止侵害再次发生,此时更需要居于二者之中且对侵权场域具有一定危险控制力的网络平台提高注意义务。意大利地方法院有判决要求YouTube在收到适格通知后将侵权内容添加进Content ID系统作为过滤参照文件,使系统能防止相同侵权内容上传。德国法院以妨害者的责任为依据,不仅要求删除通知中告知的内容,还应采取措施防止相同侵权再次发生。我国在立法上也对平台施加了类似义务①《最高人民法院关于审理侵害信息网络传播权民事纠纷案件适用法律若干问题的规定》第9条第6项:法院在认定网络服务提供者是否存在过错时应当考虑“是否针对同一网络用户的重复侵权行为采取了相应的合理措施”。,司法实践亦遵循此规定。优酷诉百度案中②北京知识产权法院(2020)京73民终字155号民事判决书。,法院要求平台应对用户的侵权行为采取必要措施,不仅包括及时断开链接,还应包括预防侵权的合理措施,以及对重复侵权用户采取限制措施。

2.以多元因素为参考的主动注意标准认定

网络服务提供者主动预防侵权行为发生的注意义务不能被笼统确定,其主动程度与注意义务的高低成正比。而注意义务的高低,需视具体情况综合考虑网络服务类型、行为类型及权利对象类型等因子设定。

在网络服务类型中,平台提供的服务类型、运营模式往往影响其专业能力和用户内容接触程度,进而影响危险预期能力和控制能力,平台对内容的识别和控制能力越强,其注意义务越高。在行为类型因子中,一些“人为干预”因素的多少决定平台注意义务的高低,如前文所述,广告投放的直接获益、使用算法推荐吸引流量等行为,由此引发的版权侵权平台难辞其咎。在权利对象类型中,以平台对权利对象侵权的判断难度为标准,平台面对文字、图片、音频以及视频等不同难度的侵权判断具有不同注意义务,难度越高则义务越低。是故,应综合各因素并结合个案情况充分考虑未通知阶段的主动注意义务之高低。

(二)事后规制:完善已通知阶段的被动注意义务

网络服务提供者的被动注意义务主要体现在“通知—删除”规则中,侵权通知触发平台采取措施,此为典型的被动注意义务。事前的版权过滤不能完全杜绝侵权行为发生属意料之中,因此当侵权事实已然存在,应然层面仍需平台尽到提高注意义务以履行其“善良管理人”职责,要求对侵权通知进行合理审查,并对必要措施优化适用。

1.对“侵权通知”的审查义务

通过规定网络服务提供者的审查义务来改善“通知—删除”规则的实践困境已成学界共识,但如何审查、标准如何确定一直是障碍[7]。对此,笔者认为应从三方面入手:

第一,以形式审查为主。相较于未通知阶段侵权对象的不具体性,已通知阶段注意标准之确定更为简单明确。其一,平台需审查通知和初步证明材料是否符合法律形式要求,包括通知人是否适格、形式是否书面、数量是否合规、材料是否齐全等。通知人和声明人需提交身份证明材料和侵权或不侵权的初步证据材料。其二,平台还需审查材料之间的相互一致性。如通知内容与初步证明材料中当事人的基本信息是否相互矛盾,材料之间涉及的侵权内容是否一致。

第二,以实质审查为辅。作为中间人的网络平台审查所有通知极具挑战性,囿于专业技术领域的有限知识储备极易导致判断失误,因此,其只需在能力范围内承担有限的审查义务。具体体现在以下两方面。其一,在内容上,涉及初步证据的真实性、合法性、时效性。平台应具备基本的审查能力,了解相关材料的合法性要求、真实性要求、有效期限等,熟悉相关材料的必要内容,甚至在成本合理、渠道畅通的情况下,可适当加强实质审查。其二,在程度上,要求初步证据与侵权事实之间的因果关系达到一般可能性即可。必要措施的启动若要求证据与待证事实之间的关联性达到高度盖然性,将贻误权利救济。

第三,设置底线审查义务。其一,平台可设计一款系统用于版权权利证明的接收与审查。该系统除了可以接收各类证明材料,还可以为版权人与平台签订授权协议、完善授权流程提供渠道。在此过程中,平台需为接收审查程序的公平透明及正常使用承担相应责任[8]。其二,平台只应根据法律规定对提供的证明材料进行审查,而对其真实性、有效性、证明力等不需承担责任。

2.对“必要措施”的合理适用

第一,厘清“必要措施”与“转通知”之间的关系。我国《民法典》第1195条明确了必要措施为删除、屏蔽、断开链接等,但司法实践不断扩大“必要措施”的外延,在乐动卓越诉阿里云案中①北京知识产权法院(2017)京73民终字1194号民事判决书。,鉴于用户将涉嫌侵权的游戏软件程序存储于阿里云管理的云服务器上,法院认为考虑到强行关停服务器或删除数据会殃及其中其他合法内容,所以在不适合直接采取删除措施的情况下,转通知具有警示侵权人的意图,有利于防止损害后果扩大,应被视为必要措施从而使平台达到免责条件。由于我国“避风港”规则扩大了权利适用范围,故在著作权之外的专利侵权案件中亦有类似判决。审理威海嘉易烤案的法院综合考量公司对于发明专利侵权判断的主观能力、侵权投诉胜诉概率以及利益平衡等因素后,认为在接受投诉后立即删除和屏蔽可能会损害被投诉人的合法权益,而将“转通知”认定为一种合理的必要措施②浙江省高级人民法院(2015)浙知终字第186号民事判决书。。

依司法裁判思路,网络平台面对合格的侵权通知可采取只转通知而不删除链接的必要措施,这显然与立法表述③无论是《侵权责任法》第36条第2款,还是本案公布后才通过的《电子商务法》第42条第2款,抑或适用于版权领域但也被其他权利领域广泛借鉴的《信息网络传播权保护条例》第15条,都只提及了删除等能直接避免损害扩大的措施。、司法实践[9]抑或学界观点[10]相悖。必要措施主要作用在于能避免损害扩大并维护版权人权益,“删除、屏蔽和断开链接”等措施能减少损害扩大的可能性并确保版权人权利保护的及时性,而“转通知”无法快速消除侵权,仅是为了平衡作品上传用户的利益得失更是与制度初衷相悖。因此,确有必要明确必要措施的外延并未延伸至“转通知”。

第二,在扩大“必要措施”外延的基础上做类型化适用。适用正确的必要措施是网络平台收到侵权通知后尽注意义务的方式之一,有必要完善提高注意义务标准下“必要措施”的具体适用。具言之,基于平台的信息管理能力,在法律明确规定的“删除、屏蔽、断开链接”的必要措施之外,参考侵权行为方式、损害结果大小、侵权用户数据等因素,将采取的“必要措施”划分为三类。第一类为提供保证的必要措施。此措施效力弱于“删除、屏蔽、断开链接”,但能确保在侵权行为没有被最终证实的情况下不影响被通知人的经营行为。提供保证的措施可分为信用担保与经济担保,前者将削弱用户在平台上的信用积分,最终对用户的流量吸引和变现产生负面影响,后者以要求用户缴纳一定保证金为主。在天猫案、小程序案、阿里云案中,法院均表示删除措施过于严厉,根据平台的服务性质和信息管理水平,除“转通知”外,还可要求提供保证金等。第二类为关闭网络用户获取渠道的必要措施,即法律上所明确的“删除、屏蔽、断开链接”。一方面要考虑侵权行为的种类与危害程度,另一方面要在“善良管理人”的认知基础上,对初步证明材料与侵权事实之间的关联做有限的实质审查,要求二者之间达到一般可能性。第三类为消除服务资格的必要措施。此类必要措施的效力重于“删除、屏蔽、断开链接”,受此措施惩罚的网络用户将面临关闭店铺或查封账号的处境,对用户权利的干预程度之深要求平台慎重适用。

五、结语

历史车轮滚滚向前,网络服务提供者被动移除侵权内容的行为已然无法适配当前算法时代对版权保护之要求,若不对算法技术带来的冲击采取措施和妥善应对,必将对互联网版权保护造成更大隐患。为实现利益平衡的最终效果,网络平台理应扮演更为积极的角色,以权利人通知的发出为界限,在完善现行著作权法框架下“通知—必要措施”的基础上,设立更严格的“事前预防”机制,逐步重构网络服务提供者的版权注意义务,在理论和实践的不断积累中,促进网络版权得到更好、更公平的保护。