基于深度学习的条烟分拣线上烟包错配识别系统的构建

张毅,陈乐,刘文晓

基于深度学习的条烟分拣线上烟包错配识别系统的构建

张毅,陈乐,刘文晓

湖南省长株潭烟草物流有限责任公司,湖南省长沙市天心区中意三路500号 410000

【背景】条烟分拣线上,条烟长边相邻并排摆放形成一层,多层叠加形成烟包,与订单相比,烟包可能存在少烟、多烟、品规错误等问题,目前采用的人工检查方式效率较低,且难以完全避免错误发生。本研究的目的是构建烟包错配识别系统。【方法】采用由工业相机镜头和光源构成的机器视觉系统采集成品烟包侧面与顶面图像,以基于深度学习的物体定位和识别技术获取烟包中条烟的数量与品规,与物流上位系统订单数据比对,自动识别与提示错误烟包。【结果】(1)实际使用中烟包识别成功率≥99.99%,识别耗时≤300 ms。识别过程与原有工作步骤并行,增加识别系统不降低分拣效率。(2)系统上线运行至今有效避免了烟包连续出错和返工问题。(3)识别系统可以减轻搬运工人的工作负担,进而提高工作效率。【结论】采用深度学习机器视觉系统自动化识别烟包品规,可以提升烟草物流条烟分拣的质量和效率。

烟草物流;智慧物流;烟包;机器视觉;深度学习;物体识别

目前,烟草物流中采用自动化分拣线完成分拣。条烟经分拣后,多条条烟并排形成一层,多层叠加形成烟包,而后塑封配送给终端零售商。自动化分拣线在条烟流转中会出现条烟错位、卡烟等问题,导致和生产订单校验时,出现多烟、少烟或品规错误等问题。目前,烟草物流中心均由人工检查烟包,不能保证100%检查出烟包错误。错误烟包配送后,排查确认和纠正补送耗时耗力。当生产时条烟品规错误若未被及时发现,错误会持续向下一个订单分拣任务传递,导致连续烟包错误。返工时需要将所有错误订单拆包,调整条烟,并重新人工塑封,极大降低了工作效率。目前,机器视觉[1-2]在烟草物流中已有应用。在分拣产线上采用模板匹配技术进行条烟的定位和识别。但模板匹配方法依赖稳定一致的成像,实践难以保证,可靠性较差。

近年来,深度学习[3-14]技术迅猛发展,卷积神经网络新的基础结构不断改进,在ImageNet等数据集上分类性能已达到或接近人类水平[4]。深度学习在机器视觉和计算机视觉应用领域的新算法也不断涌现,如目标检测[7-10]、实例分割[11]、图像分类[12]、语义分割[13]等。深度学习基于大量数据样本提取物体的本质特征,相比模板匹配方法,准确率和可靠性都有显著提升。

目前,因烟包垛型多样、成像环境复杂,在线自动检测难度大,国内外还没有烟包识别的相关研究和应用。本文采用双相机机器视觉成像方案和深度学习目标检测技术建立了全新的在线烟包识别系统,以实现烟包识别的自动化,提高分拣线工作效率。

1 视觉识别系统的布局

1.1 系统结构

视觉识别系统首先需通过合理的工业相机和光源布局,采集烟包中所有条烟完整清晰的的图像。条烟印刷表面及烟包外包装的塑料薄膜光滑,光源直射易镜面反射引起成像过曝,为此,将光源布置在视野外侧,利用光源余光照射烟包表面。常规条烟码放成烟包时,均为条烟的宽高面位于烟包侧面,采集烟包侧面的图像即可识别出烟包内条烟的数量与品规。异型条烟码放成烟包时,长度超过常规烟长度规格的异型烟会横向放置,且有时两条烟并列横向放置,在侧面视角中横向放置的条烟会被遮挡。为了能获取所有条烟数据,采用顶部与侧面双工业相机布局。

包装机的烟包到位开关传感器会触发工业相机拍照,经定位和识别获取烟包中条烟品规及数量,与仓库管理系统(WMS)中订单数据进行比对,烟包配错识别系统结构如图1所示。

图1 烟包识别系统结构示意图

1.2 识别流程

识别流程包括离线和在线两个阶段。离线阶段,通过图像采集系统采集烟包图像以训练深度学习目标定位模型,训练条烟深度学习特征提取器,提取条烟的深度学习特征表示,将其保存至特征库中。为了减少数据标注量并利用大量的烟包数据,采用自监督学习方法提升预训练的条烟深度学习特征提取器。在线阶段,通过深度学习目标定位模型预测待识别烟包中条烟数量和位置,根据定位结果分割出各条烟图像,采用深度学习特征提取器提取条烟特征表示,查询特征库中条烟特征最相似的条烟的编码,融合侧面与顶面条烟品规及数量,与WMS系统中订单数据进行比对,判定烟包是否存在多烟、少烟或品规错误等异常,烟包识别流程如图2所示。

图2 烟包识别流程

2 深度学习烟包识别技术

2.1 目标检测

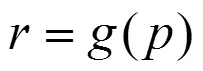

通用的目标检测以图像为输入,输出各物体在图像上的正置边界框,如公式(1)所示:

=() (1)

通用的目标检测算法[7-10]输出物体正置的目标边界框,如图3(a)所示。正置的目标边界框截取的条烟图像片会包含其它条烟的背景信息,如图3(b)所示,包含背景信息会影响后续提取的特征。

图3 通用目标检测算法获取的物体边界框(a)及截取的物体图像片(b)

为了更加精准的获取各个条烟的图像片,本文采用一种改进的深度学习目标检测模型,其输出为旋转边界框,该模型如公式(2)所示。

选择目标检测算法获取的旋转框及分割出的目标图像片如图4所示,可获得目标对象自身的图像片,避免背景干扰识别。

图4 旋转边界框目标检测算法获取的物体边界框(a)及截取的物体图像片(b)

图5 旋转框定义

在此定义下,采用目标检测算法常用的预测量归一化方法,模型输出预测框与锚框的偏差量,如公式(3)所示。

该旋转框检测损失函数及预测头设计可以直接应用于各通用目标检测骨干算法,经测试本文选用YOLO[7-8]为基础骨干网络。

2.2 深度特征提取

深度特征提取器以条烟的图像片为输入,输出为条烟的深度特征,如公式(5):

深度特征提取器以标准的34层残差网络RestNet-34[6]为骨干,以RGB图像为输入,以256维特征表示为输出,一个残差模块的构成如图6所示。

图6 参差网络模块

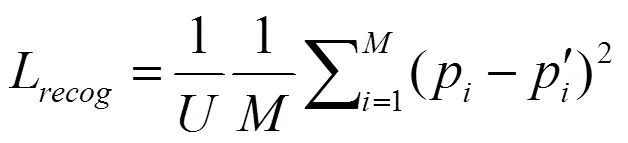

条烟分拣中会产生海量的运行时图像数据,数据标注耗时耗力,为了高效利用海量的无标签数据提升模型的判别力,本文提出了一种半监督训练框架,如图7所示。

图7 特征提取器模型框架

该框架采用Auto-Encoder[3]的结构,采用特征提取器提取深度特征,采用对称的特征解码器重构图像,定义L2损失函数描述重构图像与输入图像的误差,如公式(6),最小化重构误差可以保证学习到的特征表示最大程度保留输入图像的本质特征。重构的分支是一个无监督学习范式。

另一个分支以特征表示为输入,连接两个全连接层,而后连接Softmax层和交叉熵损失函数,如公式(7)最小化有标签数据的分类误差,提升特征表示的判别力。分类的分支是一个有监督的学习范式。

其中为类别数目,为训练时样本批量中有标签样本数目,另外y表示第个样本的真实类别。

训练时联合两个损失函数,如式(8)所示,同时输入有标签和无标签数据,进行半监督方式训练。

对提取的图像片特征,通过计算余弦相似度计算特征间的相似性。特征库中与输入图像片余弦相似度最小的特征对应的条烟类别即为输入图像片的条烟类别。

3 效果验证

3.1 仿真试验设计

本文用于验证深度学习烟包识别系统的仿真试验平台是Supermicro-SYS-4028GR-TR服务器,配备8块GeForce GTX 1080Ti GPU,IDE采用的JetBrains- CLion,标注软件采用的是labelme。本次仿真试验测试的目的是用来验证旋转定位的有效性及深度学习特征提取器的判别力。为了更好地保证仿真试验的可行性,数据集来源于工厂烟包生产线上实时采集的21000张烟包图像,并统计对应人工检测的准确率与效率。将采集的21000张烟包图像分为两类,前18000张用于训练测试,从中随机挑选16000张烟包图像作为训练集,2000张烟包图像作为验证集,后3000张烟包图像作为测试集,来测试模型的可靠性。

首先通过labelme标注烟包,得到各个条烟标注区域,如图8所示。然后利用训练好的YOLO模型进行旋转定位检测,将烟包中条烟定位出来。接着将YOLO旋转定位结果传入到本文提出的深度学习特征提取器中进行特征提取,最后将提取到的特征与模板库进行比对,得到识别结果。

图8 人工标注区域

通过深度学习特征提取器得到的是256维空间的特征向量,为了便于计算和可视化以及提取有效信息,本文采用主成分分析(PCA)算法对其进行线性降维,将原来的256维空间降维到3维空间,如图9所示。

图9 图像降维仿真结果

根据图像降维结果仿真图可以得知,同一类别的物体由于类别相似度比较高,出现聚类的情况,类间相似度越大,物体距离越近,不同类物体由于类别相似度比较低,出现分散的情况,相似度越低,区域质心欧式距离相距越大,进而验证了本文提出的特征提取器的判别力,能够根据提取到的物体的特征信息将不同类别物体区分出来。

为了进一步验证深度学习特征提取器的判别力,以10000张图像为间隔依次添加到训练集中进行训练,同时向测试集中添加一些图像灰暗,部分遮挡,包装相似度很类似的图像,提升测试集的难度,测试结果显示不同类别物体的区域质心距离随着训练数据的增加逐渐变大,最后趋于稳定,进而证明本文提出的特征提取器的判别力。统计10种不同类别物体的区域质心欧式距离如图10所示。

注:上图横轴表示类别标签,纵轴表示质心到原点的距离,从下到上不同颜色折线图表示依次添加10000训练数据的测试结果。

3.2 测试结果分析

在条烟包装相似,种类繁多以及斜烟等因素的干扰下,本文提出的旋转定位算法能够将旋转条烟分割出来,去除更多的背景信息,保留物体本身的有效特征信息,旋转定位结果如图11所示。

图11 旋转定位识别结果

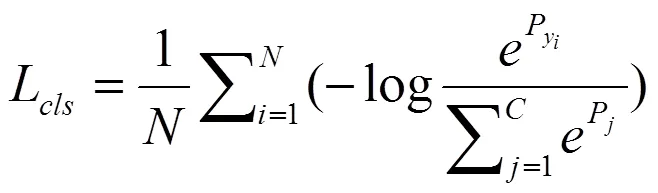

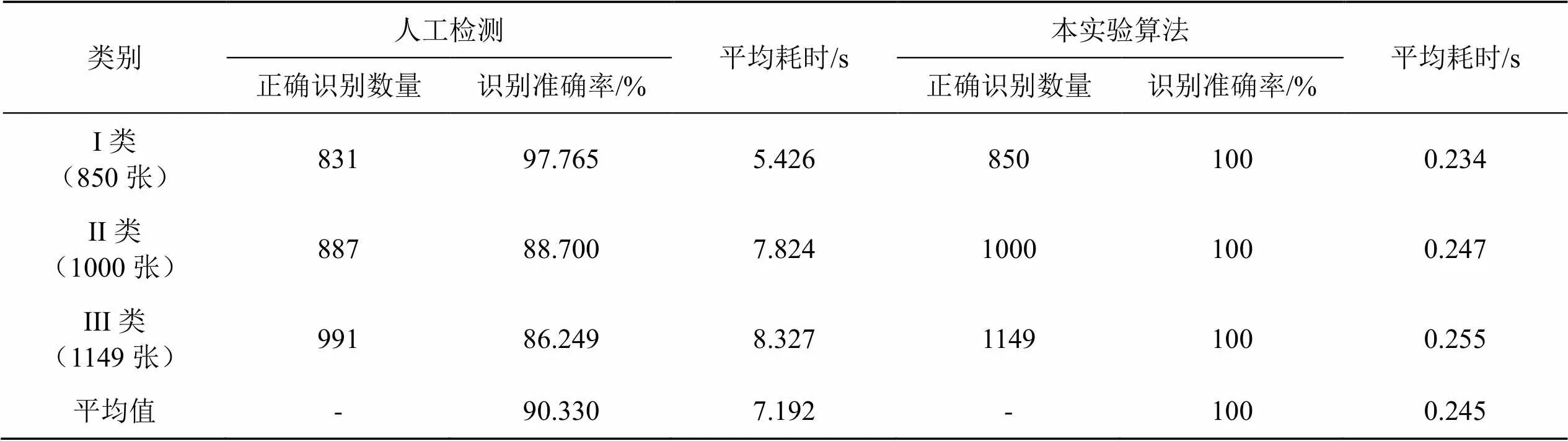

为了进一步验证旋转定位的有效性以及深度学习特征提取器的判别力。本实验运用统计学知识,从定位准确率和效率以及识别准确率和识别效率四个方面来分析旋转定位的有效性以及特征提取器的判别力。首先根据测试烟包的工况复杂程度,将烟包大致分为3类,I类表示单层斜烟(850张),II类表示多层斜烟(1000张,无遮挡),III类表示多层斜烟(1150张,部分遮挡,烟包包装相似)。

定位准确率计算如式9所示,识别定位结果如表1所示:

表1 旋转定位准确率与耗时统计

Tab.1 Statistics of rotation positioning accuracy and time-consumption

注:正确旋转定位统计标准是能将各个物体单独框出,不框出临近物体,同时各个旋转框无交集,平均耗时指定位每类图像花费时间的平均值,不包括相机拍照时间。

Note: The statistical standard for correct rotation and positioning refers to framing each object individually, but not framing adjacent objects, and with no intersection between rotating frames. Average time consumption refers to the average time taken for each type of image, excluding the time taken by the camera.

通过表1可以看出,本文提出的旋转定位算法定位准确率能达到99.971%,平均耗时0.123 s左右,能够精准地将烟包中各个旋转条烟定位出来,为后续深度学习特征提取器提供了很好的精度保证,进而验证了本文提出的旋转定位算法的有效性,具有很大的工业应用价值。

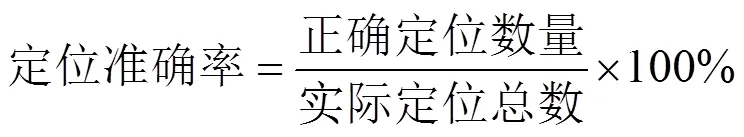

识别准确率计算如式10所示,识别结果如表2所示:

表2 识别准确率与耗时统计

Tab.2 Statistics of recognition accuracy and time-consumption

注:正确识别衡量标准是能够将物体划分到训练集相对应的类别处,人工检测与本实验算法平均耗时统计标准是检测每类图片花费时间的平均值,其中,本实验算法平均耗时包括拍照时间,旋转定位时间,以及识别时间。

Note: The criterion of correct recognition refers to classifying the objects into categories corresponding to the training set. The average time consumption of manual detection and the experimental algorithm refers to the average time spent on detecting each type of image. Among them, the average time consumption of the experimental algorithm includes the time of photographing, the time of rotation and positioning, and the time of recognition.

通过表2可以看出,人工检测每张图片耗时在7 s左右,正确率只达到90%左右,若是考虑到人工疲劳、工况差等因素,人工检测的耗时和正确率可能会更低,而本文提出的特征提取识别算法再加上拍照、旋转框定位算法总的处理每张图片的时间耗时不超过 260 ms,同时识别精度能够接近100%(本次测试的旋转定位出的2999张图像,全部识别出来,但是由于工况因素比较多,不能排除偶然因素造成个别图像识别错误)。

3.3 实际应用

基于深度学习的烟包识别系统在烟包生产线现场部署的主要硬件配置有相机、镜头、光源,工控机。烟包识别系统实际场景如图12所示,烟包经传送带、推板等机械电气装置被运送到顶部、侧方相机视野范围内,由传感器触发相机拍照,将烟包图像信息传递到视觉系统进行处理,并反馈烟包中条烟种类,数量信息等视觉处理结果,如图13所示。

图12 烟包生产线实际场景

图13 视觉处理结果

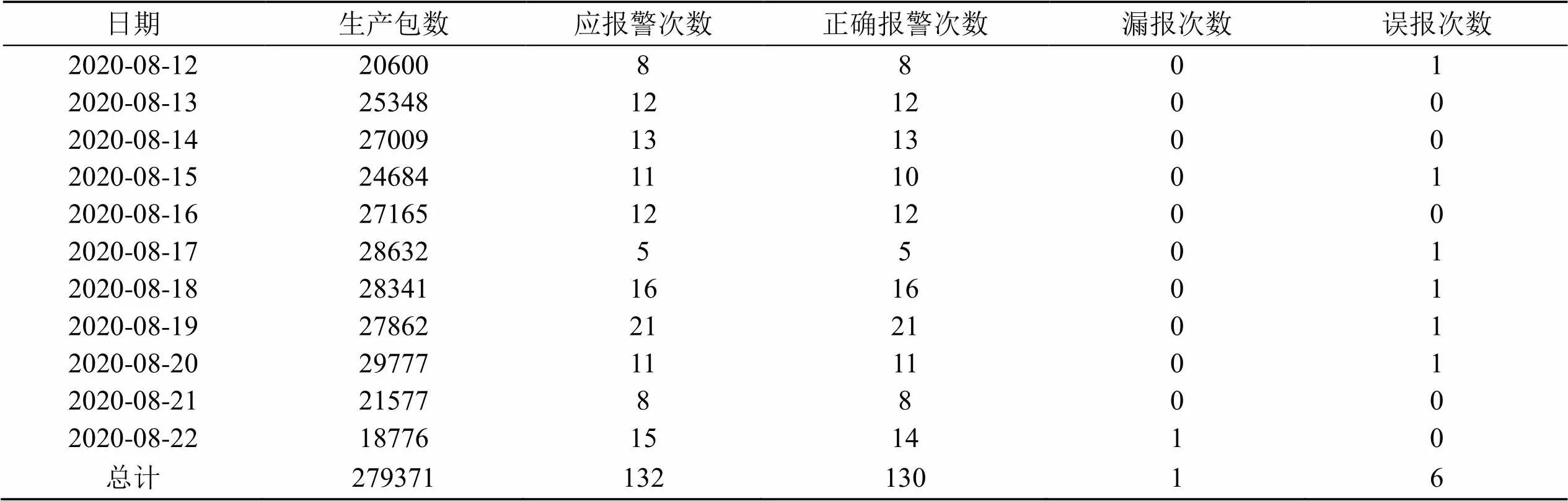

在某烟草公司烟包生产线上安装了8台混合包装机进行为期30 d的烟包条烟实时检测,统计连续11 d的烟包实测数据如表3所示。

表3 某烟草公司8台混合包装机部分实测数据

Tab.3 Some measured data of 8 mixed packaging machines of a tobacco company

注:报警次数指视觉识别结果与烟包订单数据库的比对结果。

Note: The number of alarms refers to the comparison between the visual recognition result and the cigarette pack order database.

通过表3可以看出,8台混合包装机11 d共检测烟包279371包,误报次数共有6次,识别成功率达到了99.99%以上,在烟包生产线上具有很高应用价值。

4 结论

本文根据烟草物流中条烟分拣的实际识别需求,设计了一种基于深度学习的烟包识别机器视觉系统。改进了通用定位算法的输出,可获得物体的旋转矩形框,以精准定位物体。采用大数据量半监督训练方式提升深度学习模型判别力。以特征提取器方式使用深度学习分类网络,使得模型与类别数量无关,保证该方法对新品规的扩展性。该系统采用大数据量为基础的深度学习技术,对光照变化、垛型等适应性和鲁棒性强。仿真实验和实际应用表明:(1)该系统识别成功率≥99.99%,识别耗时≤300 ms;(2)该系统可100%及时发现连续错烟,即追尾问题,避免大面积返工。该系统已经应用于国内某区域性烟草物流中心,提升了条烟分拣效率,具有较大的推广应用价值。

[1] 刘浩,贺福强,李荣隆,等. 基于机器视觉的卷烟小盒商标纸表面缺陷在线检测技术. 中国烟草学报[J]. 2020, 5: 54-59.

LIU Hao, HE Fuqiang, LI Ronglong, et al. On-line detection technology of label paper surface defects of cigarette packet based on machine vision, Acta Tabacaria Sinica[J]. 2020, 5: 54-59.

[2] 李捷,陆海华,王翔,等. 基于机器视觉的烟支接装质量在线检测系统,烟草科技[J]. 2019, 09:109-114.

LI Jie, LU Haihua, WANG Xiang, et al. Online cigarette appearance inspection system based on machine vision, Tobacco Science & Technology[J]. 2019, 52(9): 109-114.

[3] Hinton GE, Salakhutdinov RR.Reducing the dimensionality of data with neural networks, Science[J]. 2006, 313(5786): 504-507.

[4] Yann LeCun, Yoshua Bengio, Geoffrey Hinton. Deep learning. Nature[J]. 2015, 521: 436-444.

[5] Krizhevsky A, Sutskever I, Hinton GE.Imagenet classification with deep convolutional neural networks. advances in neural information processing 25[C]. Lake Tahoe, 2012: 1097-1105.

[6] HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition. 2016 ieee conference on computer vision and pattern recognition (CVPR)[C]. Las Vagas, 2016: 770-778.

[7] Redmon J, Divvala S, Girshick R. A. Farhadi, You only look once: unified, real-time object detection,[C]. Las Vegas, NV, 2016: 779-788.

[8] Redmon J, Farhadi A. YOLO9000: better, faster, stronger,[C]. Honolulu, 2017: 6517-6525.

[9] REN Shaoqing, HE Kaiming, Ross Girshick, et al. Object detection networks on convolutional feature maps, in2017, 39(7): 1476-1481.

[10] REN Shaoqing, HE Kaiming, Ross Girshick, et al. Faster r-cnn: towards real-time object detection with region proposal networks, in2017, 39(6): 1137-1149.

[11] HE Kaiming, Gkioxari G, Dollár P. Mask r-cnn,[C]. Venice, 2017: 2980-2988.

[12] LIN TsungYi, Goyal Priya, Girshick Ross, et al. Focal loss for dense object detection, ieee transactions on pattern analysis and machine intelligence[J]. 2020, 42(2): 318-327.

[13] Olaf Ronneberger, Philipp Fischer, Thomas Brox, U-net: convolutional networks for biomedical image segmentation, medical image computing and computer-assisted intervention (MICCAI)[C]. Munich, 2015: 234-241.

[14] YANG Xue, YAN Junchi, YANG Xiaokang, et al. Scrdet++: detecting small, cluttered and rotated objects via instance-level feature denoising and rotation loss smoothing, arxiv-2004.13316, 2020.

Construction of cigarette pack mismatch recognition system based on deep learning on cigarette sorting line

ZHANG YI*, CHEN Le, LIU Wenxiao

Hunan Changzhutan Tobacco Logistics Co., Ltd., Changsha City 410000, China

In tobacco logistics, several cigarettes are placed side by side to form a layer, and and multiple layers are superimposed to form cigarette packs, which may lead to problems such as fewer cigarettes, more cigarettes, and incorrect cigarette specifications. At present, the manual inspection method is inefficient and difficult to avoid errors completely. Correcting the error after the delivery of the wrong cigarette pack is time-consuming and labor-intensive, and the failure to find the wrong cigarette pack in time during production will result in multiple consecutive errors, which need to be addressed by time-consuming rework.Machine vision system based on industrial camera lens and light was used to collect the side and top surface images of the finished cigarette pack, and the object positioning and recognition technology based on deep learning was used to obtain the quantity and product specifications of the cigarettes in the cigarette pack, and compare them with the order data of logistics upper system to automatically identify and prompt wrong cigarette pack.(1) In actual use, the recognition success rate was ≥ 99.99%, and the time cost was ≤ 300 milliseconds. The recognition process was parallel to the original work steps, and the addition of the recognition system did not reduce the sorting efficiency. (2) After the system went online, the problem of continuous errors in recognizing and sorting cigarette packs was effectively avoided, and a large number of rework were avoided. (3) The identification system can reduce the workload of the operators, thereby improving work efficiency.Deep learning machine vision system can improve the quality and efficiency of cigarette sorting in tobacco logistics..

tobacco logistics; intelligent logistics; cigarette pack; machine vision; deep learning; object recognition

. Email:30870878@qq.com

张毅,陈乐,刘文晓.基于深度学习的条烟分拣线上烟包错配识别系统的构建[J]. 中国烟草学报,2022,28(6). ZHANG YI,CHEN Le,LIU Wenxiao. Deep learning based cigarette pack recognition system on the cigarette sorting line[J]. Acta Tabacaria Sinica, 2022,28(6).doi:10.16472/j.chinatobacco.2021.059

支撑项目:中国烟草总公司湖南省公司科技项目“基于环保材料及机器视觉技术的卷烟包装系统研究与应用”(No. HN2020KJ08)

张毅(1985—),研究生,工程师,主要研究方向为烟草物流和人工智能,Tel:18900787019,Email:30870878@qq.com

2021-03-24;

2022-02-08