车内司乘人员异常行为检测研究

王晨WANG Chen;张海宁ZHANG Hai-ning

(西安工业大学电子信息工程学院,西安 710021)

0 引言

车内异常行为的发生严重影响司乘人员的行车安全,现有车内视频监控异常行为主要集中在疲劳驾驶和分心驾驶。本文主要研究突发疾病时驾驶员的异常驾驶行为及司乘人员的异常交互行为[1]。

目前,针对驾驶员异常行为识别研究主要有以下2类:基于车辆状态及参数的方法,通过测量方向盘运动、踏板位置等参数检测驾驶状态,增加了车载外设将导致高错误识别率且无法识别特定行为[2];基于人工基本特征的方法,如提取图像的局部纹理、Haar、HOG等人工特征[3]并引入多特征融合,弥补了仅依赖单个特征的缺点,但对复杂背景的多维时间序列和多分类,仅识别行为是否属于异常,降低了识别准确率。

目前,检测司乘人员异常行为应用很少。但据其他不同场景中异常行为识别应用:如Rougier C等将运动历史图像与人体形状变化相结合以检测异常行为,但只能近似表示人体,精度较低[4]。基于运动轨迹方法,跟踪并检测人体运动图像轨迹是否偏离正常轨迹来确定异常行为[5]。如文献[6]方法主要针对开放或人员位移变化明显的场景,且在光照、空间受限等约束下,其准确率会大大降低。

本文引入骨架关键点重构姿势模型,设计一种DBDC分类检测方法;对司乘人员异常行为提出一种基于时空特征的检测算法,利用金字塔光流算法跟踪SIFT算法提取的时间特征点,统计特征点位移及动能,该方法能准确识别人体行为姿态,使识别准确率可达95%以上。

1 网络模型

使用AlphaPose骨架关键点检测模型,用于提取车中驾驶员和乘客的关键点,以识别车内行为。如图1所示为AlphaPoae网络结构。

图1 AlphaPose网络结构

2 驾驶员异常行为识别检测

2.1 构建姿态特征

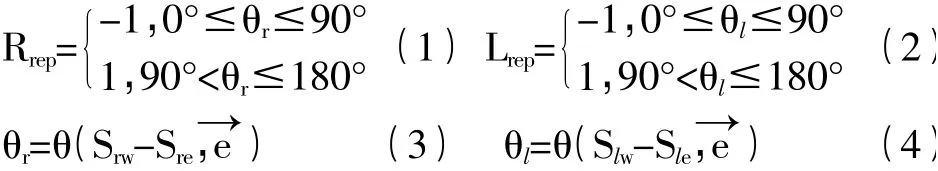

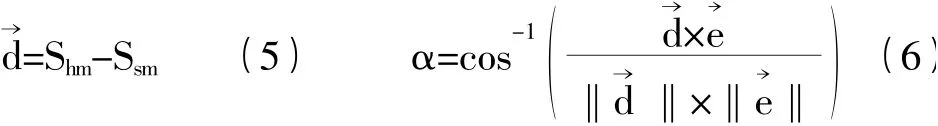

车内人员大部分保持坐姿,驾驶行为基本由上身运动组成,本文使用人体上部13个关键骨架点坐标位置信息提取特征数据,区分安全驾驶、趴在方向盘上、晕倒斜躺三种行为。研究知道,驾驶员三种姿势间特征明显,故构建以下5个特征:驾驶员右左手肘的夹角θ1、θ2,左右手腕和左右手肘的上下相对位置关系Lrep、Rrep(公式(1)、(2)),驾驶员与垂直方向之间的夹角α,如图2。

图2 姿势特征部分标注

对驾驶员右、左肘指向右、左腕的向量和垂直方向的单位矢量间的夹角θr、θl计算如公式(3)、(4):

当θr、θl≥90°且θr、θl≤180°:表示手腕的相对位置在肘部上方,置为1;当θr、θl≥0°且θr、θl≤90°:表示手腕在肘部下方,置为-1。使用Rrep和Lrep区分是否属于晕倒斜躺。图3表示安全驾驶和晕倒斜躺时θr和θl夹角的比较。

图3 安全驾驶和晕倒斜躺姿势角度对比

对于趴在方向盘上行为构建驾驶员与竖直方向间的夹角α来区分,驾驶员向量为Ssm与Shm间的连线,计算为公式(5)、(6):

如图2,安全驾驶时α一般很小或可忽略,即倾斜角度非常小,但当驾驶员趴在方向盘上时,α会发生较大变化,即可能变为较大的锐角或出现更大变化,以此来区分驾驶员是否发生趴在方向盘上这种异常行为。

2.2 DBDC模型训练

受MobileNetV2模型思想启发,本文提出了DBDC模型(图4)对驾驶员三种行为进行分类识别,使其识别精度和速度更高。模型使用5层深度可分离卷积层,通道数以2的幂次方逐次增加,每层由一层深度卷积和逐点卷积构成,大大降低了卷积参数和计算量,提高了识别速率。最后使用全局平均池化和全连接层对其进行分类。

图4 DBDC模型网络结构

2.3 异常行为检测算法评价指标

在对该模型评估中,评价指标使用准确率、精确率、召回率、F值、漏警率和虚警率。

3 司乘人员异常行为识别检测

3.1 构建检测模型

司乘人员异常行为主要指所发生在前排乘客与驾驶员之间的身体交互行为,包括撕扯、打架等暴力行为,包括大量大幅度行为动作。

本文将AlphaPose模型提取的关键坐标点信息在黑色背景下重建相关性姿态。采用SIFT算法对司乘人员姿态图进行角点提取以获得每帧图像的空间特征信息。采用金字塔L-K光流算法将角点作为特征点进行跟踪并计算获得帧间特征点的光流矢量。并对图像帧中所有特征点的位移变化及动能进行计算以判断是否发生异常行为。

3.2 判别规则

首先根据特征及其光流变化信息,将每个特征点的位移变化量划分为坐标轴上的x轴和y轴上的分量(ux,uy),计算得出相应每个特征点的位移变化值d(公式(7)),从而计算每帧图像上所有特征点位移的平均值davg(公式(8)),表示车内人员的整体移动幅度:

发生冲突时,其时间相对比较长,因此为避免因时间过短而造成的误判,在进行数据计算分析时,本文中设定分界阈值dth,当连续三帧图像中计算的davg均高于dth时,即首先认为存在冲突行为。

由以上可知,对于连续三帧阈值判断,不能完全正确对异常行为进行区分判断,故再次对图像帧中特征点的动能进行计算,由动能公式可得,对于特征点的动能依赖于其权重和运动速度幅值,其中将每个特征点的光流矢量划分为坐标轴上的x、y轴上的分量(vx,vy),求得每一个特征点的速度平方值(公式(9))及方向角(公式(10))。

在计算动能中,特征点运动方向决定了权重Q的取值(公式(11)),即可计算得到第帧图像上所有特征点的动能值,从而得到平均动能(公式(12))来体现每一帧图像上的动能变化。其中表示第k帧内第i个特征点的速度方向,θk-1表示k-1帧的平均运动方向。

本文中设定动能阈值Eth,与所计算的每帧平均动能Eavg进行比较。若Eavg>Eth,则表示车内有大幅动作产生,即判断发生异常行为;若Eavg<Eth,则表示车内未发生大幅动作,即判断为安全驾驶。

最后将两者结合判断,判定规则如下:若davg、Eavg两者满足同时大于所设阈值,则判定为出现异常行为,否则视为安全驾驶。

4 实验与分析

4.1 实验条件与数据准备

本实验平台操作系统为Windows 10;CPU为Inter Corei7-6700;软件采用PyCharm2021.3.3;深度学习框架是Pytorch;编程环境是Python 3.9。使用小米云台版2K监控摄像头且位置处于前排乘客座位前的右下角。

司乘人员行为数据集是为5组视频数据所保存的图像帧和视频帧,其中包含驾驶员的三种驾驶行为图像帧2433张,和司乘人员之间交互行为视频帧100段,分别为安全驾和有暴力冲突的驾驶行为各50段,每段5秒左右。

4.2 驾驶员异常行为检测结果

①驾驶员姿势识别模型评估。在评估所构建的驾驶员姿势识别模型时,使用本文所划分训练好的三种行为数据集对模型进行测试,获得表1所示的准确率。

表1 驾驶员姿态识别模型对三种行为的识别结果

分析测试结果可得,其平均准确率达到了96.46%,三种驾驶行为的识别准确率都在95%以上,对于异常行为的识别检测相差不大。

②DBDC模型评估结果。定义安全驾驶为负样本,趴在方向盘上、晕倒斜躺为正样本,对输出结果进行二分类,计算上述指标得出地结果如表2。

表2 DBDC模型评估结果

由表2结果可得,算法的准确识别率达到在97.59%,漏警率为2.3%,虚警率为5.03%,由测试数据分析,其中有4帧图片为漏警、9帧图片为虚警。

4.3 司乘人员异常行为检测结果

①绘制特征点位移、动能变化曲线图。如图5(a)位移变化曲线图可看出对于正常驾驶和异常驾驶行为有明确的分界点,设置判别阈值为22,当连续三帧均davg>22,即首先可判断车内司乘人员发生异常行为;图5(b)动能变化阈值设为4000,在30帧和110帧之间,平均动能非常大,在前30帧和110帧后,平均动能小于阈值,故动能变化能较准确判别驾驶行为是否异常。

图5 特征点位移、动能变化曲线图

②司乘人员异常行为检测算法评估结果。结合特征点平均位移及动能变化,对本文提出的司乘人员异常行为检测算法评估结果如表3。

表3 司乘人员异常行为检测算法测试结果

分析测试结果,识别安全准确率达到99.68%,异常识别准确率为95.03%。经过对误判帧图像的分析可得其主要原因一是视频数据为摄像头模拟拍摄,乘客突然出现大幅度动作时会遮挡摄像头,导致在识别时会误判为打斗行为;二是当两人某点同时出现大幅度动作且持续则会出现误判为打斗行为。

5 结束语

针对前排司乘人员的异常驾驶行为,提出基于AlphaPose模型的骨架关键点的识别检测方法。首先,针对驾驶员异常行为,结合骨架关键点构建姿态模型,引入深度可分离卷积,设计训练DBDC分类模型。其次,针对车内司乘人员异常交互行为并利用驾驶员和乘客姿势估计中获得的结果在黑色背景上重构姿态模型,提取时空特征,并根据特征点光流信息计算图像帧中平均位移及动能来判断行为是否异常,使得检测准确率提高到95%以上,并降低了检测速度,以此作为智能监控系统应用的技术支撑。