一种基于CycleGAN改进的低剂量CT图像增强网络

廖仕敏,刘仰川,朱叶晨,王艳玲,高 欣

一种基于CycleGAN改进的低剂量CT图像增强网络

廖仕敏1,2,刘仰川2,朱叶晨2,王艳玲3,高 欣1,2

(1. 徐州医科大学医学影像学院,江苏 徐州 221004;2. 中国科学院苏州生物医学工程技术研究所医学影像技术研究室,江苏 苏州 215163;3. 苏州高新区人民医院放射科,江苏 苏州 215129)

低剂量CT是一种有效且相对安全的胸腹部疾病筛查手段,但图像中的伪影和噪声会严重影响医生的诊断。基于深度学习的图像增强方法中网络训练大多依赖于难以获取的配对数据,即同一患者相同部位像素级匹配的低剂量和常规剂量CT图像。针对非配对数据,提出了一种基于循环一致性生成对抗网络(CycleGAN)改进的低剂量CT图像增强网络,在生成器前添加浅层特征预提取模块,增强对CT图像特征的提取能力;并利用深度可分离卷积替换生成器中的部分普通卷积,减少网络参数和显存占用。该网络使用3 275张低剂量CT图像和2 790张非配对常规剂量CT图像进行训练,另外1 716张低剂量CT图像进行测试。结果表明,该网络生成的CT图像的平均感知图像质量评价指标(PIQE)为45.53,比CycleGAN的结果降低了8.3%,更远低于三维块匹配滤波(BM3D) 31.9%、无监督图像转换网络(UNIT) 20.9%,且在结构细节保持、噪声和伪影抑制方面均获得了更好的主观视觉效果,是一种具有潜在临床应用前景的低剂量CT图像增强方法。

低剂量CT;图像增强;深度学习;非配对数据;循环一致性生成对抗网络

计算机断层成像(computed tomography,CT)是一种通过无损方式获取人体内部解剖信息的成像技术,具有扫描时间短、图像分辨率高等特点。然而,CT扫描过程中较高的辐射剂量会损害患者健康,甚至诱发癌变。相比于常规剂量CT,低剂量CT在扫描中可有效降低患者所受的辐射剂量,因而广泛应用于胸腹部(特别是肺部)疾病筛查领域。目前临床上通常采用降低射线源的管电流或管电压的方式实现低剂量CT扫描,由此探测器检测到的光子数也相应变少,投影数据的信噪比降低,导致重建图像中出现大量的噪声和伪影,严重影响医生的准确诊断。因此,有效抑制低剂量CT图像中的噪声和伪影,提高图像质量,具有重要的临床意义。

传统低剂量CT图像增强方法可分为基于投影域数据和基于图像域数据2类,前者可细分为投影域处理方法[1-3]和迭代重建方法[4-5]。投影域处理方法对探测器接收到的投影数据进行滤波去噪,计算过程简单、耗时短,但容易引起数据过校正,导致重建图像引入新的伪影。迭代重建方法通过引入先验知识和约束条件来构建具备特定优化效果的目标函数,并借助迭代最优化方法求解得到高质量CT图像,但迭代过程计算复杂度高、耗时严重,且依赖于优化准则,临床应用价值受限。此外,投影数据涉及CT机的部分核心技术,因此厂家一般不提供投影数据获取权限。基于图像域数据的方法[6]则不依赖投影数据,直接对重建图像进行增强,具有一定的去噪、去伪影效果,但容易引起图像过度平滑、细节信息丢失等问题,如三维块匹配滤波(block-matching and 3D filtering,BM3D)[7]。近年来,随着深度学习的发展,卷积神经网络(convolutional neural network,CNN)在计算机视觉领域[8-11]的应用愈加广泛。剂量感知网络(dose aware network,DAN)[12],基于残差编解码结构的卷积神经网络(residual encoder- decoder CNN,REDCNN)[13],自注意卷积神经网络(self-attention CNN,SACNN)[14]凭借各自强大的特征提取能力,在低剂量CT图像去噪、伪影抑制和结构保持方面,表现出比传统方法更大的优势。上述网络均属于监督学习网络,依赖于临床上难以获取的配对数据,即同一患者相同部位像素级匹配的低剂量和常规剂量CT图像。部分研究[15]通过仿真获取配对的CT图像,但因仿真成像与真实物理成像在射线透射与散射、旋转扫描、人体模型等方面存在差距,应用价值受限。

近几年,研究人员提出了多种使用非配对数据进行训练的无监督网络,如无监督图像到图像转换网络(unsupervised image-to-image translation network,UNIT)[16]、循环一致性生成对抗网络(cycle-consistent generative adversarial network,CycleGAN)[17]、通过解耦表征的多样化图像到图像转换网络(diverse image-to-image translation network via disentangled representations,DRIT)[18]、多模态无监督图像到图像转换网络(multimodal unsupervised image-to-image translation network,MUNIT)[19]等。其中CycleGAN作为最经典的无监督网络,被广泛应用于图像生成任务,也将其应用于低剂量CT图像增强。朱斯琪等[20]将CycleGAN生成器中特征转换模块的残差连接替换为稠密残差连接,增强了网络层间的联系;TANG等[21]将BM3D增强后的低剂量CT图像作为先验信息,进一步约束网络的训练过程,2个改进网络均取得了较好的结果。然而,前者采用的心脏CT数据集因人工截取感兴趣区域(region of interest,ROI)导致其缺乏完整性;后者采用的死猪CT数据集缺乏生理运动信息且与人体解剖结构相差较大。本文以非配对临床胸腹部常规、低剂量CT图像作为数据集,借助浅层特征预提取模块和深度可分离卷积(depthwise separable convolution,DSC)[22]改进CycleGAN,并与传统增强方法BM3D、深度学习网络UNIT和CycleGAN做对比,验证改进后的CycleGAN在低剂量CT图像增强方面的效果。

1 材料和方法

1.1 数据和预处理

本研究所用临床胸腹部CT影像数据由第四届图像计算与数字医学国际研讨会(ISICDM 2020)主办方提供,训练集包含10例受试者的低剂量CT图像3 275张和另外10例受试者的常规剂量CT图像2 790张,测试集包含另外5例受试者的低剂量CT图像1 716张,图像尺寸是512×512。此外,为加快网络收敛并考虑到人体组织的CT值存在负值,将数据归一化到[-1, 1]。

1.2 基础网络

1.2.1 生成对抗网络

生成对抗网络(generative adversarial network,GAN)是CycleGAN[17]的基础,包含一个生成器和一个鉴别器,生成器的目标是生成能最大程度还原捕捉到的训练集特征的图像;鉴别器的作用则是正确区分训练集中的真实图像和生成器生成的假图像,并将分类结果反馈给生成器,使生成器生成更接近真实数据的图像,由此构成博弈。GAN的对抗损失函数可表示为一个最小-最大化问题,即

其中,为数学期望函数;为真实数据;为随机噪声;()为真实数据分布;()为用于随机噪声采样的先验分布;为生成器;为鉴别器。生成器和鉴别器在博弈过程中,不断提升自身性能,直至达到纳什平衡,即生成器无法再提高生成图像的逼真程度,鉴别器无法区分真实图像和生成图像。

1.2.2 循环一致性生成对抗网络

在GAN中,生成器为生成逼真的图像,常常会忽略输入变量间的差异性,导致模式崩溃,即源域中的不同图像被生成器转换成目标域中同一图像。CycleGAN通过引入循环一致性损失,同时训练生成器和,确保转换到目标域中的图像经生成器可转换回与原始图像近似的图像,从而避免上述问题,如图1所示。

图1 CycleGAN原理示意图

图1中,和为鉴别器,分别鉴别生成器和生成的图像是否足够接近真实图像。CycleGAN的生成器主要由编码器、特征转换模块和解码器3部分组成,如图2所示。

图2 生成器结构

编码器包含2层步幅为2的跨步卷积,特征转换模块包含9个残差块,每个残差块由2层普通卷积组成,解码器包含2层步幅为2的反卷积。

输入图像尺寸为1×256×256 (通道数为1,长和宽均为256),经普通卷积后,得到尺寸为64×256×256的特征图。再依次由编码器下采样,经特征转换模块转换特征,解码器上采样,普通卷积融合通道,最终输出尺寸为1×256×256的图像。

此外,为进一步约束生成器的训练过程,CycleGAN还引入了一致性损失,将目标域或源域中的图像分别输入生成器或中,生成器输出的图像应保持不变。

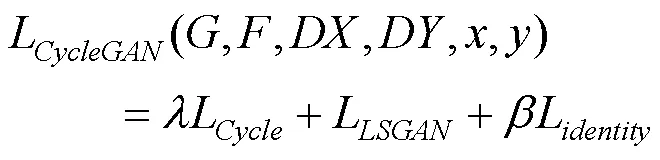

CycleGAN的损失函数包含循环一致性损失函数L、对抗损失函数L(CycleGAN的对抗损失函数为最小二乘损失)和一致性损失函数L的3部分,即

其中

其中,()为目标域中的数据分布;和为权重系数,平衡网络的循环一致性损失、对抗损失和一致损失,值分别为10和5。

1.3 改进网络

为有效抑制低剂量CT图像中的噪声和伪影,并保留图像中的结构细节信息,本文对CycleGAN做如下改进和调整。

1.3.1 深度可分离卷积

生成器由大量的卷积层堆叠而成,因此网络参数极多,大量参数不仅会降低网络的训练速度而且易导致网络过拟合。使用DSC[22]替换CycleGAN生成器中的部分普通卷积可减少网络参数,降低训练过程中显存的占用。

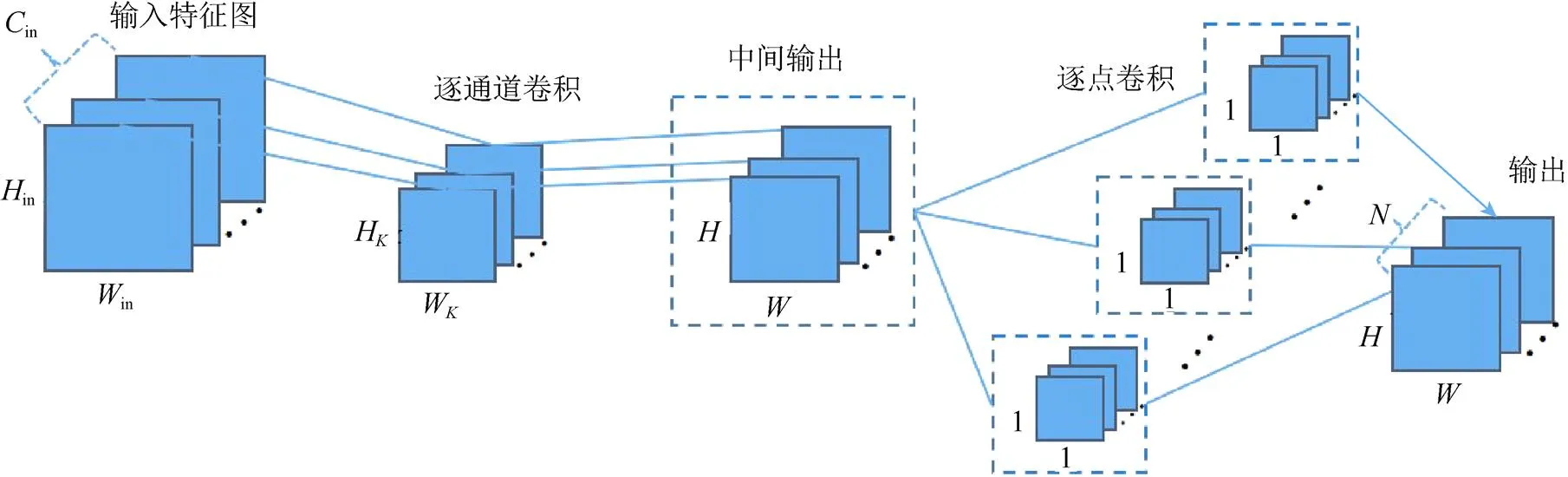

DSC是文献[22]在2017年提出的一种应用于移动端视觉的卷积方法,该方法将普通卷积分解为逐通道卷积和逐点卷积,如图3所示。

输入特征图的尺寸为in×in×in,且in,in,in分别为特征图的宽、高和通道数。DSC首先对输入特征图进行逐通道分离,对分离出的通道使用in个尺寸为W×H×1的卷积核进行逐通道卷积,得到尺寸为××的中间输出,W,H和,分别为卷积核的宽、高和中间输出的宽、高。最后使用个尺寸为1×1×in的卷积核对中间输出进行逐点卷积,最终输出特征图的尺寸为××。

图3 深度可分离卷积

不考虑偏置的情况下,上述普通卷积、逐通道卷积和逐点卷积的参数计算公式分别为W×H×in×,W×H×in×1和1×1×in×,因此DSC的参数计算式为W×H×in×1+1×1×in×。

在输入(in)和输出通道数()都很大的情况下,DSC的参数量远小于普通卷积。因此利用其可得到一个参数量更小、训练速度更快的神经网络。

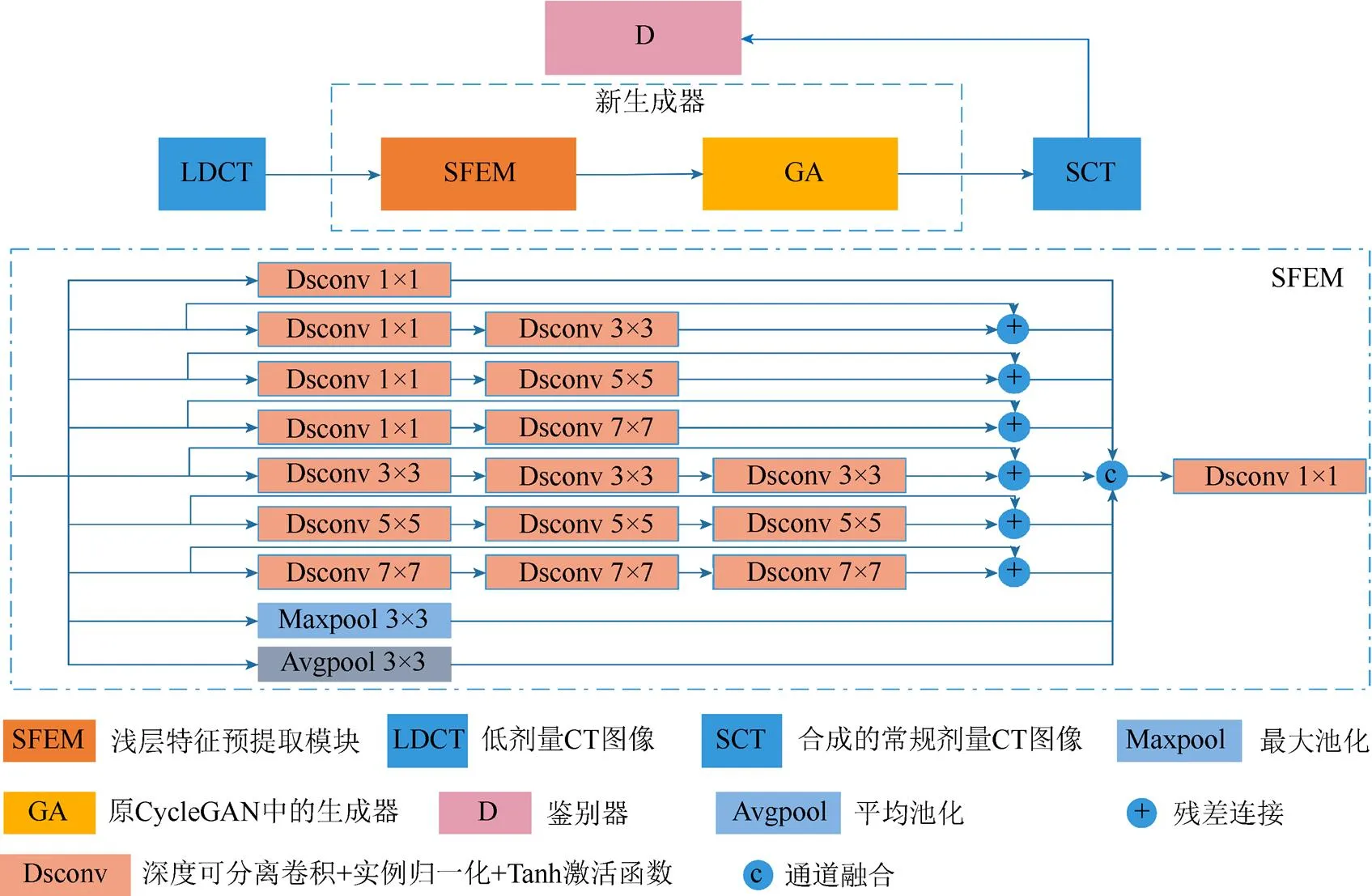

1.3.2 浅层特征预提取模块

通常情况下,自然图像的数据类型为8位无符号整型,而医学CT图像的数据类型为16位有符号整型(数据预处理后为32位有符号浮点型)。面向自然图像的CycleGAN直接用于医学CT图像增强,会因为网络提取的医学影像特征不足,导致丢失反应病灶细节的部分信息。浅层特征预提取模块(shallow feature pre-extraction module,SFEM)可提取含有丰富语义信息的图像特征,在生成常规剂量CT图像的生成器前添加该模块,可增强网络对CT图像特征的提取能力,保留图像中反应结构细节的信息。

浅层特征预提取模块由7条卷积核尺寸(逐通道卷积中卷积核的尺寸)和卷积层数目均不相同的DSC支路,及2条不同的池化支路组成,为避免网络深度增加导致梯度消失,除第1条以外的其余6条DSC支路中采用残差连接。将各支路提取到的多层次浅层特征在通道维度上连接并进行信息融合,最终输入CycleGAN的生成器,如图4所示。

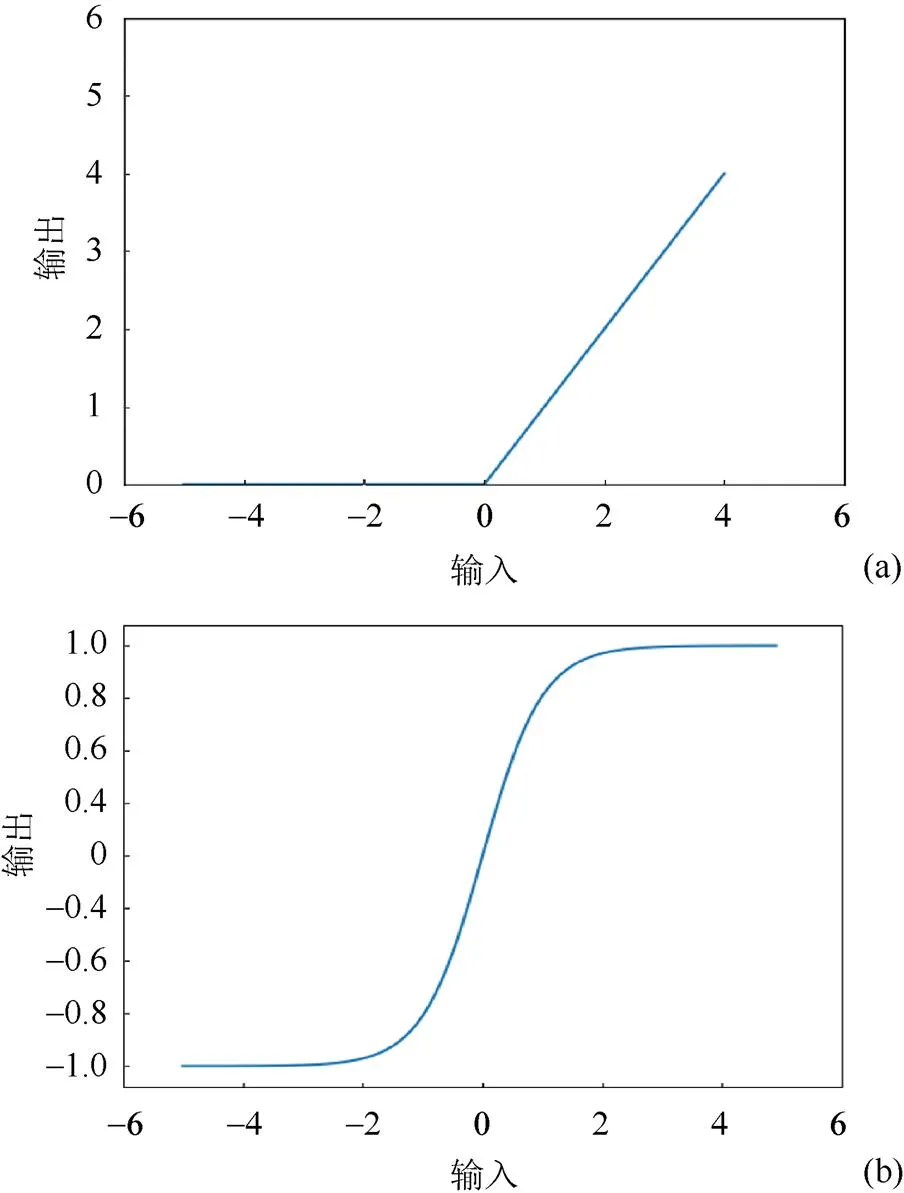

1.3.3 激活函数调整

原生成器中的部分激活函数是ReLu (图5(a)),会导致值域为(-1,0)的数据丢失。因此,本文将原网络中的ReLu激活函数均替换成Tanh激活函数(图5(b))。

图4 浅层特征预提取模块

图5 ReLu激活函数曲线和Tanh激活函数曲线((a) ReLu激活函数曲线;(b) Tanh激活函数曲线)

1.4 图像质量评价指标

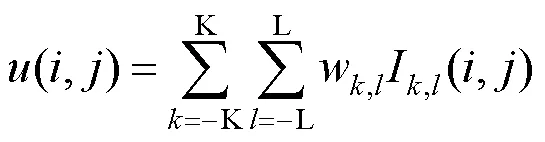

通常情况下,生成图像的质量评价指标是峰值信噪比(peak signal-to-noise ratio,PSNR)和结构相似度(structural similarity,SSIM),但二者均依赖配对数据进行计算,不适用于本研究中非配对数据的生成图像评价。感知图像质量评价指标(perception-based image quality evaluator,PIQE)是VENKATANATH等[23]提出的一种基于人类视觉的无参考自然图像评价指标,其充分考虑了局部噪声和显著失真对整体图像质量的影响,具有客观性强、适应性好等优点。而CT图像中的局部噪声和伪影有时会严重影响临床医生的准确诊断,因此本研究引入PIQE定量评估生成CT图像质量,其计算过程可分为6步:

(1) 计算亮度图像的去均值对比度归一化(mean subtracted contrast normalized,MSCN)系数矩阵,即

其中

式(6)中,(,)为自然图像对应的亮度图像;C为常数1;(,)和(,)分别为亮度图像(,)经高斯滤波后得到的加权均值图像和加权标准差图像。式(7)中,,和分别代表自然图像红、绿、蓝3通道。式(8)和式(9)中,K和L均为常数3;为滤波核为7×7像素的高斯滤波函数。由于CT图像为灰度图像,故PIQE计算过程中所涉及到图像的亮度值均由灰度值代替。

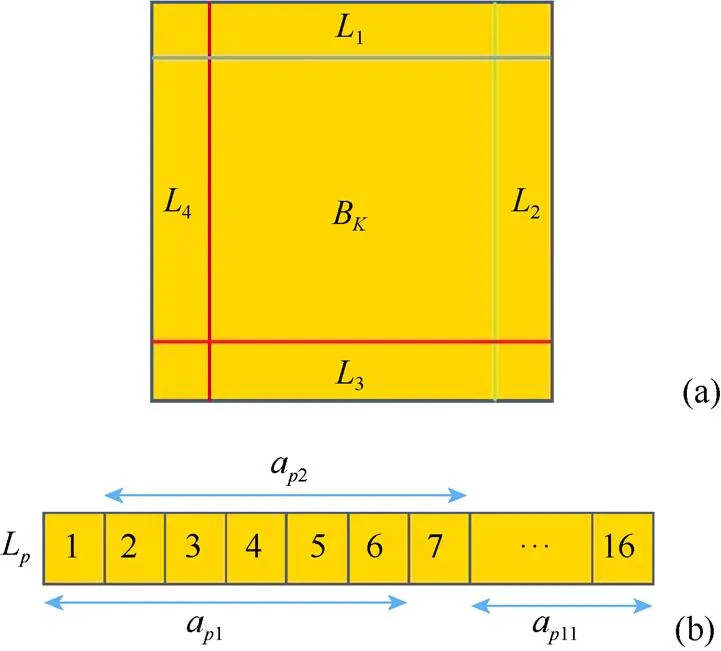

(2) 将图像尺寸分为16×16像素的多个不重叠块,每个块在MSCN系数矩阵上对应相同尺寸的区域记为B,如图6所示。

图6 多个不重叠块((a)图像;(b) MSCN系数矩阵)

块可分为均匀(uniform,U)块或空间活跃(spatially active,SA)块,即

其中,为块的类别;TU为常数0.1;为块在MSCN系数矩阵上对应区域B的方差。

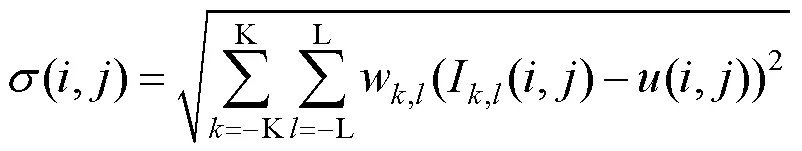

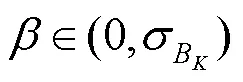

(3) 判断块是否存在显著失真。块对应的B的4条边(L;Î1,2,3,4)均被错位分成11段(a1,a2,a3,···;Î1,2,3,4),每段长度均为6个像素,彼此错位1个像素,如图7所示。

如果B的4条边中存在任何一段的标准差小于阈值0.1,则表明该B对应的块存在显著失真,即

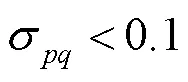

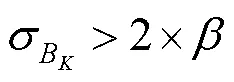

(4) 判断块是否存在噪声。块对应的B以中心线对称,尺寸为2×16像素的中心区域(S)和尺寸为14×16像素的外围区域(S),如图8所示。

图7 判断空间活跃块是否存在显著失真((a) BK和BK的4条边;(b)将每条边错位分成11段)

图8 BK的中心区域和外围区域

计算整体区域B、中心区域S、外围区域S之间数据分布的相似程度为

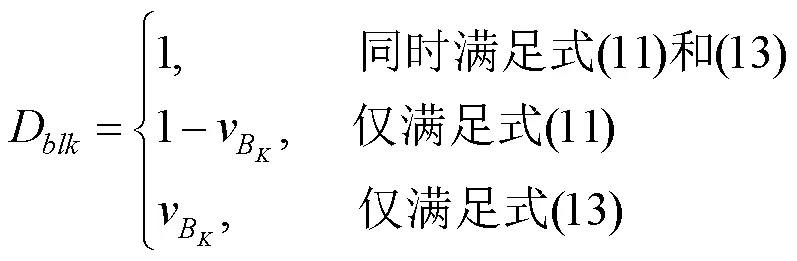

(5) 根据的失真类型(显著失真和噪声),计算其质量分数为

(6) 通过所有的质量分数D,评估整张图像的质量,即

其中,C1为常数1;N为的数量。值越大为图像质量越差。

2 实验和结果

2.1 实现环境及参数设置

使用深度学习框架PyTorch实现所提出的网络架构。实验设备为装有Nvidia GeForce 2080Ti GPU的Dell P5820X工作站,操作系统为Ubuntu 16.04 LTS。

2.2 实验结果

2.2.1 定量评价

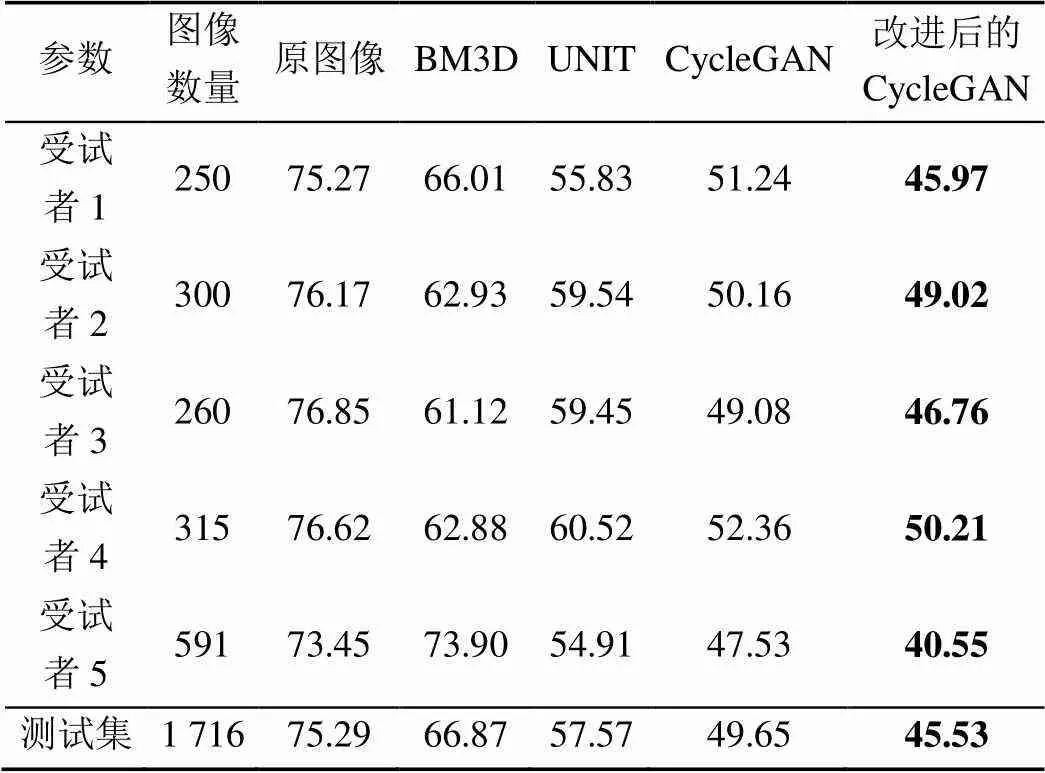

分别采用传统方法BM3D、深度学习方法UNIT,CycleGAN和改进后的CycleGAN对测试集中5位受试者的1 716张低剂量CT图像进行增强(深度学习网络生成的常规剂量CT图像视为增强结果),并计算各增强后图像的PIQE。此后,以受试者为单位求平均PIQE,结果见表1。

表1 低剂量CT图像增强前后的平均PIQE

注:加粗数据为同行中最小的PIQE

表1中,与原图像相比,经BM3D增强后,受试者1~4的平均PIQE均大幅减小,但受试者5的平均PIQE小幅增大。这表明,传统方法BM3D对低剂量CT图像具有一定的增强效果,但稳定性较差。经UNIT,CycleGAN和改进后的CycleGAN增强后,所有受试者的平均PIQE均大幅减小,且减小幅度依次提升。这表明,深度学习方法UNIT,CycleGAN和改进后的CycleGAN对低剂量CT图像的增强效果均优于传统方法BM3D且性能依次提高,稳定性好。此外,在整个测试集上,改进后的CycleGAN的平均PIQE由CycleGAN的49.65降低为45.53,降幅达8.3%,更远低于BM3D的31.9%和UNIT的20.9%,验证了本文改进方法的有效性。

2.2.2 定性评价

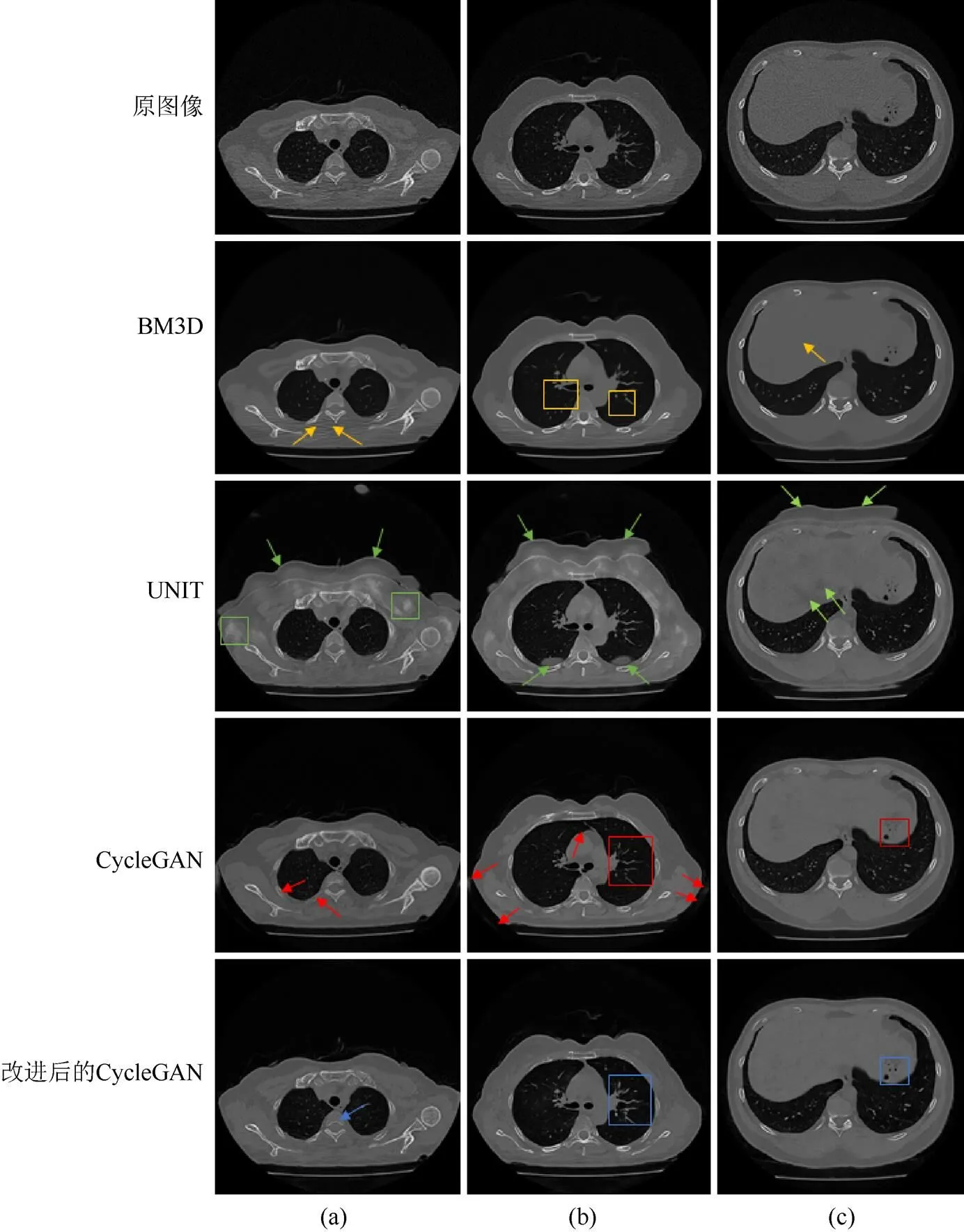

观察4种方法增强结果后发现,虽然原图像中的噪声和伪影得到了抑制,但是部分图像存在新伪影引入、结构细节丢失和灰度值改变的问题。为此,本文采用主观对比方式对增强图像进行定性评价。由于骨组织、肺组织、软组织是胸腹部CT筛查的重要依据,因此从伪影抑制、结构完整性、灰度值保持3个方面,重点考察增强图像中这3类组织的增强效果,从而主观评价各方法的性能。图9为选取的3张可显著表现这3种组织的对比图像。

图9(a)为骨组织,BM3D的增强图像中,下侧骨组织周围仍存在大量条纹状伪影(黄箭)。UNIT的增强图像中,骨组织周围出现了大量白色斑状伪影(绿框);胸廓上侧出现了带状伪影(绿箭)。CycleGAN的增强图像中,部分骨组织灰度值降低甚至难以识别(红箭)。改进后的CycleGAN的增强图像中,骨组织灰度值虽然轻微降低,但是结构完整且边界清晰(蓝箭)。

图9(b)为肺组织,BM3D中的肺组织结构丢失严重(黄框)。UNIT中的肺腔下侧出现了2个扁圆状伪影、胸廓上侧出现了带状伪影(绿箭)。CycleGAN中的肺组织结构完整(红框),但位于肺腔上侧的软组织丢失了少量结构信息并且胸廓两侧出现了条状伪影(红箭)。改进后的CycleGAN中的肺组织增强效果显著(蓝框)。

图9(c)为软组织,BM3D中的软组织平滑严重,纹理丢失(黄箭)。UNIT中的软组织中出现了多个暗色伪影、胸廓上侧出现带状伪影(绿箭)。CycleGAN中的软组织伪影抑制良好,但部分空洞丢失(红框)。改进后的CycleGAN的软组织空洞保持完整(蓝框)。

主观对比所有受试者的测试结果发现,BM3D过度平滑了图像,导致结构和纹理丢失,有时不能完全去除原始图像中条纹状伪影;UNIT则引入了大量伪影;CycleGAN虽然对各组织均有增强效果,但是会降低部分骨组织灰度值、丢失部分软组织信息、在图像边缘引入少量伪影;改进后的CycleGAN对各组织均有显著增强效果,在伪影抑制、结构完整性、灰度值保持3方面均有所提升。

图9 4种低剂量CT图像增强方法效果对比((a)骨组织;(b)肺组织;(c)软组织)

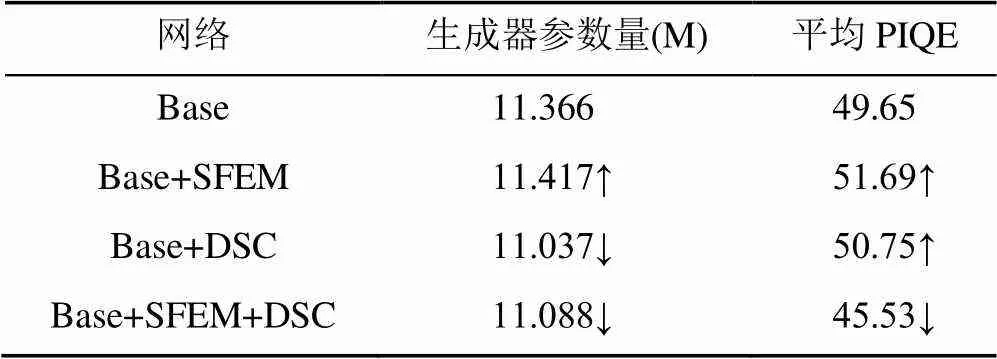

2.2.3 消融实验

为了进一步验证本文改进网络的有效性,分别对浅层特征预提取模块和深度可分离卷积进行消融实验。将CycleGAN记为Base,CycleGAN生成器中添加浅层特征预提取模块记为Base+SFEM,CycleGAN生成器中部分普通卷积替换为DSC记为Base+DSC,CycleGAN生成器中添加浅层特征预提取模块且部分普通卷积替换为DSC记为Base+SFEM+DSC (即本文改进网络)。

采用与上文中相同的数据和参数对4种网络进行训练和测试,在训练阶段记录生成器的参数量,并在测试后计算增强图像的平均PIQE,结果见表2。

表2 4种网络增强效果定量比较

注:Base=CycleGAN;SFEM=浅层特征预提取模块;DSC=深度可分离卷积;M=百万

表2中,与Base相比,Base+SFEM的生成器参数量有所增加,增强图像的平均PIQE增大,表明生成器添加SFEM会引入额外的参数量,不利于网络训练,降低了网络对低剂量CT图像中噪声及伪影的抑制能力。Base+DSC的生成器参数量大幅减少,但增强图像的平均PIQE依旧增大,说明DSC可有效降低生成器参数量,便于网络训练,但由于其在空间和通道上的交互更为稀疏,使网络对图像的特征提取能力不强,限制了网络对低剂量CT图像中噪声及伪影的抑制效果。Base+ SFEM+DSC的参数量减少,增强图像的平均PIQE减小,表明SFEM与DSC相结合,在提取丰富语义信息的同时有效降低网络参数量,进而提升网络对低剂量CT图像噪声及伪影的抑制能力。

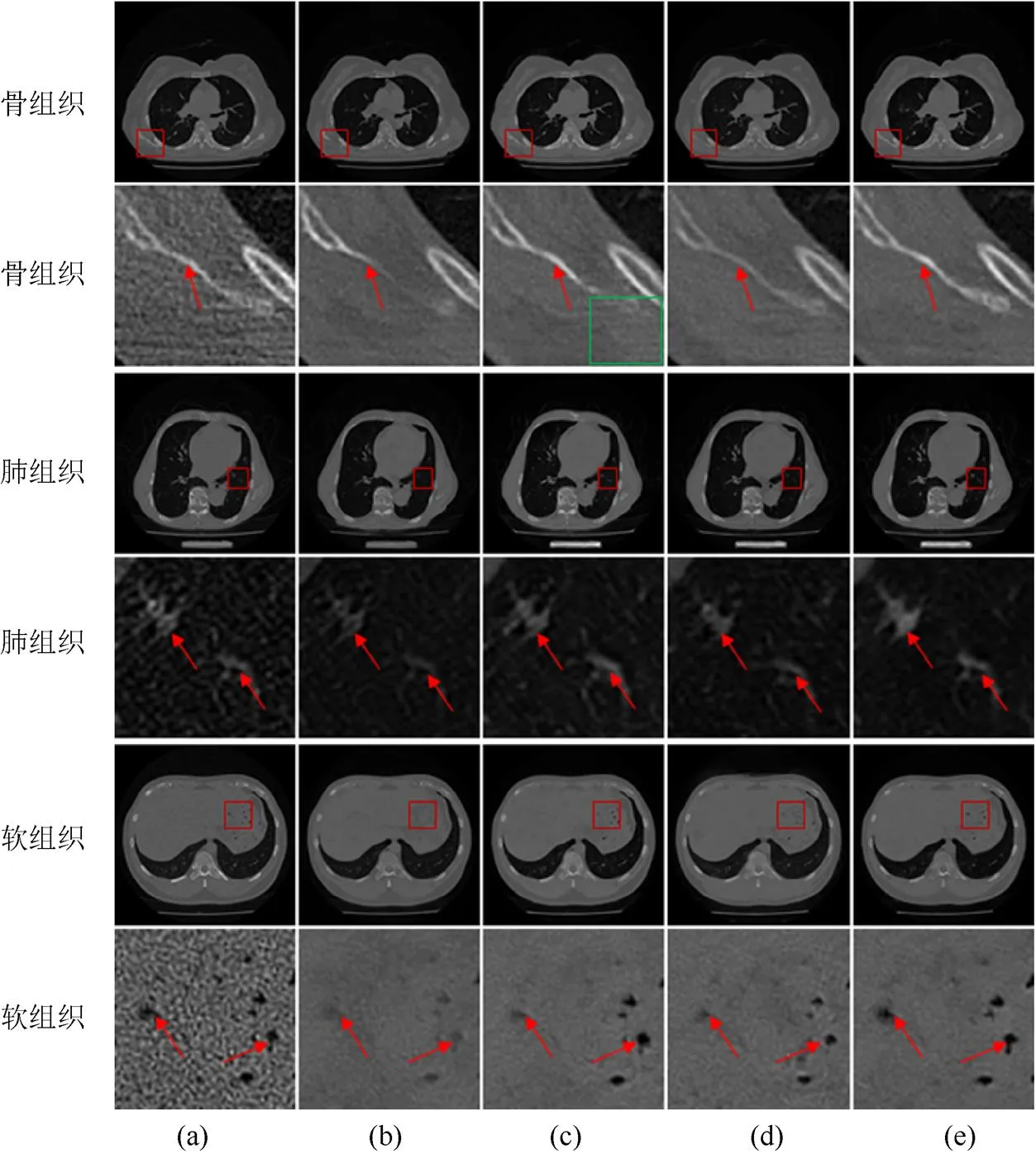

为了直观说明SFEM和DSC相结合的必要性,从实验结果中选取3张分别对应骨组织(第1,2行)、肺组织(第3,4行)和软组织(第5,6行)的切片及其ROI放大图,如图10所示,主观评价基础网络及模块组合网络对低剂量CT图像的增强效果。

图10中,4种网络对低剂量CT图像中的噪声均有较好的抑制效果,但在骨组织、肺组织及软组织保持方面存在差异。与原图相比,Base的增强图像中部分骨组织丢失,肺组织灰度值下降,软组织空洞对比度降低或丢失,表明Base对3种组织的特征提取能力不足;与Base结果相比,Base+SFEM的增强图像中骨组织、肺组织及软组织空洞的对比度及轮廓均保持较好,仅部分骨组织周围仍存在伪影,如图10(c)绿框所示,表明SFEM增强了Base架构保持组织结构细节的能力,但降低了其抑制伪影的能力;而Base+DSC的增强图像中骨组织丢失严重,肺组织灰度值下降明显,软组织空洞对比度上升,以上表明DSC减弱了网络对骨组织及肺组织的特征提取能力;相比上述3种网络,Base+SFEM+DSC的增强图像中骨组织、肺组织、软组织结构均保持完整,未发生组织信息丢失,且骨组织周围伪影抑制效果较好,表明SFEM和DSC相结合的策略在组织结构细节保持和伪影抑制两方面做到了较好的平衡。

以上消融实验结果表明,SFEM虽然能增强网络对骨、肺及其软组织的保持能力,但会限制网络的去伪影效果。DSC虽然能降低网络的参数量,但相比普通卷积,对图像的特征提取能力不足,导致网络对图像中的骨、肺及其软组织的保持能力下降。单独使用SFEM和DSC均不能有效保留图像中的结构细节信息,而SFEM和DSC的结合,可在提取丰富语义信息的同时,有效降低网络参数量,提升网络对医学图像的特征提取能力,从而增强网络对低剂量CT图像中伪影和噪声的抑制能力,并保留图中的结构细节信息。

图10 基础网络及模块组合网络实验结果主观对比

3 结 论

本文基于CycleGAN改进的低剂量CT图像增强网络,利用DSC替换CycleGAN生成器中部分普通卷积,减少网络参数,降低训练过程中的显存占用,并在生成常规剂量CT图像的生成器中添加SFEM,利用不同的支路提取不同的浅层特征信息,并进行融合,以此增强生成器对CT图像特征的提取能力,从而生成高质量的CT图像。实验结果表明,本文网络在骨组织灰度值保持、肺组织信号增强、伪影抑制等方面的主观评价均优于BM3D,UNIT和CycleGAN,并且该网络生成的常规剂量CT图像的平均PIQE下降到了45.53,而其余3种方法中增强效果最好的CycleGAN生成的常规剂量CT图像的平均PIQE仅下降到了49.65,因此本文网络是一种性能优越,具有潜在临床应用前景的低剂量CT图像增强网络。

[1] MANDUCA A, YU L F, TRZASKO J D, et al. Projection space denoising with bilateral filtering and CT noise modeling for dose reduction in CT[J]. Medical Physics, 2009, 36(11): 4911-4919.

[2] HSIEH J. Adaptive streak artifact reduction in computed tomography resulting from excessive X-ray photon noise[J]. Medical Physics, 1998, 25(11): 2139-2147.

[3] KACHELRIESS M, WATZKE O, KALENDER W A. Generalized multi-dimensional adaptive filtering for conventional and spiral single-slice, multi-slice, and cone-beam CT[J]. Medical Physics, 2001, 28(4): 475-490.

[4] XU Q, YU H Y, MOU X Q, et al. Low-dose X-ray CT reconstruction via dictionary learning[J]. IEEE Transactions on Medical Imaging, 2012, 31(9): 1682-1697.

[5] ZHANG Y, ZHANG W H, LEI Y J, et al. Few-view image reconstruction with fractional-order total variation[J]. Journal of the Optical Society of America A, 2014, 31(5): 981-995.

[6] ZHANG H, ZENG D, ZHANG H, et al. Applications of nonlocal means algorithm in low-dose X-ray CT image processing and reconstruction: a review[J]. Medical Physics, 2017, 44(3): 1168-1185.

[7] ZHAO T T, HOFFMAN J, MCNITT-GRAY M, et al. Ultra-low-dose CT image denoising using modified BM3D scheme tailored to data statistics[J]. Medical Physics, 2019, 46(1): 190-198.

[8] 黄凯奇, 赵鑫, 李乔哲, 等. 视觉图灵: 从人机对抗看计算机视觉下一步发展[J]. 图学学报, 2021, 42(3): 339-348.

HUANG K Q, ZHAO X, LI Q Z, et al. Visual Turing: the next development of computer vision in the view of human-computer gaming[J]. Journal of Graphics, 2021, 42(3): 339-348 (in Chinese).

[9] 林晓, 屈时操, 黄伟, 等. 显著区域保留的图像风格迁移算法[J]. 图学学报, 2021, 42(2): 190-197.

LIN X, QU S C, HUANG W, et al. Style transfer algorithm for salient region preservation[J]. Journal of Graphics, 2021, 42(2): 190-197 (in Chinese).

[10] 任好盼, 王文明, 危德健, 等. 基于高分辨率网络的人体姿态估计方法[J]. 图学学报, 2021, 42(3): 432-438.

REN H P, WANG W M, WEI D J, et al. Human pose estimation based on high-resolution net[J]. Journal of Graphics, 2021, 42(3): 432-438 (in Chinese).

[11] 李彬, 王平, 赵思逸. 基于双重注意力机制的图像超分辨重建算法[J]. 图学学报, 2021, 42(2): 206-215.

LI B, WANG P, ZHAO S Y. Image super-resolution reconstruction based on dual attention mechanism[J]. Journal of Graphics, 2021, 42(2): 206-215 (in Chinese).

[12] HUANG Z X, CHEN Z X, CHEN J C, et al. DaNet: dose-aware network embedded with dose-level estimation for low-dose CT imaging[J]. Physics in Medicine and Biology, 2021, 66(1): 015005.

[13] CHEN H, ZHANG Y, KALRA M K, et al. Low-dose CT with a residual encoder-decoder convolutional neural network[J]. IEEE Transactions on Medical Imaging, 2017, 36(12): 2524-2535.

[14] LI M, HSU W, XIE X D, et al. SACNN: self-attention convolutional neural network for low-dose CT denoising with self-supervised perceptual loss network[J]. IEEE Transactions on Medical Imaging, 2020, 39(7): 2289-2301.

[15] 周博超, 韩雨男, 桂志国, 等. 基于VGG网络和深层字典的低剂量CT图像去噪算法[EB/OL]. [2022-02-10]. http:// www.ecice06.com/CN/10.19678/j.issn.1000-3428.0060582.

ZHOU B C, HAN Y N, GUI Z G, et al. Low-dose CT image denoising algorithm based on VGG network and deep dictionary[EB/OL]. [2022-02-10]. http://www.ecice06.com/ CN/10.19678/j.issn.1000-3428.0060582 (in Chinese).

[16] LIU M Y, BREUEL T, KAUTZ J. Unsupervised image- to-image translation networks[EB/OL]. [2022-01-10]. https:// arxiv.org/abs/1703.00848v1.

[17] ZHU J Y, PARK T, ISOLA P, et al. Unpaired image-to-image translation using cycle-consistent adversarial networks[C]// 2017 IEEE International Conference on Computer Vision. New York: IEEE Press, 2017: 2223-2232.

[18] LEE H Y, TSENG H Y, MAO Q, et al. DRIT++: diverse image-to-image translation via disentangled representations[J]. International Journal of Computer Vision, 2020, 128(10-11): 2402-2417.

[19] HUANG X, LIU M Y, BELONGIE S, et al. Multimodal unsupervised image-to-image translation[C]//The 15th European Conference on Computer Vision. Heidelberg: Springer, 2018: 172-189.

[20] 朱斯琪, 王珏, 蔡玉芳. 基于改进型循环一致性生成对抗网络的低剂量CT去噪算法[J]. 光学学报, 2020, 40(22): 70-78.

ZHU S Q, WANG J, CAI Y F. Low-dose CT denoising algorithm based on improved Cycle GAN[J]. Acta Optica Sinica, 2020, 40(22): 70-78 (in Chinese).

[21] TANG C, LI J, WANG L Y, et al. Unpaired low-dose CT denoising network based on cycle-consistent generative adversarial network with prior image information[J]. Computational and Mathematical Methods in Medicine, 2019(12): 1-11.

[22] HOWARD A G, ZHU M L, CHEN B, et al. MobileNets: efficient convolutional neural networks for mobile vision applications[EB/OL]. [2021-12-20]. https://arxiv.org/abs/1704. 04861.

[23] VENKATANATH N, PRANEETH D, BH M C, et al. Blind image quality evaluation using perception based features[C]// 2015 21st National Conference on Communications. New York: IEEE Press, 2015: 1-6.

An improved low-dose CT image enhancement network based on CycleGAN

LIAO Shi-min1,2, LIU Yang-chuan2, ZHU Ye-chen2, WANG Yan-ling3, GAO Xin1,2

(1. School of Medical Imaging, Xuzhou Medical University, Xuzhou Jiangsu 221004, China; 2. Medical Imaging Department, Suzhou Institute of Biomedical Engineering and Technology, Chinese Academy of Sciences, Suzhou Jiangsu 215163, China; 3.Department of Radiology, the People’s Hospital of Suzhou New District, Suzhou Jiangsu 215129, China)

Low-dose CT is an effective and relatively safe screening method for thoracic and abdominal diseases, but the artifacts and noise in the image will seriously affect the doctor’s diagnosis. Network training in image enhancement methods based on deep learning mostly relies on paired data that is pixel-level matched low-dose and conventional-dose CT images at the same site of the same patient. An improved low-dose CT image enhancement network based on the cycle-consistent generative adversarial network (CycleGAN) was proposed for unpaired data. A shallow feature pre-extraction module was added in front of the generator to enhance the capability to extract CT images features. In addition, the depthwise separable convolution was used to replace some common convolutions in the generator to decrease network parameters and reduce GPU memory usage. In the proposed network, a total of 3 275 two-dimensional low-dose CT slices and a total of 2 790 two-dimensional unpaired conventional-dose CT slices were used for training, and a total of 1 716 two-dimensional low-dose CT slices were employed for testing. The results show that the averaged perception-based image quality evaluator (PIQE) of CT images generated by the network is 45.53, which is 8.3% lower than that of CycleGAN, 31.9% lower than that of Block-Matching and 3D filtering (BM3D), and 20.9% lower than that of unsupervised image translation network (UNIT). Moreover, the proposed network can produce better subjective visual effects in terms of structural detail preservation, noise and artifact suppression. This shows that the network is a low-dose CT image enhancement method with potential clinical prospects.

low-dose CT; image enhancement; deep learning; unpaired data; cycle-consistent generative adversarial network

30 December,2021;

National Natural Science Foundation of China (81871439, 61801475); Suzhou Institute of Biomedical Engineering and Technology (CAS) Planned Project (Y95K091K05)

LIAO Shi-min (1997–), master student. His main research interest covers medical image processing. E-mail:1255567784@qq.com

TP 391

10.11996/JG.j.2095-302X.2022040570

A

2095-302X(2022)04-0570-10

2021-12-30;

2022-02-16

16 February,2022

国家自然科学基金项目(81871439,61801475);中科院苏州医工所自主部署项目(Y95K091K05)

廖仕敏(1997–),男,硕士研究生。主要研究方向为医学图像处理。E-mail:1255567784@qq.com

高 欣(1975–),男,研究员,博士。主要研究方向为低剂量锥束CT、基于智能计算的精准医疗、手术导航及机器人。E-mail:xingaosam@163.com

GAO Xin (1975–), researcher, Ph.D. His main research interests cover low-dose cone-beam CT, precision medicine based on intelligent computing, surgical navigation and robot. E-mail:xingaosam@163.com