基于改进蚁群算法的行人运动特征跟踪提取方法

潘 云 磊

(芜湖职业技术学院体育教学部,安徽 芜湖 241000)

道路上的车辆数量呈现直线上升趋势,加大了交通管制的难度,对行人安全也产生了极大的威胁。视觉图像系统主要构成部分为行人运动特征提取与跟踪,能够在图像序列中提取行人运动特征,以此为基础,可以确定行人的位置、大小等信息,帮助车辆规避行人,帮助指挥人员精准调度交通流,保障行人的安全。

国外对视频图像处理的研究较早,主要通过背景减除法提取行人运动特征,与对应的背景图像进行匹配,从而发现行人目标,并利用行人运动特征提取、分析与理解过程,更好地保护行人安全。目前,国内视频图像相关研究水平不高,缺少可靠、先进的行人运动特征跟踪提取方法,文献[1]利用基于高斯混合模型的背景消减法提取运动目标前景,实现复杂场景中多行人运动目标的检测和跟踪,对画面中的人数进行实时统计和更新,准确地检测和追踪多行人运动目标。文献[2]改进相似性分数计算方法,提取基于多信息融合的多目标跟踪方法,更好地处理目标遮挡、目标误检及目标丢失等情况。

本文提出了一种基于改进蚁群算法的行人运动特征跟踪提取方法,计算运动特征数据关联矩阵,确定正确的行人观测数据,针对多目标行人运动特征跟踪的数据关联问题,改进蚁群算法,提高行人运动特征跟踪提取的精度,为行人安全提供更有效的保障。

1 行人运动特征跟踪提取方法研究

1.1 行人运动目标检测

以道路监控视频作为研究对象,提取视频图像序列中的目标区域,检测行人运动目标,以此提升行人运动特征提取精度[3]。

首先,构建视频图像背景模型。设置行人运动视频图像序列为n帧,在图像相同位置(x,y)处采集灰度值,构成灰度值序列为{Pi(x,y),i=1,2,…,n}。 对应于该位置的图像背景模型,由n帧灰度值序列的中间值表示,其表达式为

B(x,y)=Median(Pi(x,y))

(1)

式(1)中,B(x,y)表示图像背景像素点(x,y)的灰度值,Median(·)表示中间值提取函数。

然后,检测行人运动目标,其原理为对视频图像帧进行差分运算,结果为前景图像(不含背景)。差分运算公式为

dc(x,y)=|fc(x,y)-B(x,y)|

(2)

式(2)中,dc(x,y)表示前景图像,fc(x,y)表示当前视频图像帧。

最后,对公式(2)结果dc(x,y)进行二值化分割处理,获取行人运动目标。选取适当的分割阈值T,则处理结果为

(3)

通过上述过程即可获得行人运动目标的检测结果,如图1所示。

图1 行人运动目标检测结果示例

1.2 行人运动特征提取

行人运动特征提取是目标跟踪的核心环节,包含静态特征与动态特征,分别对应的是行人轮廓特征与肢体关节角度特征,具体提取过程如下:

行人轮廓特征具备唯一性与整体性,能够在整体上描述行人的运动状态,表征特定的行人身份。视频图像中,行人轮廓线是二维的,因此,此研究利用7个Hu不变矩表示行人轮廓特征[4]。不变矩具备尺度、平移、旋转等不变性,计算公式逐渐复杂,其表达式为

(4)

式(4)中,φ1、φ2、φ3、φ4、φ5、φ6与φ7表示7个不变矩,ηpq表示视频图像(p+q)阶的中心距。

在视频图像中,行人的肢体形状会随着时间发生变化[5]。

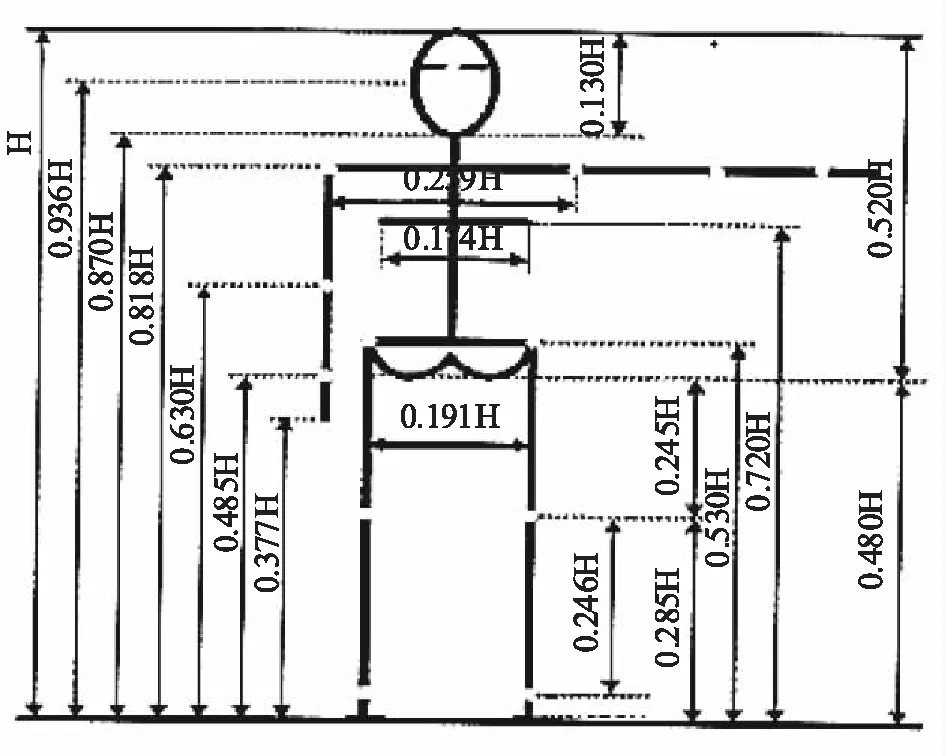

行人运动时关节点的角度能够表征行人特有的行走姿态,故选取肢体关节角度特征作为行人运动特征之一,表征行人运动的动态信息[6]。设行人直立时两脚站立位置为水平基线,行人身高记为H,基于生物解剖学原理对人类肢体比例关系进行确定(图2)。

图2 人类肢体比例关系示意

如图2所示,依据肢体比例关系,结合人体行走运动的几何特征,定位12个肢体关节点位置,分别为踝关节(左/右)、膝关节(左/右)、髋关节、腕关节(左/右)、肘关节(左/右)、肩关节(左/右)与颈关节[7]。对肢体关节角度进行统一计算,计算公式为

(5)

式(5)中,θ表示角度;(x1,y1)与(x2,y2)表示任意2个关节点的位置坐标。

通过公式(5)计算每个肢体关节角度(共9个),将其进行整合获得肢体关节角度特征矢量为[θ1,θ2,θ3,θ4,θ5,θ6,θ7,θ8,θ9]′[8]。

1.3 多行人运动目标特征数据关联

一般情况下,一幅道路监控视频图像可能包含多个行人运动目标,提取的运动特征也是多个行人运动目标特征,容易出现特征与运动目标之间的伪相关现象,这给行人运动特征的跟踪和提取带来了很大的困难[9]。为了解决上述问题,引入了改进的蚁群算法解决多人运动目标特征数据关联问题。

基于改进蚁群算法的原理,假设行人运动目标在某一时刻最多生成一组特征数据。同时,一组特征数据最多只能与一个运动对象相关联。当行人运动目标进入观察区域时,蚁群算法开始执行第一个循环,通过搜索和迭代找到最短路径,直到行人运动目标离开观察区域[10]。

通过上述描述确定多行人运动目标特征数据关联步骤如下:

步骤1:当获得行人运动特征数据后,将k只蚂蚁放置在行人运动轨迹上,轨迹数量记为M,同时开启轨迹-运动特征关联对;

步骤2:蚂蚁r以转移概率p对行人运动特征进行选择。与此同时,设置禁忌表tabuk与临时池temppool(k), 采用tabuk记录蚂蚁k已经选好的轨迹-运动特征关联对, 应用temppool(k)保存蚂蚁k选好的概率值[11]。其中,转移概率计算公式为

(6)

式(6)中,α表示信息素量τij的权重参数;β表示能见度参数ηij的权重参数,由1/dij计算获得,其中,dij表示多个行人中某一个轨迹-运动特征关联对(i,j)的距离。

步骤3:在路径寻优过程中,种群蚂蚁会实时留下信息素量τij,为了防止某条路径(关联对(i,j))信息素量极速增加,导致算法陷入局部最优情况,设置初始最大和最小信息素量分别为τmax,τmin,τij取值范围为[τmin,τmax];

步骤4:在选择路径过程中[12],基于局部更新规则对信息素量进行更新。路径选择结束后[13],信息素量更新规则改为全局更新规则。全局更新规则表达式为

(7)

式(7)中,ρ表示信息素量更新系数,(1-ρ)表示信息素量残留系数,Δτij表示根据σ-1只优秀蚂蚁路径长短排序信息对(i,j)路径信息素量进行更新,其计算公式为

(8)

步骤5:当确定关联矩阵后,对全部轨迹-运动特征关联对信息进行记录,获得正确的多行人运动目标特征数据关联结果。

1.4 行人运动目标跟踪

根据上述获得的多行人运行目标特征数据关联结果,选取Mean Shift算法跟踪行人运动目标,并依据1.2节,提取运动特征,最终完成行人运动特征的跟踪提取[15]。

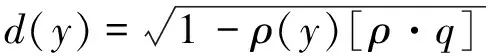

行人运动目标跟踪主要通过每帧图像目标模型的相似度实现,其由Bhattacharyya函数计算所得。首先,将目标模型记为p,将候选模型记为q,以其之间距离作为相似度的判断依据,距离计算公式为

(9)

式(9)中,d(y)表示目标模型与候选模型之间的距离,ρ(y)表示目标模型与候选模型采样点的Bhattacharyya系数估计数值,取值范围为[0,1]。

为了简化Bhattacharyya系数的估计过程[16],采用单位向量之间的夹角余弦值表示Bhattacharyya系数,估算公式为

(10)

由公式(10)可以看出,2个单位向量夹角余弦值越小,表明ρ(y)越大,距离d(y)越小,p与q相似度越高,两者为同一行人运动目标的可能性越大。

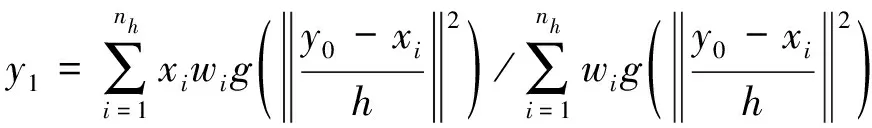

行人运动目标跟踪完成后,需要在不同帧图像中准确定位行人运动目标的位置,以便有效地提取行人运动特征。行人运动目标定位的原理:以当前帧图像中目标的中心为起始位置y0,在其邻域内搜索目标,搜索停止条件是Bhattacharyya系数达到最大,此时可以得到行人运动目标的最佳位置[17]。

由上述分析可知,要想对行人运动目标位置定位,首先获得当前帧y0处候选模型的运动特征分布概率,记为pu(y), 再对公式(10)进行Taylor展开,以此为基础,结合以y0为中心的均值漂移向量mh,G(y0), 通过递归迭代得到行人运动目标的位置,其表达式为

(11)

式(11)中,wi表示权值,h表示搜索步长。

在行人运动目标位置定位后,提取行人运动特征,实现了行人运动特征的跟踪提取,为路上行人安全提供更加有效的保证。

2 实例分析与结果分析

2.1 实例分析准备

在道路监控视频中随机截选一段视频作为实例分析对象,对行人运动特征进行跟踪提取。在每次实例分析过程中,采用VC++6.0平台,图像尺寸为320×240(pixels),频率为每秒15帧。

实例分析对象——视频图像序列共为120帧,如图3所示。

图3 实例分析对象示例

2.2 实例分析结果分析

以上述选取的实例分析对象为基础,构建行人运动目标状态方程,表达式为

xi,t=Ai,t-1xi,t-1+Γωt

(12)

式(12)中,Ai,t-1表示行人运动目标状态转移矩阵,xi,t-1表示行人运动目标i在t-1时刻的状态,Γ表示过程噪声矩阵;ωt表示系统噪声。

公式(12)中,参数Ai,t-1与Γ计算公式为

(13)

式(13)中,T表示采样间隔,设置为1。

则行人运动目标观测方程表达式为

yi,t=Hi,txi,t+vt

(14)

式(14)中,Hi,t表示行人运动目标量测矩阵,vt表示量测噪声。

为了加快改进蚁群算法的收敛速度(如果蚁群种群数量过大,搜索时间会随之增加;蚁群种群数量过小,则无法获得最优路径),设定蚁群种群数量为k=30。在实例分析过程中,对实例分析对象进行10次采样,采用改进蚁群算法关联xi,t与yi,t获取的行人运动特征数据,其关联过程如1.3节所示,不对其进行再次的赘述,记录行人运动特征关联执行时间,见表1。

表1 行人运动特征关联执行时间表

如表1数据显示,应用提出方法后,行人运动特征关联执行时间范围为0.78~2.00 min,证明改进蚁群算法收敛速度较快,满足行人运动特征跟踪提取需求。

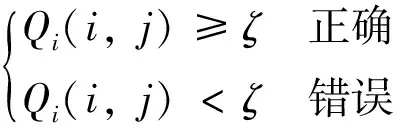

对获得的轨迹-运动特征关联对正确率进行判定,判定规则为

(15)

式(15)中,Qi(i,j)表示轨迹-运动特征关联对转换数值,ζ表示关联对正确率判定阈值。

依据公式(15)对轨迹-运动特征关联对正确率进行判定,判定结果如图4所示。

图4 关联对正确率判定结果示意

图4中,虚线表示的是行人运动特征关联对正确率的最低标准。应用提出方法后,关联对正确率范围为60%~96%,均大于最低标准限值,表明提出方法具备可行性与有效性。

3 结 论

应用改进蚁群算法对行人运动特征进行关联,以此降低行人运动特征的关联时间,提升关联对的正确率,获得更加精准的行人运动特征跟踪提取结果,为行人安全提供保障,也为交通指挥提供精准的数据支撑。