基于深度残差网络的服装图像检索

摘要:针对服装图像检索这一问题,用深度残差网络ResNet101作为骨干模型,并使用DeepFashion数据集中的子数据集Category and Attribute Prediction Benchmark中的图片作为研究对象。文中首先将服装图片进行处理后送入已经训练好的网络模型中得到服装图像特征,并建立服装特征库,然后将待检索的服装图片送入模型中得到图像特征,并与服装特征库中的特征进行相似度度量,最后按照相似度大小得到检索结果。实验结果表明,该方法可以得到比较完整的服装特征,具有较高的检索准确率。

关键词:深度学习;图像检索;度量学习;残差网络;积神经网络

中图分类号:TP183 文獻标识码:A

文章编号:1009-3044(2021)32-0087-02

Clothing Image Retrieval Based on Deep Residual Network

YAN Si-xue

(Hunan University of Technology, Zhuzhou 412007,China)

Abstract:In order to solve the problem of clothing image retrieval, the deep residual network Resnet101 is used as the backbone model, and the images in the Category and Attribute Prediction Benchmark, a sub-dataset of the DeepFashion dataset, are used as the research object. In this paper, first of all be incorporated into clothing pictures after processing has trained network model in the clothing image characteristics, and establish the clothing characteristic library, and then to retrieve the clothing pictures into the model of image characteristics, and with the clothing features in the library for a similarity measure, finally according to the size of similarity retrieval results are obtained. Experimental results show that this method can obtain more complete clothing features and has a high retrieval accuracy.

Key words: deep learning;image retrieval;metric learning;residual network;convolutional neural network

1引言

近年来,随着互联网的高速发展,电子商务进入了一个蓬勃发展的阶段,并且网络购物已经成为大多数人购买物品的第一选择,而服装作为电子商务的一个重要组成部分,产生了大量的服装图像,而想要在众多服装图像中选中自己喜欢的服装是一个十分棘手的难题。

为了解决这个难题,研究人员提出了两种解决办法:第一种解决办法是基于文本的图像检索方法(TBTR),第二种是基于内容的图像检索方法(CBIR)。基于文本的图像检索方法一般是以关键词或是以等级目录的形式查询图像。它是在以文本注释为基础的图像上进行图像检索。其主要过程是:首先,对图像建立相应的关键词或者是描述性的文字,其次,根据这些文字对图像进行特征抽取,建立相应的图像索引数据库,最后按照数据库管理,采用数据库管理方法。基于内容的图像检索方法是根据图像内容语义进行查找。其主要过程是先用软件对图像进行处理,得到图像特征,然后将图像特征进行处理,将其作为特征向量存入图像特征库中。在检索的过程中,先是对一张给定的图像进行处理,得到它的特征向量,然后将其与特征数据库的向量进行相似度度量,根据度量结果输出检索图像。

2相关工作

2.1服装图像检索

研究者们针对服装图像检索这一问题提出了很多解决方法。现在使用最多的是基于内容的服装图像检索。使用基于内容的服装图像检索主要解决两个问题,一是对服装图像提取特征,二是对服装图像特征进行相似度度量。现在比较流行的方法是提取服装图像的传统特征和使用深度学习来提取服装图像的深度特征。葛俊等[1]提出一种基于累加直方图与Hu不变矩加权特征和局部二值模式(LBP)的检索方法,董俊杰[2]使用方向梯度直方图(HOG)实现了服装图像检索系统,张腾等[3]使用颜色直方图(HSV)进行服装图像检索,肖行等[4]使用改进的LBP特征进行服装图像检索,陈双[5]对VGG-16模型引入哈希层后进行图像检索。包青平[6]等使用Tripletloss进行度量学习完成图像检索任务。何媛媛[7]等使用融合GoogleNet的多层特征并使用K-Means聚类算法进行图像检索。曾雄梅[8]通过融合感兴趣区域特征和深层特征来进行图像检索。相似性度量的目的是减少同类样本间的距离,增大不同类别之间的距离,目前主要是使用有监督学习方法,在卷积神经网络中引入的有监督度量学习,主要形成了Siamese结构和Triplet结构。Siamese结构是由两个共享权值的子神经网络组成,将两个输入分别送入子神经网络中得到输出,最后得出两个输出之间的距离。Triplet结构由三个共享权值的子网络组成,其中输入样本分别为参考样本,正样本和负样本组成,同与参考样本为类别的是正样本,与参考样本不同类别的为负样本,将样本分别送入子网络中得到输出特征,然后分别计算参考样本和正样本之间的距离,参考样本和负样本之间的距离。本文使用ResNet101网络模型提取服装特征,使用Triplet结构进行相似性度量。

2.2 深度残差网络

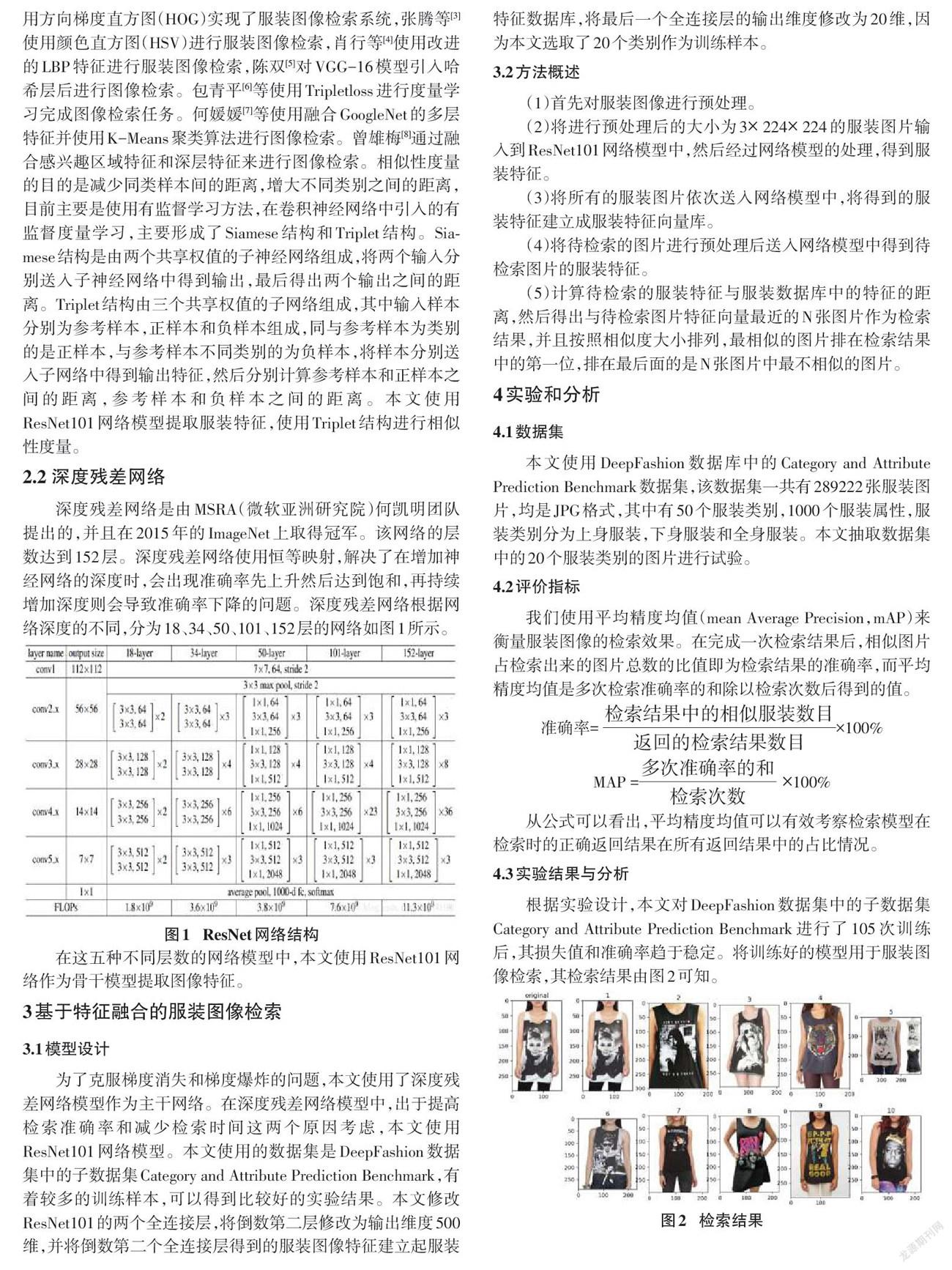

深度残差网络是由MSRA(微软亚洲研究院)何凯明团队提出的,并且在2015年的ImageNet上取得冠军。该网络的层数达到152层。深度残差网络使用恒等映射,解决了在增加神经网络的深度时,会出现准确率先上升然后达到饱和,再持续增加深度则会导致准确率下降的问题。深度残差网络根据网络深度的不同,分为18、34、50、101、152层的网络如图1所示。

在这五种不同层数的网络模型中,本文使用ResNet101网络作为骨干模型提取图像特征。

3基于特征融合的服装图像检索

3.1模型设计

为了克服梯度消失和梯度爆炸的问题,本文使用了深度残差网络模型作为主干网络。在深度残差网络模型中,出于提高检索准确率和减少检索时间这两个原因考虑,本文使用ResNet101网络模型。本文使用的数据集是DeepFashion数据集中的子数据集Category and Attribute Prediction Benchmark,有着较多的训练样本,可以得到比较好的实验结果。本文修改ResNet101的两个全连接层,将倒数第二层修改为输出维度500维,并将倒数第二个全连接层得到的服装图像特征建立起服装特征数据库,将最后一个全连接层的输出维度修改为20维,因为本文选取了20个类别作为训练样本。

3.2方法概述

(1)首先对服装图像进行预处理。

(2)将进行预处理后的大小为3[×] 224[×] 224的服装图片输入到ResNet101网络模型中,然后经过网络模型的处理,得到服装特征。

(3)将所有的服装图片依次送入网络模型中,将得到的服装特征建立成服装特征向量库。

(4)将待检索的图片进行预处理后送入网络模型中得到待检索图片的服装特征。

(5)计算待检索的服装特征与服装数据库中的特征的距离,然后得出与待检索图片特征向量最近的N张图片作为检索结果,并且按照相似度大小排列,最相似的图片排在检索结果中的第一位,排在最后面的是N张图片中最不相似的图片。

4实验和分析

4.1数据集

本文使用DeepFashion数据库中的Category and Attribute Prediction Benchmark数据集,该数据集一共有289222张服装图片,均是JPG格式,其中有50个服装类别,1000个服装属性,服装类别分为上身服装,下身服装和全身服装。本文抽取数据集中的20个服装类别的图片进行试验。

4.2评价指标

我们使用平均精度均值(mean Average Precision,mAP)來衡量服装图像的检索效果。在完成一次检索结果后,相似图片占检索出来的图片总数的比值即为检索结果的准确率,而平均精度均值是多次检索准确率的和除以检索次数后得到的值。

准确率= [检索结果中的相似服装数目返回的检索结果数目]×100%

MAP =[多次准确率的和检索次数×]100%

从公式可以看出,平均精度均值可以有效考察检索模型在检索时的正确返回结果在所有返回结果中的占比情况。

4.3实验结果与分析

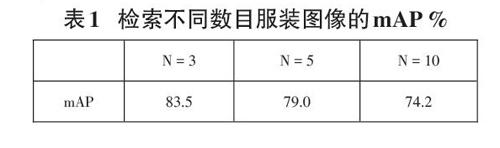

根据实验设计,本文对DeepFashion数据集中的子数据集Category and Attribute Prediction Benchmark进行了105次训练后,其损失值和准确率趋于稳定。将训练好的模型用于服装图像检索,其检索结果由图2可知。

在图像检索中,本文分别返回前3、5、10张图片来计算平均精度均值(mAP),实验结果如表1所示。

5结论

本文使用ResNet101网络模型作为主干网络,使用Triplet进行相似性度量,并计算图像之间的余旋距离,最后的检索结果按照图像之间的相似度进行排序。从表一可知,本实验具有较高的平均精度均值,该模型较好地完成了服装图像检索工作。在后续的工作中,可以使用Flask做一个网页的服装图像检索系统。

参考文献:

[1] 葛俊,于威威.一种基于加权颜色形状特征和LBP服装图像检索方法[J].现代计算机(专业版),2018(19):33-38.

[2] 董俊杰.基于HOG和SVM的服装图像检索系统的设计与实现[D].广州:中山大学,2014.

[3] 张腾,郭清宇.基于HSV颜色直方图的服装检索[J].信息与电脑(理论版),2011(20):28-29.

[4] 肖行.一种基于Gabor小波和LBP的服装图像检索方法[J].企业技术开发,2014,33(33):51-52.

[5] 陈双.基于深度学习的服装图像分类与检索研究[D].杭州:浙江理工大学,2019.

[6] 包青平,孙志锋.基于度量学习的服装图像分类和检索[J].计算机应用与软件,2017,34(4):255-259.

[7] 侯媛媛,何儒汉,刘军平.融合颜色特征和深度特征服装图像检索算法[J].计算机应用与软件,2020,37(10):194-199.

[8] 曾雄梅.基于感兴趣区域和特征融合的服装图像检索研究[D].武汉:华中科技大学,2019.

【通联编辑:唐一东】

收稿日期:2021-07-25

基金项目:田园综合体信息化运营技术集成与示范(2019YFD1101305);湖南省自然科学基金(2018JJ2098)

作者简介:晏思雪(1996—),女,四川简阳人,电子与通信工程专业硕士,主要研究方向为计算机视觉。