基于改进ResNet-UNet的火焰图像分割方法

宫艳晶,黄 民,黄小龙

(北京信息科技大学 机电工程学院,北京 100192)

0 引言

传统的火灾识别方法以气体型、感温型、光感型及烟感型传感器为主,通过检测火灾中的物理特性进行信息融合,判断火灾是否发生[1]。目前气体型、感温型、光感型及烟感型传感器已经得到了广泛的应用。但由于传感器位置固定,导致探测范围受到限制,如装满货物的工厂、长通道的建筑、森林等,探测范围受限,很难及时发现火灾[2]。传感器采集信息单一,易受到光照、气流的影响,从而导致误报漏报的情况,影响火灾信息传输的实时性和准确度。

随着深度学习的发展,利用图像识别技术检测是否有火灾发生成为有效且直接的方法。Qin Y.等[3]使用基于DS证据理论的多分类器融合火焰检测算法来对相同的火焰特征进行分类,将分类结果融合后作出初步决策。Kim J.J.等[4]使用Faster R-CNN算法在火灾图像中检测到火焰。

虽然基于卷积神经网络的火焰分割方法在一定程度上优于传统的火焰识别,但仍然存在一些问题。例如:火灾图像复杂,火焰区域很容易受到烟雾等背景信息的影响,导致编码器无法提取到有效的火焰特征,还存在用于训练的样本数较少导致过拟合现象的弊端。本文以UNet神经网络为基础,引入 ResNet-34残差网络结构,损失函数采用以交叉熵损失BCELoss与 Dice损失两者进行线性组合的形式,规避了由于网络梯度消失而出现的网络退化,提高火焰图像的分割精度。

1 模型建立

最早提出UNet 网络结构是将其运用于医学图像细胞分割当中,并取得了很好的分割效果。UNet网络结构以下采样、上采样和跳跃连接为主要构成部分,如图1所示[5]。从结构的左右来看,左边是图片压缩部分,即编码结构,由3×3尺寸的卷积层、ReLU函数和2×2尺寸的池化层构成。对输入图像共进行4次下采样,每经过2×2池化层操作,特征图的尺寸下降,同时通道数翻倍,采用卷积层和下采样层来实现图像尺寸的缩小,并提取图像的浅层特征。UNet的右半部分的作用是对图像进行解码,通过和编码部分对应的4次2×2的反卷积层实现上采样,扩大特征图的尺寸,从而恢复原图像的大小。

图1 UNet网络结构

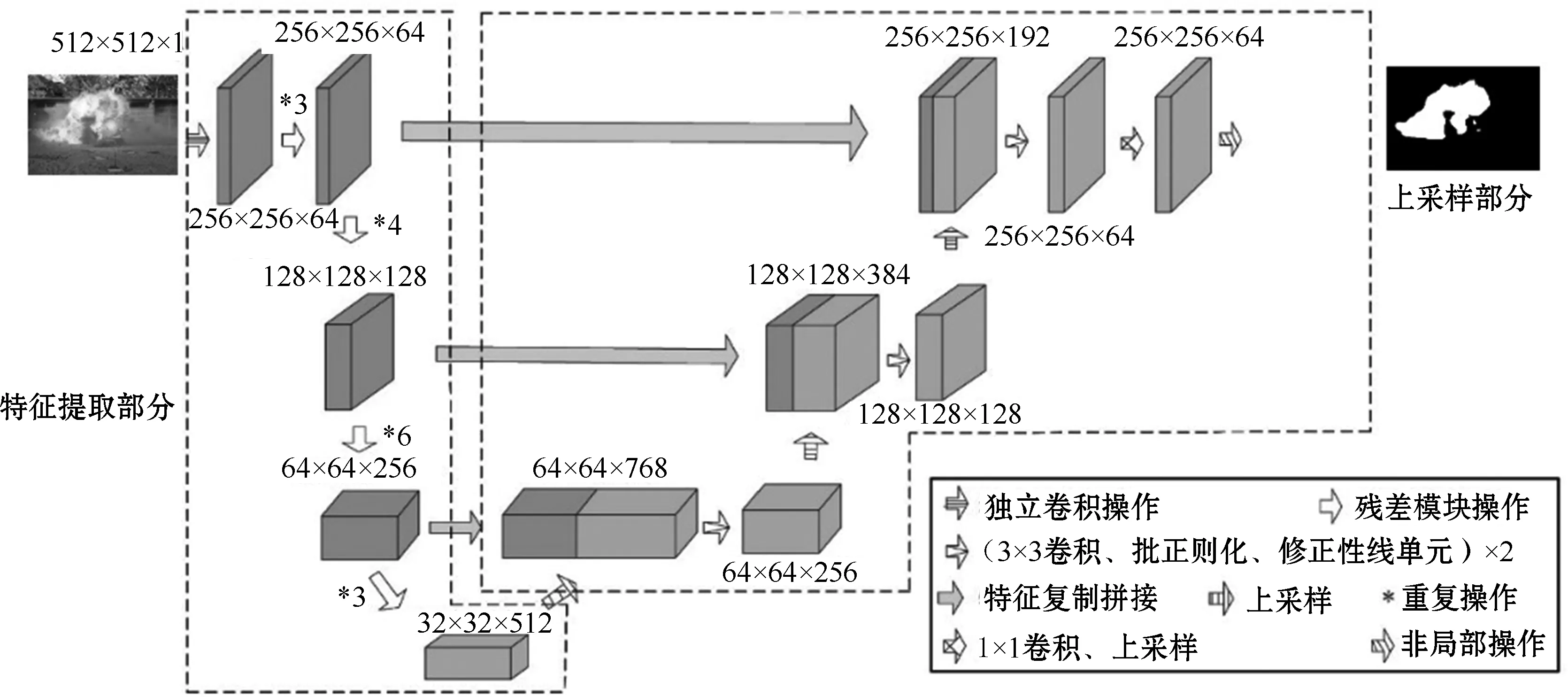

在UNet卷积神经网络结构的基础上,引入ResNet残差块部分[6],图2所示为ResNet-UNet神经网络结构图。

图2 ResNet-UNet网络结构

图3 ResNet-UNet网络结构

ResNet-UNet编码过程的层级明确,5个卷积层和1个池化层构成了残差块,旨在将输入数据256×256维度转变为16×16维度的特征信息。在编码过程中,步长设置为1,卷积核设置为3×3,在图像数据经过残差块的过程中,通过对折图片大小与对折通道数量,来保证图像特征信息不丢失。在解码过程中,含有1个反卷积层和5个卷积层,目的是将下采样层获得的16×16维特征信息转为256×256维。ResNet-UNet网络结构中,将编码后处理得到的特征图融合解码部分的特征图,更好地保留了图像的特征信息。

由于火焰特征复杂,在火灾发生区域火焰的覆盖面大,且覆盖面不集中等,需要经过多次运算才能提高模型拟合的准确度,网络层数越多,越容易导致梯度弥散或梯度爆炸。因此在UNet神经网络中引入残差神经网络,来解决由网络深度带来的问题。以UNet网络框架为基础,采用ResNet-34网络作为神经网络特征提取前端,提高火焰的分割准确度。

如图3所示,在特征提取层,将512×512的火灾图像输入到网络中,经过ResNet-34残差网络结构对图像进行特征提取,保留ResNet-34的独立卷积结构和残差结构。同时为了保证ResNet-34网络和UNet网络完美融合,需要将ResNet-34网络最后一层的卷积通道数和ResNet-UNet网络特征提取最后一个残差模块处理后的通道数保持一致。基于UNet神经网络的基础模型,采用插值处理手段,达到图像分辨率复原的目的。并将网络提取的特征部分与下采样进行拼接融合,形成新的特征。在形成新的特征后需要依次重复3×3的卷积操作、批正则化和ReLU操作。

由于火焰图像的特征不明显,火灾在图像中所占比例差异大,因此取代了二进制的交叉熵损失函数,采用交叉熵损失BCELoss与 Dice损失线性组合并对 Dice 损失加权来解决该问题。采用Dice Loss非线性损失函数与二进制交叉损失函数相结合的方法,改善数据极度不平衡问题。在关注整体图像损失度的前提下,更注重目标物损失度的变化,从而避免特征面积对分割精度的影响。

Dice损失函数的损失率LD为

LD=

(1)

BCELoss函数的损失率LB为

ln(1-xn))

(2)

Dice_BCE_Loss函数的损失率LDB为

LDB=0.5LB+LD

(3)

式中:N为分割图片的所有像素点个数;p为模型预测训练集的前景像素点个数;r为训练集标签中真实的前景像素点个数;n为每次训练的次数;xn为损失函数训练的自变量;yn为梯度变化的因变量。

2 实验结果与分析

2.1 数据集处理

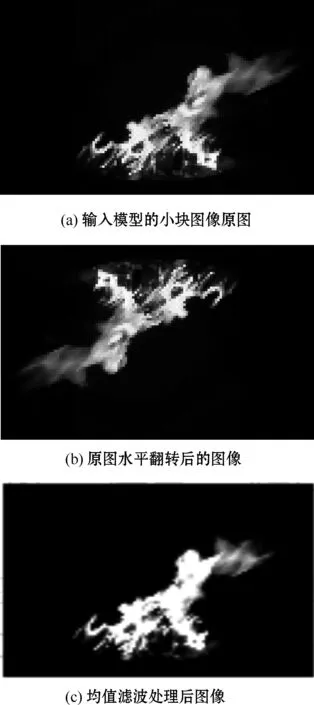

通过网络搜索到含有火焰的图片1 000张、干扰图片200张作为原始数据集。由于图片有限,无法满足训练的需求,通过对图片随机旋转、镜像、按比例随机缩放方法,形成了6 000张图片,扩充火焰数据集,将训练集、验证集和测试集按3∶1∶1的比例分配。图4为本文中数据增强操作示例。

图4 数据增强操作示例

为了提高火焰的分割准确度,首先将图像的尺寸统一裁剪为512×512像素,再通过灰度化处理变为灰度图像。图片显示的颜色从黑色到白色,颜色值是连续无穷多的,这一特征对于火焰图像比较适合[7],因为火焰相对于周围的物体来说是比较亮的。本文选取了8 bit的灰度图,颜色值有256种。相较于三通道彩色图,灰度图的网络输入层减少到原来的1/3。

为了防止火焰图像中噪声点的干扰,即火焰周围被火焰照亮的地方的亮度和火焰类似,或严重干扰后期卷积神经网络对火焰图像的学习,导致火焰周围被照亮的地方误判为火焰造成过度分割,采用均值滤波的方式对火焰图像进行处理,消除火焰图像中的干扰性噪声点[8]。火灾图像会忽略均值滤波带来的图片模糊化,因为均值滤波在模板尺寸小的情况下不会破坏火焰的特征,并且这些特征可以通过卷积网络学习。

最后,为了提高火焰图像的对比度,突出火焰的特征,采用自适应均衡化的方法,通过调整图像的直方图分布,增强火焰和背景的对比度,使火焰图像中的火焰和周围环境亮度上有更大的差异,有利于网络训练[9]。

2.2 实验细节

实验采用的系统环境为Ubuntu 18.01,64位操作系统,CPU为E5-2682 v4@2.50GHz,显卡为 2080Ti。网络实验依托于Pytorch框架。

在训练改进的ResNet-UNet网络模型过程中,模型中的参数如表1所示。

表1 训练过程中实验参数设置

为了防止实验过程中图像处理出现训练过拟合的现象,采用早停法来控制是否终止[10]。当实验中每轮训练结束后,记录验证集上的测试结果,当实验中损失不断上升时,选择停止实验,并将之前训练的验证集的精度作为改进的ResNet-UNet网络的最终参数。

设置学习率为0.000 3,每次训练学习率减少0.000 1,直到训练次数达到初始化的数据,或者因为早停法导致实验的终止。

2.3 评价指标

在图像处理过程中,根据网络处理后的预测结果和标注图像的不同,实验的结果可以分为4类,即真阳性、真阴性、假阳性、假阴性。

预测值为正例,记为P;预测值为反例,记为N;预测值与真实值相同,记为T;预则值与真实值相反,记为F;预测类别为P,真实类别也为P的记为TP(真阳性);预测类别为P,真实类别为N的记为FP(假阳性);预测类别为N,真实类别也为N的记为TN(真阴性);预测类别为N,真实类别为P的记为FN(假阴性)。

在火焰分割过程中,通过对图像标记区域的处理,实现二值化。

实验评价标准采用Dice准确性和Hausdorff_95。

2.3.1 Dice准确性

Dice系数主要判断两个样本之间的相似度[11]。本文利用Dice值表示预测得到的火焰分割图像和作为标准的火焰图像之间的重合度。Dice值的计算公式为

XDice=2nTP/(nFP+2nTP+nFN)

(4)

式中:nTP为TP样本数;nFP为FP样本数;nTN为TN样本数;nFN为FN样本数。Dice的取值范围为[0,1],当Dice值越接近1时,表示预测的火焰图片和标准火焰图片越相似,同理当Dice值越接近0时,表示网络分割效果越差或者网络分割错误。

2.3.2 Hausdorff_95

Hausdorff_95计算的是预测值和真实值对于特征点集之间的距离,Hausdorff_95越小,说明预测值和真实值越接近。

Hausdorff的计算公式如下:

DH(P,T)=max (dPT,dTP)

(5)

其中,

dPT=maxp∈Pmint∈Td(p,t)

(6)

dTP=maxt∈Tminp∈Pd(p,t)

(7)

式(5)为双向Hausdorff距离,是Hausdorff距离的基本形式,它度量了两个点集间的最大不匹配程度;式(6)和式(7)中的dPT和dTP分别称为从P集合到T集合和从T集合到P集合的单向Hausdorff距离,即dPT实际上首先对点集合P中的p到距离此点最近的点集合T中t之间的距离进行比较,取该距离中的最大值作为dPT的值,dTP同理可得。

Hausdorff_95是指Hausdorff的值乘以95%,目的是为了消除离群值的一个非常小的自己的影响。Hausdorff_95的计算公式如下:

DH95(P,T)=0.95×DH(P,T)

(8)

Dice对火焰的内部填充比较敏感,而Hausdorff 距离对分割出的边界比较敏感。

2.4 实验结果分析

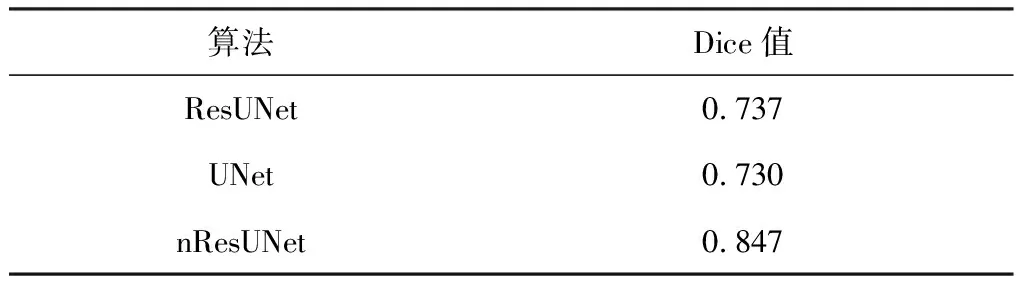

选取UNet、ResNet-UNet和改进的ResNet-UNet进行对比实验。实验中将ResNet-UNet简称为ResUNet,将改进后的ResNet-UNet称为nResUNet。

如图5所示为ResNet-UNet和本文改进的网络模型分割后产生的对比图,从图中可以看出,改进后的网络模型对火焰图像的分割边界更平滑,火焰分割效果更好。

图5 ResUNet和nResUNet的网络分割对比

如图6所示为不同算法对火焰图像分割的Dice效果。

图6 三种算法的Dice指标对比图

分别计算不同算法的Dice值如表3所示。由表3可知,本文提出的改进ResNet-UNet算法,在火焰分割任务上Dice值达到了0.847,较原来的ResNet-UNet网络准确度有所提升。

表3 不同算法的Dice值比较

如图7所示为3种算法Hausdorff_95指标的对比。

图7 三种算法Hausdorff_95指标对比

表4 不同算法的Hausdorff_95效果比较

根据表4的数据分析可知,nResUNet算法在火焰分割任务上Hausdorff_95效果是最好的。因此在3种算法中,本文提出的算法分割的效果和真实值最为接近。

3 结束语

针对现有的火焰图像分割不准确等问题,本文提出改进的ResNet-UNet算法。基于UNet网络结构,引入ResNet-34网络结构,保留ResNet-34的独立卷积结构和残差结构,加深网络结构,通过将每次下采样部分处理的特征和上采样进行拼接融合。同时,为了防止火焰图像中噪声点干扰可能导致的过度分割,采用均值滤波对火焰图像进行处理,消除图像中的噪声点,提高火焰的图像分割性能。实验表明,和ResNet-UNet神经网络相比,本研究提出的改进方法准确度提高了11%,同时Hausdorff_95效果更好,网络得出的预测值和真实值更为接近,有效地提高了火焰的分割性能。