基于背景约束的抗遮挡目标跟踪算法研究

阳永清

(长沙师范学院信息与公共实验管理中心,湖南 长沙 410100)

目标跟踪技术一直以来都是计算机图像智能处理领域中的研究热点,其最早应用于军事领域,现已在专项侦察、人机交互、医疗诊断、安防监控和虚拟现实等诸多领域有着广泛的应用[1-2],成为城市智能视频监控的核心技术之一。目标跟踪的目的主要在于确定目标在视频图像中的准确位置和状态,从而有效获取目标的行迹、特征信息和空间位置信息等内容,为对目标状态进行更精准的分析提供技术支持。目标跟踪过程可以依据目标的类别分为点目标跟踪和特征目标跟踪两种。

目前,已有一些相对成熟的目标跟踪方法。刘美枝、杨磊等[3]设计了基于Camshift的跟踪算法,该算法充分考虑了角点的特征不变性,并利用图像Harris角点检测过程提取图像信息的局部特征点,继而在视频图像的连续两帧之间,通过对特征信息的配准剔除图像中的虚假特征点,从而获得特征点的实际位置和主方向,再利用CamShift算法完成对目标位置和方向的搜索和跟踪。曾礼灵、李朝锋[4]设计了基于支持向量机(Support Vector Machine,SVM)的跟踪算法,该算法在多核学习过程中导入了Boosting提升方法,利用比普通多核学习过程更加便捷的样本训练过程,建立基于互补性特征集和核函数集的弱分类器池,然后把多个单核的弱分类器组合起来,形成一个较强、多核的分类器,使得双方可以在强背景干扰的环境下仍能实现对目标的识别和跟踪。周珂、张浩博等[5]设计了基于SiamMask的跟踪算法,该算法利用了融合优化的思想,将传统的基于PyTorch深度学习框架的SiamMask单目标跟踪过程和感兴趣区域检测过程相结合,并使用时空语境预测过程,根据图像中目标的时空变化,对目标下一时刻的新位置进行预测,借助于SiamMask模型的校正能力实现对图像中目标的快速识别和跟踪。周克虎、周进等[6]设计了基于Struck的遮挡目标跟踪算法,该算法在Struck算法框架的基础上融入遮挡判断机制,当追踪目标存在遮挡时,通过缩放搜索样本的尺寸避免遮挡检测虚警,并通过卡尔曼滤波实现目标全遮挡后的持续跟踪。卢瑞涛、任世杰等[7]设计了基于稀疏表示多子模板的跟踪算法,该算法首先利用子模板选择方法最大程度地捕捉目标特征信息。这一过程中,针对图像直方图对光照敏感的弊端,引入了稀疏表示理论,将其用于描述子模板特征,从而提高模板子块的适应能力,然后通过构造表决图对目标位置进行融合决策,对目标模型进行有效跟踪。

为进一步提高目标跟踪结果的质量,建立了背景约束模式,在此基础上设计了一种抗遮挡目标跟踪算法,以实现优质的运动目标跟踪。

1 算法设计

1.1 基于背景约束机制的目标识别

1.1.1 前景目标物与背景信息提取

目标识别过程中,图像内前景目标物与背景划分是一个关键环节[8]。为实现对视频图像内信息的智能感知,有效划分图像内跟踪目标识别前景与背景,采用由下向上的视觉注意模型生成图像马尔科夫矩阵,获取显著图[9]。过程如下:

Step 1:在对图像进行降采样后提取图像颜色c、亮度l、方向d三类低级特征,调整每一个尺度下的图像低级特征生成“activation maps”;

Step 2:归一化处理“activation maps”,过程为:

其中,H(φ)是归一化过程的哈密顿算符,h表示欧氏距离,t表示尺度。

1.1.2 背景约束机制

视频图像背景内通常存在大量情景信息,这些信息同跟踪目标的出现密切相关,基于这些相关性能够辅助确定图像内跟踪目标出现的概率[10]。基于此,利用先验知识构建背景对目标的约束机制,可提升目标识别概率,同时与单纯目标分类获取的识别结果相比更能满足人类的认知心理。

根据背景约束机制构建背景对象(Background Object,BO)模型,图像背景信息与跟踪目标出现的相关性关系Z用下式描述:

其中,Background、Object和Probability分别表示图像集内背景集合、目标物集合和某图像背景下目标物出现的概率。

根据以上分析可知,目标物集合内各目标物元素同背景集合内各背景元素之间都存在某种程度的相关性,但各背景元素下不同目标物元素存在的可能性有所差异,这种概率约束被定义为背景对标定的概率约束机制[11]。划分视频图像内前景目标物与背景后,识别判断背景,利用背景约束机制构建的BO模型对前景目标物进行分析,由此实现视频图像内跟踪目标识别。

1.2 基于多线索融合的目标跟踪

1.2.1 粒子滤波的跟踪框架

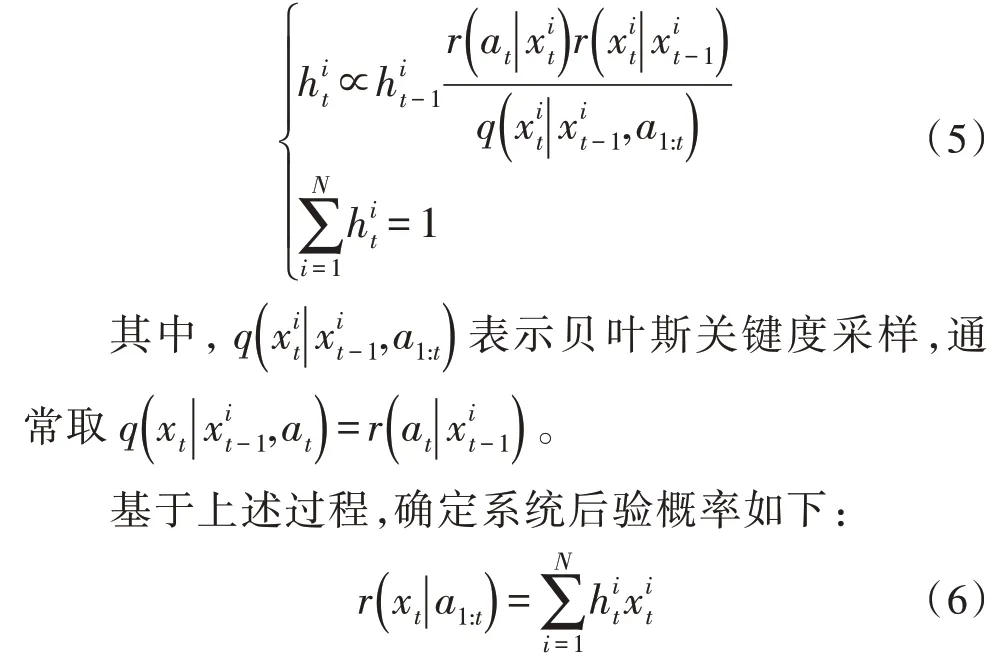

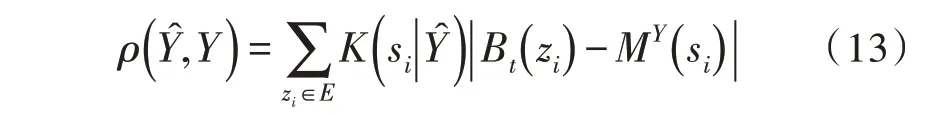

依照观测值优化粒子权值:

1.2.2 mean-shift算法

其中,N和Kφ分别表示粒子总数和核宽为φ的高斯核函数。依照均值向量梯度方向将粒子移动至后验概率密度的局部极值区域,同时利用上限Bhattacharyya系数确定跟踪目标运动的最优方位。

1.2.3 线索的选取

利用颜色直方图模板和基于核密度椭圆的二值形状模板选取[16-17]粒子滤波跟踪的线索。

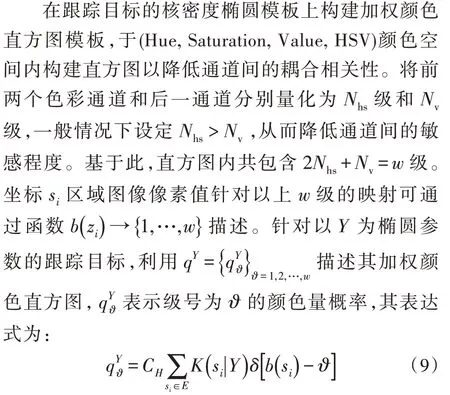

1)加权颜色直方图模型

其中,CH和δ分别表示归一化因子和Kronecker函数。

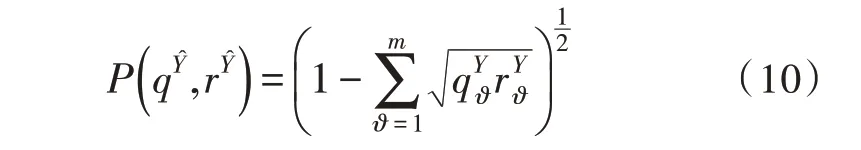

其中,P值与分布一致度之间为反比关系。针对两个一致的加权颜色直方图模板,P值为0可描述最优的匹配度。

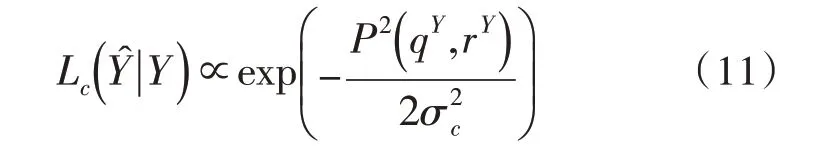

在此基础上,利用式(11)描述候选目标的颜色似然函数:

其中,σc表示颜色线索观测值内的高斯噪声。

2)二值形状线索

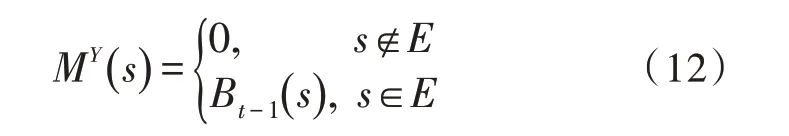

以二值形状为目标跟踪线索时,假设Y表示跟踪目标椭圆参数,由此得到跟踪目标的二值形状模板:

其中,Bt-1表示前景目标的二值分割图像。

利用式(14)描述候选目标的概率化形状似然函数:

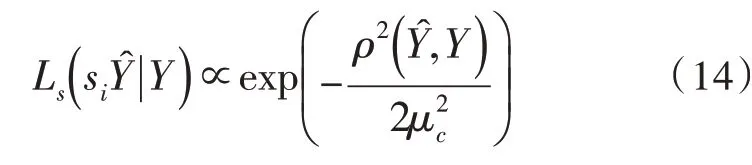

1.3 遮挡判定与融合策略自适应

当跟踪目标存在被遮挡现象后,跟踪算法应通过相应策略进行抗遮挡处理,至遮挡现象消失后返回正常跟踪模式[19]。Bhattacharyya系数可描述当前候选跟踪目标与跟踪目标之间的一致度。在跟踪目标无遮挡情况下,Bhattacharyya系数波动控制在一定范围内;在跟踪目标被遮挡情况下,Bhattacharyya系数将显著下降。因此可根据Bhattacharyya系数的波动情况判断跟踪目标是否被遮挡。

在跟踪目标被遮挡条件下,遮挡物不同,Bhattacharyya系数下降水平也有所差异[20]。在遮挡物同跟踪目标颜色差异较小的条件下,Bhattacharyya系数下降幅度也有所减缓。一般来说,若遮挡物颜色类似于跟踪目标,其纹理特征通常区别于跟踪目标。因此,在颜色线索与二值形状线索中,若任意线索的Bhattacharyya系数存在显著下降的趋势,则可说明跟踪目标被遮挡。

融合颜色直方图与二值形状线索过程中采用自适应融合策略[21],在线索充分的条件下,为获取高精度的似然函数,两种线索采用乘性融合模式;若存在跟踪目标被遮挡导致线索退化现象发生时,为提升似然函数的稳定性,则转换为加权融合的模式。

在跟踪目标无遮挡、跟踪线索充分的条件下,选用的乘性融合模式的表达式如下:

其中,α、β都表示加权系数,同时α+β=1,两者的值由跟踪场景决定,若存在目标遮挡,α值较大。

在目标跟踪时,粒子滤波跟踪框架自适应优化两种线索直方图,用q和r分别表示当前模板和当前候选跟踪目标的直方图,在两者的Bhattacharyya距离小于阈值Th时,优化模板;相反判定跟踪目标受外界因素影响显著,或跟踪目标被局部或整体遮挡,不优化模板。以此避免跟踪结果受外界因素影响,并确保跟踪目标被遮挡条件下目标模板的准确优化。

2 实验分析

2.1 跟踪结果初步检验

实验对象选取某场篮球比赛视频进行实验测试,视频帧率为24 fps,分辨率为352×288。利用该文算法追踪该视频内的22号球员,初步判断该文方法的有效性,结果如图1所示。

图1 文中算法追踪结果

由图1可知,采用该文算法进行目标追踪的过程中,第18帧、第69帧和第97帧图像在非遮挡与遮挡条件下都可以准确跟踪运动目标,由此可初步证明该文算法能够有效跟踪运动目标。这是因为该文方法在目标跟踪算法的基础上增加了判断模式,若存在目标遮挡,则及时转变线索融合模式,在粒子滤波框架内引入了mean-shift算法,因此可在存在目标遮挡的情况下有效追踪目标。

2.2 跟踪效果对比

2.2.1 非遮挡目标跟踪

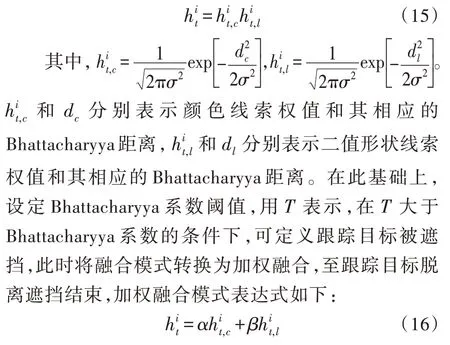

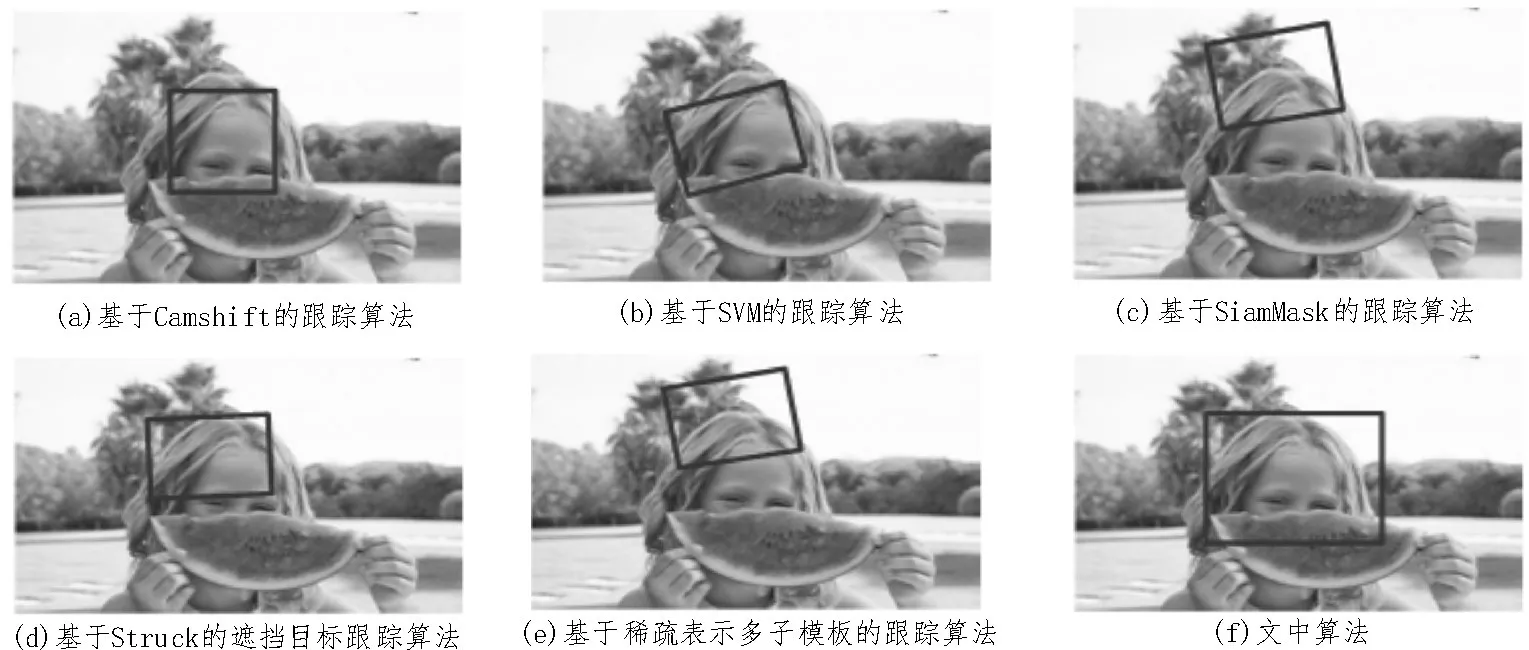

在实验对象内选取某非遮挡运动目标视频进行实验测试,对比该文算法、基于Camshift的跟踪算法、基于SVM的跟踪算法、基于SiamMask的跟踪算法、基于Struck的遮挡目标跟踪算法和基于稀疏表示多子模板的跟踪算法的跟踪效果,结果如图2所示。

图2 非遮挡目标跟踪效果对比

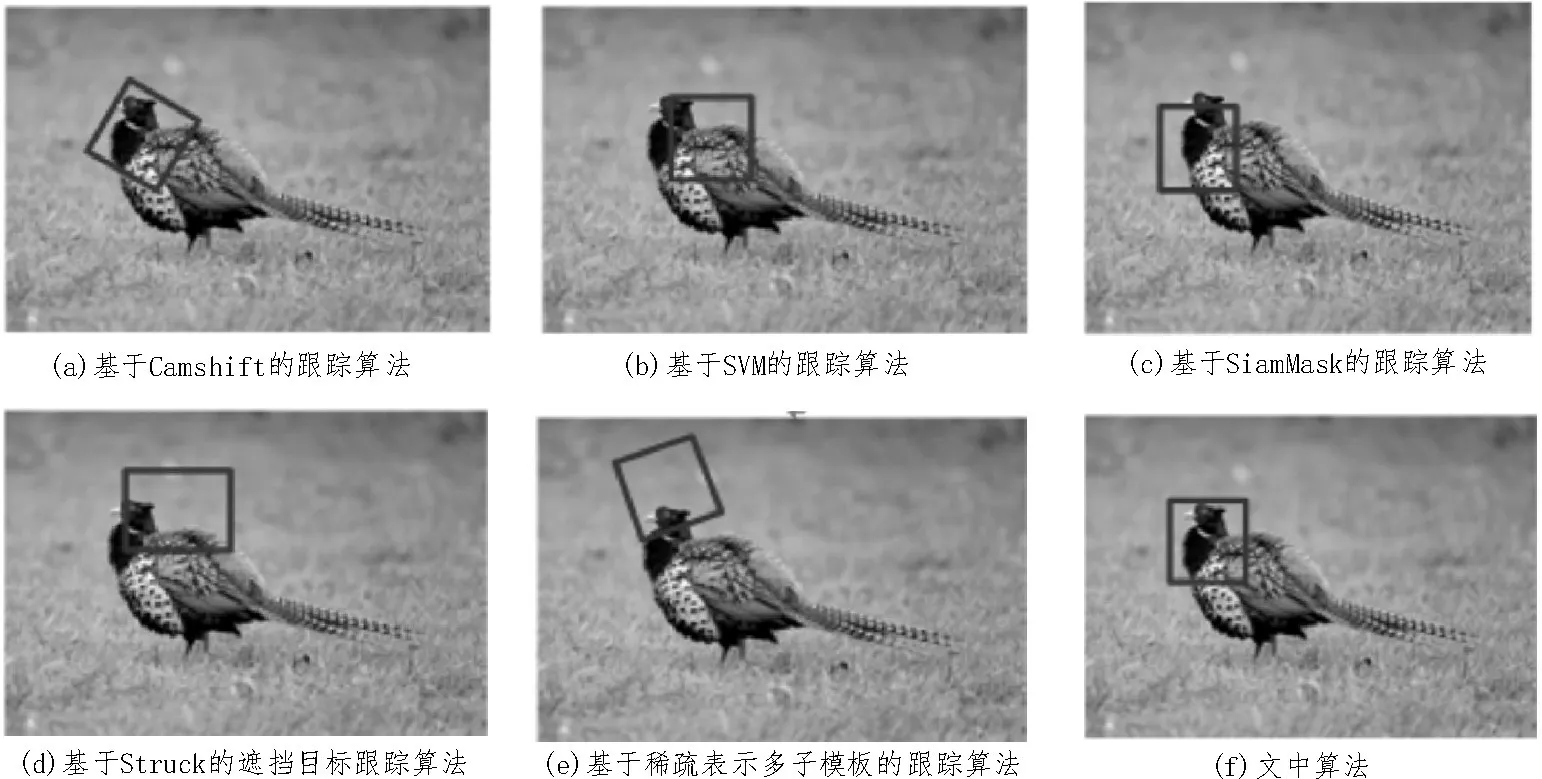

2.2.2 遮挡目标跟踪

在实验对象内选取某遮挡运动目标视频进行实验测试,对比不同方法的跟踪效果,结果如图3所示。

图3 遮挡目标跟踪效果对比

2.3 跟踪性能测试

2.3.1 跟踪速度测试

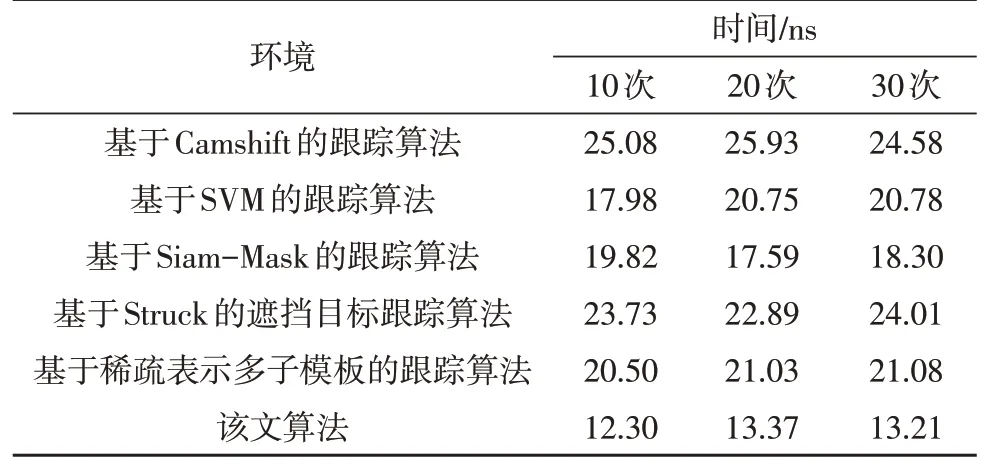

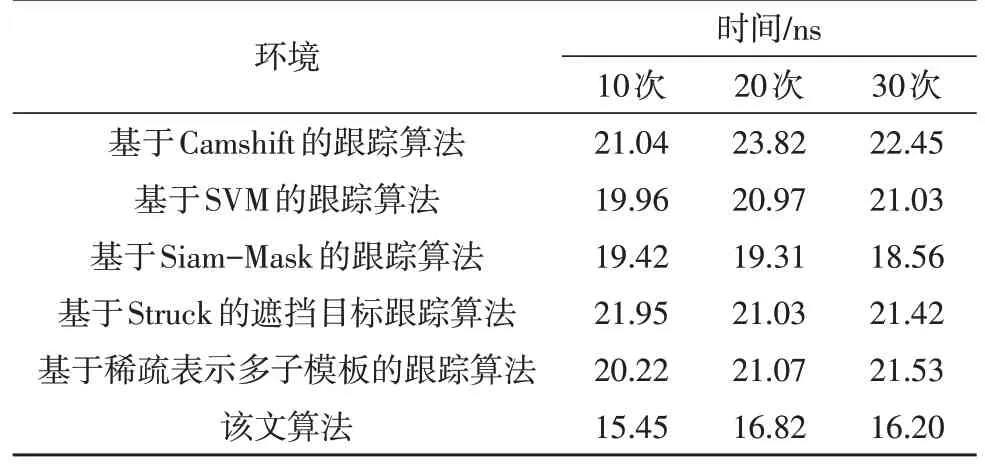

在相同实验环境下,对比不同算法对不同目标进行跟踪所需的时间,结果如表1、表2所示。

表1 非遮挡目标跟踪时间对比

表2 遮挡目标跟踪时间对比

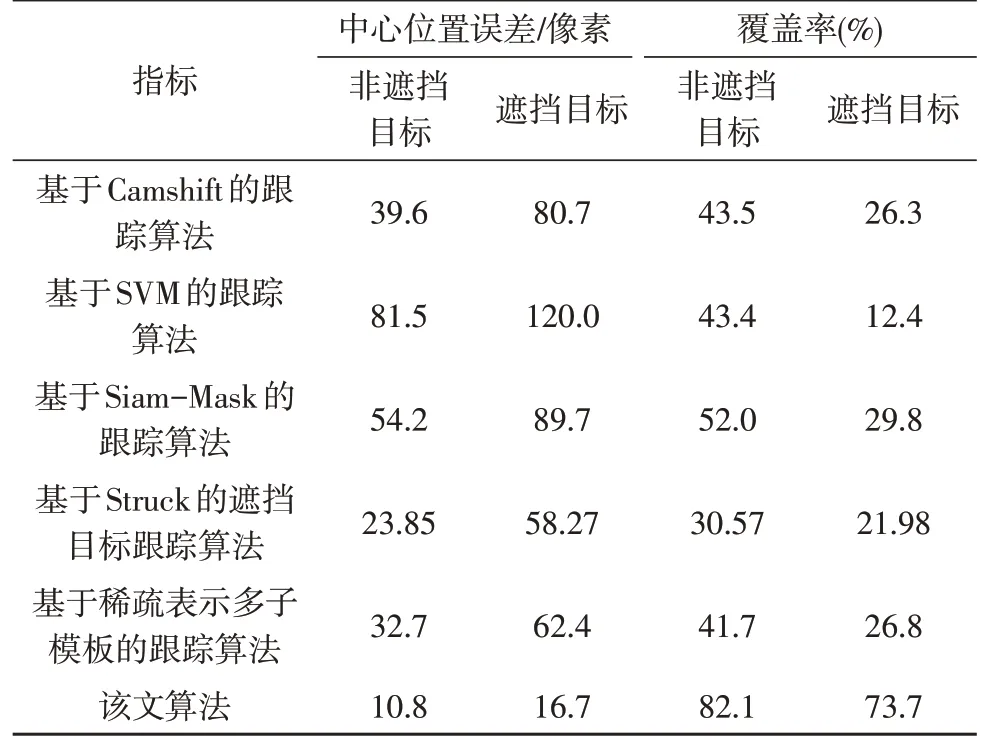

2.3.2 中心位置误差与覆盖率对比

中心位置误差与覆盖率分别描述跟踪框与实际目标框的中心偏差和两者合并部分内的重叠比重。为定性评价该文算法的跟踪效果,将上述两个指标作为评标标准,结果如表3所示。

分析表3可知,该文算法在中心位置误差与覆盖率两项指标的计算结果均显著优于其他5种算法,这一结果表明该文算法的跟踪效果更优。这是因为该文算法通过建立前景目标物的概率约束提高了目标识别的精度,并将mean-shift算法引入粒子滤波框架内,减小了遮挡信息的干扰。

表3 中心位置误差及覆盖率对比

3 结论

该研究在提取初始帧图像内的前景目标与背景特征的基础上,建立了对前景目标物的概率约束,有效地提高了目标识别的精度,并在目标跟踪算法的基础上增加了判断模式,若存在目标遮挡,则及时转变线索融合模式,将mean-shift算法引入粒子滤波框架内,实现了抗遮挡的目标跟踪。实验结果表明,该文算法在跟踪精度与跟踪速度上均显著优于现有算法。