基于深度学习的单幅图像超分辨率重建综述*

李 彬,喻夏琼,王 平,傅瑞罡,张 虹

(1.国防科技大学电子科学学院,湖南 长沙 410073;2.32021部队,北京 100094; 3.中国船舶科学研究中心,江苏 无锡 214000)

1 引言

由于硬件设备限制和信息传输处理的实时性要求,人们获取到的图像数据往往为低分辨率LR(Low-Resolution)图像,但在实际应用中,高分辨率HR(High-Resolution)图像可以提供更多信息,帮助专业人士做出更准确的判断,同时也具有更好的感知效果。单幅图像超分辨率SISR(Single Image Super-Resolution)重建利用图像中像素点与周围像素点之间存在的内在联系,学习自然数据中存在的隐式冗余,可以从单幅的LR图像恢复出丢失的细节信息,从LR图像得到HR图像。目前,SISR技术被广泛应用于诸多领域,如社会安全[1]、医学成像[2]和军事遥感[3]等。

现有的SISR算法大致分为3类:基于插值的算法、基于重建的算法和基于学习的算法[4]。基于插值的算法简单,但是重建图像会引入伪影和振铃现象。基于重建的算法虽然重建效果较好,但是算法执行效率低,对尺度缩放因子敏感。基于学习的算法解决了对尺度缩放因子敏感的问题,在SISR领域得到了广泛应用。由于SISR问题具有不适定性(存在多种可能解,即多幅HR图像对应同一幅LR图像),需要构建一定条件来约束重建图像的解空间。

作为基于学习算法的一个分支,基于深度学习的SISR算法通过多层卷积神经网络CNN(Convolutional Neural Network)建立输入和输出之间非线性端对端的映射关系。首个基于深度学习算法的SISR网络模型SRCNN[5]构建了一个简单浅层的CNN,得到的图像重建效果相对其他SR重建算法有了显著提升。近年来,诸多深度学习超分辨率SR重建网络模型被提出,如ESPCN[6]、VDSR[7]、SRGAN[8]和RCAN[9]等,进一步提升了SISR重建效果。由于基于深度学习的SR重建算法通常是构建一个端对端的网络模型,将LR图像输入到该特定网络模型中,通过特征映射和尺度放大等方式优化网络的损失函数,进而得到HR图像,因而现有的SR重建网络模型主要在尺度放大方式、模型结构组成和损失函数构建3个方面存在较大差异,本文针对这3个方面进行了详细分析。

2 尺度放大方式

所谓图像SR尺度放大,就是进行图像上采样,即在放大图像的尺度的同时提升分辨率。在网络构建中,上采样的方法和时机不同,带来的SR重建效果不同。

2.1 上采样方法

常见的图像SR上采样方法主要有3种:基于插值的图像SR上采样、基于反卷积的图像SR上采样和基于亚像素卷积的图像SR上采样。

基于插值的图像SR上采样在LR图像的基础上,使用合适的内插算法在原有像素点间插入新的像素点。常用的插值算法有最近邻插值、双线性插值和双三次插值等。基于插值的图像SR上采样原理简单,能够实时高效地对LR图像进行尺度放大,但插值放大后的图像质量差,容易带来锯齿状的失真,因而与基于反卷积和基于亚像素卷积的图像SR上采样方法相比,其应用相对较少。早期网络模型也将插值放大结果作为网络输入,如SRCNN[4]、VDSR[6]等网络模型的输入就是插值放大后的图像。

反卷积(Deconvolution),也称转置卷积,最早的反卷积概念出现在Zeiler等人[10]发表的论文中。它并不是正向卷积完全的逆过程,而是比较特殊的正向卷积,通过对补零操作后的图像进行卷积,使输出图像的尺度放大,相当于使用一种分数步长的卷积方法对图像进行上采样,基本操作如图1a所示。相对于基于插值的图像SR上采样方法,基于反卷积和基于亚像素卷积的图像SR上采样都属于基于学习的上采样,可以有效减少锯齿状失真。基于反卷积的图像SR上采样方法是目前SISR重建领域中最常用的方法,FSRCNN[11]、EDSR[12]等网络结构中都采用基于反卷积的图像SR上采样进行尺度放大。

Figure 1 Principle of deconvolution and sub-pixel convolution图1 反卷积和亚像素卷积实现原理

亚像素卷积(Sub-Pixel Convolution)[5]是一种像素洗牌的上采样方法,虽然名称为亚像素卷积,但并未进行卷积操作,实际是像素的一种重新排列。亚像素卷积要求输入是r2(r指尺度放大的倍数)个通道的特征图,通过一定的规则对所有像素进行重新排列,从而得到一幅尺度放大的图像,具体操作如图1b所示,实质上是一种反抽样的思想。由于亚像素卷积操作中不涉及卷积计算,因而基于亚像素卷积的上采样速度非常快,有助于实现实时上采样。

2.2 上采样实施方式

根据上采样时机的不同,SISR重建网络可以采用预先上采样、单次上采样、渐进上采样和迭代上采样4种方式。

预先上采样是通过预处理方式,使得输入网络的图像为经插值放大的中分辨率MR(Middle-Resolution)图像,该方法最早出现在SRCNN网络中,通过简单的CNN建立MR图像与HR图像之的映射关系。早期的SR网络模型,如SRCNN、VDSR[6]、DRCN[13]和DRRN[14]等均采用预先上采样的方式提高重建图像的尺度。由于该方式在预处理阶段对图像进行上采样,极大增加了网络训练过程中的计算量,特别是随着网络深度的逐步加深,进一步制约着网络模型训练的效率和重建图像质量。因而随着网络模型的发展,预先上采样的方式基本不再使用。

单次上采样通常指在SISR网络模型的最后一个模块,通过反卷积或亚像素卷积的方法实现特征尺度放大,从而得到重建MR图像。目前大部分的SISR网络模型都采用单次上采样,典型的有FSRCNN[13]、ESPCN[5]、EhanceNet[15]和IDN[16]等。单次上采样解决了预先上采样带来的网络计算量大的缺点,加快了网络训练速度,同时通过基于反卷积和基于亚像素卷积这2种基于学习的图像SR上采样方法,使得重建图像效果更加逼真。

渐进上采样最早出现在Lapsrn[17]网络中,旨在解决大尺度上采样时单次上采样方法存在图像失真和重建质量差的问题。渐进上采样充分利用2倍上采样的网络结构解决4倍、8倍等大尺度上采样的问题。目前Lapsrn网络和EUSR[18]网络均采用了渐进上采样的方式。通过对2倍上采样网络结构堆叠,使各结构之间参数共享,不仅实现了较好的上采样效果,同时也有效缩短了训练时间。表1是ESUR网络通过2种不同上采样方法重建的图像质量对比(表中数字加粗表示最优结果),PSNR和SSIM[19]是2种图像质量评价指标,可以看到,在Set5和Set14数据集上的4倍上采样结果中,与直接上采样相比,渐进上采样效果更优。

Table 1 Comparison of reconstruction effects of different upsampling methods onSet5 and Set14 datasets of ESUR network表1 ESUR网络中不同上采样方法在Set5和Set14数据集上重建效果对比

迭代上采样的方法伴随着迭代SR网络的提出而得到应用,最早出现在DBPN[20]网络中,目前在DBPN和SRFBN[21]网络中得到了应用。迭代上采样的方法使网络能有效学习不同深度特征映射的上采样特性,充分利用浅层和深层的不同特征映射重建上采样图像,由于在DBPN网络和SRFBN网络中展现的良好重建效果,迭代上采样也成为近两年SR领域的主流方法之一。

目前常见的SR重建网络都将不同整数尺度因子的SISR重建作为研究任务,长期以来,任意尺度因子的SR重建网络研究一直被忽略。Meta-SR[22]模型构建了任意尺度SISR的网络结构,通过引入元学习[23]的思想构建元上采样模块,该模块实际是通过一个全连接网络预测上采样卷积核参数,从而实现图像任意尺度的SR重建,其基本原理图如图2所示。

Figure 2 Principle of arbitrary upsampling scale图2 任意尺度上采样原理

3 模型结构组成

目前在SISR重建领域,根据网络模型结构组成不同,基于深度学习的网络模型可分为以下3种:基于CNN的网络模型、基于CNN-RNN(Convolutional Neural Network-Recurrent Neural Network)的网络模型和基于生成对抗网络GAN(Generative Adversarial Networks)的网络模型[24]。其中基于CNN的网络模型是该领域应用最广的模型。

3.1 基于CNN的网络模型

基于CNN的SR网络模型不同于一般任务的深度学习网络模型,由于要实现图像的尺度放大,SR网络模型一般不使用池化层。基于CNN的网络模型也可细分为直接连接模型、残差连接模型、密集连接模型和注意力模型等模型结构。

SRCNN网络是典型的直接连接结构,也是第1个用于SISR重建的CNN网络结构,它包含了一个3层的浅层CNN,通过训练一组LR和对应的HR图像数据,寻找一个最优的模型F,将该模型应用于未训练的测试数据X,精确预测X对应的SR图像。SRCNN网络的基本模块包括特征提取、非线性映射和图像重建,如图3所示,其中特征提取采用9×9的卷积核,SRCNN通过1×1的卷积核完成非线性映射,最后经过5×5的卷积核完成图像重建过程。通过使用大的卷积核使得浅层网络也能获得较大的感受野,因而仅仅只用3层卷积网络就可以实现较好的SR重建效果。

Figure 3 Model of SRCNN network图3 SRCNN网络模型

FSRCNN[13]网络在SRCNN的基础上针对重建方法进行了改进,它主要包括5个模块,分别是特征提取、收缩、映射、展开和反卷积。由于输入是原始LR图像,在重建层通过反卷积对输入图像进行尺度放大,因而相对于原始SRCNN网络来说,该网络降低了计算量,加快了模型训练,同时通过使用更小的卷积核和更深的网络结构提升了重建图像质量,ESPCN网络主要也是针对SRCNN的重建层进行了改进,网络输入为LR图像,在重建层采用亚像素卷积层使得网络训练速度有了成倍的提高,适用于实时的视频SR。

以上3个模型结构都是典型的直接连接的网络模型,SRCNN网络最主要的优点就是网络结构非常简单,使得模型实现以及调试非常容易,因而该网络结构非常适用于深度SR重建领域的初学者掌握基本方法。但是,SRCNN网络模型的缺点也非常致命,大的卷积核的使用和网络输入是插值放大后的图像使得浅层的网络就需要大量的参数计算,导致该网络在增加深度和宽度时反而引起SR重建效果的下降。相对于SRCNN,FSRCNN和ESPCN减少了计算参数,同时也在一定程度上加深了网络深度,使得重建效果和图像重建质量有了较大提高,特别是ESPCN,简单的结构组成和极高的重建速度使其特别适用于高速且重建精度要求不是很高的实时系统。直接连接的结构面临的最大问题就是随着网络深度的加深,参数逐渐增加,网络训练的难度越来越大,导致网络难以收敛,需要更有效的训练方法,因而直接连接网络模型目前的发展已经出现瓶颈。

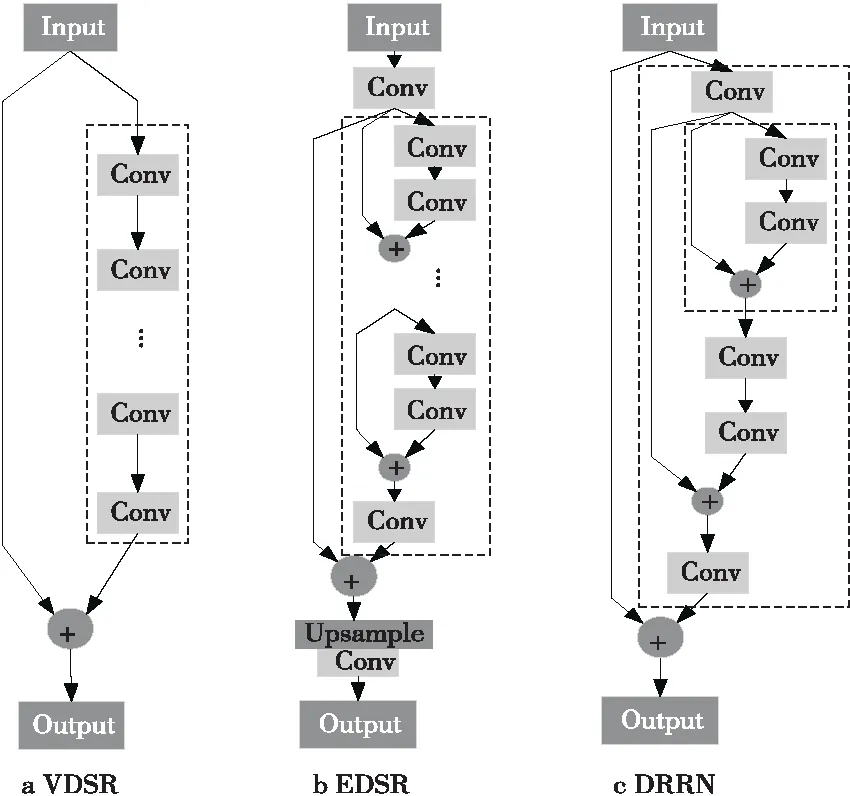

残差网络建模是目前应用最广泛的技术,在现有的深度模型中几乎都有应用。残差连接的成功应用有效提高了ResNet[25]网络的深度,因而在图像SR重建领域也引起了极大关注。由于原始LR图像和输出的HR图像在很大程度上是相似的,也就是说LR图像携带的低频信息与HR图像的低频信息基本一致。残差连接的应用使得原始的稠密矩阵学习转化为稀疏矩阵学习,因而使得计算量大幅度降低。Kim等人[7]于2016年提出了第1个基于残差连接的网络模型VDSR,如图4所示。该网络模型通过在输入和输出之间引入残差连接,使模型对HR图和LR图的残差进行建模,加上梯度剪裁的应用,有效解决了网络加深时无法训练的问题,将网络深度提高到20层,同时VDSR通过对不同尺度大小图像进行混合训练,使网络可以实现单一模型的多尺度SR重建。RED30[26]利用卷积和反卷积构造编码器与解码器结构,卷积层充当特征提取器,它保留图像中对象的主要组件,反卷积层用于恢复图像内容的细节,通过直接相连对应的卷积和反卷积构建残差结构,使网络深度有效提高到30层。

Figure 4 Structural contrast diagram of VDSR、EDSR、DRRN图4 VDSR、EDSR、DRRN网络结构对比图

EDSR[12]和DRRN[14]通过全局残差降低网络训练的难度,通过局部残差学习更加精细的图像细节。有所不同的是,EDSR仅仅是将2个卷积核构建的模块进行简单的堆叠,如图4b所示;而在DRRN网络中,不仅通过多条残差连接构建了局部信息共享,同时在内嵌残差单元时引入递归循环,如图4c所示,通过递归循环的构建从而在加深网络的同时不带来更多计算量,使得网络模型在提高重建图像质量的同时,加快了收敛速度。图4所示为VDSR、EDSR和DRRN的结构对比图。

Lapsrn首次使用融合的方法实现SISR重建。引入融合机制可以对不同频段的像素信息采用不同的SR重建方法,进一步均衡图像重建质量。Lapsrn网络将原始LR图像分解为高频细节部分和低频内容部分,对高低频采用不同的处理方法后将图像融合,得到最终的SR重建图像。网络模型中设置2个支路,分别是特征提取支路和图像重建支路,特征提取支路实现高频特征提取和尺度放大,重建支路将低频尺度放大后与高频特征融合获得重建图像。Lapsrn网络通过对2倍尺度SR模块递归实现高倍尺度的重建,提升了网络训练速度。

IDN在VDSR的基础上,引入多个信息蒸馏单元(DBblocks)作为网络的基本结构,其中,信息蒸馏单元包括一个增强单元和一个压缩单元。增强单元结构如图5a所示,包括2个3层的浅层CNN,通过获取长短路径的特征图从而提升网络的表达能力,压缩单元通过1×1的卷积核压缩增强单元提取的冗余特征。

Figure 5 Enhance unit of IDN network and channel attention mechanism of RCAN network图5 IDN网络结构增强单元 和RCAN网络结构的通道注意力机制

残差连接的优点是使网络在前向传播时,输入信号可以从任意低层直接传播到高层。由于包含了天然的恒等映射,一定程度上可以解决网络退化问题[27]。在反向传播时,误差信号不经过任何中间权重矩阵变换,直接传播到低层,该方法一定程度上缓解了梯度弥散问题,因而残差连接使得原有的复杂矩阵的学习转变为稀疏矩阵的学习,极大地降低了网络学习难度。但是,VDSR网络为了使该网络能够以训练单一的模型实现多尺度的SR重建,因而采用插值放大的图像作为输入,这样的方法使得网络计算量大大增加,网络深度受到限制;同时只引入单跳跃,使网络信息流动提升不够明显,导致网络收敛难度较大,网络模型通过引入梯度剪裁的办法使网络能较好收敛,之后的EDSR等网络就是针对这些问题进行了改进得到的。残差连接由于结构较为简单,SR重建质量也较好,因而能应用在大多数的SR重建场景中。

密集连接建模是受残差连接的启发,在保证网络中层与层之间最大程度的信息传输的前提下,直接将所有层连接起来,使网络中每一层输入为之前卷积层输出的总和,极大地增强了信息流动的能力,有效抑制了梯度爆炸和消失的问题。SRDesnet[28]将密集连接网络结构引入图像SR重建领域,将8个完全一致的稠密块进行堆叠,每个稠密块为密集连接的8个卷积层,如图5b所示,每个稠密块获取的特征进行融合重建SR图像。密集连接的成功应用使得图像SR重建质量有了明显提升。RDN[29]是在SRDesnet稠密块的基础上改进直接堆叠连接的稠密块,通过在密集结构首尾引入残差连接和1×1卷积进行特征降维,构建RDN基本单元RDB,同时RDN网络充分利用每个RDB学习的分层特征,分层特征的充分利用使该网络模型具有更强的特征表达能力。Meta-SR网络模型是在RDN网络的基础上,针对上采样方式进行改进,实现了任意尺度上采样。

D-DBPN[20]是在密集连接的基础上,通过构建多个迭代的上下投影单元实现浅层特征到深层特征的映射,同时通过密集连接使该迭代单元的输入为浅层网络和投影网络块的输出特征堆叠结果,这样一来,浅层的信息通过直接的恒等映射能迅速传递到深层网络结构中,有助于缓解梯度问题。其基本结构如图6所示,图中[L1,…,Lt-1]表示对直接传递的特征进行拼接。在投影单元内构建了交替连接的上下采样和残差连接,同时反馈网络将HR图像的预测过程分解为多个步骤,使网络具有迭代自纠错的能力。

Figure 6 Up-down sampling projection unit of D-DBPN network图6 D-DBPN网络的上下采样投影单元

前面提到的网络模型在空间域和通道域对特征映射进行等价处理,但在实际视觉环境中一幅图像中存在不同重要性的区域和通道[30],等价处理将造成极大的计算资源浪费。RCAN网络构建了通道注意力结构,通过学习不同通道的重要性得到一个权重值,这相当于对信道间特征的相互关系进行建模,自适应调整每个信道特征,从而在有效强化有用特征通道的同时抑制无用特征通道,使计算资源得到更充分的利用。通道注意力机制如图7所示,其基本原理相当于对不同通道特征进行重新加权分布。图7中,HGP运算提取通道描述符,WD和WO为2个全连接网络层的参数,f为非线性变换。同时,RCAN通过构建局部残差和全局残差,使其成为目前图像SR重建领域内深度最深的网络(可达1 000层),从而在现有的硬件条件下,RCAN在峰值信噪比PSNR指标上获得了最佳结果。

Figure 7 Channel attention mechanism of RCAN network图7 RCAN网络的通道注意力机制

3.2 基于CNN-RNN的网络模型

传统的CNN网络采用的是单路径的前馈网络,随着网络结构的加深会引入更多的参数,容易造成网络规模过大,对硬件设备要求高,同时网络训练时易出现过拟合的问题。递归神经网络就是充分利用参数共享机制,使其在不增加参数的情况下加深网络的深度,降低网络的复杂度,加快训练速度。

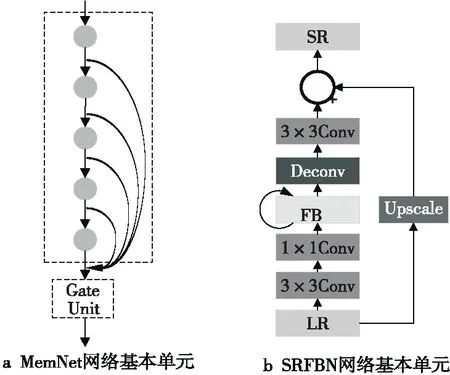

DRCN[13]是第1个CNN-RNN结构的深度网络,它通过循环使用同一个卷积层16次使网络深度扩展到20层,因而相对于SRCNN网络来说,DRCN卷积核的感受野也由原来的13×13扩展到41×41,从而网络能够学习到输入图像的更多细节特征,有效提升了图像重建质量。参数共享机制增加了网络深度但并未带来更多的参数,因而能保持较快的训练速度。但是,递归网络的应用仍然无法避免较高的计算成本,同时会带来固有的梯度消失和爆炸的问题,网络构建的多重监督一定程度上减缓了梯度爆炸和消失问题,但该问题仍然是影响基于CNN-RNN的网络模型重建的重要原因。由于传统前向卷积网络浅层卷积层特征对深层卷积层状态影响较小,因而MemNet网络[31]在DRCN的基础上,通过添加门控单元构建记忆块结构。该门控机制可以建立长期记忆,在每个记忆块中,门控单元自适应地控制不同的卷积层在最终输出中所占的权重,控制保留哪些门控单元,存储哪些信息,因而可以自适应保留有用特征,其基本结构如图8a所示。

SRFBN[21]以迭代反馈结构为基础,构建递归神经网络循环块。SRFBN构建了反馈模块并对反馈状态进行递归传递,使得递归模块输入为LR特征及上一次反馈模块的隐含层的输出特征,从而充分利用原始LR图像引导图像重建过程,获得更好的SR重建图像。如图8b所示为SRFBN网络基本单元。3.1节中提到的DRRN网络模型也利用循环网络实现参数共享。

Figure 8 Elementary unit of MemNet network and SRFBN network图8 MemNet和SRFBN网络结构的基本单元

3.3 基于GAN的网络模型

生成对抗网络GAN(Generative Adversarial Network)[25]是一种生成模型,SISR的任务目标也是生成HR图像,因而GAN非常适宜于解决SISR问题。引入对抗训练能够使网络生成更加精细的纹理细节。生成器和鉴别器的协同训练,使网络不再拘泥于在像素域判断生成图像与实际高分辨率图像的相似程度,同时更加注重在像素空间中的分布相似程度。Ledig等人[8]提出了第1个基于GAN的网络SRGAN,其中生成器采用多个残差结构完成特征映射,与3.1节中提到的基于残差结构的CNN网络非常相似。SRGAN网络生成器使用亚像素卷积实现上采样,鉴别器通过二分类网络结构对生成图像和HR图像进行判别区分。生成器使生成的图像尽可能混淆鉴别器的鉴别结果,鉴别器要尽可能地区分图像真假,通过双方博弈,生成对抗网络结构,克服了3.1与3.2节中所提网络模型重建图像感知质量差的缺点,生成的图像更加自然,感知更好。

ESRGAN[32]在SRGAN的基础上进行网络结构改进。在生成网络中,ESRGAN在构建基础网络结构中移除SRGAN网络中的BN块,以降低重建图像中产生的伪影,将网络残差块的顺序连接转化为密集连接,以充分利用各分层提取的特征,使生成网络能够更好地重建图像。在判别网络中ESRGAN将标准判别器更换为相对平均判别器[33],使网络可以学习更尖锐的边缘和更细节的纹理。

Figure 9 Transformation principle of SR-WDST图9 SR-WDST图像变换原理

SR-WDST[34]充分利用基于感知损失和像素损失的网络的优点,使用小波变换[35]提取基于像素损失模型和感知损失模型的低频部分和高频细节;通过风格变换转换方式[36]将基于感知生成的高频细节融合到基于像素的细节中,从而使高频细节部分具有基于感知和基于像素的生成模型的双重特点;对低频细节部分通过VDSR进行再重建,以恢复更多像素细节部分;最后经过小波逆变换[37]融合获得重建图像,提高了重建图像感知和失真的均衡[38]。其图像变换过程如图9所示。图9中,LLP、LHP、HLP和HHP为基于GAN网络生成图像经小波分解得到的小波系数,其中LLP为低频小波系数,LHP、HLP和HHP为高频小波系数,LL0、LH0、HL0和HH0为基于CNN网络生成图像的分解系数,WDST指图像风格变换,LSE为VDSR图像,ISWT指小波逆变换。

基于GAN的网络相对基于CNN的SR网络获得了更加接近真实感知的重建图像,因此基于GAN的网络更加适用于一些对观感要求较高的任务。但是,由于更加注重像素分布特性,因而图像整体像素的微调对图像的真实感知不会有大的影响,而对于部分需要高精度的像素信息的任务(如遥感图像超分辨用于军事目标识别打击),基于GAN的网络模型明显不适用。同时,基于GAN的网络模型由于要协调生成器和鉴别器进行训练,网络计算复杂,学习速率慢,同时也对硬件具有较高的要求,因而训练难度非常大。

上面提到的3种不同的网络具有不同的特性,因而具有不同的性能和应用场景,其对比如表2所示。

4 损失函数构建

SISR重建网络的目的是找到一个最优的网络映射函数F,对于一组LR图像X和其对应的HR图像Y,精确预测X对应的SR图像F(X),使得F(X)通过最大似然估计越接近于Y,重建图像质量越好。目前SISR领域常用的损失函数有基于像素的损失函数和基于感知的损失函数。

4.1 基于像素的损失函数

均方误差MSE(Mean-Square Error)是最常用的损失函数,在GAN被应用于SR重建领域之前,大量的SR重建网络中都使用MSE作为损失函数进行训练,MSE只是最大似然估计的一种特殊情况,其基本表达式如式(1)所示:

Table 2 Advantages and disadvantages comparison of different network and applicable scenarios表2 不同网络的优缺点和适用场景对比

(1)

其中,L(Θ)表示网络需要优化的损失函数,N表示每个训练批次中图像的数目,Θ表示深度神经网络的参数,F(Xi,Θ)为经网络实现超分辨后的图像,Yi表示对应的HR图像。最小均方误差的应用有效解决了SR重建图像与目标HR图像之间差值衡量问题,使得基于深度学习的图像SR模型相对传统基于学习的SR重建模型有了较大的提高。与MSE相同,平均绝对值误差MAE(Mean-Absolute Error)也是最大似然估计的一种特殊情况。理论上基于L1的损失函数相对基于L2的损失函数具有更小的计算量,在EDSR网络模型中引入MAE损失函数,网络重建图像的质量也有一定的提高。平均绝对值误差(MAE)的基本表达式如式(2)所示:

(2)

其基本符号意义与式(1)中一致。一般来说,对回归模型进行预测时,需要使模型在训练数据上损失函数值最小,即经验风险函数最小化。但是,如果只考虑经验风险,容易造成过拟合,因此还需要考虑模型的泛化能力。常用方法便是在目标函数中引入正则项,文献[17]在L1的基础上提出了一个鲁棒的损失函数,其表达式如式(3)所示:

(3)

不论是基于LMSE的损失函数还是基于LMAE的损失函数,本质上都是反映对应像素之间的误差关系,忽略了像素与邻域像素间存在的内在联系,因而重建图像质量存在边缘模糊和振铃现象。基于像素的损失函数对图像的微小变化非常敏感,例如,图像一个像素的移动造成的视觉影响非常小,人眼感知没有差别,但是会造成评价值PSNR的显著降低,因而其非常适合用于高精度要求的任务。

4.2 基于感知的损失函数

基于像素的损失函数是一种低水平的损失表示方式,导致图像重建质量与人眼视觉感知差距比较大。基于感知的损失函数可以恢复更多的高频信息,使重建图像感观质量更佳。目前SR网络感知损失函数通常是内容损失函数、对抗损失函数和上下文损失函数[39]的组合形式。

内容损失函数包括特征重建损失函数和风格重建损失函数。特征重建损失函数在最小均方误差或最小绝对值误差的基础上,通过预训练的网络结构提取SR图像和HR图像在不同网络层所得的特征向量,最小化提取的特征向量之间的MSE或者MAE。Bruna等人[40]最早提出特征重建损失,通过预训练的VGG19网络分别提取重建SR图像和HR图像在特征空间中对应的特征映射并进行对比。事实证明,通过特征重建损失的应用使重建图像在视觉上获得了相对基于像素损失更令人信服的结果。基于特征重建的损失函数基本表达式如式(4)所示:

(4)

为了使重建SR图像与HR图像的颜色、纹理等保持一致,Gatys等人[41]提出了风格重建损失函数,该损失函数是在特征重建损失函数的基础上,定义了一个Gram矩阵,如式(5)所示:

(5)

(6)

SRGAN网络构建的损失函数中除了基础的内容损失,还包括对抗损失。图像其实是一种高维概率分布的样本,基于GAN的网络模型就是为使重建图像具有与真实HR图像尽可能一致的概率分布。在面对复杂的自然图像分布时,构建包含对抗损失的目标函数进行对抗训练能使重建图像更加自然。对抗损失函数的基本形式如式(7)所示:

(7)

其中,DθD(GθG(X))表示生成图像GθG(X)是真实的HR图像的可能性,N表示一个批次内的图像个数,θD和θG分别表示鉴别网络和生成网络的参数。SRGAN网络最终的优化目标是一个最小最大化的问题,如式(8)所示:

EILR~PG(ILR)[1-logDθD(GθG(ILR))]

(8)

其中,Ptrain(IHR)表示标签HR图像分布,即抽样的每个Ptrain(IHR)服从Ptrain(IHR)分布。PG(ILR)表示LR图像分布,对抗训练使得生成的SR图像与真实的HR图像高度相似,从而判别网络难以分辨,最终获得可以以假乱真的SR图像。ESRGAN在SRGAN的基础上,将判别网络的判别器改为相对平均判别器, SRGAN的判别目标为输入图像是否是真,ESRGAN的判别目标为预测真实HR图像比生成SR图像更真实的概率。判别网络如式(9)和式(10)所示:

D(Xr)=σ(C(real))→1,

D(Xf)=σ(C(fake))→0

(9)

DRa(Xr,Xf)=σ(C(real)-Ε[C(fake)])→1,

DRa(Xf,Xr)=σ(C(fake)-Ε[C(real)])→0

(10)

式(9)为SRGAN的判别网络原理,式(10)为ESRGAN相对判别器原理。real表示真实HR图像,fake表示生成SR图像,C(real)表示鉴别网络判断结果,E[C(fake)]表示一个批次所有生成SR图像经过鉴别网络鉴别的结果的均值。其中σ表示Sigmoid函数,通过改进判别器帮助网络学习更锐利的边缘和细致的纹理特征。

内容损失函数配合对抗损失函数是GAN训练的基本方法,GAN网络重建的结果相对真实,更符合人眼感知。但是,GAN也存在缺陷,如非常难收敛,训练难度大,重建结果影响因素多。为降低训练难度并保证感知质量,Roey等人[39]提出了上下文损失函数,通过最小化真实图像与重建图像在特征空间中的统计分布来提升图像重建质量。上下文损失函数通过最小化KL散度[42]实现特征统计分布的一致性。损失函数表达如式(11)所示:

(11)

(12)

5 实验方法及结果分析

本节主要对本文所提算法进行比较分析。通过在测试数据集上对PSNR、SSIM和NRQM[43]指标进行对比,比较各算法的有效性。常用的SR任务训练数据集为DIV2K[44],它是NTIRE超分辨率比赛专用的训练数据集,包括800幅训练数据图像、100幅验证数据图像和100幅测试数据图像,均为2K的HR图像,包含了自然界中丰富的图像纹理细节,同时也包括对应不同尺度下采样的LR图像,非常适宜图像SR任务。在实验中,需要将数据集中的图像进行对应裁剪,以适应不同SR网络训练。测试数据集为Set5、Set14和BSD100等基准数据集,它们分别包括5幅、14幅和100幅图像对。为公平比较各算法的重建效果,本文选取了Set5、Set14和BSD100数据集作为测试数据集,对4倍尺度SR结果进行比较,基于像素损失函数重建方法的各网络结果比较如表3所示。

表3展示了包括Bicubic和17个本文提到的基于深度学习的超分辨网络。Bicubic指的是通过双线性插值直接对图像尺度进行放大,通过插值相邻像素,学习隐含在其中的亚像素的值,从而获得尺度放大后的图像。通过对这18个网络分析可以看到,基于深度学习的图像SR网络相对传统SR模型在重建质量上取得了质的飞跃,同时近年来图像SR重建领域网络结构也呈现不断加深的趋势。残差网络结构构建使VDSR克服了SRCNN网络无法通过加深网络提高性能的问题,DRCN和DRRN通过构建递归循环,有效实现了参数共享机制,使得网络加深的同时不引入过多的参数,提高重建图像质量的同时保证了较快的训练速度。ESPCN中的亚像素卷积层,有效解决了上采样的速度与质量均衡的问题,使得实时视频上采样问题得到了解决。SRDesnet充分利用分层网络提取的特征映射,保证了信息流的有效传递,为图像重建提供了更多的参考信息。通道注意力机制的应用进一步提升了网络自适应通道处理能力,通过构建残差结构和通道注意力机制,RCAN结构深度可以达到1 000层,同时也获得了最好的图像重建效果。表3中加粗的数据表示现有模型中最佳的SR重建效果。Meta-SR[22]实现了任意尺度SR,使得图像SR应用更加广泛。

Table 3 Comparison of SISR models based on pixel loss function表3 基于像素损失函数的SISR深度模型的比较

基于像素损失函数始终无法避免的问题是重建图像丢失过多的高频信息,边缘平滑,与人眼视觉感知仍存在较大差距。感知损失函数的应用一定程度上提高了图像人眼视觉感知的质量。表4展示了基于感知损失函数与基于像素损失函数网络在Set14数据集上4倍尺度SR结果的比较(加粗数据表示每项评测指标最佳值)。其中L2表示MSE函数,L1表示MAE损失函数,LC表示感知损失中的内容损失函数,LGAN表示对抗损失函数,LCX表示上下文损失函数。为了更好地比较分析,对基于像素损失函数和基于感知损失函数的重建图像进行可视化结果比较,如图10所示。

Table 4 Comparison of SISR models with different loss functions表4 不同类型损失函数SISR深度模型的比较

Figure 10 Visualized reconstruction results of different networks on Set14图10 不同重建网络在Set14数据集上重建结果可视化

通过表4可以看到,在PSNR评价指标上,相对EDSR等基于像素的损失函数网络,基于感知损失函数网络在PSNR值有所降低。但是,通过图10对比可以发现,基于感知损失函数的网络重建图像边缘更加清晰、纹理更加丰富,也更符合人眼感知,引入上下文损失和对抗损失的CX网络模型在NRQM指标上取得了最好的效果,SR-WDST以基于感知和基于像素损失函数的网络为基础,在视觉感知和像素精确度之间取得了较好的均衡,图像重建效果更接近感知失真界。

6 结束语

SISR技术目前已经在安防、医疗等领域内得到重要的应用,是计算机视觉领域的一个重点研究方向。尽管目前深度学习技术在SISR重建任务中取得较大成功,但仍然暴露出许多亟待解决的问题。总的来说,作者认为未来深度神经网络在SISR重建任务中的发展趋势体现在以下几个方面:

(1)构建轻量有效和高精度2类重建网络。网络模型可分为2个主要发展方向,分别是轻量有效的网络和高精度的重建。不同的应用场景对SR重建效果有着不同的要求,对于对重建速度要求高的应用场景,诸如娱乐视频网站、生活照片修复等场景,轻量有效的网络满足该场景对重建速度的要求,同时注意力机制、残差连接、特征融合的应用也可以使轻量有效的网络具有更好的特征表达能力,实现较好的重建效果。而对于一些军事应用场景,诸如敌情侦查、安全搜救等领域,相对于重建速度,重建的精度要求更加严格,因而作者认为轻量有效的网络和高精度的重建网络都是SR模型发展的重要方向。

(2)设计更加科学合理的损失函数。随着感知损失函数的提出,SISR重建任务中恢复了更多的高频纹理细节,但同时带来了PSNR评价指标的下降。因此,低失真和高感知是一个相对矛盾的问题。未来SISR重建任务要求结合人眼视觉感知系统,提出更加符合人眼感知的损失函数;自注意力机制目前在超分辨重建模型中展现了良好的性能,因而其技术也可以用于基于GAN的网络[45,46],同时结合任务需要,在低失真和高感知之间取得均衡。现有网络ESRGAN和SR-WDST已经在此方面做出了探索。

(3)构建多任务的SR网络。现有的SR网络通常为单任务的网络框架,是以数据驱动的网络。实际上,SR重建也可以有效提升图像目标识别、语义分割的效果,因而构建包含SR重建任务的多任务网络也是未来的一个趋势。