基于深度残差收缩网络的HEp-2图像识别

何 涛,陈 剑,闻英友

(东北大学东软研究院,辽宁 沈阳 110169)

0 引 言

自身免疫性疾病是指免疫系统错误地攻击人体组织中的健康细胞,在这种情况下,身体会释放各种抗体,其中一种是抗核抗体(ANA)。抗核抗体类型的特异性因自身免疫性疾病的不同而不同,因此,ANA的识别可以作为协助医疗手段,监督患者体内的破坏程度,具有重要的医学价值。检测ANAs最常用的检测方法是间接免疫荧光法(IIF)[1],IIF显像具有较好的特异性和敏感性,通过检测患者血清中相应的抗体,在诊断特异性自身免疫性疾病中有着重要的作用。

传统的HEp-2细胞模式识别[2-4]方法不仅需要经验丰富的医生花费大量的时间进行人工判别,并且不同的医生对于细胞类型的判断方式是相对主观的,不同医生的判断会出现不一致的情况[5]。因此,构建自动、可靠的HEp-2图像识别模型成为一个重要的研究课题。

1 相关工作

目前在HEp-2细胞分类领域已经开展了深入的研究,尤其是卷积神经网络[6]在这方面的应用更加广泛。Foggia等人[7-8]对HEp-2细胞分类方法的发展进行了全面的总结。Hobson等人[9]提出了在大数据集上的分类方法,分析了在细胞和样本不同层次上的算法及其性能。Shen等人[10]提出了一个基于强度顺序池的梯度特征的HEp-2分类框架,分类性能得到提升。Pomponiu等人[11]提出使用预训练的深度神经网络自动提取一组代表性特征进行分类。Esteva等人[12]用GoogLeNet预训练模型进行迁移学习,得到的结果准确率略高于皮肤病专家的诊断准确率。在AlexNet[13]、VGG[14]网络和GoogLeNet[15]的基础上,He等人[16]提出了一个更深层次的深度残差网络,成为图片处理领域应用最广泛的模型之一。Manivannan等人[17]从HEp-2细胞图像中提取了根筛特征和多分辨率局部模式,并根据支持向量机集合进行分类。谢欣等人[18]提出了一种改进的残差网络算法,根据不同病变程度的宫颈细胞建立权重矩阵,有针对地对假阴性类别的输出进行加权处理,优化分类输出。夏为为等人[19]提出了一种基于残差神经网络的改进算法,通过对训练模型引入动量参数、改变训练样本数量的措施,对各种超参数进行调整,去除冗余信息及噪声,提高算法的识别率。Lei等人[20]提出了一种跨模态转移学习策略自动识别HEp-2细胞。杨云等人[21]提出一种利用批量归一化优化并结合残差学习对图像分割精度进行提升的改进全卷积神经网络U-Net,将批量归一化应用在每一网络模块输出,减少网络内部协变量转移加速网络收敛。Reddy等人[22]研究了基于迁移学习的疟疾感染细胞分类方法的实现,以提高诊断准确率。Xie等人[23]设计了一种基于ResNet的深度监控网络,可以直接指导网络的上下层的训练,抵消不稳定梯度变化对训练过程的影响。娄润东等人[24]在原始ResNet50基础上添加了更高级别的嵌套快捷连接,以挖掘残差网络的优化能力,有效提高细胞分类的正确率和工作效率。

然而,现有的HEp-2细胞识别方法大多是针对单细胞样本的处理,而实际的需求往往是包含许多不同形态的整张图片。因此,本文提出一种图片级的基于深度残差收缩网络(Deep Residual Shrinkage Network,DRSN)的HEp-2图像识别模型,与其他改进的卷积神经网络相比,该模型可以获得更高的分类性能。

2 HEp-2图像识别模型

2.1 数据增强

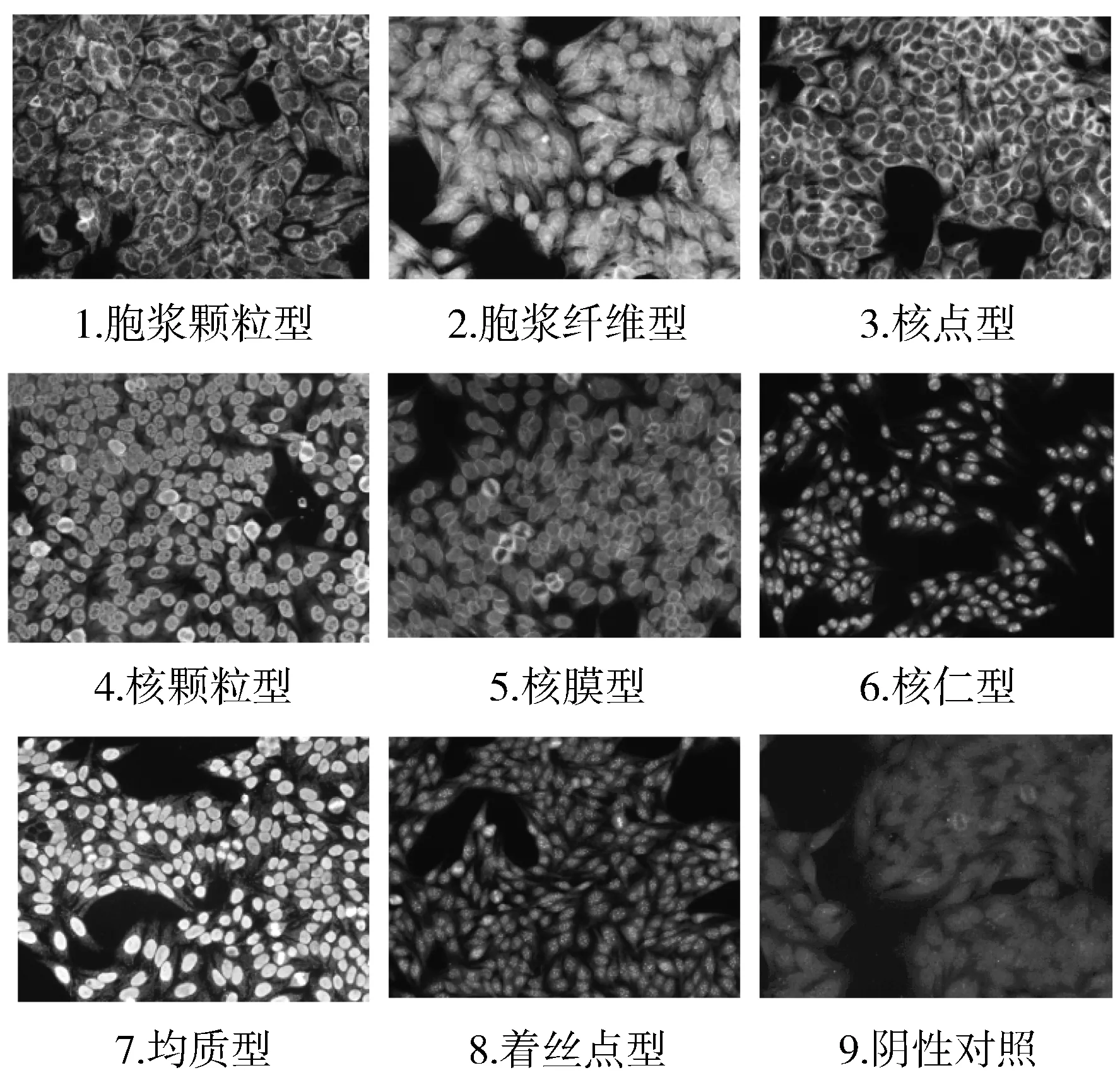

成像的HEp-2细胞图片共分为9个类别,分别是胞浆颗粒型、胞浆纤维型、核点型、核颗粒型、核膜型、核仁型、均质型、着丝点型和阴性对照型,如图1所示。每种类型的图片在形态上具有很大的相似性,使图片特征提取增加了很大的难度。同时由于图片获取过程繁琐,需要检验科医生在显微镜下手工拍照,导致每种类型的图片需要200张左右,数量远远达不到深度学习的要求,需要通过技术手段对HEp-2细胞图像的训练数据集和测试数据集进行数据增强,以达到扩充样本数据集和增强数据特征的作用。

图1 HEp-2细胞图片类型示例

根据HEp-2细胞图片成像和应用的特点,选择使用旋转和翻转2种方式进行扩充。1)以图片中心为原点,将图片以顺时针方向依次旋转5度,共可旋转72次,即用一张图片派生出72张同标签图片;2)在进行旋转的同时,以y轴作为中心线进行翻转,将数据量再增加一倍。

2.2 深度残差学习

对于传统的深度学习网络,一种直观的认知是网络层数越多,生成的模型参数越多,非线性表达能力越强,因此网络可以进行更加复杂的特征提取,在克服梯度消失和梯度爆炸的前提下,所能学习到的特征就越多。经典的CNN网络从5层的LeNet、8层的AlexNet,发展到19层的VGGNet和22层的GoogLeNet,网络的性能逐步提升。然而经过试验发现,传统的CNN网络结构随着层数加深到一定程度,准确率达到饱和之后,更深的网络反而提升了训练错误率和测试错误率,这种问题称之为网络退化问题。

深度残差学习是解决网络退化问题非常有效的方法,该方法并不直接使用几层网络拟合出所期望的实际映射关系,而是拟合一个残差映射,这种方式使得输出变化对权重的调整作用更大,因而训练起来更加容易。用H(x)表示通过若干堆叠的网络层得到的实际映射,x表示对这些层的初始输入,堆叠网络层可以逐渐逼近输入与输出的残差,即H(x)-x。堆叠层拟合H(x)等价于去拟合残差函数F(x)=H(x)-x,而拟合残差函数会更为方便和高效。

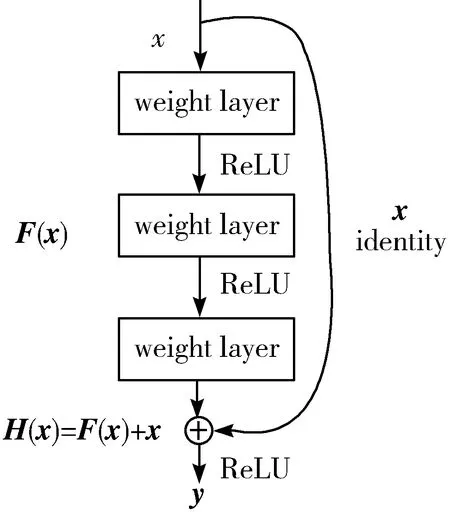

公式F(x)+x通过添加短路连接实现,短路连接是指一种跳过一个或多个层次的连接,并没有引入新的参数,也没有增加计算复杂度,残差学习模块的结构如图2所示。

图2 残差学习模块

在图2中,y表示残差学习模块的输出向量,x表示残差学习模块的输入向量,在F与x维度相同的条件下,y可以定义为:

y=F(x,{Wi})+x

(1)

其中,函数F(x,{Wi})表示学习到的残差映射。如果F与x的维度不相同,无法直接进行运算,则需要在短路连接上作一个线性投影,使用矩阵Ws来解决维度匹配的问题,公式为:

y=F(x,{Wi})+Wsx

(2)

对于图2中的3层网络,F函数的公式表示为:

F=W3σ(W2σ(W1x))

(3)

其中,σ表示ReLU激活函数,为了简化公式省略了偏置项。

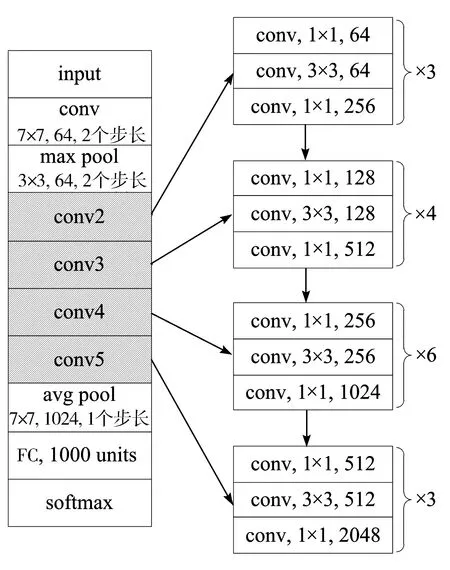

本文使用50层的深度残差网络,其整体网络结构如图3所示。

图3 深度残差网络结构

ResNet-50使用了3层残差学习单元,包含3个输出256个特征图的残差单元、4个输出512个特征图的残差单元、6个输出1024个特征图的残差单元、3个输出2048个特征图的残差单元。在中间3×3卷积层前后使用1×1的卷积层,目的是为了降维,减少计算量。

对于输出特征图大小相同的层,有相同数量的卷积核,当特征图尺寸减半时,则需要增加一倍过滤器数量来保持各层的时间复杂度。在网络的输出端包括一个全局的均值池化层和包含1000个神经元的全连接层(fully connected layers,FC),并使用softmax进行分类。

2.3 深度残差收缩网络

在一张HEp-2细胞图片中,只有局部的部分细胞形态与连接可以体现出该图片的类型,而其他部分细胞则不能作为类别判定的依据,这部分细胞影像即形成噪声,如何去除噪声和冗余数据成为影响模型性能的一个重要问题。

软阈值是信号降噪算法最常用的一个技术,它将信号中小于某个阈值的特征置为0。传统设置软阈值的方法需要业务领域的专家根据专业知识,通过不断的调试来选择一个合适的软阈值,这种方法不具备学习能力,更缺乏可扩展性。因此,将软阈值学习和深度残差网络结合,通过自动学习和调整,形成一种有效地消除噪声信息和构建高判别性特征的方式,其转化公式为:

(4)

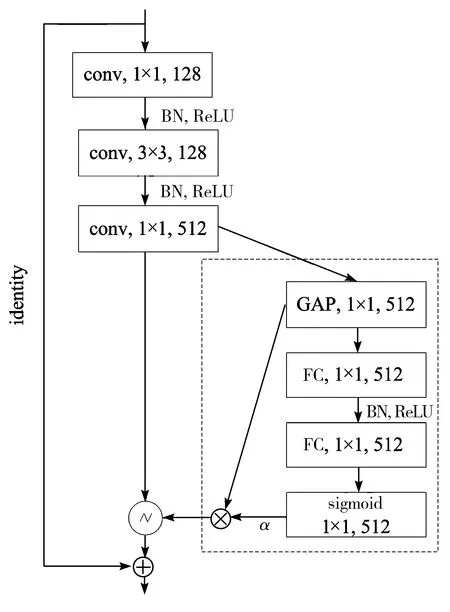

其中,x是输入特征,y是输出特征,τ是正数阈值。特征经过计算之后,绝对值小于τ的特征都会被置0,绝对值大于τ的特征会向中心收缩,因此称为深度残差收缩网络。软阈值不是像ReLU激活函数那样将负值设置为0,这样可以保留有用的负值特征。一个深度残差收缩模块结构可以用图4表示。

深度残差收缩网络是对深度残差网络的一种改进,将软阈值作为非线性变换层插入到残差学习单元中,软阈值学习模块如图4中虚线框内所示。在该模块中,首先将残差单元最后一层网络输出的绝对值经过全局平均池化(global average pooling,GAP),得到与上一层卷积核数量相同的一维向量。将一维向量输入到2层全连接网络中,在2层FC网络的末端应用一个sigmoid函数,将缩放参数进行归一化,公式如下:

图4 深度残差收缩模块

αi=1/(1+e-zi)

(5)

其中,zi是收缩模块最后一层FC网络第i神经元的输出值,αi是将zi进行归一化的结果,阈值计算如下:

τi=αi·average{gm,n,i}m,n

(6)

其中,τi表示特征图第i个通道的阈值,m、n代表特征图的宽度和高度。将缩放参数α乘以{g}的平均值,得到阈值,这是为了限制阈值保持在一个合理的范围内。如果阈值大于特征映射的最大绝对值,则软阈值的输出将为0。

通过在深度残差网络的残差模块中嵌入收缩网络,通过各种非线性变换学习判别特征,消除噪声相关信息,并且阈值是在深层架构中自动学习的,而不是由专家手动设置,真正实现端到端的学习模型。

3 实验结果分析

本文实验的硬件环境是Dell R740服务器,挂载2块NVIDIA Tesla P40的GPU卡;深度学习框架使用TensorFlow 1.12.0版本。

3.1 数据样本分布

本实验使用的样本来自医院LIS系统的真实数据,图像的标注与审核均由具备医学专业知识的人员完成。由于样本数量并不充足,故使用旋转、翻转等一些方法进行数据增强,剔除一些不可用样本后,各个标签的原始图像样本和扩充图像样本分布如表1所示。

表1 各标签样本数量分布

3.2 实验结果分析

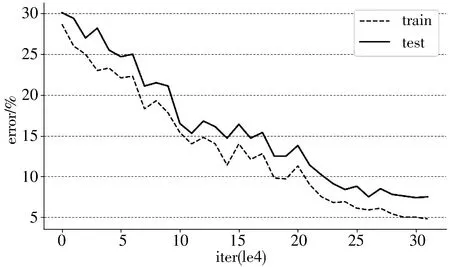

错误率是指分类错误的样本数量占样本总量的比例,从实验过程可以看出,使用深度残差收缩网络,训练集与测试集的错误率随着迭代次数的增加可以很快地下降。图5的曲线展示了样本整体错误率随迭代次数变化的情况,该网络很好地解决了网络退化问题。

图5 训练和测试错误率随迭代次数变化

在机器学习中评估模型的性能通常使用精度P、召回率R、F1分数3个指标,计算公式分别为:

P=TP/(TP+FP)

(7)

R=TP/(TP+FN)

(8)

F1=2×P×R/(P+R)

(9)

其中,TP表示真正类的数量,FP表示假正类的数量,FN表示假负类的数量。由公式可知,P表示正确识别的实体数量与识别出的实体总数的比率,R表示正确识别的实体数量与该实体的总数的比率,F1分数是精度和召回率的谐波平均值。

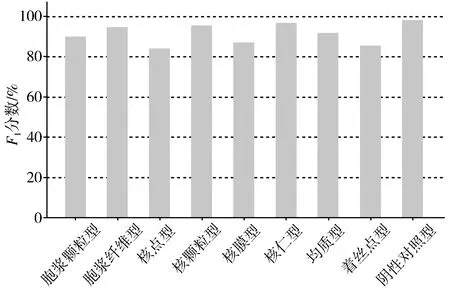

各标签数据在测试集上的F1分数如图6所示。

图6 各标签数据在测试集上的F1分数

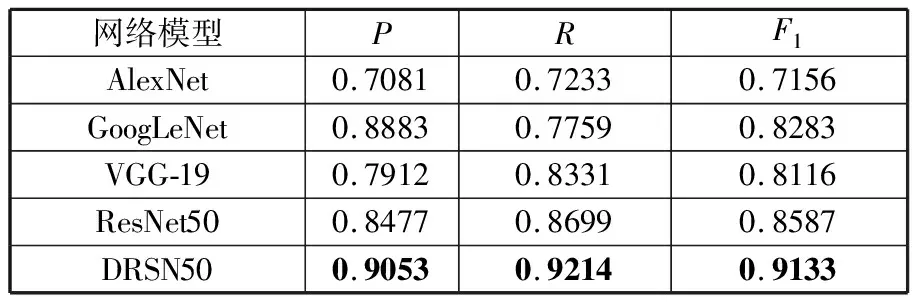

为了验证深度残差收缩网络在HEp-2细胞模式识别性能方面的优越性,在相同数据集上,分别与AlexNet、GoogLeNet、VGGNet和ResNet模型进行比较,各模型性能如表2所示。

表2 各模型在测试集上的性能比较

将软阈值作为可训练的收缩函数嵌入到深度残差网络中,将噪声特征强制置0,从而使学习到的高层特征更具有效性,并且不需要信号处理方面的专业知识。通过与其他的深度学习方法的实验比较,使用了50层的深度残差收缩网络的F1分数达到91%,比50层深度残差网络提高了5.5个百分点左右,比GoogLeNet和VGG-19的F1分数提高10个百分点左右,在性能上有了显著提高。由此可见,在深度学习方法中,将软阈值作为可训练收缩函数进行集成,可以有效地提高对高噪声数据的特征识别能力。

4 结束语

本文提出了一种将深度残差收缩网络用于HEp-2细胞模式识别的方法,首先使用数据增强技术扩充样本数量,然后构建50层的深度残差网络,在每一个残差模块中嵌入软阈值学习子网络,通过自动学习的软阈值对原残差模块的输出数据进行收缩,达到去除噪声的目的,并最终完成HEp-2细胞图片的分类。实验表明,本文模型在HEp-2细胞模式识别性能上超越GoogLeNet、ResNet50等经典的CNN网络,具有先进性。