基于改进K-means聚类算法的大田麦穗自动计数

刘 哲,黄文准,王利平

基于改进K-means聚类算法的大田麦穗自动计数

刘 哲,黄文准,王利平

(西京学院信息工程学院,西安 710123)

单位种植面积的小麦麦穗数量是评估小麦产量和小麦种植密度的一个重要参量。为了实现高效、自动地麦穗计数,该文提出了基于改进K-means的小麦麦穗计数方法。该方法建立从图像低层颜色特征到图像中包含麦穗的一个直接分类关系,从而不需要再对图像进行分割或检测。以颜色特征聚类为基础的这种方法能够估计麦穗在空间局部区域中数量,并且在不需要训练的情况下更具有可扩展性。统计试验结果表明,该文算法能够适应不同光照环境,麦穗计数的准确率达到94.69%,超过了传统基于图像颜色特征和纹理特征分割的麦穗计数方法93.1%的准确率。

图像分割;图像处理;算法;麦穗计数;K-means;聚类

0 引 言

小麦种植密度不仅影响小麦生长对水、肥料的需求,而且影响小麦群体内的通风和透光,进而影响到小麦个体的生长发育,从而影响小麦的产量[1-2]。单位小麦种植面积的麦穗数是实现局部范围小麦产量预测和种植密度评估的重要参数之一。目前国内外已有研究学者将图像处理和视频监控技术应用于作物生长监控中,并且对小麦产量预测做了一些有意义的研究工作,尤其是在基于图像处理技术的小麦麦穗自动计数方面做了一些探索。国内,刘涛等[3]提出了利用图像的颜色特征和纹理特征对大田环境下麦穗图像进行分割,该方法在麦穗图像没有粘连时计数精度较高可达到93%,当麦穗粘连时该方法精度较差。范梦阳等[4]提出了提取麦穗的颜色、纹理特征,采用SVM 学习的方法,精确提取小麦麦穗轮廓,同时构建麦穗特征数据库,对麦穗的二值图像细化得到麦穗骨架;最后通过计算麦穗骨架的数量以及麦穗骨架有效交点的数量得到图像中麦穗的数量,统计的平均计数精度达到93.1%。赵锋等[5]提出一种基于乳熟期小麦麦穗颜色特征以及选取Haar特征的AdaBoost算法相结合的麦穗检测方法,并以综合纹理、形状的LBP特征来取代Haar特征对Adaboost算法改进。Zhu等[6]和Cointault 等[7]分别设计了一种箱式结构的麦穗计数系统,该系统四周用黑色材料进行蒙皮,内部装有彩色摄像机和光源,这种设计能有效地避免太阳光和遮挡阴影对成像的影响,运用图像处理技术实现对麦穗精确计数,但是该系统结构复杂、不便于移动,影响了该系统的运用。Jose等[8]提出利用拉普拉斯频域滤波器去除图像中高频和低频部分,然后用中值滤波器去除麦穗图像的噪声,最后找到图像的局部峰值的个数,从而实现麦穗的计数。Dornbusch等[9]提出基于RGB图像,利用边缘检测、膨胀腐蚀、孔洞区域填充等方法对麦穗进行计数,并且对在不同氮条件下生长的5种无芒小麦品种进行检测试验,麦穗计数准确率达到91%。

其他类似的应用有,如用高分辨率的天顶RGB图像来估计树的密度[10-14],使用了与上述文献类似的图像处理技术。在通过航空和高分辨率卫星图像进行树冠检测时,经常使用平滑滤波器来简化树冠形式并降低图像噪声,同时,局部极大值滤波器也被应用于高分辨率空间图像以检测可能的树冠中心。针对水果测量和识别应用(如苹果、蓝莓、葡萄、芒果等),系统在RGB色彩空间中使用了高分辨率的图像以优化目标对象的图像特征,然后进行分割处理任务[15-23]。作物密度是用于管理农作物和估算产量的关键农艺性状,用高分辨率RGB相机拍摄的RGB图像被分类以识别对应于植物的绿色像素,提取裁剪行并识别连接的组件(对象),然后训练神经网络,使用对象特征估计对象中的植物数量[24]。一些学者基于像素水平的颜色特征[25-27]和纹理特征[26-31]分割果穗,处理速度快,但极易产生噪声。通过生成候选区域,判定候选区域的类别(穗或背景),可提高分割准确度。深度卷积神经网络(convolutional neural network, CNN)是近几年来兴起的一种适用于图像分析的深度学习模型[32-33],已成功应用于农业图像识别与分割。在作物果穗识别与分割方面,Pound等[34]利用CNN实现了小麦特征部位如根尖、穗尖、穗基部等的识别。Xiong等[35]提出了一种基于超像素分割和CNN的稻穗分割算法-Panicle-SEG,能很好地应用于不同品种及生育期的大田稻穗分割,该算 法缺点在于需要构建大量的样本库进行训练,算法耗时较长。

上述方法都是基于图像的颜色特征、纹理特征、Haar特征等,运用图像分割技术或者SVM方法来实现麦穗计数。本文提出基于改进的K-means算法麦穗数量估计方法,该方法通过颜色特征,建立从图像低层特征到图像中包含麦穗数的一个直接映射关系,从而不需要再对目标进行分割或检测。这是一种充分利用麦穗图像颜色特征,将局部区域内提取的子区域面积特征作为麦穗判断依据,从而把聚类区域内的子区域数作为麦穗数估计值输出避免了目标检测和定位的任务。

1 图像获取与方法

1.1 图像获取

麦穗图像于2017年5月中下旬和2018年5月中下旬在宝鸡农科院试验场拍摄,此时小麦正处于灌浆期,生长态势良好。摄像机选用陕西维视MV-E工业相机,该相机为1 000万像素,采用千兆以太网络进行传输,相机功耗低、散热良好,具有图像质量清晰、色彩还原性好和工作稳定等特点,支持IO信号输入输出。小麦品种主要以西农979为主,在晴天逆光条件下垂直拍摄,拍摄高度距离地面150 cm,拍照时间10:00—14:00。另外为了验证本文提出算法的可行性,本文从相关文献和网络收集了相关大量的麦穗图片进行算法的验证。图1给出了部分试验样本图像。

图1 麦穗图像

1.2 图像特性分析

图1所示的图像求反色,结果如图2所示。由图2可以看出,反色图像体现的更加明显,麦穗图像的颜色值、耕地颜色值、叶子和茎秆颜色值三者有明显的差异。基于以上分析,可以用图像聚类算法对麦穗图像进行聚类,从而提取出麦穗。

1.3 改进K-means图像聚类算法

K-means是聚类算法中一种典型的基于距离的聚类算法,采用欧式距离作为相似性的评价指标,即认为2个对象的距离越近,其相似度就越大。该算法认为簇是由空间欧式距离靠近的对象组成的,因此把得到紧凑且独立的簇作为最终目标。该算法通过预先设定的值及每个类别的初始聚类中心对相似的数据点进行划分。并通过划分后的聚类中心与本聚类中其他点之间距离均值迭代优化获得最优的聚类结果。

由K-means算法可以看出,该算法存在以下2个缺点:1)该算法中是事先给定的,这个值的选定是非常难以估计的。很多时候,事先并不知道给定的数据集应该分成多少个类别才最合适;2)算法中,首先需要根据初始聚类中心来确定一个初始划分,然后对初始划分进行优化。这个初始聚类中心的选择对聚类结果有较大的影响,如果初始值选择的不好,可能无法得到有效的聚类结果。

1)本身的密度大,即它被密度不超过它的邻居包围;

2)与其他类之间的类间距大。

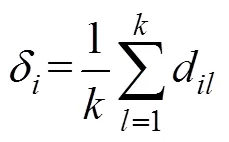

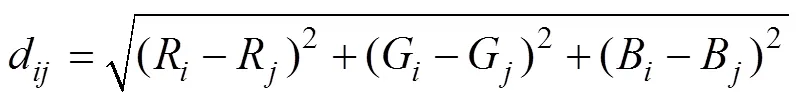

在此定义2个参数ρ和δ,ρ表示第个数据点的局部密度,δ表示第个数据点与最近邻类间距离。首先,求出数据x与数据集中其他数据点x之间的距离d,于是

式中代表密度值最大的个数据点,本文选取2。由上面的分析可以看出,当ρ和δ的值都很大时,可以选取x为聚类中心。

按照上文,计算出每个像素点的(ρ,δ),设t=ρδ,依据麦穗图像由麦穗、耕地和麦叶麦茎3部分构成,选取t值最大的3个像素点作为麦穗图像的3个聚类中心,然后依据相近原则,将所有像素点进行聚类。

1.4 改进的K-means聚类算法性能分析

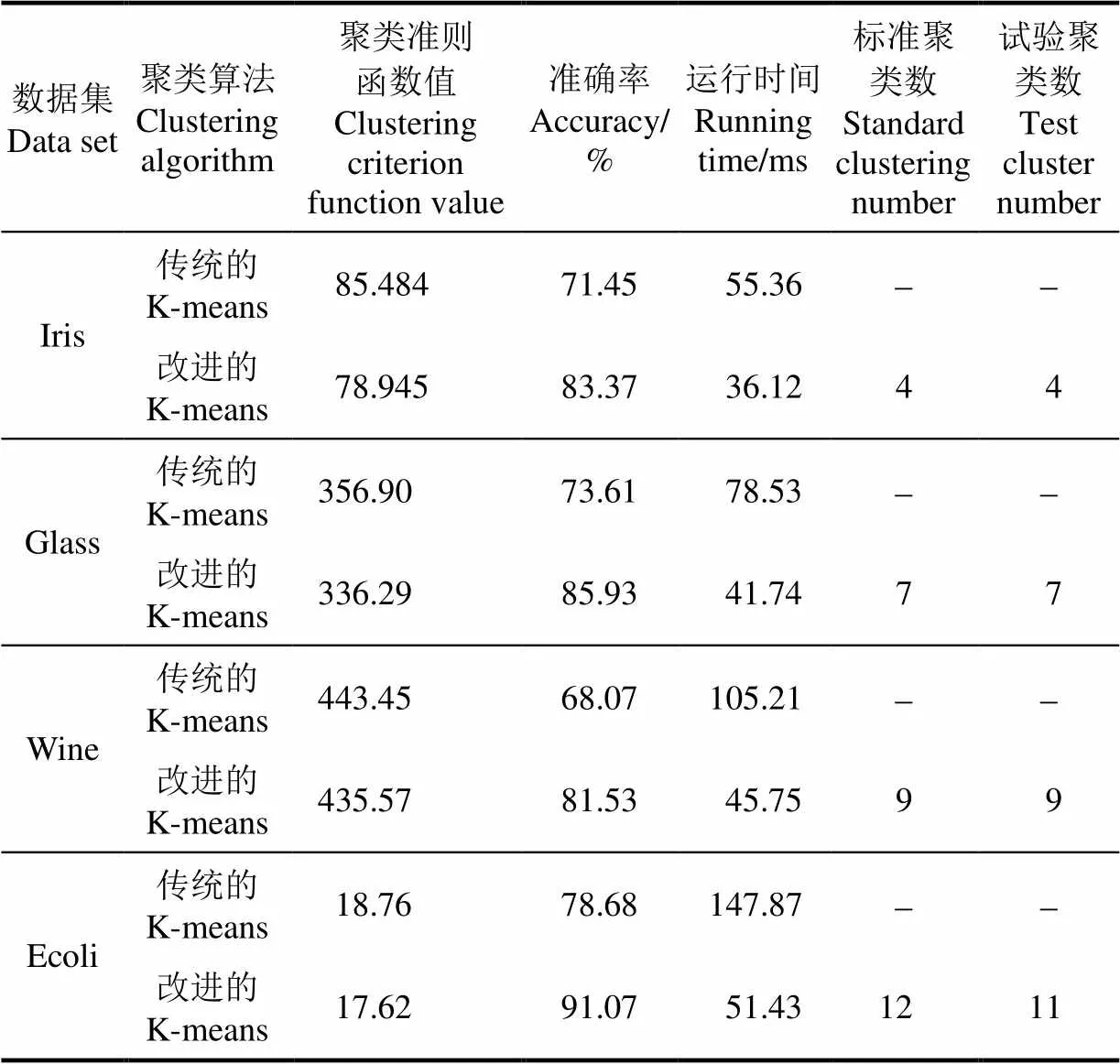

1)传统的K-means算法的聚类准则函数值都明显大于改进K-means算法的聚类准则函数值,聚类准则函数代表类内距离,聚类准则函数值越小代表算法的聚类结效果更好。另外,对于每个数据集,改进K-means算法的聚类准确率都明显高于传统K-means算法,改进K-means算法聚类结果更优,证实了改进K-means算法中选择的初始聚类中心比较理想。

注:ρi表示第i个数据点的局部密度,δi表示第i个数据点与最近邻类间距离;图中数字表示数据编号。

表1 聚类算法性能比较

2)改进K-means算法运行时间上远小于传统的K-means算法。随着类别数和数据量的增加,传统K-means算法运行时间消耗快速增加,而改进K-means算法运行时间消耗增长缓慢。在实际应用中,为了得到较准确的聚类结果,通常都要多次执行K-means算法,而采用本文的改进算法只需执行一次,因此在时间性能上,本文的改进算法要远远优于传统K-means算法。

3)改进K-means算法能够准确地计算出类别数和聚类中心,在随着数据量和类别数增大,改进K-means算法在计算聚类数时会出些错误。

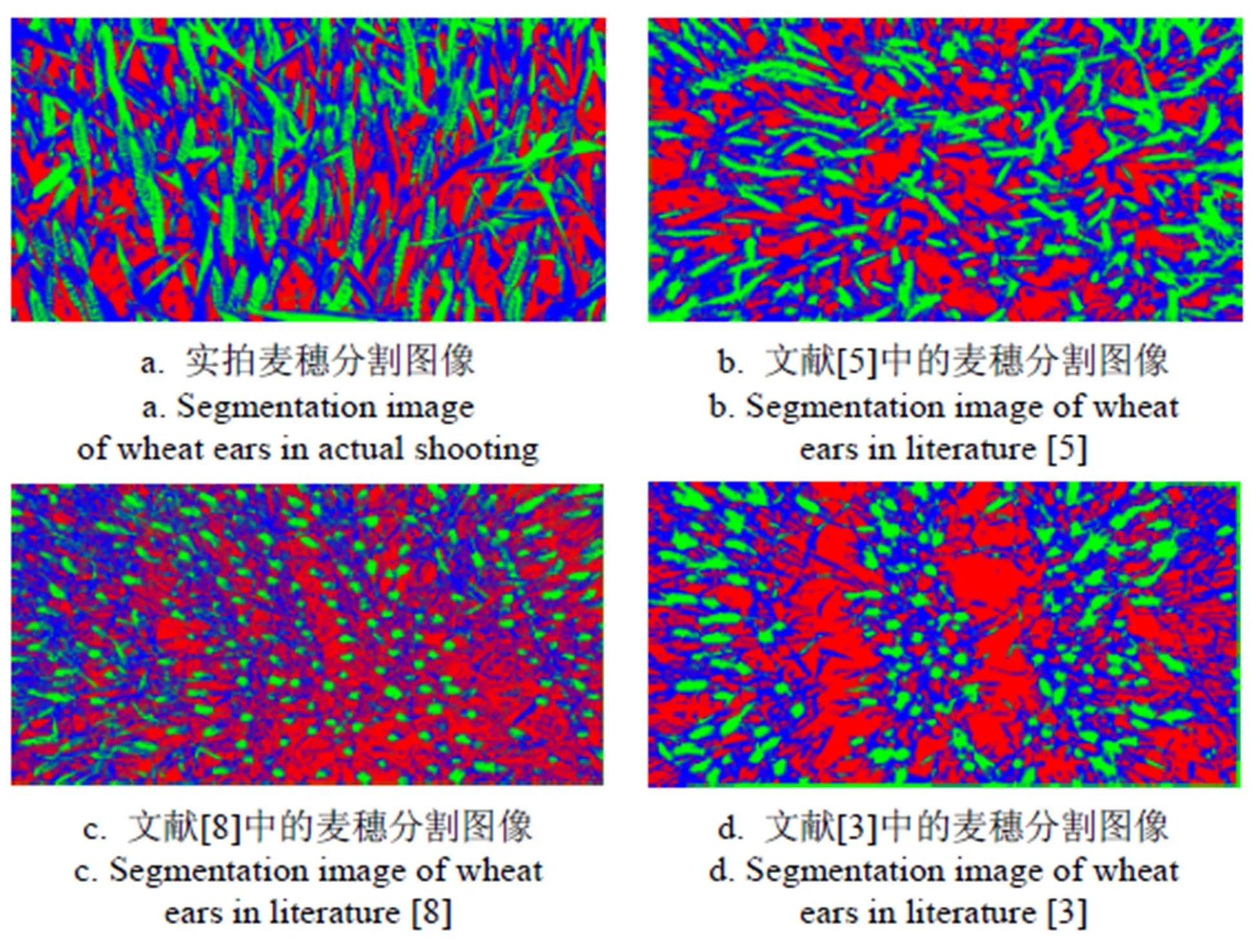

利用改进的K-means算法对图1所示麦穗图像进行分类,结果如图4所示,可以看出,利用本文提出的聚类算法能将麦穗、耕地、麦叶和茎秆很好地区分出来。

图4 利用改进的K-means聚类算法对麦穗图像分割结果

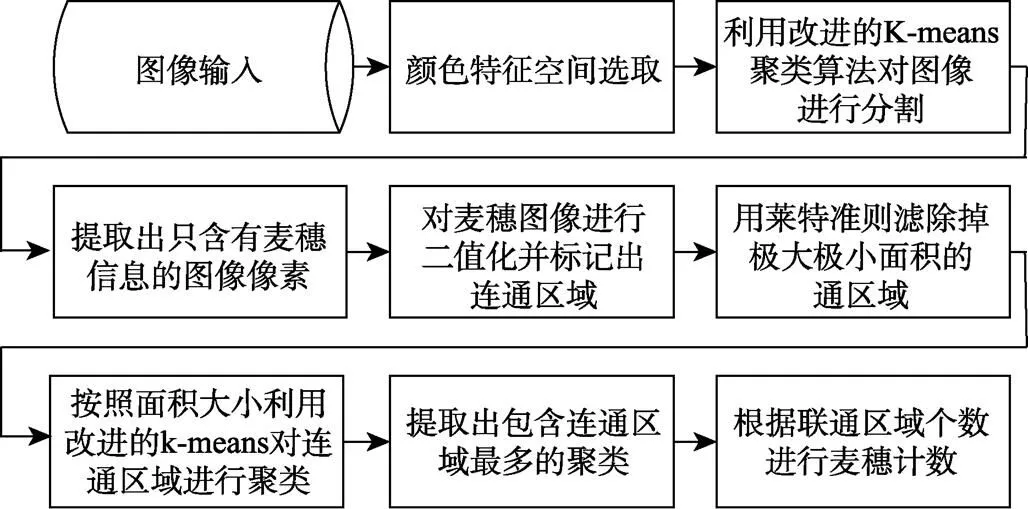

1.5 基于面积滤波和改进的K-means麦穗计数

根据上述分类结果,麦穗图像中绿色区域代表麦穗部分,提取出只含有麦穗的图像并进行二值化,二值化后的结果如图5所示。从二值化图可以看出,图中绝大部分二值化区域是麦穗图像,少部分过小或过大的二值化区域是由叶子影响造成。麦穗计数步骤如下:

1)将图像中的各个孤立连通区域找出并标记;

2)计算各个不同二值区域的面积,面积用区域的像素数表示;

3)运用本文提出的面积滤波器对二值化区域进行滤波,过滤掉面积过小或过大的连通区域;

4)对剩余的二值化连通区域运用改进K-means聚类进行计数,得到麦穗的数量。

根据莱特准则,当时,为异常值予以剔除。经过面积滤波后,滤除了面积极大极小非麦穗连通区域,剩下连通区域就为麦穗。麦穗计数算法流程图如图6所示。

图6 麦穗计数算法流程图

2 试验与结果分析

2.1 试验设计

为了验证本文算法的有效性,于2017年5月初至2017年6月中旬、2018年5月初至2018年6月中旬,在宝鸡农业科学院采集了500幅小麦图片。在晴天逆光条件下垂直拍摄,拍摄高度距离地面150 cm,设计了以下3种试验。

1)选择不同的颜色特征空间,分析本文算法在不同颜色特征空间对麦穗图像的分类效果;

2)在不同光照条件、小麦不同密集程度和不同拍摄角度下本文算法的适应性分析;

3)通过试验,比较本文麦穗计数方法与其他自动麦穗计数方法的准确率及计数效率。

2.2 特征选择

本文通过选取麦穗图像的(,,)颜色空间,运用改进的K-means聚类算法对麦穗图像进行分类,取得了比较好的分类效果,如图3所示。为了进一步分析不同颜色特征空间对麦穗图像分类效果的影响,同时考虑到麦穗图像颜色空间中绿色分量占比大于其他2个颜色分量,所以选取在超绿颜色特征值空间E与绿色特征空间进行本文算法分类效果验证试验。

为了便于比较分析,分别选取图1c和1d在绿色和超绿色2个特征空间进行比较分析。图7给出了这2幅图像中麦穗、耕地、叶子和茎秆在绿色和超绿色特征空间的直方图。由图可以看出:1)在绿色空间基本上可以把麦穗、耕地、叶子区分开,麦穗与耕地、叶片具有明显的差异,可以利用阈值分割进行提取,但也有少量叶片在颜色特征上与麦穗接近,会影响麦穗的提取效果;2)在超绿色空间可以把麦穗、耕地、叶子区分的更为明显,目标的效果分类效果更好。根据对500幅图像的分析,超绿颜色空间更适合于麦穗分割。图8给出了图1 c和1d在超绿颜色特征空间的运用分文算法的分割结果,与图4相比分割效果更优。所以,在下一步实际推广应用中选用超率颜色特征空间。

图8 基于超绿空间的改进K-means图像分割图

2.3 算法适应性分析

拍照时间于2018年5月初至2018年6月中旬的上午10:00至下午14:00,拍照天气覆盖了阴天、多云和晴天,拍照方式有垂直拍摄和侧拍,拍摄高度距离地面150 cm,太阳光有垂直照射、倾斜照射,拍摄的图片涵盖了小麦不同生长期。根据试验结果统计,本文方法能较好地实现小麦麦穗的自动标记和计数,且计数准确率高。图9给出了部分处理结果,分别对应小麦的开花期、灌浆期和成熟期,而且对应了不同小麦密集程度。从处理结果可以看出,本文算法能适应复杂光照情况、不同小麦密集程度和倾斜角度拍照等情况,在实现小麦自动计数方面,具有一定的适应性和拓展性。

图9 本文算法适应性分析结果图

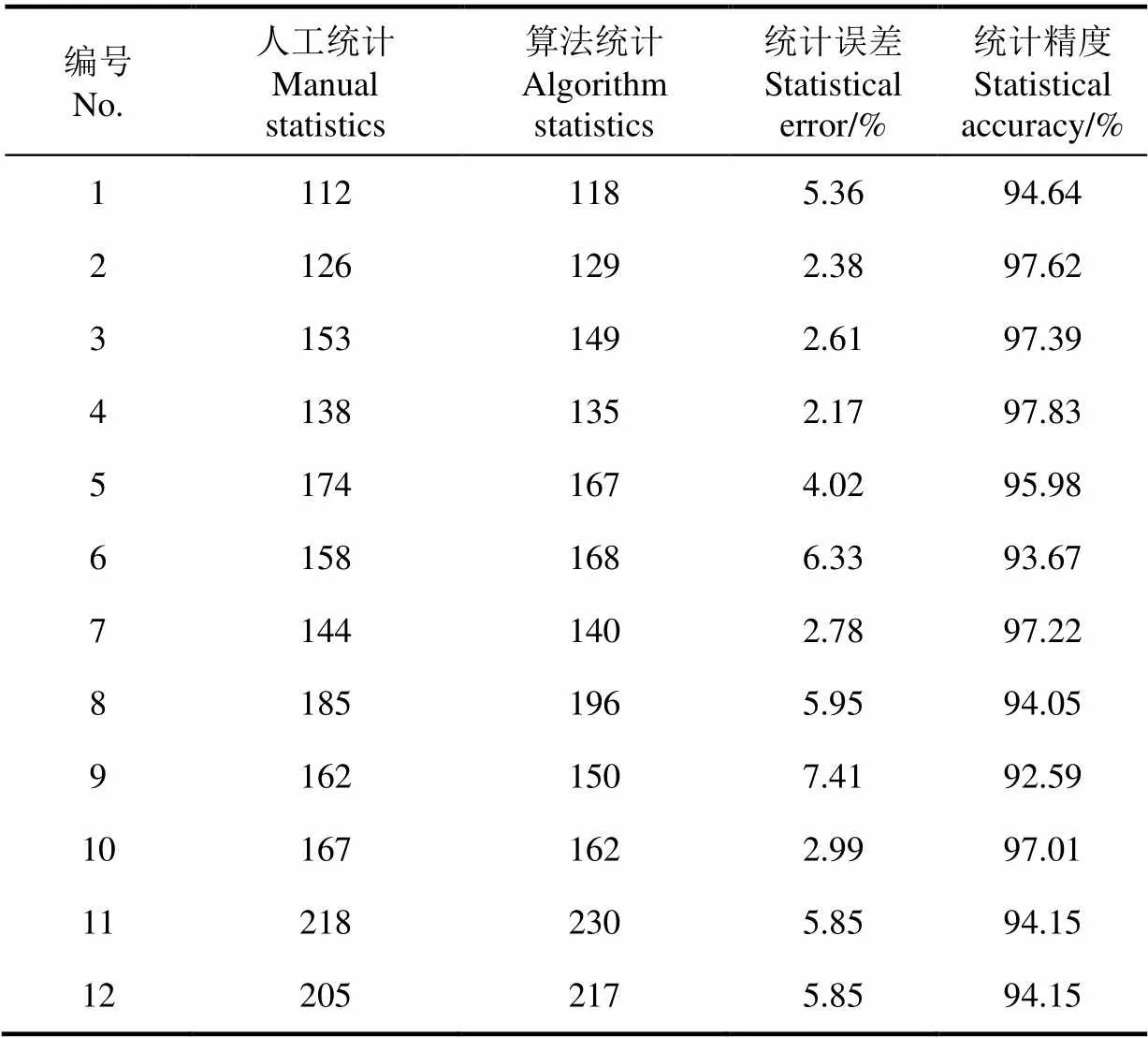

2.4 麦穗计数分析

从试验采集的500幅图像中挑选出12幅图像,分别运用本文算法和人工计数方法进行麦穗计数,统计结果如表2所示。

表2 人工计数与算法计数统计比较

由表2可以看出,统计的平均计数精度是94.69%,赵峰等[25]提出的基于改进的AdaBoost算法精度约为84.3%,而基于Haar 特征的AdaBoost算法的精度约为67.1%。范梦阳等[4]采用提取麦穗的颜色、纹理特征,采用SVM 学习的方法的平均测量精度是93.1%。刘涛等[3]提出利用颜色特征和纹理特征分割麦穗和粘连区域麦穗个数的计算方法,通过对撒播和条播各35幅样本图像进行计数试验,准确率为95.77%。本算法的计数精度高于上述前3种方法,略微低于上述最后一种方法,能满足大田环境下小麦麦穗统计的需求。

将试验中采集的500幅麦穗图像,分别运用赵峰 等[25]、范梦阳等[4]、刘涛等[3]提出的算法和本文提出算法进行麦穗计数,统计每种算法的计数效率。经统计,本文算法的麦穗计数效率分别是以上3种文献中算法计数效率的2倍以上,分别为2.2、2.45、3.13倍。

图10为麦穗利用算法计数和人工计数结果的1:1比较图。可以看出,虽然算法计数较人工计数值较为偏高一些,但总体上两者仍具有一致性,相关系数2=0.923。统计误差在2.17%~7.41%之间,平均为5.31%。以上比较分析表明,说明利用本文方法可以有效地进行麦穗自动计数,且精度较高。

图10 人工计数和算法计数的回归分析

3 结 论

针对传统的基于图像颜色特征、纹理特征、Haar特征的麦穗图像计数方法存在效率低和计数准确率不高等问题,本文提出基于改进的K-means算法麦穗数量估计方法。该方法通过颜色特征,建立从图像低层特征到图像中包含麦穗数的一个直接映射关系,从而不需要再对目标进行分割或检测。这类方法更加适应于复杂的光照和密集麦穗的场景,相比基于图像分割的方法有更高的计算效率。在本文算法中将提取密集麦穗图像中的局部颜色特征,最终图片中的麦穗数估计值由改进的K-means算法获得。该方法能充分利用麦穗图像颜色特征,局部区域内提取的局部区域面积特征作为麦穗判断依据,聚类区域内的子区域数作为麦穗数估计值输出从而避免了目标检测和定位的任务,也可以大大提高麦穗计数的准确率。

1)提出了改进的K-means聚类方法,该方法能够自动提取出聚类中心和自动实现聚类,大大拓展了k-means聚类方法的准确性和提高了聚类效率。该方法运用在麦穗自动计数中,平均计数精度为94.69%,计数效率是传统自动麦穗计数方法的2倍以上。

2)本文算法能适应复杂光照、不同小麦密集程度和倾斜角度拍照等情况,在实现小麦自动计数方面,具有较强的适应性和拓展性。

[1] Olsen J, Kristensen L, Weiner J. Influence of sowing density and spatial pattern of spring wheat () on the suppression of different weed species[J]. Weed Biol Manag, 2006,34(6): 165‒173.

[2] Olsen J, Weiner J. The influence of Triticum aestivum density, sowing pattern and nitrogen fertilization on leaf area index and its spatial variation[J].Basic Appl Ecol, 2007, 43(8): 252‒265.

[3] 刘涛,孙成明,王力坚,等. 基于图像处理技术的大田麦穗计数[J]. 农业机械学报,2014,45(2):282‒290.Liu Tao, Sun Chengming, Wang Lijian, et al. In-field wheatearcounting based on image processing technology[J]. Transactions of the Chinese Society for Agricultural Machinery, 2014, 45(2): 282‒290.(in Chinese with English abstract)

[4] 范梦阳,马钦,刘峻明,等. 基于机器视觉的大田环境小麦麦穗计数方法[J]. 农业机械学报,2015,46(12):234-239. Fan Mengyang, Ma Qin, Liu Junming, et al. Counting method of wheat ear in field based on machine vision technology[J]. Transactions of the Chinese Society for Agricultural Machinery, 2015, 46(12): 234‒239. (in Chinese with English abstract)

[5] 赵锋,王克俭,苑迎春. 基于颜色特征和AdaBoost算法的麦穗识别的研究[J]. 作物杂志,2014,34(1):140-145. Zhao Feng, Wang Kejian, Yuan Yingchun. Study on wheat spike identification based on color features and adaboost algorithm[J]. Crops, 2014, 34(1):140‒145. (in Chinese with English abstract)

[6] Zhu Y, Cao Z, Lu H, et al. In-field automatic observation of wheat heading stage using computer vision[J]. Biosyst Eng, 2016, 53(143): 28‒41.

[7] Cointault F, Guerin D, Guillemin J, et al. In-field Triticum aestivum ear counting using colour-texture image analysis[J]. N Z J Crop Hortic Sci., 2008, 21(36): 117‒130.

[8] Jose A. Fernandez-Gallego, Shawn C Kefauver, et al. Wheat ear counting in‑field conditions: High throughput and low‑cost approach using RGB images[J]. Plant Methods, 2018, 14(22): 21‒33.

[9] Dornbusch T, Hawkesford M, Jansen M, et al. Digital field phenotyping by LemnaTec[Z]. Aachen: LemnaTec, 2015.

[10] Erikson M. Species classification of individually segmented tree crowns in high-resolution aerial images using radiometric and morphologic image measures[J]. Remote Sens Environ, 2004, 32(91): 469‒477.

[11] Leckie D G, Gougeon F A, Tinis S, et al. Automated tree recognition in old growth conifer stands with high resolution digital imagery[J]. Remote Sens Environ, 2005, 33(94): 311‒326.

[12] Leckie D G, Gougeon F A, Walsworth N, et al. Stand delineation and composition estimation using semi automated individual tree crown analysis[J]. Remote Sens Environ, 2003, 31(85): 355‒369.

[13] Pouliot D A, King D J, Bell F W, et al. Automated tree crown detection and delineation in high-resolution digital camera imagery of coniferous forest regeneration[J]. Remote Sens Environ., 2002, 30(82): 322‒334.

[14] Wulder M, Niemann K O, Goodenough D G. Local maximum filtering for the extraction of tree locations and basal area from high spatial resolution imagery[J]. Remote Sens Environ, 2000, 28(73): 103‒114.

[15] Font D, Pallejà T, Tresanchez M, et al. Counting red grapes in vineyards by detecting specular spherical reflection peaks in RGB images obtained at night with artificial illumination[J]. Comput Electron Agric, 2014, 26(108): 105‒117.

[16] Stajnko D, Lakota M, Hočevar M. Estimation of number and diameter of apple fruits in an orchard during the growing season by thermal imaging[J]. Comput Electron Agric, 2004, 16(42): 31‒42.

[17] Tian L F, Slaughter D C. Environmentally adaptive segmentation algorithm for outdoor image segmentation[J]. Comput Electron Agric,1998, 21: 153‒168.

[18] Arroyo J, Guijarro M, Pajares G. An instance-based learning approach for thresholding in crop images under different outdoor conditions[J]. Comput Electron Agric, 2016, 28(127): 669‒679.

[19] Guijarro M, Pajares G, Riomoros I, et al. Automatic segmentation of relevant textures in agricultural images[J]. Comput Electron Agric, 2011, 75(1): 75‒83.

[20] Li H, Lee W S, Wang K. Identifying blueberry fruit of different growth stages using natural outdoor color images[J]. Comput Electron Agric, 2014, 106: 91‒101.

[21] Payne A B, Walsh K B, Subedi P P, et al. Estimation of mango crop yield using image analysis : Segmentation method[J]. Comput Electron Agric, 2013, 25(91): 57‒64.

[22] Payne A, Walsh K, Subedi P, et al. Estimating mango crop yield using image analysis using fruit at “stone hardening” stage and night time imaging[J]. Comput Electron Agric, 2014, 100: 160‒167.

[23] Ruiz-Ruiz G, Gómez-Gil J, Navas-Gracia L M. Testing different color spaces based on hue for the environmentally adaptive segmentation algorithm (EASA)[J]. Comput Electron Agric, 2009, 68(1): 88‒96.

[24] Liu Shouyang, Fred Baret, Denis Allard, et al. A method to estimate plant density and plant spacing heterogeneity: Application to wheat crops[J]. Plant Methods, 2017, 8(3): 1-10.

[25] 赵锋. 基于颜色特征和改进AdaBoost算法的麦穗识别的研究[D]. 保定:河北农业大学,2014. Zhao Feng. Research on Wheat Spike Identification Based on Color Features and Improved AdaBoost Algorithm [D]. Baoding: Agricultural University of Hebei, 2014. (in Chinese with English abstract)

[26] 陈含,吕行军,田凤珍,等. 基于Sobel 算子边缘检测的麦穗图像分割[J]. 农机化研究,2013,35(3):33‒36. Chen Han, Lü Xingjun, Tian Fengzhen, et al. Wheat panicle image segmentation based on sobel operator-edge detection [J]. Journal of Agricultural Mechanization Research, 2013,35(3): 33-36. (in Chinese with English abstract)

[27] Tang W, Zhang Y, Zhang D, et al. Corn tassel detection based on image processing [C]// International Workshop on Image Processing and Optical Engineering. International Society for Optics and Photonics, 2012, 8335:83350J-1-83350J-7.

[28] Cointault F, Guerin D, Guillemin J P, et al. In- field Triticum aestivum ear counting using colour-texture image analysis[J]. New Zealand Journal of Crop and Horticultural Science, 2008, 36(2): 117-130.

[29] Frédéric C, Frédéric J, Gilles R, et al. Texture, color and frequential proxy-detection image processing for crop Characterization in a Context of Precision Agriculture[M]. Godwin Aflakpui: Agricultural Science, 2012.

[30] Zhu Y, Cao Z, Lu H, et al. In-field automatic observation of wheat heading stage using computer vision[J]. Biosystems Engineering, 2016, 143: 28-41.

[31] Duan L, Huang C, Chen G, et al. Determination of rice panicle numbers during heading by multi-angle imaging[J]. The Crop Journal, 2015, 3(3): 211-219.

[32] Lecun Y, Bengio Y, Hinton G. Deep learning[J]. Nature, 2015, 521(7553): 436-444.

[33] 周云成,许童羽,邓寒冰,等.基于面向通道分组卷积网络的番茄主要器官实时识别[J].农业工程学报,2018,34(10):153-162. Zhou Yuncheng, Xu Tongyu, Deng Hanbing, et al. Real-time recognition of main organs in tomato based on channel wise group convolutional network[J].Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE),2018,34(10):153-162. (in Chinese with English abstract)

[34] Pound M P, Atkinson J A, Townsend A J, et al. Deep machine learning provides state-of-the-art performance in image-based plant phenotyping[J]. Gigascience, 2017, 6(10): 1-10.

[35] Xiong X, Duan L, Liu L, et al. Panicle-SEG: A robust image segmentation method for rice panicles in the field based on deep learning and superpixel optimization[J]. Plant Methods, 2017, 13(1): 104-113.

Field wheat ear counting automatically based on improved K-means clustering algorithm

Liu Zhe, Huang Wenzhun, Wang Liping

(710123,)

The amount of wheat ears per unit area is an important parameter for assessing wheat yield and wheat planting density. Generally, phenotype parameters should be obtained by manual count technique which is time-consuming and needs great effort. Aiming at the traditional image segmentation method based on color feature, texture feature and Haar feature, in this paper, we proposed an improved K-means algorithm for estimating the number of wheat ears. This method established a direct mapping relationship from the low-level features of the image to the number of wheat ears in the image through the color feature so that the target did not need to be segmented or detected. This type of method was more suitable for complex lighting and dense wheat ears, and had higher computational efficiency than counting methods based on image segmentation. This method made full use of the color feature of wheat ear image, took the area feature of local region extracted from local region as the basis of wheat ear judgment, and used the number of sub-regions in clustering region as the estimation value of wheat ear number, thus avoiding the task of target detection and location, and greatly improving the accuracy of Wheat ear counting. According to classification results of K-means method, the wheat ear image was divided into three regions. The green area pixel value representing the wheat eat region was set to 255, the pixel value of other areas was set to 0, so the binary image of wheat ears was obtained. Most of the binarized areas in the image were wheat ears, and a small part of the binarized area that was too small or too large was caused by the leaves. Following the steps were used to count wheat ears: 1) extracting the connected regions of the binary image and labeling them; 2) calculating the area of each connected region, the area was represented by the number of pixels in the region; 3) using the following method to filter out the connected region where the area was too small or too large; 4) finally, the number of wheat ears was obtained by counting the retained binary regions. This method established a direct classification relation from the image color feature of the lower layer to the image containing wheat ears so that the image did not need to be segmented or detected. Based on color feature clustering, this method could estimate the number of wheat ears in local area of space, and it was more scalable without training. The average prediction precision of the total wheatear number in a wheatear image for 12 wheatear images was 94.69%. And the Statistical error of the total wheatear number was between 2.17% and 7.41%, the average statistical error was 5.31%. The statistical experiment results showed that the accuracy of this algorithm to wheat ear counting was better than the traditional method based on image color feature and texture feature.

image segmentation; image processing; algorithms; wheat ear counting; K-means; clustering

刘 哲,黄文准,王利平. 基于改进K-means聚类算法的大田麦穗自动计数[J]. 农业工程学报,2019,35(3):174-181. doi:10.11975/j.issn.1002-6819.2019.03.022 http://www.tcsae.org

Liu Zhe, Huang Wenzhun, Wang Liping. Field wheat ear counting automatically based on improved K-means clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(3): 174-181. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2019.03.022 http://www.tcsae.org

2018-08-02

2019-01-11

国家自然科学基金资助项目(61473237);陕西省科技厅重点研发项目资助(2017ZDXM-NY-088)

刘 哲,教授,博士,主要研究方向模式识别、人工智能、智慧农业。Email:757417366@qq.com

10.11975/j.issn.1002-6819.2019.03.022

S126

A

1002-6819(2019)-03-0174-08