基于局部学习的车辆图像识别方法

赵小敏,孙志刚,夏 明

(浙江工业大学 计算机科学与技术学院,浙江 杭州 310023)

基于局部学习的车辆图像识别方法

赵小敏,孙志刚,夏 明

(浙江工业大学 计算机科学与技术学院,浙江 杭州 310023)

随着机动车交通违法行为的增多,民众利用智能手机拍照举报式的监督模式应运而生.针对由手机拍照举报的静态图像的车辆识别问题,提出一种基于局部学习的车辆识别方法.与在整个样本空间里训练一个全局模型的传统方法不同,该方法以局部学习中心选取策略和巴氏距离大小为基础,将样本划分若干子集并在每个子集上训练一个局部分类器.仿真结果表明:与已有形状模型法、超像素级别等图像目标识别方法相比,该方法在静态车辆图像识别的问题上拥有更好的识别率和识别效果.

局部学习;超像素;目标识别;车辆识别

近年来,我国的汽车数量不断增加,交通违法问题也愈发凸显.交警站岗职守与定点摄像监控的方式已越来越难以应对如此大规模增长的机动车.因此,在移动互联网飞速发展的当下,依靠民众随时随地拍摄车辆违法现象进行举报的监督方式应运而生.鉴于流量和社交习惯等限制,这种监督方式大多通过静态图像而非视频提交给交警部门进行举报.在已有的研究中,针对车辆的识别方法大多基于视频和定点摄像机,如Zhang等[1]通过改进基于Haar-like特征的Adaboost算法,提出一种实时的车辆识别检测方法,应用于汽车的安全辅助驾驶中;为了解决高速公路交通监控系统中对检测车辆的外型、位置和大小等不精确问题,Noh等[2]提出一个名为ASW的窗口滑动技术,应用于高速公路无拥塞情况下的车辆检测;Tian等[3]通过突出车牌和车灯并建立一个名为MRF模型作为特征检测区域,提出一种用于复杂城市交通流量监控的车辆实时监测跟踪方法,并可适应于不同天气和交通繁忙情景.董天阳等[4]使用Harr-like与HOG特征相结合,并利用反馈式AdaBoost算法训练分类器,提出一种面向交通视频的前后车辆图像识别方法.基于静态图像的车辆检测识别研究则相对较少,Sun等[5]提出一种改进的HOG特征,结合车底特征和支持向量机,提出一种面向交通场景中静态图像的车辆检测方法.Aarthi等[6]利用颜色变换和贝叶斯分类器,并使用角点地图(Corner map)来移除误检区域,提出一种适用于不同天气和光照条件下静态车辆图像的车辆识别方法.目前,针对移动端拍摄的静态照片情景研究较少,这对民众上传车辆违法行为的图像进行自动筛选处理带来了较大的困难.

笔者将非固定设备拍摄的静态图像的车辆识别问题,转换为基于超像素的背景和目标二分类问题,提出一种基于局部学习的车辆图像识别方法(Vehicle image recognition method based on local learning,VIRLL).算法的基本思想是将图像进行超像素分割后,对图像进行密集SIFT(Scale invariant feature transform)特征提取;然后对提取的特征进行聚类并统计超像素内的特征类别分布,计算特征分布直方图,将其作为支持向量机的训练特征;最后,采用一种局部学习中心样本选取策略,建立局部学习样本空间来训练分类器,从而进行静态图像的车辆识别.

1 车辆图像识别问题分析

1.1 问题分析

在基于视频的车辆识别方式中,通常可利用背景差法[7]提取前景目标区域,从而消除背景干扰.而面向静态图像的车辆识别中,所有信息仅源于一张静态图片,无法方便地获取背景信息,并且背景也会因为拍摄角度不同而表现不同,因此存在背景干扰的问题.

车辆图像目标识别面临的另一项巨大挑战就是车辆图片的内部差异.车辆图像会因为车辆的型号、颜色等不同而呈现出不同的特征.即使是同一辆汽车,在不同的光照、拍摄角度和拍摄距离等条件下,也会有较大差异.

为解决上述两个问题,笔者提出VIRLL采用超像素分割的方式,将一幅车辆图像分割成多个像素区域,并通过支持向量机分类器分出车辆区域来减少背景影响.同时引入局部学习理论,以减少车辆内部差异所带来的分类准确度影响.

1.2 超像素分割

超像素是指由一些拥有相似纹理、颜色和亮度等特征的相邻像素所构成的像素块.它将像素依据特征来分组,进而可以获得图像的冗余信息、局部特征等,为后续的图像处理带来了极大方便[8].采用Achanta等提出的SLIC超像素分割方法[9],具有速度快、生成的超像素紧凑均匀等优势,其步骤如下:

2) 相似度计算.对于每个像素点,分别计算与其最近的种子点间的相似度,将其以最相似的种子点标签标记,不断迭代直至收敛.相似度定义为

式中:x,y为像素空间坐标;l,a,b为像素在Lab色彩模型下的各分量值;m为平衡系数,用来权衡颜色与空间信息间的比重;d为种子点间距离.

1.3 局部学习

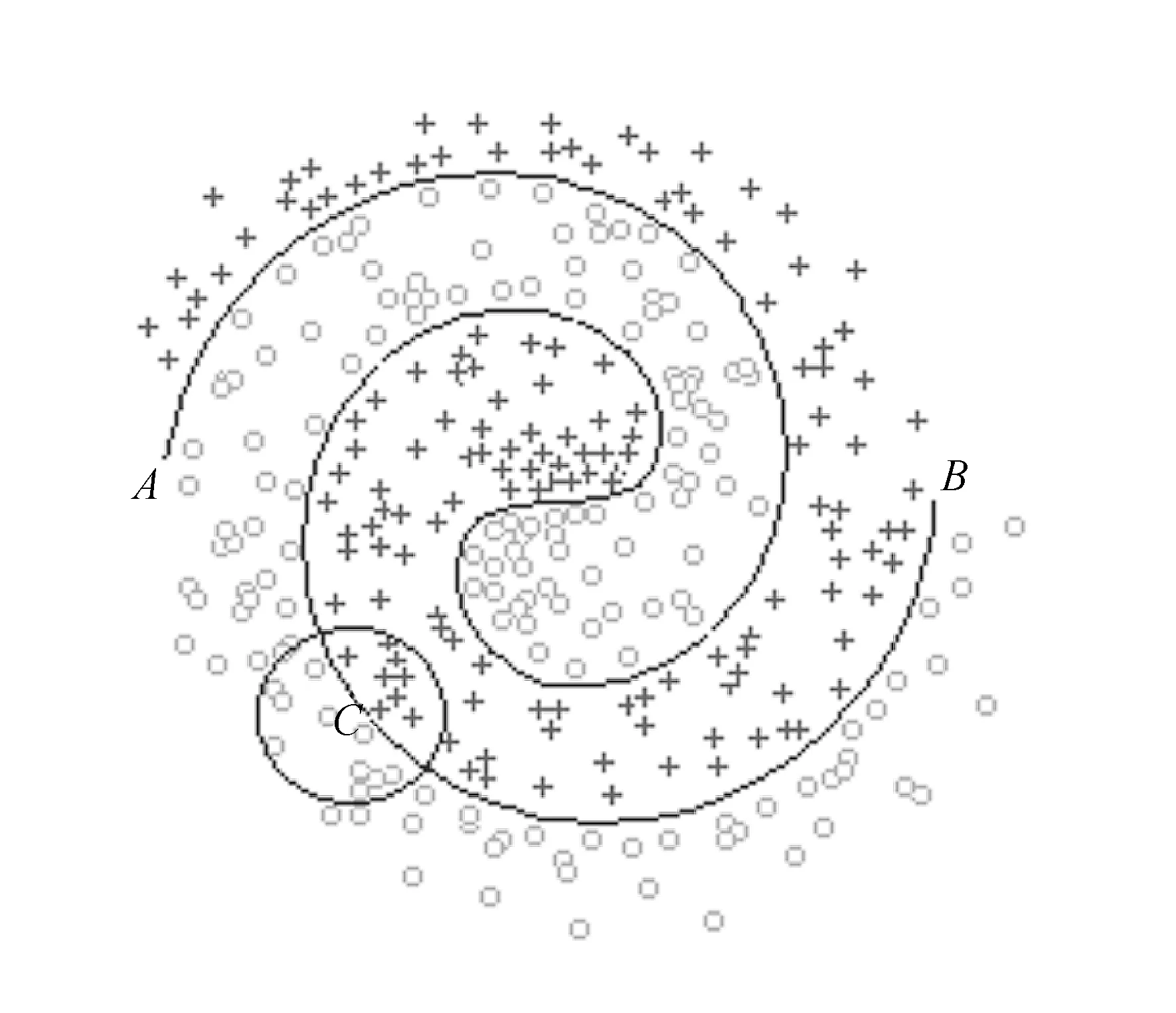

局部学习是一种能够有效地解决内部间差异问题的方法,考虑多个局部模型而非全局方法中的一个全局模型,并且每个局部模型都是由总样本中的子样本集训练得到的,如图1所示的费马螺线[10]问题.

图1 费马螺线问题示意图Fig.1 The sketch map of Fermat spiral problem

图1中两种类别的样本分布在二维平面上,分别以加号和圆圈进行表示,曲线AB代表这两类样本的一个可能分类决策边界.从图1可看出:这两种样本分布呈螺旋状,高度非线性化,在实际应用中训练如此复杂的分类器是比较困难的.相反地,对于局部的样本子集C,在其范围内可以训练一个局部分类器,它对C样本子集的分类性能显然会优于全局分类器,同时也大大减少了分类器训练的复杂度.

2 车辆图像识别方法

VIRLL车辆识别方法是以超像素作为分类单元.由于车辆本身含有车窗、车身、车灯和车牌等不同的区域,如果分割出的超像素过大,可能会出现一个超像素块内包含上述多种区域或者同时含有车辆目标和大量背景信息的情景,从而影响特征描述和识别效果;倘若分割出的超像素过小,不仅会使得超像素所携带的特征过于局部性而不利于表述语义信息,还会带来过大的计算量.因此,需要在所分割的超像素大小上找到一个较为合理的平衡点,如图2所示.

图2 VLfeat库[11]超像素分割示意图Fig.2 The sketch map of superpixelsin VLfeat Lib

图2中,rs为超像素的区域大小.在图2(a)中初始超像素区域大小rs=10,分割得到大量的超像素且每个超像素大小都过小,车辆边缘描述很细腻但所携带的特征信息过于局部化.图2(c)中区域大小rs=100时,所得到的超像素数量大大减少,但目标车辆上的部分超像素过大而且部分车辆目标上的超像素包含了大量背景像素,势必会导致在训练分类器时受到这些背景干扰而影响训练的准确性.图2(b)为一种较为合理的分割结果,超像素大小适中且车辆目标上的超像素不含或只含少量背景信息.

在图像处理领域广泛应用的SIFT特征,具有抗角度变化、尺度变化和扭曲旋转等诸多优点,但对于以超像素为单位的情景,单个超像素内可能并不含有关键点,以至于采用SIFT特征不足以描述超像素特征.在特征提取阶段,采用省略关键点检测的DSIFT特征(Dense SIFT)[11-12],保证每个超像素内的特征数量以及局部梯度信息的直方图统计.对于一个给定尺度的图像L(x,y),像素点的梯度[12]计算式为

θ(x,y)=tan-1[((L(x,y+1)-L(x,y- 1))/(L(x+1,y)-L(x-1,y))]

式中:m(x,y)为梯度的模;θ(x,y)为梯度方向.DSIFT特征提取过程采用滑动窗口的方式,滑动步长为1,逐列对图像中的像素点进行密集采样.每次以窗口中心为特征点,计算该窗口中心4×4像素区域内的梯度,并将每个子域的梯度量化为8个方向上形成直方图向量,最终将所有梯度直方图向量串接成特征点的一个128维特征描述子:

V=[v1,v2,…,v128]

算法1 CSPLL

输入:样本空间集S,中心个数Nc

输出:局部样本集C

1) 初始化C

2) 根据真值信息将S分为正样本集S1和负样本集S0

3) 在S1中随机选取Nc个样本作为种子点集合Rc

4) foreachrc∈Rc

5) 在S0中选取与rc距离最小的负样本s0

6)rc←s0

7) 在S1中选取与rc距离最小的正样本s1

8)rc←s1

9)rc作为一个中心样本加入集合C

10) end foreach

11) returnC

对于C中的每个局部样本子集ct,设其中心样本为zt,拥有的样本数量为at.分别在S0和S1空间内,计算各正负样本与zt的距离,选取N0个距离最近的负样本和N1个正样本,将其添加到ct中,其中N0=λ·N1,λ为局部学习正负样本比例系数.

欧氏距离是各领域广泛应用的距离计算方式,通常情况下它可以满足绝大数需求.但它有一个明显的缺点是将各分量等同看待,如对于2个n维向量a(x1,x2,…,xi),b(y1,y2,…,yi),其欧式距离Do为

显然a向量中xi+Δ分量对ab间欧式距离Do的影响与xi是等同的.而超像素特征的本质是一个直方图信息,同等对待hi的各分量势必会对特征区分带来影响从而降低分类的准确度.因此,这里采用巴氏距离来计算样本直方图特征间的距离,离散巴氏距离计算式[14]为

DB=-ln(B)

式中B为巴氏系数,是对两个样本间重叠量的计算.当两个直方图特征的各分量重叠得越多,所得的巴氏系数B会越大,也就代表着两个样本越相关,最终巴氏距离DB也就越小.这样可以在计算样本间距离的同时,把直方图特征hi的各分量进行区分.

在局部样本集合C中,依据局部学习理论以ct作为训练集为每个局部模型训练一个局部SVM分类器,并在预测阶段以各局部SVM分类器的判定结果作为最终分类结果.具体的车辆识别训练阶段算法如下:

算法2 训练阶段

输入:训练图像集I,真值图像集I0

输出:SVM分类器集合svm_set,局部样本集C

1) 初始化T,P,S,S1,S0

2) foreachi∈I

3) 对i高斯平滑滤波处理

4)pi←SLIC(i)

5) DSIFT(i),并加入集合T

6)pi加入集合P

7) end foreach

8)k-means(T)

9) foreachpi∈P

10)hi←统计pi内tj的类型kr分布

11)hi归一化,并加入集合S

12) end foreach

13)C←CSPLL(S)

14) foreachct∈C

15) 计算ct样本中心zt与S0和S1中各样本的距离

16) 选取最小的N0个负样本加入ct

17) 选取最小的N1个正样本加入ct

18) 以ct为样本集训练SVM,得到的分类器加入svm_set

19) end foreach

20) return svm_set和C

算法3 预测阶段

输入:测试图像I′,SVM分类器集合svm_set,局部样本集C

输出:识别的图像R

1) 初始化T′,P′,R

2) 对I′高斯平滑滤波处理

4) DSIFT(I′),并加入集合T′

9) end foreach

13) foreachct∈C

15) end foreach

16) 选取距离最小的zt

20) end if

21) end foreach

22)R←P′

23) ReturnR

3 仿真实验与结果分析

为验证车辆识别方法的有效性,使用Matlab 2014在windows7×64平台下利用Graz-02数据库[10]中的Cars库进行仿真实验.Graz-02数据库中的车辆图片内差异较大,背景也很复杂,如图3所示.

图3 Graz-02数据库部分图片Fig.3 Some examples in the Cars lib of Graz-02

实验的超像素分割和特征提取部分使用VLfeat[11]库实现,对图片的每个像素点进行DSIFT特征提取.SVM分类器使用libsvm[15]库,核函数选择线性核,损失函数c采用交叉验证法确定.选取车身比例适中的训练图片40张,阈值θsp=0.5,k-means聚类k=400,共得到总样本空间大小为5 200,建立局部学习中心440个,每个中心选取正负样本各150个,分别训练这440个SVM分类器.

结果评价标准使用分类、检索问题普遍应用的查准率(Precision ratio)、查全率(Recall ratio)以及Precision-Recall曲线[16].VIRLL方法虽是以超像素为识别单位,但为了方便与其他方法比较,这里采用像素级别的查准率和查全率,其定义为查准率=被正确判定为车辆的像素数/被判定为车辆的总像素数;查全率=被正确判定为车辆的像素数/真正车辆区域的总像素数.从Graz-02数据库余下的图片中选取30张进行预测,根据SVM分类器返回的决策值矩阵,通过改变不同的阈值进行多次检索查询得到Precision-Recall曲线及实验所得到的识别结果,分别如图4,5所示.

图4 Precision-Recall曲线Fig.4 The Precision-Recall curve of VIRLL

图5 部分车辆识别结果Fig.5 Recognition results of VIRLL

图4中实线为车辆图像识别方法VIRLL在超像素区域大小rs=50时由仿真实验得到的Precision-Recall曲线,点线为rs=60时对应得到的结果,虚线是随机分类时的对比结果,其中横纵坐标单位为1,即为百分比.对于一个好的识别系统,应该同时拥有更高的查全率和查准率,即Precision-Recall曲线越靠近坐标(1,1)的位置系统性能越好.图5中第一列为原图,第二列为对应的真值图片,第三列和第四列分别为rs=50和rs=60时实验所得的对应识别结果.图4中rs=60的Precision-Recall曲线要比rs=50的更接近(1,1)点,说明系统性能更好,主要是因为rs=60时每块超像素面积更大,统计的直方图特征更易于后期分类.但由于超像素增大,车辆边缘处的超像素更容易含有更多的背景像素,使得分类器误判的几率也更大,误判时会导致识别出的车辆产生缺失,如图5(c)第四列和图5(b)第四列结果所述.在识别结果中,所识别的目标车辆区域存在一些非车辆的像素区域和误识别区域,原因是在超像素分割阶段并未完全保证所分割的超像素只含有车辆或背景像素中的一种,因此存在两者共存的超像素,当其被SVM分类器判定为车辆区域或背景时便出现了图5(b)第三列和第四列的情况.另外,由于同时含有车辆和背景信息,在SVM分类器训练阶段也会对分类器准确性造成影响,从而产生误识别的超像素,如图5(a)所示.为了优化识别效果和准确度,可在超像素分割阶段分割出小块超像素,然后将小块超像素按一定规则进行邻域合并,减少车辆和背景共存的超像素,从而减少“阴影”区域.

在Precision-Recall曲线中,令查全率=查准率,找到的点为等错点(Equal error rate, EER)[10],将该点的像素级查全率(查准率)值作为识别率的评价标准.可见该点为Precision-Recall曲线与p=r的交点,该点处值越大代表着Precision-Recall曲线越接近右上角(1,1)位置,所得的分类器性能也越好.笔者将VIRLL方法与形状模拟法[17]和超像素级别LL[10]在Graz-02的Cars数据库上进行对比:Marszalek等所提出的利用形状模型来模拟相似特征的识别方法中,Precision-Recall曲线与p=r的交点(EER点)出现在53.8%[17]处;在基于局部学习(LL)的超像素级别图像目标识别方法中,其Precision-Recall曲线的EER点在69.2%[10]处;VIRLL识别方法在rs=50时,Precision-Recall曲线的EER点在70.4%,而rs=60时EER点在74.2%处,均大于上述2种方法的结果,由此可见:在车辆图像识别问题上,笔者提出的基于局部学习的车辆图像识别方法(VIRLL)与其他2种方法相比拥有较优的识别率.

4 结 论

针对移动设备拍摄的静态图像中因存在内部差异和背景干扰而引起的低识别率问题,提出一种基于局部学习的车辆图像识别方法(VIRLL).该方法以超像素内的DSIFT特征类别分布直方图为特征,使用局部学习中心样本选取策略(CSPLL)来确定局部学习的各样本子集中心,并添入一些拥有最小巴氏距离的正负样本来组建各局部样本空间,以此来训练各局部SVM分类器.从仿真实验结果可以看出该方法拥有良好的识别效果.为了提高识别效果和准确度,在下一步的研究工作中,可考虑利用车辆的先验知识或优化超像素分割,将小块超像素按一定规则进行合并,减少车辆和背景共存的超像素,从而进一步提高识别率.

[1] ZHANG Yunzhou, SUN Pengfei, LI Jifan, et al. Real-time vehicle detection in highway based on improved Adaboost and image segmentation[C]//IEEE International Conference on Cyber Technology in Automation, Control, and Intelligent Systems. Shenyang: IEEE,2015.

[2] NOH S J, SHIM D, JEON M. Adaptive sliding-window strategy for vehicle detection in highway environments[J]. IEEE transactions on intelligent transportation systems,2015,17(2):1-13.

[3] TIAN Bin, LI Ye, LI Bo, et al. Rear-view vehicle detection and tracking by combining multiple parts for complex urban surveillance[J]. IEEE transactions on intelligent transportation systems,2014,15(2):597-606.

[4] 董天阳,阮体洪,吴佳敏,等.一种Haar-like和HOG特征结合的交通视频车辆识别方法研究[J].浙江工业大学学报,2015,43(5):503-507.

[5] SUN Diqing, WATADA J. Detecting pedestrians and vehicles in traffic scene based on boosted HOG features and SVM[C]//Intelligent Signal Processing (WISP),2015 IEEE 9th International Symposium on. Siena: IEEE,2015:1-4.

[6] AARTHI R, PADMAVATHI S, AMUDHA J. Vehicle detection in static images using color and corner map[C]//International Conference on Recent Trends in Information, Telecommunication and Computing. Kochi:IEEE,2010:244-246.

[7] 彭宏,韩露莎,王辉,等.基于小波变换与多帧平均法融合的背景提取[J].浙江工业大学学报,2013,41(2):228-231.

[8] 王春瑶,陈俊周,李炜.超像素分割算法研究综述[J].计算机应用研究,2014,31(1):6-12.

[9] ACHANTA R, SHAJI A, SMITH K, et al. SLIC superpixels compared to state-of-the-art superpixel methods[J]. IEEE transactions on pattern analysis & machine intelligence,2012,34(11):2274-2282.

[10] 冯雪娇.基于局部学习的超像素级图像目标识别[D].大连:大连理工大学,2011.

[11] VEDALDI A, FULKERSON B. Vlfeat: an open and portable library of computer vision algorithms[C]//Proceedings of the 18th ACM International Conference on Multimedia. Firenze: ACM,2010:1469-1472.

[12] 张晓明.基于SIFT特征的人脸表情识别研究[D].南京:南京邮电大学,2014.

[13] HARTIGAN J A, WONG M A. Ak-means clustering algorithm[J]. Applied statistics,1979,28(1):100-108.

[14] 梁亦聪,丁晓青,方驰.开集人脸识别中的性能评估系统[J].模式识别与人工智能,2014,27(4):289-293.

[15] CHANG C C, LIN C H. LIBSVM: a library for support vector machines[J]. Acm transactions on intelligent systems & technology,2011,2(3):1-27.

[16] 潘翔,陈敖,周春燕,等.基于视图特征点分布的三维模型检索算法[J].浙江工业大学学报,2013,41(6):641-645.

[17] MARSZALEK M, SCHMID C. Accurate object localization with shape masks[C]//IEEE Conference on Computer Vision and Pattern Recognition. Minneapolis: IEEE,2007:1-8.

(责任编辑:陈石平)

A vehicle image recognition method based on local learning

ZHAO Xiaomin, SUN Zhigang, XIA Ming

(College of Computer Science and Technology, Zhejiang University of Technology, Hangzhou 310023, China)

Along with the increase in vehicle traffic violations, a supervising mode that people use smart phones to take pictures and report the illegal phenomenon comes into being. For the problem that recognizes vehicle from the photoes taken by smart phones, a vehicle recognition method based on local learning is proposed. We divide the sample into several subsets basing on center selection policy for local learning and Bhattacharyya distance, then train a local classifier for each subset, which is different from the traditional training on the whole sample space. The simulation results show that, compared with several existing image target recognition method, this method has better recognition rate and a good recognition effect on the recognition problem of vehicle static image.

local learning; super pixel; object recognition; vehicle recognition

2016-12-06

国家自然科学基金资助项目(61401397);浙江省科技厅公益资助项目(2014C33073)

赵小敏(1976—),男,浙江文成人,副教授,博士,研究方向为无线传感器网络和信息安全,E-mail:zxm@zjut.edu.cn.

TP391

A

1006-4303(2017)04-0439-06