基于视觉显著性的目标分割算法*

李 璐,温 静,王文剑

山西大学计算机与信息技术学院,太原030006

ISSN 1673-9418 CODEN JKYTA8

Journal of Frontiers of Computer Science and Technology 1673-9418/2016/10(03)-0398-09

基于视觉显著性的目标分割算法*

李璐,温静+,王文剑

山西大学计算机与信息技术学院,太原030006

ISSN 1673-9418 CODEN JKYTA8

Journal of Frontiers of Computer Science and Technology 1673-9418/2016/10(03)-0398-09

E-mail: fcst@vip.163.com

http://www.ceaj.org

Tel: +86-10-89056056

* The National Natural Science Foundation of China under Grant Nos. 61201453, 61303091, 61273291,61401265 (国家自然科学基金); the Specialized Research Fund for the Doctoral Program of Higher Education of China under Grant No. 20121401120015 (高等学校博士学科点专项科研基金); the Basic Research Program of Shanxi Province under Grant No. 2014021022-2 (山西省基础研究计划项目); the Scientific and Technological Innovation Program of Higher Education Institutions in Shanxi Province under Grant No. 2015108 (山西省高等学校科技创新项目); the Research Project Supported by Shanxi Scholarship Council of China under Grant No. 2012-008 (山西省回国留学人员科研资助项目).

Received 2015-04,Accepted 2015-06.

CNKI网络优先出版: 2015-06-05, http://www.cnki.net/kcms/detail/11.5602.TP.20150605.1708.003.html

摘要:传统的图像分割算法在分割前需要输入目标的先验信息,因此不适应盲图像的分割。为此,提出了一种基于显著性的图像分割算法,主要借鉴人的注意力机制将图像中具有视觉显著性的区域分割出来。首先,book=399,ebook=103利用Gist全局特征获取目标图像的相似图像集;然后,结合尺度不变特征SURF(speeded up robust features)和Lab颜色模型空间特征对目标图像内以及相似图像集提取显著性特征,并根据显著性块频率低的原理进行显著性分割;最后,结合图分割获得最终的显著性区域分割结果。实验结果表明该方法适用于具有显著性视觉语义的盲图像。

关键词:显著性;SURF;Gist;图论

1 引言

随着图像数量的迅猛增长,图像处理的应用越来越广泛,而图像处理中的许多问题都是以图像分割为基础的,图像分割的好坏将直接影响后续的图像处理。

图像分割是将图像中有意义的特征或区域提取出来的过程,传统的图像分割方法中有基于阈值的[1]、基于边缘的[2]或者两者结合的图像分割方法;结合特定理论的图像分割方法中有基于数学形态学的[3-4]、基于模糊理论的[5-6]、基于图论的[7-8]以及基于支持向量机的[9-10]图像分割方法,这些方法都会用到目标的先验性信息,有些是图像的原始特征,如像素的灰度值、物体轮廓、颜色、反射特征和纹理等,也有些是空间频谱等,如直方图特征。自从1985年,Koch和Ullman提出了显著性区域本质上与它周围的区域是明显不同的这一特征,许多研究者都开始研究这一特征,进而产生了许多此类型的模型[11-14]。视觉系统可以快速而有效地获取有用的视觉信息进行研究,而这项研究主要源于目标文本或图像异常值会吸引人注意这一特点,可以在没有先验性信息的情况下进行图像分割。为此本文提出了一种基于图像显著性的图像分割算法,主要借鉴人的注意力机制对图像中具有显著性视觉语义的盲图像进行分割。首先,利用Gist全局特征[15]获取目标图像的相似图像集,它是一种纹理特征,可以根据图像的轮廓找到与目标图像场景最相似的图像,有效地提高在图像采样后计算显著度的准确率和效率。随之,结合尺度不变特征SURF (speeded up robust features)[16-18]和Lab颜色模型空间特征对目标图像内以及相似图像集提取显著性特征。由于SURF特征是一种图像局部特征向量,并且这种特征具有尺度不变,图像旋转不变和视角不变性,以及良好的特征提取速度,本文采用该方法进行特征提取,之后与Lab色彩模型空间特征在纹理和色彩上,实现目标图像内以及相似图像集的特征提取。然后,根据显著性块频率低的原理进行显著性分割。最后,与图分割[19]获得的区域标注结果相结合,输出最终的显著性区域分割结果。

本文首先介绍了图像分割的意义和研究现状,阐述了本文的主要内容和框架;其次介绍了显著性特征提取使用的方法;再次介绍了基于显著性的图像分割算法;最后给出了实验结果与分析。

2 显著性特征提取

2.1 Gist相似图像集

人类能够在短时间内完成图像场景分类的关键在于其快速获取场景要点语义的能力。Gist[15]体现了场景分类建模过程中图像的全局意义,避开了对单个目标或区域的分割和处理,模拟人的视觉提取图像中粗略但简明扼要的上下文信息。

2.1.1图像的全局Gist特征提取

对于一幅大小为r´c的灰度图像f(x,y),用m尺度n方向的Gabor滤波器组gmn(x,y)[20]进行滤波,即分别同nc个通道的滤波器进行卷积,其中nc=m´n,再级联卷积的结果,称为图像Gis(tIG)特征,即:

其中,cat为级联运算符;*为卷积运算符;GI的维数为nc´r´c。

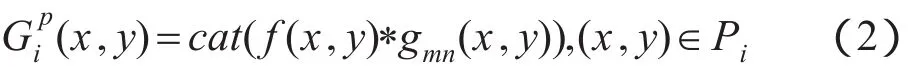

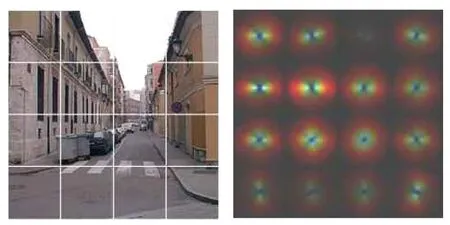

本文采用Oliva和Torralba[15]的规则网格方法,将r´c的图像f(x,y)划分成np´np的规则网格,各网格块按行依次记作Pi,其中i=1,2,...,ng;网格块大小为r′´c′,其中r′=r/np,c′=c/np;并用nc个通道的Gabor滤波器对图像进行滤波获得图像的全局Gist特征,则每个网格块各通道滤波后级联获得块Gist(PG)特征,即:其中,Gp的维数为nc´r′´c′,且Gp是GI的子集。通过Gabor滤波器组提取特征的过程图和效果图分别如图1和图2所示。

Fig.1 Extraction process of global Gist features图1 全局Gist特征的提取过程

Fig.2 Division of 16 blocks and global Gist features extracted by Gabor filters图2 将图片划分为16块并经过Gabor滤波器得到的全局Gist特征

各通道滤波结果取均值后按行组合的结果称为全局Gist(GG)特征,即:

GG的维数为nc´ng。

2.1.2 Gist相似图像集搜索

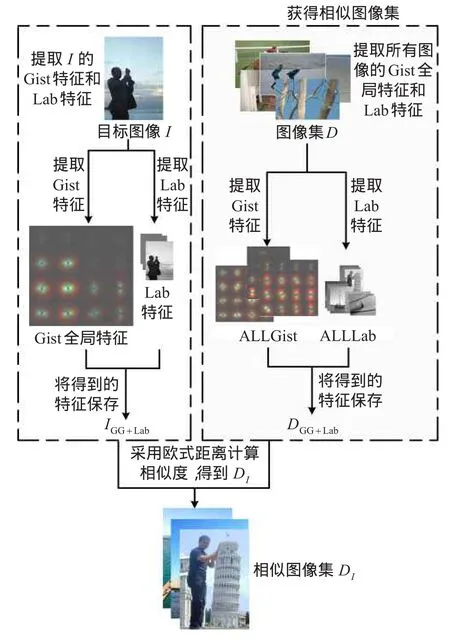

通过计算图像的Gist特征,并结合图像的Lab颜色信息,对目标图像进行相似图集搜索的过程如图3所示。

Fig.3 Gist similar sets searching process图3 获得图像相似图像集DI的过程

步骤1对目标图像I提取Gist特征和Lab颜色特征,结合后得到目标图像的特征IGG+Lab。

步骤2对图像集D中的每一张图片分别提取Gist特征和Lab特征,得到每张图像的特征DGG+Lab。

步骤3对目标图像的特征和图像集中每张图片的特征计算欧式距离,取其中距离最近的N张图片作为目标图像的相似图像DI。

2.2计算图像显著值

根据显著性块频率低的原理分析可知,若目标图像块在相似图像集中匹配频率高,则该块的显著性低,反之,则显著性高。因而,需要对图像块提取特征,计算目标图像块和相似图像集中块的匹配度,以获得目标图像块的显著性。

本文选用了具有尺度、旋转不变性的SURF特征[16]与Lab色彩模型空间特征相结合的特征作为图像块特征,并使用了Kd-树算法[21]进行特征点匹配。

给定一幅目标图像I和一个图像集D,希望找到目标图像I的显著图SI,为此给出以下定义。

定义1(显著性块)图像I中的显著性块在相似图像集DI中存在的频率px非常低。

这里的相似图片集DI是包含目标图像I和其他根据Gist全局特征和Lab特征得到的一类图片。

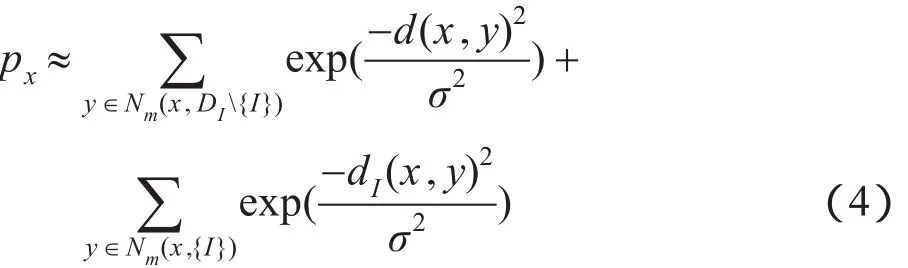

为了有效计算px,它的计算公式为:

其中,d(x,y)为两个块之间的欧式距离;Nm(x,DI{I})是除了目标图像本身外的m个最相似图片中的块;dI(x,y)是根据目标图像本身得到的空间距离上的偏移:

其中,c是常数;l(×)为归一化后图片中块的坐标。

px若为一个高的值,则表明该块x在图片中是不显著的,块x的显著性值为:

Sx=1-px(6)

考虑到显著性目标尺度上的变化,在几种不同尺寸(本文采用4种尺寸:1.0,0.8,0.5,0.3)下,用n´n(本文采用7×7和16×16)大小,步长为4的块进行遍历,最后计算目标块的显著性值Sx,并平均这几个值作为该块的显著性-Sx。

3 基于显著性的图像分割算法

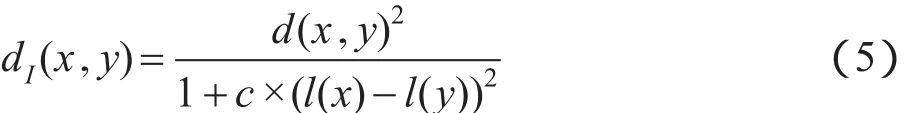

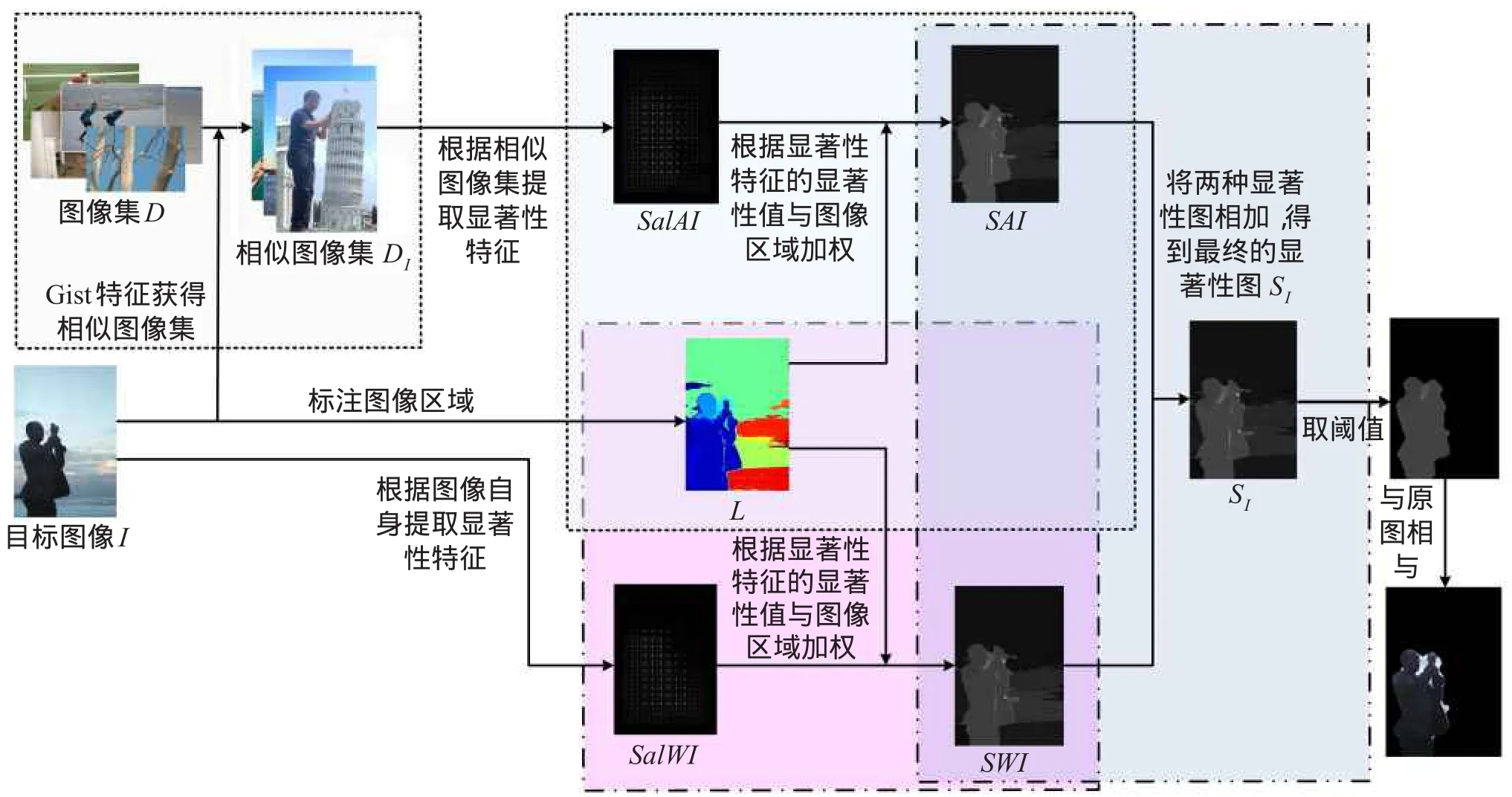

基于显著性的图像分割算法的主要思想是将图像显著性问题转化为采样问题,在不同的尺寸下对待分割图像和相似图像集中的图像进行采样,然后提取图像块的SURF特征,并进行匹配获得显著性值,随后将得到的显著性值和得到的图像区域标记进行加权平均,得到最终的显著性图。其中,为了指引显著性区域的分割,借鉴图分割的方法[19]来实现对图像区域的标记。分割算法的步骤如图4所示。

基于显著性的图像分割算法的步骤如下:

步骤1寻找相似图像集DI。对图像集D中的图片进行预处理,使用Gist方法提取全局特征和色彩空间Lab特征,得到DGG+Lab,方便调用并加速程序运行。采用同样的方法获得待分割图像I的Gist全局特征和Lab特征IGG+Lab,计算目标图像I与图片集D中每个图像上述特征之间的欧氏距离,获取前20张图像作为目标图像的相似图像集DI。

步骤2标记超像素区域L。对目标图像I进行基于图的图像分割,得到超像素块L。

步骤3求待分割图像的显著性值SalAI。将待分割图像I在4种不同尺寸(1.0,0.8,0.5,0.3)下,重复步骤4,完成后,将4个S进行平均,得到待分割图像的显著性值SalAI。

步骤4按尺寸为7´7的块,步长为4进行遍历,得到SURF特征和Lab特征相结合的块特征集ISURF+Lab(每个块的特征值表示为3×42+64)。对相似图像集DI在3种不同的尺寸下,分别按尺寸为16×16的块,步长为4进行遍历,得到SURF特征和Lab特征相结合的块特征集DI_SURF+Lab。最后,根据ISURF+Lab和DI_SURF+Lab对待分割图像的每一个块与DI中的每个块计算相似度值px,获得每块的显著性值Sx(式(6)),从而得到整幅图像的显著性值S。

步骤5求待分割图像的显著性值的偏移值SalWI。因为获取显著性值是在不同尺寸下进行的,会造成一定的偏移,所以需要求取偏移值。将待分割图像I 在4种不同尺寸(1.0,0.8,0.5,0.3)下,重复步骤6,完成后,将4个S′进行平均,得到待分割图像的显著性值SalWI。

步骤6按尺寸为7×7的块,步长为4进行遍历,得到SURF特征和Lab特征相结合的块特征集ISURF+Lab(每个块的特征值表示为3×42+64)。对待分割图像在3种不同的尺寸下,分别按尺寸为16×16的块,步长为4进行遍历,得到SURF特征和Lab特征相结合的块特征集DI_SURF+Lab′。最后,根据ISURF+Lab和DI_SURF+Lab′对待分割图像的每一个块与不同尺寸下图片中的每个块计算相似度值px',获得每块的显著性值Sx'(式(6)),从而得到整幅图像的显著性值S′。

步骤7将SalAI和SalWI分别与L加权平均,得到初始显著性图SAI和显著性偏差图SWI。

步骤8将SWI和SAI以相加的方式结合,得到最终的显著性图SI。

Fig.4 Object segmentation图4 目标分割过程

4 实验结果与分析

为了验证本文算法的有效性,实验采用PASCAL VOC 2012数据集[22]。该数据集主要用来实现图像分类,因此数据集中的目标存在多视角、光照变化剧烈以及背景复杂等多种因素的干扰。

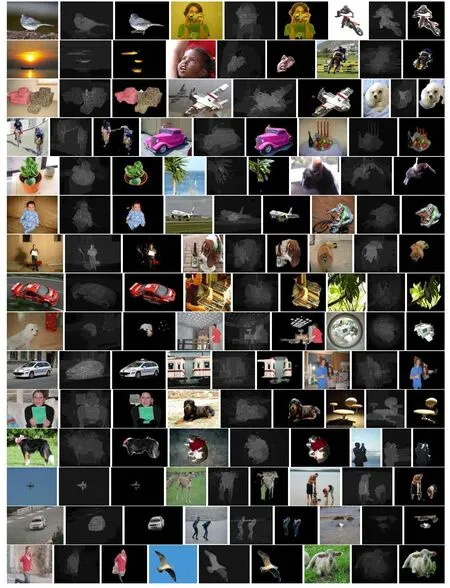

实验1按照数据集中的类别,在20类图像中选取部分实验结果,如图5所示。图5展示了实验结果中的45张图片,分别为原图、显著性图、分割结果图。实验结果显示本文方法对具有显著视觉语义的图像具有很好的分割效果,然而对于视觉语义不明确的图片无法获得显著性较强的结果。实验结果证明本文方法可以成功地实现图像分割。

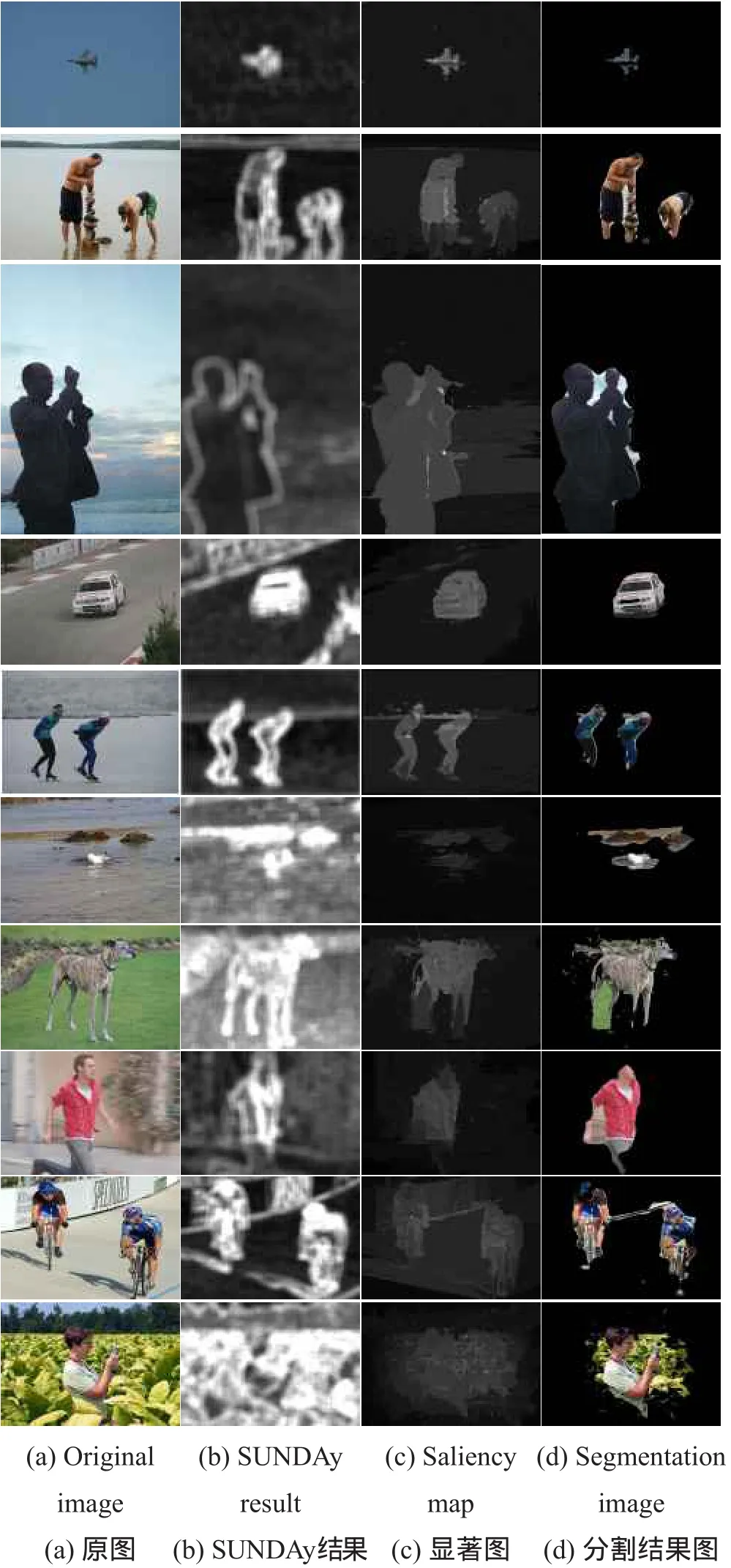

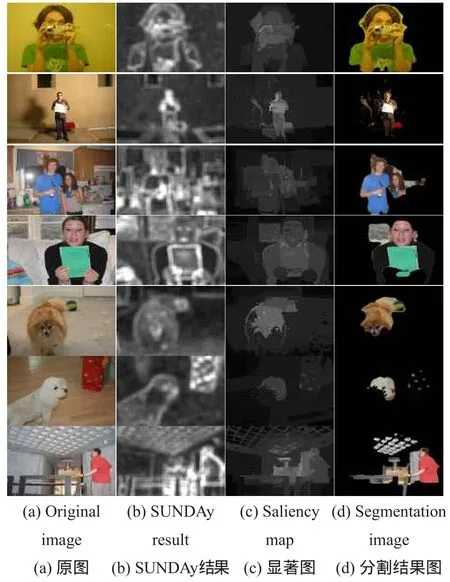

实验2为了验证本文方法的有效性,对比了Zhang等人提出的SUNDAy方法[23]。分别将数据集中的图片分为室内和室外场景,其中室外和室内实验的部分分割结果分别如图6和图7所示。由图中可以看出,本文方法得到的显著性图的轮廓更为清晰精确,没有太多的噪音,而且得到的显著性是区域性的,更有利于进行图像分割。

由图6可知,在室外场景中,以天空、大海等比较空旷的场景作为背景的,可以非常清楚准确地将图中显著性区域检测出来;一些背景显著性稍强的图片,也可以检测出易于区分的显著性区域;一些前后景显著性对比不是特别强的图片会检测出较多的背景区域;而在室外少见的复杂场景中,前后景显著性区分不大,不能分割出想要的区域;在室外最少见的复杂场景中,背景对于目标显著性很低,可以成功将目标分割出来。

Fig.5 Part results of image segmentation图5 图像分割部分实验结果

由图7可知,在室内场景中,对于一些背景简单的图像,易于检测图像的显著性区域,但是由于人影相对背景来说也表现为显著性,导致人影部分也被分割出来;对于室内场景中经常出现的复杂场景,分割出来的部分并没有清楚的边界;但是在一些即使场景复杂但是前后景显著性差别很大的图像,可以清楚地分割出目标;由于环境比较复杂,一些在人眼看来并不是显著的区域会被检测出来,出现误检;或者由于光线等原因,人们想要得到的区域并没有被检测出来。

Fig.6 Comparison result for indoor images图6 提取室外场景显著图结果比较

Fig.7 Comparison result for outdoor images图7 提取室外场景显著图结果比较

5 结论

本文将视觉显著性特征运用到图像分割中,首先,利用Gist全局特征获取目标图像的相似图像集;然后,结合尺度不变特征SURF和Lab颜色模型空间特征对目标图像内以及相似图像集提取显著性特征,并根据显著性块频率低的原理进行显著性分割;最后,结合图分割获得最终的显著性区域分割结果。实验结果表明,本文算法根据人的视觉显著性,在对图像没有任何先验信息时,能获得符合人视觉感知特性的显著性区域分割,并且由于使用了SURF的特征提取方法,速度比较快。本文算法基本适应于具有显著性视觉语义的盲图像。

References:

[1] Sonka M, Hlavac V, Boyle R. Image processing, analysis, and machine vision[M]. [S.l.]: Cengage Learning, 2014.

[2] Xue Wenge, Kuang Tianfu. Research on image edge detec-tion[J]. Computer Knowledge and Technology, 2007, 16: 133.

[3] Serra J. Mathematical morphology[M]. London, UK:Academic Press, 1982.

[4] Serra J. Image analysis and mathematical morphology[M]. London, UK:Academic Press, 1982.

[5] Masooleh M G, Moosavi SAS.An improved fuzzy algorithm for image segmentation[J]. Proceedings of World Academy of Science, Engineering and Technology, 2008, 28(4): 400-404.

[6] Wang Yanchun, Liang Dequn, Wang Yan. The transition region extraction and segmentation based on image entropy neighborhood of fuzzy entropy[J]. Chinese Journal of Electronics, 2008, 36(12): 2245-2249.

[7] Hu Xuegang, Sun Huifen, Wang Shun.Anew image segmentation algorithm based on graph theory[J]. Journal of Sichuan University: Engineering Science Edition, 2010, 42 (1): 138-142.

[8] Liu Songtao, Yin Fuliang. Image segmentation based on graph cut and its new progress[J]. Journal of Automation, 2012, 38(6): 911-922.

[9] Yang Najuan, Wang Huiqin, Ma Zongfang. Fire detection in image type algorithm based on support vector machine[J]. Computer Application, 2010, 30(4): 1129-1131.

[10] Liu Ting, Wen Xianbin, Quan Jinjuan, et al. Multiscale SAR image segmentation using support vector mchines[C]//Congress on Image and Signal Processing, Sanya, China, May 27-30, 2008. Piscataway, USA:IEEE,2008: 706-709.

[11] Itti L, Koch C, Niebur E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(11): 1254-1259.

[12] Gao Dashan, Mahadevan V, Vasconcelos N. On the plausibility of the discriminant center-surround hypothesis for visual saliency[J]. Journal of Vision, 2008, 8(7): 13.

[13] Bruce N D B, Tsotsos J K. Saliency, attention, and visual search: an information theoretic approach[J]. Journal of Vision, 2009, 9(3): 5.

[14] Torralba A, Oliva A, Castelhano M S, et al. Contextual guidance of eye movements and attention in real-world scenes: the role of global features in object search[J]. Psychological Review, 2006, 113(4): 766-786.

[15] Oliva A, Torralba A. Modeling the shape of the scene: a holistic representation of the spatial envelope[J]. International Journal of Computer Vision, 2001, 42(3): 145-175.

[16] Bay H, Tuytelaars T, van Gool L. SURF: speeded up robust features[C]//LNCS 3951: Proceedings of the 9th European Conference on Computer Vision, Graz, Austria, May 7-13, 2006. Berlin, Heidelberg: Springer, 2006: 404-417.

[17] Lowe D G. Object recognition from local scale-invariant features[C]//Proceedings of the 7th IEEE International Conference on Computer Vision, Kerkyra, Greece, Sep 20-27, 1999. Piscataway, USA: IEEE, 1999: 1150-1157.

[18] Wang Yongming, Wang Guijin. Image local invariance features and description[M]. Beijing: National Defense Industry Press, 2010.

[19] Felzenszwalb P F, Huttenlocher D P. Efficient graph-based image segmentation[J]. International Journal of Computer Vision, 2004, 59(2): 167-181.

[20] Jain A K, Ratha N K, Lakshmanan S. Object detection using Gabor filters[J]. Pattern Recognition, 1997, 30(2): 295-309.

[21] Zhou Kun, Hou Qiming, Wang Rui, et al. Real-time KD-tree construction on graphics hardware[J]. ACM Transactions on Graphics, 2008, 27(5): 126-136.

[22] Everingham M, van Gool L, Williams C, et al. Pascal visual object classes challenge results[EB/OL]. (2005)[2015-02-05]. http://www.pascal-network.org/challenges/VOC/.

[23] Zhang Lingyun, Tong M H, Cottrell G W. SUNDAy: saliency using natural statistics for dynamic analysis of scenes[C]// Proceedings of the 31st Annual Cognitive Science Conference. Cambridge, USA:AAAI Press, 2009: 2944-2949.

附中文参考文献:

[2]薛文格,邝天福.图像边缘检测方法研究[J].电脑知识与技术, 2007, 16: 133.

[6]王彦春,梁德群,王演.基于图像模糊熵邻域非一致性的过渡区提取与分割[J].电子学报, 2008, 36(12): 2245-2249.

[7]胡学刚,孙慧芬,王顺.一种新的基于图论的图像分割算法[J].四川大学学报:工程科学版, 2010, 42(1): 138-142.

[8]刘松涛,殷福亮.基于图割的图像分割方法及其新进展[J].自动化学报, 2012, 38(6): 911-922.

[9]杨娜娟,王慧琴,马宗方.基于支持向量机的图像型火灾探测算法[J].计算机应用, 2010, 30(4): 1129-1131.

[18]王永明,王贵锦.图像局部不变性特征与描述[M].北京:国防工业出版社, 2010.

LI Lu was born in 1989. She is an M.S. candidate at School of Computer and Information Technology, Shanxi University. Her research interest is computer vision.李璐(1989—),女,山西晋中人,山西大学计算机与信息技术学院硕士研究生,主要研究领域为计算机视觉。

WEN Jing was born in 1982. She received the Ph.D. degree from School of Electronic Engineering, Xidian University in 2010. Now she is an assistant professor and M.S. supervisor at Shanxi University, and the member of CCF. Her research interests include computer vision, image processing and pattern recognition, etc.温静(1982—),女,山西晋中人,2010年于西安电子科技大学电子工程学院获得博士学位,现为山西大学计算机与信息技术学院副教授、硕士生导师,CCF会员,主要研究领域为计算机视觉,图像处理,模式识别等。主持和参与多项国家自然科学基金、教育部博士点基金、山西省自然科学基金等项目。

WANG Wenjian was born in 1968. She received the Ph.D. degree from Institute for Information and System Science, Xi’an Jiaotong University in 2004. Now she is a professor and Ph.D. supervisor at School of Computer and Information Technology, Shanxi University, and the senior member of CCF. Her research interests include neural networks, support vector machine, machine learning theory and environmental computations, etc.王文剑(1968—),女,山西太原人,2004年于西安交通大学信息与系统科学研究所获得博士学位,现为山西大学计算机与信息技术学院教授、博士生导师,CCF高级会员,主要研究领域为神经网络,支持向量机,机器学习理论,环境计算等。在国内外重要学术刊物和国际会议上发表论文70余篇,主持和参与多项国家自然科学基金、国家863计划、教育部博士点基金、山西省自然科学基金等项目。

Image Segmentation Algorithm Based on Visual Saliencyƽ

LI Lu, WEN Jing+, WANG Wenjian

School of Computer and Information Technology, Shanxi University, Taiyuan 030006, China

+ Corresponding author: E-mail: wjing@sxu.edu.cn

LI Lu, WEN Jing, WANG Wenjian. Image segmentation algorithm based on visual saliency. Journal of Frontiers of Computer Science and Technology, 2016, 10(3):398-406.

Abstract:Because the traditional image segmentation algorithms need the prior information of the object of interest, they usually fail to segment satisfactorily in blind images. In order to obtain the salient regions without prior, this paper proposes a salient image segmentation algorithm based on the human visual attention mechanism. Firstly, the global Gist feature is extracted to collect the correlative image set of the target image. Secondly, the salient region of the target image is computed and extracted in both target image and correlative image set by combining scale invariant feature SURF (speeded up robust features) and Lab color model space feature. Finally, the salient object can be segmented with the assistance of the efficient graph-based image segmentation. The experimental results show that the proposed method is applicable to the blind image which is visual salient semantic.

Key words:saliency; speeded up robust features (SURF); Gist; graph theory

doi:10.3778/j.issn.1673-9418.1505016

文献标志码:A

中图分类号:TP391