基于改进HOG特征的空间非合作目标检测

陈路, 黄攀峰, *, 蔡佳

1. 西北工业大学 航天飞行动力学技术重点实验室, 西安 710072 2. 西北工业大学 航天学院智能机器人研究中心, 西安 710072

基于改进HOG特征的空间非合作目标检测

陈路1, 2, 黄攀峰1, 2, *, 蔡佳1, 2

1. 西北工业大学 航天飞行动力学技术重点实验室, 西安 710072 2. 西北工业大学 航天学院智能机器人研究中心, 西安 710072

传统的非合作目标检测方法大都基于一定的匹配模板,这不仅需要预先指定先验信息,进而设计合适的检测模板,而且同一模板只能对具有相似形状的目标进行检测,不易直接用于检测形状未知的非合作目标。为降低检测过程中对目标形状等先验信息的要求,借鉴基于规范化梯度的物体区域估计方法,提出一种基于改进方向梯度直方图特征的目标检测方法,首先构建包含有自然图像和目标图像的训练数据集;然后提取标记区域的改进方向梯度直方图特征,以更好地保持局部特征的结构性,并根据级联支持向量机训练模型,从数据集中自动学习目标物体的判别特征;最后,将训练后的模型用于检测测试集图像中的目标。实验结果表明,算法在由4 953幅和100幅图像构成的测试集中分别取得94.5% 和94.2%的检测率,平均每幅图像的检测时间约为0.031 s,具有较低的时间开销,且对目标的旋转及光照变化具有一定的鲁棒性。

非合作目标; 目标识别; 规范化梯度; 方向梯度直方图; 局部特征

随着航天技术的不断发展,各国对于故障卫星维修、近距离目标捕获、轨道垃圾清理等新型在轨服务技术的需求日益迫切。传统空间机器人的机械臂几乎属于全刚体系统,加上其作用范围受到机械臂长度和刚体灵活性的限制,因此空间机械臂主要用于合作目标的抓捕和操作,不能很好地适应未来的空间碎片清理等任务。空间绳系机器人系统利用柔性系绳代替多自由度刚性机械臂,在任务安全性和可靠性等方面有了显著提高。系绳结构的应用不仅减少了平台向目标移动过程中的能量消耗,而且避免了平台与目标的直接接触,从而消除了与目标直接碰撞的可能,因而在未来的空间操作中有着广泛的应用前景。

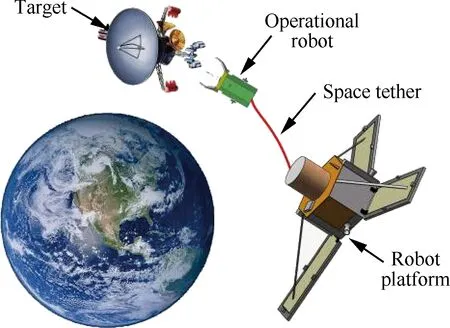

空间绳系机器人由空间机动平台、空间系绳和捕获装置3部分构成,如图1所示。在轨捕获过程分为3个阶段:①空间平台的绕飞阶段,即空间机动平台进行的远程、中近距离的目标搜索和监测过程;②空间绳系机器人捕获目标阶段,即空间机动平台到达作用距离内时(约200 m),操作机器人被平台释放,自主完成目标追踪、识别和抓捕的过程;③空间机动平台把目标拖入坟墓轨道的过程,即空间绳系机器人抓住目标卫星后,空间机动平台将目标卫星由原轨道拖入坟墓轨道的过程[1]。

图1 空间绳系机器人系统示意图

Fig. 1 Diagram of tethered space robot system

目标特征提取是非合作目标位姿测量的基础,在逼近非合作目标的过程中,机器人需要对目标进行识别、跟踪并测量目标的结构、运动轨迹、空间位置和三维姿态等信息。基于视觉系统的空间目标检测/识别是获取这些信息的重要手段。

因此本文的出发点是根据目标检测/识别算法确定目标的待抓捕区域,缩减感兴趣区域的尺寸,从而为后续目标特征点等特征的提取排除背景信息的干扰。研究表明,尽管非合作目标的结构各不相同,但它们有诸多相似的部件,如用于星箭相连的分离螺栓、对接环,用于连接太阳帆板与卫星本体的太阳帆板支架等,这些非合作目标星共有的特征是机器人抓捕操作的理想部位。不失一般性,本文选取目标星本体与帆板连接处的三角形或多边形支架作为待识别区域。

传统的卫星帆板检测算法往往基于一定的先验信息,并针对具有相似形状特征的识别目标。徐文福等[2]针对三角形类卫星帆板支架,提出基于立体视觉的目标识别算法;Wong[3]指出与空间域相比,频率域的非合作目标识别具有更大的优势,更易区分不同的飞行器类别;Ramirez等[4]将遗传算法应用于图像中四边形的检测,算法对高斯噪声污染和形变具有一定的鲁棒性。文献[5]提出一种基于弹性网稀疏编码的特征袋模型,能够较好地识别目标;文献[6]借鉴FAST算法的空心圆环结构提出一种具有旋转不变性的模板匹配算法,有较强的抗噪声和抑制光照变化的能力。文献[7]通过提出一种光照模糊相似融合不变矩,有效解决了不同位姿和光照条件的航天器目标识别问题;文献[8]通过网络参数的不断调整,将目标的特征反映到网络结构中,以实现对图像目标的识别,但算法仅突出了目标特征,并未对目标的位置信息进行预测。

上述方法在所假设的目标形状特征下,具有较好的检测效果,但在实际中,帆板支架的结构各不相同,且帆板的旋转角度也会随时变化,很难找到不同条件下都能得到满意结果的检测模板。

本文提出一种基于改进方向梯度直方图(Histogram of Oriented Gradient, HOG)特征的目标定位算法,首先建立含有标记信息的帆板图像训练集,分别提取帆板目标区域和非目标区域的特征,然后采用级联支持向量机(Cascaded Support Vector Machine, Cascaded SVM)框架训练特征模型,最后通过训练模型检测测试集图像中的帆板支架区域。实验结果表明,在不同视角、不同帆板旋转角度下,文中所提算法均能够以较低的时间开销,高准确度定位帆板支架。

1 区域提取方法

现有识别算法的检测器大都依赖于图像的种类,即一种检测器只能识别一类或多类相似的物体,这导致在目标检测/识别过程中,需用不同的检测器对同一物体进行检测,以确定物体是否属于特定类中的实例[9],并且采用滑窗的方式定位物体需要在不同尺度和位置下进行检测,搜索区域较大,因此上述算法的时间复杂度较高。为降低待分类区域的数目,研究人员提出不依赖于目标种类的物体测量方法。物体度定义为图像窗口包含有某种物体的概率,而不考虑物体的具体分类,概率越大意味着当前窗口中包含有完整物体的可能性越大。

由文献[10-11],物体可看作图像中具有闭合边界的孤立元素,其与周围背景元素的相关性较弱。传统基于空间的理论认为人在观察图像时,注意力会从一个空间位置转移到另一个空间位置[12],而认知学的研究表明,人类视觉更倾向于首先识别图像中的物体,通过简单的选择机制初步确定潜在的物体区域,这也验证了通过物体度确定潜在物体区域的可行性。文献[13]提出结合图像的形状、颜色和纹理等特征,对物体的潜在区域进行测量,从而得到潜在区域中包含有物体的概率;文献[14]引入级联形式,提高了潜在区域评价的速度和精度;文献[15]基于图像的梯度信息,提出一种非常快速的潜在区域评价算法。

文献[15]将标记图像目标区域的规范化梯度(Normed Gradient, NG)作为区分物体区域和非物体区域的特征。首先选取不同尺度和方向比下的窗口{(W0,H0)},其中W0和H0分别表示窗口的尺寸,且W0,H0∈{10,20,40,80,160,320},计算其NG特征。然后采用线性模型w评价当前窗口:

(1)

式中:hl为窗口l所表示的NG特征;fl为w滤波后特征的评价值;i和(x,y)分别代表窗口l的尺寸和位置。对于尺寸i下的潜在区域,通过非极大值抑制(Non-MaximalSuppression,NMS)保留局部区域的最大响应,以达到减小搜索区域的目的。

基于以下事实:相比于由长宽方向比值较大的矩形包围的区域,长宽比接近于1的区域中包含有物体的可能性更大,窗口区域的评价指标进一步修正为

sl=aifl+bi

(2)

式中:ai和bi分别为尺寸i下的训练系数和偏置项;sl为窗口的最终评价值,即窗口中包含有物体的概率。

为得到图像窗口包含物体的概率值,采用文献[16]的级联SVM方法训练参数:

1) 将标记区域的NG特征看作正样本,随机采样非标记区域,其特征作为负样本,利用线性SVM训练模型w。

2) 采用线性SVM训练参数ai、bi。对训练集的已标记图像,利用式(1)和式(2)生成非极大值抑制后的潜在物体区域,通过与真实标记的对比达到训练参数的目的。

上述训练方法具有较小的训练时间开销,并在PASCALVOC2007[17]数据集上取得了很好的物体定位效果,但上述算法将图像梯度值的欧氏距离作为判别特征,如式(3)所示:

hl=min(|Gx|+|Gy|,255)

(3)

式中:Gx和Gy为窗口l对应图像块的梯度值。虽然梯度特征具有计算简单、运行速度快的优点,但却没有考虑图像中广泛存在的纹理信息,用梯度作为特征忽视了像素间及局部区域中所包含的方向信息,因此不能很好地作为目标区域的判别特征。

2 基于改进HOG特征的特征提取方法

NG特征用于VOC 2007数据集取得了较好的目标定位效果,但在实际中,尤其是对于不包含在数据集中的物体类,人工采集的图像易受光照、噪声等因素的影响,往往不能够直接使用,通常要对其进行预处理,以增强图像中的显著特征。实验表明,NG特征直接应用于预处理图像其效果并不理想。

为减小卫星载荷,卫星帆板支架大都具有骨架型结构,支架上像素点的梯度变化方向类似,而支架与背景交界处的梯度值波动较大,其方向同支架上的梯度变化方向正交,因此在规范化梯度的基础上,引入方向信息,不仅可以包含局部区域中的方向响应,减小因离散化梯度造成的能量丢失,而且能够表示物体的基本形状,从而作为一种较好地判别目标区域的特征。

2.1 方向梯度直方图

基于如下假设:虽然无法精确地估计图像中局部灰度值的梯度分布,但其中物体的局部外观和形状通常可以由对应梯度和边缘信息很好地表征和描述,文献[18]提出用于特征提取的方向梯度直方图算子;文献[19]将方向梯度直方图算子应用于图像/视频行人检测,只需行人大致保持直立状态便可取得较好的检测效果;文献[20]指出HOG算子特别适合于刚体特征的表示。HOG特征是一种梯度方向的直方图表示,与SIFT特征[21]相比,虽然HOG特征不具备尺度不变性,但其运算复杂度要低得多。首先全局归一化图像,减少光照等因素对物体识别的影响;然后计算图像的梯度信息,捕获物体的轮廓、纹理等特征,并进一步降低光照因素变化的影响;进一步,根据梯度的方向和幅值,得到各连通区域区域内(称为细胞)不同方向下像素分布的一维向量,为增强算子的鲁棒性,对相邻细胞组成的集合块中的特征向量进行局部归一化;最后,将所有集合块的向量首尾相连,形成对当前图像的HOG特征表示,特征提取过程如图2所示,其中输入图像由数据集中图像的标记信息获得。

图2 HOG特征提取流程

Fig. 2 Flowchart of extracting HOG feature

为表示输入图像,HOG算子需提取高维特征表示向量,其维度为

(4)

式中:w、b、c分别为检测窗口、块区域和细胞区域的尺寸;s为块区域移动的步长;p为细胞内梯度方向的数目。由于不同图像块之间有一定的重叠,导致特征表达向量存在一定的冗余度,定义r为生成特征表达向量中重叠部分所占比例,则有

r=

若相邻块之间没有重叠部分,则定义冗余度为0。以w、b、c、s、p分别取72、16、8、8、9时为例,特征表示维度和冗余度分别为2 304和0.19,高维的特征表示给分类、检测等问题带来计算上的压力,并且冗余度的存在一定程度上降低了算法的执行效率。值得注意的是,文献[19]中指出这种冗余特性能够提升行人目标检测效果,但本文试图通过对HOG特征的改进提取具有更低维数和更适合目标和非目标区域判别的特征,因此,有必要进一步降低维数及冗余度。

2.2 改进的局部特征

HOG特征将图像块内多个细胞区域的不同方向的梯度响应展开为向量,作为当前图像块特征的表达,不同图像块之间有一定的重叠,导致特征表达向量存在一定的冗余,且维数较高,这使得HOG特征应用于较大规模的数据集时不适合直接作为目标区域和非目标区域的判别特征。

本节首先以梯度方向为标准,将图像块内多个细胞区域的梯度响应集中于单个细胞区域,从而获得局部区域具有最大响应的方向,并作为当前区域的主方向;然后,对其进行极大值池化,使得子采样后的特征具有一定的平移、旋转不变性,进而提出一种改进的HOG特征P-HOG(Pooling-HOG)。

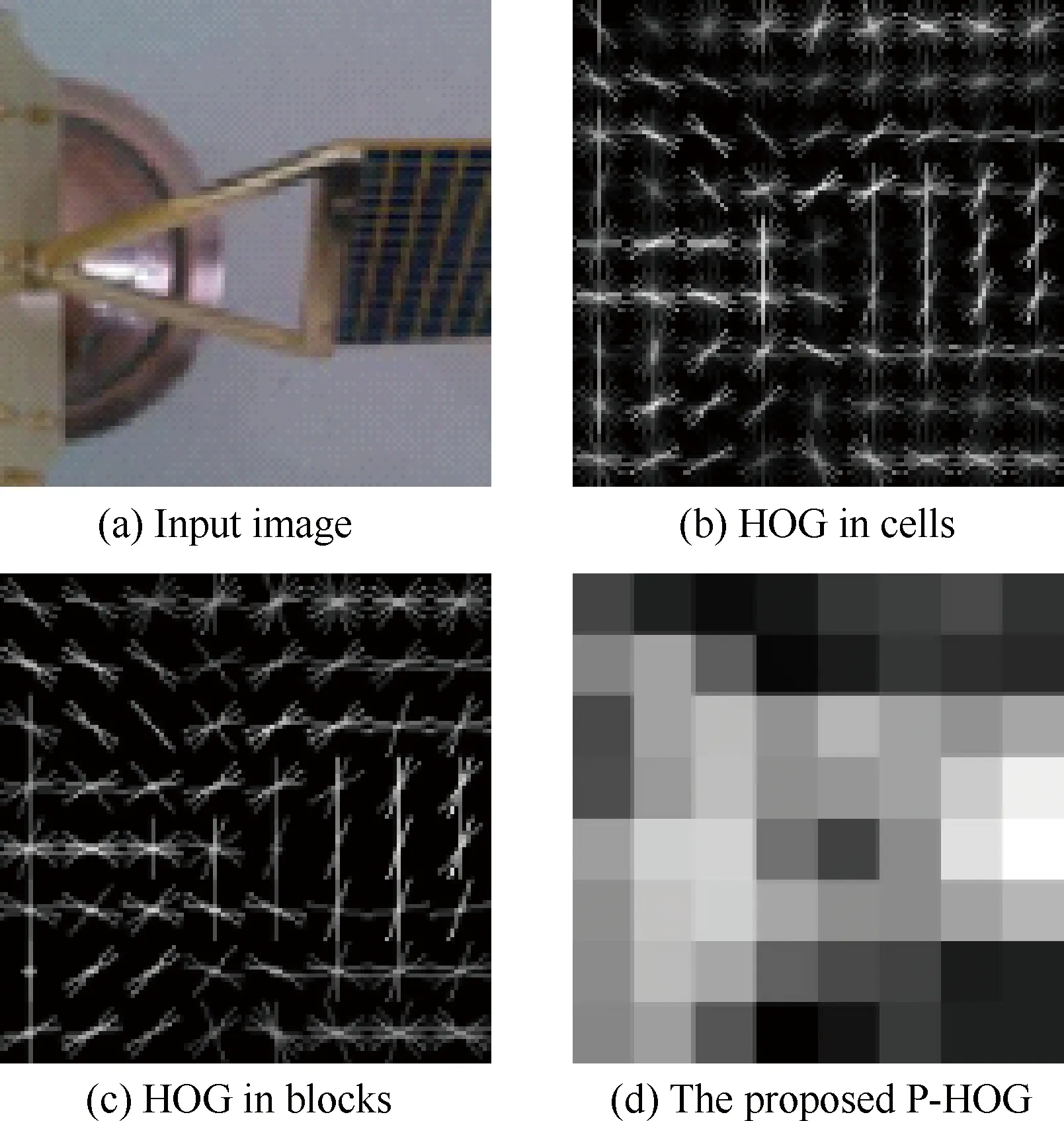

如图3所示,对于输入图像x,首先将其放缩至72×72大小,若x的宽度和高度不相等,则改变其长宽比;然后计算每个细胞内方向梯度的分布,如图3(b)所示,梯度方向的分布大致刻画了物体的形状边缘;为获得更好的空间不变性,将连通区域内的多个细胞合并,以形成更强的局部方向响应(见图3(c));最后下采样提取块区域中的最大响应值,生成对应于原图像的鲁棒特征表达(见图3(d))。此时,原图像x由一个抽象后的8×8 的判别特征表达,特征的表示维度为64,通过下采样操作,特征的冗余度同样得到降低。

由于图像的灰度值统计特性不同,加之容易受亮度、噪声等外界因素的干扰,因此在对图像进行特征提取前,通常需要对其进行预处理。文献[18]中采用图像元素求平方根或取对数的方法进行全局归一化,虽然降低了光照等因素对物体识别的影响,但同时也降低了物体与背景的对比度,并且单纯采用平方根法或对数法没有消除图像中存在的相关性,因此本文考虑在不影响物体主要形状边缘的基础上,尽可能抑制背景区域的光照、对比度等变化,同时消除图像元素间的相关性。

图3 不同阶段下输入图像的特征表示

Fig. 3 Feature representations of input image at different stages

为降低输入图像特征间的相关性,并在增强图像显著性特征的同时,有效抑制其他特征,按照如下步骤[22]对图像进行预处理。

步骤 1RGB图像转为灰度图像,并放缩至固定尺寸。

步骤 2 全局归一化,使图像具有均值为0、方差为1的统计特性:

步骤3 局部归一化,减弱非显著性特征的影响:

式中:xi为输入的图像块;mi为高斯滤波器;f(xi,mi)表示用mi对xi进行卷积滤波;yi为局部归一化后的图像块。由于实际采集到的图像不可避免地存在一定程度的噪声,为在图像的预处理阶段减少噪声信息的干扰,文中应用维纳滤波器于局部归一化过程,结果如图4所示。

图4 不同预处理方式下图像的输出对比

Fig. 4 Output comparison of input image with different pre-processing procedures

同只采用全局归一化的预处理结果相比,局部归一化后的图像更能突出物体的特征轮廓,并可抑制背景等无关信息的干扰;应用维纳滤波表现为对原图像细节的模糊,尤其是当图像中噪声较少时,同时对图像中边缘等具有局部显著性的特征加以增强。

2.3 算法流程

在基于二元规范化梯度的物体区域估计框架基础上,引入改进的方向梯度直方图特征描述算子,能够保留局部区域的方向性信息,其中的池化操作为算子提供了一定的空间、旋转不变性。此外,在提取特征之前,对图像进行预处理操作以突出其中的显著性元素同样有助于提高算法的识别效果,算法流程如图5所示。

图5 基于P-HOG的目标识别算法流程图

Fig. 5 Flowchart of object detection algorithm based on P-HOG

3 实验条件及结果分析

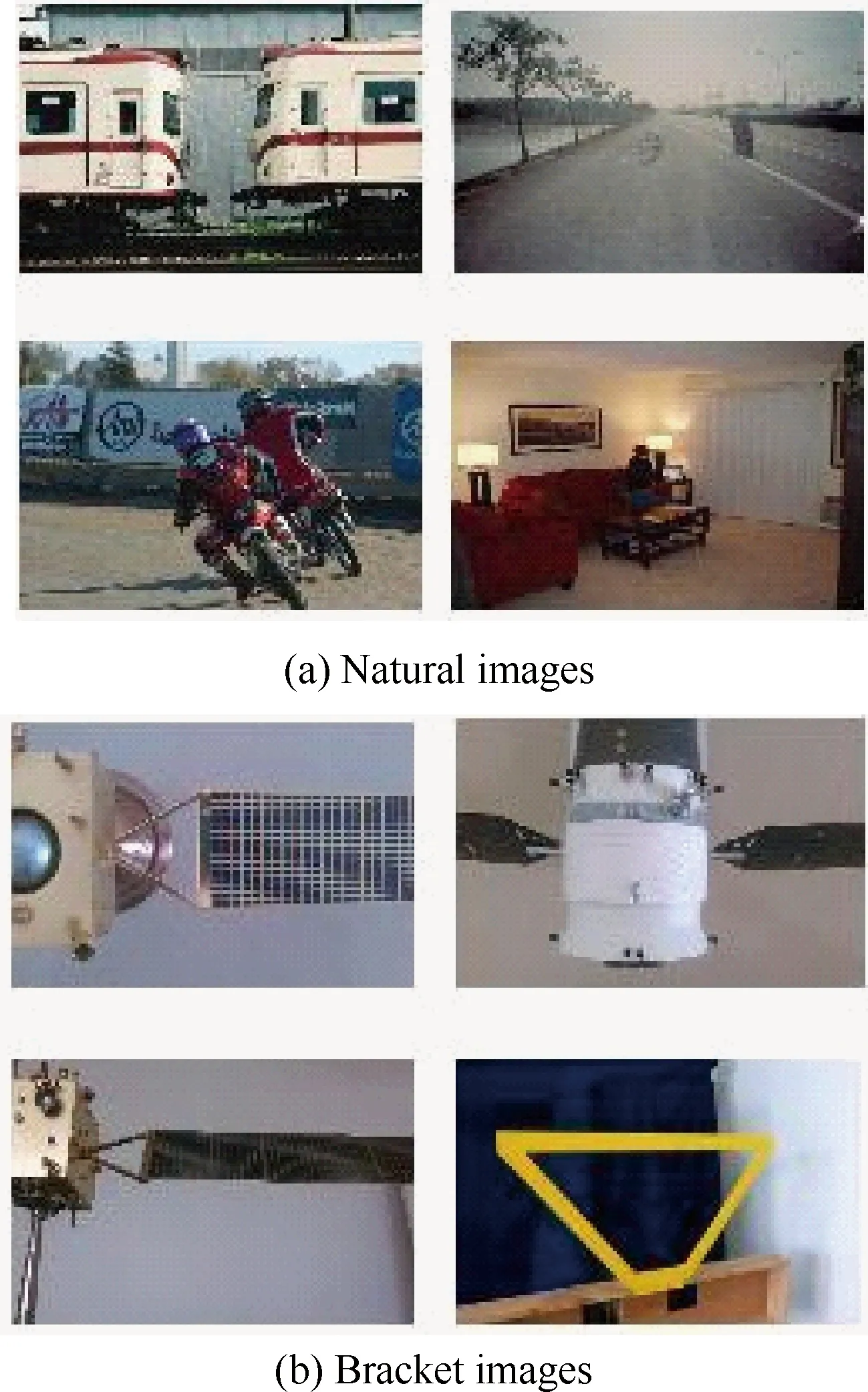

本文方法主要应用于绳系抓捕装置接近非合作目标后的视觉测量阶段,空间平台在绕飞阶段对目标的跟踪过程并不涉及本文的讨论范围,因此图像目标因观测距离变化引起的差异并不大,图像差异主要集中于目标本身,如图6所示。

3.1 实验条件

训练卫星帆板支架的识别模型依赖于大量的标记数据,由于人工标记上千幅图像的工作量较大,同时注意到Zitnick和Dollr[10]将物体定义为具有闭合边界的孤立元素,这和帆板支架的结构形态相吻合,因此在测试集中整合其他图像库(如PASCALVOC2007),利用其中的自然图像学习包括帆板支架在内的物体基本形态,利用手动采集的少量帆板支架图像提取支架的对应特征。

为验证算法有效性,手动采集共126幅不同形状、角度和光照条件下的卫星帆板图像(见图6(b)),并进行了人工标记。

图6 训练图像集

Fig. 6 Training image set

处理单元采用CPU为IntelCorei3 3.40GHz,内存为2G的主机,操作系统为WindowsXPSP3,开发工具为VS2010IDE。

3.2 结果分析

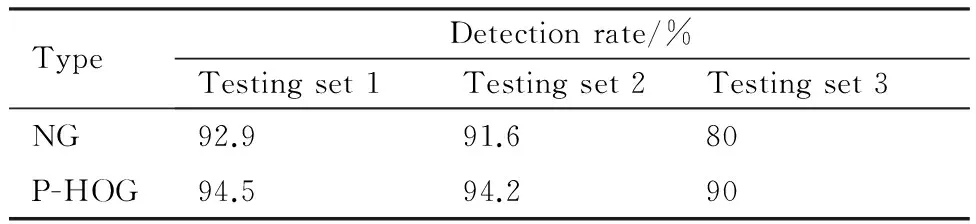

物体度被用于预先选取可能包含有物体的区域,通过增加特定目标的样本数,选取更加符合局部结构性的特征算子,将算法直接应用于目标的检测中,其中训练图像集的大小为1 421,其中1 331幅自然图像由VOC2007中随机选取,90幅卫星帆板图像由手动采集得到,能够使算法学习更多关于卫星帆板的特征信息,有效防止欠拟合的发生。测试图像集分成3个子测试集,测试集1由4 953幅VOC2007图像组成,以验证本文算法的有效性;测试集2由100幅图像构成,包括90幅自然图像和10幅卫星帆板图像;测试集3只含有10幅卫星帆板图像,用以验证模型直接用于目标检测的效果,不同测试集下的训练结果见表1。

表1 NG特征和P-HOG特征在不同测试集下目标检测效果的对比

Table 1 Comparison of object detection performance under different testing sets between features NG and P-HOG

TypeDetectionrate/%Testingset1Testingset2Testingset3NG92.991.680P-HOG94.594.290

可以看出,相比于规范化梯度特征,P-HOG特征的检测效果更好,因为预处理操作在增强图像显著性特征的同时,也改变了图像中原有梯度值的分布,破坏了视觉连续性,单纯采用梯度特征会产生更多的误判,而P-HOG特征则能很好地保持局部区域的特性,因此其检测效果更好。

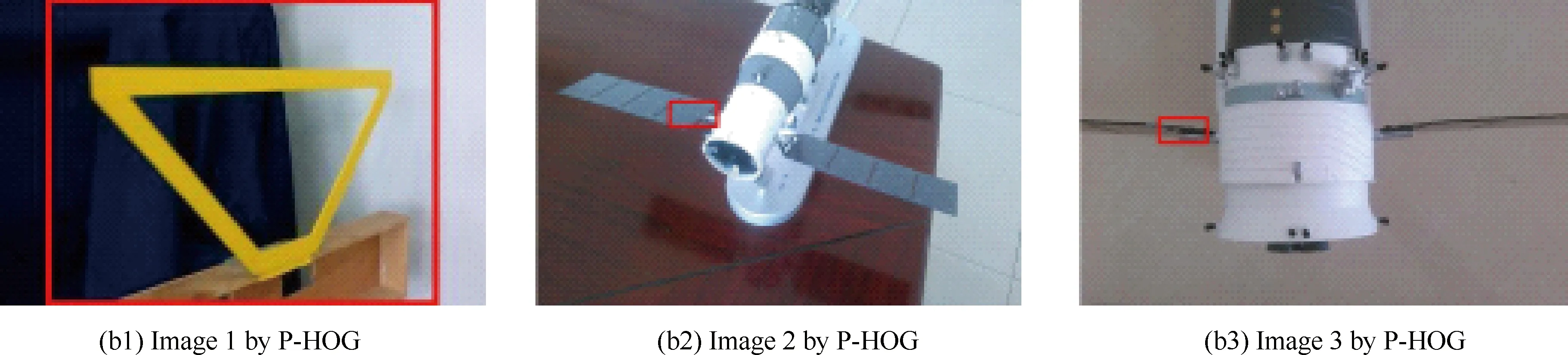

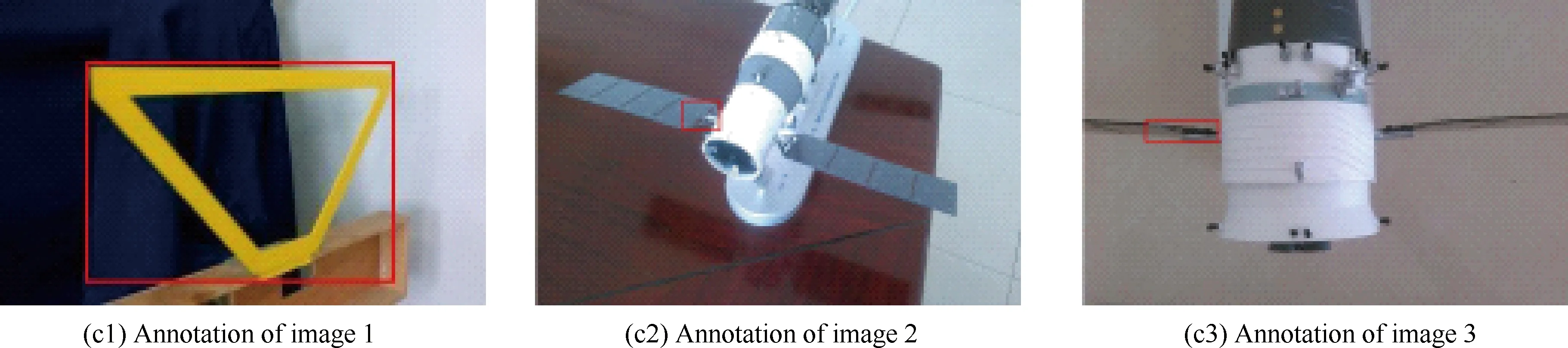

其中,目标的检测效果用检测率衡量,定义为测试集中被正确检测的图像占测试集中图像总数的比例,检测率越大表示算法的检测效果越好。如果算法对目标的预测区域与已标记的实际区域之间的交集部分超过其并集的50%,图像可以被认为是正确检测的。图7(a)所示的卫星帆板支架得到正确检测,而图7(b)中由于预测窗口与实际区域未相交(NG)或重叠区域比例过低(P-HOG),故判定为检测错误。

图7 NG特征和P-HOG特征对卫星帆板支架的正确及错误检测结果

Fig. 7 Correct and incorrect detection results by features NG and P-HOG of satellite panels stents

进一步,表2给出了不同特征下每幅图像的平均训练和测试时间对比,由于规范化梯度的判别特征计算简单,因此其时间开销很低。而P-HOG特征虽然能够有效地保持局部信息,但不可避免地提高了计算复杂度,其平均训练时间为0.046 s(为NG特征的2.421倍),预测时间为0.031 s(为NG特征的2.385倍)。虽然算法运行时间低于NG特征,但相对于基于模板匹配的检测算法仍然具有优势。

表2 NG特征和P-HOG特征下每幅图像的平均训练、预测时间开销对比

Table 2 Comparison of average training and testing time per image between features NG and P-HOG

TypeTotaltrainingtime/sTrainingtimeperimage/sTestingtimeperimage/sNG27.0160.0190.013P-HOG65.7340.0460.031

图8给出了规范化梯度特征和P-HOG特征对卫星帆板支架的检测结果对比,不难看出两种方法都能够正确检测大部分的图像,但后者由于利用了更多的结构性信息,因此其预测窗口更接近于实际的标记区域。

特别地,图8反映了本文算法能够适应一定视角差异下的目标检测任务。算法将帆板支架看作具有闭合边界的元素,这一性质是不随着视角的改变而变化的,因此算法可以适应目标视角的变化。此外,构建的训练集中已经包含目标在不同视角下的图像,进一步保证了训练后的模型能够学习到不同角度下目标的判别特征。

图9给出了算法在不同光照条件下对目标的检测结果,结果表明算法在不同光照条件下均能正确检测目标,对光照影响有一定的鲁棒性。

值得注意的是,虽然检测算法能够适应不同的光照环境,但实际的在轨服务,尤其是交会对接任务一般都在太阳入射角恒定的情况下开展。因此检测过程中因光照引起的图像差异并不大。

图8 NG特征和P-HOG特征对卫星帆板支架的检测结果对比

Fig. 8 Detection results comparison of bracket images by features NG and P-HOG of satellite panels stents

图9 本文算法在不同光照条件下的检测结果

Fig. 9 Detection performances of the proposed method under different luminance

从局部来看,除灰度值较大外,图像中的光亮部分与其余部分并无实质的不同,局部归一化后仅有部分亮光边缘得以保留,大部分的光亮部分作为非显著性特征被抑制。而保留的边缘一般非闭合,且形态特征与目标支架差异较大,因此并不会对目标的检测造成过多干扰。

4 结 论

1) 利用局部归一化方法在突出图像局部显著性特征上的优势,结合维纳滤波,对数据集图像进行预处理,减弱了图像中光照、噪声等外界因素对检测过程的影响,并进一步增强物体的边缘。

2) 利用级联SVM能够从数据集中学习目标判别特征和HOG特征适用于刚性物体检测的特点,提出一种改进的HOG特征算子,可以有效地保持图像的局部信息,从而保证目标检测的精度。

3) 通过对标准图像集的检测实验,验证了算法对物体检测精度的提升;通过对包含卫星帆板支架的图像应用模型,验证了算法能够适应目标形状和尺度的变化,并对光照条件和旋转具有一定的鲁棒性。相比于NG特征,算法的检测结果更接近于实际标记;同基于模板的检测方法比,算法的时间效率更高。

4) 进一步,本文算法假定测试图像中一定含有目标物体,因此模型只考虑目标的检测定位问题,但实际的场景更为复杂,测试图像中可能并不包含所检测的目标物体,此时对图像进行目标检测是没有意义的。因此未来工作考虑引入图像物体的分类过程,通过分类模型首先判断图像中是否包含待检测的目标类型,以提高模型的自适应性。

[1] HUANG P F, CAI J, MENG Z J, et al. Novel method of monocular real-time feature point tracking for tethered space robots[J]. Journal of Aerospace Engineering, 2014, 27(6): 04014039.

[2] 徐文福, 梁斌, 李成, 等. 空间机器人捕获非合作目标的测量与规划方法[J]. 机器人, 2010, 32(1): 61-69. XU W F, LIANG B, LI C, et al. Measurement and planning approach of space robot for capturing non-cooperative target[J]. Robot, 2010, 32(1): 61-69 (in Chinese).

[3] WONG S K. Non-cooperative target recognition in the frequency domain[J]. IEE Proceedings-Radar, Sonar and Navigation, 2004, 151(2): 77-84.

[4] RAMIREZ V A, GUTIERREZ S A M, YANEZ R E S. Quadrilateral detection using genetic algorithms[J]. Computacióny Sistemas, 2011, 15(2): 181-193 .

[5] 史骏, 姜志国, 冯昊, 等. 基于弹性网稀疏编码的空间目标识别[J]. 航空学报, 2013, 34(5): 1129-1139. SHI J, JIANG Z G, FENG H, et al. Elastic net sparse coding-based space object recognition[J]. Acta Aeronautica et Astronautica Sinica, 2013, 34(5): 1129-1139 (in Chinese).

[6] CAI J, HUANG P F, WANG D K. Novel dynamic template matching of visual servoing for tethered space robot[C]//2014 4th IEEE International Conference on Information Science and Technology (ICIST). Piscataway, NJ: IEEE Press, 2014: 389-392.

[7] 徐贵力, 徐静, 王彪, 等. 基于光照模糊相似融合不变矩的航天器目标识别[J]. 航空学报, 2014, 35(3): 857-867. XU G L, XU J, WANG B, et al. CIBA moment invariants and their use in spacecraft recognition algorithm[J]. Acta Aeronautica et Astronautica Sinica, 2014, 35(3): 857-867 (in Chinese).

[8] 李予蜀, 余农, 吴常泳, 等. 红外航空图像自动目标识别的形态滤波神经网络算法[J]. 航空学报, 2002, 23(4): 368-372. LI Y S, YU N, WU C Y, et al. Morphological neural networks with applications to automatic target recognition in aeronautics infrared image[J]. Acta Aeronautica et Astronautica Sinica, 2002, 23(4): 368-372 (in Chinese).

[9] 黄凯奇, 任伟强, 谭铁牛. 图像物体分类与检测算法综述[J]. 计算机学报, 2014, 36(6): 1225-1240. HUANG K Q, REN W Q, TAN T N. A review on image classification and detection[J]. Chines Journal of Computers, 2014, 36(6): 1225-1240 (in Chinese).

[10] ZITNICK C L, DOLLR P. Edgebox: Locating object proposals from edges[C]//Computer vision-ECCV 2014. Zurich: Springer International Publishing, 2014: 391-405.

[11] HEITZ G, KOLLER D. Learning spatial context: Using stuff to find things[C]//Computer vision-ECCV 2008. Marseille: Springer, 2008: 30-43.

[12] YANULEVSKAYA V, UIJLINGS J, GEUSEBROEK J M. Salient object detection: From pixels to segments[J]. Image and Vision Computing, 2013, 31(1): 31-42.

[13] ALEXE B, DESELAERS T, FERRARI V. Measuring the objectness of image windows[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(11): 2189-2202.

[14] RAHTU E, KANNALA J, BLASCHKO M. Learning a category independent object detection cascade[C]//2011 IEEE International Conference on Computer Vision (ICCV). Piscataway, NJ: IEEE Press, 2011: 1052-1059.

[15] CHENG M M, ZHANG Z M, LIN W Y, et al. BING: Binarized normed gradients for objectness estimation at 300fps[C]//2011 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Piscataway, NJ: IEEE Press, 2014.

[16] ZHANG Z, WARRELL J, TORR P H S. Proposal generation for object detection using cascaded ranking SVMs[C]//2011 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Piscataway, NJ: IEEE Press, 2011: 1497-1504.

[17] EVERINGHAM M, GOOL L V, WILLIAMS C K I, et al. The pascal visual object classes (VOC) challenge[J]. International Journal of Computer Vision, 2010, 88(2): 303-338.

[18] DALAL N, TRIGGS B. Histograms of oriented gradients for human detection[C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2005, 1: 886-893.

[19] DALAL N. Finding people in images and videos[D]. Grenoble: Institut National Polytechnique de Grenoble-INPG, 2006: 33-50.

[20] UIJLINGS J, VAN DE SANDE K E A, GEVERS T, et al. Selective search for object recognition[J]. International Journal of Computer Vision, 2013, 104(2): 154-171.

[21] LOWE D G. Object recognition from local scale-invariant features[C]//Proceedings of the Seventh IEEE International Conference on Computer Vision. Piscataway, NJ: IEEE Press, 1999, 2: 1150-1157.

[22] JARRETT K, KAVUKCUOGLU K, RANZATO M, et al. What is the best multi-stage architecture for object recognition?[C]//2009 IEEE 12th International Conference on Computer Vision. Piscataway, NJ: IEEE Press, 2009: 2146-2153.

陈路 男, 博士研究生。主要研究方向: 目标检测与识别, 计算机视觉, 机器学习。

Tel: 029-88460366-803

E-mail: chenlu11@mail.nwpu.edu.cn

黄攀峰 男, 博士, 教授, 博士生导师。主要研究方向: 空间机器人学, 空间遥操作, 导航、制导与控制。

Tel: 029-88460366-801

E-mail: pfhuang@nwpu.edu.cn

蔡佳 男, 博士研究生。主要研究方向: 非合作目标检测, 跟踪与相对位姿测量, 视觉导航。

Tel: 029-88460366-803

E-mail: caijia@mail.nwpu.edu.cn

Received: 2015-01-04; Revised: 2015-02-07; Accepted: 2015-03-11; Published online: 2015-03-18 14:16

URL: www.cnki.net/kcms/detail/11.1929.V.20150318.1416.002.html

Foundation items: National Natural Science Foundation of China (11272256, 61005062)

*Corresponding author. Tel.: 029-88460366-801 E-mail: pfhuang@nwpu.edu.cn

Space non-cooperative target detection based on improved features of histogram of oriented gradient

CHEN Lu1, 2, HUANG Panfeng1, 2, *, CAI Jia1, 2

1.NationalKeyLaboratoryofAerospaceFlightDynamics,NorthwesternPolytechnicalUniversity,Xi′an710072,China2.ResearchCenterforIntelligentRobotics,NorthwesternPolytechnicalUniversity,Xi′an710072,China

Traditional non-cooperative target detection methods are mostly based on different matching templates which are well-designed with additional prior information. Moreover, one single template can be merely used to detect objects with similar shapes and structures, causing low applicability in detecting non-cooperative targets whose prior information are usually unknown. In order to solve those problems and inspired by the object estimation technique based on normed gradient, an object detection algorithm using improved features of histogram of oriented gradient is proposed. A training data set composed of natural images and target images is first built manually. Secondly, we extract the modified HOG information in the labeled regions to preserve detailed structures of the local features. Then, the cascaded support vector machine is used to train the model autonomously, which does not require prior information. Finally, we design several tests using the trained model to detect targets from the testing images. Numerous experiments demonstrate that the detection rates of the proposed method are 94.5% and 94.2% respectively when applied to testing sets with 4 953 and 100 images. The time consumption of extracting one image is about 0.031 s while it is robust to object rotation and illumination under certain condition.

non-cooperative target; object detection; normed gradient; histogram of oriented gradient; local feature

2015-01-04; 退修日期: 2015-02-07; 录用日期: 2015-03-11; < class="emphasis_bold">网络出版时间:

时间: 2015-03-18 14:16

www.cnki.net/kcms/detail/11.1929.V.20150318.1416.002.html

国家自然科学基金 (11272256, 61005062)

.Tel.: 029-88460366-801 E-mail: pfhuang@nwpu.edu.cn

陈路, 黄攀峰, 蔡佳. 基于改进HOG特征的空间非合作目标检测[J]. 航空学报, 2016, 37(2): 717-726. CHEN L, HUANG P F, CAI J. Space non-cooperative target detection based on improved features of histogram of oriented gradient[J]. Acta Aeronautica et Astronautica Sinica, 2016, 37(2): 717-726.

http://hkxb.buaa.edu.cn hkxb@buaa.edu.cn

10.7527/S1000-6893.2015.0072

V412.4+1; TP301.6

: A

: 1000-6893(2016)02-0717-10

*