基于差异的视差估计方法研究

高 强,卢云朋,杨红叶

(华北电力大学 电气与电子工程学院,河北 保定 071003)

基于差异的视差估计方法研究

高 强,卢云朋,杨红叶

(华北电力大学 电气与电子工程学院,河北 保定 071003)

视差估计在立体图像编码、视频检索、立体图像分割等领域有重要的应用,是进行图像、视频分析的基础。首先,基于模糊隶属度提出了一种基于差异的视差估计方法;其次,引入模糊隶属度,把图像灰度转换为差异值;然后,分析了多块匹配的优越性;提出了基于多块匹配的视差估计方法;最后,在Middlebury网站上的测试结果证明了该方法的有效性。

视差;隶属度;立体;差异

在双目立体视觉系统中,视差是空间中的一点投影到左右双目成像平面上的成像点的位置差矢量,间接反映了景物的深度信息[1-2]。目前,基于窗口的视差估计方法逐渐受到大多数学者的青睐[3-4]。在该类算法中,窗口的选择是获得精准视差图的关键,窗口既要大到保证在低纹理区域能涵盖足够的灰度信息,又要小到保证在视差不连续区域获得光滑视差场。目前还没有一种黄金标准用以衡量这两者之间的矛盾。为了克服窗口选择的困难,出现了自适应窗口和自适应权重的视差估计方法[5-6]。

在块匹配中,相似性测度的选择也是决定视差估计效果的关键因素。在基于窗口的方法中大多采用的测度有SAD(Sum of Absolute Differences)、SSD(Sum of Squared Difference)、NCC(Normalized Cross-Correlation)[7]。以上测度是基本也是经典的,通常能够获得较稠密的视差图,但在视差不连续及低纹理区域的表现能力较差。针对这个不足很多学者对测度因子进行了改进。将模糊理论引入到相似性测度中,能够降低由于图像采集过程中带来的遮挡、光照、反射、阴影等一系列问题的影响[8-9]。本文基于模糊数学中的隶属度,提出了一种新的视差估计方法。

1 基于差异的视差估计方法

1.1 差异值的定义式

根据直观经验知:某个对象和某个等级(如优、良等)的差异与这个对象属于这个等级的隶属度密切相关。如果某个对象属于某个等级的隶属度越大,则该对象与该等级的差异就会越小;反之,与该等级的差异越大。显然差异D与隶属度u之间的关系具有如下的性质:

1) 差异D是隶属度u的函数,即D=f(u)。

2) 差异D是隶属度u的单调递减函数,即u→1时,D→0;u→0时,D→1。

3) 如果u(x,y)=u(x)·u(y),则D(x,y)=D(x)+

D(y)。

4) 差异D具有模糊性、可加性、单调性和非负性等属性。

引理[10],如果实函数满足以下条件:

1) f(x)≥0;

2) f(x)是严格单调增函数,即x≥y⟹f(x)≥f(y);

3) f(x·y)=f(x)+f(y)。

则f(x)=c·logax。

1.1.1 定理1

差异值与隶属度之间的关系为

(1)

式中:u(0≤u≤1)为属于某个等级(如优、良、中等)的隶属度;D(D≥0)为与之对应的某个等级(如优、良、中等)的差异;c(c∈R)为系数;a(a>1)为底数。

结合备注1与引理1即可证明定理1。

定义1:为了方便,将定理1的公式定义为u(0≤u≤1)为属于某个等级(如优、良、中等)的隶属度;D(D≥0)为与之对应的某个等级(如优、良、中等)的差异,c(c=1)为系数,a(a=10)为底数时,差异的单位为“阶”。

(2)

定义2:假设两个不同的对象属于某个等级(如优、良、中、差)的隶属度分别为u1(0≤u1≤1),u2(0≤u2≤1),与之对应的差异分别为D1(D1≥0),D2(D2≥0),则将两者之间的差异值定义为

(3)

Dd满足距离的公理化定义:

1) 0≤Dd(A,B)<∞;

2)A=B⟺Dd(A,B)=0;

3)Dd(A,B)=Dd(B,A);

4)Dd(A,C)=Dd(A,B)+Dd(B,C)。

1.1.2 定理2

设矩阵A=(aij)n×n,矩阵B=(bij)n×n,矩阵C=(cij)n×n,C=A-B,则

(4)

式中:aij(aij∈R)(i,j=1,2,…,n);bij(bij∈R)(i,j=1,2,…,n)是对象差异值。

证明:由以上可知

cij=aij-bij

(5)

由三角关系

(6)

可得

(7)

即

(8)

(9)

1.2 新的视差估计方法的建立

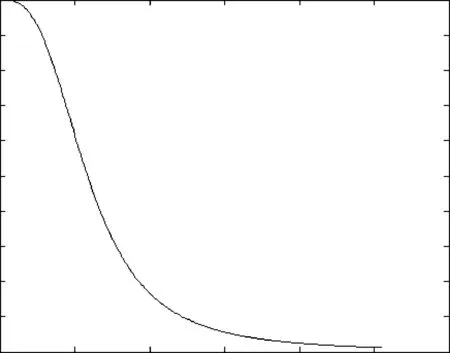

1.2.1 隶属度函数

隶属度函数的选择,对图像模糊化效果产生影响。

(10)

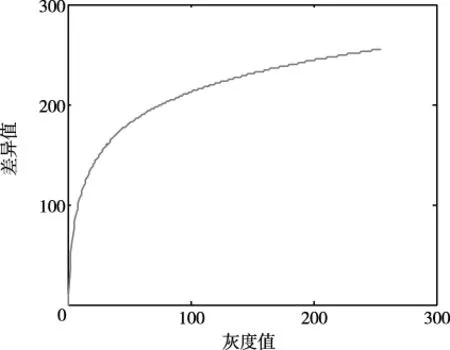

图1为本文中使用隶属度函数曲线。在选择隶属度函数上,本文考虑利用单调隶属度函数,即灰度值和隶属度一一对应,因此本文选择戒上型隶属度函数,灰度值、隶属度和差异值一一对应。典型隶属度函数中的戒上型可表达为

(11)

式中:a,b,c为参数。在本文中,令a=1,b=3,c=0。

图1 戒上型隶属度函数

1.2.2 差异值和测度SD(Sum of Differences)的建立

本文基于SAD的思想提出一种新的基于隶属度测度。IR(x,y)为基准图中点(x,y)的灰度值,IL(x+d,y)为对准图中点(x+d,y)的灰度值;W为以点(m,n)为中心的匹配窗口。则两个窗口的SAD的算法表达式为

(12)

式中:d为视差。基于SAD的表达式,可得差异测度的表达式为

(13)

式中:u(IR(x,y))和u(IL(x+d,y))分别是右图像中点(x,y)和左图像中点(x+d,y)的隶属度;lgu(IR(x,y))和lgu·(IL(x+d,y))是相应隶属度的差异值。

SAD视差估计方法是基于窗口的,处理过程中只是针对图像灰度进行处理,对处于视差不连续区域边界上灰度值进行匹配时,图2中两个匹配窗口的中心点恰好匹配。若中心点向右移动,则会出现图3中两个窗口的中心点原则上匹配,但通过观察看到两个矩形窗口内灰度值和差别很大,实际匹配过程无法正确匹配,造成误匹配。本文提出的基于模糊隶属度的视差估计算法,利用隶属度函数将图像灰度值转化为模糊化的差异值,将图像的差异值矩阵转换到0~255范围(见图4)。由图4可知,经过转换后,原图像灰度值都被放大,但在低灰度值区域被放大的倍数要远大于在高灰度区域的倍数,即缩小了低灰度区域与高灰度区域之间的差距。当出现图3的情况时,由于低灰度区域被放大得很多,高灰度区域被放大得很少,能够使得两个窗口内的差异值和基本一致,从而正确匹配,提高在视差不连续区域的稳健性。

图2 窗口处于视差连续区边界

图3 窗口处于视差不连续区域

图4 窗口处于视差不连续区域

1.2.3 多块匹配

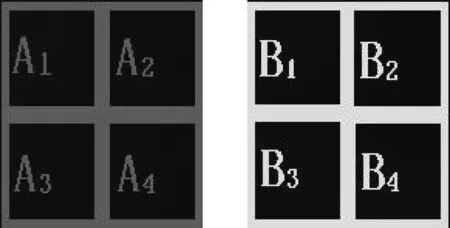

假定Ai(i=1,2,3,4)分别代表图5a中以像素点ai(i=1,2,3,4)为中心的窗口W(n×n)内像素的均值;Bi(i=1,2,3,4)分别代表图5b中以像素点bi(i=1,2,3,4)为中心的窗口W(n×n)内像素的均值。

图5 左、右图像4块匹配示意图

在基于块匹配的视差估计方法中通常采用单个块之间的匹配为:A1→B1或A2→B2或A3→B3或A4→B4。

如图5所示,匹配过程中如果满足

(14)

(15)

(16)

(17)

式中:th为设定的阈值,则认为其相似度较大,即判定对应块匹配。对应这样的匹配可以找到对应的块,但是匹配精度过低。若采用A1A2A3A4→B1B2B3B4之间的匹配,即4个块之间合起来进行相似性的比较,即

(18)

式中:TH为设定的阈值,根据上文定理2,单个块之间分别判定相似度与多个块联合再判断相似度满足下列条件

(19)

式(19)说明单个块之间的差值的和大于多个块之间和的差,由于SAD/SD属于最小距离测度,距离越小,相似度越大,利用多个块进行匹配比利用单个块进行匹配具有更高的可靠性根本原因是多块匹配利用了块与块之间的关联信息。

基于多块匹配的算法流程如下:

1)以右图像为参考图像,在右图像中选定一个窗口。

2)在左图中选定同一大小的窗口。

3)根据立体匹配外极限约束,两个匹配的窗口在同一水平线上,因此移动左图中的窗口,找到与右图像中最相似的子窗口,则用单块匹配原则判定这两个窗口的中心点为对应匹配点,将这两个子窗口做好标记。

4)移动右图中的窗口使其中心点到下一像素点,重复步骤2)、3),找到另外两个对应的子窗口,做好标记。

5)找到的被标记两对子窗口,利用多块匹配方法判断其相似性,若判断为相似,则保留这两对子窗口;若不相似,则放弃这两对子窗口的匹配结果。

2 实验结果与分析

在为了验证基于差异的视差估计方法的正确性及有效性,借助标准图像对比较基于差异视差估计算法与其他方法的性能。

2.1 与基于SAD的视差估计方法及参数不同的新方法的直观比较

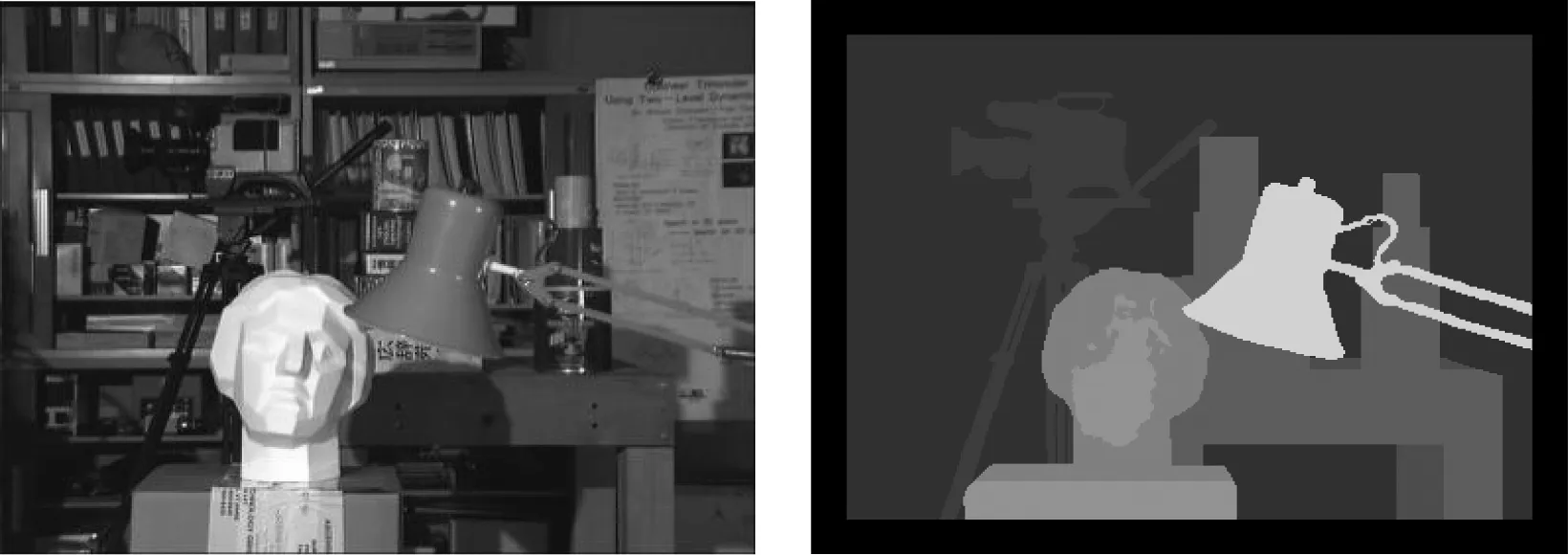

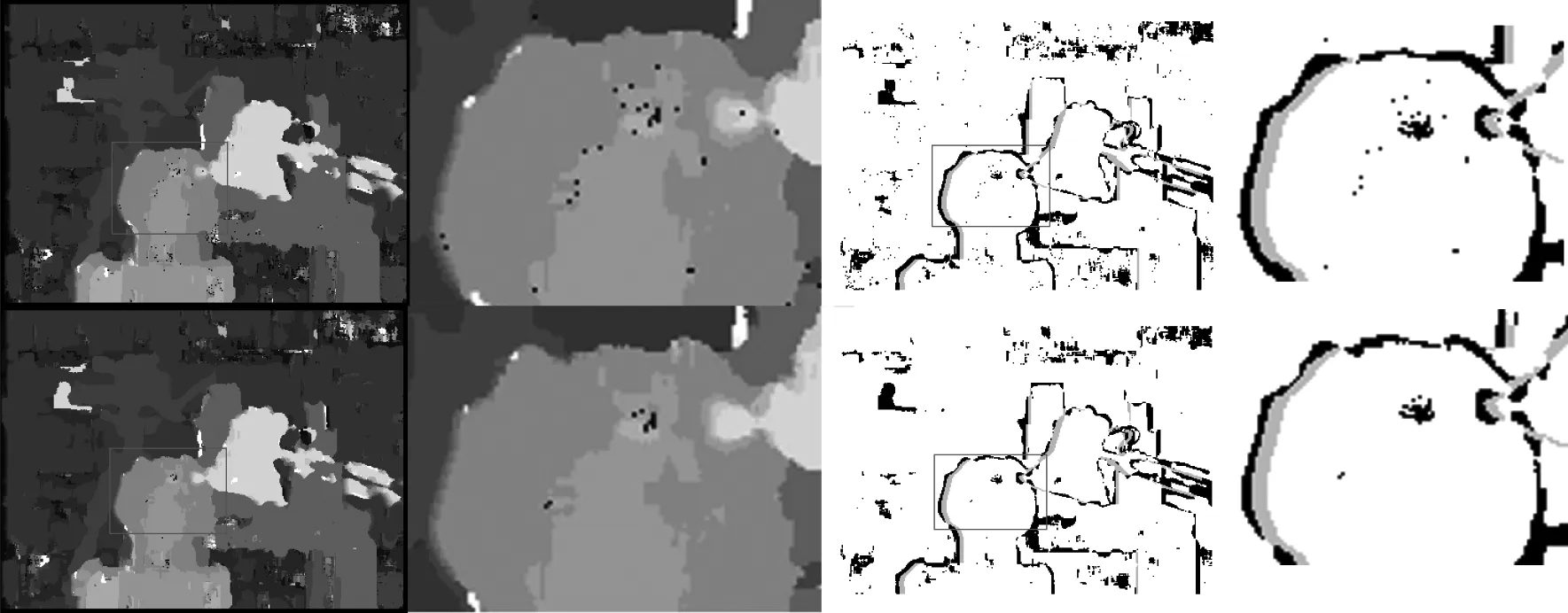

本文提出的SD测度因子是基于SAD测度因子的思想,因此本文首先与SAD的方法进行比较。图6为Tsukuba的左视图像与真实视差图,图7为SAD与SD的比较结果。图7中第1行为基于SAD的视差估计方法所得结果,第2行为基于SD的视差估计方法所得结果,其中参数为a=0.1,b=3,c=0。从图7中可看到基于SD的视差估计方法误匹配点较少(图中黑点代表误匹配点),即提高了匹配精度。

2.2 实验数据对比与分析

图6 Tsukuba图像

图7 基于SAD与基于SD的视差估计方法视差图对比图

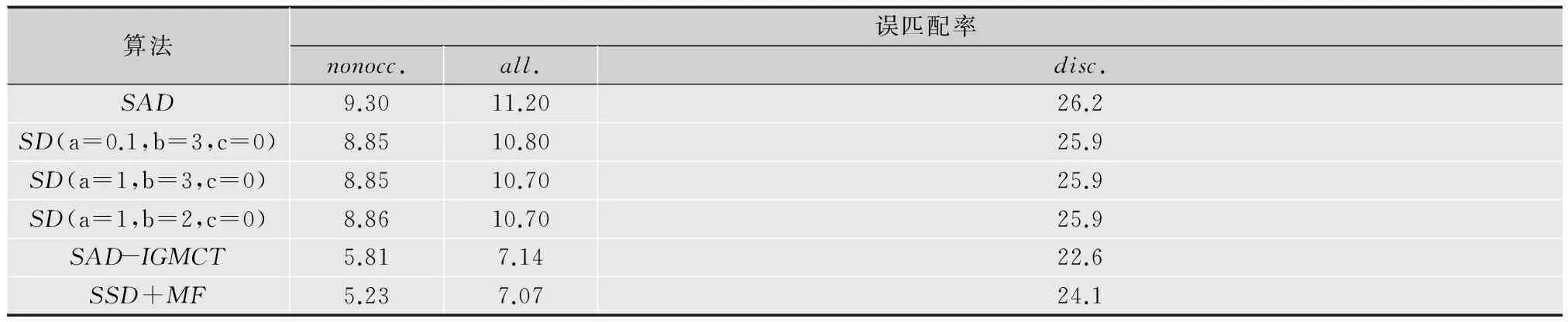

上文从直观角度说明了基于差异的视差估计方法的正确性与有效性,在本节中将从实验数据上分析本文提出方法的正确性与有效性。同时为了比较本文提出的算法与其他区域立体匹配算法的优劣,本文利用middlebury网站提供的SSD+MF[11]和SAD-IGMCT[12]两种方法做了比较,这两种算法都是以区域匹配算法SAD或SSD作为获取初始视差图的方法,而后再利用其他理论的联合视差估计算法。

如表1所示,实验数据为在middlebury网站测试结果,其中nonocc代表未遮挡区域误匹配率,all代表全部区域误匹配率,disc代表视差不连续区域误匹配率。从表1实验数据可得以下结论:

1)本文提出的基于差异的视差估计方法与基于SAD的视差估计方法性能有一定提升,主要表现在非遮挡区(nonocc)误匹配率由原来的9.3%下降到8.85%;全局(all)由原来的11.2%下降到10.8%;尤其是在视差不连续区(disc)由原来的26.2%下降到25.9%,说明了本方法能够提升视差不连续区域的匹配精度,即具有很好的稳健性。

2)基于差异的方法中隶属度函数参数不同时匹配精度略有不同。

3)由表中与SAD-IGMCT的联合视差估计方法相比,基于SD的算法性能仍需进一步提高。

表1 Tsukuba图像在基于SAD及SD视差估计方法的误匹配率 %

3 结论

本文提出了一种基于差异的视差估计方法。在相似性测度因子中引入了模糊隶属度,分析了隶属度的选择对视差估计方法的影响,分析了利用多块匹配代替单块配的优越性。本文提出的方法在视差不连续区域具有良好的稳健性,适合于边界模糊的立体图像的初始视差估计。本方方法与联合视差估计方法相比匹配精度较低,结合其他理论以提高匹配精度是今后研究的重点。

[1]段军,何明一,戴玉超.基于线段分割的图割立体匹配[J].电视技术,2012,36(11):15-18.

[2]吴方,王沛.一种改进的自适应权重立体匹配算法与校正[J].电视技术,2012,36(11):19-23.

[3]GUPTARK,CHOSY.Window-basedapproachforfaststereocorrespondence[J].IETComputerVision,2013,7(2):123-134.

[4]SUX,KHOSHGOFIAARTM.Arbitrarily-shapedwindowbasedstereomatchingusingthego-lightoptimizationalgorithm[C]//Proc.IEEEInternationalConferenceonImageProcessing,2007(ICIP2007).[S.l.]:IEEEPress,2007:556-559.

[5]DE-MAEZTUL,VILLANUEVAA,CABEZAR.Stereomatchingusinggradientsimilarityandlocallyadaptivesupport-weight[J].PatternRecognitionLetters,2011,32(13):1643-1651.

[6]GUZ,SUX,LIUY,etal.Localstereomatchingwithadaptivesupport-weight,ranktransformanddisparitycalibration[J].PatternRecognitionLetters,2008,29(9):1230-1235.

[7]MEIX,SUNX,ZHOUM,etal.Onbuildinganaccuratestereomatchingsystemongraphicshardware[C]//Proc.IEEEInternationalConferenceonComputerVisionWorkshops,2011(ICCVWorkshops2011).[S.l.]:IEEEPress,2011: 467-474.

[8]DUTTAA,KARA,CHATTERJIBN.Anovelapproachtocornermatchingusingfuzzysimilaritymeasure[C]//Proc.7thInternationalConferenceonAdvancesinPatternRecognition,2009(ICAPR′09).[S.l.]:IEEEPress,2009:57-60.

[9]GALARM,FERNANDEZJ,BELIAKOVG,etal.Interval-valuedfuzzysetsappliedtostereomatchingofcolorimages[J].IEEETrans.ImageProcessing,2011,20(7):1949-1961.

[10]SAFFEB,SNIDERAD.Fundamentalsofcomplexanalysiswithapplicationstoengineering,science,andmathematics[M].NJ:PrenticeHall,2003.

[11]SCHARSTEIND,SZELISKIR.Ataxonomyandevaluationofdensetwo-framestereocorrespondencealgorithms[J].InternationalJournalofComputerVision,2002,47(1):7-42.

[12]AMBROSCHK,KUBINGERW.Accuratehardware-basedstereovision[J].ComputerVisionandImageUnderstanding,2010(11):1303-1316.

责任编辑:时 雯

New Disparity Estimation Method Based on Difference Measurement

GAO Qiang,LU Yunpeng,YANG Hongye

(SchoolofElectricalandElectronicEngineering,NorthChinaElectricPowerUniversity,HebeiBaoding071003,China)

Disparity estimation is a basic analytic method for images and video and is highly used in fields like stereo image coding,video retrieval and stereo image segmentation.A new disparity estimation method based on the membership degree in fuzzy mathematics is proposed.In this paper,the membership degree is introduced,gray values of the image are transformed to difference values.Meanwhile,the superiority of the multi-block matching is analyzed.The new method based on the idea of block matching constructs a multi-block matching algorithm.The experimental results based on the Middlebury stereo datasets demonstrate that this method can achieve a better performance.

disparity;membership degree; stereo; difference

【本文献信息】高强,卢云朋,杨红叶.基于差异的视差估计方法研究[J].电视技术,2015,39(3).

TN911.73;TP391.4

A

10.16280/j.videoe.2015.03.006

2014-02-09