选择性背景优先的显著性检测模型

蒋寓文谭乐怡王守觉

①(中国科学院半导体研究所 北京 100083)

②(中国科学院苏州纳米技术与纳米仿生研究所 苏州 215123)

③(同济大学电子信息与工程学院 上海 200092)

选择性背景优先的显著性检测模型

蒋寓文①②谭乐怡*②③王守觉①②

①(中国科学院半导体研究所 北京 100083)

②(中国科学院苏州纳米技术与纳米仿生研究所 苏州 215123)

③(同济大学电子信息与工程学院 上海 200092)

在检测图像显著性区域的领域中,背景优先是一个较新的思路,但会遇到背景鉴别这个具有挑战性的难题。该文提出背景真实性的判断问题,在探索的过程中发现背景通常具有连续性的特征,根据这一特性实现了判定背景的方法,并将判断的结果作为显著性先验值应用于后继的计算中,最终结果的准确性和正确性得到有效提高。该文首先采用均值漂移(MS)分割算法将图片预分为超像素,计算所有超像素的初始显著值;随后提取原图的4个边界条,计算每两条之间的色彩直方图距离,判定小于预设阈值的两条边界作为“真”的背景,选择它们作为优先边界,计算先验显著性值;最后进行显著性计算,得到最终的显著图。实验结果表明,该算法能够准确检测出显著性区域,与其他6种算法相比具有较大优势。

计算机视觉;显著性分析;背景连续性;色彩直方图;超像素

1 引言

视觉注意机制的研究在计算机视觉中通常被称为显著性分析。Itti视觉模型是第1个用计算机分析注意机制的模型[1]。自它诞生以来,关于图像视觉显著性的研究开始引起众多学者的兴趣。经过近20年的发展,现已有多种显著性模型广泛应用于图像分割、目标识别、图像检索、视频追踪等多个领域[2]。

目前,显著性提取中最常用的算法还是直接计算像素或超像素的显著值[3- 6],本文称之为“显著性优先”。在众多采取这种思想的模型中,文献[5]的算法是近年影响较大的一种。该算法提取3种特征:多尺度对比度、中心直方图距离和色彩分布广度概率,最后把3种特征输入CRF模型计算显著图。与所有“显著性优先”的算法一样,该算法有一个局限性:检测到的显著性区域与中心区域的选择相关,与显著性区域邻近的像素也会获得较高的显著性,并常常出现显著性区域提取不完整的情况。

与“显著性优先”相反,文献[7]采用“背景优先”的思想来分析像素的显著性,提出了背景优先(background prior)模型,文献[7]中尝试这种方法解决提取不完整的问题。该算法先确定背景,然后将其剔除,剩余的部分就是显著性区域。它计算每个超像素(预分类算法得到的小区域)与背景的相似程度,相似程度越高显著性越小,反之,显著性越高。该算法对多数图片有很好的效果,但是也有一定的不足:如果背景较为复杂或者显著性区域在背景(主要指边界)中所占比例较大时,最终的显著图会有所偏差。我们认为问题产生的原因是该算法没有将背景看作一个整体进行分析,该算法仅仅是单独计算了边界上每一个超像素的显著值,作为后续计算的一个基础,而没有将边界作为一个整体进行考察,这样的处理方式有可能将图像边界中的孤立超像素误认为显著区域。此外,该算法还有一些其它的缺陷,例如:检测到的显著区域轮廓不够精确;背景中的某些孤立节点会被赋予偏高的显著值,区域一致性不佳等。

针对以上“背景优先”模型存在的问题,本文相应地提出了3点改进策略:(1)提出背景真实性的问题,并实现了判断“真”背景的算法:计算色彩直方图之间的距离,选择满足预设条件的一组边界,并将它们作为“优先边缘”参与后续的显著性计算,这也是本文最主要的创新点。(2)采用均值漂移(Mean Shift, MS)超像素预分割算法,使物体轮廓更精确,改善显著图的区域一致性。(3)提出适合MS超像素的显著度的计算方法。

在下文的论述中,统一将本文的显著性模型称为“选择性背景优先算法”,其主要思路为:首先基于MS超像素进行图片预分割,计算超像素的显著性初始值;随后加入判断背景真实性的步骤,通过计算色彩直方图距离,从图片的四边中选出距离小于预设阈值的两条边界判定为“真”的背景,将其作为优先边界,计算先验显著值;在此基础上进行后续的显著性计算并归一化,得到最终显著图。通过对大量图片的实验,证明了本文算法得到的显著图质量有较大提高。下面先介绍微软的显著性模型。

2 微软的背景优先(background prior)显著性模型

背景优先算法是近年新出现的一种显著性检测思路,由微软的几位学者于2012年提出。该算法使用Olga Vexler的Superpixel算法[8]得到超像素集{S},将所有包含边界像素的超像素集视为一个节点B,超像素Si的显著性是这样计算的:首先,用Dijkstra算法计算Si到背景B的最短路径,然后把最短路径上的所有连接边的权值相加,即得到超像素Si的显著性值:其中,Si是超像素,B是虚拟的背景节点B={B1, B2,…,BK},Bi为某一个边界超像素。E是边集,E={(Si, Sj)|Si与Sj相邻} ∪{(Si, B)|Si在边界上}。这样的定义实质上是建立了一个图结构G={V, E}, V是节点集V={Si}∪{B}。wt(Si, Si +1)是相邻超像素之间距离。

因为显著性区域也有可能分布在边界上,为了防止将显著性区域误认为边界,该算法先对边界超像素的显著性值进行计算,并将其作为基础显著性值参与到后继的计算中。尽管经过上述的处理,某些图片的检测结果还是会出现较大偏差,图1即显示了这样的情况。

图1(b)中,在进行边界超像素显著值计算时,属于显著区域的油箱在下边界中所占比例较大,因此油箱超像素没有获得较高的显著值,而背景中的亮光得到了更高的显著值(以白色椭圆标识),与原图产生了偏差。微软模型孤立地考察每一个超像素,则必然会产生这样的结果,如果对算法加以改进,增加一个判断真实背景的步骤,能够在一定程度上解决这个问题。

图2显示了微软模型存在的其他一些问题。在图2(a)中,虽然显著区域的判断在大体上无误,但背景区域中的一些叶片过亮了,使得区域一致性欠缺。在图2(b)中,甲虫的轮廓不够自然,在背部还出现了一处明显的鼓起(以白线标识),同时在图2(a)中也可以直观地看到,蒲公英的毛刺轮廓与显著图中的形状不是很一致。这是由于Olga预分割算法得到的超像素是由一个个小方格演变而来,在保留物体轮廓方面存在一定局限性。

本文算法首先通过增加“判断背景、选择背景”这一步骤,提出验证背景的算法,提高了背景优先模型的准确率;其次使用MS预分割算法,进一步在细节上改善了显著图的质量。

3 选择性背景优先算法

3.1 基于MS超像素的背景优先模型

采用某种分割算法先将图片预分为超像素,然后计算超像素的显著值是近年较常用的手段。由于均值漂移(MS)分割算法能完整地保留图像的轮廓,在色彩和空间上都具有良好的特性。我们选择它作为预分割算法。

图1 微软模型的检测偏差

图2 微软模型的其他缺陷

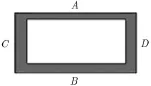

微软模型得到的超像素类似于一个个小方格,形状过于规则,有时会导致图像的一些细节有所损失;而MS算法得到超像素对原图的轮廓特征作了完整的保留,获得超像素的形状和图像中的景物的边界比较一致。但是MS算法不太适用于微软模型的框架,所以本文提出了不同的确定边界的方法。在提取边界时,我们采取了这样的手段:在边界上画出一定宽度的区域(见图3),以A, B, C, D命名,ABCD内的区域记为Ar(ABCD),称为背景区。A, B的长、宽分别为w,0.05h; C, D为h,0.05w。

图3 深灰色条代表提取的4条边缘,A, B, C, D是边缘条的名称

由预分类算法获得的超像素集记为{S1, S2,…, Sn},如果背景区域中包含Si的像素,那么Si称为背景超像素,所有符合这个条件的超像素记为{BS1,BS2,…,BSK},统计BSi中属于背景区的像素数目|Ar(BSi)|,计算θi=(|Ar(BSi)|-1)/|BSi|。显然,θi的值越大,超像素BSi是背景的可能性就越大。超像素Sk的显著性值定义为Sk到所有背景超像素{BS}的距离之和Ds(Sk)。

具体算法如下:

算法1 基于MS超像素的背景优先模型

步骤1 设置MS预分类参数(hs=7,hr=5,M =50),得到超像素集S1, S2,…,Sn,计算每个超像素的CIELab色彩均值(li, ai, bi);

步骤2 将包含边缘的超像素视为背景超像素BS1,BS2,…,BSK,对每个BSi计算θi;

步骤3 计算所有超像素到背景超像素集的距离,超像素Si距离计算方式为这个距离即S的

i初始显著性值;

步骤4 将所有距离值归一化到[0,1]:Ds(Si)

需要说明的是,文献[7]算法所定义的显著性值为该超像素到背景的测地线距离;而本文算法定义的是该超像素到所有背景超像素的距离之和,这样可以避免给复杂、分块的背景赋予不一致的显著值。下面介绍怎样添加“选择背景”这个先验知识。

3.2 基于边界连续性的背景判断

在对大量图片仔细分析后,我们注意到连续的、一致的景物或者色彩往往是图片的背景,比如天空、海洋、草地等等,而显著性部分通常是“突然介入”的人或其他事物。根据这样的假设,如果相隔较远的两条边界(A和B, C和D)相似度都较高(连续)的话,那么它们所包含的色彩或景物则更有可能是真正的背景。因此,对于鉴别背景“真”、“假”的问题,只需判断边界的连续性即可。

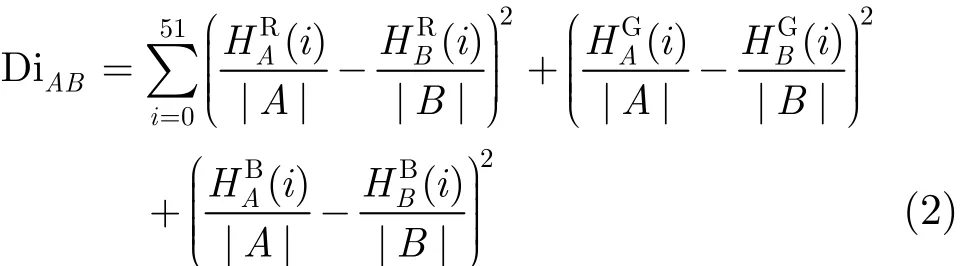

本文方法是这样的:先对A, B, C, D分别做基于RGB的直方图统计(HR(i),HG(i),HB(i)),i= 0,1,…,51,然后除以每个区域的总像素数目最后计算每2条之间的欧氏距离。直方图统计时每5级为一个划分,每个通道共分52级。边缘A, B之间的欧氏距离记为

最终边界连续性判断算法如下:

算法 2 边界判断算法

步骤1 计算相对的两组边缘(A, B),( C, D)的欧氏距离值,即DiAB和DiCD,如果二者中至少有一个取值小于0.1,则判定这两组边缘连续,选择它们作为优先边缘;

步骤2 如果这两个值都大于0.1(多次实验得出的经验值),则继续计算其余边缘对的距离DiAC,DiAD,DiBC,DiBD,选择其中距离最小(必须小于0.1)的一对边作为优先计算边缘;如果6组边缘的距离值都大于0.1的话,说明4条区域连续较小,选择纵向的两条边界为优先边缘。

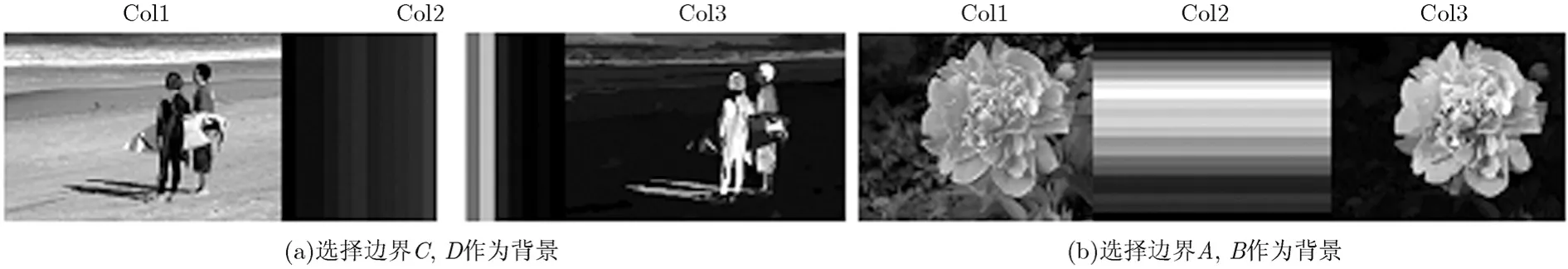

图4显示的是对边界连续性判断后的结果,Col1为原始图片,Col2 是计算边界距离后,相似度较高的两条边界计算的先验显著图,Col3是精化后的显著性分析结果。竖向显示的线条表示两条纵向的边界具有更高的相似性,而横向显示的线条表示横向的边界相似度更高。在实验中,我们发现大多数风景图片纵向边界相似程度高者往往较横向边界更多,这是由于所处的环境天空和陆地这两个大的背景是横向分布的,而竖直的方向则可以把两种元素都包括进来。因此,若4条边界的连续性都较小,我们选择纵向的两条为优先边缘。

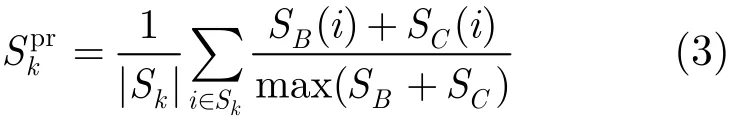

在完成优先边界的选择后,要根据入选的边缘组来计算先验显著性值。举例来说,如果选中的边缘对为B, C,那么要将图片分割为很多和B平行的纵向区域B1, B2,…,Bn,统计每条区域的直方图,计算Bi与B直方图的欧氏距离,这个距离即是Bi中像素的先验显著性值,归一化后记为SB(i), i为像素;用同样的方法计算相对于C区域的显著性值,归一化后记为SC(i);超像素SK的先验显著性值通过式(3)获得:

在获得先验显著性值之后,调用算法2计算背景优先显著性值Ds(Si),最终的显著性值为其中,为选中的优先边界。这个扩展虽然简单,对于显著性图质量的提高很有帮助。综上所述,本文算法主要步骤如下:

算法 3 本文算法

步骤 1 使用均值漂移算法分割图片;

步骤 2 使用3.1节算法1计算超像素的初始显著值;

步骤 3 使用3.2节算法2选择优先边界,计算先验显著性值;

步骤4 使用式(4)计算最终的显著性值,并归一化。

4 实验结果与分析

本节通过3组实验来测试选择性背景优先算法。首先,将选择性背景优先模型与本文的背景优先模型进行比较,考察最终的结果是否有改善;其次是选择性背景优先模型与微软亚研的背景优先模型的比较,由于二者都源于“背景优先”的思想;最后,将与一些广泛使用的模型进行对比。本算法使用Matlab2008和VS2008混合编程实现,测试环境为Intel(R) Core Quad 2.5 GHz CPU, 4 G内存,均值漂移分割参数均设为(hr=5.0,hs=7.0,M =50);实验用图为MSRA1000数据库和BSD500数据库中的图片。

4.1 背景优先模型与选择性背景优先模型

图4 边界连续性判断结果

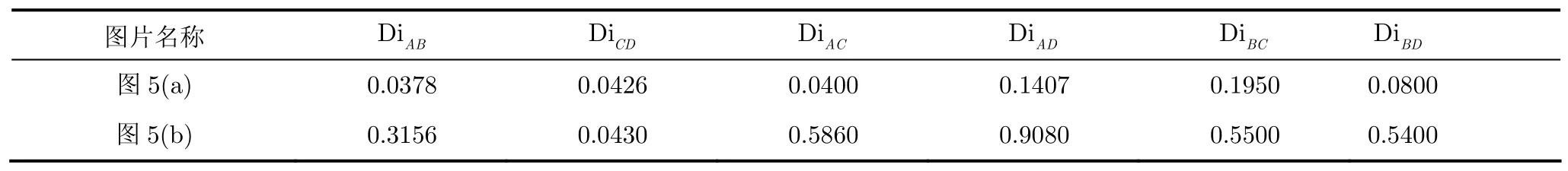

图5比较的是背景优先模型和选择性背景优先模型的计算后的显著图差异。Col1栏的图片为原始图片,Col2栏的图片是背景优先模型所得到的结果,Col3为加入选择背景后所得到的结果。表1显示了图5中两幅图片的6组边缘距离值。

根据算法的设定,图5(a)选择A, B两条边缘作为优先边缘;图5(b)选择C, D作为优先边缘。仅从视觉上看,加入选择性优先背景条件后的所得到的显著性图前景、背景之间的界限更加分明:前景更明亮,背景更黯淡;之前未能正确检测的图5(b)也得到了较好的结果。这也说明加入背景判断对于提高算法的正确率是有效的。接下来介绍本文模型和微软模型的比较。

4.2 与微软模型的比较和分析

本文模型和微软模型同是源于“背景优先”的思路,将二者作一个比较是很有必要的。本文模型与微软模型在预分类算法的选择、背景确定、显著性的计算方法上均不同。此外,本文利用了背景通常具有连续性这一特质来判断其真实性,并将判断的结果作为先验信息加入显著性计算。两个算法的实验结果如图6所示。Col1, Col2, Col3依次是原始图片,微软模型的处理结果,选择性背景优先模型的处理结果。

在图6(a)中,本文算法的背景部分呈现更好的区域一致性,显著区域的轮廓更与实物更接近,尤其是蒲公英的绒毛形状更精确,这与我们选择的预分类算法和显著度计算方法有关;图6(b)中,微软模型未能检测出显著性区域,而本文算法获得了正确的结果。总体来说,两种算法的正确率都比较高,但由于均值漂移预分割算法对原始图像的细节保存得更完整,因此本文算法获得的显著性区域更准确;同时,由于加入了背景判断,更多地利用了先验信息,所以正确性更高。

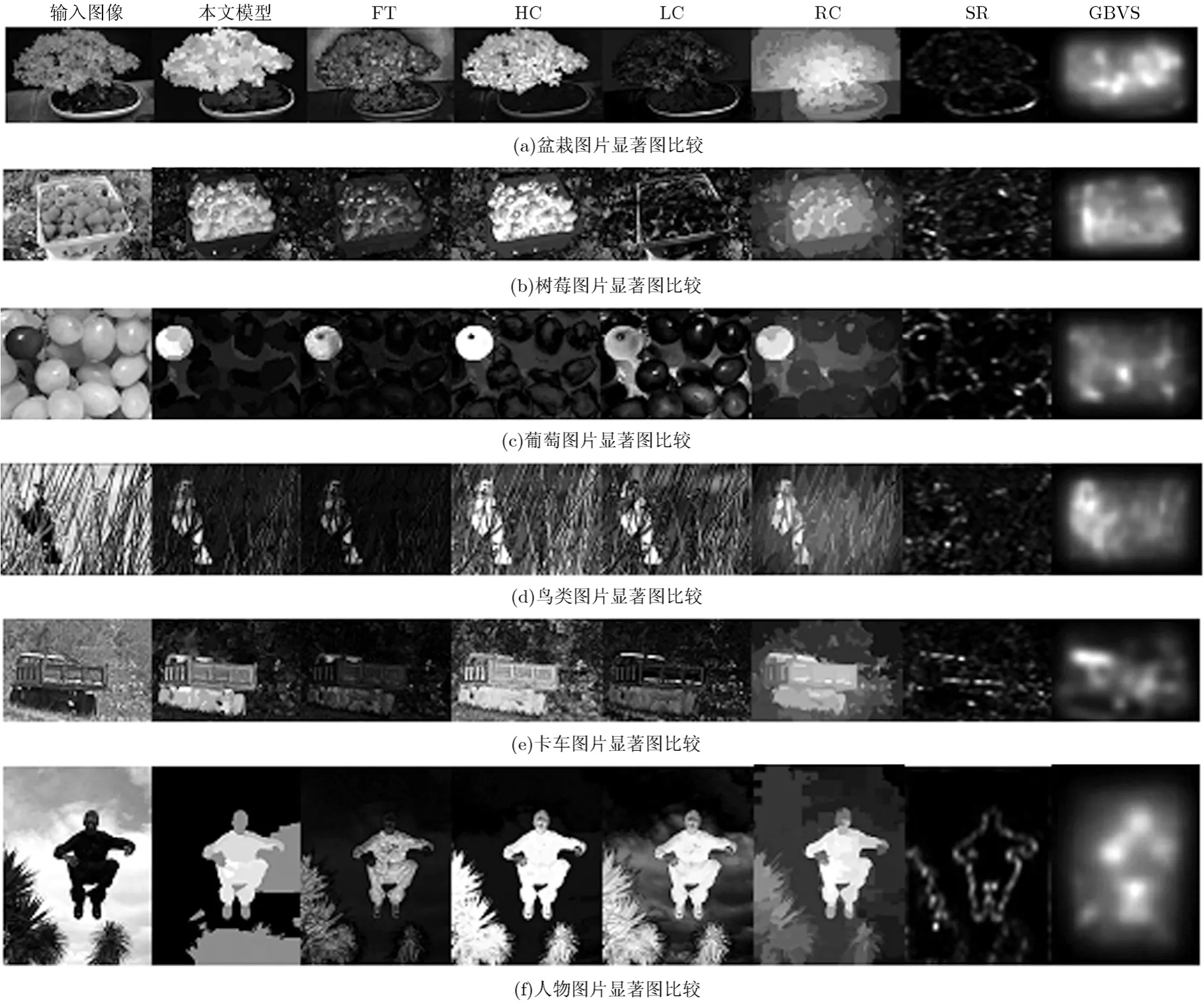

4.3 与其它算法的对比结果

为了进一步验证算法的性能,本节将展示与其他6种流行算法的对比结果:基于频率调制的FT[9]算法,基于直方图对比度的HC[10]算法,基于局部对比度的LC[11]算法和RC[10]算法(RC算法也使用超像素)、基于频域分析的SR算法和基于图论GBVS[12]算法。这6种算法采用不同的实现方式,较具代表性和多样性,其中FT算法,HC算法和RC算法都是较新的算法。

图7中,从左往右依次是原始图片,本文算法处理结果,FT, HC, LC, RC, SR, GBVS处理结果。从图7的实验结果来看,总体上本文算法能更准确地将背景排除。比起FT, LC, RC, SR, GBVS算法,本文得到的显著区域更明亮,与背景的对比更强烈,主体轮廓更完整;和HC算法相比,本文的背景部分更暗也更完整,大量减少了将背景区域误判为显著性区域的情况。图7(f)的原图左下角有一丛树木,与人物主体的颜色很相似,并且与天空背景形成强烈对比,但它并不是人眼所关注的显著区域,只有本文算法将其判断为“背景”而排除在外,其余6种对比算法都错误地将其纳入显著区域。

图5 背景优先模型和选择性背景优先的显著图比较

表1 图5两幅图片6组边缘距离值

图6 微软亚研背景优先模型与选择性背景优先模型的比较

图7 更多模型和选择性背景优先的显著图比较

我们使用文献[13]的F度量法对分割结果进行定量比较。以人工分割的结果作为理想情况,使用F度量进行评估。查准率(precision)代表当前分割结果中准确分割部分所占的比例,查全率(recall)代表此准确分割部分在理想分割结果中所占的比例,而F度量则为查准率和查全率的线性加权(加权系数参考文献[14],设定为0.5)。F度量所表示的综合指标值越大,分割结果越符合人类视觉的主观目标判断准则。F度量见图8。

图8 7种算法的F度量

从图8的定量分析的结果来看,多数情况下,本文算法的F度量优于其余6种算法。仅两幅图片的F度量略低,但是结果也相当地接近:图8(a)本文算法的F度量值为0.942, HC算法为0.962;图8(d)本文算法的F度量值为0.622, FT算法为0.624。这说明本文模型具有较强的鲁棒性。如果仅从人眼主观视觉角度来看,本文算法得到的显著图背景的区域一致性更好,易于与前景分离,可高效地用于后续的处理中。因此本文的“背景优先”模型比目前常用的“显著性优先”模型能更正确地区分主体和背景,不失为一种有效的、值得探讨显著性计算方法。

5 结论

本文采取“背景优先”的思想计算图像的显著性区域。提出背景判断的问题,发现背景具有连续性这一特征,有针对性地找到了解决的办法:把边界的连续性作为判断条件,若两条边界的直方图距离小于某个阈值,则认为它们是连续的,选择作为优先边界计算过程中显著性先验值。经过这样的处理后,最终得到的显著性图层次分明,更易于做后续的处理(如分割、提取等等)。通过在公开数据库MSRA和BSD-500上的实验,从多个角度证明了本文算法的可行性和有效性。

[1] Itti L, Koch C, and Niebur E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(11): 1254-1259.

[2] 马儒宁, 涂小坡, 丁军娣, 等. 视觉显著性凸显目标的评价[J].自动化学报, 2012, 38(5): 870-876. Ma Ru-ning, Tu Xiao-po, Ding Jun-di, et al.. To evaluate salience map towards popping out visual objects[J]. Acta Automatica Sinica, 2012, 38(5): 870-876.

[3] Achanta R, Estrada F, Wils P, et al.. Salient region detection and segmentation[C]. Proceedings of the 6th International Conference on Computer Vision Systems, Santorini, Greece, 2008: 66-75.

[4] Hou X and Zhang L. Saliency detection: a spectral residual approach[C]. IEEE Conference on Computer Vision and Pattern Recognition, Minneapolis, Minnesota, USA, 2007: 1-8.

[5] Kim C, Kim J, and Sim J. Multiscale saliency detection using random walk with restart[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2014, 24(2): 198-210.

[6] Perazzi F, Krahenbuhl P, Pritch Y, et al.. Saliency filters: contrast based filtering for salient region detection[C]. Proceeding of IEEE International Conferrence of Computer Vision and Pattern Recognition, RI, USA, 2012: 733-740.

[7] Wei Yi-chen, Wen Fang, and Zhu Wang-jiang. Geodesic saliency using back ground priors[C]. Proceeding of the European Conference on Computer Vision 2012: Part III, Florence, Italy, 2012: 29-42.

[8] Veksler O, Boykov Y, and Mehrani P. Superpixels and supervoxels in an energy optimization framework[C]. Proceeding of the European Conference on Computer Vision 2010, Berlin Heidelberg, 2010: 211-224.

[9] Achanta R, Hemami S, Estrada F, et al.. Frequency-tuned salient region detection[C]. IEEE Conference on Computer Vision and Pattern Recognition, Miami, FL, USA, 2009: 1597-1604.

[10] Cheng M, Zhang G, Mitra N, et al.. Global contrast based salient region detection[C]. IEEE Conference on Computer Vision and Pattern Recognition, Colorado Springs, USA, 2011: 409-416.

[11] Zhai Y and Shah M. Visual attention detection in video sequences using spatiotemporal cues[C]. Proceedings of ACM Multimedia, Santa Barbara, CA, USA, 2006: 815-824.

[12] Harel J, Koch C, and Perona P. Graph-based visual saliency[C]. Proceedings of Neural Information Processing Systems, Montreal, Quebec, Canada, 2006: 545-552.

[13] Russell B, Freeman W, Efros A, et al.. Using multiple segmentations to discover objects and their extent in image collections[C]. IEEE Conference on Computer Vision and Pattern Recognition, New York, USA, 2006: 1605-1614.

[14] 钱晓亮, 郭雷, 韩军伟, 等. 视觉显著性检测: 一种融合长期和短期特征的信息论算法[J]. 电子与信息学报, 2013, 35(7): 1636-1643. Qian Xiao-liang, Guo Lei, Han Jun-wei, et al.. Visual saliency detection: an information theoretic algorithm combined long-term with short-term features[J]. Journal of Electronics & Information Technology, 2013, 35(7): 1636-1643.

蒋寓文: 女,1986 年生,博士,主要研究方向为高维仿生信息学、图像处理、计算机视觉等.

谭乐怡: 女,1980 年生,博士,主要研究方向为模式识别、图像处理、计算机视觉等相关方向.

王守觉: 男,1925年生,中国科学院院士,主要研究方向为仿生模式识别、高维信息学.

Saliency Detected Model Based on Selective Edges Prior

Jiang Yu-wen①②Tan Le-yi②③Wang Shou-jue①②①(Institute of Semiconductors, Chinese Academy of Sciences, Beijing 100083, China)

②(Suzhou Institute of Nano-Tech and Nano-Biotics, Chinese Academy of Sciences, Suzhou 215123, China)

③(College of Electronics and Information Engineering, Tongji University, Shanghai 200092, China)

In the field of saliency detection, background prior has become a novel viewpoint, but how to identify the real background is challenging. In this paper, a background-identified method is proposed based on homology continuity using the extracted background features, and the identified background is applied to the following computation, improving the eventual saliency map in accuracy as well as correctness. First, the primary saliency of each superpixel produced by Mean Shift (MS) segmentation algorithm is calculated. Second, 4 edges are extracted to generate their RGB histograms, and the Euclidean distance between each two of the histograms is calculated, if the distance is smaller than a given value, these two edges are defined to be continual and more likely to be the real background. Finally, the pixel’s saliency is calculated using the prior background knowledge to figure the final saliency map. The results show that the proposed method outperforms other algorithms in accuracy and efficiency.

Computer vision; Saliency analysis; Background continuity; RGB histogram; Super pixel

TP391.4

A

1009-5896(2015)01-0130-07

10.11999/JEIT140119

2014-01-20收到,2014-06-13改回

国家自然科学基金(90920013)资助课题

*通信作者:谭乐怡 ywjiang2009@sinano.ac.cn