基于模糊测度的多特征融合鲁棒粒子滤波跟踪

郝 帅,程咏梅,马 旭,赵建涛,刘虎成

(1.西安科技大学电气与控制工程学院,陕西西安710054;2.西北工业大学自动化学院,陕西西安710072)

基于模糊测度的多特征融合鲁棒粒子滤波跟踪

郝 帅1,程咏梅2,马 旭2,赵建涛2,刘虎成2

(1.西安科技大学电气与控制工程学院,陕西西安710054;2.西北工业大学自动化学院,陕西西安710072)

针对基于单一颜色特征的粒子滤波跟踪算法易受光照变化、部分遮挡及相似干扰物的影响,而利用多特征融合的粒子滤波方法存在各特征权值、跟踪模板及窗口大小自适应选取问题,提出了一种基于模糊测度的多特征融合鲁棒粒子滤波跟踪算法。采用颜色及边缘方向直方图来描述目标量测模型,通过分别计算这两类特征在候选目标与参考目标之间的Bhattacharyya距离来确定其各自特征的模糊测度,通过查取模糊规则表来自适应地确定两类特征的权重;将连续帧的多特征联合模板更新机制用于对初始目标模板的更新;针对目标发生尺度变化造成跟踪窗口难以自适应的问题,通过引入粒子离散度实现了跟踪窗尺寸的自适应调整。实验结果表明:所提出的跟踪算法位置平均误差小于8个像素,相比于传统方法可以有效克服光照、部分遮挡以及相似目标干扰等影响,具有较高的跟踪精度及较强的鲁棒性。

粒子滤波;模糊测度;多特征融合;粒子离散度;目标跟踪

0 引 言

目标跟踪是计算机视觉领域中一个研究热点,在视频监控、军事侦察以及无人机视觉着陆/着舰相对导航[15]等领域有着广泛的应用。在目标跟踪领域中,粒子滤波跟踪算法以其处理非线性、非高斯问题能力受到研究人员的重视。文献[6]首先提出了基于颜色特征的粒子滤波跟踪算法,并验证了算法的有效性。文献[7]和文献[8]都采用颜色特征进行粒子滤波跟踪,通过实验验证了算法对目标平移、旋转、尺度变化具有不变性,且对部分遮挡也具有较好的鲁棒性。然而采用单一的颜色特征进行目标跟踪其鲁棒性不高,当目标和背景颜色相似或是光照不稳定的时候,往往导致跟踪精度下降甚至跟踪失败[9]。而利用多个特征在不同条件下的互补性可以实现鲁棒跟踪,因此很多研究人员采用多特征融合的方式进行目标跟踪,以增强跟踪的鲁棒性。文献[10]将颜色特征和纹理特征进行融合,并在压缩感知理论框架下实现目标的跟踪。文献[11]利用一种改进的粒子滤波算法进行目标跟踪,目标特征采用颜色和边缘方向进行融合。文献[12]在mean shift框架下将颜色特征和纹理特征进行融合跟踪。他们的实验都证明了多特征跟踪相比于单一特征跟踪的优势。然而上述方法在进行特征融合时主要是通过调整各个特征的权系数来实现的,但是这些系数一般取为固定的经验值。由于跟踪过程中目标周围环境的变化,导致各种特征在不同时刻、不同地点的可靠程度是不同的,因此如果能根据各特征的可靠程度自适应的调整权值,跟踪算法的鲁棒性及精度将会进一步提高。此外,由于目标尺寸及环境的变化,使得初始目标模板难以准确描述当前目标而且初始的跟踪窗口也难以自适应目标尺寸的变化,从而使得跟踪精度变差,鲁棒性变弱。

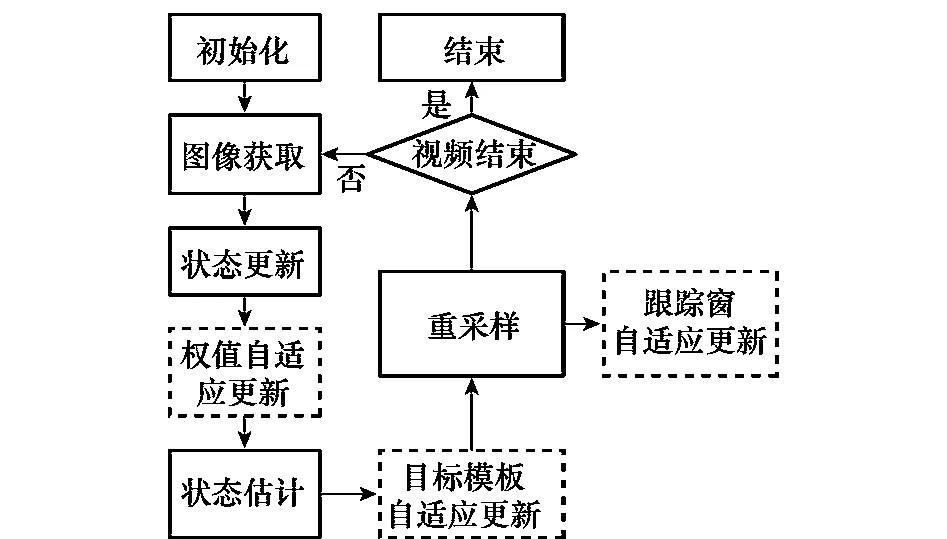

针对上述问题,本文提出一种基于模糊测度的多特征融合粒子滤波跟踪算法,原理图如图1所示,其中虚线框为本文重点解决的问题。本文选取目标的颜色特征和边缘方向直方图对目标进行描述。首先分别计算参考目标中这两类特征与候选目标特征之间的Bhattacharyya距离来确定其各自特征的模糊测度,并利用构造的隶属度函数进行模糊融合从而自适应的确定两类特征的权重。然后提出了基于连续帧的多特征联合模板更新策略并引入粒子离散度来解决初始目标模板更新及跟踪窗尺寸自适应的问题。最后通过实验验证了本文算法在各种环境下的跟踪精度及鲁棒性。

图1 跟踪算法流程图

1 粒子滤波跟踪算法

假设动态时变系统的状态向量为Xk,观测向量为Zk,状态转移模型和观测模型如下:

式中,F为系统的状态转移模型;Vk为系统的噪声;H表示观测模型;Wk表示观测噪声。

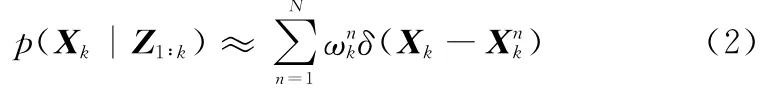

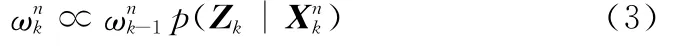

式中,δ(·)为Dirac delta函数。然后将先验转移概率作为重要性采样函数进行采样[13],则可得到粒子在k时刻的更新权值公式为

归一化权值为

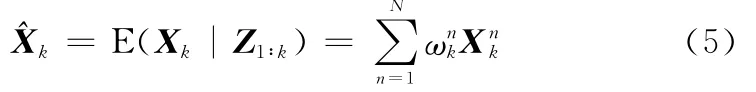

k时刻的系统状态估计可以表示如下:

2 基于模糊测度的多特征融合

图像中目标跟踪的实质就是从视频序列搜索感兴趣的目标。而目标通常可以用一些状态变量来描述,如目标的位置、速度、尺度、角度及形状等。因此,图像中对目标的跟踪也可以等效为估计目标状态变量的问题,也就是一个滤波问题。

2.1 系统动态模型的选取

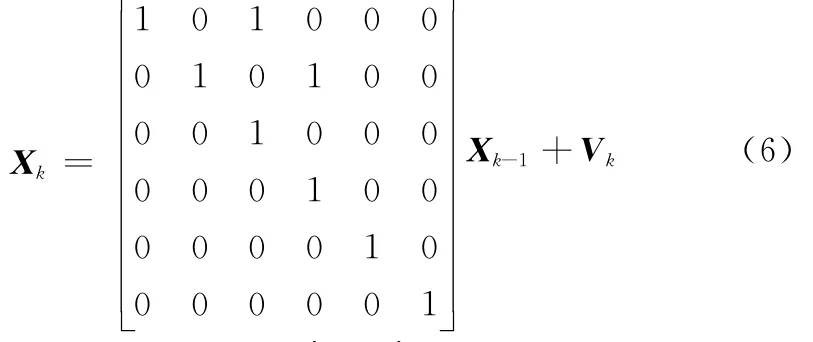

系统的动态模型是描述目标状态随时间的转移过程。在粒子滤波跟踪问题中,目标的状态就是粒子,系统的动态模型也就是粒子的传播过程。考虑到相邻帧间目标机动性较小,所以本文采用匀速模型来描述状态方程,如式(6)所示:

2.2 多特征融合的概率观测模型

观测模型主要是对粒子的状态量进行观测,计算每个粒子代表目标的可能状态与目标真实状态之间的相似程度,并且使与真实目标相似性大的粒子获得较大的权重,而与目标相似性小的粒子获得较小的权重。由于颜色直方图特征具有尺度不变性、旋转不变性而且抗部分遮挡,但是易受光照变化影响;而边缘方向直方图具有较好的抗光照特性,与颜色直方图特征具有较好的互补性。因此,本文将这两种特征进行融合来构造概率观测模型。

2.2.1 基于颜色直方图特征的概率观测模型

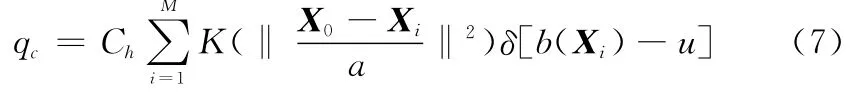

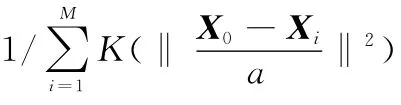

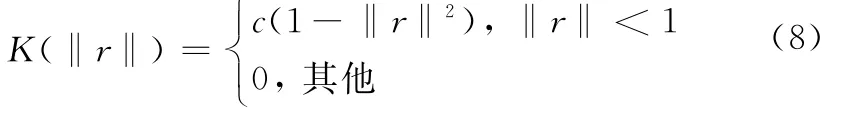

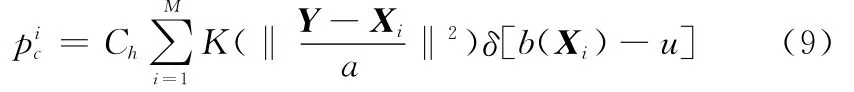

本文将红绿蓝(red green blue,RGB)颜色空间的R、G和B子空间分别分成8个相等的空间,构成8×8×8的特征空间,其中特征值的个数为83=512。考虑到像素点距离所跟踪目标中心的远近不同,其可靠程度也不同,因为离目标中心远的像素更有可能是背景像素或是被其他物体遮挡所以应该赋以小权值,故构造带有核函数加权颜色直方图特征qc={}u=1,2,…,512来描述目标:

式中,Y为区域中心点状态,通过Bhattacharyya系数来描述候选目标模型与目标模型之间的相似度:

进一步可得Bhattacharyya距离为

从而可以计算出颜色直方图特征的概率密度函数为

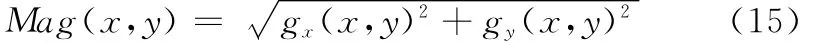

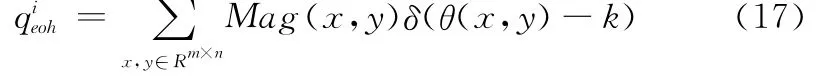

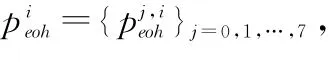

2.2.2 基于边缘方向直方图特征的概率观测模型

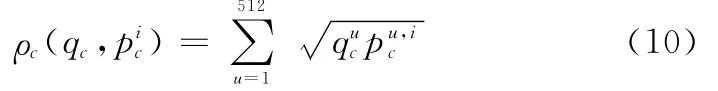

为了计算边缘方向直方图,首先需要统计目标区域的梯度幅值Mag(x,y)和方向θ(x,y)。利用Sobel算子计算像素在x和y方向上的梯度值:

式中,I(x,y)表示图像函数;Sobelx和Sobely分别为水平和垂直方向上的Sobel算子。则梯度幅值g(x,y)和梯度方向θ(x,y)表示如下[14]:

进一步可得Bhattacharyya距离为

但是边缘方向直方图特征不具备旋转不变性,当目标发生旋转时用该特征对目标进行跟踪可能会产生较大的误差。本文通过寻找边缘直方图相邻量化区间相似度的最小值来解决边缘方向直方图不具备旋转不变性这个问题。首先假设目标在相邻帧间的形变不会太大,认为相邻帧之间的形变不超过45°,则边缘方向直方图de(qe,)可以表述为

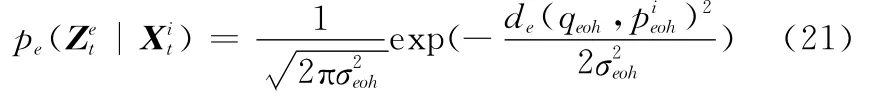

式中,n=-1,0,1。当n=-1时,表示候选区域边缘直方图向左循环移位45°;当n=0时,表示当前候选区域边缘直方图;当n=1时,表示候选区域边缘直方图向右循环移位45°。从而可以计算出边缘方向直方图特征的概率密度函数为

2.3 基于模糊测度的多特融合观测模型

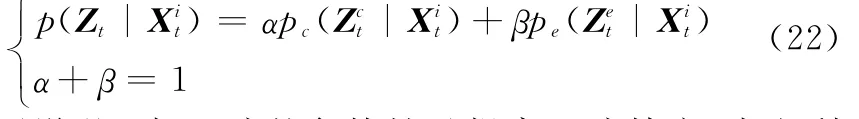

当得到两个特征的观测概率密度后,将两个特征进行融合有

为了增强目标跟踪的鲁棒性及提高跟踪精度,本文利用模糊原理自适应分配α和β值的大小,步骤如下。

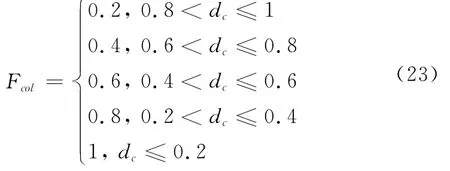

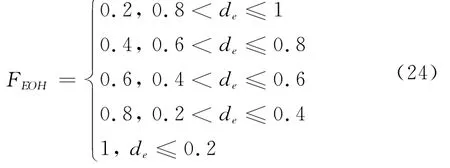

步骤1根据dc(qc,)(简记为dc)和de(qeoh,)(简记为de)构造模糊测度函数分别记为Fcol和FEOH,这两个函数用来表征各特征跟踪时的可靠程度。按照模糊逻辑规则对于可靠程度大的特征应该赋予较大的权值,可靠度小的赋予较小的权值,所以本文设计出模糊测度函数如式(23)和式(24)所示:

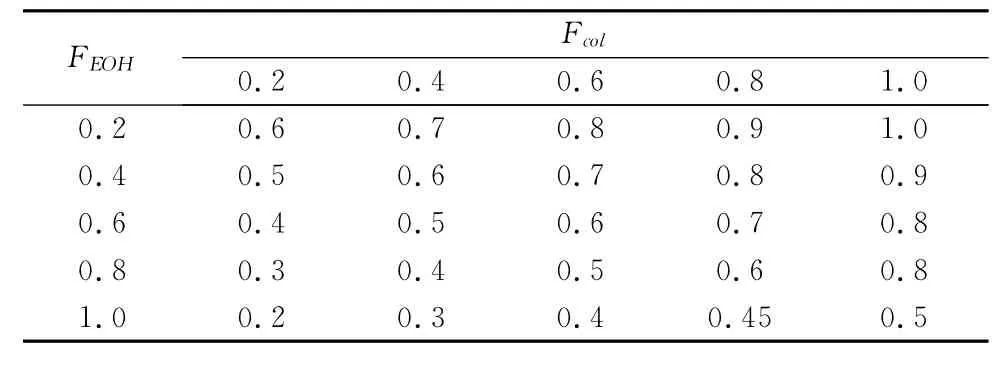

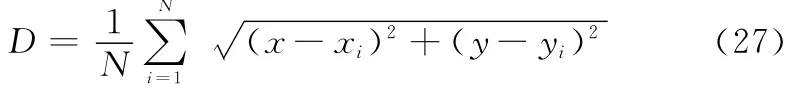

步骤2根据模糊测度函数制定权值系数规则表,如表1所示。在得到α权值系数后,通过式(14)就可以得到β。

表1 权值系数α的模糊控制规则表

2.4 自适应目标模板更新机制

在进行目标跟踪时,由于目标受光照、遮挡等因素的影响,其自身也会发生变化,造成从初始帧中选择的目标特征难以适应环境变化。因此,引入目标模板更新机制是非常必要的。模型更新可以采用如下形式:

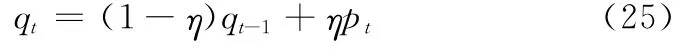

式中,qt为第t帧目标颜色/边缘方向特征的直方图;pt为第t帧目标跟踪结果计算出的特征直方图;η为更新系数。

基于连续帧的多特征联合模板更新机制原理如下:设目标第t帧的颜色和便边缘方向直方图分别为和,目标跟踪结果直方图分别记为和。在计算出各特征的模糊测度函数值后,比较这两个值的大小,只有当其中一个测度函数值大于另一个特征的模糊测度函数值且大于固定阈值K(本文取为0.6)时,才对较小相似度的特征模板进行更新。此外,为了消除目标特征瞬间跳变造成的影响,只有当连续3帧图像都满足上述条件时才对相似度较小的目标进行更新。给出算法实现的伪代码如下:

然而当颜色特征和边缘方向特征的模糊测度函数值都小于0.4时,说明用两个特征描述目标的相似度都较低,目标很有可能被遮挡。在这种情况下,文本主要通过增大系统的噪声方差来增加搜索范围。

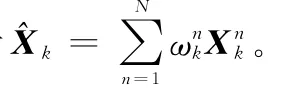

2.5 基于粒子离散度的自适应跟踪窗口

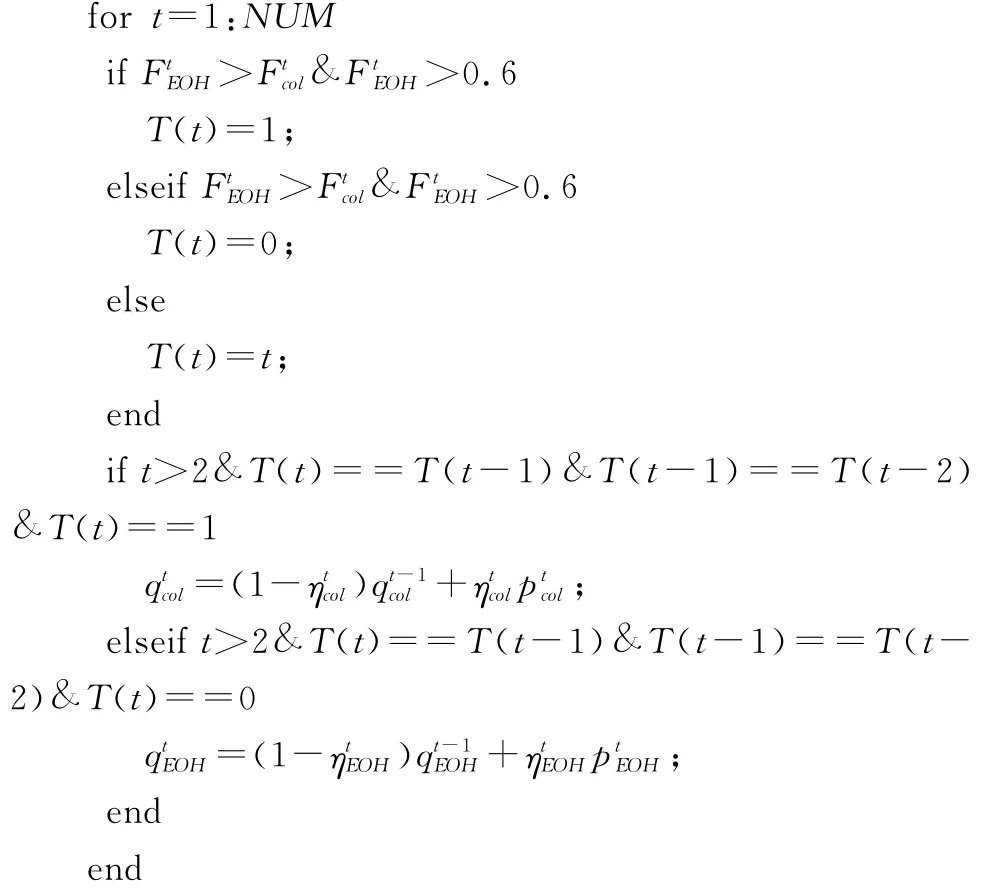

为了实现跟踪窗口的自适应调整,本文通过粒子离散度(记为D)进行描述,它定义如下:

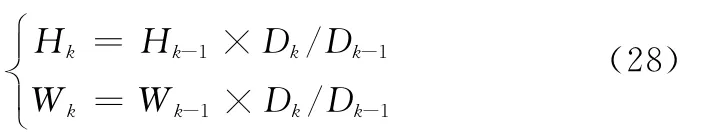

式中,N为粒子个数;(xi,yi)为第i个粒子的横、纵坐标;(x,y)为目标中心的横、纵坐标。考虑到权值小的粒子对粒子离散度确定贡献度也较小,所以本文将粒子按权值大小排列后,只选其中的前95%×N个粒子进行粒子离散度的计算。通过求取前后两帧的粒子离散度就可以建立窗口自适应调整模型:

式中,H和W为跟踪窗的高度和宽度;k表示第k帧图像。

3 算法流程

基于模糊测度的多特征融合跟踪算法步骤如下。

步骤3权值更新。根据式(13)分别求取颜色特征观测概率密度pc(Zk|)和边缘直方图特征观测概率密度pe(Zk|),并由式(12)和式(21)分别求取两种特征各自的模糊测度。然后根据表1的模糊控制规则表求取各个特征的权值系数,代入式(22)求得每个粒子的权值。

步骤5根据式(26)求取更新系数后,按照式(5)进行目标模板的跟新。

步骤7根据式(27)和式(28)求出跟踪窗口的尺寸,进行输出显示。

步骤8转入步骤2中执行。

4 实验结果及分析

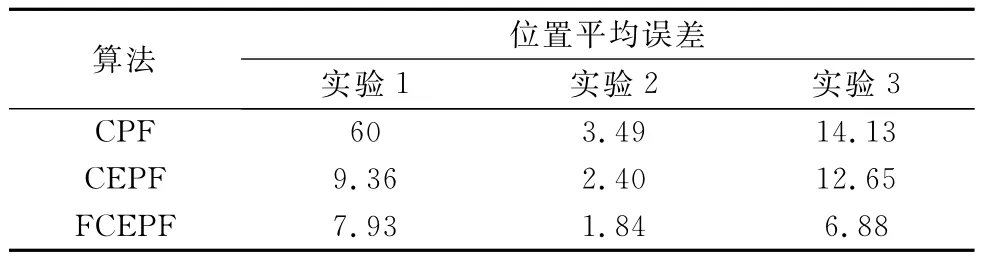

实验是在联想笔记本电脑(型号为T410)上用MATLAB2011实现的。为了验证本文算法(记为FCEPF)的有效性,选取了有相似目标干扰、遮挡以及有光照和尺度影响的3段视频进行实验,并与基于颜色的粒子滤波跟踪方法(记为CPF)以及融合了颜色和边缘特征(其中特征权值系数固定)的粒子滤波跟踪方法(记为CEPF)进行比较。

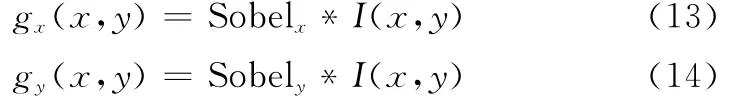

(1)存在干扰物的实验

用CMU标准数据库中航拍小汽车的视频,截取其中一段长度为301帧的视频进行测试。实验中在第105帧的时候,从图2中可以看出所用的3种跟踪方法都能较好的跟踪目标。但是在第108帧的时候由于出现颜色相近的干扰目标,导致CPF方法目标跟踪错误,而CEPF和FCEPF方法依然能够对合作目标进行准确跟踪。在第275帧,由于CPF已经跟踪了错误的目标,所以该方法离真实目标位置越来越远,而FCEPF相比于CEPF方法跟踪精度较高,如图2所示。

图2 汽车视频跟踪结果

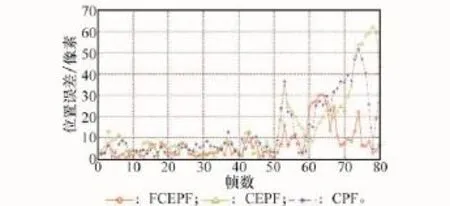

3种方法的跟踪误差用跟踪目标的中心坐标与实际目标位置的欧式距离来描述,其跟踪误差结果如图3所示。

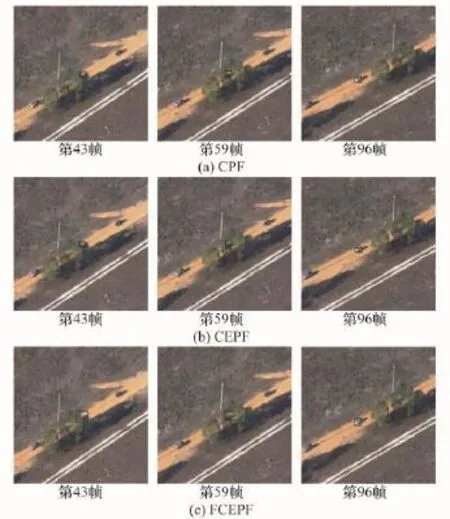

(2)遮挡实验

采用CMU标准数据库中小汽车被树遮挡的视频,截取其中一段长度为第105帧的视频进行测试。第43帧和第59帧分别为目标半遮挡和全遮挡情况,当目标被遮挡时FECPF算法计算出两个特征描述目标的相似度都较低,因此将系统噪声加大从而扩大粒子的搜索范围,并通过粒子离散度的计算扩大了跟踪窗,所以相比于其他两种跟踪方法其跟踪精度较高。而在第96帧目标未被遮挡情况,3种方法都能较好的跟踪目标,结果如图4所示。

图3 汽车视频跟踪误差曲线

图4 遮挡实验跟踪结果

3种方法的跟踪误差结果如图5所示。

图5 遮挡实验跟踪误差曲线

(3)尺度+光照实验

利用机载相机拍摄了一段无人机跟踪航母上合作目标的视频,合作目标大小为5.5 cm×5.5 cm,并将其置于航母模型上,其合作目标的具体设计过程可参考文献[15],最后选取其中80帧进行实验。实验是在光照条件下进行的,可以看出红色的合作目标由于受太阳光照影响亮度较高,而且为了模拟飞机着舰,实验是一个由远及近的过程,合作目标存在尺度的变化。从图6的第2帧可以看出,起始时刻3种方法都能较好的跟踪舰上合作目标,第30帧时可以看出由于受光照影响CPF的跟踪误差大于其他两种方法。第65帧时由于目标有明显的尺度变化,CPF法的跟踪误差增大,ECPF法也同样具有一定的误差而且跟踪窗不能自适应调整。本文提出FECPF跟踪方法则具有较高的精度,而且能够实现跟踪窗口的自适应调整,较为准确的跟踪合作目标。

图6 合作目标跟踪结果

3种方法的跟踪误差结果如图7所示。

图7 合作目标跟踪误差曲线

3种算法的位置平均误差结果如表2所示。

表2 跟踪精度 像素

从以上3个实验的跟踪结果及跟踪精度表的分析可知,本文提出的FECPF方法不仅可以抗遮挡、相似物干扰以及抗光照、尺度的影响,而且相比于CPF法和CEPF法具有较高的精度及较强的鲁棒性,误差不超过8个像素。

5 结 论

本文针对基于单一颜色特征的粒子滤波跟踪算法易受光照变化、部分遮挡及相似干扰物的影响,而利用多特征融合的粒子滤波方法存在各特征权值、跟踪模板及窗口大小自适应选取问题,提出了一种基于模糊测度的多特征融合鲁棒粒子滤波跟踪算法。通过构造的隶属度函数来确定颜色特征和边缘方向特征各自的模糊测度值,从而自适应地确定这两类特征的权重进行特征融合。并在此基础上提出了基于连续帧的多特征联合模板更新机制来解决传统模板更新鲁棒性弱的问题。最后通过引入粒子离散度来实现跟踪窗尺寸的自适应调整。实验结果表明本文所提出的方法可以有效解决光照及复杂环境下目标跟踪问题,3组实验位置平均误差小于8个像素,具有较高的跟踪精度和较强的鲁棒性。如何进一步提高跟踪算法的实时性将是本文后续研究的重点。

[1]He S F,Yang Q X,Lau R W H,et al.Visual tracking via locality sensitive histograms[C]∥Proc.of the IEEE International Conference on Computer Vision and Pattern Recognition,2013:2427- 2434.

[2]Coutard L,Chaumette F.Visual detection and 3D model-based tracking for landing on an aircraft carrier[C]∥Proc.of the IEEE International Conference on Robotics and Automation,2011:1746- 1751.

[3]Cheng J,Zhou Y,Cai N,et al.Infrared object tracking based on paricle filters[J].Journal of Infrared and Millimeter Waves,2006,25(2):113- 117(程建,周越,蔡念,等.基于粒子滤波的红外目标跟踪[J].红外与毫米波学报,2006,25(2):113- 117.)

[4]Arora S,Jain S,Scherer S,et al.Infrastructure-free shipdeck tracking for autonomous landing[C]∥Proc.of the IEEE International Conference on Robotics and Automation,2013:323- 330.

[5]Li S J,Xiao L P,Gao L.Detection and tracking of moving targets in photoelectric imaging guidance[J].Systems Engineering and Electronics,2014,36(1):23- 30(李少军,肖利平,高磊.光电成像制导中地面运动目标检测与跟踪[J].系统工程与电子技术,2014,36(1):23- 30.)

[6]Katja N,Esther K M,Luc V G.An adaptive color-based filter[J].Image Vision Computing,2003,21(1):99- 110.

[7]Han Z Y,Xu T R,Chen Z H.An improved color-based tracking by particle filter[C]∥Proc.of the International Conference on Transportation,Mechanical,and Electrical Engineering,2011:2512- 2515.

[8]Satoshi H,Nozomu H.A model update scheme of color-based particle filter for multi-color object tracking[C]∥Proc.of theIEEE International Symposium on Intelligent Signal Processing and Communication Systems,2012:102- 107.

[9]Li Y Z,Lu Z Y,Gao Q X,et al.Particle filter and mean shift tracking method based on multi-feature fusion[J].Journal of Electronics&Information Technology,2010,32(2):411- 415.(李远征,卢朝阳,高全学,等.基于多特征融合的均值迁移粒子滤波跟踪算法[J].电子与信息学报,2010,32(2):411- 415.)

[10]Zhu Q P,Yan J,Zhang H,et al.Real-time tracking using multiple features based on compressive sensing[J].Optics and Precision Engineering,2013,21(2):437- 443.(朱秋平,颜佳,张虎,等.基于压缩感知的多特征实时跟踪[J].光学精密工程,2013,21(2):437- 443.)

[11]Jin L J,Cheng J,Huang H.Human tracking in the complicated background by particle filter using color-histogram and hog[C]∥Proc.of the International Symposium on Intelligent Signal Processing and Communication Systems,2010:1- 4.

[12]Ning J F,Zhang L,Zhang D,et al.Robust object tracking using joint color-texture histogram[J].International Journal of Pattern Recognition and Artificial Intelligence,2009,23(7):1245- 1263.

[13]Arulampalam M S,Maskell S,Gordon N,et al.A tutorial on particle filters for online nonlinear/non-Gaussian Bayesian tracking[J].IEEE Trans.on Signal Processing,2002,50(2):174- 188.

[14]Zuo J Y,Zhao C H,Cheng Y M,et al.Particle filter based on visual tracking using new observation model[C]∥Proc.of the IEEE International Conference on Automation and Logistics,2007:436- 440.

[15]Hao S,Cheng Y M,Ma X,et al.Robust corner precise detection algorithm for visual landing navigation of UAV[J].Systems Engineering and Electronics,2013,35(6):61- 66.(郝帅,程咏梅,马旭,等.无人机视觉着舰导航鲁棒角点精确检测算法[J].系统工程与电子技术,2013,35(6):61- 66.)

马 旭(198-5 -),女,博士研究生,主要研究方向为视觉导航、模式识别和图像处理。

E-mail:maxu.fish@yahoo.com.cn

赵建涛(199-0 -),男,硕士研究生,主要研究方向为视觉导航、模式识别和图像处理。

E-mail:haoxust@163.com

刘虎成(199-0 -),男,硕士研究生,主要研究方向为视觉导航、飞行仿真。

E-mail:huchengliu@163.com

Multi-feature fusion robust particle filter tracking based on fuzzy measure

HAO Shuai1,CHENG Yong-mei2,MA Xu2,ZHAO Jian-tao2,LIU Hu-cheng2

(1.School of Electrical and Control Engineering,Xi’an University of Science and Technology,Xi’an 710054,China;2.College of Automation,Northwestern Polytechnical University,Xi’an 710072,China)

In order to overcome the problem that particle filter tracking based on the single color feature is susceptible to illumination changes,partial occlusion and the interference of the similar,and the feature weight,tracking template and tracking window size are difficult to adaptive when the particle filter tracking method based on multi-feature fusion is used,a multi-feature fusion particle filter tracking based on the fuzzy measure is presented.A color histogram and a edge orient histogram are used to describe the target measure model,and Bhattacharyya distance of these two features between the candidate and reference targets is used to determine their separate fuzzy measures.Then,the weights of these two features are adaptively determined by referring to the fuzzy rule table.Besides,a combined template update mechanism of multi-feature based on successive frames is adopted to update the initial target template.Finally,particle dispersion is introduced to solve the problem that the tracking window cannot adapt to changes of the tracking target scale.Experimental results indicate that the average error of the proposed tracking algorithm is less than 8 pixel errors.Compared with the traditional tracking algorithm,the proposed algorithm can effectively solve the problem of illumination changes,partial occlusion and the interference of the similar,and it can satisfy the system requirements of higher precision and strong robustness.

particle filter;fuzzy measure;multi-feature fusion;particle dispersion;target tracking

TP 391

A

10.3969/j.issn.1001-506X.2015.11.04

郝 帅(1986- ),男,讲师,博士,主要研究方向为视觉导航、模式识别和图像处理。

E-mail:hsh000@163.com

程咏梅(1960 -),女,教授,博士,主要研究方向为信息融合、目标跟踪、视觉导航。

E-mail:chengym@nwpu.edu.cn

1001-506X(2015)11-2447-07

2014- 10- 23;

2015- 04- 10;网络优先出版日期:2015- 05- 13。

网络优先出版地址:http://www.cnki.net/kcms/detail/11.2422.TN.20150513.1112.003.html

西安市科技计划(CXY1436(9));西安科技大学博士启动金(2015QDJ007);西安科技大学培育基金(2014015)资助课题