一种多目视觉三维测距系统设计

佘彩云, 胡贤洪, 唐 坤

(上海无线电设备研究所,上海200090)

0 引言

空间交会对接测量技术是指两航天器在空间交会对接时,采用测量敏感器对相对位置和相对姿态进行测量及其他相关的技术[1]。两飞行器在距离较近时,相对于雷达和其他方法,采用光学成像和图像信息处理的方法,识别和跟踪性能好,且能够反近距射频干扰。通常,逼近段目标位置姿态的估计主要由光学成像敏感器完成[2-3]。

本文介绍了一种对近距离目标实现快速定位的多目视觉测距系统设计。系统硬件采用低成本、小型化、低功耗的CMOS传感器实现数据采集,采用低功耗的高性能信号处理器完成图像处理与目标位置的精确测量。

系统由三个摄像头模块组成,采用了共线构型的布局,任意两个摄像头模块都可以组成一个双目视觉系统。相比于双目视觉系统,由三个摄像头组成的多目视觉系统很好地解决了测量精度与测量范围之间的矛盾。

1 双目视觉测距原理

1.1 双目视觉测距模型

双目视觉测距原理是利用目标在成像平面之间投影位置的不同,解算深度信息或三维坐标。

图1 双目立体成像示意图

图1为平视双目立体成像原理图[5],左摄像机坐标系为OC1X1Y1Z1,图像坐标系为O1U1V1;右摄像机坐标系为OC2X2Y2Z2,图像坐标系为O2U2V2。左摄像机光心OC1和右摄像机光心OC2的连线距离即为基线b,两个摄像机的焦距为f。空间点P 在左图像和右图像中投影坐标分别为(u1,v1)和(u2,v2),P1和P2为空间点P 的匹配点对。

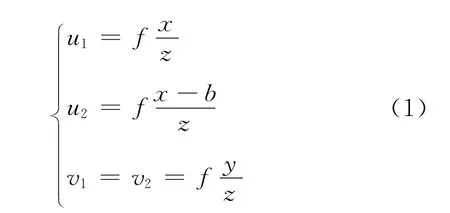

假定两摄像机的图像在同一平面上,由三角几何关系可得

式中:(x,y,z)为点P 在左摄像机坐标系中的坐标;b为基线距;f 为两个摄像机的焦距。

视差为某一点在两幅图像中相应点的位置差,可表示为

由式(1)和式(2),可导出空间某点P 在左摄像机坐标系中的坐标

由此可见,只需找出同一空间点在左、右图像中对应的匹配点对,即可得到目标的位置信息。

1.2 双目视觉图像特征匹配技术

由上节的模型分析可知,利用双目视觉原理进行测距的关键就是求出两匹配点对的坐标信息[4]。系统设计采用基于Harris算子的角点检测算法提取特征点[6],采用灰度相关匹配法进行特征点匹配。

(1)基于Harris算子的角点检测算法

基于Harris 算子的角点检测法包括三个步骤。

步骤1:对灰度图像上的每个像素点计算其在横向和纵向的一阶导数及两者的乘积。对应值分别为gx、gy和gxgy,其中gx为x 方向的梯度,gy为y 方向的梯度。

步骤2:对灰度图像上的每个像素点进行高斯滤波得到Harris自相关矩阵。矩阵表达式为

式中:G(¯s)为高斯滤波模板;⊗为卷积符号。

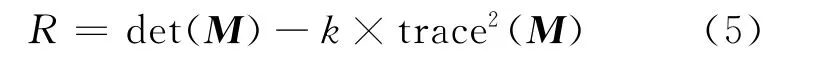

步骤3:计算每个像素点的兴趣值R。兴趣值表达式为

式中:det(M)表示矩阵M 的行列式;k 为权值系数,取值0.04~0.06;trace(M)表示矩阵M 的迹。

设M 具有 特征值r1、r2,当r1和r2都很大,对应像素点为角点,对应Harris算子的兴趣值R值大。因此筛选出函数R 的局部极大值点所对应的像素点即为Harris角点。

(2)灰度相关匹配法

相关匹配法通过计算特征点周围像素的相似度来计算匹配度,当两像素相似度最大且大于设定的阈值则认为两特征点匹配。灰度相关函数表达式为

式中:A 为以左图像中的特征点为中心的m×n区域的灰度窗口;A-为窗口A 内的灰度均值;B 为以右图像的特征点为中心的m×n区域的灰度窗口;B-为窗口B 内的灰度均值。

窗口完全相似时,相关分数值为1,本系统将相关分数阈值设为0.9,即大于0.9 的点被认为是候选匹配点。此外,利用图像匹配约束条件可以提高匹配的速度和准确性。双目视觉特征匹配的主要约束条件:

a)极线约束,左图像上的任一点,在右图像上的对应点只可能位于一条特定的被称为极线的直线上;

b)唯一性约束,左图像上的一个特征点只与右图像的特征点唯一对应;

c)位置约束,左图像上的特征点必须位于右图像上特征点的右边,即右图像上的特征点的横坐标必须小于左图像上的特征点的横坐标。

2 系统硬件设计

2.1 系统硬件架构

系统硬件主要由CMOS光电传感器、高速可读写存储器SRAM、基于数字信号处理器DSP和现场可编程门阵列FPGA 构成。

CMOS光电传感器实现对图像进行感应并转化为数字信号;FPGA 负责图像数据的采集、预处理、存储以及与其它模块的通信;DSP 为主控芯片,负责图像处理算法和三维信息计算,以及对存储和通信模块的控制。系统框图如图2所示。

2.2 多目视觉摄像头模块布局设计

图2 系统框图

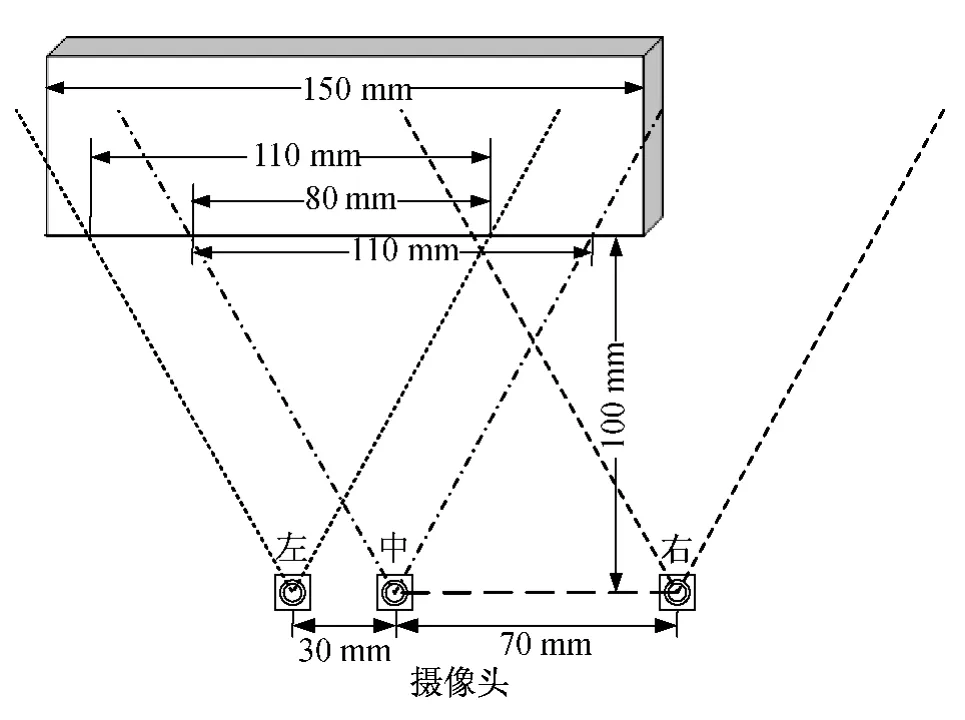

在双目视觉系统中,当摄像头的视角范围固定时,摄像头之间基线越长,测量的精度越高,但盲区越大。为了兼顾测量精度与测量范围,系统设计采用左、中、右三个摄像头,并采用共线构型的摄像头模块布局。

为了提高测量精度,左、右两摄像头基线设计为结构小型化允许最大尺寸100mm。为了保证左、中摄像头的视场重叠尽可能大,同时考虑摄像头模块的体积大小,左、中两摄像头基线设计为30mm。目标为边长不大于150 mm 的立方体,位于左、中两个摄像头的正前方,左、右两个摄像头组成的双目视觉系统只能获取到与基线的距离大于458mm 的目标整体轮廓。因此,系统设计在目标距离基线500mm 以上时,左、右两个摄像头工作;目标距离基线100mm~500mm 时,左、中两个摄像头工作。

如图3所示,目标距离摄像头基线100 mm时,左、右两个摄像头不能获取目标的共同边沿特征,也无法在左、右摄像头视场重叠部分利用目标的特征点进行测距。但此时采用左、中摄像头工作,能够利用两个摄像头视场重叠部分的目标特征点进行测距。

相比于双目视觉系统,由三个摄像头组成的多目视觉系统有三个优势:

a)增加特征点匹配的约束条件;

b)扩大测量范围;

c)提高测量精度。

图3 多目视觉系统的作用范围示意图

2.3 视频数据采集模块

视频数据采集模块为系统提供原始视频数据,主要由三个摄像头模块组成。每个摄像头模块包括一个镜头和一个CMOS 图像传感器MT9D112。MT9D112是由Micron公司生产的一款1/4英寸、200万像素的CMOS图像传感器,集成自动聚焦和光学变焦、片内10位ADC 以及两线串行的控制接口。

整个系统级芯片SoC 可以在低照度条件下具备卓越的性能,同时功耗较低。FPGA 通过I2C 总线对三个摄像头模块的输出格式、缩放大小和特殊效果进行控制,三个摄像头模块分别输出10位数字信号Dout、随路时钟PIXCLK 以及对应的同步信号FRAME_VALID 和LINE_VALID,实现图像数据的采集功能。

2.4 测距控制模块

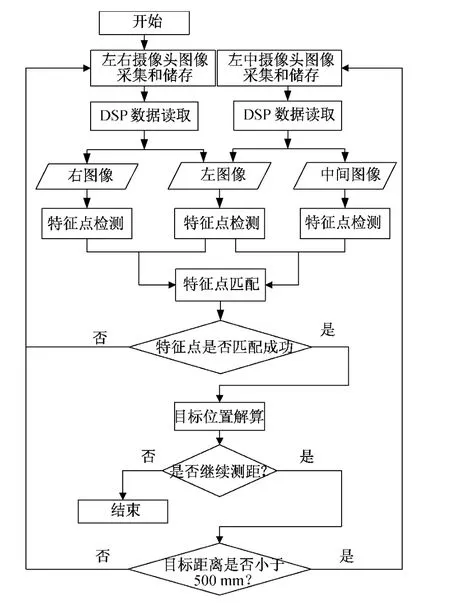

多目视觉三维测距系统的工作过程由DSP芯片主控。DSP 对当前存储的两个摄像头图像数据进行获取、分析处理,计算出当前目标的距离,并进行分析,选择下一次需要进行图像存储的两个摄像头,以便FPGA 对这两个摄像头的图像数据进行存储。

测距控制流程图如图4所示。

2.5 通信接口模块

图4 测距控制示意图

多目视觉三维测距系统与主控计算机间采用422接口全双工通讯方式。共采用两个422接口:一个422接口的通讯内容为系统发送给主控计算机的测量数据帧,包括相对位置、相对角度、方位角、高低角、摄像日期和时间;另一个422接口的通讯内容为系统发送给主控计算机的图像数据帧。为了减少通信接口的数据传输量,系统设计先对图像数据进行压缩,数据传输完成后,再在主控计算机上恢复图像。该系统的图像数据压缩率为1/64,有效地减少了数据传输量。

3 测试结果

在室内布置一个黑背景,将边长为150 mm的立方体置于多目视觉三维测距系统前,目标与背景如图5所示。

图5 目标与背景实物图

由近及远多次改变目标距离进行测试。实验测量结果如表1所示。测试表明,该测距系统在近距离测量目标时,能够准确测量出目标位置信息。

表1 距离测量结果

4 结束语

本文介绍了一种基于CMOS视觉传感器、现场可编程门阵列FPGA 和DSP 信号处理器的多目视觉三维测距系统的设计。设计和研制结果表明,该系统具有体积小、重量轻、功耗小等优点。静态实物测距试验表明,系统具有较高的测距精度,能够满足航天器对空间非合作目标的相对位置测量要求,对航天器的在轨实时测距,具有应用价值。

[1] 任行行.空间交会接近视觉测量方法研究[D].哈尔滨:哈尔滨工业大学,2008.

[2] 高雷.交会对接逼近阶段飞行器空中位置和姿态的视觉测量[D].长沙:国防科技大学,2010.

[3] 岳晓奎.基于Rodrigues参数的视觉相对位姿确定算法[J].宇航学报,2010,32(1).

[4] 邱河波.基于DSP 的移动机器人双目视觉技术研究[D].成都:电子科技大学,2013.

[5] 刘凯.非合作目标视觉测量方法研究及系统实现[D].西安:西安电子科技大学,2011.

[6] 于浛.非合作航天器双目视觉位姿估计算法研究[D].哈尔滨:哈尔滨工业大学,2011.