基于相位信息与空间关系的路面裂缝检测

陈 松,靳华中,郭 鹏

(湖北工业大学计算机学院,湖北 武汉430068)

裂缝是路面常见的病害之一,它不仅影响路容美观和行车舒适性,若不及时发现和修补还容易扩展造成路面的结构性破坏,缩短路面的使用寿命。传统的人工检测路面裂缝的方式工作量十分巨大且不安全,目前路面裂缝检测技术研究主要围绕着路面灰度图像的处理展开。尽管裂缝识别算法取得了很多成果,但在实际应用上非常有限,尚未达到商业化的路面图像处理软件要求[1]。

自21世纪以来,基于图像的路面裂缝识别研究得到越来越多的重视,多种裂缝检测算法相继被提出。依据路面图像灰度信息的梯度变化识别裂缝,基于边缘检测的裂缝检测算法得到了广泛研究,其中具有代表性的是,Ayenu-Prah和 Atto-Okine[2]对路面图像进行去噪处理后,用Sobel边缘检测算子对裂缝进行提取。Yan等[3]用中值滤波方法对图像进行增强,然后利用灰度形态算子对裂缝进行边缘检测。Zhou等[4]和Subirats等[5]利用小波变换将路面灰度图像变换到不同方向的子带中,然后在不同方向下对裂缝边缘进行检测。然而,以上边缘检测方法往往只考虑对阶跃型边缘检测,是一种基于局部特征的裂缝检测方法。由于路面图像受到宏观纹理、斑点噪声和光照条件等因素的影响,裂缝呈现弱信号性,其灰度特征通常由阶跃、屋顶和线的一些组合来表示。此外,没有涉及裂缝描述、分析和处理的全局性方法。

针对裂缝图像的灰度特征和全局性特征,本文研究对其灰度特征进行建模和全局描述方法。方向能量模型以相位一致性作为图像特征的不变度量,考虑相位信息在边缘检测中的重要性和稳定性,能够可靠地检测阶跃、屋顶和线形特征[6]。本文利用相位一致性为基础的方向能量模型进行裂缝灰度特征建模。由于图论的谱聚类方法直接利用对象间的相似性作为聚类分析的依据,且收敛于全局最优解,便于对裂缝进行全局分析与操作。由于它将聚类问题转化为图的最优划分问题,是一种点对聚类算法,因此能够利用区域之间的邻接关系调整点对之间的相似性,从而能够更准确地进行裂缝边缘检测。目前,谱聚类对图像边缘检测的应用尚处于初级应用阶段,利用区域的空间关系进行边缘检测研究的报道较少。

综上所述,由于传统裂缝边缘检测算法没有考虑相位信息,且没有利用区域之间的空间关系,本文提出一种基于相位信息与空间关系的路面裂缝检测方法。首先利用方向能量方法描述相位信息,并对裂缝灰度特征进行建模;然后计算图像的方向能量来度量成对像素的相似性,并引入空间关系修正相似性;最后用谱方法聚类,完成裂缝边缘检测。

1 方向能量模型

针对路面裂缝的成像特点,裂缝几何模型呈现倒置脉冲状、屋顶、梯形及其组合形态,其灰度特征通常表现为具有阶跃、屋顶和线形的复合特征。若依赖于单一检测算子,将无法检测出完整的裂缝边缘信息,造成裂缝的漏判。Morrone等[7]提出各种阶跃、屋顶、线等特征类型的边缘可以使得相位一致性高的点出现,因此,裂缝的边缘信息能够通过检测图像的相位一致性进行分析和处理。由于图像的相位一致性是一个难以计算的量,其值通常由图像局部能量函数计算,采取近似值进行逼近。在频率域内图像的傅里叶相位信息是不变的,且信号的整体大小与相位一致性无关,在计算相位一致性时能够保证图像的对比度和亮度的不变性,同时不受尺度空间变化对裂缝边缘特征的影响。

裂缝边缘特征由边缘方向、边缘强度和连续性等要素描述,其中,边缘方向在可靠提取相互邻近、交叉的块裂时发挥重要的作用。在裂缝边缘检测中若忽视边缘方向的作用,往往无法有效提取复杂裂缝,会带来大量边缘的碎片。这里将边缘方向引入局部能量函数模型约束边缘的提取,让边缘方向一致的裂缝保持连续性,且尽可能延长或封闭边缘。

由于高斯函数窗口的傅里叶变换被证明是唯一满足时频测不准原理的下限,在信号处理与分析中得到广泛的应用,本文在图像频域内利用高斯滤波器描述路面图像的裂缝局部边缘特征点。复指数滤波器的实部采用具有偶对称的高斯函数二阶导数;奇对称的高斯函数是实部的Hilbert变换,将它作为复指数滤波器的虚部[8]。于是,由高斯函数构造复指数滤波器W=A+jB,其中A为偶对称的高斯函数二阶导数,B为奇对称的高斯函数。将复指数滤波器W与图像I进行卷积处理,其结果是J=I*W =(I*A)+j(I*B)。因此,局部能量函数的定义为

对于图像I,图像像素点(x,y)处的方向能量定义为

式中,σ是以像素点(x,y)为中心的圆的邻域大小,θ是计算方向能量OEθ,σ时所沿方向角度的大小。作为复指数滤波器响应的幅值,OEθ,σ是尺度σ下、方向角为θ处的方向能量。由于其最大值对应于裂缝边缘处的点,因此,OEθ,σ能够较好地描述复合边缘的反差,从而可靠地检测路面灰度图像中屋顶、阶跃和线形的组合特征。在路面灰度图像上调整θ和σ的大小,能够在多个方向和多个尺度上计算OEθ,σ,保证一定方向下提取裂缝时的边缘连续性和封闭性。

2 利用空间关系修正相似性

利用方向能量模型描述图像的裂缝边缘特征,这样图像中每一像素处的OEθ,σ是边缘特征值。考虑引入空间关系,通过度量成对像素的相似性来确定像素的类属性质。谱聚类将聚类问题转化为图的最优划分问题,属于一种点对聚类算法。于是,能够利用它,通过判断区域之间是否邻接调整像元对之间的相似性,改善裂缝边缘检测效果。其主要思想:如果两个像素之间有边界将它们分隔开,这两个像素分别属于不同的类别。将它们之间的相似性调低。反之,边界一侧的像素相似性调高,表示它们属于同类。

区域之间的空间关系如图1所示。在图1a中,原图方框部分很明显划分为两部分。在图1b中,将方框图像进行放大,分别标识两部分为I和II。I和II属于不同的区域。

图1 区域之间的空间关系

像素p1,p2位于区域I内,像素p3则位于区域II里。若像素p1,p2和p3有相似的亮度值,单纯考虑像素灰度值度量它们之间的相似性,可能会将它们错分成一组。但是,在图1.c中,由于像素p1、p2与像素p3之间存在边界,显然像素p1、p3之间的相似性大于像素p1与p2的相似性。因此,若仅仅从图像亮度上度量像素间的相似性,直观上可知:沿着边界一侧的像素间的相似性较小,则边界两侧的像素间的相似性较大。因此,从图1.c看到,若连接两个像素之间的方向能量很大,则它们之间的不相似性就会很强。于是,将两个像素之间的相似性度量定义以下形式:

其中,

l2是连接像素p1和p2的直线段;这里的p1和p2是像素p1和p2所处的位置是直线段l2上最大方向能 量 的 像 素 点 所 在 位 置。 Eavg(OEcon(p1),OEcon(p2))是像素p1和p2之间的平均权重。于是,它就表示为像素p1和p2方向能量的相对差。

由区域间的空间关系,计算相似性矩阵Wij

通常在半径为r的邻域内,计算图像(i,j)位置处像素点之间的相似性。这里取r=5。Wij表示不相似性,其方向沿连接两个像元直线方向的最大梯度方向。

3 基于相位信息与空间关系的裂缝检测

谱聚类没有假设特征概率密度分布的前提条件,聚类分析时不受样本空间的形状限制,是描述对象间相似性的一种全局性方法[9]。谱聚类方法建立在图论的基础上,提供了对事物及其之间关系进行描述、分析和处理的全局最优理论和方法。该方法直接利用对象间的相似性作为聚类分析的依据,对于图像分割而言,将像素的类别划分转化为图的最优划分问题。在聚类过程中,能够利用裂缝两侧不同区域之间的空间关系调整点对之间的相似性,将裂缝边缘检测转化为不同区域的分割,边缘作为不同区域的边界。

基于相位信息与空间关系的裂缝边缘检测见图2。

图2 路面裂缝检测流程图

本文裂缝边缘检测算法主要分以下四步进行。

第一步:计算方向局部能量

根据公式(1)计算图像中所有像素的方向局部能量。其中,θ表示特定方向上的弧度,θ=m×,且m∈ [0,n),m 表示某个特定的分片,n表示对π等分的个数。这里方向数设置为8(n=8),m∈[0,7],高斯函数尺度因子σ=2。

第二步:利用裂缝两侧区域之间的相邻关系信息修正相似性,根据公式(2)计算相似性矩阵Wij。

第三步:计算特征向量

像素间的相似性是谱聚类方法进行聚类分析和计算的依据,在图像分割过程中,不同区域的像素类属作为图论中节点最优划分问题。在图像的Laplacian矩阵中通过让子图内的边权重之和最大,各子图间边权重之和最小,完成图像分割。Ncut方法作为谱聚类中一种常用方法,由于其能够保证样本内的相似度最大,且样本间的相似度最小,目前在图像分割、模式识别等多个领域,已成为研究聚类问题的一种经典的方法[10]。利用Ncut方法将图像进行k类划分,其一般步骤如下[8]:

1)将图像m!n映射为一个图,图的每一个节点对应一个像元。令N=m!n,把这个图用邻接矩阵的形式表示出来,组成一个N!N的矩阵W,矩阵W元素ωij为第二步中相似性矩阵Wij相应的元素。

2)把W的每一列元素加起来得到N个数,把它们放在对角线上,得到矩阵W 的节点度矩阵,记为D。并令L=W-D,得到相应的Laplacian稀疏矩阵。

第四步:裂缝边缘提取

1)计算特征向量的梯度 使用梯度算子计算第三步中特征向量的梯度。

2)方向非最大值抑制 由上一步得到八个方向的图像梯度值,利用方向非极大值抑制弱小边缘点,同时定位复合边缘点。取八个方向中的梯度极大值对应的角度,作为当前像素的边缘方向,在该像素任意一侧沿其主导方向的垂直方向,查看两个邻近像素的梯度值。若该像素的梯度值大于或等于其邻近点的像素值,则保留该像素的梯度值,否则将其抑制为零值。

4 实验与分析

本文实验数据由车载线扫描相机采集,线扫描相机分辨率为1024×1280像素,相机纵向覆盖视场1.4m,横向覆盖视场1.9m,车辆移动方向采样间距1mm。为验证本文所提方法的有效性,分别选用纵裂、横裂和块裂的灰度图像进行裂缝目标检测实验。实验图像均从原始图像中剪裁得到,大小256像素×256像素,且都经过了预处理,如中值滤波、归一化等。

实验目的是测试本文方法在检测不同类型裂缝时的效果,并同人工方法进行比较。

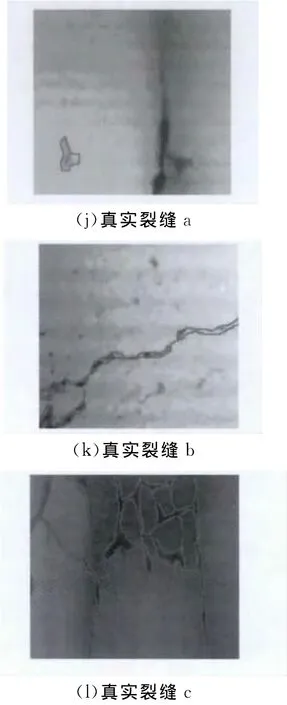

图3 裂缝提取实验

图3 a、图3b和图3c分别表示包含纵向裂缝、横向裂缝和网状裂缝的路面灰度图像。图3d、图3e和图3f是本文提出的算法得到的最终分割结果;图3g、图3h和图3i是本文算法的分割结果与原始图像叠加;通过对比看出,本文算法处理结果既减少了裂缝碎片,不连续性,同时能够将裂缝边缘较好地闭合处理,获得了完整的裂缝区域目标。因此,本文提出的算法大大改善了影像边缘的提取效果,它以封闭边界围成的区域显示出来,减少了细小破碎的边缘,增强了裂缝边缘的完整性。图3j、图3k和图3l为真实裂缝,通过实地测量和人工编辑得到。通过对比可发现,本文方法的裂缝检测结果与真实裂缝十分接近。

5 结论

本文针对传统边缘算法存在的不足,利用裂缝图像的相位信息和区域之间的空间关系,以方向能量作为成对像元间的相似性,将图像区域相邻关系作为相似性的约束,利用谱聚类方法进行全局最优求解,完成裂缝边缘的提取。本文算法采用各种类型裂缝(横裂、纵裂和块裂)的路面图像作为实验对象,检测出的裂缝边缘与传统的算法相比有较好地视觉效果。实验结果表明,本文提出的方法具有较强的克服路面宏观纹理和噪声能力,从路面灰度图像中提取裂缝具有较高的可靠性和稳定性。

[1] Wang K C P,Elliott R P,Meadors A,et al.Application and validation of an automated cracking survey system[C]//6th International Conference on Managing Pavements:The Lessons,The Challenges,The Way Ahead,2004.

[2] Ayenu-Prah A,Attoh-Okine N.Evaluating pavement cracks with bidimensional empirical mode decomposition[J].EURASIP J.Adv.Signal Process,2008,2008(1):861701-1.

[3] Maode Y,Shaobo B,Kun X,et al.Pavement crack detection and analysis for high-grade highway[C]//electronic measurement and instruments,2007.icemi′07.8th international conference on[A].IEEE,2007:4-548-4-552.

[4] Zhou J,Huang P S,Chiang F P.Wavelet-based pavement distress detection and evaluation[J].Optical Engineering,2006,45(02):1-10.

[5] Subirats P,Dumoulin J,Legeay V,et al.Automation of Pavement Surface Crack Detection Using the Continuous Wavelet Transform[C]//Image Processing,2006IEEE International Conference on.IEEE,2006:3 037-3 040.

[6] Kovesi P.Edges Are Not Just Steps In:The 5th asian conference on computer vision [C].Melbourne Australia:Springer/LNCS,2002:23-25.

[7] Morrone M C,Burr D C.Feature detection in human vision:aphase dependent energy model in:proceedings of the royal society of london.series b,biological sciences[C].London:Royal Society of London,London,ROYAUME-UNI(1934-1990)(Revue),1988,235(1280):221-245.

[8] 靳华中,周祺,陈明泉.结合方向能量模型和谱聚类的航空影像边缘提取[J].湖北工业大学学报,2011,26(02):57-60.

[9] 蔡晓妍,戴冠中,杨黎斌.谱聚类算法综述[J].计算机科学,2008,35(07):14-18.

[10]Shi J,Malik J.Normalized cuts and image segmentation[J].Pattern Analysis and Machine Intelligence,IEEE Transactions on,2000,22(08):888-905.