应用人类视觉特性的立体图像质量评价方法

沈丽丽 ,侯春萍

(1. 天津大学电子信息工程学院,天津 300072;2. 国家海洋技术中心,天津 300112)

传统的平面图像质量评价分为2类:主观评价和客观评价.主观评价方法的准则(mean opinion score,MOS)[1]可能不同,但基本原理都类似,主观质量评价过程需要挑选大量的观察者,每个观察者要对多个测试图像进行大量反复的实验,耗时长且费用高,易受被测试者个人心理和生理变化的复杂性和差异性的影响,操作难度较大且无法做到实时性.因此如何建立与主观评价结果相吻合的客观质量评价方法成为亟待解决的研究课题.

传统的基于数学统计量的图像质量客观评价方法,主要有均方误差(mean squared error,MSE)和峰值信噪比(peak signal-noise ratio,PSNR)方法,以及派生出来的均方根误差(root mean squared error,RMSE)方法等.这类方法的优点是简单易行,因此在很多应用中被广泛使用;缺点是没有考虑这些差异对于人类的视觉感知的影响以及图像本身的特点,有时不能真实地反映视觉信息的质量,结果往往与主观评价有较大的差异.

近几年出现了一些与立体图像质量评价有关的文献[2].Seuntiëns[3]提出 3,DTV 主观质量评价应该从图像深度、图像质量、立体感是否存在、立体感是否自然、立体感舒适程度和立体感是否符合视觉经验等多方面进行评价.Saygih等[4]在进行大量的主观测试后指出参考视点的编码质量高时,辅助视点的编码质量只要大于最低门限值,立体视频的质量下降不明显.而该最低门限值与显示方式、失真类型有关.Alexandre等[5-6]提出了一种立体图像客观质量评价方法,该方法考虑了2类失真:视差失真与平面图像质量失真,计算2类失真后,综合给出了最终的评价指标,但由于样本数量过少而受到了学者的质疑.笔者[7-8]也提出过基于人类生理视觉特性的立体图像的客观质量评价方法.

对于立体图像的客观质量评价尚无统一的判定标准,因此,研究立体图像质量的评价方法将具有重要的意义,可以为立体图像的压缩传输处理研究提供新的思路,也可为制作出具有更好视觉舒适度的立体图像提供理论依据.本文提出了一种立体图像的质量评价方法,提取出能够表征立体图像的特征参数作为判定要素,通过利用心理立体视觉感知图像的方式来分割立体图像的特征信息,用灰度聚类的方法模拟人眼观察图像信息的过程,基于结构相似性理论对不同深度层次上的图像进行加权,最后得到立体图像的质量评价指标.

1 系统设计

对于立体图像的客观质量评价,分析影响立体图像视觉效果的因素,准确地提取影响立体图像质量的特征因子,是建立有效的质量评价方法的前提和基础.本算法提取了用来表征立体视觉信息的 2类特征参数:立体图像的绝对差异信息和视差信息.生理心理学已经证明,人类观看立体图像、感知信息时,距离越远,立体感越不明显.运用图像分割算法对视差信息进行聚类分割后,基于结构相似性理论对不同深度层次上的图像进行加权.显然,对于一幅立体图像,近处的景物立体感很强,分割后应当分配较大的权重,而远处景物的立体感较差,可以降低权重,甚至不予考虑.

笔者所提出的质量评价方法考虑了人类的生理和心理视觉特性,如图1所示.

图1 联合立体视觉的质量评价模型Fig.1 Quality assessment model with joint stereo vision

1) 立体图像的绝对差异信息

人眼观看立体图像与平面图像区别很大.在观看平面图像时,两只眼睛看到的是同一幅图像;而观看立体图像时,两只眼睛看到的是2幅具有双目视差的左图像和右图像.从单只眼睛观看的角度和效果来讲,平面图像与立体图像没有区别,看到的都是同一幅图像.但是从两只眼睛观看的角度以及融合效果来讲,平面图像与立体图像有很大区别:人双眼观看立体图像时看到的是视点对,人类大脑内部能够用视点对中的双目视差信息形成立体感;观看平面图像时则不会有这种现象.

下面以一幅双视点图像为例来阐述绝对差异(差值)信息对立体图像质量的影响.图 2是一幅具有双目视差的立体图像的左右视点对.该图像源于美国Middlebury stereo datasets立体图像库[9].该库给出了不同类型的多幅双视点原始参考立体图像,图像的原始大小为436× 3 60× 2 4,设左图像各点像素值为 L,右图像各点像素值为R.

图2 双视点立体图像TeddyFig.2 Two viewpoint pairs named ‘Teddy’

图3是图2所示立体图像的绝对差异图像,观察此图会发现,具有双目视差的视点对,其绝对差异图像是单幅视图的近似轮廓线,而视差在物体边缘处表现最明显.

设视点对的绝对差异值为 Diff,在计算时取绝对值,则有

人的双眼视轴并非完全平行,而是稍稍向内倾斜,而且两眼相距一定距离(瞳距),所以当人们观看一个物体时,左眼和右眼看到的物体是不一样的,不但角度不同,看到的范围也不同,不仅如此,物体离人眼的距离不同在视网膜上对应的位置和印记也不同,正是由于双眼存在视差,人眼才会形成立体视觉.具有人眼标准视差的视点对,它们的绝对差值图像是一幅图像的轮廓线[7].这一幅差值图像是两眼看到的不同信息,包含立体视差相关信息.越接近原始图像对的差值图,立体图像的质量就越好.因此,笔者利用差值图来对图像质量进行客观评价.

图3 立体图像的绝对差异Fig.3 Absolute disparity of stereo image

2) 立体图像的深度信息——视差图

在立体视觉系统中,视差是一个重要的物理量,间接反映了景物的深度信息.人们认识到当两眼从稍有不同的2个角度观察三维景物时,2个视网膜上的映像略有不同,大脑视觉皮层区域通过检测投影在左右眼视网膜上的图像之间的细微差别和图像特征等与深度相关的信息,进行三维数据重建,获得深度感知.双眼视差则体现的是观看的物体深度信息,是产生立体视觉的主要因素.

本实验中用到的视差提取方法是基于图像分割的立体匹配算法[10],图 4是通过上述算法得到的原始立体图像的视差,用此算法提取的视差图看起来平滑、边缘处误差较少,比较准确.

图4 原始立体图像的视差Fig.4 Disparity map of original stereo image

笔者所提出的立体图像质量评价方法主要有以下几个部分:首先,按照上述 2种办法提取出立体图像的特征参数;利用聚类的算法对得到的特征量进行分割,本文用 K-means算法[11]实现;用基于加权结构相似性的评价法则对分割后的数据进行拟合得到评价指标.

1.1 聚类分割

图像分割的任务是把图像分成互不交叠的有意义的区域,以便进一步的处理、分析、应用.在图像分析和理解中,分割的精确程度影响下一步分析的精确程度.图像分割的主要方法可以分为 3大类:①边界方法,这种方法假设图像分割结果的某个子区域在原来图像中一定会有边缘的存在;②区域方法,这种方法假设图像分割结果的某个子区域一定会有相同的性质,而不同区域的像素则没有共同的性质;③将前2类方法结合起来,形成混合图像分割方法.

本文评价算法中采用的图像分割方法属于第 1类.如果 2个相邻的区域有亮度的突变,人们就能感受到边缘的存在,通过边缘灰度的变化检测,可以表明一个类与另一个类的区别.灰度图像都具有一些特有的性质:图像里的每个区域都由不同的灰度值构成;图像中每个区域的灰度信息都可以用一些近似的量化的值代替,而不丢失原来图像的特征;在 2个不同事物的交界处,灰度值呈跳跃变化,这是基于灰度分割图像的出发点.具体实现时使用 K-means聚类算法[11]来对图像进行分割.这里采用欧氏距离来表示,基于这种距离度量的算法趋向于发现具有相近密度和尺寸的类,即

式中:xi,j为各类中的数据对象;zi,j为各类的均值;d( xi,j, zi,j)为对象i和类的中心在第 j维变量上的距离或相似度.

输入条件为聚类个数K,以及包含n个数据对象的样本集;输出条件为满足方差最小标准的K个聚类.

对转换后的灰度图像做 K-means聚类分割,模拟人眼视觉观看自然景物时习惯于将相似性强的物体进行聚类的特点.经过实验发现 K=2~3时用本算法得到的客观评价值与主观结果的一致性较好.图 5是基于 K-means算法对原始立体图像的绝对差异图像(特征参数之一)分割后得到的类图.

1.2 平均结构相似性法则

结构相似性度量将失真建模为 3个不同因素的组合:亮度l、对比度c和结构s.用均值(μX,μY)作为亮度的估计,用标准差(σX,σY) 作为对比度的估计,用协方差σXY作为结构相似程度的度量,于是,结构相似度量(structural similarity,SSIM)定义为

式中:α,β,γ> 0 ,3个参数用来调整亮度、对比度和结构信息的权重.

图5 类图Fig.5 Class-map

平均结构相似度(mean structural similarity,MSSIM)法则是将原始参考图像 X、失真图像 Y以相同大小的窗口进行互不重叠的分块,分块总数为 M,利用滑动窗口操作将窗口沿图像逐像素地从左上角向右下角移动,计算每次窗口对应子图像的 SSIM值,对所有子图像的SSIM值进行平均.

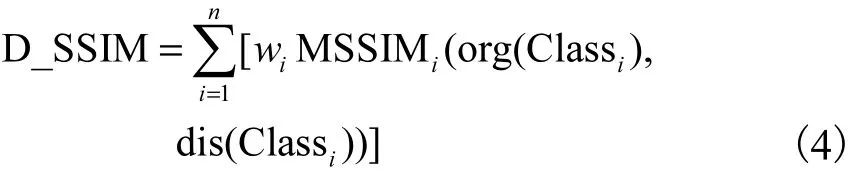

观察分割后的2类特征图像,发现类图1为近景图像,是立体图像的主要景象,立体感最强;类图 2其次;如果有更多分类,则根据聚类算法原理,越后面的类,距离越远,则多背景,观察时不引人注意;这也与人眼感知立体视觉信息的过程相一致.这几类图像对于合成后立体图像立体感和图像质量贡献大小不同,影响也不同,因此可以对图像进行加权,其公式为

式中:org(Classi)、dis(Classi)分别为原始立体图像的视差信息经过分割后得到的类图和失真立体图像的视差信息经过分割后的类图;D_SSIM为用本文的方法得到的客观评价值;wi为加权系数,其表达式为

式中:im为类i的灰度均值;N为分类数目.

2 仿真条件

仿真实验在一台普通 PC机上进行,利用美国Middlebury stereo datasets提供的图像,图像大小为436× 3 60× 2 4,用 teddy.bmp、baby3.bmp、Art.bmp、Dolls.bmp、tsukuba.bmp等多个立体图像作为测试图像.对每个视点对中的左视点进行失真处理,得到一系列不同失真情形下的立体图像.观看设备采用天津三维成像技术有限公司生产的立体视窗“3D WINDOWS-19A01型”计算机立体成像器.图 6列出了名为teddy的立体图像的单幅视点的12种失真情况中的4种.

图6 图像失真类型Fig.6 Distortion type of images

3 仿真结果

图 7给出了 3种客观质量评价算法的评估曲线(3D_SSIM1、3D_SSIM2、PPSNR)和主观MOS值曲线,横坐标代表不同的失真情况,纵坐标是用4种客观评价方法得到的评价值.3D_SSIM1、3D_SSIM2分别是本文方法得到的客观评价值,即以立体图像的绝对值信息和视差信息作为特征参数的算法实现.PPSNR(parallax peak signal-to-noise ratio)值通过计算原始立体图像和失真立体图像的绝对差异图像之间的PSNR得到,即有

图7 客观算法和主观算法的评价值Fig.7 Objective assessment values and MOS value

式中:MN为图像的大小;D ifforg(i, j)为原始左右视图的绝对差异信息;D iffdis(i, j)为失真后左右视图的绝对差异信息.

从图7可以看出,不同失真情况下,3D_SSIM评价值的曲线与 MOS值的曲线看起来变化趋势很相似,而 PPSNR评价值与 MOS值的相似程度不及本方案得到的评价值3D_SSIM1和3D_SSIM2.为了更直观地比较3种算法与主观MOS值是否相符,本文又分别给出了 3个客观评价值 3D_SSIM1、3D_SSIM2和PPSNR与主观MOS值之间的绝对差曲线,如图 8所示,本算法得到的评价值 3D_SSIM1和3D_SSIM2与主观MOS值之间的误差最小.在充分应用人类视觉特性的方法中,采用立体图像的深度信息作为输入时,算法复杂度要高于绝对差异信息作为输入的情况,但是与主观评价的总体契合度优于PPSNR算法.

本文还给出了主客观评价值之间的相关系数,其中PPSNR值和MOS值的相关系数为R(PPSNR)=0.658,3,说明这种评价方法与主观评价的相关性较弱;而用本算法得到的 3D_SSIM1、3D_SSIM2值和MOS值的相关系数分别为 0.806,6和 0.892,5.上述分析均表明通过本算法得到的质量评价结果与主观评价结果相关性较强,更符合人眼的视觉特性.

图8 主客观评价值之间的绝对差曲线Fig.8 Absolute deviation between objective and MOS values

4 结 语

本文提出了一种联合生理和心理立体视觉特性的质量评价方法,并分别用立体图像的视差信息和绝对差异信息作为特征参数,给出了2种不同的实现方式.实验结果表明,2种复杂度不同的方法均能很好地用于立体图像的质量评价,且所提出的评价方法简捷有效,能较好地与人眼的主观质量评价结果相匹配.

[1]Rec. ITU-R BT. 500-11. Methodology for the subjective assessment of the quality of television pictures [EB/OL].http://www. dii. unisi. it/~menegaz/DoctoralSchool 2004/papers/ITU-R_BT. 500-11. pdf,2002.

[2]Aldo Maalouf,Mohamed-Chaker Larabi.CYCLOP:A stereo color image quality assessment metric[C]//IEEE International Conference on Acoustics,Speech,and Signal Processing. Prague,Czech Republic,2011:1161-1164.

[3]Seuntiens˙P J H. Visual Experience of 3,DTV[D]. Netherlands:the Eindhoven University of Technology and Philips Research Eindhoven,2006.

[4]Saygih G,Goktug Gurler C,Murat Tekalp A.Quality assessment of asymmetric Stereo video coding[C]//IEEE 17th International Conference on Image Processing. Hongkong,China,2010:4009-4012.

[5]Alexandre B,Patrick L C,Patrizio C,et al. Using disparity for quality assessment of stereoscopic images[C]//Image Processing,ICIP 15th IEEE International Conference.San Diego,United States,2008:389-392.

[6]Alexandre B,Patrick L C,Patrizio C,et al.Quality assessment of stereoscopic images [J].EURASIP Journal on Image and Video Processing,2008:390-392.

[7]沈丽丽,侯春萍,杨嘉琛,等. 适合立体压缩图像的客观质量评价方法[J]. 天津大学学报,2009,42(12):1083-1088.

Shen Lili,Hou Chunping,Yang Jiachen,et al. Objective measurement for stereo compressed images[J].Journal of Tianjin University,2009,42(12):1083-1088(in Chinese).

[8]沈丽丽,侯春萍,张卓筠,等. 基于三维特征和结构相似度的立体图像质量评价方法[J]. 光电子·激光,2010,21(11):1713-1719.

Shen Lili,Hou Chunping,Zhang Zhuoyun,et al. A stereo image quality evaluation method based on three dimensional characteristics and structural similarity [J].Journal of Optoelectronics·Laser,2010,21(11):1713-1719(in Chinese).

[9]Scharstein D,Szeliski R.A taxonomy and evaluation of dense two-frame stereo correspondence algorithms[J].International Journal of Computer Vision,2002,47(1/2/3):7-42.

[10]Klaus A,Sormann M,Karner K. Segment-based stereo matching using belief propagation and a self-adapting dissimilarity measure[C]//The 18th International Conference on Pattern Recognition.Hongkong,China,2006:15-18.

[11]Xiong Hui,Wu Junjie,Chen Jian. K-means clustering versus validation measures:A data-distribution perspective[J].IEEE Transaction on Systems,Man and Cybernetics,2009,39(2):318-331.