多用户参与的可解释群决策交互模式及设计

摘 要:现代人类的决策活动更多地从个人决策过渡到群决策。从工业设计和交互设计出发,提出并讨论多用户参与的可解释交互群决策模式,对群决策如何融合的可解释性、交互设计和多用户参与进行分析,探讨多用户参与的可解释交互群决策模式的研究内容和表示结构,指出其关键技术和研究方法。以辅助群体出游计划安排的应用原型设计为例,探究群体出游人群的表示结构、群决策逻辑与可解释交互设计,为群体决策场景服务的知识体系建立和快速设计提供新的研究思路。

关键词:交互设计;群决策;可解释;多用户参与

中图分类号:TB47;TH166文献标志码:B文章编号:1671-5276(2024)03-0015-05

Explainable Group Decision-making Interaction Mode and Design for Multi-participation

Abstract:Decision-making activities among human beings have developed more towards group decision-making. From the perspectives of industrial design and interaction design, this study proposes and discusses a mode of explainable group decision-making interaction for multi-participation, and analyses the approach to combine explainability, interaction design and multi-participation. This paper discusses the research content and representation structure of the mode and introduces its related key technologies and reserch methods. The application prototype design of assisting group travel planning process is given to explore the representation struture of the travel group , the logic of group decision-making and the design of explainable interaction, which provides us with a novel research idea of knowledge system establishment and and agile design approach for group decision-making scenarios.

Keywords:interaction design; group decision-making; explainability; multi-participation

0 引言

随着社会活动、信息和面临问题的复杂度增加,现代人类的决策活动更多地从个人决策过渡到群决策。伴随着计算机辅助功能的介入,所涉及的客观信息量和个体主观认知进一步交织,直接影响着群决策过程和结果。因此,为群决策场景服务的知识体系构建和快速设计需要新的切入角度,同时从业者需要一个能够长效拓展群决策辅助交互设计的新思路。

在当今现代人类活动快速发展大环境下,决策者面临的内部、外部环境日益复杂多变,往往要求综合多领域的专业知识才能解决问题,很多决策需要集中群体的智慧和优势才能做出最佳的决策,例如跨领域设计决策、可持续发展决策和重大灾难应对决策等。得益于现代决策科学和计算机技术的快速发展,一些算法已经可以辅助人们做出决策。然而,“黑盒子”般存在的算法交织在人类决策者的主观认知中,给决策者理解机器的逻辑造成了障碍,使得群决策者相互不了解,难以很好地辅助群决策过程。本文从工业设计和交互设计的角度出发,融合计算机技术、人机交互理念、可视化设计、文化和行为研究等学科知识,提出多用户参与的可解释(explainability)群决策交互模式并进行探讨。

1 群决策及交互模式

有关群决策(group decision-making,GDM)的研究,学者们从最开始就在关注群决策中和谐、合群、一致性的重要性,包括部分成员在群决策中表达不同意见的影响[1]。一些研究证明,应对群决策中的不一致性,不确定性和争议性是至关重要的;同时,对群决策有需求的领域广泛,覆盖了人们的日常生活决策、工业需要、商业决定等[2]。最早针对群决策的模型包括了多标准决策方法与其延伸和拓展版本,这些模型旨在评估一个相对最优的群决策方案解。

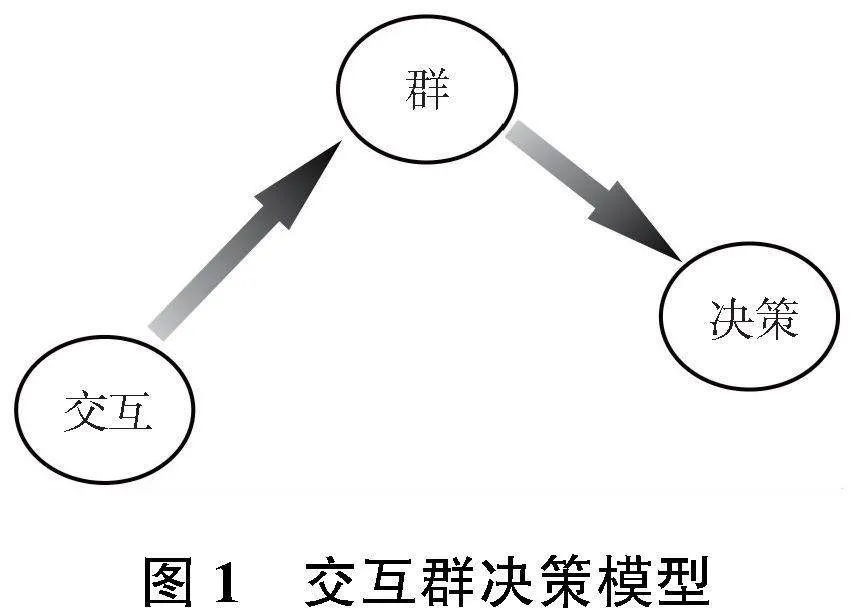

应该强调的是,群决策最需要的是群成员之间的讨论、协商和商议,然后将决策的最终权力交还给人而不是简单地依赖模型或算法,如图1所示(用于与本文提出的决策模型形成对比)。因此,从交互的角度来看,为了达到一个共同接受的决策,每一个群决策者都应该在有观点争议的情况下表明自己的决策态度[3]。有些时候,某一两个群决策者由于没有发表意见,而让群体错过了某些至关重要的信息,因而,群决策系统通过交互模式的转变,调整决策者交互方式,支持信息的协调、控制和可视化,从而达到支持群决策的目的。

群决策中的交互模式设计主要体现在决策者被赋予了多少主动参与到决策过程中的机会。在提高群共识方法中,有两类交互模式:反馈机制和自动机制。反馈机制允许决策者在后端算法结果的基础上进行主观的人工修改;而自动机制则不允许决策者的主动输入,直接进行自动修改[4]。对于反馈机制,决策者的想法被主动包容进群决策机制中,而此自动机制则可能在参与者不知情的情况下自动循环,脱离了决策者的想法而不自知。在基于信任进行的群决策推荐机制中,学者们尝试找到更好的定义来描述主观信任的方法并与客观信任融合,共同使用。因此,群决策不仅仅是后端的算法决定的,还包括了人的主观因素和人与系统交互的因素。本文试图从支持多用户参与的角度,研究一个具有可解释性的交互群决策模式。

2 多用户参与决策的交互新维度

多用户参与决策,作为群决策的最大特征,给相应的交互设计带来了新的维度。首先,决策者是否在知识对等的基础上提出自己的决策观点,也就是说,信息在决策者之间的分布至关重要。因此,信息可视化将很好地服务于多参与者信息、知识、观点的共享。第二,需要考虑构建的群决策网络结构是集中式或分散式。集中式结构中有一位决策者扮演权力的角色,所有信息、决策、更新都要经过他;而分散式结构需要参与者之间达成更加分散的沟通协议。第三,如何应对少数观点和不配合的决策行为是群决策中的独有难题[5]。最后,互联网带来的信息技术,会将决策支持系统推向社会化[6]。这意味着,决策过程可以同时邀请不同文化地域背景的决策者,参与到复杂的问题决策过程中。

因此,多用户参与的群决策交互需要在发展基本模型和后端算法的基础上,很好地设计前端的交互模式,支持决策者的主动和主观信息输入。在设计与后端相匹配的前端交互功能同时,融合支持多用户参与决策的新维度,让决策者的观点和行为被系统和其他参与者掌握。

3 可解释性交互模式

大量群决策相关研究集中在提出更加精确的后端决策模型和人工智能算法。然而,算法系统对于大多数用户决策者来说是一个黑匣子,其内部运作逻辑是不公开透明的[7]。由大数据和人工智能驱动的群决策系统在设计和用户数据上含有偏见,可能是不公正的[8]。同时,人工智能在精确度上表现仍有不足,而作为决策者的人可以为群决策提供高质量的反馈数据。难点在于,如何结合决策者的主观信息,如何设计决策者与系统的交互模式,提高群决策的过程和结果。

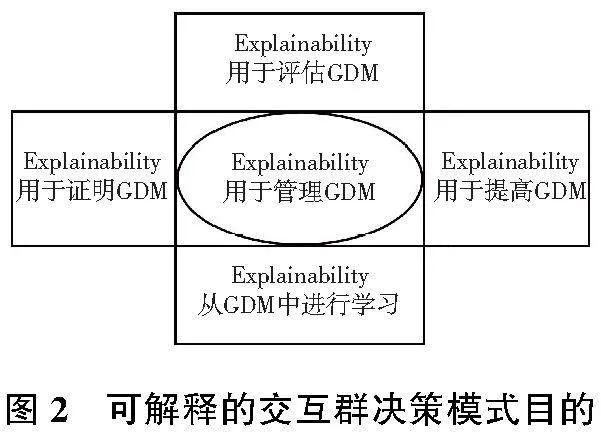

有关群决策及其交互模式的研究应该引入可解释性(explainability)[9]的理念。可解释性可以辅助人理解黑匣子挖掘出的隐性信息并理解黑匣子内决定的逻辑,从而进行群决策。目前,关于可解释性的相关探讨多在计算机领域和开发者中展开。然而,可解释性在智能决策中是公平、责任和可信赖的前提,最终可解释性影响着人们如何使用、参与和管理群决策。可解释交互群决策的目的和重要性在于:管理群决策、证明群决策的正当性,从群决策中学习、评估群决策、提高群决策,如图2所示。因此,构建可解释性群决策交互模式是一个很大的挑战,如何设计系统中人机交互模式,如何让系统准确地识别决策者的意图且避免引入错误和偏见,如何设计整个系统的流程,是当前研究的重点和难点。

4 多用户参与的可解释交互群决策模式

4.1 知识体系

目前,关于群决策研究主要集中在计算机科学和经济与管理科学领域,局限于决策模型和算法的探索开发,缺乏从人机交互和人机认知的角度重新审视群决策。随着人工智能的快速发展,单向利用决策模型及算法辅助群决策过程开始表现不足,因此研究必须向多用户参与的可解释交互群决策方向延伸。

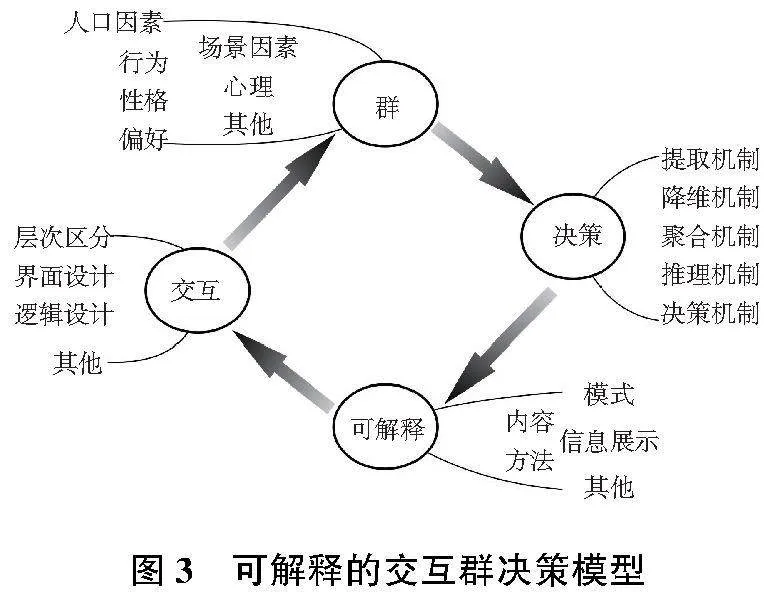

本文提出的可解释交互群决策模式在已有模块(图1)的基础上,通过搭建“可解释”模块,提高决策模型和算法的可解读性,最终起到了链接“群”、“决策”和“交互”模块,将群决策过程形成了回路(图3)。“群”模块中包括了决策参与者的个人信息和场景信息;“决策”模块中包含了计算机及人工智能领域的知识获取、推理、规划、识别、神经网络、复杂系统、遗传等人类思维方式算法;“交互”模块包括了人和系统的各类交互方法、信息的分层、逻辑和界面设计等;“可解释”模块包括了可解释功能的内容、模式、方法等元素。

4.2 表示结构

群决策中“群”的结构由每一个单独的个体组成,用IuP表示一个决策者u所自带的个人特征的集合。集合中包含偏好、行为、人口、性格和场景特征等,表示为

IuP={IuP,p,IuP,b,IuP,d,IuP,c,…,IuP,con}(1)

式中以“群”的性格特征为例,IuP,c是一个元组,表示一个决策者u所对指定性格类别j的拥有程度puj。Trait涵盖例如“大五”人格特征的严谨性、外向性、开放性等,表示为

IuP,c={(u,j,cuj)}, j∈Trait(2)

“可解释”的结构是一个大的集合IF,组成部分为决策者和决策系统两个元组,表示为

IF={IuF,c,IsF,c}(3)

式中以“可解释”的决策者元组为例,IuF,c是一个元组,代表决策者u对某个目标c的信息内容Infu,可以是任何类型的信息内容,包括文字、数据、原引等,表示为

IuF,c={(u,c,Infu)}, c∈Objective(4)

式中“可解释”的决策系统元组是指决策节点s对某个目标c的信息内容Infs,可以是任何类型的信息内容,表示为

IsF,c={(s,c,Inf s)}, c∈Objective(5)

5 研究方法和关键技术

面向多参与者的可解释交互群决策中,主要涉及到以下关键技术和研究方法。

5.1 多决策者的信息提取

所有决策者的相关信息提取是支持可解释交互群决策的第一步。为了尽可能地做到全方位描述参与者,信息提取应包含参与者的显性和隐性信息。从实际的角度,找出能够代表并区分各决策者特征的最小单元元素信息。提取能够准确描述决策者的信息是研究交互群决策的关键,对于实现可解释交互群决策具有重要意义。

5.2 多决策者的信息解义编码

所有决策者的信息编码是群决策设计的重要环节,主要将提取到的参与者显性和隐性特征信息编译为符合群决策认知的特征知识。可以通过统计学分析、内容分析、自然语言分析、大数据和人工智能结合等分析方法,建立群决策模型可以识别的关于描述决策者的数据结构,有助于计算机理解分析每个决策者。一方面,为群决策模型给予数据支持;另一方面,通过可解释交互模式随时进行自我信息更新。

编码的数据结构IuP应有利于计算机的储存、修改和分析,使群决策中的辅助交互功能、辅助决策功能、辅助解释功能实现无人工链接,在保证群决策表现可靠、稳定和最大化最优解的基础上,提升参与者的群决策交互体验。

5.3 构建群决策模型

确定群决策模型是设计师针对不同领域和需求的群决策场景选择适合的群决策机制过程。不同的群决策场景面临的决策问题不同,服务的群参与者特征也不同。这一环节主要研究在特定群决策场景下,面向特定群决策需求,基于特定决策者的信息,构建群决策机制模型,建立参与者信息与决策之间的映射关系,为探索多用户参与的可解释交互群决策奠定基础。

构建群决策模型主要包括两步。第一步是聚合群参与者的信息编码并提取离群值,由于群参与者的信息编码是单独储存的,因此需要群决策模型首先对单独的信息进行聚合,得到群信息编码。但同时,模型不希望丢失具有特殊特征的参与者编码,因此需要提取离群值用于后续交互模型设计。第二步是建立群决策推理机制,构建决策者编码和决策结果之间的推理关系。这里的推理可以是各类推荐机制,例如基于内容过滤、协同过滤等方法;也可以是人工智能领域相关的算法,例如神经网络、遗传算法、基于本体论的推理等方法。

5.4 确定可解释方法

可解释方法的构建是探究可解释交互群决策中的关键。首先,可解释方法需要能够为决策者的行为特征、态度想法、和思维模式进行恰当的解释,让决策者之间更多地互相了解对方;另一部分,可解释方法需要能够为群决策模型得出的结果进行合理的解释和过程阐述,有助于决策者理解计算机模型的思考逻辑,最终有助于决策者通过整合同伴的需求和计算机的思考逻辑,做出自己的综合判断。

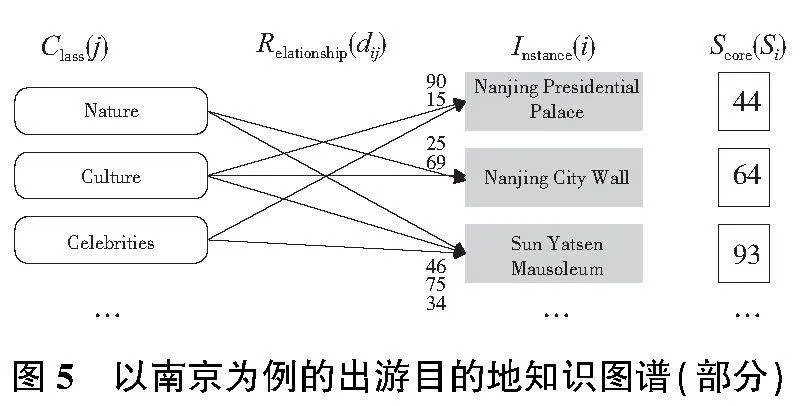

设计师可以从4个角度考虑构建可解释方法(图4):局部与全局、可解释性的目的、可解释的数据类型、针对特定模型与通用所有模型。例如,可以采取针对文字信息、提供局部功能解释、为单一群决策模型、以达到模型的透明度为目的,进行可解释方法的设计。

5.5 建立可解释交互模式

在确定可解释功能和方法的基础上,建立可解释交互模式是实现可解释性的关键步骤。可解释信息将被系统地存储,并使用固定格式的数据结构,能满足计算机对可解释内容的任何一个数据进行查询、删除、修改等操作。最终,通过选择适合的交互方法,例如短触、长按、查阅、点赞、留言等,建立可解释交互模式,在为决策者提供解释的基础上,随时更新决策者的信息。

6 实例说明

本文以一个辅助群体出游计划安排的手机应用设计原型系统为例,主要从群决策的技术生成、应用及可解释交互模式、界面设计的角度出发,在群决策算法的基础上融入可解释交互理念,从而得以更好地支持群体出游决策过程。此原型系统是基于Appery.io的手机应用开发平台。

6.1 群体出游的人群表示结构

在设计多用户参与的可解释群决策交互中,设计师通常从参与决策人群的角度出发,明确决策者的哪些个人特征影响着群决策的过程和结果,例如性别、年龄、偏好、风格、性格等。本研究中,基于出游人群的个人旅游偏好特征建立群资料库,由直接询问的方式获得,出游者u所对给定类别的旅游风格j的偏好程度puj形成一个偏好元组IuP,p,表示为

IuP,p={(u,j,puj)},j∈Class,puj∈[0,100](6)

式中:Class表示涵盖的各类旅游风格,例如,自然、文化、名人等。出游人群表示结构的确定可以很好地描述群决策所需的特征信息。下一步需要将出游人群中个人的特征信息整合为一个聚合群特征信息,为群决策逻辑做准备,表示为

GGP=(G,j,pGj),j∈Class,pGj∈[0,100](7)

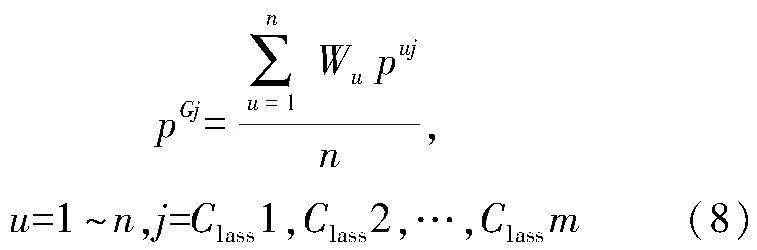

本研究中起始采用基础的聚合方法,取所有人的偏好平均值,根据不同的权重Wu∈0.5,1.5形成聚合后的群资料库,表示为

聚合方法的交互设计将在可解释交互模式部分进一步介绍。

6.2 群体出游的群决策逻辑

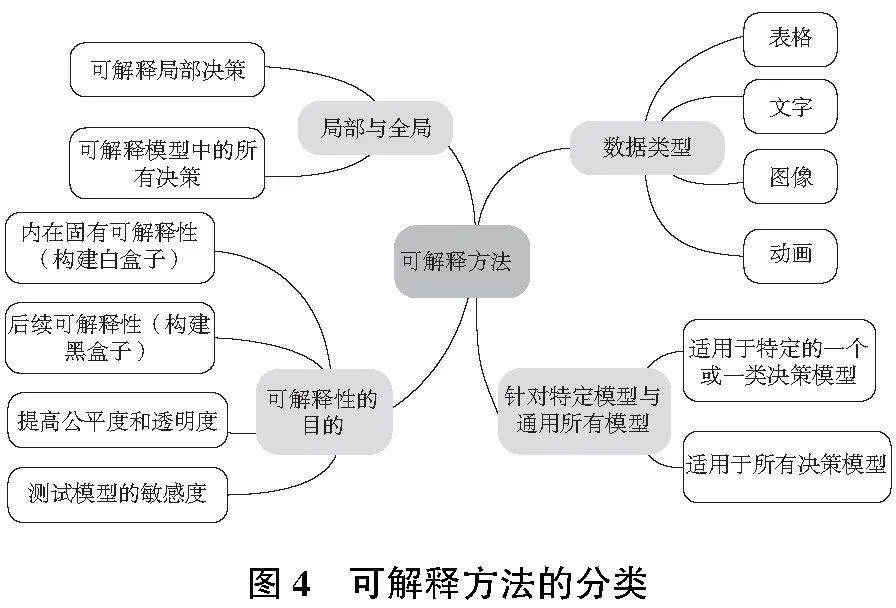

本研究中采用的群决策逻辑是基于知识本体论的推理模型。首先,需要建立一个关于出游目的地的知识图谱模型,包含推理所需的目的地基本信息,基于Noy提出的知识本体论构建指南,图5表示了本研究构建以南京为例的旅游目的地的知识图谱。

图5中:Class表示涵盖的各类旅游风格;Instance表示本体论中的待选项目;Relationship表示待选项目在各类的旅游风格上分别体现了多少;Score表示了待选项目的受欢迎程度。这些信息都直接有助于群决策的形成。

其次,需要构建一个群决策推理模型,完成基于知识图谱的出游群推荐,基本逻辑是基于群资料库GGP的信息,结合图5的知识图谱,得到每个待选项目i的推荐程度DGi。重新根据DGi数值的大小对待选项目排序将得到模型为特定出游群的决策结果。DGi的计算表示为

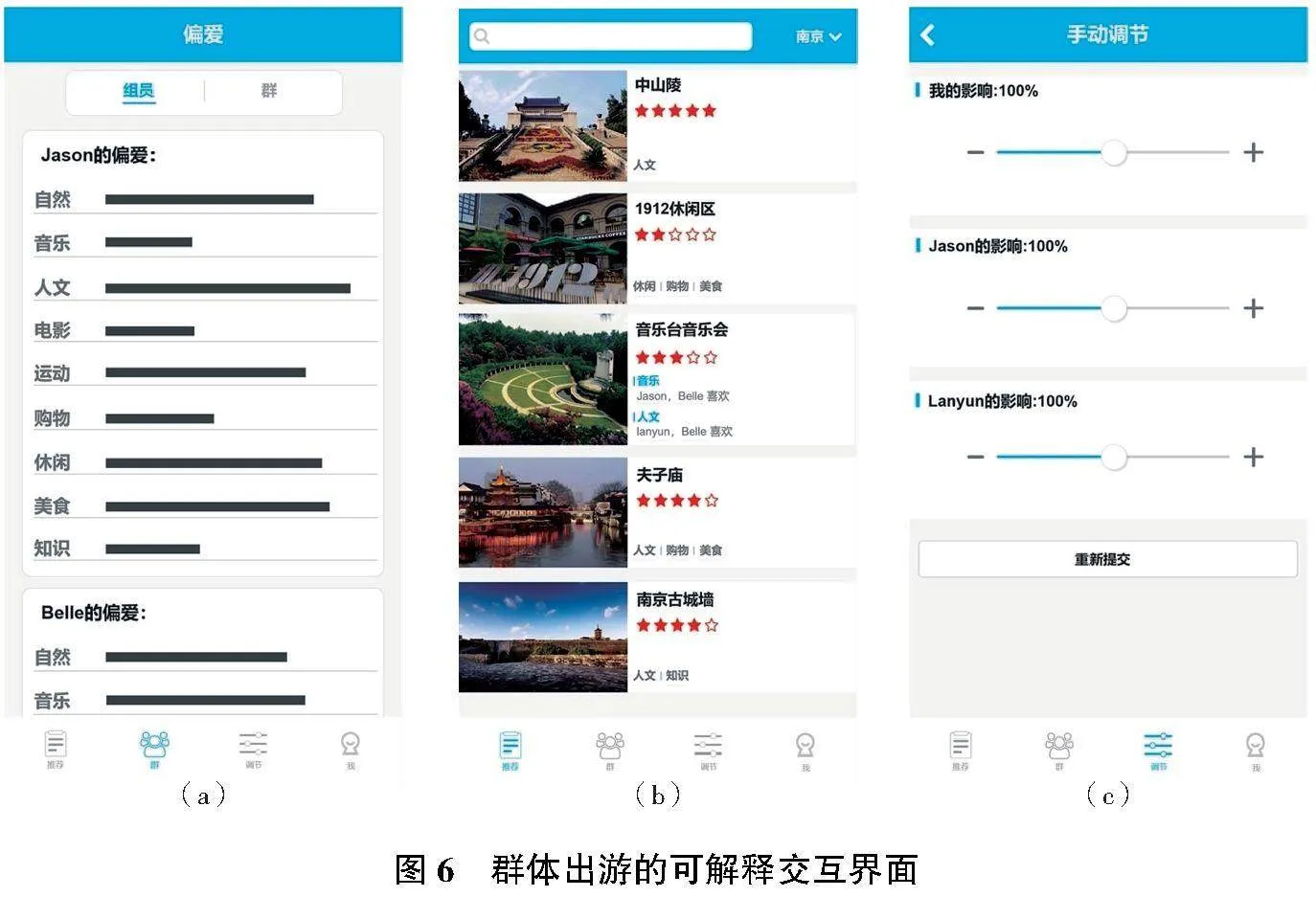

6.3 群体出游的可解释交互模式

本研究中针对群体出游的可解释交互设计主要从三个角度进行了探索。首先,可解释功能支持群决策者浏览其他参与者的出游偏好,有助于出游群成员相互了解(图6(a))。其次,可解释功能支持群决策模型做出某一决策的关键要素和节点,将原先不透明的决策算法过程可视化,一定程度上有助于出游群成员了解系统为什么给出特定的决策结果(图6(b))。最后,交互功能支持成员手动调整群出游成员的权重Wu∈[0.5,1.5],从而得到更看重某些成员偏好的群决策结果(图6(c)),这里Wu的设定仅用于此案例测试,其范围可以在不同案例和场景下进行调整。

7 结语

1)本文从工业设计和交互设计的角度出发,针对群决策过程,试图融合计算机技术、人机交互理论、可视化设计、心理学、文化和行为研究等学科知识,对多用户参与的可解释群决策交互模式进行了探讨,为群体决策场景服务的快速设计和知识体系建立提供了新的研究思路,也为从业者长效且可持续拓展群决策交互设计提供了新的设计思路。

2)后续研究工作将进一步挖掘可解释性的新型表达模式和交互模式,提高可解释群决策的合理性、适用性、鲁棒性和有效性。

参考文献:

[1] TORRANCE E P. Group decision-making and disagreement[J]. Social Forces,1957,35(4):314-318.

[2] 赵海燕,张友良. 面向产品并行开发过程的群决策支持系统研究[J]. 中国机械工程,2000,11(12):1376-1379.

[3] PREZ I J,CABRERIZO F J,ALONSO S,et al. On dynamic consensus processes in group decision making problems[J]. Information Sciences,2018,459:20-35.

[4] WU Z B,XU J P. Managing consistency and consensus in group decision making with hesitant fuzzy linguistic preference relations[J]. Omega,2016,65:28-40.

[5] DEMIRKAN H,DELEN D. Leveraging the capabilities of service-oriented decision support systems:putting analytics and big data in cloud[J]. Decision Support Systems,2013,55(1):412-421.

[6] UREA R,KOU G,DONG Y C,et al. A review on trust propagation and opinion dynamics in social networks and group decision making frameworks[J]. Information Sciences,2019,478:461-475.

[7] 吴飞,廖彬兵,韩亚洪. 深度学习的可解释性[J]. 航空兵器,2019,26(1):39-46.

[8] TUFEKCI Z. Algorithmic harms beyond facebook and google: emergent challenges of computational agency[J]. Journal on Telecommunications and High Technology Law, 2015,13:203.

[9] 成科扬,王宁,师文喜,等. 深度学习可解释性研究进展[J]. 计算机研究与发展,2020,57(6):1208-1217.