跨文化表情识别中的群内优势效应:自发性和呈现方式对气愤和厌恶表情识别的影响

方霞 葛猷勋

摘 要 以往研究发现, 识别与自身文化背景相同的个体的面部表情比跨文化背景个体更准确, 这被称为群内优势效应。然而, 以往研究主要关注静态表演表情, 对动态表情和自发表情识别中的群内优势效应知之甚少。为了探究群内优势效应是否受表情自发性(表演和自发)和呈现方式(靜态和动态)的调节, 本研究招募了中国和加拿大/荷兰被试, 分别对中国和荷兰模特表演和自发的气愤和厌恶表情(实验1), 以及静态和动态表演的气愤和厌恶表情(实验2)进行识别。研究结果显示, 在多数情况下, 表演和自发表情的识别都呈现群内优势效应, 且表演表情的群内优势效应显著高于自发表情; 静态和动态表演表情的识别也出现群内优势效应, 但两者总体上没有显著差异。这些结果表明, 表情识别的群内优势效应会受到表情自发性的调节, 但可能不受表情呈现方式的影响。本研究结果对于拓展群内优势效应研究和深化跨文化表情识别理解具有重要意义。

关键词 表情识别, 群内优势效应, 表演与自发表情, 静态与动态表情, 文化差异

分类号 B842

1 引言

当今全球化时代, 不同文化之间的交流日益频繁。在不同文化和语言的个体之间进行交流时, 准确解读对方的非语言行为, 尤其是面部表情, 显得尤为重要(Fang, Rychlowska, & Lange, 2022; Van Kleef & C?té, 2022)。然而, 准确识别面部表情并非易事, 尤其是解读其他文化个体的面部表情时。以往研究发现, 与文化群体内部交流相比, 当交流发生在不同文化个体间时, 非语言情绪沟通会受到损害(Elfenbein & Ambady, 2002)。具体而言, 人们在识别与自己具有相同文化背景个体的面部表情时, 其准确性要高于识别与自己文化背景不同的个体的面部表情(张秋颖 等, 2011; Elfenbein & Ambady, 2002), 这种效应被称为群内优势效应(in-group advantage)。

以往有关表情识别的群内优势效应研究主要聚焦于表演表情(posed facial expressions)和静态表情(static facial expressions; Elfenbein & Ambady, 2002)。表演表情是指个体有意识地摆出某种表情以传达特定的情绪(Elfenbein & Ambady, 2002), 而静态表情则是指在特定时刻捕捉的面部表情。然而, 在现实生活中, 表情往往是自发的, 即个体在交互过程中自然流露(Matsumoto, Olide, Schug et al., 2009), 也是动态的, 即表情会随着时间的推移发生变化(张琪 等, 2015; Krumhuber et al., 2023)。近年来, 越来越多的研究揭示个体对表演表情、自发表情(spontaneous facial expressions)、静态表情和动态表情(dynamic facial expressions)的表达和知觉可能存在差异(Kang & Lau, 2013; Krumhuber et al., 2021; Matsumoto, Olide, & Willingham, 2009; Valente et al., 2018), 因此有必要考察群内优势效应是否会受到表情的自发性和呈现方式的调节。为此, 本文首先回顾群内优势效应及其相关的情绪方言理论, 然后探讨表演表情和自发表情识别以及静态表情和动态表情识别可能存在的差异, 最后通过两项实验室研究探究表情的自发性和呈现方式是否调节气愤和厌恶表情识别的群内优势效应。本研究首次考察了表情识别的群内优势效应是否受到表情的两个重要特性——自发性和呈现方式的调节, 对于拓展表情识别中的群内优势效应研究, 并加深我们对跨文化表情识别的理解具有重要意义。

1.1 群内优势效应和情绪方言理论

尽管早期研究认为情绪面部表情(至少基本情绪面孔)具有文化普遍性, 不受文化的调节(如, Ekman et al., 1969), 但是近年来越来越多的研究者指出情绪表情既有文化普遍性也具有文化特异性(Elfenbein et al., 2007; Fang et al., 2021)。其中一种观点认为, 尽管来自不同文化的个体均能以高于机会水平识别不同文化个体的表情, 但人们对与自己文化相同的个体的表情识别率更高(Elfenbein & Ambady, 2002)。

研究者用情绪方言理论(Dialect Theory of Emotion)解释这种群内优势效应(Elfenbein, 2013; Elfenbein et al., 2007)。该理论认为, 情绪可以类比为一种在全球范围内使用的通用语言, 但来自不同文化背景的人在情绪表达和感知上略有差异, 即形成了所谓的“情绪方言” (Elfenbein & Ambady, 2002)。同一文化群体内的情绪识别受益于与其“情绪方言”更好的匹配, 而不同文化群体间较差的“情绪方言”匹配则导致情绪识别的准确性降低。Elfenbein等人(2007)的研究为情绪方言理论提供了实证支持。在该研究中, 来自加拿大和加蓬的被试被要求使用面部表情来表演气愤、厌恶、恐惧、惊讶、悲伤和快乐等情绪。研究人员使用面部行为编码系统(Facial Action Coding System, FACS; Ekman et al., 2002)分析了这些表情中使用的动作单元(Action Units, AUs)。结果发现, 尽管不同文化群体的表情均包含了FACS手册中标准表情的动作单元, 但也存在稳定差异(即情绪方言)。随后, 来自加拿大和加蓬的一组新被试被要求识别这些表情。结果显示, 与情绪方言理论相一致, 表情的情绪方言差异越显著, 群内优势效应就越强烈。

1.2 表演/自发表情和群内优势效应

虽然群内优势效应在许多研究中都得以验证, 但这些研究主要集中在表演表情上, 较少关注自发表情(见Elfenbein & Ambady, 2002的元分析)。近年来, 有研究发现, 在表达相同情绪时, 个体的表演表情和自发表情的动作单元有显著区别(Namba, Kagamihara et al., 2017; Namba, Makihara et al., 2017)。Fang, Sauter等人(2022)则发现, 相比于自发表情, 表演表情激活了更多的动作单元。这些结果共同表明, 表演表情和自发表情在面部肌肉运动模式上可能存在差异。

那么, 不同自发性的表情在其识别的群内优势效应上会有差异吗?以往研究发现, 表演表情可能比自发表情更易受文化的影响(有关综述, 请参阅Valente et al., 2018)。无论是早期观察研究还是标准化面部肌肉运动测量研究, 都发现先天性盲人产生的自发表情与视力正常的个体相似, 但表演表情却与正常个体有显著差异。这表明, 相比于自发表情, 表演表情可能更容易受到社会学习的影响。由此, 我们预测表演表情可能比自发表情包含更多与文化相关的情绪方言, 从而导致表演表情识别的群内优势效应大于自发表情。该推论获得了Matsumoto, Olide和Willingham (2009)的研究的初步支持。在这项研究中, 美国和日本被试对美国和日本运动员在2004年雅典奥运会获奖后的快乐或悲伤表情进行识别, 结果并未发现群内优势效应。这表明群内优势效应可能不存在于自发产生的表情中。然而, Kang和Lau (2013)却有不同的发现。他们让欧裔和亚裔美国被试识别欧裔和亚裔美国模特的标准表情(按照FACS手册标准制定的表情原型)和自发表情。其中标准表情来自Japanese and Caucasian Facial Expressions of Emotion (JACFEE; Matsumoto & Ekman, 1988)的表情图片, 而自发表情则是通过引导被试讲述个人经历而获得的动态表情视频片段。结果显示, 亚裔美国人在识别标准表情和自发表情时均出现了群内优势效应。值得注意的是, 该研究考察的标准表情以静态方式呈现, 自发表情以动态方式呈现, 且两种表情的情绪类别并不完全相同(模仿表情:悲伤、惊讶、恐惧、气愤、厌恶和愉快; 自发表情:悲伤、惊讶、沮丧、气愤和愉快)。因此, 表情的自发性对表情識别的群内优势效应是否具有调节作用还有待商榷。

然而, 另一方面, 相较于自发表情, 表演表情具有更高的强度和原型性(Krumhuber et al., 2021; Tcherkassof et al., 2007)。这些特性可能会导致表演表情比自发表情具有更高的识别率。跟该推论一致, 以往研究结果确实表明, 不论是人类还是机器, 都能更好地识别表演表情(Fang, Sauter et al., 2022; Krumhuber et al., 2021)。因此, 我们预测这种高识别特性可能缩小了感知者对不同文化个体的表演表情识别率的差异, 从而导致表演表情识别的群内优势效应小于自发表情。

1.3 静态/动态表情和群内优势效应

除了考察表情识别的群内优势效应是否会受到表情自发性的调节外, 本研究的第二个目标是探究表情的呈现方式是否影响表情识别的群内优势效应。相比静态表情, 动态表情含有独特的动态信息, 如表情运动的方向、质量和速度(Bould & Morris, 2008; Cunningham & Wallraven, 2009; Jack et al., 2014)。这些动态信息会启动更高级的认知过程, 支持社交和情绪推断, 从而促进面部表情的识别(Blais et al., 2017; Sato et al., 2008)。

尽管如此, 我们仍不清楚动态信息的促进作用是针对特定文化感知者群体, 还是普遍适用于所有文化感知者群体。换言之, 动态表情中的动态信息是否涵盖了文化特有的情绪方言。如果该动态信息包含情绪方言, 那么这些额外的情绪方言将进一步增强表情识别的群内优势效应。因此, 我们预期动态表情识别的群内优势效应将大于静态表情识别的群内优势效应。这一猜想在Elfenbein和Ambady (2002)的元分析中初步得到支持。他们发现, 使用动态表情作为实验材料的研究(共43项研究)所揭示的群内优势效应大于使用静态表情作为实验材料的研究(共79项研究)。值得注意的是, 该元分析发现的表情呈现方式对群内优势效应的调节仅呈边缘显著。此外, 该元分析包含的研究除了在表情呈现方式上存在差异外, 还在其他诸多方面存在差异, 例如表情的自发性、文化和情绪类别的选择。由于缺乏对其他方面差异的控制, 我们无法确定仅仅表情的呈现方式是否会调节表情识别的群内优势效应。

然而, 如果动态表情中的动态信息不包含文化特有的情绪方言, 而是普遍促进所有文化感知者的情绪识别表现, 那么动态表情和静态表情识别的群内优势效应将不会有差异。因此, 我们预期表情的呈现方式不会调节表情识别的群内优势效应。

1.4 当前研究

综上, 关于跨文化表情识别的群内优势效应是否受到表情自发性调节的问题, 现有研究虽然进行了初步探讨, 但存在一些限制。其中, 有些研究只包括了自发表情识别任务而没有涉及表演表情识别任务(Matsumoto, Olide, & Willingham, 2009), 因此无法直接比较自发表情和表演表情识别的群内优势效应是否存在差异; 而其他研究则在自发表情和表演表情的情绪类别和呈现方式上存在不匹配(Kang & Lau, 2013), 因此无法排除这些因素对结果的影响。此外, 现有研究对于表情自发性是否调节表情识别的群内优势效应的结论也不一致。至于跨文化表情识别的群内优势效应是否受到表情呈现方式的调节, 目前尚未开展相关研究。

本研究旨在通过两项实验考察跨文化表情识别中的群内优势效应是否受到表情自发性(表演表情和自发表情; 实验1)和呈现方式(静态表情和动态表情; 实验2)的调节。具体而言, 实验1招募来自东西方文化的被试, 以识别来自东西方文化表达者的表演动态表情和自发动态表情; 实验2招募来自东西方文化的被试, 以识别来自东西方表达者的静态表演表情和动态表演表情。其中, 表演表情是通过让模特摆出特定表情以便于他们的朋友能够轻松理解他们的感受所得, 而自发表情则是通过让模特回忆并讲述过去生活中与特定情绪相关的个人经历所得。相较于前人使用的标准表情(如, Kang & Lau, 2013), 本研究中采用的表演表情更加符合各自文化中的情绪表达规范, 并且避免了按照统一标准表演的面部表情掩盖文化差异可能导致群内优势效应消失的问题(Elfenbein et al., 2007)。

本研究关注气愤和厌恶两种情绪的面部表情。主要考虑如下三点。首先, 气愤和厌恶被广泛认为是基本情绪(Ekman, 1992; Izard, 2007), 因此预计在东西方文化中都普遍存在且较为常见。其次, 尽管气愤和厌恶是不同的情绪, 但它们在概念上存在关联(Giner-Sorolla et al., 2018), 并且在面部形态上具有相似性(Cordaro et al., 2018; Fang, Sauter et al., 2022)。这些相似性导致个体容易混淆气愤和厌恶这两种表情(Fang et al., 2018, 2019; Jack et al., 2009; Pochedly et al., 2012)。采用这两种具有混淆度的面部表情可以更好地诱发表情识别的群内优势效应。相反, 当采用两种完全不同的表情, 如气愤和快乐时, 个体对无论来自哪个文化的气愤和快乐表情的辨别都比较好, 因此表情识别的群内优势效应不太可能显现。第三, 现有表情数据库主要刻画静态表演表情, 对动态或自发表情的刻画较少(有关综述, 请参阅Dawel et al., 2022; Krumhuber et al., 2017), 同时包含两种表情自发性或者两种表情呈现方式的跨文化表情数据库更少。据作者所知, 目前仅有一项跨文化情绪表达的研究同时包含了上述4种条件的表情, 为中国和荷兰模特的气愤和厌恶的静态/动态的表演和自发表情(Fang, Sauter et al., 2022)。因此, 本研究利用该材料, 着重考察气愤和厌恶表情识别的群内优势效应是否受到表情自发性和呈现方式的调节。

2 实验1:表演和自发动态表情识别的群内优势效应

2.1 方法

2.1.1 被试

参照以往相关研究(Elfenbein & Ambady, 2002; Kang & Lau, 2013), 本实验计划招募加拿大被试和中国被试各100名。我们事先决定在被试数量接近100的那一天停止数据收集(Simmons et al., 2013)。最终, 本实验招募了126名加拿大被试和126名中国被试。其中, 62名加拿大被试(52名女性; 平均年龄为20.67岁, SD = 6.91岁)和62名中国被试完成表演表情识别任务(52名女性; 平均年龄为20.18岁, SD = 1.29岁), 另外64名加拿大被试(58名女性; 平均年龄为20.89岁, SD = 6.07岁)和64名中国被试(58名女性; 平均年龄为20.03岁, SD = 1.33岁)完成自发表情识别任务。使用软件G*Power 3.1 (Faul et al., 2007)进行敏感性分析(sensitivity analysis)表明, 本实验的最终样本数量(N = 252)可以检测到的关键交互作用(表情自发性 × 表达者文化 × 感知者文化)的效应大小为f = 0.21 (ηp2 = 0.04; power = 0.80, α = 0.05)。所有被试身心均健康, 视力或矫正视力正常, 自愿参与实验, 并在参与实验前签署了知情同意书。本实验获得了加拿大约克大学伦理委员会的批准, 编号为e2018-028。

2.1.2 设计与材料

实验1采用2 (表情种类:气愤、厌恶) × 2 (表情自发性:表演、自发) × 2 (表达者文化:东方、西方) × 2 (感知者文化:东方、西方)的混合实验设计, 其中表情种类和表达者文化为被试内变量, 表情自发性和感知者文化为被試间变量。

实验材料来源于Fang, Sauter等人(2022)的研究。该研究收集了表演表情和自发表情。在表演表情条件中, 被试被要求在摄像机前摆出特定的表情, 以便“他们的朋友能够轻松理解他们的感受”。被试完成两种表情的表演后, 观看自己的视频, 并选择最能表达相应情绪的那一帧画面作为静态表演表情材料(用于实验2; 参见图1示例)。这种方法确保了所选择的静态表情准确地表达了被试意图表达的情绪, 避免了引入实验者偏差(类似操作见Cordaro et al., 2018; Elfenbein et al., 2007)。动态表情材料则基于被试选择的那一帧画面, 截取前后共2秒的视频片段 。共有45名中国模特(22名女性)和49名荷兰模特(36名女性)参与了气愤和厌恶表情表演, 因此共获得了188个静态/动态表演表情材料。在自发表情的采集中, 被试被告知将协助开发一个能够理解人类情感的机器人。他们需要回忆过去生活中与气愤或厌恶情绪相关的个人经历, 并向机器人详细讲述这些经历。在讲述过程中, 被试的面部表情被全程记录。研究表明, 这种情绪重现法(relived- emotion method)能有效诱发自发表情(如, Siedlecka & Denson, 2019; Tsai & Chentsova-Dutton, 2003)。其余程序与表演表情相同。共有35名中国模特(24名女性)和35名荷兰模特(24名女性)参与了气愤和厌恶故事讲述, 因此共获得了140个动态自发表情刺激。由于被试在自发条件下会因为讲述故事而产生嘴部动作, 因此无法区分静态自发表情的嘴部动作是由说话引起的还是由做特定表情动作引起的。因此, 本实验只关注动态的自发表情和表演表情之间的比较。

2.1.3 实验程序

实验在PsychoPy (Peirce et al., 2019)上进行。被试被随机分配到动态表演表情或动态自发表情的识别任务中。在每个试次中, 屏幕中央先呈现500 ms注视点, 再呈现2000 ms大小为18° × 12°的动态表情视频。视频播放完毕后, 屏幕上紧接着呈现情绪强度评分量表。被试需要移动量尺上的滑块, 分别对先前呈现的动态表情的气愤、厌恶、恐惧、悲伤和愉快情绪的强度进行评分, 评分范围从0 (一点也不)到100 (非常) 。这里采用评分量表的方式是因为感知者可能会在表情中识别出多种情绪(Fang et al., 2018, 2019; Hess et al., 2016)。与迫选法不同, 评分量表允许被试表达在感知特定表情时识别出的不同情绪的强度, 而不仅仅是选择一种情绪。

动态表演表情识别任务包含4个blocks, 每个block有47个试次, 共188个试次。动态自发表情识别任务包含140个试次。所有面部表情材料仅呈现一次, 呈现顺序完全随机。所有被试均使用自己的语言进行测试。

2.2 结果和讨论

表情识别正确率的具体计算方式如下:如果被试在目标情绪维度上的评分大于或等于其他情绪维度上的评分且不等于0, 则编码结果为1 (正确判断), 否则编码为0 (错误判断)。为了更加直观地考察群内优势效应, 在每种呈现方式和每种表情种类条件下, 计算被试对来自相同文化背景的表情识别正确率减去其对来自不同文化背景的表情识别正确率的差值, 作为群内优势效应的指标。若差值显著大于0, 则说明存在群内优势效应; 若差值显著小于0, 则说明感知者对其他文化表达者表情的表情识别正确率显著高于对相同文化表达者表情的表情识别正确率; 若差值和0没有显著差异, 则说明感知者对不同文化表达者表情的表情识别正确率没有显著差异。结果发现, 西方感知者在识别表演表情和自发表情时均出现了群内优势效应; 东方感知者在识别表演表情时也出现了群内优势效应, 但在识别自发表情时未出现群内优势效应。在综合讨论部分中将对该结果作进一步讨论。各条件下群内优势效应的均值、标准差和单样本t检验结果见表1。各条件下表情识别正确率的均值、标准差和单样本t检验结果见网络版附表1。

对群内优势效应进行2 (表情种类:气愤、厌恶) × 2 (表情自发性:表演、自发) × 2 (感知者文化:东方、西方)三因素混合设计方差分析 。所有效应的概览见表2。

表情种类的主效应显著, F(1, 248) = 6.54, p = 0.011, ηp2 = 0.03, 厌恶表情的群内优势效应(M = 0.06, SD = 0.11)显著大于气愤表情(M = 0.04, SD = 0.12); 感知者文化的主效应显著, F(1, 248) = 27.18, p < 0.001, ηp2 = 0.10, 西方感知者的群内优势效应(M = 0.08, SD = 0.07)显著大于东方感知者(M = 0.03, SD = 0.09)。

重要的是, 跟本研究假设相关的表情自发性的主效应显著, F(1, 248) = 31.34, p < 0.001, ηp2 = 0.11, 表演表情的群内优势效应(M = 0.08, SD = 0.08)显著大于自发表情(M = 0.03, SD = 0.09)。并且, 表情自发性 × 感知者文化的二阶交互作用, F(1, 248) = 13.09, p < 0.001, ηp2 = 0.05, 表情种类 × 表情自发性 × 感知者文化的三阶交互作用, F(1, 248) = 57.08, p < 0.001, ηp2 = 0.19, 均显著(见图2)。为了进一步分解该三阶交互作用, 我们首先拆分感知者文化。结果显示, 在东方和西方感知者中, 表情种类 × 表情自发性的二阶交互作用均显著(东方:F(1, 124) = 15.23, p < 0.001, ηp2 = 0.11; 西方:F(1, 124) = 46.20, p < 0.001, ηp2 = 0.27)。由于本研究对群内优势效应是否会受到表情自发性调节感兴趣, 因此將该二阶交互作用从表情种类进行拆分。结果发现, 对于东方感知者而言, 表演气愤和表演厌恶表情的群内优势效应分别显著大于自发气愤和自发厌恶表情(气愤:t(124) = 6.98, p < 0.001, Cohens d = 1.24, 95% CI = [0.86, 1.62]; 厌恶:t(124) = 2.09, p = 0.039, Cohens d = 0.37, 95% CI = [0.02, 0.72])。对于西方感知者而言, 表演厌恶表情的群内优势效应同样显著大于自发厌恶表情, t(124) = 5.66, p < 0.001, Cohens d = 1.01, 95% CI = [0.64, 1.38]。然而, 西方感知者识别自发气愤表情时的群内优势效应显著大于识别表演气愤表情时, t(124) = 3.82, p < 0.001, Cohens d = 0.68, 95% CI = [0.32, 1.04]。

综上, 实验1的结果表明动态表情识别的群内优势效应会受到表情的自发性调节。总体而言, 表演表情识别的群内优势效应大于自发表情。这可能是由于表演表情相较于自发表情更容易受到社会学习的影响(Matsumoto & Willingham, 2009; Rinn, 1991), 从而包含了更多的情绪方言。这些额外的情绪方言进一步扩大了人们在识别本文化和外文化个体表演表情的差异, 即增强了群内优势效应。唯一的例外是, 西方感知者在识别自发气愤表情时的群内优势效应大于识别表演气愤表情时。有关此问题的进一步讨论将在综合讨论部分进行。

3 实验2:静态和动态表演表情识别的群内优势效应

3.1 方法

3.1.1 被试

本实验中完成动态表演表情任务的被试来自实验1。和实验1类似, 实验2计划招募荷兰和中国被试各约60名完成静态表演表情的识别任务。我们事先决定在被试数量接近60的那一天停止数据收集(Simmons et al., 2013)。最终, 实验2招募了75名荷兰被试(59名女性; 平均年龄为21.53岁, SD = 4.15岁)和82名中国被试(58名女性; 平均年龄为24.16岁, SD = 5.10岁)。使用软件G*Power 3.1 (Faul et al., 2007)进行敏感性分析(sensitivity analysis)表明, 本实验的最终样本数量(N = 283)可以检测到的关键交互作用(表情自发性 × 表达者文化 × 感知者文化)的效应大小为f = 0.19 (ηp2 = 0.03; power = 0.80, α = 0.05)。所有被试身心均健康, 视力或矫正视力正常, 自愿参与实验, 并在参与实验前签署了知情同意书。本实验获得了阿姆斯特丹大学伦理委员会的批准, 编号为2018-SP-9379。

3.1.2 设计与材料

实验2采用2 (表情种类:气愤、厌恶) × 2 (呈现方式:静态、动态) × 2 (表达者文化:东方、西方) × 2 (感知者文化:东方、西方)的混合实验设计。其中表情种类和表达者文化为被试内变量, 呈现方式和感知者文化为被试间变量。实验材料获取方式见实验1。

3.1.3 实验程序

静态表演表情识别任务在Qualtrics在线调查平台(https://www.qualtrics.com/)上进行。在每个试次中, 屏幕上会呈现一张气愤或厌恶情绪的面部表情图片, 以及图片下方的气愤、厌恶、恐惧、悲伤这四个情绪的强度评价量尺。鉴于愉快与这气愤和厌恶这两种负面情绪有着明显的效价区别, 且实验1中被试只会在少数情况下(约14.84%的试次)将目标表情图片识别为愉快, 故实验2中不再将愉快作为强度评价的项目。除此以外, 实验程序与实验1保持一致。动态表演表情识别任务来自实验1。

3.2 结果和讨论

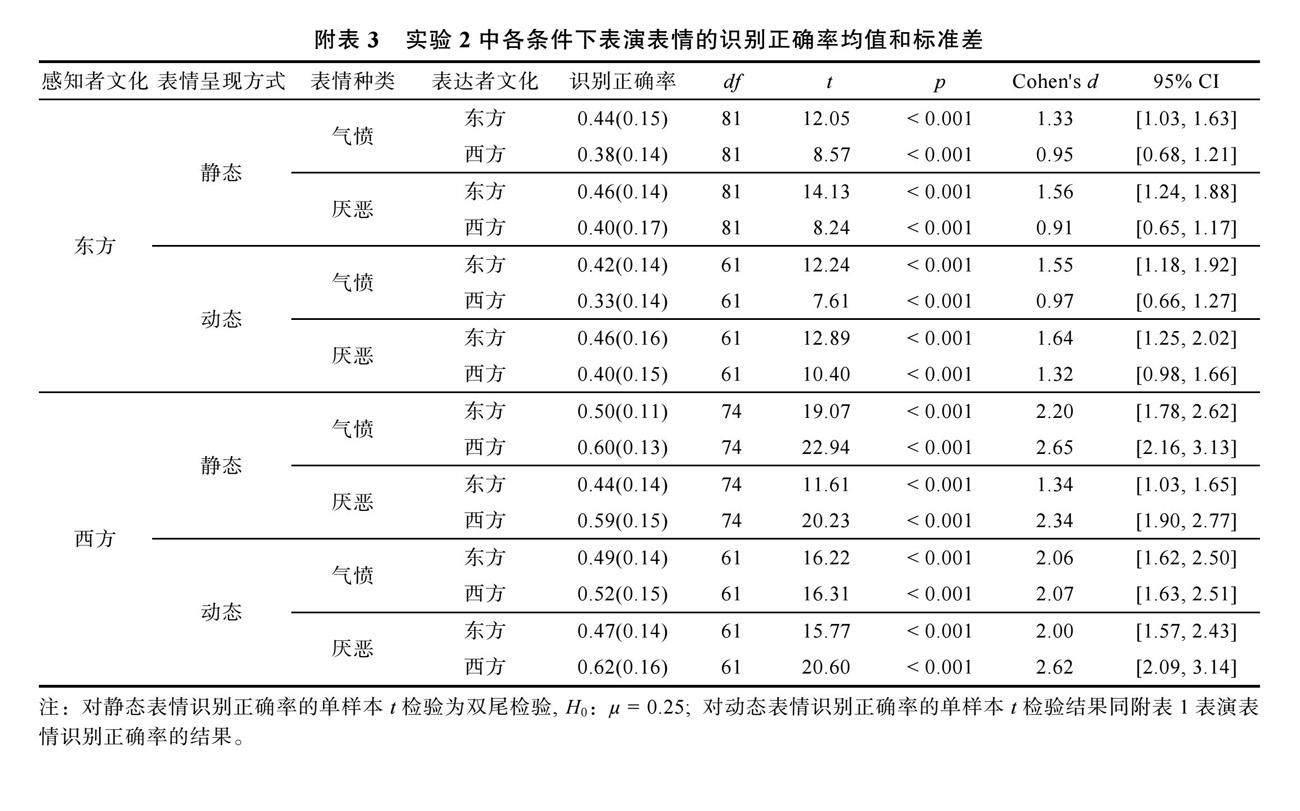

静态表演表情的识别结果来自本实验, 动态表演表情的识别结果来自实验1。表情识别正确率和群内优势效应的计算方式同实验1。结果显示, 东方感知者和西方感知者在识别静态和动态表演表情时均出现了群内优势效应。各条件下静态表演表情的群内优势效应的均值、标准差和单样本t检验结果见表3。各条件下表情识别正确率的均值、标准差和单样本t检验结果见网络版附表3。

对群内优势效应进行2 (表情种类:气愤、厌恶) × 2 (呈现方式:静态、动态) × 2 (感知者文化:东方、西方)三因素混合设计方差分析 。所有效应的概览见表4。

表情种类的主效应显著, F(1, 277) = 13.25, p < 0.001, ηp2 = 0.05, 厌恶表情的群内优势效应(M = 0.10, SD = 0.12)显著大于气愤表情的群内优势效应(M = 0.07, SD = 0.11); 感知者文化的主效应显著, F(1, 277) = 18.87, p < 0.001, ηp2 = 0.06, 西方感知者的群內优势效应(M = 0.11, SD = 0.08)显著大于东方感知者的群内优势效应(M = 0.07, SD = 0.07)。

重要的是, 跟本研究假设相关的表情呈现方式的主效应不显著, F(1, 277) = 2.52, p = 0.113。然而, 呈现方式 × 感知者文化的二阶交互作用, F(1, 277) = 7.44, p = 0.007, ηp2 = 0.03, 表情种类 × 呈现方式 × 感知者文化的三阶交互作用, F(1, 277) = 4.81, p = 0.029, ηp2 = 0.02, 均显著(见图3)。为了进一步分解该三阶交互作用, 我们同样先拆分感知者文化。结果显示, 在东方感知者中, 表情种类 × 呈现方式的二阶交互作用不显著, F(1, 142) = 1.44, p = 0.233, 而在西方感知者中, 该二阶交互作用呈边缘显著, F(1, 135) = 3.55, p = 0.062, ηp2 = 0.03。进一步将西方感知者的二阶交互作用从表情种类进行拆分, 我们发现静态气愤表情的群内优势效应显著大于动态气愤表情, t(135) = 3.60, p < 0.001, Cohens d = 0.62, 95% CI = [0.27, 0.96], 而静态和动态厌恶表情的群内优势效应无显著差异, t(135) = 0.66, p = 0.513。

综上, 实验2的结果表明, 在大部分条件下, 群内优势效应不受表演表情呈现方式的调节。唯一的例外是, 西方感知者识别静态气愤表情时的群内优势效应显著大于动态气愤表情。综合讨论中将对这些发现进行进一步讨论。

4 综合讨论

随着全球化的发展, 人们获得了更多与其他文化群体交流的机会, 了解不同文化背景的个体如何感知彼此的情绪也变得愈发重要。以往研究普遍发现了情绪识别的群内优势效应, 即识别同一文化个体面部表情的情绪时的表现优于识别不同文化个体面部表情的情绪时(Elfenbein, 2013; Elfenbein et al., 2007)。然而, 大部分研究仅限于使用模特表演的静态表情, 很少有研究探讨群内优势效应是否存在于对自发表情和动态表情的识别中。在日常生活中, 人们看到的表情往往是动态的, 且与实验中模特表演的表情相比, 强度更低, 原型性更弱(Dawel et al., 2022; Krumhuber et al., 2021; Scherer et al., 2011)。因此, 基于静态表情和表演表情的研究发现是否能推广到真实情境中有待商榷。

本研究通过比较中国和加拿大/荷兰感知者对中国和荷兰表达者的气愤和厌恶表情的识别, 首次考察群内优势效应是否会受到表情自发性(表演和自发)和表情呈现方式(静态和动态)的调节。结果显示, 总体而言, 表情识别的群内优势效应受到表情自发性的调节, 但不受表情呈现方式的调节。表演表情比自发表情表现出了更强的群内优势效应, 然而静态和动态表情之间的群内优势效应并不存在显著差异。下文将详细讨论这些发现。

4.1 表演和自发表情识别的群内优势效应

本研究揭示, 在绝大多数情况下(表情种类 × 感知者文化), 表演表情识别的群内优势效应均大于自发表情。这可能是由于人们有意识摆出的表情更多地受社会化的塑造, 而自发流露的表情表情则较少受到社会学习的影响(Matsumoto & Willingham, 2009; Rinn, 1991)。因此, 表演表情相较于自发表情可能含有更多的情绪方言。需要注意的是, 本研究中的表演和自发表情材料均来自Fang, Sauter等人(2022)的研究。该研究显示, 除了荷兰表达者的表演气愤表情的动作单元数量少于自发气愤表情外, 其他情况下表演表情的动作单元数量均多于自发表情。这些额外的肌肉运动说明表演表情包含更多信息, 更有可能蕴含文化特有的情绪方言。因此, 表演表情的群内优势效应大于自发表情。然而, 在实验1中存在一个例外:西方感知者识别自发气愤表情时的群内优势效应大于表演气愤表情。这可能是因为荷兰表达者的表演气愤表情常用的动作单元数量少于其自发气愤表情, 并且两者常用的动作单元相似度较低(仅共享5或6个动作单元中的其中两个)。具体而言, 荷兰表达者的表演气愤表情常用的动作单元有5个, 分别为AU4 (双眉紧皱)、AU7 (内眼睑缩紧)、AU23 (嘴唇紧缩)、AU54 (低头)、AU63 (双眼向上), 而自发气愤表情常用的动作单元有6个, 分别为AU1 (眉毛内侧抬升)、AU2 (眉毛外侧抬升)、AU4、AU7、AU61 (双眼向左)、AU64 (双眼向下)。这些结果表明, 荷兰表达者在自发气愤表情和表演气愤表情方面存在较大差异。荷兰表达者的自发气愤表情可能涵盖了更多文化特有的情绪方言, 从而导致自发气愤表情具有更强的群内优势效应。

此外, 尽管表情识别的群内优势效应在大部分情况下都存在(表情种类 × 表情自发性 × 感知者文化), 但东方感知者识别自发气愤和厌恶表情时并未出现群内优势效应。该结果可能由两个原因导致。首先, 除情绪方言对跨文化情绪沟通的影响外, 历史异质性是另一个常见的影响因素(historical heterogeneity; Niedenthal et al., 2018)。历史异质性指的是过去500年中对一个国家的当前人口做出贡献的来源国的数量(Rychlowska et al., 2015; Wood et al., 2016)。历史异质性越高的社会拥有更多样化的价值观和信仰。为了在如此多元化的社会环境中生存, 个体需要直接而准确地传达他们的情感和意图。因此, 相较于来自历史同质性社会(例如中国和日本)的个体, 来自历史异质性社会(例如美国和加拿大)的个体在使用面部表情表达不同情绪时往往更加清晰(Fang, Rychlowska et al., 2022; Wood et al., 2016), 因此更容易被其他个体识别。在本研究中, 与表演表情相比, 历史异质性可能对自发表情产生了更大的影响。对于中国感知者来说, 尽管情绪方言使得他们能更好地辨认中国的自发表情(相比于荷兰的自发表情), 但历史异质性使得他们能更好地辨认荷兰的自发表情(相比于中国的自发表情)。这两种作用相互抵消, 从而导致中国感知者识别自发气愤和厌恶表情时并未出现群内优势效应。

第二, 除了历史异质性外, 集体主义/个人主义也会影响情绪的跨文化沟通(Matsumoto et al., 2008)。相较于西方文化, 东方文化的个体更具集体主义倾向, 更注重维护群体的和谐与稳定, 在交流时可能更倾向于弱化对消极情绪的表达(Ekman, 1971; Matsumoto et al., 2008)。Fang, Sauter等人(2022)的研究在一定程度上支持了这一推论。他们发现, 中国个体在自发表达气愤和厌恶表情时常用的动作单元(气愤表情仅有2个, 厌恶表情仅有3个)远远少于荷兰个体(气愤表情有6个, 厌恶表情有7个)。弱化的情绪表达提高了表情识别的难度。因此, 即使对于中国感知者来说, 中国表达者的自发消极表情也可能较难识别, 导致中国感知者在识别自发表情时并未出现群内优势效应。未来的研究需要更深入地探讨这些可能的解释。

4.2 静态和动态表情识别的群内优势效应

本研究发现, 表演表情识别的群内优势效应不受表情呈现方式的调节。然而, 与预期不一致的是, 该现象并不是因为动态信息普遍促进了所有文化感知者群体的表情识别。相反, 在绝大多数情况下(表情种类 × 表达者文化), 感知者对静态表情和动态表情的识别率并无显著差异(详见补充材料2)。该结果说明, 本研究中的动态信息对表演表情识别没有促进作用。尽管以往大量研究揭示动态表情的识别率优于静态表情, 但也有其它研究并未发现两者的识别率存在差异(如, Fiorentini & Viviani, 2011; Wehrle et al., 2000)。这些不一致的结果可能与面部表情材料及感知情境有关。当面部表情信息有限时, 如表情真实性受损(K?tsyri et al., 2008; Wehrle et al., 2000)或表情强度较弱(Bould & Morris, 2008; Yitzhak et al., 2018), 动态信息可以弥补静态表情的信息不足, 从而有助于提高表情识别。然而, 当面部表情信息充足时, 如表情清晰或者强烈, 静态表情的识别可能已经达到较高水平, 额外的动态信息并不会提高表情识别准确率(Bould & Morris, 2008; Gold et al., 2013)。此外, 當面部表情材料呈现时间短暂且被试应答时间有限时, 静态表情比动态表情得到更加充分的加工, 反而导致个体对静态表情的识别率大于动态表情(Jiang et al., 2014)。在本研究中, 静态表情和动态表情的比较建立在模特表演特定情绪的表情上, 而表演表情往往包含了相对强烈的情绪信息(Kayyal & Russell, 2013)。这些强烈的情绪信息导致静态表情和动态表情的识别率相当, 从而进一步导致了表情识别的群内优势效应不受呈现方式调节。

然而, 实验2发现一个例外:当西方感知者识别静态和动态表演的气愤表情时, 静态表情具有更大的群内优势效应。进一步的分析表明, 该差异是由于西方感知者对于西方表达者的静态气愤表情的识别率高于对于西方表达者的动态气愤表情, 而对于东方表达者的静态和动态气愤表情的识别则没有明显差异(详见补充材料2)。该发现与以往研究揭示动态信息促进表情识别的结果完全相反(Ambadar et al., 2005; Krumhuber et al., 2023)。值得注意的是, 与以往研究主要使用morph软件生成从中性表情转变为特定情绪的动态表情不同(Krumhuber et al., 2023), 本研究使用的动态表情材料是真实个体的动态表演录像片段。这些片段是从个体选取的, 能够最好地代表特定情绪表情的那一帧前后共2秒的视频片段。因此, 与以往研究中的情绪变化呈线性变化不同, 本研究中的情绪变化可能呈现非线性和不规律的特点。这些不规律的动态信息可能缺乏清晰的情绪信号, 因此导致动态表情的识别率与静态表情没有差异, 甚至可能低于静态表情。

4.3 局限与展望

本研究仍存在一些局限之处, 后续研究可进一步从以下几个方面继续深化对跨文化情绪识别的认识。

首先, 本研究仅考察了两种消极情绪——气愤和厌恶的群内优势效应。同时, 本研究仅考察了中国和荷兰这两种文化识别各自文化个体的情绪时的表现。目前尚不清楚本研究的结论是否也适用于除气愤和厌恶外的其他情绪的感知, 以及是否适用于其他文化群体。因此, 未来研究可以探究其他情绪和其他文化群体在情绪识别方面是否也存在群内优势效应, 以及群内优势效应是否受表情自发性或者呈现方式的调节, 以更全面地了解不同文化群体的成员进行情绪交流时的文化异同。

其次, 本研究在考察表情自发性对群内优势效应的调节作用时仅采用了动态表情(动态表演表情 vs. 动态自发表情), 而在考察表情呈现方式对群内优势效应的调节作用时仅采用了表演表情(静态表演表情 vs. 动态表演表情)。这是因为本研究使用的自发面部表情是根据个体自述以往经历时伴随的面部表情获得的。如果在此基础上截取特定帧作为静态自发表情, 可能导致被试无法区分嘴部动作是由说话引起的还是由特定表情动作引起的。因此, 在排除静态自发表情这一选项后, 我们选择了上述比较对象。未来可以尝试使用其他自发表情诱发技术, 如让模特观看带有特定情绪色彩的电影片段(Gross & Levenson, 1995)或闻特定的气味等(Zhang et al., 2014), 以在避免嘴部影响的前提下获取模特的静态自发表情。

最后, 虽然本研究发现群内优势效应会受到动态表情自发性的调节, 并推测面部动作单元的激活数量可能与群内优势效应的大小相关, 但具体的关联机制仍需要进一步的实证检验。此外, 本研究发现群内优势效应可能不受表演表情呈现方式的调节, 但这可能是因为本研究中感知者识别静态和动态表情时的表现没有区别。未来的研究可以探究当表情强度较低时, 动态信息是否在感知者识别本文化和其他文化个体表情时的增益不同, 从而导致静态表情与动态表情识别的群内优势效应产生差异。

5 结论

本研究首次考察了气愤和厌恶表情识别的群内优势效应是否会受到表情自发性(表演表情和自发表情)和表情呈现方式(静态表情和动态表情)调节。总体而言, 表演表情识别的群内优势效应大于自发表情识别的群内优势效应, 但群内优势效应未受到表情呈现方式的调节。本研究结果扩展了跨文化情绪识别领域的发现, 揭示了表演表情和自发表情在识别上的群内优势效应的差异, 为更好地理解人们如何识别不同文化个体的表情提供了新的实证证据。

参 考 文 献

Ambadar, Z., Schooler, J. W., & Cohn, J. F. (2005). Deciphering the enigmatic face: The importance of facial dynamics in interpreting subtle facial expressions. Psychological Science, 16(5), 403?410. https://doi.org/10.1111/ j.0956-7976.2005.01548.x

Bain, A. (2006). The emotions and the will. New York, NY: Cosmo Classics. (Original work published 1859)

Blais, C., Fiset, D., Roy, C., Saumure Régimbald, C., & Gosselin, F. (2017). Eye fixation patterns for categorizing static and dynamic facial expressions. Emotion, 17(7), 1107?1119. https://doi.org/10.1037/emo0000283

Bould, E., & Morris, N. (2008). Role of motion signals in recognizing subtle facial expressions of emotion. British Journal of Psychology, 99(2), 167?189. https://doi.org/10.1348/ 000712607X206702

Cordaro, D. T., Sun, R., Keltner, D., Kamble, S., Huddar, N., & McNeil, G. (2018). Universals and cultural variations in 22 emotional expressions across five cultures. Emotion, 18(1), 75?93. https://doi.org/10.1037/emo0000302

Cunningham, D. W., & Wallraven, C. (2009). Dynamic information for the recognition of conversational expressions. Journal of Vision, 9(13), 7?7. https://doi.org/10.1167/9.13.7

Dawel, A., Miller, E. J., Horsburgh, A., & Ford, P. (2022). A systematic survey of face stimuli used in psychological research 2000?2020. Behavior Research Methods, 54(4), 1889?1901. https://doi.org/10.3758/s13428-021-01705-3

Ekman, P. (1971). Universals and cultural differences in facial expressions of emotion. Nebraska Symposium on Motivation, 19, 207?283.

Ekman, P. (1992). An argument for basic emotions. Cognition and Emotion, 6(3?4), 169?200. https://doi.org/10.1080/ 02699939208411068

Ekman, P., Friesen, W. V., & Hager, J. C. (2002). The facial action coding system: A technique for the measurement of facial movement. San Francisco, CA: Consulting Psychologists Press.

Ekman, P., Sorenson, E. R., & Friesen, W. V. (1969). Pan-cultural elements in facial displays of emotion. Science, 164(3875), 86?88. https://doi.org/10.1126/science.164.3875.86

Elfenbein, H. A. (2013). Nonverbal dialects and accents in facial expressions of emotion. Emotion Review, 5(1), 90?96. https://doi.org/10.1177/1754073912451332

Elfenbein, H. A., & Ambady, N. (2002). On the universality and cultural specificity of emotion recognition: A meta-analysis. Psychological Bulletin, 128(2), 203?235. https://doi.org/10.1037/0033-2909.128.2.203

Elfenbein, H. A., Beaupré, M., Lévesque, M., & Hess, U. (2007). Toward a dialect theory: Cultural differences in the expression and recognition of posed facial expressions. Emotion, 7(1), 131?146. https://doi.org/10.1037/1528-3542.7.1.131

Fang, X., Rychlowska, M., & Lange, J. (2022). Cross-cultural and inter-group research on emotion perception. Journal of Cultural Cognitive Science, 6(1), 1?7. https://doi.org/10.1007/ s41809-022-00102-2

Fang, X., Sauter, D. A., Heerdink, M. W., & van Kleef, G. A. (2022). Culture shapes the distinctiveness of posed and spontaneous facial expressions of anger and disgust. Journal of Cross-Cultural Psychology, 53(5), 471?487. https://doi.org/10.1177/00220221221095208

Fang, X., Sauter, D. A., & Van Kleef, G. A. (2018). Seeing mixed emotions: The specificity of emotion perception from static and dynamic facial expressions across cultures. Journal of Cross-Cultural Psychology, 49(1), 130?148. https://doi.org/10.1177/0022022117736270

Fang, X., van Kleef, G. A., Kawakami, K., & Sauter, D. A. (2021). Cultural differences in perceiving transitions in emotional facial expressions: Easterners show greater contrast effects than Westerners. Journal of Experimental Social Psychology, 95, 104143. https://doi.org/10.1016/ j.jesp.2021.104143

Fang, X., van Kleef, G. A., & Sauter, D. A. (2019). Revisiting cultural differences in emotion perception between easterners and westerners: Chinese perceivers are accurate, but see additional non-intended emotions in negative facial expressions. Journal of Experimental Social Psychology, 82, 152?159. https://doi.org/10.1016/j.jesp.2019.02.003

Faul, F., Erdfelder, E., Lang, A.-G., & Buchner, A. (2007). G*Power 3: A flexible statistical power analysis program for the social, behavioral, and biomedical sciences. Behavior Research Methods, 39(2), 175?191. https://doi.org/ 10.3758/BF03193146

Fiorentini, C., & Viviani, P. (2011). Is there a dynamic advantage for facial expressions? Journal of Vision, 11(3), 17. https://doi.org/10.1167/11.3.17

Giner-Sorolla, R., Kupfer, T., & Sabo, J. (2018). Chapter Five - What makes moral disgust special? An integrative functional review. In J. M. Olson (Ed.), Advances in experimental social psychology (Vol. 57, pp. 223?289). Academic Press. https://doi.org/10.1016/bs.aesp.2017.10.001

Gold, J. M., Barker, J. D., Barr, S., Bittner, J. L., Bromfield, W. D., Chu, N., Goode, R. A., Lee, D., Simmons, M., & Srinath, A. (2013). The efficiency of dynamic and static facial expression recognition. Journal of Vision, 13(5), 23?23. https://doi.org/10.1167/13.5.23

Gross, J. J., & Levenson, R. W. (1995). Emotion elicitation using films. Cognition and Emotion, 9(1), 87?108. https://doi.org/10.1080/02699939508408966

Hess, U., Kafetsios, K., Mauersberger, H., Blaison, C., & Kessler, C.-L. (2016). Signal and noise in the perception of facial emotion expressions: From labs to life. Personality and Social Psychology Bulletin, 42(8), 1092?1110. https://doi.org/10.1177/0146167216651851

Hoffmann, H., Traue, H. C., Bachmayr, F., & Kessler, H. (2010). Perceived realism of dynamic facial expressions of emotion: Optimal durations for the presentation of emotional onsets and offsets. Cognition and Emotion, 24(8), 1369?1376. https://doi.org/10.1080/02699930903417855

Izard, C. E. (2007). Basic emotions, natural kinds, emotion schemas, and a new paradigm. Perspectives on Psychological Science, 2(3), 260?280. https://doi.org/10.1111/ j.1745-6916.2007.00044.x

Jack, R. E., Blais, C., Scheepers, C., Schyns, P. G., & Caldara, R. (2009). Cultural confusions show that facial expressions are not universal. Current Biology, 19(18), 1543?1548. https://doi.org/10.1016/j.cub.2009.07.051

Jack, R. E., Garrod, O. G. B., & Schyns, P. G. (2014). Dynamic facial expressions of emotion transmit an evolving hierarchy of signals over time. Current Biology, 24(2), 187?192. https://doi.org/10.1016/j.cub.2013.11.064

Jiang, Z., Li, W., Recio, G., Liu, Y., Luo, W., Zhang, D., & Sun, D. (2014). Time pressure inhibits dynamic advantage in the classification of facial expressions of emotion. PLOS ONE, 9(6). https://doi.org/10.1371/journal.pone.0100162

Kang, S.-M., & Lau, A. S. (2013). Revisiting the out-group advantage in emotion recognition in a multicultural society: Further evidence for the in-group advantage. Emotion, 13(2), 203?215. https://doi.org/10.1037/a0030013

K?tsyri, J., Saalasti, S., Tiippana, K., von Wendt, L., & Sams, M. (2008). Impaired recognition of facial emotions from low-spatial frequencies in Asperger syndrome. Neuropsychologia, 46(7), 1888?1897. https://doi.org/10.1016/ j.neuropsychologia.2008.01.005

Kayyal, M. H., & Russell, J. A. (2013). Americans and Palestinians judge spontaneous facial expressions of emotion. Emotion, 13(5), 891?904. https://doi.org/10.1037/ a0033244

Krumhuber, E. G., Küster, D., Namba, S., & Skora, L. (2021). Human and machine validation of 14 databases of dynamic facial expressions. Behavior Research Methods, 53(2), 686?701. https://doi.org/10.3758/s13428-020-01443-y

Krumhuber, E. G., Skora, L. I., Hill, H. C. H., & Lander, K. (2023). The role of facial movements in emotion recognition. Nature Reviews Psychology, 2(5), 283?296. https://doi.org/10.1038/s44159-023-00172-1

Krumhuber, E. G., Skora, L., Küster, D., & Fou, L. (2017). A review of dynamic datasets for facial expression research. Emotion Review, 9(3), 280?292. https://doi.org/10.1177/ 1754073916670022

Matsumoto, D., & Ekman, P. (1988). Japanese and Caucasian facial expressions of emotion and neutral faces (JACFEE and JACNeuF) [Slides]: San Francisco, CA: Intercultural and Emotion Research Laboratory, Department of Psychology, San Francisco State University.

Matsumoto, D., & Ekman, P. (2004). The relationship among expressions, labels, and descriptions of contempt. Journal of Personality and Social Psychology, 87(4), 529?540. https://doi.org/10.1037/0022-3514.87.4.529

Matsumoto, D., Olide, A., Schug, J., Willingham, B., & Callan, M. (2009). Cross-cultural judgments of spontaneous facial expressions of emotion. Journal of Nonverbal Behavior, 33(4), 213?238. https://doi.org/10.1007/s10919-009-0071-4

Matsumoto, D., Olide, A., & Willingham, B. (2009). Is there an ingroup advantage in recognizing spontaneously expressed emotions? Journal of Nonverbal Behavior, 33(3), 181?191. https://doi.org/10.1007/s10919-009-0068-z

Matsumoto, D., & Willingham, B. (2009). Spontaneous facial expressions of emotion of congenitally and noncongenitally blind individuals. Journal of Personality and Social Psychology, 96(1), 1?10. https://doi.org/10.1037/a0014037

Matsumoto, D., Yoo, S. H., & Fontaine, J. (2008). Mapping expressive differences around the world: The relationship between emotional display rules and individualism versus collectivism. Journal of Cross-Cultural Psychology, 39(1), 55?74. https://doi.org/10.1177/0022022107311854

Namba, S., Kagamihara, T., Miyatani, M., & Nakao, T. (2017). Spontaneous facial expressions reveal new action units for the sad experiences. Journal of Nonverbal Behavior, 41(3), 203?220. https://doi.org/10.1007/s10919-017-0251-6

Namba, S., Makihara, S., Kabir, R. S., Miyatani, M., & Nakao, T. (2017). Spontaneous facial expressions are different from posed facial expressions: Morphological properties and dynamic sequences. Current Psychology, 36(3), 593?605. https://doi.org/10.1007/s12144-016-9448-9

Niedenthal, P. M., Rychlowska, M., Wood, A., & Zhao, F. (2018). Heterogeneity of long-history migration predicts smiling, laughter and positive emotion across the globe and within the United States. PLOS ONE, 13(8), e0197651. https://doi.org/10.1371/journal.pone.0197651

Oatley, K., & Johnson-Laird, P. N. (1987). Towards a cognitive theory of emotions. Cognition and Emotion, 1(1), 29?50. https://doi.org/10.1080/02699938708408362

Ortony, A. (2022). Are all “basic emotions” emotions? A problem for the (basic) emotions construct. Perspectives on Psychological Science, 17(1), 41?61. https://doi.org/ 10.1177/1745691620985415

Peirce, J., Gray, J. R., Simpson, S., MacAskill, M., H?chenberger, R., Sogo, H., Kastman, E., & Lindel?v, J. K. (2019). PsychoPy2: Experiments in behavior made easy. Behavior Research Methods, 51(1), 195?203. https://doi.org/ 10.3758/s13428-018-01193-y

Pochedly, J. T., Widen, S. C., & Russell, J. A. (2012). What emotion does the “facial expression of disgust” express? Emotion, 12(6), 1315?1319. https://doi.org/10.1037/a0027998

Rinn, W. E. (1991). Neuropsychology of facial expression. In R. S. Feldman & B. Rimé (Eds.), Fundamentals of nonverbal behavior (pp. 3?30). Cambridge University Press.

Rychlowska, M., Miyamoto, Y., Matsumoto, D., Hess, U., Gilboa-Schechtman, E., Kamble, S., Muluk, H., Masuda, T., & Niedenthal, P. M. (2015). Heterogeneity of long-history migration explains cultural differences in reports of emotional expressivity and the functions of smiles. Proceedings of the National Academy of Sciences, 112(19), E2429?E2436. https://doi.org/10.1073/pnas.1413661112

Sato, W., Fujimura, T., & Suzuki, N. (2008). Enhanced facial EMG activity in response to dynamic facial expressions. International Journal of Psychophysiology, 70(1), 70?74. https://doi.org/10.1016/j.ijpsycho.2008.06.001

Scherer, K. R., Clark-Polner, E., & Mortillaro, M. (2011). In the eye of the beholder? Universality and cultural specificity in the expression and perception of emotion. International Journal of Psychology, 46(6), 401?435. https://doi.org/10.1080/00207594.2011.626049

Siedlecka, E., & Denson, T. F. (2019). Experimental methods for inducing basic emotions: A qualitative review. Emotion Review, 11(1), 87?97. https://doi.org/10.1177/1754073917749016

Simmons, J. P., Nelson, L. D., & Simonsohn U. (2013, January). Life after p-hacking. Paper presented at the Meeting of the Society for Personality and Social Psychology, New Orleans, LA, 17-19. https://ssrn.com/ abstract=2205186 or http://dx.doi.org/10.2139/ssrn.2205186

Tcherkassof, A., Bollon, T., Dubois, M., Pansu, P., & Adam, J.-M. (2007). Facial expressions of emotions: A methodological contribution to the study of spontaneous and dynamic emotional faces. European Journal of Social Psychology, 37(6), 1325?1345. https://doi.org/10.1002/ejsp.427

Tsai, J. L., & Chentsova-Dutton, U. (2003). Variation among European Americans in emotional facial expression. Journal of Cross-Cultural Psychology, 34(6), 650?657. https://doi.org/10.1177/0022022103256846

Valente, D., Theurel, A., & Gentaz, E. (2018). The role of visual experience in the production of emotional facial expressions by blind people: A review. Psychonomic Bulletin & Review, 25(2), 483?497. https://doi.org/ 10.3758/ s13423-017-1338-0

Van Kleef, G. A., & C?té, S. (2022). The social effects of emotions. Annual Review of Psychology, 73(1), 629?658. https://doi.org/10.1146/annurev-psych-020821-010855

Wehrle, T., Kaiser, S., Schmidt, S., & Scherer, K. R. (2000). Studying the dynamics of emotional expression using synthesized facial muscle movements. Journal of Personality and Social Psychology, 78(1), 105?119. https://doi.org/ 10.1037/0022-3514.78.1.105

Widen, S. C., Christy, A. M., Hewett, K., & Russell, J. A. (2011). Do proposed facial expressions of contempt, shame, embarrassment, and compassion communicate the predicted emotion? Cognition and Emotion, 25(5), 898?906. https://doi.org/10.1080/02699931.2010.508270

Wood, A., Rychlowska, M., & Niedenthal, P. M. (2016). Heterogeneity of long-history migration predicts emotion recognition accuracy. Emotion, 16(4), 413?420. https://doi.org/ 10.1037/emo0000137

Yitzhak, N., Gilaie-Dotan, S., & Aviezer, H. (2018). The contribution of facial dynamics to subtle expression recognition in typical viewers and developmental visual agnosia. Neuropsychologia, 117, 26?35. https://doi.org/10.1016/ j.neuropsychologia.2018.04.035

Zhang, Q., Yin, T. Z., & Ran, G. M. (2015). Psychological and neural mechanisms for the superiority effect of dynamic facial expressions. Advances in Psychological Science, 23(9), 1514?1522.

[张琪, 尹天子, 冉光明. (2015). 动态面孔表情优势效应的心理机制及神经基础. 心理科学进展, 23(9), 1514?1522.]

Zhang, Q. Y., Chen, J. W., Yu, Q. L., & Xin, P. (2011). An in-group advantage in recognizing emotion. Advances in Psychological Science, 19(2), 209?216.

[张秋颖, 陈建文, 于全磊, 辛鹏. (2011). 情绪识别中的群内优势效应. 心理科学进展, 19(2), 209?216.]

Zhang, X., Yin, L., Cohn, J. F., Canavan, S., Reale, M., Horowitz, A., Liu, P., & Girard, J. M. (2014). BP4D- Spontaneous: A high-resolution spontaneous 3D dynamic facial expression database. Image and Vision Computing, 32(10), 692?706. https://doi.org/10.1016/j.imavis.2014.06.002

The impact of spontaneity and presentation mode on the ingroup advantage

in recognizing angry and disgusted facial expressions

FANG Xia, GE Youxun

(Department of Psychology and Behavioral Sciences, Zhejiang University, Hangzhou 310058, China)

Abstract

With the acceleration of globalization, effective cross-cultural communication has become increasingly important in modern society. One significant aspect of this communication involves accurately interpreting facial expressions of emotion. Previous research has found that nonverbal emotional communication is compromised when communication occurs between individuals from different cultural backgrounds compared to within cultural groups. Specifically, individuals are more accurate at recognizing facial expressions of individuals from their own cultural background than those from a different cultural background, a phenomenon known as ingroup advantage effect. However, most previous studies examining the ingroup advantage in facial expression recognition have focused primarily on posed and static facial expressions, paying less attention to spontaneous and dynamic facial expressions. Given that facial expressions in real-life interactions are often spontaneous and dynamic, it is imperative to investigate whether the ingroup advantage is influenced by the spontaneity (posed and spontaneous) and presentation mode (static and dynamic) of facial expressions.

To address these research objectives, we conducted two experiments involving participants from China, Canada, and the Netherlands. In Experiment 1, Chinese and Canadian participants were asked to recognize posed and spontaneous facial expressions of anger and disgust displayed by Chinese and Dutch models. In Experiment 2, Chinese and Dutch participants were recruited to recognize static and dynamic facial expressions of anger and disgust displayed by Chinese and Dutch models. Specifically, Experiment 1 included 126 Chinese participants and 126 Canadian participants, while Experiment 2 involved 82 Chinese participants and 75 Dutch participants. In both experiments, participants were asked to rate the intensity of facial expressions on scales of anger, disgust, fear, sadness, and joy ranging from 0 (not at all) to 100 (extremely).

The results indicated that the ingroup advantage was influenced by the spontaneity of the facial expressions. In three out of four cases (Eastern perceivers recognizing facial expressions of anger and disgust, and Western perceivers recognizing facial expressions of disgust), posed expressions exhibited a stronger ingroup advantage compared to spontaneous expressions. The exception was Western perceivers demonstrating a greater ingroup advantage when recognizing spontaneous facial expressions of anger. Furthermore, the findings revealed that the ingroup advantage was not influenced by the presentation mode of the facial expressions. In three out of four cases (Eastern perceivers recognizing facial expressions of anger and disgust, and Western perceivers recognizing facial expressions of disgust), there was no significant difference in the ingroup advantage between static and dynamic expressions. The only exception was Western perceivers' recognition of static expressions of anger, where the ingroup advantage was greater than that for dynamic expressions of anger.

In conclusion, the present research demonstrated that the ingroup advantage was more pronounced in posed expression recognition compared to spontaneous expression recognition, while the presentation mode of the expressions did not influence the ingroup advantage. These findings contribute to the existing knowledge in the field of cross-cultural emotion recognition by revealing differences in the ingroup advantage between posed and spontaneous expressions. Consequently, these results provide new empirical contributions that enhance our understanding of how individuals recognize expressions displayed by individuals from different cultural backgrounds.

Keywords facial expression recognition, ingroup advantage, posed and spontaneous facial expressions, static and dynamic facial expressions, culture difference

附录

补充材料1:实验1中对表情识别正确率的分析

对实验1各条件下的表情识别正确率进行单样本t检验(见附表1), 以检验表情识别正确率是否大于随机水平(即1/5个情绪维度 = 0.2)。结果发现, 大部分条件下的表情识别正确率均显著大于0.2, 这表明被试均能以高于随机水平的概率识别目标情绪。然而, 当西方感知者识别东方表达者的自发气愤表情时, 识别正确率与0.2差异不显著, 说明西方感知者可能难以识别东方表达者的自发气愤表情。

对表情识别正确率进行2 (表情种类:气愤、厌恶) × 2 (表情自发性:表演、自发) × 2 (表达者文化:东方、西方) × 2 (感知者文化:东方、西方)四因素混合设计方差分析(见附表2)。结果显示, 感知者文化的主效应显著, F(1, 248) = 21.08, p < 0.001, ηp2 = 0.08, 西方感知者的表情识别正确率(M = 0.39, SD = 0.16)显著大于东方感知者的表情识别正确率(M = 0.34, SD = 0.10); 表达者文化的主效应显著, F(1, 248) = 27.18, p < 0.001, ηp2 = 0.10, 被试对西方表达者的表情识别正确率(M = 0.38, SD = 0.15)显著大于对东方表达者的表情识别正确率(M = 0.35, SD = 0.14); 表情自发性的主效应显著, F(1, 248) = 295.42, p < 0.001, ηp2 = 0.54, 被试对表演表情的表情识别正确率(M = 0.46, SD = 0.12)显著大于对自发表情的表情识别正确率(M = 0.27, SD = 0.07); 表情种类的主效应显著, F(1, 248) = 8.87, p = 0.003, ηp2 = 0.04, 被试对厌恶表情的表情识别正确率(M = 0.38, SD = 0.17) 显著大于对气愤表情的表情识别正确率(M = 0.35, SD = 0.15)。

与假设相关的表情自发性 × 表达者文化 × 感知者文化的三阶交互作用显著, F(1, 248) = 31.34, p < 0.001, ηp2 = 0.11, 且表情种类 × 表情自发性 × 表达者文化 × 感知者文化的四阶交互作用也显著, F(1, 248) = 4.02, p = 0.046, ηp2 = 0.02。进一步分析发现, 在所有条件下, 西方感知者对西方表达者的表情识别正确率均大于东方表达者(表演气愤:t(61) = 2.55, p = 0.013, Cohens d = 0.32, 95% CI = [0.01, 0.06]; 表演厌恶:t(61) = 9.86, p < 0.001, Cohens d = 1.25, 95% CI = [0.11, 0.17]; 自发气愤:t(63) = 7.84, p < 0.001, Cohens d = 0.98, 95% CI = [0.07, 0.12]; 自发厌恶:t(63) = 3.43, p = 0.001, Cohens d = 0.43, 95% CI = [0.02, 0.06])。对于东方感知者来说, 他们对东方表达者的表演表情识别正确率大于西方表达者的表演表情(表演气愤:t(61) = 6.50, p < 0.001, Cohens d = 0.83, 95% CI = [0.06, 0.11]; 表演厌恶:t(61) = 4.38, p < 0.001, Cohens d = 0.56, 95% CI = [0.03, 0.08])。然而, 他们对东方表达者的自发气愤表情的识别正确率小于西方表达者的自发气愤表情, t(63) = 3.48, p < 0.001, Cohens d = 0.44, 95% CI = [0.02, 0.08], 对东方表达者的自发厌恶表情的识别正确率与西方表达者的自发厌恶表情无显著差异, t(63) = 1.47, p = 0.147, Cohens d = 0.18, 95% CI = [?0.01, 0.04]。

补充材料2:实验2中对表情识别正确率的分析

对各条件下静态表情的表情识别正确率进行单样本t检验(见附表3), 以检验表情识别正确率是否大于随机水平(即1/4个情绪维度 = 0.25)。结果发现, 大部分条件下静态表情的表情识别正确率均显著大于0.25, 这表明被试均能以高于随机水平的概率识别目标情绪。

对表情识别正确率进行2 (表情种类:气愤、厌恶) × 2 (呈现方式:动态、静态) × 2 (表达者文化:东方、西方) × 2 (感知者文化:东方、西方)的四因素混合设计方差分析(见附表4)。结果显示, 感知者文化的主效应显著, F(1, 277) = 99.74, p < 0.001, ηp2 = 0.27, 西方感知者的表情识别正确率(M = 0.53, SD = 0.10)显著大于东方感知者的表情识别正确率(M = 0.41, SD = 0.09); 表达者文化的主效应显著, F(1, 277) = 18.87, p < 0.001, ηp2 = 0.06, 被试对西方表达者的表情识别正确率(M = 0.48, SD = 0.15) 显著大于对东方表达者的表情识别正确率(M = 0.46, SD = 0.10); 呈现方式的主效应不显著, F(1, 277) = 2.35, p = 0.126; 表情種类的主效应边缘显著, F(1, 277) = 3.77, p = 0.053, ηp2 = 0.01。

与假设相关的呈现方式 × 表达者文化 × 感知者文化的三阶交互作用不显著, F(1, 277) = 2.52, p = 0.113, ηp2 = 0.01, 但是表达者文化 × 感知者文化的二阶交互作用显著, F(1, 277) = 345.35, p < 0.001, ηp2 = 0.56。东方感知者对东方表达者的识别正确率(M = 0.45, SD = 0.10)显著大于西方表达者(M = 0.38, SD = 0.10), t(143) = 10.64, p < 0.001, Cohens d = 0.89, 95% CI = [0.69, 1.08]; 西方感知者对西方表达者的识别正确率(M = 0.59, SD = 0.12)显著大于东方表达者(M = 0.48, SD = 0.10), t(136) = 15.31, p < 0.001, Cohens d = 1.31, 95% CI = [1.08, 1.54], 表明东西方感知者识别表演表情时均会出现群内优势效应。

为了考察表情的不同呈现方式对表情识别是否有影响, 我们还关注了与呈现方式相关的效应。尽管呈现方式主效应不显著, F(1, 277) = 2.35, p = 0.126, 但是呈現方式 × 表达者文化的二阶交互作用, F(1, 277) = 7.44, p = 0.007, ηp2 = 0.03, 以及表情种类 × 呈现方式 × 表达者文化的三阶交互作用, F(1, 277) = 4.81, p = 0.029, ηp2 = 0.02, 均显著。对该三阶交互作用进一步分析发现, 除了西方表达者的气愤表情外, 其余情况下的静态表情(东方气愤:M = 0.47, SD = 0.14; 东方厌恶:M = 0.45, SD = 0.14; 西方厌恶:M = 0.50, SD = 0.19)和动态表情(东方气愤:M = 0.45, SD = 0.14; 东方厌恶:M = 0.47, SD = 0.15; 西方厌恶:M = 0.51, SD = 0.19)的识别正确率均没有显著差异(东方气愤:t(279) = 1.29, p = 0.200; 东方厌恶:t(279) = 0.68, p = 0.495; 西方厌恶:t(279) = 0.55, p = 0.582)。对于西方表达者的气愤表情而言, 静态表情的识别准确率(M = 0.49, SD = 0.18)显著大于动态表情(M = 0.42, SD = 0.17), t(279) = 3.11, p = 0.002, Cohens d = 0.37, 95% CI = [0.14, 0.61]。

补充材料3:剔除表情识别正确率过低的被试后的群内优势效应分析

在实验1中, 我们剔除了表情识别正确率低于平均值减去2.5倍标准差(M ? 2.5 SD)的被试, 剩余249名被试进行了分析。我们同样对群内优势效应进行了2 (表情种类:气愤、厌恶) × 2 (表情自发性:表演、自发) × 2 (感知者文化:东方、西方)三因素混合设计方差分析。结果显示剔除被试前后的分析结果相似(见附表5)。

在实验2中, 我们同样剔除了表情识别正确率低于平均值减去2.5倍标准差(M ? 2.5 SD)的被试, 剩余277名被试纳入了分析。我们对群内优势效应进行了2 (表情种类:气愤、厌恶) × 2 (表情自发性:表演、自发) × 2 (感知者文化:东方、西方)三因素混合设计方差分析。结果显示剔除被试前后的分析结果相似(见附表6)。

- 心理学报的其它文章

- 知觉学习中非显著性刺激视觉加工的学习机制