基于渐进式生成对抗网络的农作物病虫害

邓昀 冯琦尧 牛照文 康燕萍

摘要:随着深度学习应用的普及和飞速发展,基于深度学习的图像识别方法广泛应用于农作物病虫害领域,但大部分的神经网络重视识别准确率的提高,却忽略神经网络庞大的参数计算量。为解决这个问题,基于渐进式生成对抗网络判别器模型和卷积注意力模块,提出一种改进的渐进式生成对抗网络判别器CPDM网络模型对农作物病虫害进行识别。通过对渐进式生成对抗网络判别器网络结构的调整,采用均衡学习率、像素级特征向量归一化和卷积注意力模块增强CPDM网络模型的特征提取能力,提高对真实图片的识别准确率。试验在PlantVillage数据集上进行,将该模型与VGG16、VGG19和ResNet18进行比较,得到TOP-1准确率分别为99.06%、96.50%、96.65%、98.86%,分别提高2.56%、2.41%、0.2%,且参数量仅为8.2 M。试验证明提出的CPDM网络模型满足在保证分类准确率的基础上,有效控制神经网络参数计算量的目的。

关键词:农作物病虫害;渐进式生成对抗网络;卷积注意力模块;细粒度分类

中图分类号:S435: TP391 文献标识码:A 文章编号:2095-5553 (2024) 03-0156-08

Fine-grained classification of crop diseases and pests based on progressive growing of GANs

Deng Yun1, 2, Feng Qiyao1, 2, Niu Zhaowen1, 2, Kang Yanping1, 2

(1. School of Information Science and Engineering, Guilin University of Technology, Guilin, 541004, China;2. Guangxi Key Laboratory of Embedded Technology and Intelligent System, Guilin, 541004, China)

Abstract:

With the popularity and rapid development of deep learning applications, image recognition methods based on deep learning are widely used in the field of crop diseases and insect pests. However, most neural networks attach importance to the improvement of recognition accuracy, but ignore the huge parameter computation amount of neural networks. In order to solve this problem, based on the progressive growing of GANs discriminator model and convolutional attention module. an improved CPDM network model was proposed to identify crop pests and diseases. By adjusting the network structure of the progressive growing of GANs discriminator, the feature extraction capability of CPDM network model was enhanced by using balanced learning rate, pixel-level feature vector normalization and convolutional attention module, and the recognition accuracy of real images was improved. The experiment was carried out on the PlantVillage dataset, and compared with VGG16, VGG19 and ResNet18, the TOP-1 accuracy was 99.06%, 96.50%, 96.65% and 98.86%, respectively, which was improved by 2.56%, 2.41% and 0.2%, respectively. And the number of parameters was only 8.2 M. The experimental results show that the proposed CPDM network model meets the purpose of effectively controlling the calculation amount of neural network parameters on the basis of ensuring the classification accuracy.

Keywords:crop diseases and pests; progressive growing of GANs; CBAM; fine-grained classification

0 引言

農作物病虫害作为对农作物产量和质量危害最大的影响因素之一,每年造成的农业经济损失可达20%~50%[1]。如何有效地发现及预防农作物病害成为农作物病害防治工作的重要环节。基于人工的识别方法对人力和物力都产生了巨大的消耗,造成了严重的经济负担[2]。随着深度学习算法的逐渐兴起,如何利用深度学习算法快速有效地识别农作物病虫害成为相关研究者的新方向。

Mohanty等[3]在2016年利用GoogleNet卷积神经网络,通过使用迁移学习对模型进行训练,共分析了14种农作物包括26类病害的共54306幅农作物病害图像,证明了深度学习神经网络模型可以同时识别多类农作物病虫害的图像数据;Lü等[4]基于Alex Net网络,使用批量归一化、PRelu激活函数等提高网络收敛性,避免过拟合,并结合使用了拓展卷积和多尺度卷积以提高网络特征提取能力,证明对特征增强的算法可以有效地提高网络对特征的提取能力,提升识别准确率;Pandian等[5]利用基于图像处理和深度学习的图像增强技术对农作物病害数据集进行增强,并通过使用利用迁移学习技术的对抗生成网络和神经样式转移对数据集进行扩充和增强,试验结果表明,使用这种增强方式的数据集可以获得更高准确率;Zeng等[6]利用深度卷积生成对抗网络将原始训练数据集增加了2倍,采用Inception_v3模型进行识别,平均准确率为92.60%,比利用原始训练数据集训练的识别准确率提高近20%,证明了使用深度卷积生成对抗网络生成的数据集具有更加明显的特征;项小东等[7]基于Xception,提出一种采用带有通道分配权重的多尺度深度卷积与组卷积结合的通道扩增模块,并且对网络结构采取了通道扩张—保持—再扩张—压缩的策略,引入密集连接方式,对10种农作物的50类病害图像进行分类,试验证明这种对通道权重进行重分配的方式可以在特征提取上有更好的效果;王美华等[8]通过对CBAM注意力机制的改进,将通道注意力和空间注意力原本的串联连接改为了并联连接,并通过试验证明了并联的连接方式可以对农作物病虫害细粒度分类产生更高的准确率。

深度学习卷积神经网络的高速发展与应用为农作物病虫害识别带来了新的解决问题的方式。近年来GANs的广泛流行为研究学者提供了新的解决问题的思路[9]。渐进式生成对抗网络(Progressive Growing of GANs,ProGAN)[10]作为较为成熟的GANs[11],相较于之前的GANs,可以生成更高质量的图像,且训练过程趋于稳定。因为其稳定的训练过程和对图像特征的学习能力,本文以ProGAN判别器采用图像像素级别的识别方法[12]进行农作物病害分类,通过对网络结构的调整,使用像素级别的特征向量归一化以及卷积注意力模块(Convolutional Block Attention Module,CBAM)[13]对ProGAN判别器进行优化,主要针对农作物病虫害数据集子类别类间差异小、类内差异大的特点进行研究,本文使用弱监督细粒度图像算法[14],设计CPDM网络模型对农作物病虫害进行细粒度分类。

1 试验材料与方法

1.1 数据预处理

本文使用的图像数据集为PlantVillage农作物病虫害数据集,其中包括苹果、葡萄、小麦、马铃薯等14种作物共38个病害类别共有54 303张健康和病害图片。部分农作物病虫害数据集图像及标签如图1所示。

为能够更好地训练模型,防止过拟合,提高网络模型的鲁棒性,通过数据增强策略扩充数据集。首先对数据图像进行训练集和测试集的划分,按照8∶2的比例划分为训练集和测试集,之后对训练集数据图像采取水平镜像操作,扩充到81 454张图片,作为扩充后的训练集。最后对数据图像的分辨率大小进行重构,统一为256×256分辨率大小,之后按照均值和标准差来标准化图像。

1.2 研究方法

1.2.1 渐进式生成对抗网络

渐进式生成对抗网络(ProGAN)作为较为成熟的GAN网络,其主要思想为渐进式,即对数据图像进行从低分辨率图像逐渐增长到高分辨率图像的特征学习。ProGAN的实验原理是在生成器生成相应分辨率的图片后,判别器会搭建相应的网络结构对生成图片进行判断。以1 024×1 024分辨率图片为例,ProGAN判别器结构如表1所示。

其中WE_Conv为经过初始化权重的卷积层,LRelu为LeakyRelu激活函數[15],Downsample为下采样,Avg_Pool为均值池化。通过均衡学习率[16]来保证每个权重都有相同的动态范围,公式如式(1)所示。

Wf=Wi×2k×k×θ(1)

式中:Wf——该层通道权重;Wi——初始化权重;k——该层卷积核分辨率;θ——该层归一化常数。

通过这种方法,确保所有权重拥有相同的动态范围和学习率。

ProGAN在生成器训练过程中摒弃了批标准化,而是采用一种像素级别的特征向量归一化来对图像进行像素归一化。为了避免生成器和判别器中的像素幅度由于竞争而失控,在每个卷积层之后将每个像素在生成器中的特征向量规范化为统一的长度,因此使用局部响应规范化,公式如式(2)所示。

bx,y=ax,y1M∑M-1j=0(ajx,y)2+ε(2)

式中:M——特征映射通道数;a、b——图像在x、y位置时的像素值;ε——恒值,ε为10-8。

基于像素级特征的特征向量归一化可以有效地限制像素特征的幅度变化范围,对像素级别的特征变化更加敏感,加深全局特征与局部特征的关联性。

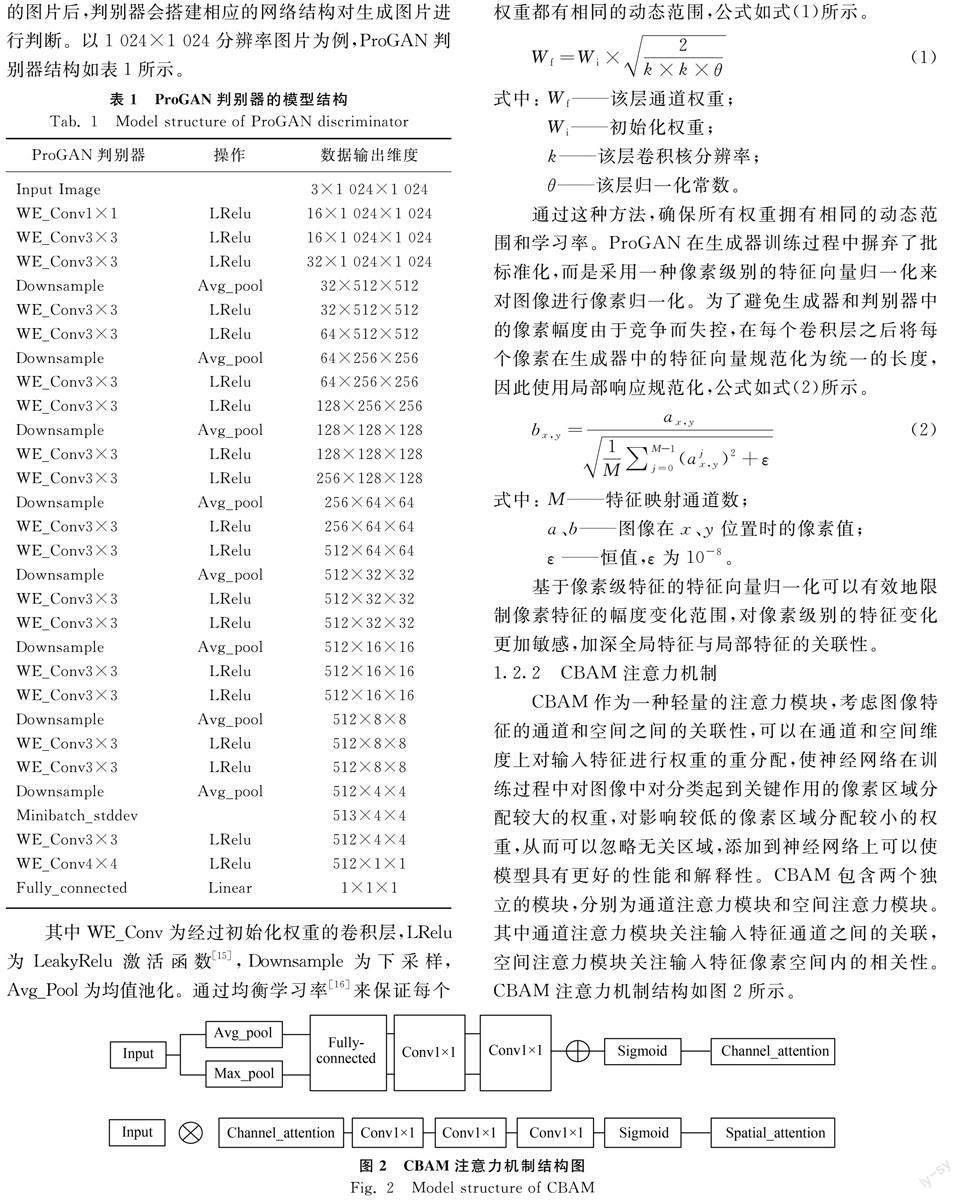

1.2.2 CBAM注意力机制

CBAM作为一种轻量的注意力模块,考虑图像特征的通道和空间之间的关联性,可以在通道和空间维度上对输入特征进行权重的重分配,使神经网络在训练过程中对图像中对分类起到关键作用的像素区域分配较大的权重,对影响较低的像素区域分配较小的权重,从而可以忽略无关区域,添加到神经网络上可以使模型具有更好的性能和解释性。CBAM包含两个独立的模块,分别为通道注意力模块和空间注意力模块。其中通道注意力模块关注输入特征通道之间的关联,空间注意力模块关注输入特征像素空间内的相关性。CBAM注意力机制结构如图2所示。

图2中,SymbolEC@表示基于张量的加和操作,SymbolDC@表示特征之间的加权运算。特征图像通过CBAM注意力机制的处理后,加深新得到的特征图像的通道特征和空间特征的联系,能够有效地提高网络特征提取的能力。

1.2.3 CPDM网络模型

考虑试验的实际情况,对农作物病害进行分类不需要从低分辨率到高分辨率渐进式地学习特征,这种渐进式的学习只会增加网络参数,不能在图像分类方面产生较好的效果,因此舍弃生成器,直接使用判别器进行农作物病虫害图片的特征学习与分类。考虑到试验数据集PlantVillage中所有图片分辨率被统一为256像素×256像素,对原判别器进行改动。

使用CBAM注意力机制、均衡学习率和像素级别的特征向量归一化来完成对特征图像像素空间的注意力分配、重分配的过程,不断地更新像素空间特征的权重,即通过CBAM注意力对通道特征和空间特征权重的重分配后,使用均衡学习率对特征图像的空间特征进行权重动态范围的更新,并对每个卷积层的输出特征图像进行像素级别的特征向量归一化。

CPDM网络模型整体结构如图3所示,根据原ProGAN判别器结构,图片输入后会分别进入两个网络分支进行训练,图3中网络左分支对数据图像进行卷积操作,网络右分支则进行下采样操作(Downsample),最后由淡入(Fade In)操作对特征图像进行点加操作,如式(3)所示。

F=α×Lnew+(1-α)×Downsample(Lold)(3)

式中:F——淡入后特征图像;α——当前网络层的权重;Lnew——网络左分支训练得到的新的特征图像;Lold——输入数据图像。

α设置为默认值0.2。为避免参数混淆,将下采样Downsample中的平均池化操作改为最大池化操作。

由图3可见,为能够加快网络收敛,提升梯度下降的效果,同时防止过拟合并提高网络模型的鲁棒性,特征图像在淡入操作后会进行批量归一化(Batch Normalization)操作[17]。

为能够更好地突出CBAM注意力机制对像素级权重的分配表现,本文使用搭载了均衡学习率的WEConv和普通的卷积层与像素级特征向量归一化共同搭建了一个卷积模块Conv_Block,其结构如图4所示,特征图像在经过WEConv后,通过LeakyRelu激活函数,进行第一次像素级的特征向量归一化,之后通过卷积层Conv,再进行一次像素级的特征向量归一化,以达到网络反向传播时可以更好地初始化卷积层权重的目的。并将WE_Conv卷积层的卷积核尺寸改为1×1[18, 19],保留了特征图的像素信息的同时进行升维,扩充网络通道,有效地减少了网络参数。

为能够进一步提高网络反向传播时对权重的分配能力,本文在集成的卷积网络层Conv_Block_List中,在每一个Conv_Block前面添加了CBAM注意力机制,以提高网络对权重的分配,为了避免参数混淆,将平均池化(Average Pooling)改为最大池化(Max Pooling),如图5所示,按照这种结构共搭建5个网络层,加强对数据图像像素级特征的提取能力。

特征图像在经过Conv_Block_List后,经由小批量标准偏差(Minibatch Standard Deviation),通过计算小批量上像素空间上的特征的标准差后,对所有的标准差值进行平均得到一个值,并将该值连接到每一个小批量的空间特征上,从而产生了一个额外的特征图像。为了底层神经网络可以更好地提取特征,最后输出特征图保留特征维度为4×4。以试验图像数据分辨率为256像素×256像素为标准,详细的CPDM网络结构及操作如表2所示。

2 试验结果分析

2.1 试验环境

试验环境使用Python3.6,深度学习框架Pytorch10.2,Cuda10.2,操作系统为Windows10。CPU为Intel(R) Core(TM) i7-7820X CPU @ 3.60 GHz,GPU为NVIDIA GeForce RTX 2070,显存8 GB。在模型训练环节,以每批次8张图像为基准,选取随机批次的图像进行训练,共训练20次。选取优化器为随机梯度下降优化算法,损失函数为交叉熵损失函数。学习率为0.001。

2.2 评价标准与损失函数

本文选择TOP-1准确率作为试验部分的评价标准。TOP-1准确率将会根据神经网络输出的特征向量,选取特征向量中得分最高的类别与真实类别进行判断,如果相等则为真,否则为否,最后对每个类别样本进行统计,输出每个类别的准确率。

本文选择交叉熵函数作为CPDM网络模型训练的损失函数。交叉熵函数通常用来对比两个分布的异同程度,应用在深度学习神经网络训练中可以衡量真实数据概率分布和预测数据概率分布的异同。一般来说,得到的交叉熵值越小,则训练出的神经网络收敛性越好,神经网络的预测性能越高。交叉熵损失函数的公式如式(4)所示。

Loss=-1N∑i∑Cc=1yiclog(pic)(4)

式中:Loss——损失值;N——样本总数;C——类别总数;yic——第i个样本类别c的标签;pic——第i个样本类别c的概率。

2.3 结果与分析

原ProGAN判別器模型的应用在于对生成器生成图像的真伪判断,由于本文使用的图像数据集中的图片的分辨率统一为256像素×256像素,所以为了能让原ProGAN判别器模型适用于试验数据集,对其进行了网络结构上的调整,通过对卷积层和下采样的删减,确保最后全连接层的输出格式大小不变,改变其全连接层输出通道为38,以适应农作物病虫害分类问题。使用本文提出的CPDM网络模型与原ProGAN判别器模型,在农作物病虫害数据集PlantVillage上分别进行训练,得到TOP-1准确率以及损失值并进行对比,以证明CPDM在农作物病虫害分类上的可行性。

由图6、图7可见,本文提出的CPDM模型比较原ProGAN判别器更适合对图像进行分类,CPDM网络模型在农作物病虫害分类上的表现明显优于原ProGAN判别器网络模型。CPDM网络模型在第5次训练中就可以达到95%的TOP-1准确率,并开始逐渐拟合。而原ProGAN判别器模型在训练结束20次后,TOP-1准确率仅可达42%,且训练梯度较低,拟合过程较慢。由此证明了改进后的ProGAN判别器模型的可行性。

為进一步验证CPDM网络模型的可行性,本文使用VGG16、VGG19[20]、ResNet18[21]与CPDM网络模型进行对比试验。在农作物病虫害数据集PlantVillage上分别进行训练,得到TOP-1准确率和损失值并进行对比,同时证明CPDM网络模型的优越性。

从图8可以看出,CPDM网络模型确实保持了一定的优越性。

第一次训练过程,CPDM网络模型表现优于VGG16和VGG19,差于ResNet18,TOP-1准确率可达67.6%,优于VGG16和VGG19的50.9%和58.5%TOP-1准确率,比ResNet18的76.9%TOP-1准确率相差9.3%。但是从第三次训练过程后,CPDM网络模型的TOP-1准确率开始超过ResNet18,TOP-1准确率可以达到91.5%,比ResNet18的88.9%TOP-1准确率高了2.6%。并且在之后的训练过程中,CPDM网络模型基本可以保持对ResNet18、VGG16和VGG19在TOP-1准确率上的领先。

结合图9可以看出,CPDM网络模型的损失值曲线下降明显。虽然第一次训练过程得到的损失值高于ResNet18,但是CPDM网络模型损失值下降的梯度较优,对随机梯度下降的适应要优于ResNet18,损失值下降较快,且相较于ResNet18的损失值曲线更加稳定,网络的鲁棒性较优。以此证明了CPDM网络模型的优越性。

2.4 参数分析

为进一步证明CPDM网络模型的优越性,本文使用VGG16、VGG19、ResNet18和原ProGAN判别器模型与CPDM网络模型进行参数对比。原ProGAN判别器的参数有23.1 M,由于本文根据图像数据分辨率对其结构进行了调整,使其网络参数量下降为20.7 M。网络参数对比结果如表3所示。

由表4可知,VGG19的TOP-1准确率比VGG16提高了0.15%,其中的原因和VGG19的网络参数量比VGG16多有关,而本文试验设计的CPDM网络模型在网络参数上,比原ProGAN判别器的参数量减少了60%,与VGG16和VGG19高达134.4 M和139.7 M的参数量相比,减少的较明显。本文对比试验重点是与ResNet18的比较,在TOP-1准确率的比较上,CPDM网络模型比ResNet18高0.2%;但是在参数量的比较上,CPDM的参数量要比ResNet18减少3 M。试验证明,CPDM网络模型在保证准确率的基础上,有效控制网络参数计算量的目的。

3 结论

1) 本文通过对ProGAN在农作物病虫害分类问题上的可行性分析,因其优越的特征学习和稳定的训练过程,选取ProGAN判别器模型进行农作物病虫害分类,设计了CPDM网络模型。通过均衡学习率配合使用CBAM注意力机制,并使用像素级特征向量归一化的方式对特征权重进行重分配。并针对其网络结构,通过增加1×1卷积,改变卷积层,调整全连接层,降低通道数量的方式调整网络结构,减少网络参数量。并与VGG16、VGG19、ResNet18和原ProGAN判别器模型进行对比试验。

2) 通过试验,验证了均衡学习率、CBAM注意力机制和像素级特征向量归一化结合使用对模型性能的实际提升能力。特征图在经过CBAM注意力机制和像素级特征向量归一化后,可以有效地提升通道特征和空间特征的相关性,提升了对有效特征的提取能力。配合使用均衡学习率,可以使神经网络在训练时更加稳定。

3) 通过试验对比,CPDM网络模型可以在PlantVillage农作物病虫害数据集上达到99.06%的TOP-1准确率,且CPDM网络模型总参数量8.2 M,实际参数大小为32.84 MB。与VGG16、VGG19和ResNet18进行对比,验证了本文设计的CPDM网络模型整体性能更优。试验证明,CPDM网络模型实现了在获得较高识别准确率的同时,减少网络参数计算量的目的。

参 考 文 献

[1]Barbedo J. Factors influencing the use of deep learning for plant disease recognition [J]. Biosystems Engineering, 2018, 172: 84-91.

[2]翟肇裕, 曹益飞, 徐焕良, 等. 农作物病虫害识别关键技术研究综述[J]. 农业机械学报, 2021, 52(7): 1-18.Zhai Zhaoyu, Cao Yifei, Xu Huanliang, et al. Review of key techniques for crop disease and pest detection [J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(7): 1-18.

[3]Mohanty S P, Hughes D P, Salathe M. Using deep learning for image-based plant disease detection [J]. Frontiers in Plant Science, 2016, 7.

[4]Lü M, Zhou G, He M, et al. Maize leaf disease identification based on feature enhancement and DMS-Robust Alexnet [J]. IEEE Access, 2020, 8: 57952-57966.

[5]Pandian J A, Geetharamani G, Annette B. Data augmentation on plant leaf disease image dataset using image manipulation and deep learning techniques [C]. 2019 IEEE 9th International Conference on Advanced Computing (IACC). IEEE, 2019: 199-204.

[6]Zeng Q, Ma X, Cheng B, et al. Gans-based data augmentation for citrus disease severity detection using deep learning [J]. IEEE Access, 2020, 8: 172882-172891.

[7]项小东, 翟蔚, 黄言态, 等. 基于Xception-CEMs神经网络的植物病害识别[J]. 中国农机化学报, 2021, 42(8): 177-186.Xiang Xiaodong, Zhai Wei, Huang Yantai, et al. Plant disease recognition based on Xception-CEMs neural network [J]. Journal of Chinese Agricultural Mechanization, 2021, 42(8): 177-186.

[8]王美华, 吴振鑫, 周祖光. 基于注意力改进CBAM的农作物病虫害细粒度识别研究[J]. 农业机械学报, 2021, 52(4): 239-247.Wang Meihua, Wu Zhenxin, Zhou Zuguang. Fine-grained identification of crop pests and diseases based on improved CBAM via attention [J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(4): 239-247.

[9]贾少鹏, 高红菊, 杭潇. 基于深度学习的农作物病虫害图像识别技术研究进展[J]. 农业机械学报, 2019, 50(S1): 313-317.Jia Shaopeng, Gao Hongju, Hang Xiao. Research progress on image recognition technology of crop pests and diseases based on deep learning [J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(S1): 313-317.

[10]Karras T, Aila T, Laine S, et al. Progressive growing of gans for improved quality, stability, and variation [J]. arXiv Preprint arXiv: 1710.10196, 2017.

[11]Creswell A, White T, Dumoulin V, et al. Generative adversarial networks: An overview [J]. IEEE Signal Processing Magazine, 2018, 35(1): 53-65.

[12]金耀, 徐陽, 韩飞杨, 等. 基于深度学习语义分割的桥梁病害图像像素级识别方法[J]. 公路交通科技(应用技术版), 2020, 16(1): 183-188.Jin Yao, Xu Yang, Han Feiyang, et al. Pixel-level recognition method for bridge disease images based on deep learning semantic segmentation [J]. Journal of Highway and Transportation Research and Development (Application Technology Edition), 2020, 16(1): 183-188.

[13]Woo S, Park J, Lee J Y, et al. CBAM: Convolutional block attention module [C]. Proceedings of the European Conference on Computer Vision (ECCV), 2018: 3-19.

[14]罗建豪, 吴建鑫. 基于深度卷积特征的细粒度图像分类研究综述[J]. 自动化学报, 2017, 43(8): 1306-1318.Luo Jianhao, Wu Jianxin. A survey on fine-grained image categorization using deep convolutional features [J]. Acta Automatica Sinica, 2017, 43(8): 1306-1318.

[15]Demir A, Yilmaz F. Inception-ResNet-v2 with LeakyReLU and average pooling for more reliable and accurate classification of chest X-ray images [C]. 2020 Medical Technologies Congress (TIPTEKNO). IEEE, 2020: 1-4.

[16]He K, Zhang X, Ren S, et al. Delving deep into rectifiers: Surpassing human-level performance on ImageNet classification [C]. Proceedings of the IEEE International Conference on Computer Vision, 2015: 1026-1034.

[17]Ioffe S, Szegedy C. Batch normalization: Accelerating deep network training by reducing internal covariate shift [C]. International Conference on Machine Learning. PMLR, 2015: 448-456.

[18]Lin M, Chen Q, Yan S. Network in network [J]. arXiv Preprint arXiv: 1312.4400, 2013.

[19]Szegedy C, Liu W, Jia Y, et al.Going deeper with convolutions [C]. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015: 1-9.

[20]Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition [J]. Computer Science, 2014.

[21]He K, Zhang X, Ren S, et al. Deep residual learning for image recognition [C]. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016: 770-778.

基金項目:广西科技计划项目(桂科AD16380059);广西自然科学基金项目(2018GXNSFAA281235)

第一作者:邓昀,男,1980年生,广西桂林人,硕士,教授;研究方向为嵌入式与物联网、数据分析、图像分类。E-mail: 574359451@qq.com

通讯作者:康燕萍,女,1987年生,广西桂林人,硕士,实验师;研究方向为物联网、数据分析。E-mail: 460843302@qq.com