基于L-FPN的无人机上小目标识别模型轻量化方法

魏昊坤 刘敬一 陈金勇 楚博策 孙裕鑫 朱进

摘 要: 由于遥感图像拍摄的高度和设备不同导致每张图像的地面采样间隔(GSD)也不同, 许多小目标往往易被忽略, 遥感图像中旋转框目标检测成为当下研究热点。 现有的旋转框检测算法主要面向通用场景下的多尺度目标检测, 特征金字塔中特征融合计算操作复杂且耗时, 部署到无人机上的边缘端设备时面临很大的挑战。 因此本文针对该场景下的小目标检测提出基于L-FPN的无人机上小目标识别模型轻量化方法, 首先依据图像的GSD信息进行尺度归一化, 然后去除特征金字塔中冗余的高层特征图, 最后针对小目标检测调整锚框的尺寸。 本方法在DOTA数据集上进行训练验证, 结果表明本文提出的基于L-FPN的无人机上小目标识别模型轻量化方法在识别精度与传统模型一致的情况下, 模型参数量较原模型减少2.7%, 模型大小减少28%, 推理速度提升13.24%。

关键词: 目标检测; 特征金字塔; 模型轻量化; 遥感图像; 无人机

中图分类号: TJ760

文献标识码: A

文章编号: 1673-5048(2024)01-0097-06

DOI: 10.12132/ISSN.1673-5048.2023.0127

0 引 言

针对无人机对地运动目标检测场景中, 模型尺寸太大, 难以在无人机上高效运行进行研究。 现有的目标识别算法模型较大、 功耗较高, 经常会在高性能计算机上运行, 但受限于无人机上边缘端设备的计算能力以及存储空间, 算法直接移植到边缘端设备上, 太大的模型会导致运行效果变差, 甚至无法运行。 边缘端设备无法提供足够的功率来支持模型的运行。 为了保证一些前沿的目标检测算法在边缘端设备上的运行效果, 且能够应用到无人机对地目标检测场景中, 本文从结构上对模型进行改进, 但直接改动模型结构, 会导致模型检测精度降低, 因此还要对此场景中的检测进行其他针对性的改进, 改进后可以维持原有模型的检测精度, 同时能够降低模型参数量和模型大小。

现有降低模型大小的方法有模型剪枝、 模型量化和知识蒸馏, 主要针对多数通用场景, 侧重于模型计算上的优化, 而模型结构优化则在特定应用场景下有很好的应用表现。

减少模型尺寸和提高模型推理速度一直是人工智能领域优化模型研究的重要目标。 从计算资源的节向和应用实时性的方面来看, 这都是必须满足的要求。 在减少计算复杂度方面, 模型剪枝[1]是目前效果明显的技术之一。 其通过去除神经网络中权重较小的参数网络结构, 同时保持或提升模型精度。 具体来说, 可以将原本设计为密集连接结构的模型转变为稀疏结构, 只保留对模型影响最大的节点连接。 另一些方法是通过对模型结构的优化, 来降低模型尺寸大小, 这些方法仅在卷积方式上做出创新, 设计出通用的轻量化网络模型[2-3], 提高网络计算效率, 并没有针对相应的应用场景, 对模型其他冗余部分进行改进, 在模型的Neck部分还有很大的改进空间。 或者是利用模型量化的方法, 将网络中参数的表示从高精度转化为低精度, 来减少模型体积大小, 在边缘端平台上能够提高运算速度。 这种压缩参数的方法虽然能够达到减小模型大小的目的, 但会改动模型中的参数, 导致模型精度的下降。

在无人机对地运动目标检测场景中, 由于目标的尺度较小, 现有的遥感图像DOTA[4]数据集标注时, 往往会忽略掉其中小目标的标注, 错过一些重要的信息。 图1为DOTA数据集的标注信息, 图2为DOTA数据集中被忽略掉的小目标。

在图像特征融合方面, 还需要再利用特定的方法对其进行改进。 在目标识别模型中对于特征金字塔部分所做的工作主要是在不断地改变各个特征层之间的融合方式来提高模型整体的预测精度, 这些方法不仅利用了多尺度上的特征图, 而且还使这些特征图之间的融合方式变得复杂, 导致模型参数量增多, 不利于在边缘端设备上运行。

在面向无人机对地运动目标检测场景时, 本文从模型结构入手, 提出了轻量化FPN的方法来减少模型参数量。 首先, 轻量化FPN方法针对传统的目标检测模型中, 特征融合模塊中冗余的过程进行简化, 针对运动目标尺度较小的问题, 从各个特征层的感受野入手, 由于高层次的特征感受野太大, 不利于检测小尺度的物体, 因此在特征金字塔部分进行特征融合时, 采用一些低层次的特征来对小目标进行检测识别, 降低特征整层融合的代价, 并且为了让模型检测到图像中更多的小目标, 本文将图像根据其GSD进行了像素级的调整, 让图像都处在同一GSD下, 充分地将更多的小目标的大小放缩到同一尺度上来解决相关的问题。

1 相关工作

现在模型轻量化工作主要是从模型的整体出发, 通过对整体进行压缩去降低模型参数量, 使模型大小降低, 来减少模型运行所消耗的资源。 另外一种方法是从模型的整体结构入手, 更改网络结构设计, 设计出符合需求的轻量化模型。

知识蒸馏[5]将大模型压缩成小模型, 利用大模型中学到的知识来指导小模型的训练学习, 使得小模型具有大模型的泛化能力, 模型参数量大大减少, 提高了模型计算性能。 利用小模型替代大模型实现推理阶段的加速。

在训练好的模型中, 卷积层和全连接层含有大量参数, 并且大量神经元的激活值趋近于零。 模型剪枝将这些激活值接近零的神经元去除后, 仍可保持同样的模型检测性能。 根据模型剪枝的粒度不同可以分为细粒度剪枝和粗粒度剪枝。 细粒度剪枝主要是针对神经元之间的连接权重进行剪枝, 对权重值进行排序, 去掉低于预设阈值的连接, 并且对剪枝后的网络进行恢复性调整, 与原模型水平保持一致, 继续去掉低于预设阈值的连接, 直到剪枝的结果满足预设目标, 终止剪枝操作。

粗粒度剪枝主要是对模型进行通道剪枝, 如基于重要性因子的剪枝法, 该方法通过评估每个通道的有效性, 再配合约束通道数使模型结构本身具有稀疏性。 依据这种方法对模型进行剪枝, 可以获得无需特定算法支持的精简模型。

通道剪枝算法是通过判断通道激活的稀疏性来评估其重要性, 通道稀疏性越高, 越应该被删除, 利用Batch Norm中的缩放因子, 以重建误差来指导剪枝。 该算法根据输入特征图各通道对输出特征图贡献大小, 对模型进行剪枝。 这种方法可以直接反映进行稀疏通道剪枝后对特征的损失情况。

这些方法在特定场景下的小目标检测计算中仍有冗余, 增加了不必要的计算过程, 识别精度较低。

2 模型轻量化方法

本文中进行验证的算法是两阶段的旋转框检测算法, 整体的架构如图3所示。 首先, 针对于原始图像, 本文利用尺度归一化的方法将其缩放到统一尺度, 减少了模型训练的时间, 学习的目标都是统一尺度, 在预测上的压力也会减少。 在模型特征提取模块(Backbone), 本文选取了最经典且精度较高的Resnet50来提取图像特征, 在Resnet50中会得到多个不同尺度上的特征图, 并且送入到图像融合模块(Neck)中进行融合。 本文针对遥感图像精简了特征图融合的计算过程, 将融合好的特征图送入到预测模块(Head)中进行图像的预测。

2.1 图像尺度归一化

图像的预处理是根据遥感图像的地面采样间隔(GSD)来进行的。 现有的用来做目标检测的遥感图像都是由不同的卫星或者航空飞机所采集, 其地面采样间隔是不同的, 这就直接导致图像中同类物体的大小尺度不同, 在进行模型训练时, 要学习同类物体不同尺度上的特征信息, 增加了训练负担, 因此在进行图像训练之前要进行尺度归一化。 尺度归一化能够将过大的目标缩小,

将过小的目标放大到较大尺度, 模型不必去学习过多的特征知识导致过拟合, 且能够获得更多的目标细节。 首先, 在GSD的选择上, 本文选择一个目标检测数据集中在特定尺度下图像最多的尺度。 根据选择出来的GSD信息, 依据每张图像各自的GSD來进行缩放, 计算出每张图片需要进行缩放的倍数scale:

式中: standard为选定的GSD标准。

获得每个图像的缩放尺度之后, 利用最近邻差值的方法对图像进行缩放:

W=w×scale(2)

H=h×scale(3)

式中: w,h分别为原始图像的尺寸大小; W,H分别为缩放后的图像尺寸。

当图像进行缩放时, 新产生的像素点的值会与周边的像素值保持一致:

式中: M×N为原始图像的大小, (x, y)为每个像素的坐标; P×Q为目标图像的大小, (i, j)为每个像素的坐标。

本研究首先对数据集所有图像进行解析, 提取其GSD信息, 并进行统计分析, 得出图像数量最多的GSD值主流范围。 随后, 进一步比对该范围内各GSD值对应的样本量, 选择样本规模最大的某个GSD值作为数据集图像特征的代表性指标。 此代表性GSD值被指定为图像统一缩放的标准, 目的是使模型学习能更好匹配数据集整体分布特点, 从而提升目标检测任务效果。 由于这一GSD尺度下采集的图像样本规模最大, 代表的是数据集主流场景, 所以采用这一标准进行模型训练, 可以使训练出的模型更好地适应数据集的整体特征和检测任务需求, 充分挖掘数据集主要场景信息。

2.2 轻量化FPN设计

特征金字塔(FPN)[6]是目标检测任务中建立金字塔结构网络的经典网络解决方案之一, FPN能够在复杂的自然场景图像中, 有效提升模型针对各尺度目标的检测性能。 由于特征提取网络输出的特征图是分层的, 高层次的特征图具有更低的分辨率, 包含更多大尺度目标的信息, 更适合检测大尺度目标, 低层次的特征图具有更高的分辨率, 更适合检测更多小尺度的目标。 在遥感图像中移动目标的尺度相对较小, 高层次的特征图做出的贡献较少。 YOLOF[7]这项研究指出FPN的成功在于其分而治之的策略去优化目标检测任务, 而不是多尺度上的特征融合。 然而在标准的模型上, FPN应用所有层次上的特征图去检测是非常冗余且低效的。

为解决这个问题, 本文对于FPN的结构进行调整, 针对遥感图像中小目标检测的任务场景去除了Resnet50输出的上边C4和C5两个高层次的特征层, 这两个特征层包含着更多大尺度目标的特征信息。 利用剩下的两个低层次的特征图C2和C3, 并且让其继续进行特征融合, 将融合后的特征图P2, P3和P4送入旋转框检测部分用于小目标的检测。 图4是轻量化FPN的详细结构。

2.3 低层次特征图锚框设计

在去除冗余的特征图和融合操作之后, 整个训练完成的模型的参数量和大小会减少。 特征金字塔输出的特征图相较于原始模型会减少两个特征层, 并且存在与预测模块(Head)耦合不完整导致预测精度下降的问题, 这是由于图像经过尺度归一化处理后, 图像中的目标大小也会进行相应的变动, 预测框难以准确地回归预测到物体的位置信息。

本文所用算法是基于锚框模型的, 利用锚框来进行目标的定位和分类, 物体大小会随之变化, 因此针对于无人机所拍摄的航空图像以及遥感图像中锚框的大小也要做出适当的调整。 以前锚框的设计是针对于多尺度目标的检测, 现在移除C4和C5两个上层特征层之后, 针对剩下的C2和C3进行回归预测。 锚框大小设计的合理性能够直接影响模型的检测精度, 合理的锚框大小能够很好的对目标进行包围。 在锚框生成的阶段锚框的大小受两个因素的影响, 分别是锚框的基本大小和锚框的移动步长:

area=s×stride(6)

式中: area为锚框的大小; s为锚框的基本大小; stride为锚框移动的步长。

3 实 验

本文在DOTA数据集上开展相关实验评估本文所提出的方法, 选取的算法是目前遥感图像识别中精度排名前三的旋转框检测算法: Rotated FaterR-CNN[8], RoI Transformer[9]和Oriented R-CNN[10]。

3.1 数 据 集

DOTA是一个公开的, 专门用于尺度变化较大的遥感图像检测数据集, 由于遥感图像中物体排列方向的任意性以及拍摄角度额不同, 此数据集中图像标注信息全部采用旋转框标注, 主要面向于旋转框目标检测。 DOTA数据集包含2 806张遥感图片和188 282个标注信息。 其标注的目标当中有15个类别, 包含遥感图像中常见的大型车辆、 游泳池、 飞机场、 小型车辆等。

由于本文主要针对于遥感图像中的小目标检测, 因此, 本文将只关注DOTA数据集中大型车辆和小型车辆两个类别, 并将这两个类别的注释都提取出来, 训练集和验证集都采用进行缩放过后的图像。

3.2 实验设计

3.2.1 尺度归一化设计细节

首先将DOTA数据集中每张图像的GSD信息进行统计, 从GSD的分布中, 选择该GSD中位数值作了代表, 是因为其能很好地反映出该数据集在该应用场景下的典型和最为广泛的GSD水平。 0.72这个中位数从统计学的角度来看, 能够有效代表DOTA数据集整体的GSD的值分布情况。 用选取的0.72作为缩放标准, 图 5是图像进行尺度归一化之后的结果, 小尺度目标的大小都被调整到了合适的尺寸。 那些容易被忽略的小目标就会有更多的细节特征被学习到, 更多被忽略不易被识别的小目标被识别, 提高模型的识别能力。

3.2.2 训练参数设置

在此次训练中, 采用单卡RTX3090进行图像训练, batchsize=2, 在mmrotate[11]平台上进行训练。 整个网络用GSD算法进行优化, 学习率设置为0.005。 针对于原始的图像大小, 为了便于模型进行读取训练, 本文将图像进行了切割, 切割成1 024×1 024大小的小圖像, 每张图像切割时小图像之间的重叠间距是200像素, 每个模型训练都是12个epoch, 设置式(6)中锚框的基本大小s=10。

3.2.3 实验结果

在原始的DOTA数据集上, 本文将小型车辆和大型车辆的注释信息提取出来, 将其标注信息也根据图像的尺度变化进行处理, 让点能够包围住车辆, 对3个模型中的FPN部分进行了更改, 并且对其精度推理速度等参数进行了测试, 还将原始的模型训练原始的DOTA数据作为baseline。

表1是3个模型经过本文所提出的方法改进之后的与原始的模型进行的对比, 所用的数据集是没有经过缩放的图像, 能够看出, 经过本文的尺度归一化以及轻量化处理, 模型针对于小目标的识别精度较原始模型有所提高。 实验结果也表明本文的轻量化方法是有效的, 特征金字塔中, 高层次的特征图对于小目标的检测所起到的作用是很低的。

本文不仅从模型预测精度也从推理速度、 模型大小方面进行了对比, 所有的模型训练集和验证集是经过尺度归一化处理后的图像, 实验结果如表2所示, 本文所改进的模型在检测精度(mAP)上与原模型在同一水平, 在模型大小和模型尺寸比原模型精简下降, 在参数方面, RoI Transformer模型下降了1.11 M, Oriented R-CNN模型下降了1.12 M, 模型大小都减少了68.8 MB, 模型推理速度都分别增加了2.9 FPS和1.8 FPS。

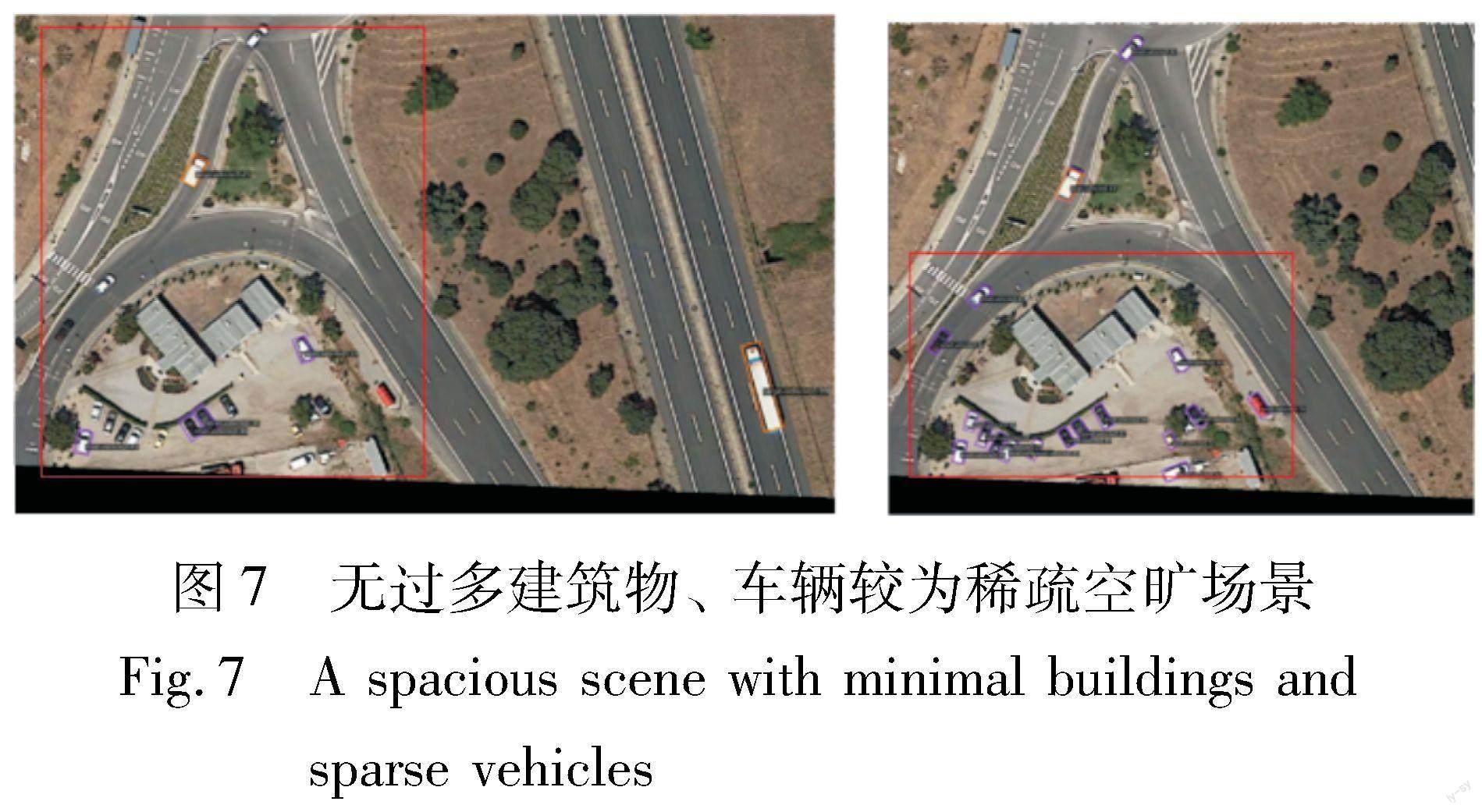

本文改进后的模型比原始的模型能够识别更多的小尺度目标, 还能检测到更多被忽略没有被注释的目标信息。 在实验结果的对比中本文选取了4个不同的场景验证改进模型的识别能力, 如图6~9所示。 图中左侧为DOTA未缩放原始数据集的检测效果, 右侧为缩放后的数据集在进行改进后的模型上的检测效果。

图6展示了建筑密集的场景下小尺度目标的检测结果, 小型车辆等小目标与较大的房屋建筑相比极易被忽略, 这些小型车辆在DOTA数据集中尺度更小, 在原始的检测模型中有许多小型车辆未被检测到, 而利用本文改进的模型能够检测更多的小型车辆目标。 图7展示了在野外无过多建筑物, 车辆较为稀疏空旷场景的结果对比, 与周边的道路和平原相比车辆目标属于小尺度目标改进后的模型检测到的目标更多。 图8~9分别展示了车辆稀疏与车辆密集的场景下的检测结果对比。 多场景实验结果对比表明本文改进的模型的检测效果不受稀疏或密集场景的干扰, 在大尺度目标周边的小尺度目标同样能检测到, 且相较于原模型检测能力更高。

4 结 论

本文主要解决遥感图像中小目标不易被检测到, 并且解决训练好的通用模型过大, 难以在嵌入式平台上部署的问题。 针对遥感图像中主流的旋转框检测算法进行改进, 模型整体性能取得了很大的提升。 将遥感图像先进行尺度归一化处理, 能够解决小目标在这类检测任务中被忽略的问题, 能够选出最适合当前检测场景的地面采样间隔。 将模型进行轻量化处理之后模型的检测精度相较与原来的模型相同, 并且模型大小, 参数量和推理速度有很大的提升。

在后续的工作中, 将会在锚框大小的选择上将利用机器学习算法对其进行改进, 选择出更合适的锚框大小。 同时会将训练好的模型部署在无人机上, 去进行模型的实施推理。

参考文献:

[1] Liu Z, Li J G, Shen Z Q, et al. Learning Efficient Convolutional Networks through Network Slimming[C]∥IEEE International Conference on Computer Vision (ICCV), 2017.

[2] 俞偉聪, 郭显久, 刘钰发, 等. 基于轻量化深度学习Mobilenet-SSD网络模型的海珍品检测方法[J]. 大连海洋大学学报, 2021, 36(2): 340-346.

Yu Weicong, Guo Xianjiu, Liu Yufa, et al. Detection Method of High Value Marine Food Organisms Based on Lightweight Deep Learning Mobilenet-SSD Network[J]. Journal of Dalian Ocean University, 2021, 36(2): 340-346.(in Chinese)

[3] Qin Z, Zhang Z N, Zhang S Q, et al. Merging-and-Evolution Networks for Mobile Vision Applications[J]. IEEE Access, 2018, 6: 31294-31306.

[4] Xia G S, Bai X, Ding J, et al. DOTA: A Large-Scale Dataset for Object Detection in Aerial Images[C]∥IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2018: 3974-3983.

[5] 邵仁荣, 刘宇昂, 张伟, 等. 深度学习中知识蒸馏研究综述[J]. 计算机学报, 2022, 45(8): 1638-1673.

Shao Renrong, Liu Yuang, Zhang Wei, et al. A Survey of Know-ledge Distillation in Deep Learning[J]. Chinese Journal of Compu-ters, 2022, 45(8): 1638-1673.(in Chinese)

[6] Lin T Y, Dollar P, Girshick R, et al. Feature Pyramid Networks for Object Detection[C]∥IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2017: 936-944.

[7] Chen Q, Wang Y M, Yang T, et al. You only Look One-Level Feature[C]∥IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2021: 13034-13043.

[8] Yang X, Yan J C, Feng Z M, et al. R3Det: Refined Single-Stage Detector with Feature Refinement for Rotating Object[C]∥ AAAI Conference on Artificial Intelligence, 2021, 35(4): 3163-3171.

[9] Ding J, Xue N, Long Y, et al. Learning RoI Transformer for Oriented Object Detection in Aerial Images[C]∥ IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2019.

[10] Xie X X, Cheng G, Wang J B, et al. Oriented R-CNN for Object Detection[C]∥IEEE/CVF International Conference on Computer Vision, 2021.

[11] Zhou Y, Yang X, Zhang G F, et al. MMRotate: A Rotated Object Detection Benchmark Using PyTorch[C]∥30th ACM International Conference on Multimedia, 2022.

A Lightweight Method for Small Object Detection Models on

Unmanned Aerial Vehicles Based on L-FPN

Abstract:Oriented object detection in remote sensing images is a current research hotspot. Due to the varying heights and equipment used in capturing remote sensing images, the ground sampling distance (GSD) of each image also varies, causing many small objects to be easily overlooked. Existing rotated object detection algorithms are mainly aimed at multi-scale object detection in general scenarios. The feature pyramid network (FPN) has complex and time-consuming fusion computations, which still faces great challenges when deployed on edge devices like UAVs. Therefore, this paper proposes a lightweight method for small object detection in UAVs based on L-FPN. First, normalize the scale according to the GSD information of the image. Second, remove redundant high-level feature maps in the FPN. Finally, adjust the anchor box sizes for small object detection. The method is trained and validated on the DOTA dataset.Results show that compared to the traditional models, the proposed L-FPN-based lightweight method for small object detection in UAVs achieves consistent recognition accuracy, with 2.7% fewer model parameters, 28% smaller model size, and 13.24% faster inference speed.

Key words: object detection; feature pyramid; model lightweight; remote sensing images; UAV