面向生成式人工智能应用的意图驱动的界面交互范式探索

刘玉磊,马艳阳

面向生成式人工智能应用的意图驱动的界面交互范式探索

刘玉磊1,马艳阳2*

(1.四川师范大学,成都 610101;2.四川农业大学,成都 611130)

对生成式人工智能技术赋能下的界面交互范式进行梳理和探析。以典型的界面范式为切入,包括WIMP范式、Non-WIMP范式、Post-WIMP范式等,分析各类型界面范式的发展、特点和局限,再以生成式人工智能技术带来的交互新特点为基础,探讨生成式人工智能技术对界面交互范式转换问题产生的推动、影响和变革。提出了一种面向生成式人工智能应用的、意图驱动的IDIM范式,包含意图域、对话流、互动启示、多模态交互几个要素。生成式人工智能技术以其强大的生成能力和智能化特性,为交互领域带来了空前的机遇和挑战,不仅为界面交互范式带来了变革,也促使交互设计向更智能、更个性化的多元交互模式转变。IDIM范式提供了一种新的界面交互范式参考,对完善交互理论、推动生成式人工智能的应用发展具有积极作用。

生成式人工智能;用户界面;交互范式;范式转换

2023年《自然》年度十大人物中,作为人工智能聊天机器人的Chatgpt入选,可见生成式人工智能给科学发展和进步带来的巨大改变。目前生成式人工智能对各类复杂问题都可以给出对应理解,能够生成复杂的图形、表格、文本、代码、视频等,具备多模态推理能力,其智能化、多模态的数据处理能力及个性化交互的特性正在改变人与机器互动的方式。生成式人工智能呈现的新特征、新模式,将带来全新的人机交互方式和设计可能性,也正在推动界面交互范式的转换。

生成式人工智能的相关研究集中在自然语言处理、计算机视觉、音频处理、混合模态生成等基础研究领域,以及医疗检测、化学分析、创意设计等应用领域。在人机交互领域,现有界面交互范式多以用户需求为导向,通过连续完成任务实现用户目标,而基于生成式人工智能技术的理解能力和生成能力,中间的任务环节可以被缩短甚至消除。那么,未来人机界面是否可以跳过任务步骤直达意图结果,在意图驱动的交互过程中界面范式将如何演变,这些问题亟需探讨。生成式人工智能的崛起标志着人机交互领域的一次革命性变革,探索一种面向生成式人工智能应用的界面交互范式,是对生成式人工智能技术应用领域的扩展和对人机交互理论的完善。

1 界面范式

1.1 范式的起源

1962年,美国科学哲学家托马斯·库恩在书中首次提出“范式”(Paragigm)的概念和相关理论[1-2]。库恩认为“范式”是指在某个学科内从事科学研究的一套公认模式,包括世界观、定理、规则、方法、行为标准、应用等。库恩还提出“范式转移”(Paradigm Shift)的概念,认为学科的变革伴随着“范式”的转变,“范式转移”为学科发展提供了新的可能性。

人机交互领域认为“范式”是指在设计和研究交互系统时所采用的基本模式、方式或者框架。这些“范式”为交互设计提供指导,帮助设计者理解用户需求、优化用户体验,以及实现有效的信息交流,助力开发新的计算设备和界面,以改进人们与现有技术的交互方式。因此,该领域的“范式”主要用来指代“界面范式”,“界面范式”一般是指用户界面的设计模型或模式。

1.2 类型和发展

用户界面经历了批处理界面、命令行界面和图形用户界面三个主要阶段。在计算机诞生时期,1945年左右,计算机以批处理(Batch Processing)的方式工作,几乎没有用户界面,不涉及用户和计算机之间的任何交互。1964年左右,出现了命令行界面CLI(Command Line Interface),用户通过键入命令来与计算机进行交互,因用户需要记住复杂的命令和参数,对非专业用户不够友好,交互效率有限。

图形用户界面GUI(Graphical User Interface)在20世纪80年代中期开始广泛应用,采用WIMP范式作为典型范式。WIMP通过窗口(Windows)、图标(Icons)、菜单(Menus)和点选设备(Pointing Device)四大互动元件实现图形化交互[3]。WIMP范式是图形用户界面最早的经典范式,Windows系统、MacOS系统和许多应用程序都有使用。

由于计算机技术和设备环境的发展,传统WIMP界面范式显露出局限性,例如:操作方式过度依赖鼠标和键盘、交互感知通道有限、二维的桌面隐喻不适用于三维虚拟场景等。20世纪90年代,一些学者陆续提出Non-wimp范式[4]和 Post-wimp范式[5],力图提供更自然的交互方式,满足新场景的需要。Post-wimp相关界面范式类型较多,例如:Jacob等[6]提出现实隐喻的RBI(Reality-based Interaction)界面范式;石磊等[7-8]提出笔式交互系统的PGIS(Paper、Gadget、Icon、Sketch);董士海等[9]提出面向多通道模型的VIR(Virtual Information Room)界面范式;张小龙等[10]提出面向智能系统的RMCP(Role、Modal、Command、Presentation Style)界面范式;王慧等[11]提出基于化身交互隐喻的ASLI(Avatar、Scenario,、Language、Instrument)界面范式;秦贵和等[12]提出LWHP(Layer、Widget、Hierarchical Menu、Pressure+Gesture)多媒体终端上新型压力交互范式;还有脑机接口BCI(Brain-Computer Interfaces)[13]、运动追踪和身体感知等Post-wimp范式的研究。

硬件设备和软件技术的发展,不断推动着界面范式的转换和升级,朝着自然、智能的方向发展,见表1。相关研究集中在触控交互、语音交互、多通道交互、脑-机交互、其他传感器类交互等领域,自然用户界面NUI(Nature User Interface)成为图形用户界面GUI之后的新方向,对应的界面范式研究也成为重要课题,见图1。

2 生成式人工智能技术推动界面范式的转换

2.1 意图驱动结果的界面范式

生成式人工智能(Generative Artificial Intelligence)是一种人工智能算法,能够通过机器学习自主地生成具有意义和逻辑性的新数据,包括文本、图像、音频、视频、代码等各种类型内容。以ChatGPT(2022年)、Midjourney(2022年)、Stable Diffusion(2022年)、Google Gemini(2023年)、文心一言(2023年)等为代表的生成式人工智能应用发展迅速,其成为一种新的设计要素,对设计范式的转变起到较大推动作用。

微软发布的关于GPT-4的研究报告[14]中验证了GPT-4的诸多能力,包括:多模态与跨学科组合的能力、视觉能力、空间理解力、音乐能力、代码能力、数学能力、与人类交互的能力等,整体上表现出较高的智能水平。在微软发布的关于新模型GPT- 4V(ision)[15]的研究报告中,GPT-4V(ision)在视觉理解、多模态知识、时间推理、抽象推理、情感理解等很多实验领域都表现出人类水平。诸多学者从不同领域研究了生成式人工智能的能力,例如:创新教育[16-17]、药物研发[18]、员工效率[19]、艺术创作[20-21]、新闻媒体[22]等。

表1 范式类型对比

Tab.1 Comparison of paradigm types

图1 界面范式的发展

传统界面设计中,用户与计算机之间的交互多通过固定的指令、按钮和菜单来实现,用户需要按照预设的规则进行操作,而生成式人工智能赋予了计算机更强大的理解和推理能力。计算机可以快速响应用户的意图、实现任务目标。生成式人工智能技术的崛起正在驱动着界面范式向更加智能、个性化和适应性的方向转变。

针对生成式人工智能技术,人机交互专家雅各布·尼尔森(Jakob Nielsen)[23]指出人工智能正催生一个新的用户界面范式。在新的人工智能系统中,用户不再需要告诉计算机做什么、怎么做,而是直接告诉计算机他们想要的结果。尼尔森将生成式人工智能带来的新界面范式定义为基于意图的结果规范(Intent- Based Outcome Specification,IBOS),它侧重于定义用户与系统交互的预期结果,而不是关注实现该结果所需的具体步骤或操作。人机交互专家马修·特克(Matthew Turk)[24]曾指出多模态交互的目标是通过技术、交互方法和界面,消除人机交互中存在的约束,朝着充分利用人类自然的交流、互动能力的方向发展。生成式人工智能技术在一定程度上消除了用户在与机器交互过程中繁琐的操作步骤,实现了更自然的交互。

2.2 生成式人工智能技术下的交互新特点

以大算力为基础,大数据、大模型驱动的生成式人工智能技术在自然语言处理、计算机视觉、语音处理等方面表现突出,具有高适应性、强学习能力、高计算能力、大语料库等特点,通过将生成式人工智能引入界面交互设计中,可以在个性化、智能化、适应性等方面对用户体验进行赋能。相比于以往的智能交互体验,生成式人工智能技术背景下的交互体验也将呈现出如图2所示的新特点。

图2 生成式人工智能交互体验新特点

1)自适应个性化交互:生成式人工智能基于海量数据进行训练,大模型自身具备强大的知识库,可以根据用户的输入了解其喜好、习惯和相关情况,实现个性化输出。同时,生成式人工智能可以持续学习用户的特定需求和偏好,不断优化输出,实现对用户意图的理解并提供符合用户期望的体验。

2)长距离上下文感知:生成式人工智能技术具备长距离感知理解上下文的能力,解决了早期语言模型无法捕捉长距离语义关系的问题,因此可以生成更连贯的文本信息。例如,在应用场景中,生成式人工智能可以与用户进行长时间的复杂对话,即使中断一段时间,也可以无缝衔接地继续交流,而不需要重复之前的对话背景。

3)多模态自动生成:利用生成式人工智能技术,可以实现多模态输入和输出。在多模态内容生成中,不同的感知模态可以相互补充,以提供更丰富的体验。例如,一个多模态生成系统可以接受一段文本描述和一个图像作为输入,然后生成与之相匹配的语音解说。

4)开放域交互场景:开放域对话是自然语言处理的一个目标[25]。生成式人工智能有赖于大模型的能力,可以基本实现开放域任务要求,即能够自适应各种任务场景、处理不受限制的输入,并提供对应合理的输出。开放域交互避免了场景选择、规则定义等约束,可以提供更自然、更直接的用户体验。

5)实时性和流畅性:生成式人工智能技术可以实时分析用户输入,并迅速提供对应的输出。这种实时性和流畅性可以增强用户的沉浸感和参与感,以提升交互体验效果。

3 面向生成式人工智能应用的意图驱动的界面交互范式

3.1 提出IDIM界面范式

界面范式依托于设备、技术和场景,服务于用户目标(如图3所示),通过前文对各类界面范式的分析,可以总结出界面范式的基本构成一般包含:信息空间、交互对象、操作方式几个方面,不同范式类型对应的具体要素形式有所不同。例如典型的WIMP范式,以窗口(Windows)作为信息空间;以图标(Icons)、菜单(Menus)作为交互对象;以点选设备(Pointing device)作为操作方式。在任务驱动的场景中,需要通过完成系列命令集得到执行结果。在WIMP范式中,窗口用于信息承载和多任务管理;图标和菜单用于命令集的归类;点选设备用于手动触发下一步操作。四要素的结合可以有效构成交互界面。基于WIMP范式构成要素的分析,再结合前文对生成式人工智能技术特点的分析,使用对比分析法和场景转译的方法,对面向生成式人工智能应用的界面范式进行推演。

图3 用户和交互界面关系图

在意图驱动的生成式人工智能的应用场景中,任务的概念将被弱化,用户可以更快速有效地直达目标。因此,信息不必固化在某个窗口中,不需要多窗口进行多任务管理,而只需要一个承载意图的开放式信息空间。同时,用于归类命令集的图标、菜单也成为非必要的交互对象,预设的命令集将升级为自然的对话流,再配合互动启示进行补偿和校准,进而完成意图理解。在交互方式层面,不再单纯依赖点选设备进行操作,而是采用多模态内容的输入和输出。

通过以上分析,作者提出一种意图驱动的、面向生成式人工智能应用的新型界面交互范式IDIM。IDIM范式包含意图域(Intent Domain)、对话流(Dialogue Flow)、互动启示(Interactive Inspiration)、多模态交互(Multimodal Interaction)四大要素。相比于传统的WIMP范式,IDIM范式更适用于生成式人工智能的应用场景,见图4。

图4 WIMP范式和IDIM范式对比

3.1.1 意图域

指用户在生成式人工智能系统中的开放式交流空间,系统通过自然语言处理和深度学习等技术,智能地分析和理解用户输入的文本、语音或图像等,以确定用户的意图和需求。相比于WIMP范式中的窗口(Windows),意图域的开放性和智能性更高,不仅是一个静态的信息承载容器,更是一个“能掐会算”的智囊库,涵盖语义理解、上下文分析、自适应推理等功能。意图域作为生成式人工智能系统界面交互的核心要素,不仅能够解读用户的输入,理解其中的意图,还可以将其映射到相应的功能领域或操作,从而为用户提供有针对性的响应和交互,见图5。

图5 意图域示意

3.1.2 对话流

是用户和生成式人工智能系统之间的信息交流,指系统根据用户的意图和上下文,构建起一种有序、连贯的交流模式,以确保交互的流畅性和任务目标的达成。相比于WIMP范式中的图标(Icon),意图驱动的界面范式中不需要预置功能项供选择,而是需要构建一种自然的、具有连贯性的交流模式,以引导用户向着实现目标的方向前进。这需要系统在对话中能够灵活地根据用户的回应和意图,自主地选择适当的问询和回应方式,从而保持对话的连贯性。这里提到的“对话”不一定是单纯的文字对话,也可以是图片、语音、视频等。

对话流可以用“河流”做隐喻,用户的每句话像是水流,系统像是河道,引导用户的话语从起点流向终点。对话流有赖于生成式人工智能的长距离上下文感知能力,以使交流保持顺畅性和连贯性,从而实现自然、友好、个性化的用户体验,见图6。

图6 对话流示意

3.1.3 互动启示

指生成式人工智能系统中的交互反馈和智能引导。界面可以根据用户的意图输入提供适当的操作引导、提示或信息。相比于WIMP范式中的菜单(Menu),互动启示不一定给出明确的操作选择,而更多的是激发用户思考、行动或参与更深入的交互。另外,互动启示可以是双向的,一方面是界面引导用户进行特定操作;另一方面在用户给出互动反馈后,系统可以根据用户的反馈调整并适应其的偏好,提供更准确的界面输出。例如,Midjourney在生成图片后会提供四个放大按钮(Upscale)、四个变体按钮(Variation)和一个刷新按钮以引导用户进行下一步的操作;ChatGPT在给出的每一条回答旁边都有赞和踩两个按钮,以帮助改进ChatGPT的回答质量和推荐更符合用户需求的答案,见图7。

图7 互动启示示意

交互的目标是自然、透明,引导并不是最优方式,但在现阶段基于意图的开放域界面中,提供适当的互动启示可以提高交互效率和用户满意度,也是该范式的要素之一。

3.1.4 多模态交互

指系统能够理解和产生多种模态的输入和输出。不同类型的信息可以整合在一个界面中展示给用户,为用户提供丰富多样的界面交互。多模态内容包括但不限于文本、图像、语音、视频等,并且可以实现跨模态应用。例如:用户使用生成式人工智能应用输入一句话,即可生成一张与文字相匹配的图片;或者输入一张图片,生成式人工智能应用会反向生成其描述文本,以用来生成类似图片。

多模态和跨模态应用颠覆了传统的单模态互动方式,相比传统WIMP范式,IDIM范式从面向步骤和过程转为面向意图和结果,带来更智能和丰富的用户体验。

3.2 IDIM范式的设计应用

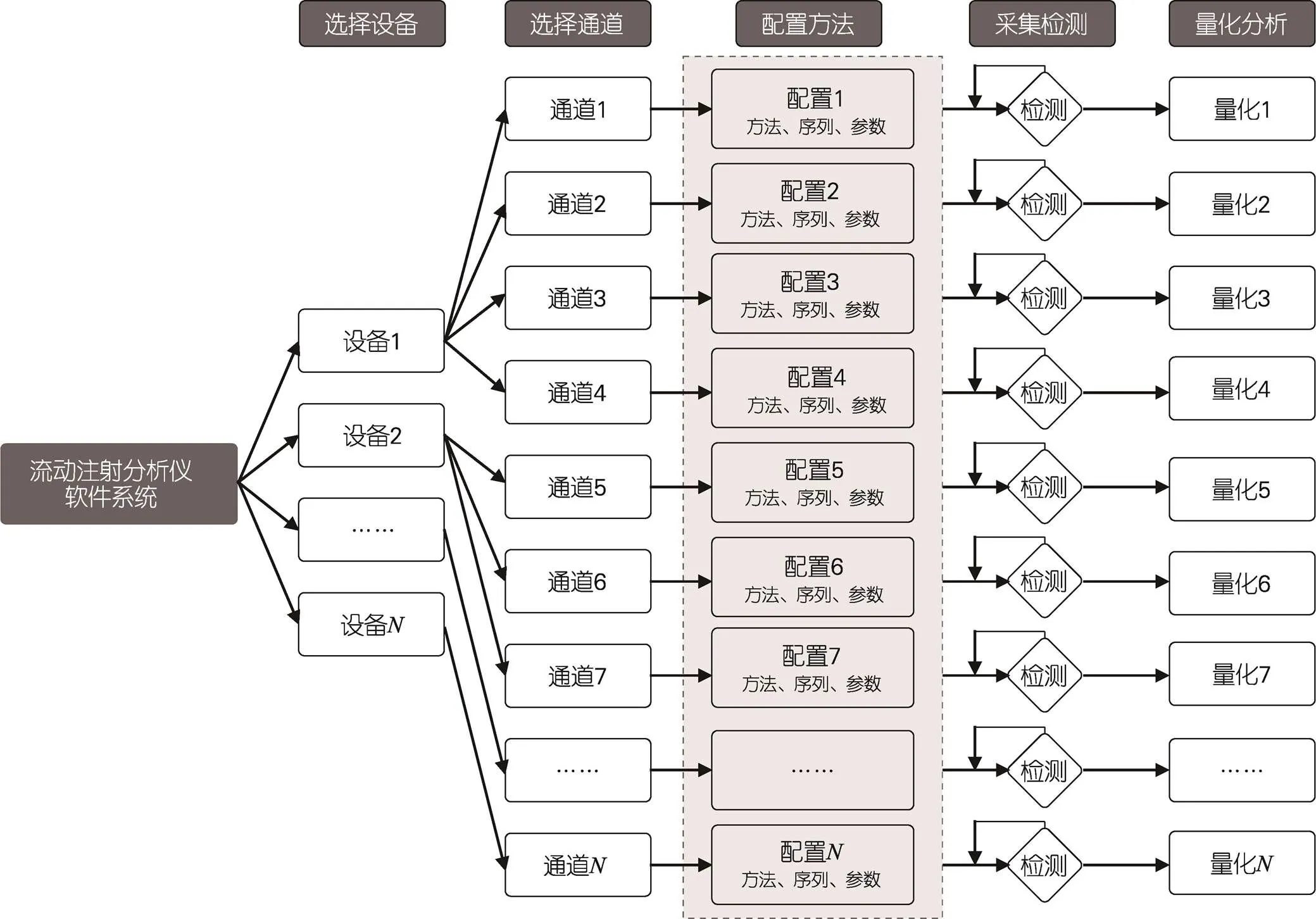

接下来通过使用IDIM范式设计一款流动注射分析仪的软件系统来说明IDIM范式的应用情况。流动注射分析仪是一种高精度的化学分析仪器,广泛应用于环境监测、药物分析、食品安全等领域。一般包含硬件主体、硬件端软件、电脑端独立软件系统三部分(如图8所示),此处重点围绕独立软件系统展开。

3.2.1 流动注射分析仪软件系统分析

流动注射分析仪软件的主要功能需求是检测和量化,其余功能为辅助,用以提高这两个功能模块的使用效率与工作效率,见图9。流动注射分析仪一般包含多个设备,每个设备又包含多个通道,各通道进行独立测量和独立数据处理。开始测量前,需要对各通道进行序列、方法、参数等设置,所有模块配置完成后可开始测量。测量过程中可查阅实时数据。测量完成后再进行数据分析和处理。整个交互流程中,在现有WIMP界面范式下,界面结构层级和任务模块较多,用户需要按照既定路径通过鼠标键盘进行图标点击、按钮点击、配置信息输入等精准操作才可以完成配置,对专业知识储备要求高,操作步骤较多,见图10。

3.2.2 IDIM范式在流动注射分析仪交互设计中的应用

通过引入生成式人工智能技术,结合文章提出的IDIM范式,优化软件交互流程。在IDIM范式下,依托生成式人工智能的知识模型能力和自适应能力,可以根据各通道特征进行自动化配置,提供智能化、个性化、自然化的交互体验,设计要点包含以下几个方面。

1)着眼于用户的操作目标,为用户提供意图输入和感知的空间。在流动注射分析仪软件的设计中,通过生成式人工智能识别用户需要的使用场景和需求来进行信息和操作的呈现,不再限定于既定的层级结构。避免界面出现复杂元素和过多层次的信息,以简单自然的交互形式为主。例如,用户通过自然语言输入当次实验目标,软件自行匹配合适的配置和操作路径,帮用户快速设定好实验步骤和自动化任务。

2)通过自然的对话过程设计,让用户能够高效交流,不受操作指令和对话规则的限制。结合生成式人工智能的机器学习能力和长距离上下文感知能力,流动注射分析仪软件可以快速进行任务理解和执行。例如,用户第一天做了多种样品的检测,第二天需要重复第一天的实验,则直接输入“重复昨天的实验任务”,即可再次进行相同选择和配置的实验任务。

3)通过互动启示的设计,让用户进行实时反馈,帮助软件不断改进和优化模型,提供更符合用户预期的体验。例如,软件根据用户的自然语言输入并进行实验配置后,其可以点击赞同或反对当前配置,以此增加用户的参与感并提升智能化配置的有效性。设计形式可采用文字按钮、图形按钮、表情反馈、手势反馈等。

图8 流动注射分析仪主体构成[26]

图9 流动注射分析仪软件系统功能需求分析

图10 流动注射分析仪软件主要操作流程

4)在流动注射分析仪设计中,参数配置、设备状态提示、曲线拟合、谱图分析等模块采用多模态交互。基于生成式人工智能的多模态能力,软件支持多模态的内容输入和输出,以适应不同用户的感知和操作习惯。例如,输入方式除了自然语言文字外,还支持语音、图像等的输入,在信息输出上同时支持文字、图形、语音等多种类型。

4 结语

生成式人工智能技术为界面交互范式带来新的可能性,同时推动着界面范式进行变革转换。文章探讨了生成式人工智能技术对界面交互范式的影响,提出了意图驱动的IDIM范式。科学仪器分析系统专业性和操作复杂度较高,文章通过IDIM范式在流动注射分析仪软件系统中的应用分析,提供了可供参考的设计提升路径,使用户能够以更自然、智能的方式与系统进行交互,提高系统效率和使用体验。整体上,IDIM范式在信息空间、交互对象、操作方式等方面提供了新的范式思路,在实际应用中可根据技术背景、交互设备、使用场景等进行适应性调整。

[1] KUHN T S. The Structure of Scientific Revolutions[M]. Chicago: University of Chicago Press, 1962.

[2] 库恩 T S. 科学革命的结构[M]. 金吾伦, 胡新和, 译, 北京: 北京大学出版社, 2004. KUHN T S. The Structure of Scientific Revolutions[M]. JIN W L, HU X H, translated. Beijing: Peking University Press, 2004.

[3] NIELSEN J. Noncommand User Interfaces[J]. Commun ACM, 1993, 36: 83–99.

[4] GREEN M, JACOB R. SIGGRAPH'90 Workshop Report: Software Architectures and Metaphors for Non-wimp User Interfaces[J]. ACM SIGGRAPH Computer Graphics, 1991, 25(3): 229-235.

[5] VAN DAM A. Post-wimp User Interfaces[J]. Communications of the ACM, 1997, 40(2): 63-67.

[6] JACOB R J K, GIROUARD A, HIRSHFIELD L M, et al. Reality-based Interaction: A Framework for Post- wimp Interfaces[C]// In Proceedings of the SIGCHI Conference on Human Factors in Computing Systems. New York: ACM Press , 2008: 201-210.

[7] 石磊, 邓昌智, 戴国忠. 一种Post-WIMP界面:PGIS的实现[J]. 中国图象图形学报, 2010, 15(7): 985-992. SHI L, DENG C Z, DAI G Z. Implementation of PGIS: A Type of Post-wimp User Interface[J]. J Image Graph, 2010, 15: 985-992.

[8] 戴国忠, 田丰. 笔式用户界面[M]. 合肥: 中国科学技术大学出版社, 2014. DAI G Z, TIAN F. Pen-based User Interface[M]. Hefei: University of Science and Technology of China Press, 2014.

[9] 董士海, 陈敏, 罗军, 等. 多通道用户界面的模型、方法及实例[J]. 北京大学学报(自然科学版), 1998, 34(2-3): 231–239. DONG S H, CHEN M, LUO J, et al. The Model, Method and Instance of Multimodal User Interface[J]. Acta Sci Nat Univ Pekinensis, 1998, 34(2-3): 231–239.

[10] 张小龙, 吕菲, 程时伟. 智能时代的人机交互范式[J]. 中国科学: 信息科学, 2018, 48(4): 406-418. ZHANG X L, LYU F, CHENG S W. The Paradigm of Human-computer Interaction in the Era of Intelligence[J]. SCIENTIA SINICA Informationis, 2018, 48(4): 406-418.

[11] 王慧, 姚乃明, 董健, 等. 基于Bots的人机交互界面范式[J]. 中国科学: 信息科学, 2018, 48(4): 475-484. WANG H, YAO N M, DONG J, et al. Bots Based Human-computer Interaction Interface Paradigm[J]. SCIENTIA SINICA Informationis, 2018, 48(4):475-484.

[12] 秦贵和, 王曼莹, 孙铭会. 多媒体终端上新型压力交互范式研究[J]. 吉林大学学报(工学版), 2023(11): 3186-3193. QIN G H, WANG M Y, SUN M H. Research on New Pressure Interaction Paradigm on Multimedia Terminals[J]. Journal of Jilin University, 2023(11): 3186- 3193.

[13] AGGARWAL S, CHUGH N. Review of Machine Learning Techniques for EEG Based Brain Computer Interface[J]. Archives of Computational Methods in Engineering, 2022, 15: 1-20.

[14] BUBECK S, CHANDRASEKARAN V, ELDAN R, et al. Sparks of Artificial General Intelligence: Early Experiments With GPT-4[EB/OL]. (2023-03-22)[2023-08- 20]. https://doi.org/10.48550/arXiv.2303.12712.

[15] YANG Z, LI L, LIN K, et al. The Dawn of lmms: Preliminary Explorations with GPT-4V (ision)[EB/OL]. (2023-08-29)[2023-09-01]. https://doi.org/10.48550/arXiv. 2309.17421.

[16] BAIDOO-ANU D, ANSAH L O. Education in the Era of Generative Artificial Intelligence(AI): Understanding the Potential Benefits of ChatGPT in Promoting Teaching and Learning[J]. Journal of AI, 2023, 7(1): 52-62.

[17] QADIR J. Engineering Education in the Era of ChatGPT: Promise and Pitfalls of Generative AI for Education[J]. In 2023 IEEE Global Engineering Education Conference (EDUCON), 2023, 5(1): 1-9.

[18] WALTERS W P, MURCKO M. Assessing the Impact of Generative AI on Medicinal Chemistry[J]. Nature Biotechnology. 2020, 38(2): 143-5.

[19] BRYNJOLFSSON E, LI D, RAYMOND L R. Generative AI at Work[EB/OL]. (2023-04-23)[2023-08-20]. https://doi.org/10.48550/arXiv.2304.11771.

[20] EPSTEIN Z, HERTZMANN A, AKTEN M, et al. Investigators of Human Creativity[J]. Art and the Science of Generative AI. Science. 2023, 380(6650): 1110-1111.

[21] GOZALO-BRIZUELA R, GARRIDO-MERCHAN E C. ChatGPT is not All You Need. A State of the Art Review of Large Generative AI Models[EB/OL]. (2023-01-11) [2023-08-20]. https://doi.org/10.48550/arXiv.2301.04655.

[22] PAVLIK J V. Collaborating with ChatGPT: Considering the Implications of Generative Artificial Intelligence for Journalism and Media Education[J]. Journalism & Mass Communication Educator, 2023, 78(1): 84-93.

[23] NIELSEN J. AI is First New UI Paradigm in 60 Years[EB/OL]. (2023-05-19)[2023-06-20]. https://www. uxtigers.com/post/ai-new-ui-paradigm.

[24] TURK M. Multimodal Interaction: A Review[J]. Pattern Recognition Letters, 2014, 36:189-95.

[25] GAO J, GALLY M, LI L. Neural Approaches to Conversational AI[J]. Foundations and Trends in Information Retrieval, 2019, 13(2-3): 127-298.

[26] 宝德仪器. BDFIA-8600/C全自动流动注射分析仪[EB/OL]. (2021-01-11)[2023-07-20]. https://www.bjbaode. com/product1/304.html. Baode Instrument. BDFIA-8600/C Automatic Flow Injection Analyzer[EB/OL](2021-01-11)[2023-07-20]. https:// www.bjbaode.com/product1/304.html.

Intent-driven Interface Interaction Paradigm under Generative Artificial Intelligence Technology

LIU Yulei1, MA Yanyang2*

(1. Sichuan Normal University, Chengdu 610101, China; 2. Sichuan Agricultural University, Chengdu 611130, China)

The work aims to sort out and analyze the interface interaction paradigm empowered by generative artificial intelligence technology. Starting from typical interface paradigms, including WIMP paradigm, Non-WIMP paradigm, Post-WIMP paradigm, etc., the development, characteristics and limitations of various types of interface paradigms were analyzed, and then based on the new interactive characteristics brought by generative artificial intelligence technology, the promotion, impact and changes of generative artificial intelligence technology on the paradigm shift of interface interaction were explored. One kind of intent-driven IDIM paradigm for generative artificial intelligence applications was proposed, which included several elements: Intent Domain, Dialogue Flow, Interactive Inspiration, and Multimodal Interaction. Generative artificial intelligence technology, with its powerful generation ability and intelligent characteristics, has brought unprecedented opportunities and challenges to the field of interaction. It has not only brought changes to the interface interaction paradigm, but also promoted the transformation of interaction design to a more intelligent and personalized multi-interaction mode. The IDIM paradigm provides a new interface interaction paradigm reference, which plays a positive role in improving interaction theory and promoting the application development of generative artificial intelligence.

generative artificial intelligence; user interface; interaction paradigm; paradigm shift

TB472

A

1001-3563(2024)04-0058-09

10.19554/j.cnki.1001-3563.2024.04.006

2023-09-05

教育部人文社科青年基金项目(23YJC760078);四川省高校哲学社会科学重点研究基地工业设计产业研究中心课题(GYSJ2022-03);四川师范大学校级实验设备科研项目(SYJS2021027);四川师范大学校级自然科学类科研基金项目(xj2022122413)